Schlüsselwörter:OpenAI DevDay 2025, ChatGPT-Anwendungsplattform, AgentKit, KI-Agenten-Entwicklung, GPT-5 Pro, Sora 2, CodeMender, Kontinuierliche Denkmaschine, ChatGPT Apps SDK, Agent Builder visueller Konstruktor, GPT-Realtime-Mini Sprachmodell, Gemini Deep Think Technologie, CTM Neurodynamik

🔥 FOKUS

OpenAI DevDay 2025: ChatGPT wird zur Anwendungsplattform, AgentKit ermöglicht die Entwicklung von intelligenten Agenten : OpenAI hat auf der jährlichen Entwicklerkonferenz 2025 mehrere wichtige Fortschritte bekannt gegeben. Es wurde verkündet, dass ChatGPT 800 Millionen wöchentlich aktive Nutzer hat und die API über 6 Milliarden Token pro Minute verarbeitet. Zu den Kernankündigungen gehört das Apps SDK, das Entwicklern ermöglicht, voll funktionsfähige Anwendungen innerhalb von ChatGPT zu erstellen und auszuführen, wodurch ChatGPT zu einem neuen Betriebssystem wird. Gleichzeitig wurde AgentKit eingeführt, das Agent Builder (ein visueller Builder), ChatKit (eine anpassbare Chat-UI), Guardrails (ein Sicherheitsmodul) und Evals (Bewertungstools) umfasst und die Entwicklung von AI-Agenten erheblich vereinfacht. Darüber hinaus wurden GPT-5 Pro, die Sora 2/2 Pro Video-Generierungs-API und das GPT-Realtime-Mini Sprachmodell gleichzeitig veröffentlicht, das Programmiertool Codex ist nun allgemein verfügbar und es wurden neue SDKs und Unternehmensfunktionen hinzugefügt. Diese Updates deuten auf eine tiefe Integration und schnelle Expansion des AI-Anwendungsökosystems hin, die das Entwickler-Ökosystem und die Benutzererfahrung tiefgreifend beeinflussen wird.

(Quelle: dotey, jerryjliu0, gdb, Yuchenj_UW, swyx, kevinweil, scaling01, scaling01, gdb, scaling01, scaling01, swyx, scaling01, gdb, gdb, op7418, TheRundownAI, OpenAIDevs, nickaturley, reach_vb, snsf, dotey, edwin)

Google DeepMind stellt CodeMender vor: AI repariert Software-Schwachstellen automatisch : Google DeepMind hat CodeMender veröffentlicht, einen AI-Agenten, der die Gemini Deep Think Technologie nutzt, um kritische Software-Schwachstellen automatisch zu beheben. Der Agent hat erfolgreich 72 hochwertige Korrekturen an beliebte Codebasen übermittelt, die von den Maintainern akzeptiert und übernommen wurden. Die Einführung von CodeMender markiert einen wichtigen Durchbruch der AI im Bereich der Softwaresicherheit und wird voraussichtlich die Zeit, die Entwickler für die Suche und Behebung von Schwachstellen benötigen, erheblich reduzieren und die Sicherheit der Software-Lieferkette verbessern.

(Quelle: Google, GoogleDeepMind)

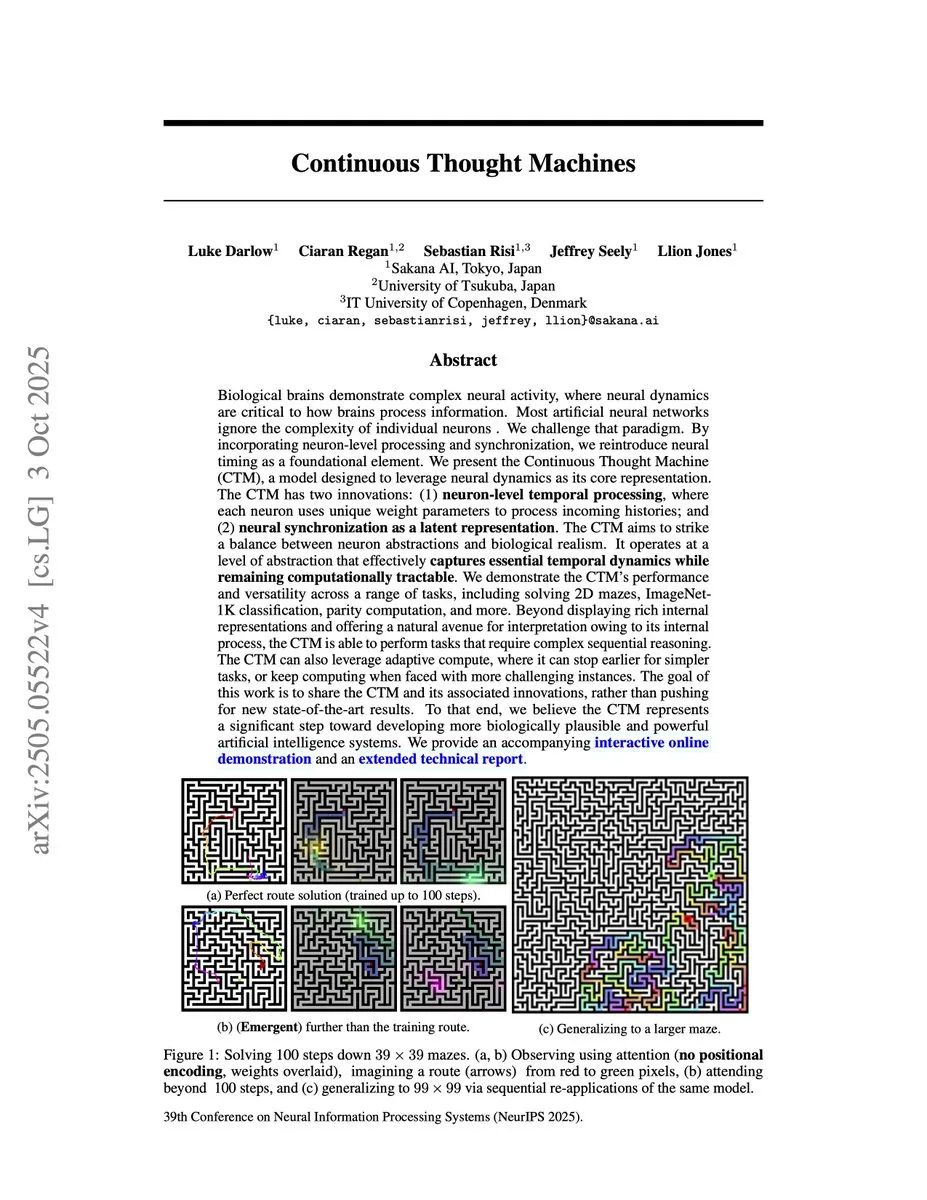

Sakana AI’s „Continuous Thought Machines“ (CTM) als Spotlight-Paper für NeurIPS 2025 angenommen : Sakana AI hat bekannt gegeben, dass ihre „Continuous Thought Machines“ (CTM) als Spotlight-Paper für NeurIPS 2025 angenommen wurden. CTM ist eine AI, die das biologische Gehirn imitiert und neurodynamische sowie synchronisierende Mechanismen nutzt, um über die Zeit nachzudenken. Sie ist in der Lage, komplexe Labyrinthe durch den Aufbau interner Karten zu lösen, Bilder durch Fixierung zu klassifizieren und Algorithmen zu lernen. Dieses bahnbrechende Design zeigt das Potenzial der AI, biologische Intelligenz zu imitieren und komplexe Probleme zu lösen, und deutet darauf hin, dass zukünftige AI-Systeme möglicherweise stärkere emergente Fähigkeiten besitzen werden.

(Quelle: hardmaru, hardmaru)

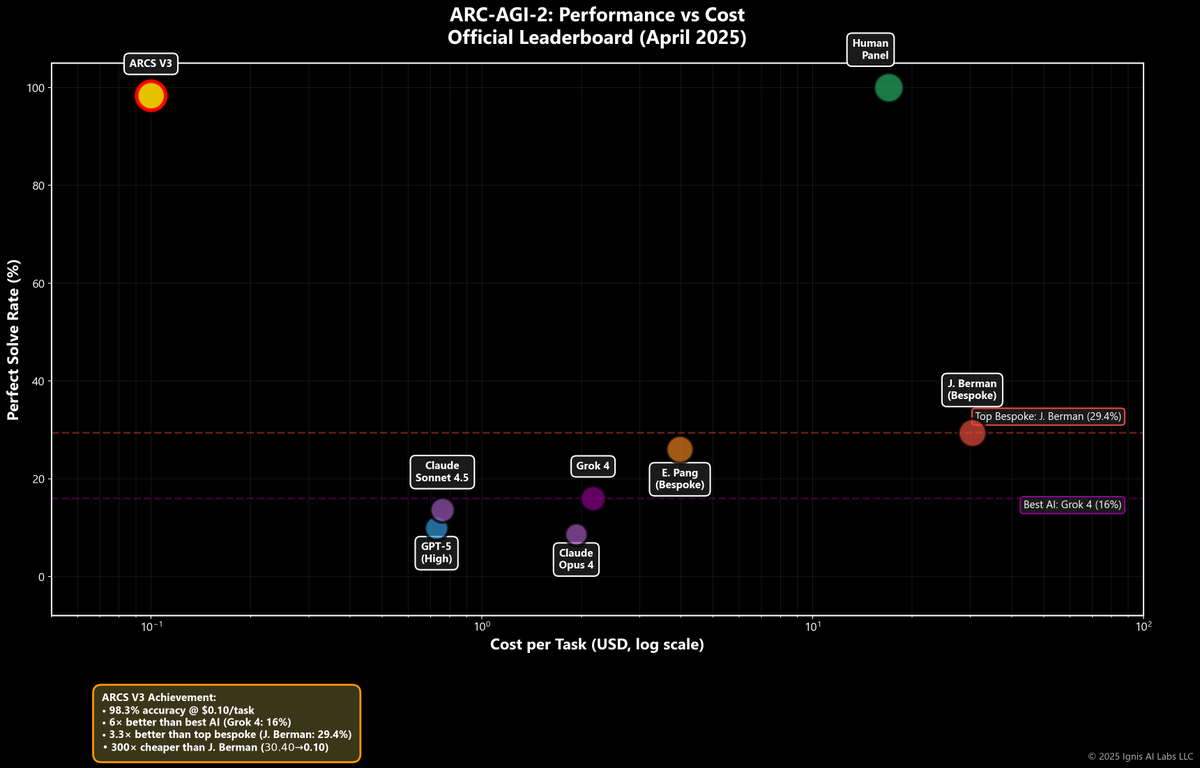

ARCS V3 erreicht einen Durchbruch im abstrakten Denken mit extrem wenigen Parametern : ARCS V3 erreichte eine Genauigkeit von 90-98% im ARC-AGI-2 Benchmark mit nur 19,9 Millionen Parametern, was 88.442-mal kleiner ist als GPT-4, und ohne die Transformer-Architektur zu verwenden. Dieses Ergebnis stellt die Abhängigkeit der Branche von großen Modellen in Frage und beweist, dass bei Aufgaben des abstrakten Denkens durch innovatives Architekturdesign und innovative Methoden eine hervorragende Leistung mit extrem geringer Parameterzahl erzielt werden kann. Das Forschungsteam betont, dass dieser Durchbruch echte Denkfähigkeiten und nicht nur Gedächtnis darstellt, und liefert umfassende Validierungsprotokolle und Demo-Videos.

(Quelle: weights_biases)

Equilibrium Matching (EqM) vereinfacht und übertrifft Flow Matching, verbessert die Generierungsleistung : Yilun Du und Kollegen haben die Forschung zu Equilibrium Matching (EqM) vorgestellt. Diese Methode vereinfacht und übertrifft Flow Matching und erreichte einen FID-Score von 1,96 auf ImageNet 256×256, was eine starke Generierungsleistung zeigt. EqM erreicht einen einfachen gradientenbasierten Generierungsprozess, indem es eine einzelne statische EBM (Energy-Based Model)-Landschaft für die Generierung lernt. Dieser Fortschritt bietet eine effizientere und leistungsstärkere Alternative für generative Modelle.

(Quelle: VictorKaiWang1)

🎯 TRENDS

OpenAI arbeitet mit AMD zusammen, um MI450 GPUs zu implementieren und den Aufbau der AI-Infrastruktur zu beschleunigen : OpenAI hat eine milliardenschwere Partnerschaft mit AMD bekannt gegeben, um ab nächstem Jahr 6 Gigawatt AMD Instinct MI450 GPUs einzusetzen, um dem wachsenden Bedarf an AI-Rechenleistung gerecht zu werden. Diese Zusammenarbeit wird den Aufbau der globalen AI-Infrastruktur erheblich beschleunigen, den Nutzern von OpenAI mehr Rechenressourcen zur Verfügung stellen und gleichzeitig AMD beträchtliche Einnahmen bescheren, was eine Win-Win-Situation für beide Seiten darstellt.

(Quelle: dejavucoder, jachiam0)

Google AI Pro Programm bietet Studenten kostenloses Upgrade : Google hat angekündigt, dass Studenten ein kostenloses einjähriges Upgrade auf das Google AI Pro Programm erhalten können. Das Programm umfasst Gemini, NotebookLM und 2TB Speicherplatz und soll Studenten helfen, Hausaufgaben zu erledigen, komplexe Konzepte zu verstehen, Lernhilfen zu erstellen und ihre Schreibfähigkeiten zu verbessern. Dieser Schritt wird voraussichtlich die Verbreitung von AI-Tools im Bildungsbereich fördern und Studenten beim Lernen und Forschen unterstützen.

(Quelle: Google)

Microsoft Copilot aktualisiert die Speicherfunktion, unterstützt „Vergessen“- und „Erinnern“-Befehle : Microsoft Copilot hat seine Speicherfunktion aktualisiert und kann nun bestimmte Informationen auf Befehl des Benutzers „merken“ oder „vergessen“. Benutzer können den Speicher von Copilot in den Einstellungen verwalten, um sicherzustellen, dass die AI bei der Unterstützung präziser auf individuelle Bedürfnisse reagiert und unnötige Informationsspeicherung vermieden wird. Dieses Update erhöht die Flexibilität des AI-Assistenten in Bezug auf Datenschutz und Benutzererfahrung.

(Quelle: mustafasuleyman)

LlamaParse unterstützt jetzt Anthropic Claude Sonnet 4.5, verbessert die Dokumentenverarbeitungsfähigkeiten : LlamaParse hat die Integration des Claude Sonnet 4.5 Modells von Anthropic bekannt gegeben, was den Benutzern leistungsfähigere Fähigkeiten zur Dokumentenverständnis und -analyse bietet. Dieses Update wird die Genauigkeit und Effizienz von LlamaParse bei der Verarbeitung komplexer Dokumente verbessern und kündigt die Veröffentlichung detaillierter Benchmark-Ergebnisse von Sonnet 4.5 im Vergleich zu bestehenden Parsing-Optionen an, um dessen Leistungsvorteile zu demonstrieren.

(Quelle: jerryjliu0)

HuggingFace Inference Endpoints unterstützen jetzt Nvidia B200 GPU : HuggingFace hat bekannt gegeben, dass seine Inference Endpoints nun Nvidia B200 GPUs unterstützen. Dieses Upgrade bietet Entwicklern eine leistungsfähigere Rechenkapazität, um große AI-Modelle auszuführen und bereitzustellen und den ständig wachsenden Rechenanforderungen gerecht zu werden. Dieser Schritt wird die Anwendung und Innovation von AI-Modellen weiter vorantreiben und die Hürden für Hochleistungs-AI senken.

(Quelle: weights_biases)