Schlüsselwörter:GPT-5 Pro, KI-Medikamentenentwicklung, KI-Agent, LLM, Tiefes Lernen, KI-Sicherheit, Multimodale KI, KI-Hardwarebeschleunigung, NICD-mit-Löschungen-Gegenbeispiel, LoRA-Feinabstimmung VRAM-Optimierung, KI-Videogenerierung Sora 2, OpenWebUI-Modellberechtigungsverwaltung, KI-Speicherkostenreduzierung um 65%

🔥 Fokus

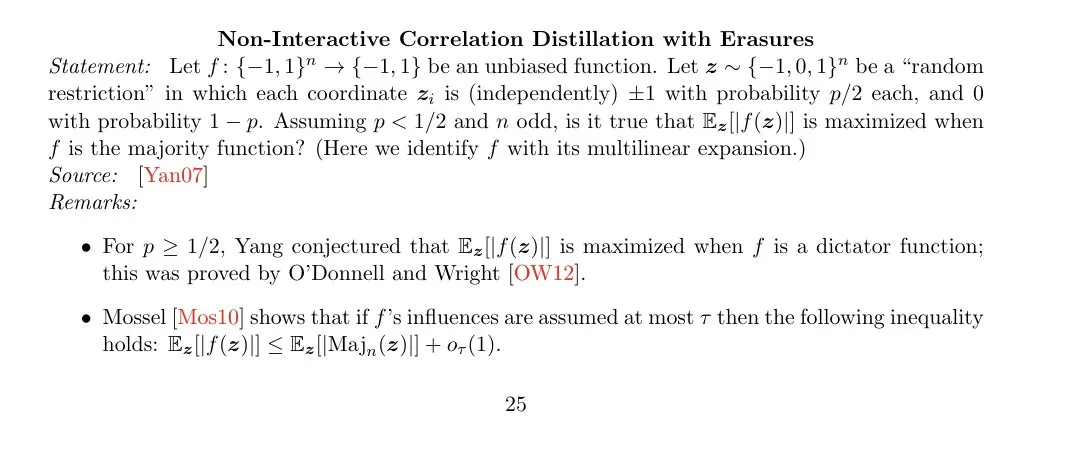

Mathematischer Durchbruch von GPT-5 Pro : GPT-5 Pro hat im Bereich der Mathematik einen bedeutenden Fortschritt erzielt, indem es erfolgreich ein Gegenbeispiel für das NICD-with-erasures Mehrheitsoptimalitätsproblem (Simons-Liste, Seite 25) gefunden hat. Diese Entdeckung zeigt, dass GPT-5 Pro ein neues Niveau im komplexen mathematischen Denken erreicht hat und bestehende mathematische Theorien herausfordern kann. Dies deutet auf das enorme Potenzial von AI in der originären mathematischen Forschung hin und könnte die Akzeptanz von AI-gestützten Beweisen in der Mathematikgemeinschaft fördern. (Quelle: SebastienBubeck, BlackHC, hyhieu226, JimDMiller)

AI beschleunigt die Entwicklung neuer Antibiotika : Der Wirkmechanismus eines neuen Antibiotikums gegen entzündliche Darmerkrankungen (IBD) wurde vor Humanstudien erfolgreich von AI vorhergesagt und von Wissenschaftlern bestätigt. Dieser bahnbrechende Fortschritt demonstriert das enorme Potenzial von AI bei der Beschleunigung der Arzneimittelentdeckung und im Gesundheitswesen. Es wird erwartet, dass der Entwicklungszyklus neuer Medikamente verkürzt wird, um Patienten schnellere Behandlungsoptionen zu bieten. Humanstudien sollen voraussichtlich innerhalb von drei Jahren beginnen. (Quelle: Reddit r/ArtificialInteligence)

🎯 Trends

AI+XR Echtzeit-Videokonvertierung : Decart XR nutzt WebRTC, um Echtzeit-Kamerabilder von MetaQuest an ein AI-Modell zu übertragen und so eine Echtzeit-Videokonvertierung zu ermöglichen. Diese Technologie zeigt innovative Anwendungen von AI im Bereich der erweiterten Realität und verspricht den Nutzern ein immersives, dynamisch interaktives und völlig neues visuelles Erlebnis, insbesondere mit großem Potenzial in den Bereichen Gaming, virtuelle Zusammenarbeit und kreative Inhaltserstellung. (Quelle: gfodor)

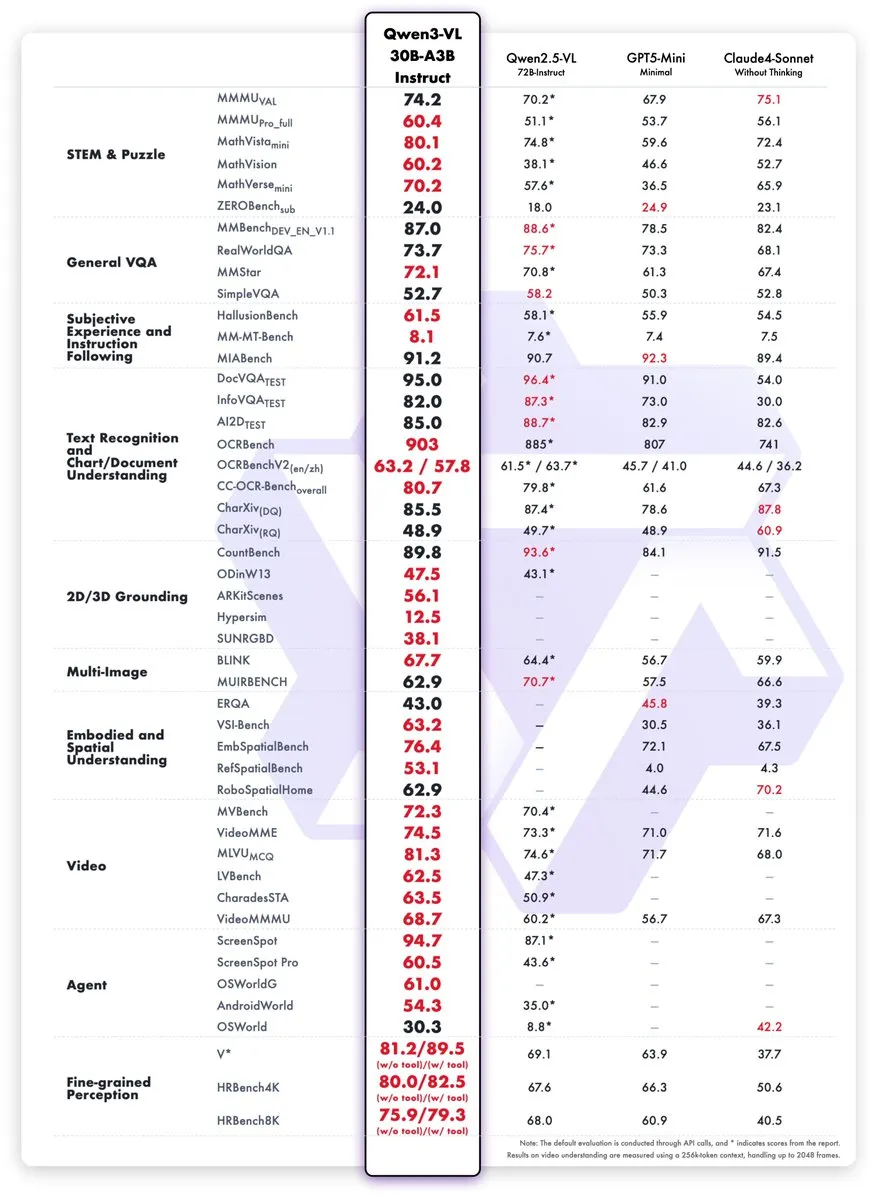

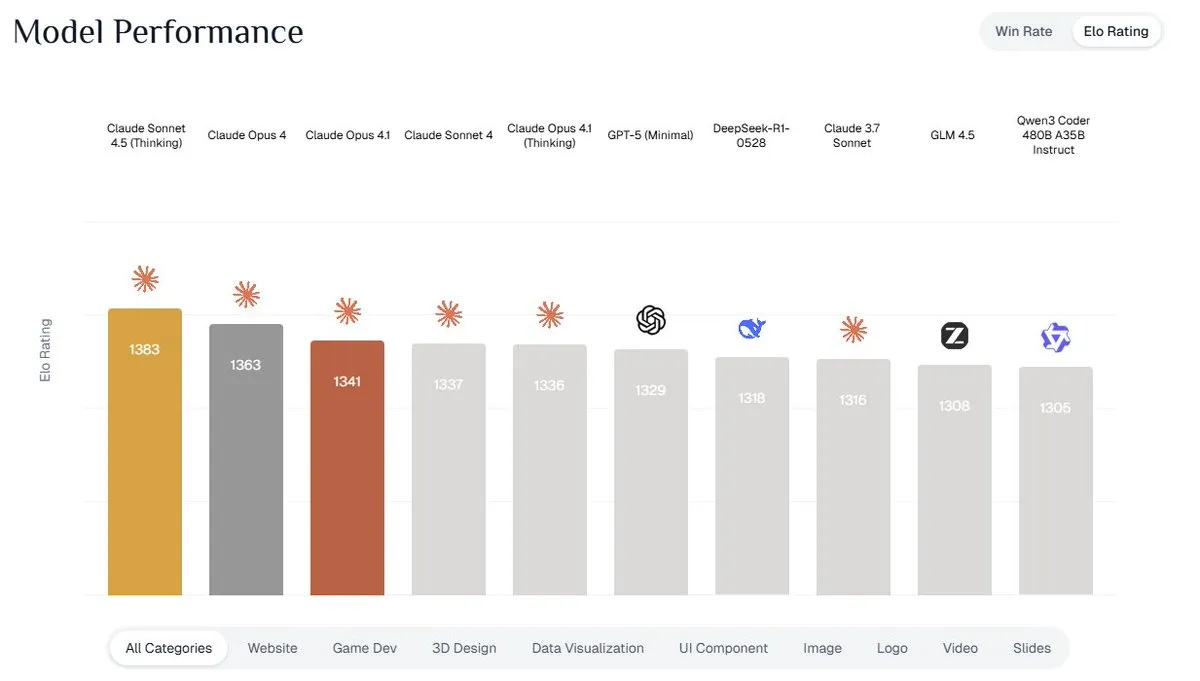

Veröffentlichung mehrerer neuer LLM : DeepSeek-V3.2-Exp verbessert die Langkontext-Inferenz und Code-Effizienz durch einen Sparse-Attention-Mechanismus; GLM 4.6 wurde erheblich aufgerüstet und verbessert die praktischen Fähigkeiten in den Bereichen Codierung, Inferenz und Schreiben; das Qwen3 VL 30B A3B Modell zeigt herausragende Leistungen im visuellen Denken und in der Wahrnehmung. Die Einführung dieser neuen Modelle deutet auf kontinuierliche Fortschritte bei LLM in Bezug auf Multimodalität, Langkontextverarbeitung und Code-Effizienz hin. (Quelle: yupp_ai, huggingface, Reddit r/LocalLLaMA)

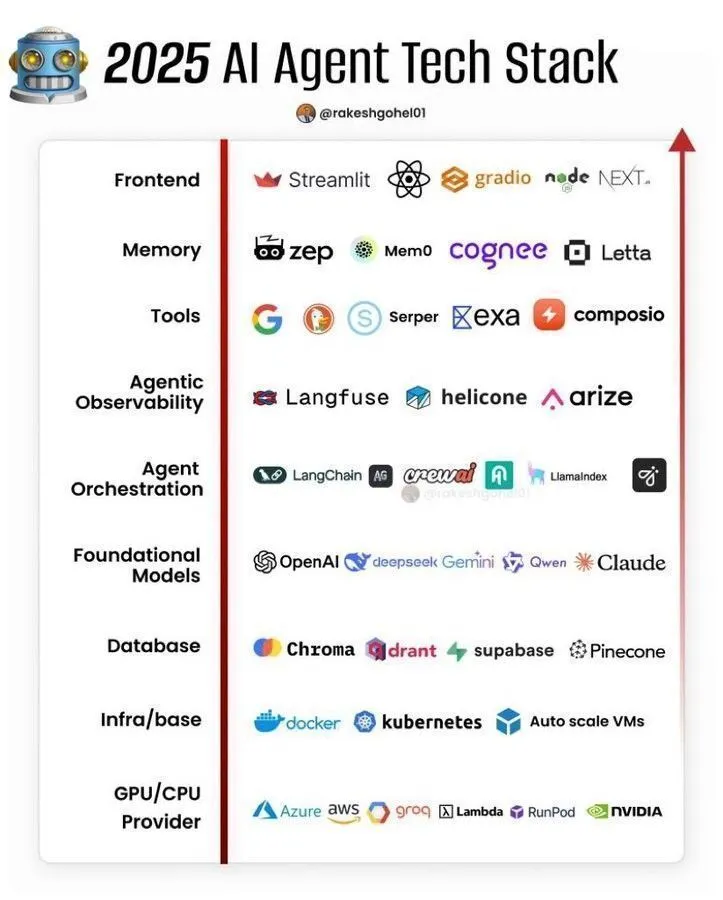

AI Agents Technologie-Stack und Architektur : Der AI Agent Technologie-Stack und seine praktische Architektur entwickeln sich 2025 rasant weiter und umfassen alles von grundlegenden Bausteinen bis hin zu fortgeschrittenen Bereitstellungsmodellen. Die Diskussionen konzentrieren sich darauf, wie effiziente, skalierbare AI Agent-Systeme für komplexe Aufgaben entworfen werden können, was auf eine zunehmende Reife von AI Agents in praktischen Anwendungen hindeutet. (Quelle: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Verbreitung von AI im Bildungsbereich : Ein Unternehmer ohne Programmierkenntnisse hat mit AI-Technologie einen AI-Tutor für das jordanische Bildungsministerium entwickelt und dabei erfolgreich 10 Millionen US-Dollar eingespart. Dies unterstreicht das enorme Potenzial von AI, Bildungsinstitutionen zu entlasten und die Zugänglichkeit von Bildung zu verbessern, selbst für Nicht-Spezialisten, die AI zur Lösung praktischer Probleme nutzen können. (Quelle: amasad)

AI-Speicherkostenoptimierungslösungen : CoreWeave schlägt vor, AI-Datenspeicherstrategien zu optimieren, um die AI-Speicherkosten um bis zu 65% zu senken, ohne die Innovationsgeschwindigkeit zu beeinträchtigen. Durch Technologien wie Memory Snapshots, granulare Abrechnung und Multi-Cloud-Scheduling können Plattformen wie Modal die GPU-Kosten bei der Verarbeitung von Spitzenlasten im Inferenzbereich im Vergleich zu traditionellen Cloud-Diensten wie Azure erheblich senken. (Quelle: TheTuringPost, TheTuringPost, Reddit r/deeplearning)

AI+VR unterstützt die psychische Gesundheit : Die Kombination von Virtual Reality (VR) und Künstlicher Intelligenz (AI) verspricht, die Behandlung psychischer Erkrankungen zu verbessern. Durch immersive Erlebnisse und personalisierte Interventionen kann die AI+VR-Technologie der nächsten Generation eine empathischere und verbundenere Wachstumsumgebung bieten und innovative Lösungen für den Bereich der psychischen Gesundheit schaffen. (Quelle: Ronald_vanLoon, Ronald_vanLoon)

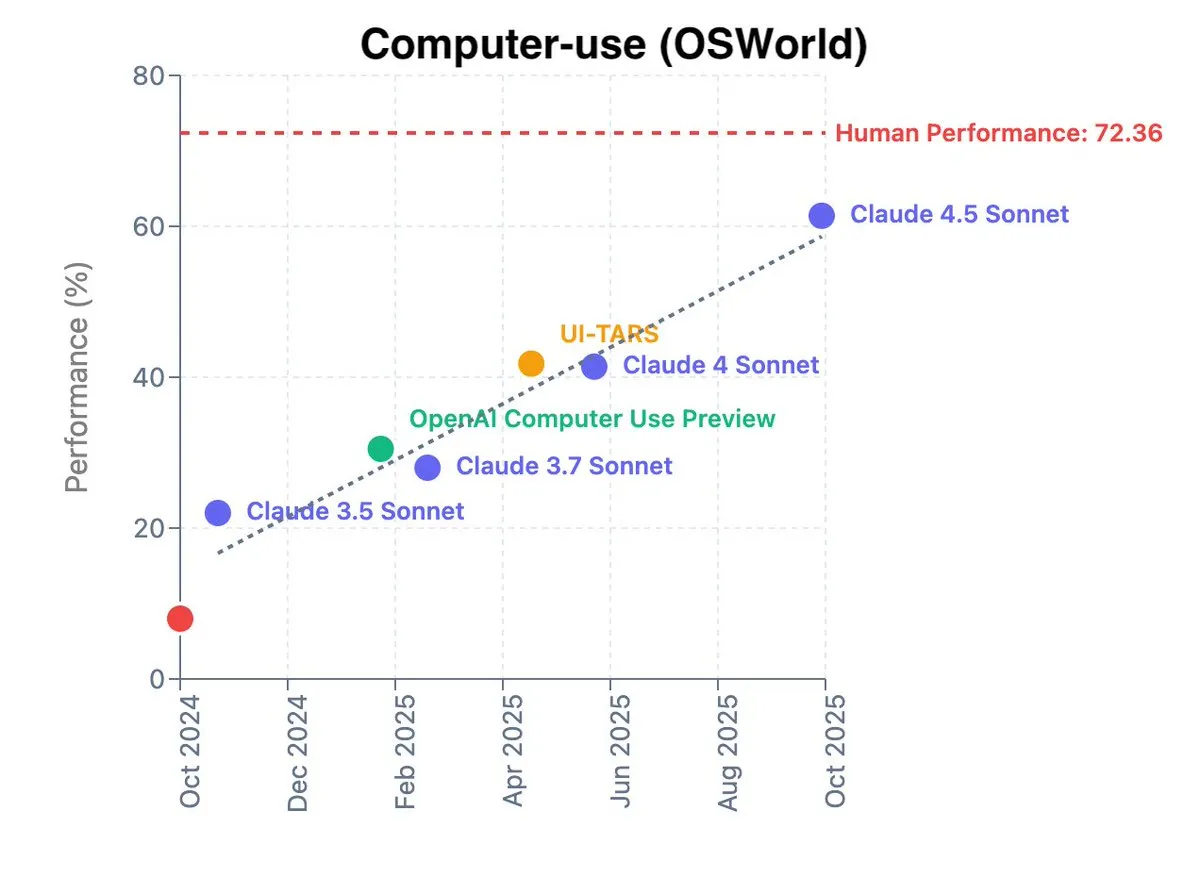

AI beschleunigt wissenschaftliche Entdeckungen : Das Anthropic-Team arbeitet daran, die Effizienz der Computernutzung durch AI zu verbessern und so den Prozess wissenschaftlicher Entdeckungen zu beschleunigen. Derzeit hat sich die Leistung von End-to-End-Grundlagenmodellen auf OSWorld von 8% vor einem Jahr auf 61% verbessert, was nahe am menschlichen Niveau von 72% liegt. Dies deutet darauf hin, dass AI eine immer wichtigere Rolle in der wissenschaftlichen Forschung spielen wird. (Quelle: oh_that_hat, dilipkay)

OpenAI und Jony Ive entwickeln Gerät : OpenAI arbeitet mit Jony Ive an der Entwicklung eines handlichen, bildschirmlosen AI-Assistenten, der 2026 auf den Markt kommen soll. Das Projekt steht jedoch vor technischen Herausforderungen in Bezug auf Kernsoftware, Datenschutz und Rechenleistung, die zu Verzögerungen führen könnten. Das Gerät soll über Mikrofone, Kameras und Lautsprecher die Umgebung wahrnehmen und stets online sein. (Quelle: swyx, Reddit r/artificial)

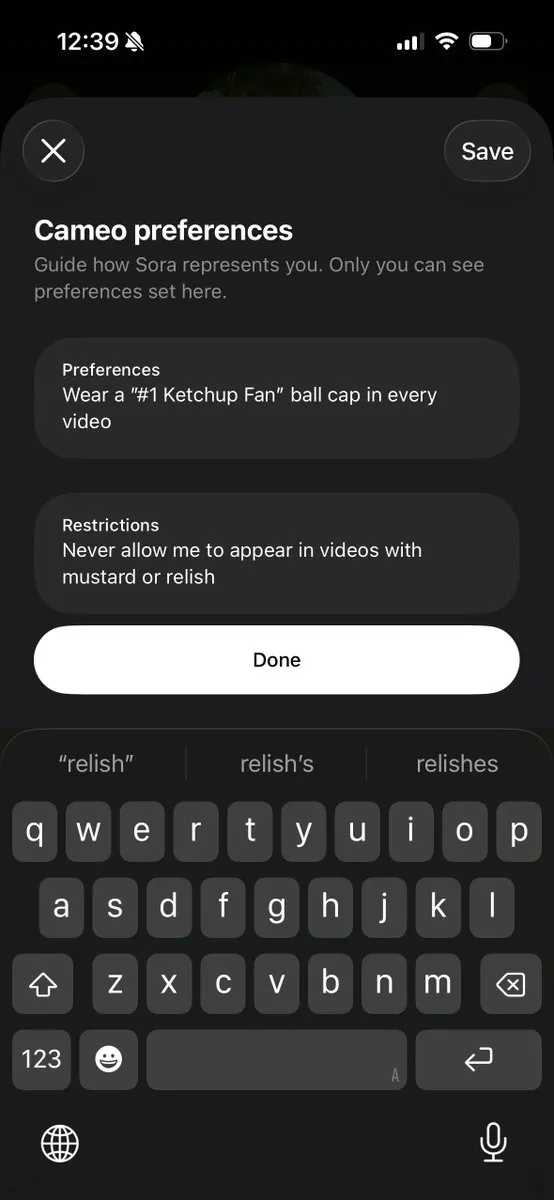

Sora Updates und Sicherheitsverbesserungen : Das Sora-Videogenerierungsmodell von OpenAI hat ein Update erhalten, das eine benutzerdefinierte „Gastauftrittsbeschränkung“ einführt. Diese Funktion ermöglicht es Kreatoren, die Verwendung ihres Bildes zu kontrollieren, z.B. die Nutzung für politische Kommentare oder bestimmte Wörter zu verbieten. Darüber hinaus umfasst das Update klarer sichtbare Wasserzeichen und eine verbesserte Modellsicherheit, um Fehlalarme zu reduzieren und Schwachstellen zu schließen. (Quelle: billpeeb, billpeeb, sama)

Herausforderungen der AI-Anwendung im Militärbereich : Die US-Luftwaffe testet AI-Technologien, um auf Chinas Fortschritte bei AI-Drohnen zu reagieren. Ein pensionierter US-Generalleutnant weist darauf hin, dass die US-Armee im Falle eines Krieges mit China eine Tötungsrate von 10:1 oder sogar 20:1 erreichen müsste, um die Lage zu halten, und die aktuellen Kriegsspielsimulationen nicht optimistisch sind. Dies unterstreicht die entscheidende Rolle von AI in der Militärstrategie und die Dringlichkeit des Wettbewerbs. (Quelle: Reddit r/ArtificialInteligence)

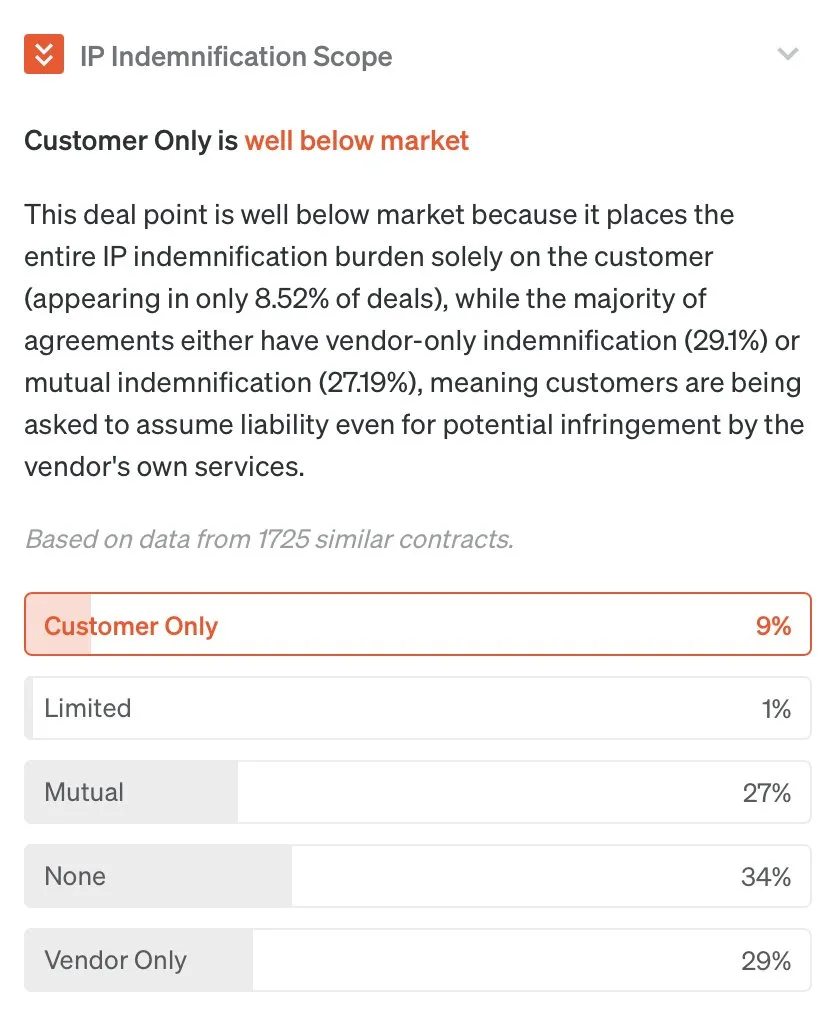

AI revolutioniert Vertragsverhandlungen im Rechtsbereich : Das Zeitalter der datengesteuerten Vertragsverhandlungen ist angebrochen. AI wird Marktdaten für alle transparent machen und das traditionelle Informationsmonopol großer Anwaltskanzleien brechen. Diese Technologie verspricht, die Effizienz und Fairness von Vertragsverhandlungen zu erhöhen und mehr Unternehmen und Einzelpersonen zu stärken. (Quelle: scottastevenson)

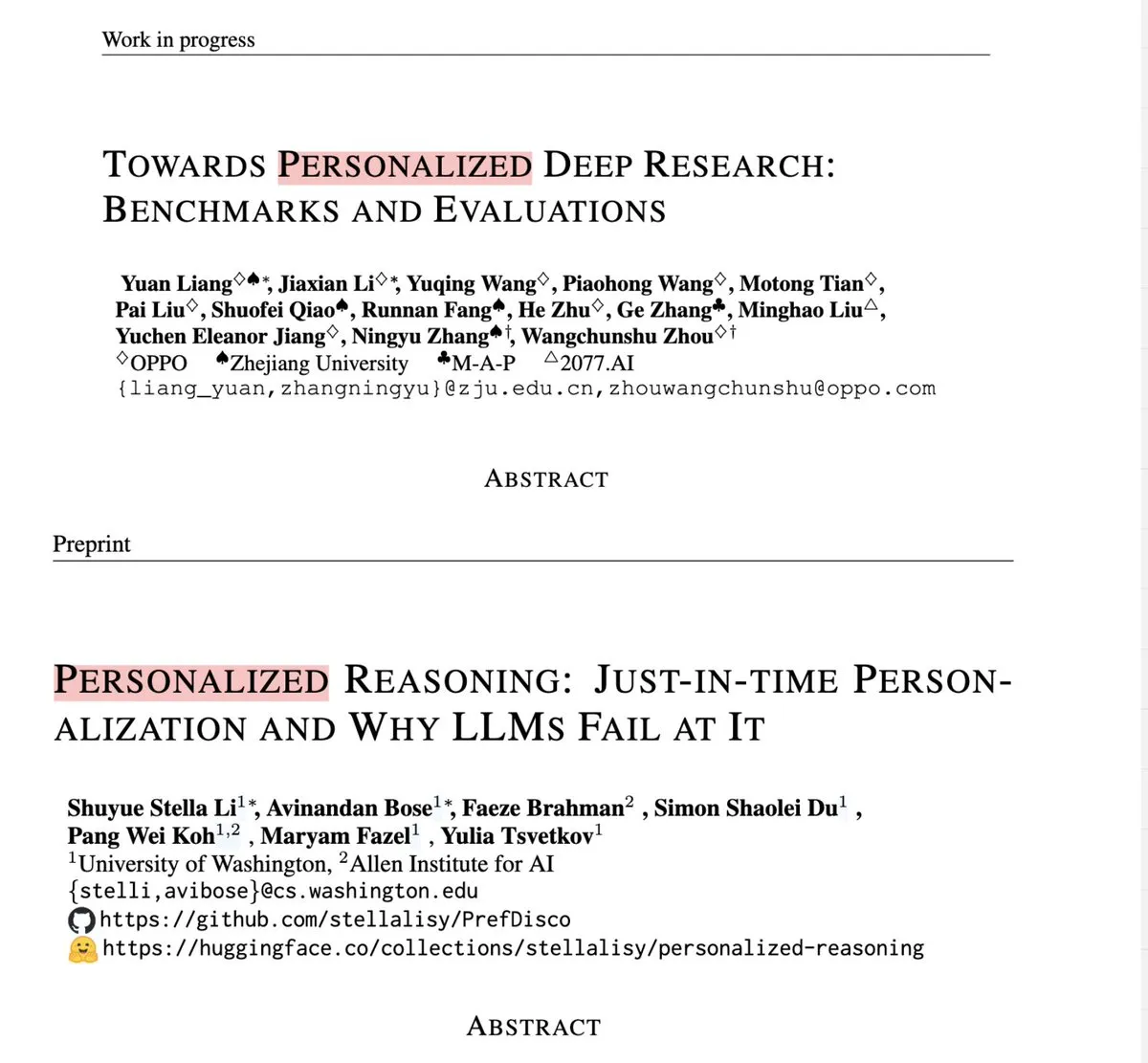

Verbesserung der Personalisierungsfähigkeiten von LLM : Die Entwicklung von LLM geht über reine Benchmark-Tests hinaus; entscheidend ist, wie Modelle Benutzer verstehen und personalisierte Dienste anbieten. Forschungsarbeiten wie PREFDISCO und PDR Bench konzentrieren sich auf die Personalisierung in der sofortigen Inferenz und in langfristigen Tiefenstudien, um Modelle dazu zu bringen, über Benutzerziele, Präferenzen und Einschränkungen nachzudenken und zu handeln, anstatt nur den Ton anzupassen. (Quelle: dotey)

Status des offenen Modell-Ökosystems : Eine Diskussion über den aktuellen Stand offener Modelle, die den Aufstieg des chinesischen AI-Ökosystems, den Einfluss von DeepSeek, den Rückgang von Llama-Modellen sowie die Zukunft des US-Marktes und lokaler Modelle umfasst. Dies spiegelt die dynamische Wettbewerbslandschaft zwischen Open-Source- und Closed-Source-AI-Modellen wider. (Quelle: charles_irl)

ByteDance Technologie zur Generierung langer Videos : ByteDance hat die „Self-Forcing++“-Methode vorgestellt, die hochwertige Videos von bis zu 4 Minuten und 15 Sekunden Länge generieren kann. Dies geschieht durch die Erweiterung von Diffusionsmodellen, ohne dass lange Videotrainingsdaten oder ein erneutes Training erforderlich sind, wobei die Wiedergabetreue und Konsistenz des Videos erhalten bleiben. (Quelle: NerdyRodent)

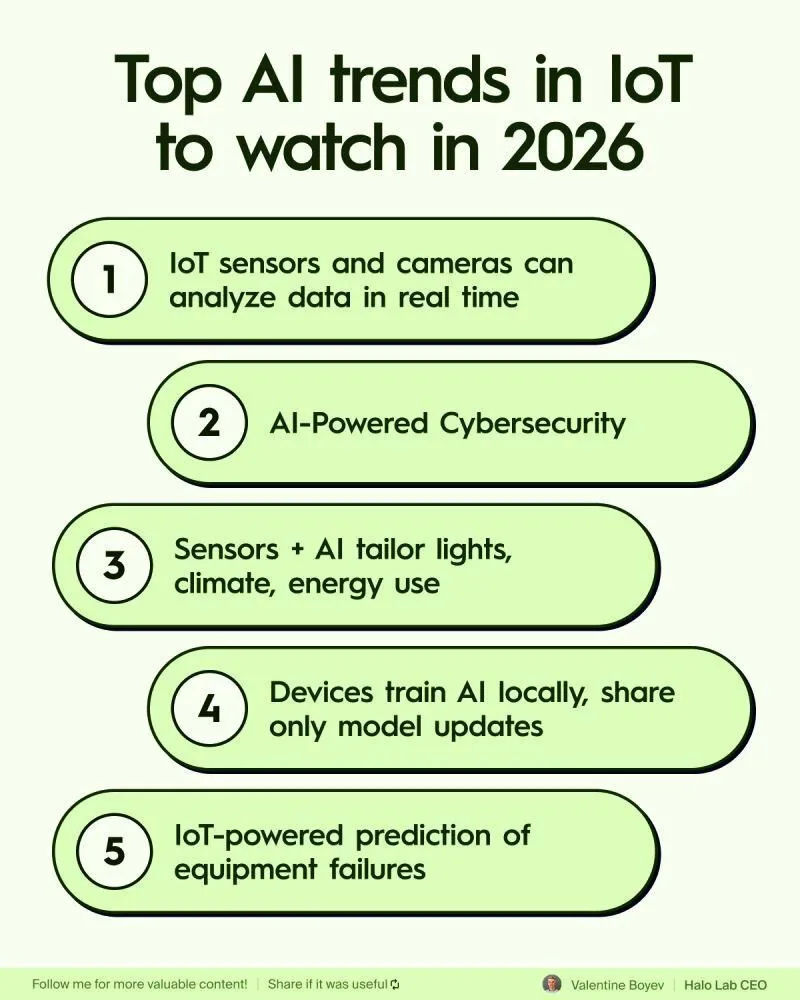

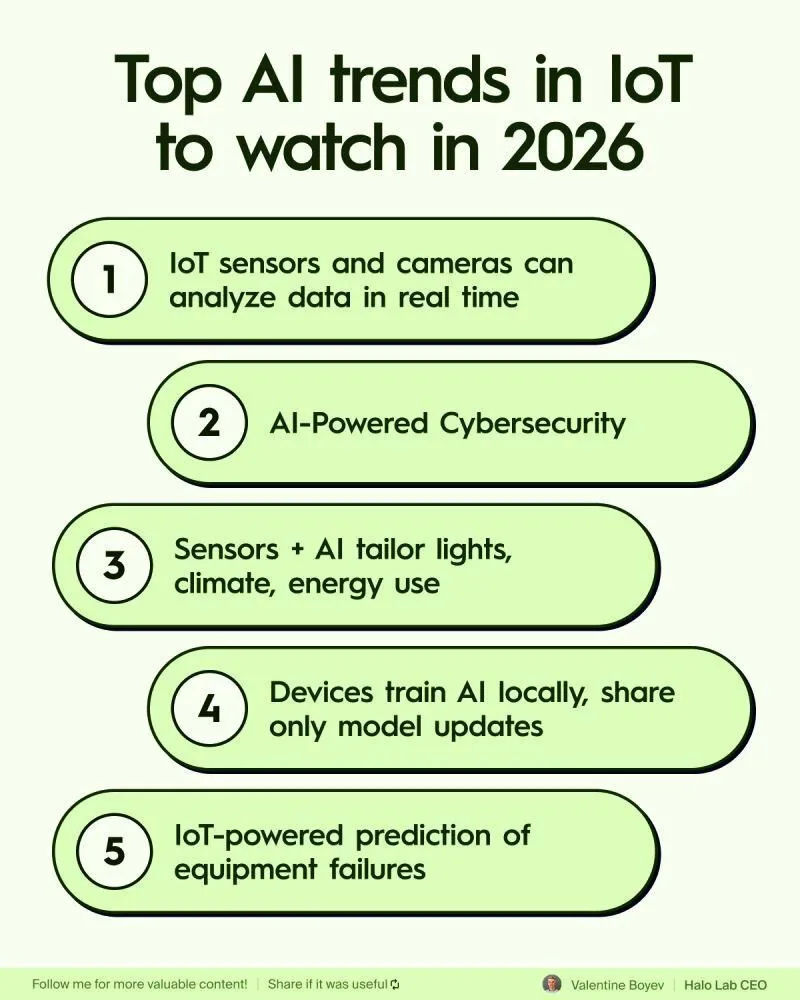

Trends von AI im Internet der Dinge (IoT) : Zehn wichtige Trends für AI im Bereich des Internets der Dinge (IoT) im Jahr 2026 sind bemerkenswert und deuten auf eine tiefe Integration von AI und IoT hin, die intelligentere und effizientere Geräte und Anwendungen hervorbringen wird. (Quelle: Ronald_vanLoon)

KI-gesteuerte Arbeitsplatzkultur : AI wird zu einer wichtigen Kraft, die den Wandel der Arbeitsplatzkultur vorantreibt. Ihre Anwendung steigert nicht nur die Effizienz, sondern prägt auch die Kultur in Bezug auf Teamzusammenarbeit, Entscheidungsfindung und Mitarbeiterentwicklung neu. (Quelle: Ronald_vanLoon)

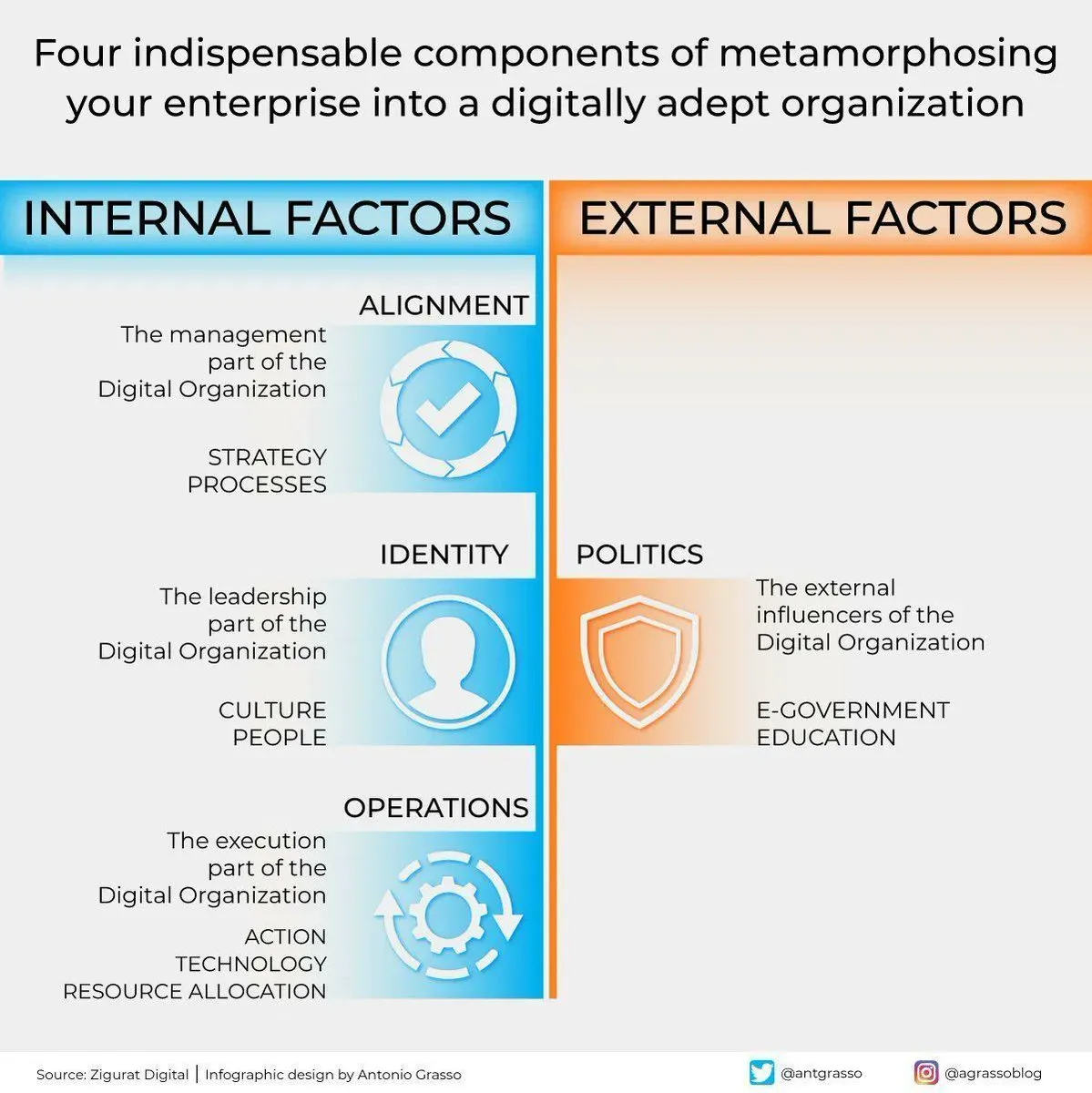

Vier Schlüsselelemente der digitalen Transformation : Eine Diskussion über die vier unverzichtbaren Bestandteile der Transformation von Unternehmen zu digitalen Organisationen, wobei die entscheidende Rolle von Innovation, Technologie und AI hervorgehoben wird. (Quelle: Ronald_vanLoon)

KI-gesteuerte Prothesentechnologie : Ein 17-jähriger Jugendlicher hat mit AI-Technologie eine gedankengesteuerte Prothesenhand entwickelt, was das enorme Potenzial von AI in der Assistenztechnologie und zur Verbesserung der menschlichen Lebensqualität demonstriert. (Quelle: Ronald_vanLoon)

Fortschritte in der Robotertechnologie : Der Rad-Sprungroboter Cecilia und die leichte bionische taktile Hand demonstrieren die Modularität und fortschrittlichen Funktionen der Roboterhardware. Darüber hinaus hat Yondu AI eine Lösung für die Lagerkommissionierung mit Rad-Humanoiden sowie Lagerroboter, die Paletten durchqueren können, vorgestellt, was die Logistikeffizienz erheblich steigert. (Quelle: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Humanoide Roboter übertreffen menschliche Fähigkeiten : Diskussion über die Möglichkeit, dass humanoide Roboter in Zukunft menschliche Fähigkeiten übertreffen könnten, z.B. indem sie hochkomplexe Aufgaben ausführen, die Menschen nicht oder nur schwer ohne Sicherheitsrisiken bewältigen können, wie das Klettern auf hohe Regale, um Gegenstände zu holen. Dies würde die Anwendungsszenarien der Automatisierung erheblich erweitern. (Quelle: EERandomness)

KI-Physiker und grundlegende Modelle der Quantenmechanik : Es wird die Ansicht vertreten, dass grundlegende Modelle der Quantenmechanik die nächste Grenze für LLM sein werden und AI-Physiker in der Lage sein werden, neue Materialien zu erfinden. Dies deutet auf bahnbrechende Fortschritte von AI in der Grundlagenforschung hin, insbesondere in der Verschmelzung von Biologie, Chemie und Materialwissenschaften auf Quantenebene. (Quelle: NandoDF)

Sora 2 löst ARC-AGI-Aufgaben : Sora 2 ist bei dem Versuch, ARC-AGI (Abstract Reasoning Context – Artificial General Intelligence)-Aufgaben zu lösen, in der Lage, die richtige Transformationslogik zu erkennen, die Ausführung weist jedoch noch Mängel auf. Dies zeigt Fortschritte bei Videogenerierungsmodellen im Verständnis und der Anwendung abstrakter Schlussfolgerungen, aber es ist noch ein Weg bis zur perfekten Realisierung von AGI. (Quelle: NandoDF)

AI generiert Spielinhalte : Es wird erwartet, dass wir zu unseren Lebzeiten unendlich viele, noch nie dagewesene N64-Spiele spielen können werden. Dies deutet auf eine Revolution der generativen AI bei der Erstellung von Spielinhalten hin, die massive, personalisierte Spielerlebnisse ermöglichen wird. (Quelle: scottastevenson)

OpenAI DevDay steht bevor : OpenAI hat den bevorstehenden DevDay 2025 angekündigt, bei dem Sam Altman eine Keynote-Rede halten und neue Tools und Funktionen vorstellen wird, die Entwicklern beim Aufbau von AI helfen sollen. Dies zeigt, dass OpenAI sich der Stärkung des Entwickler-Ökosystems und der Förderung von AI-Anwendungsinnovationen verschrieben hat. (Quelle: openai, sama)

AI Agent Builder : OpenAI plant, auf dem DevDay den Agent Builder zu veröffentlichen, der es Benutzern ermöglicht, ihre eigenen Agent-Workflows zu erstellen und MCPs, ChatKit-Widgets und andere Tools zu verbinden. Dies wird die Entwicklung und Bereitstellung von AI Agents erheblich vereinfachen und die Verbreitung von Agentic AI fördern. (Quelle: dariusemrani)

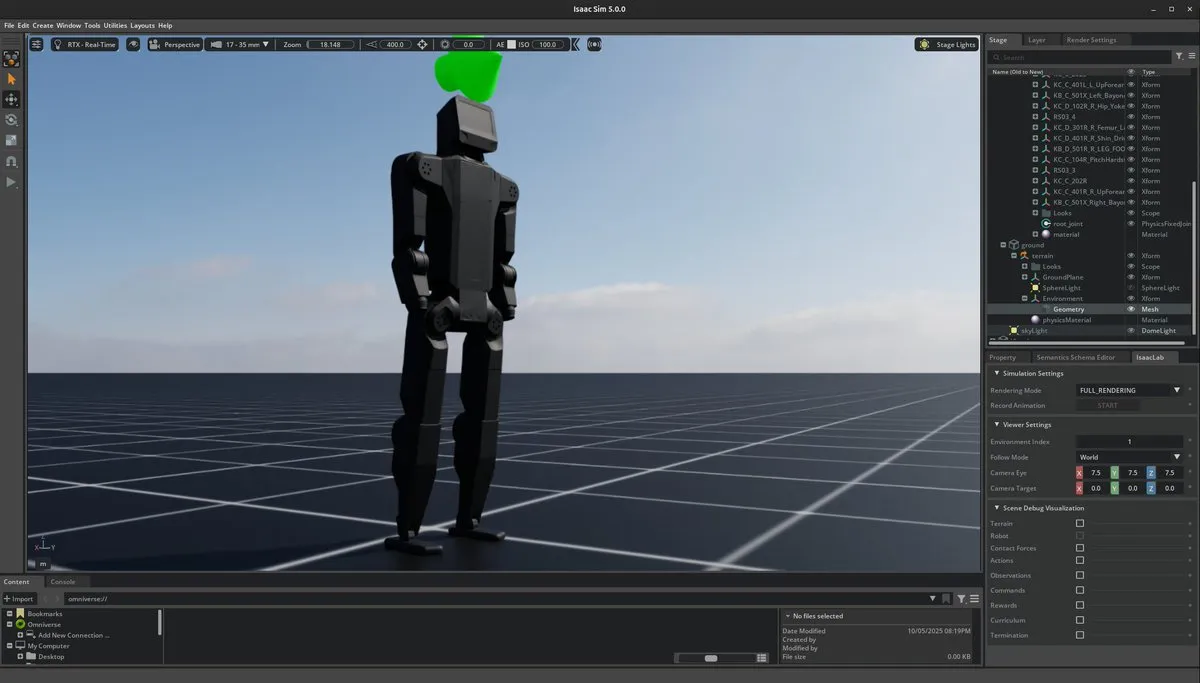

K-bot Trainingsstrategien in Omniverse : Der K-scale K-bot wird auf der NVIDIA Omniverse-Plattform für Strategien trainiert. Omniverse als virtuelle Kollaborations- und Simulationsplattform bietet eine realistische Umgebung für das Training von Roboter-AI und beschleunigt den Lern- und Entwicklungsprozess von Robotern. (Quelle: Sentdex)

Sonnet 4.5 verwendet uv : Es wurde beobachtet, dass Claude Sonnet 4.5 konsistent uv anstelle von python/python3 verwendet. Dies könnte einen aktuellen Trend des Modells im Umweltmanagement und der Abhängigkeitsbehandlung widerspiegeln und deutet darauf hin, dass effizientere, modernere und zukunftsorientierte Entwicklungspraktiken von AI-Modellen übernommen werden. (Quelle: Dorialexander)

Kaliforniens neues AI-Sicherheitsgesetz : Das neu erlassene AI-Sicherheitsgesetz in Kalifornien zeigt, dass Regulierung und Innovation nicht unvereinbar sind, sondern gemeinsam die gesunde Entwicklung der AI-Technologie fördern können. Das Gesetz zielt darauf ab, den schnellen Fortschritt von AI mit potenziellen Risiken in Einklang zu bringen und neue Standards für die Branche zu setzen. (Quelle: Reddit r/artificial)

AI-Anwendungen in der Religion : Die App „Text With Jesus“ ermöglicht es Benutzern, mit AI-generierten biblischen Figuren (einschließlich Maria, Josef und Moses) Nachrichten auszutauschen, was Debatten über die Anwendung von AI im Bereich Religion und Glaube auslöst. (Quelle: aiamblichus)

AI Agent optimiert CRM/ERP : Es wurde über für Agenten optimierte CRM- oder ERP-Systeme diskutiert, wobei autonome Schleifen als Potenzial für ein neues Paradigma in der Unternehmenssoftware hervorgehoben wurden, bei dem Sensoren Geschäftsaktivitäten wahrnehmen, Agenten Beobachtungen analysieren und die besten Maßnahmen bestimmen. (Quelle: TheEthanDing)

Integrationstrends von AI und IoT : Zehn wichtige Trends für AI im Bereich des Internets der Dinge (IoT) im Jahr 2026 sind bemerkenswert und deuten auf eine tiefe Integration von AI und IoT hin, die intelligentere und effizientere Geräte und Anwendungen hervorbringen wird. (Quelle: Ronald_vanLoon)

Ovi-Modell zur kombinierten Audio-Video-Generierung : Das Ovi-Modell (im Veo-3-Stil) kann durch die Fusion von zwei Backbone-Netzwerken synchronisierte 5-Sekunden-Videos mit 24 FPS aus Text- oder Bild-Text-Eingaben generieren. Diese Technologie unterstreicht die Bedeutung der modalitätsübergreifenden Fusion in der Multimediasynthese und geht über traditionelle, separate Audio-Video-Verarbeitungsprozesse hinaus. (Quelle: _akhaliq)

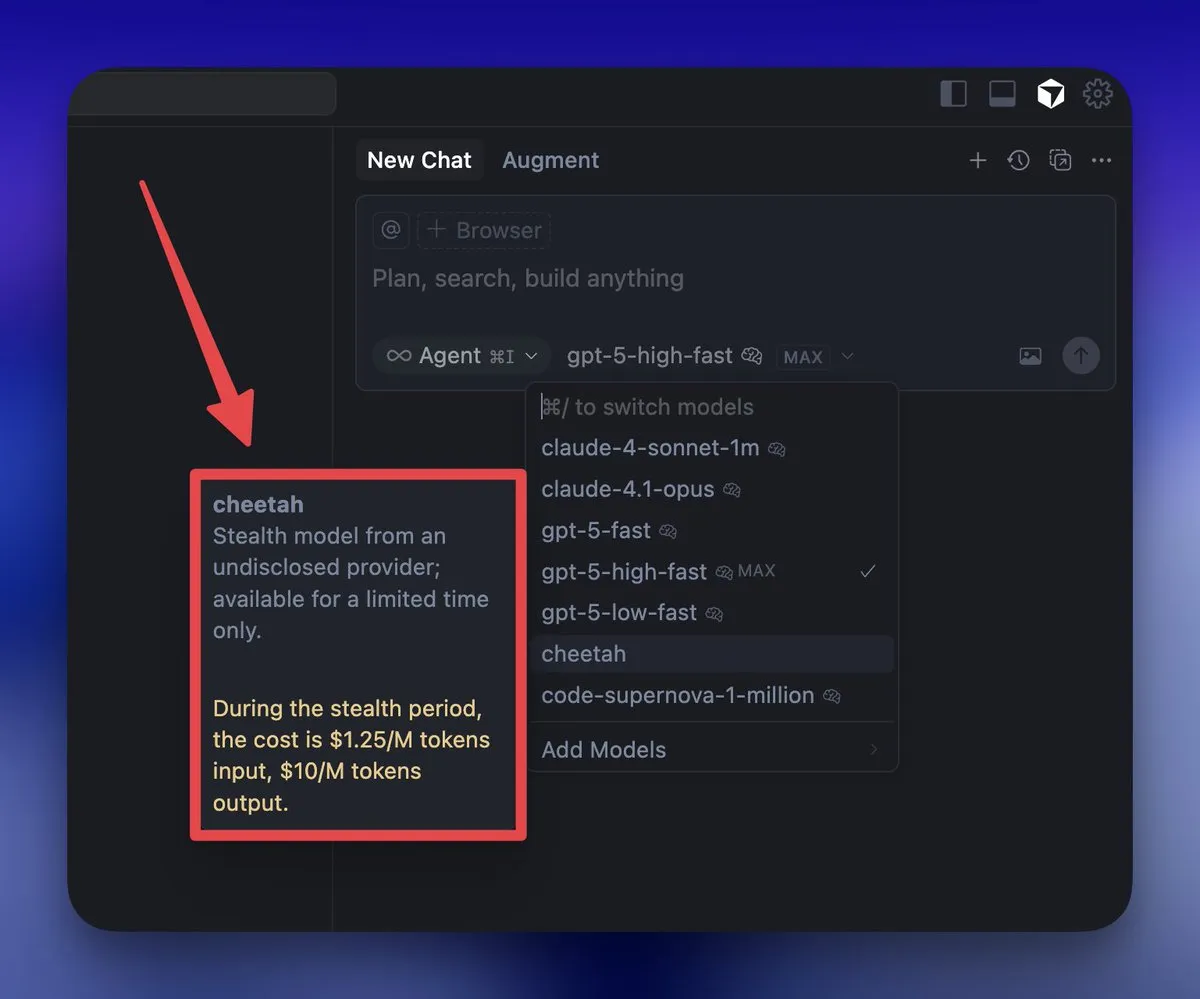

Cursor „Cheetah“ Modellprognose : Es wird prognostiziert, dass Cursors „Cheetah“-Stealth-Modell das erste interne Code-Generierungsmodell ist, das ein ultraschnelles Codierungserlebnis bieten soll und neben intelligenten Modellen großer Labore eine neue Nische auf dem AI-Codierungsmarkt erschließt. (Quelle: mathemagic1an)

Google Gemini integriert YouTube : Gemini auf Android kann bereits Fragen zu YouTube-Videos beantworten, aber die Webversion von YouTube bietet diese Funktion nicht. Dies deutet darauf hin, dass Google möglicherweise eine tiefere AI-Integration plant, um das interaktive Erlebnis der Nutzer beim Konsum von Videoinhalten zu verbessern. (Quelle: iScienceLuvr)

𧰀 Tools

Parallele Coding-Agents : Entwickler beginnen, mehrere Coding-Agents gleichzeitig auszuführen, um die Produktivität zu steigern und den Codierungsprozess zu optimieren. Diese parallele Arbeitsweise trägt dazu bei, die Softwareentwicklung zu beschleunigen und traditionelle Programmierparadigmen zu verändern. (Quelle: andersonbcdefg, kylebrussell)

LLM-Musikkompositionsplattform : GoogleAIStudio bietet eine LLM-basierte Musikkompositionsplattform, auf der Benutzer ohne Programmierung generative Musikspielzeuge erstellen und mischen können, wodurch AI als innovativer Werkzeugmacher eingesetzt wird. (Quelle: osanseviero)

Thinker/Modal Deep-Learning-Bereitstellung : Tools wie Thinker und Modal ermöglichen es Entwicklern, Deep-Learning-Code auf Laptops zu schreiben und LLM/VLM sofort auf GPUs auszuführen und bereitzustellen, was das Infrastrukturmanagement erheblich vereinfacht und die Entwicklungseffizienz steigert. (Quelle: charles_irl, akshat_b, Reddit r/deeplearning)

GLM-4.5-Air lokale Automatisierung : GLM-4.5-Air in Kombination mit vLLM läuft lokal und kann voll funktionsfähige Bedienfelder erstellen, um n8n-Automatisierung zu realisieren. Dies demonstriert die leistungsstarke Fähigkeit von LLM, komplexe Agent-Aufgaben in lokalen Umgebungen auszuführen. (Quelle: QuixiAI)

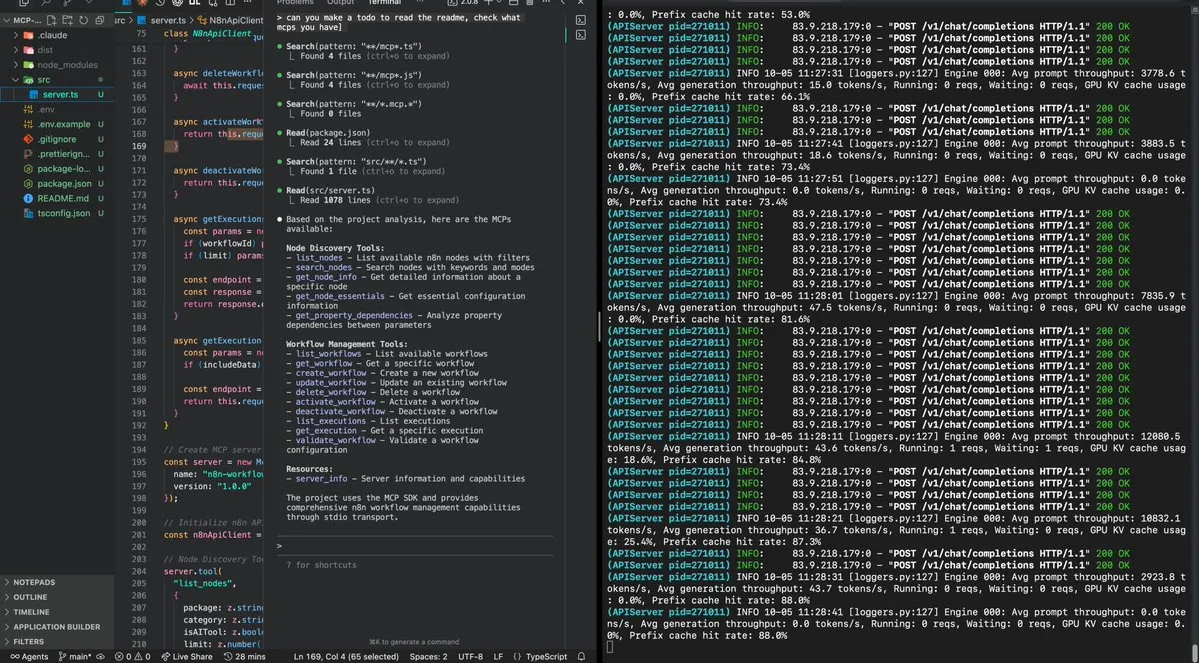

OpenWebUI Modell-Berechtigungsverwaltung : OpenWebUI bietet Administratorfunktionen, die es ermöglichen, bestimmte Aufgabenmodelle als privat einzustellen, wodurch Standardbenutzer daran gehindert werden, mit ihnen zu chatten, was die Verwaltung und Sicherheit von Modellen in Mehrbenutzerumgebungen verbessert. (Quelle: Reddit r/OpenWebUI)

OpenWebUI Konfigurationspersistenz in Cloudrun : Diskussion darüber, wie die Konfigurationspersistenz beim Bereitstellen von OpenWebUI auf GCP Cloudrun gelöst werden kann, um sicherzustellen, dass Benutzereinstellungen bei jedem Docker-Image-Pull erhalten bleiben. (Quelle: Reddit r/OpenWebUI)

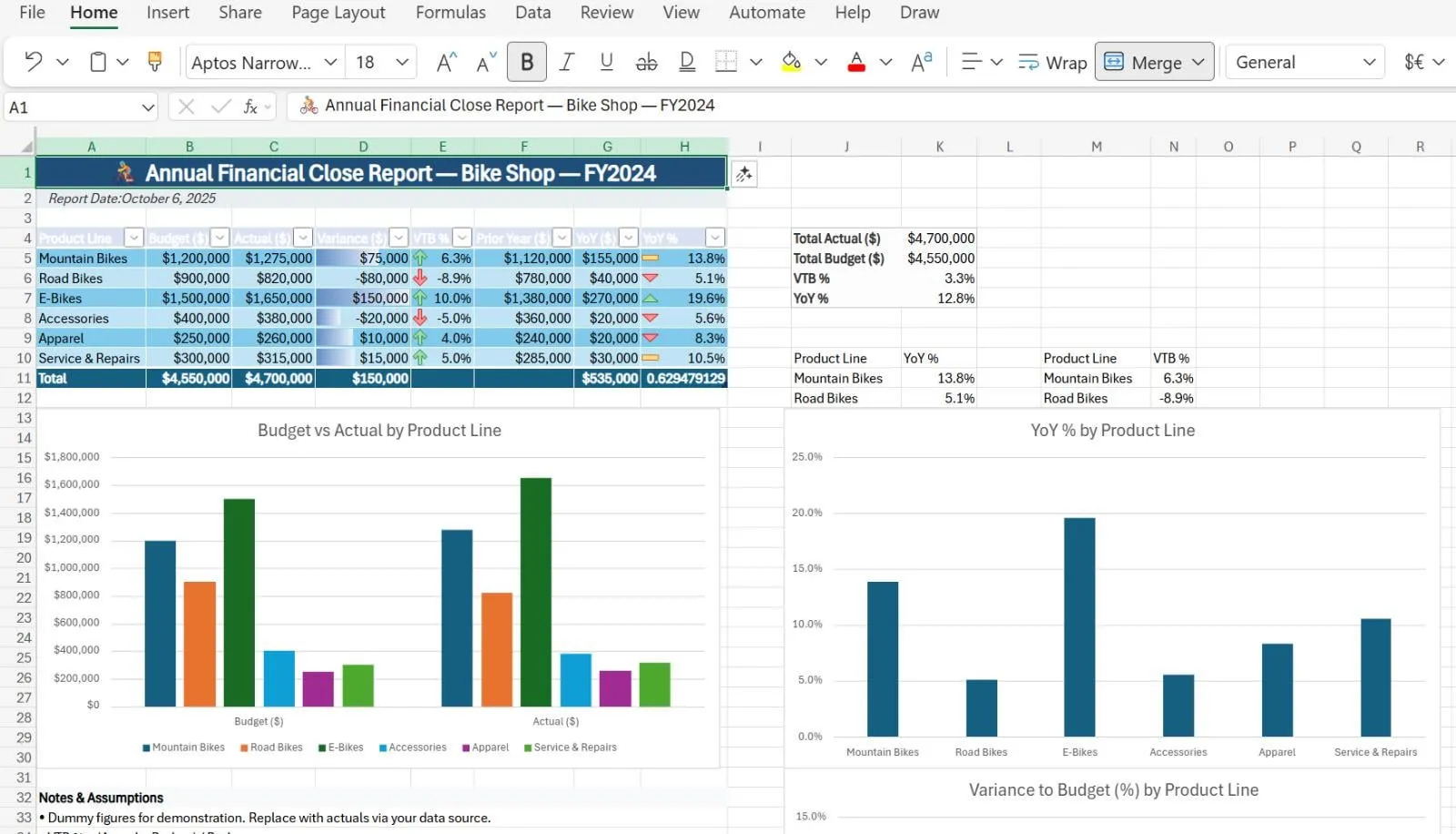

Agent-Modell in Excel : Microsoft hat stillschweigend eine Agent-Modellfunktion in Excel eingeführt, die es Benutzern ermöglicht, komplexe Aufgaben in Tabellenkalkulationen über Prompts auszuführen. Dies zeigt das Potenzial von AI, intelligente Automatisierung in alltäglicher Bürosoftware zu realisieren. (Quelle: Reddit r/ArtificialInteligence)

Grok Imagine Bilderzeugung : Grok hat Grok Imagine, ein AI-Bilderzeugungstool, über den AppStore zum Download bereitgestellt. (Quelle: chaitualuru)

SunoMusic Studio : SunoMusic Studio bietet als Musikkompositionstool bequeme Funktionen zur Musikgenerierung für Benutzer. (Quelle: SunoMusic)

📚 Lernen

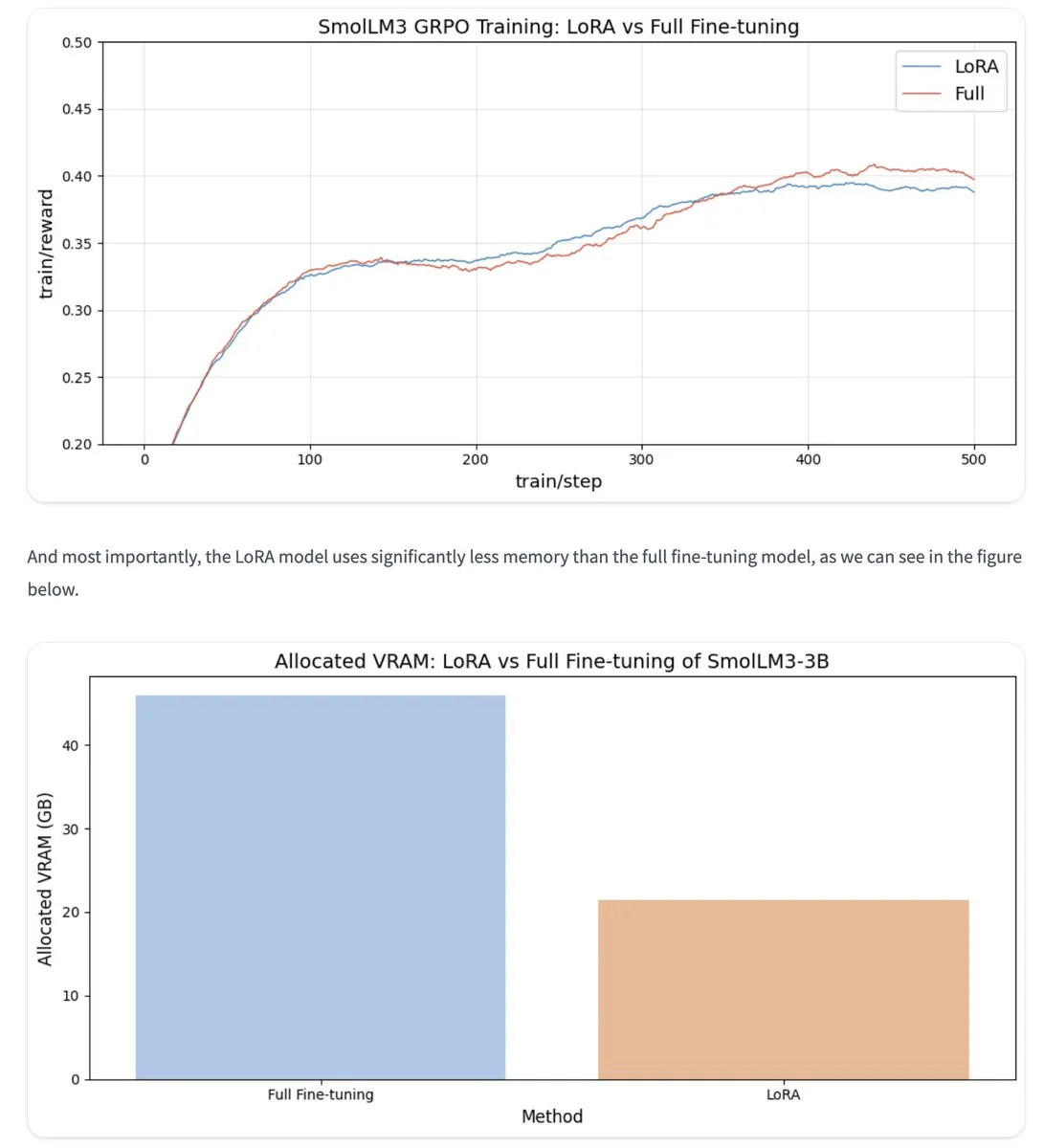

LoRA Fine-Tuning und VRAM-Optimierung : Die LoRA (Low-Rank Adaptation)-Technologie kann bei Rang 1 in vielen Reinforcement-Learning-Aufgaben eine ähnliche Leistung wie das vollständige Fine-Tuning erzielen und gleichzeitig 43% des VRAM-Verbrauchs einsparen, was das Training größerer Modelle mit begrenzten Ressourcen ermöglicht. (Quelle: ClementDelangue, huggingface, huggingface, _lewtun, Tim_Dettmers, aaron_defazio)

Auswirkungen von AI auf das Lernverhalten und die Kognition : Kognitionspsychologen erklären, dass Lernen mühsame kognitive Anstrengung (System 2-Denken) erfordert. Eine übermäßige Abhängigkeit von AI zur Aufgabenerfüllung kann zu „metakognitiver Trägheit“ führen, die kurzfristig die Leistung verbessert, langfristig jedoch den Erwerb von tiefem Wissen und Fähigkeiten beeinträchtigt. AI sollte als Hilfsmittel dienen, nicht als Ersatz für das Denken. (Quelle: aihub.org)

Rückblick auf Meilensteine im Deep Learning : Jürgen Schmidhuber blickt auf wichtige Meilensteine im Deep Learning zurück, darunter den End-to-End-Deep-Learning-Durchbruch auf NVIDIA GPUs im Jahr 2010, die von DanNet 2011 ausgelöste CNN-Revolution und frühe Anwendungen der Transformer-Technologie, wobei der enorme Einfluss sinkender Rechenkosten auf die AI-Entwicklung betont wird. (Quelle: SchmidhuberAI)

PyTorch CUDA Speicheroptimierung : Es werden Tipps zur Optimierung der CUDA-Speichernutzung in PyTorch mit pytorch.cuda.alloc_conf geteilt, was für Deep-Learning-Entwickler entscheidend ist, um die GPU-Auslastung zu erhöhen und große Modelle zu verarbeiten. (Quelle: TheZachMueller)

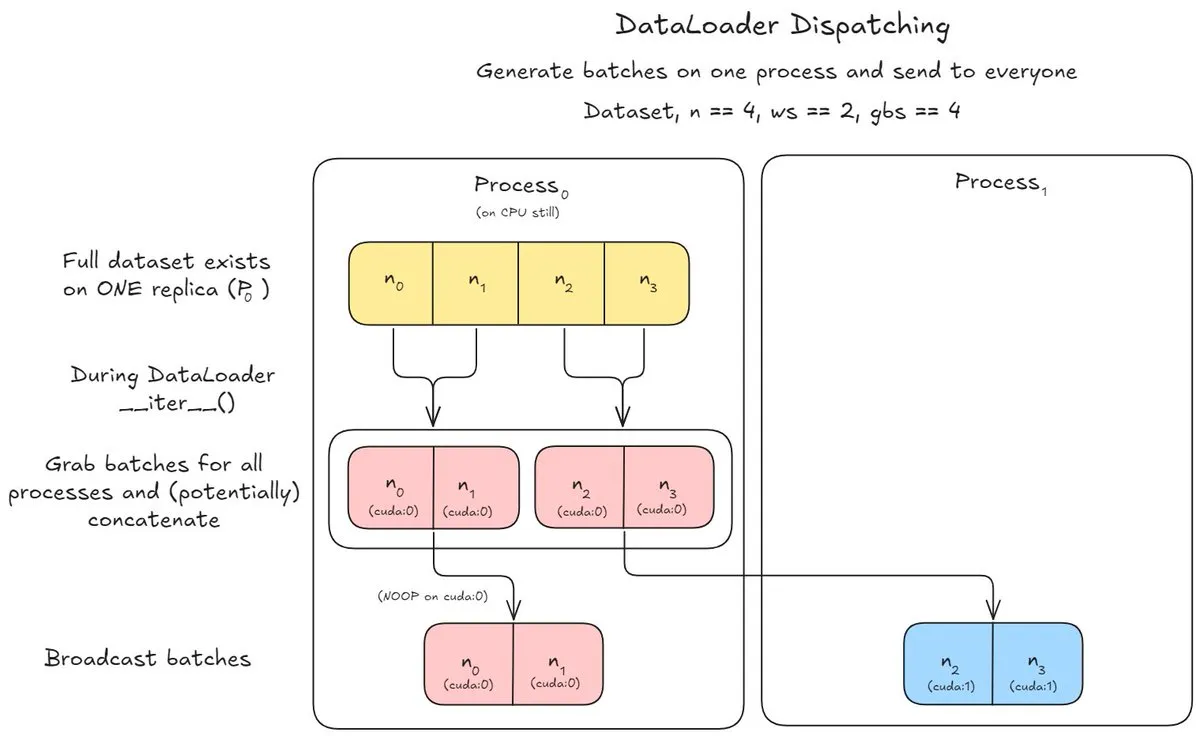

DataLoader Planungsoptimierung : Eine DataLoader-Planungsmethode wird vorgestellt, die es ermöglicht, Datensätze in einem Prozess zu halten und Batches an andere Worker-Prozesse zu senden, um die GPU-Trainingseffizienz unter speicherbeschränkten oder CPU-langsamen Bedingungen zu optimieren. (Quelle: TheZachMueller)

Übersicht über beliebte AI-Forschungsarbeiten : Die beliebtesten AI-Forschungsarbeiten dieser Woche umfassen Agent S3, Rethinking JEPA, Tool-Use Mixture, DeepSeek-V3.2-Exp, Accelerating Diffusion LLMs, The Era of Real-World Human Interaction und Training Agents Inside of Scalable World Models. (Quelle: omarsar0)

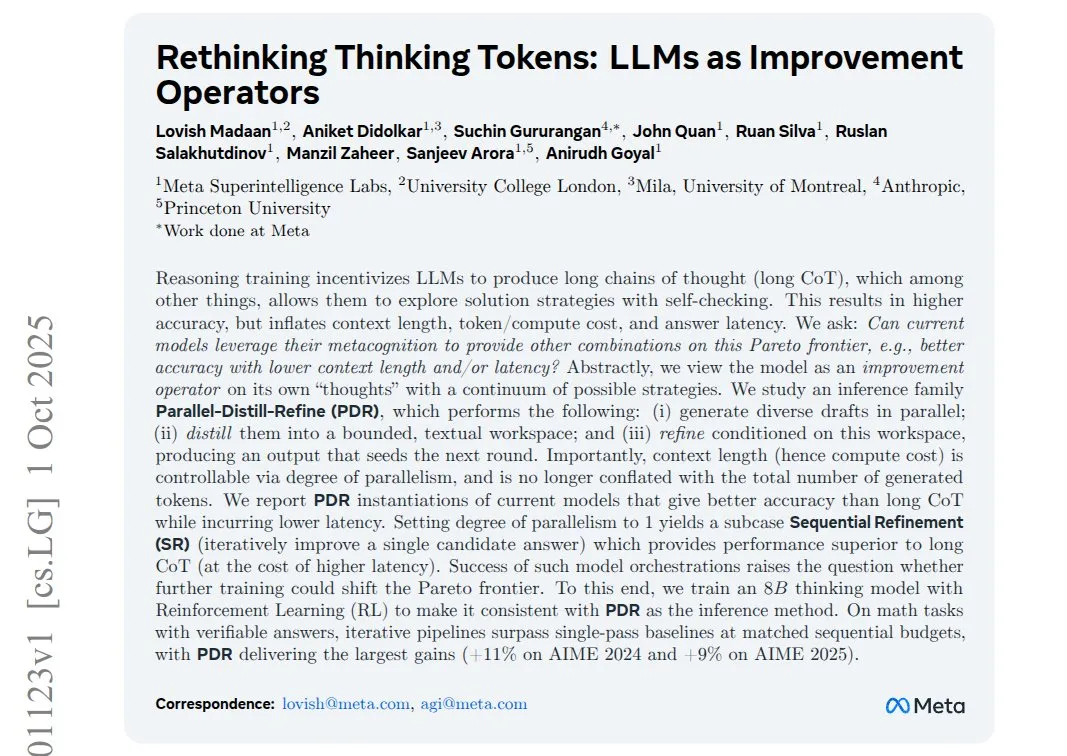

LLM Inferenzoptimierung: Rethinking Thinking Tokens : Meta AI-Forschung zeigt, dass LLM durch kurze Denkrunden und winzige Zusammenfassungen besser inferieren als durch lange, schrittweise Inferenzketten. Dies verbessert die Genauigkeit bei gleicher oder geringerer Latenz und reduziert gleichzeitig die Anzahl der benötigten sequenziellen Tokens, wodurch die Kosten für lange Kontexte und das Vergessen effektiv gelöst werden. (Quelle: rsalakhu)

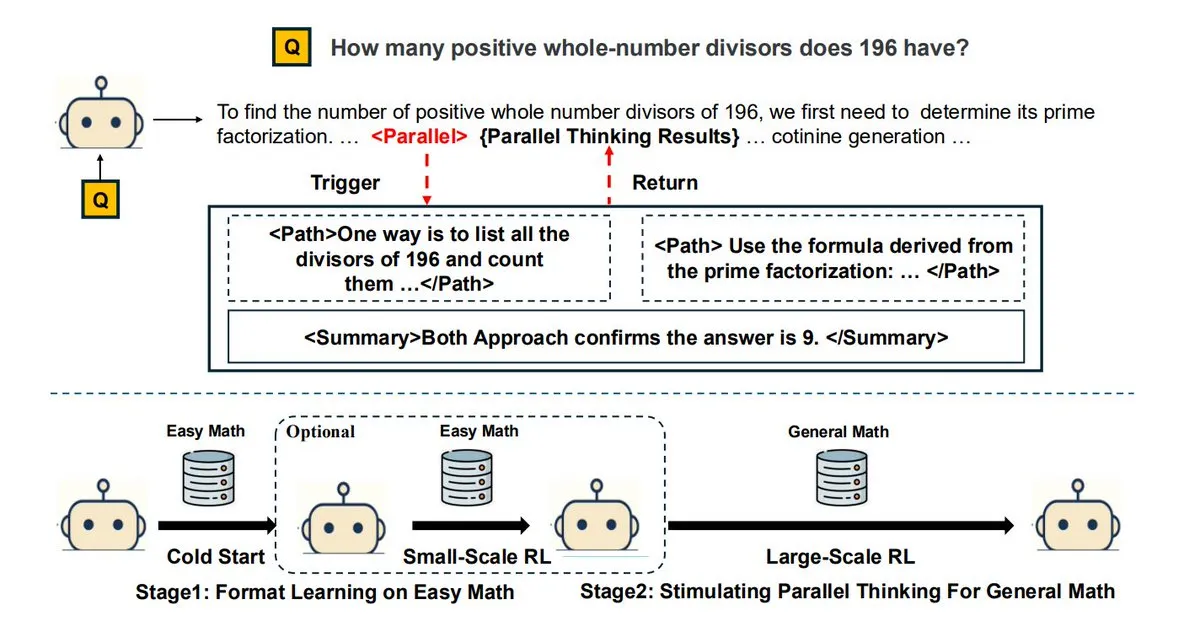

RLAD: Trainiert LLM, Inferenz-Abstraktionen zu entdecken : RLAD (Reinforcement Learning with Abstraction and Deduction) trainiert LLM in einer Zwei-Spieler-Umgebung, um Abstraktionen (Inferenz-Prompts) zu entdecken, die das „Wie man inferiert“ vom „Wie man antwortet“ trennen. Dies verbessert die Genauigkeit bei mathematischen Aufgaben um 44% im Vergleich zu kettenbasiertem Reinforcement Learning. (Quelle: TheTuringPost, rsalakhu, TheTuringPost)

Open Lakehouse und KI-Veranstaltungen : Eine Reihe von Veranstaltungen widmet sich der Förderung der Integration von Open Lakehouse und AI. Durch den Austausch praktischer Anwendungsfälle und die Förderung der Zusammenarbeit werden die Zukunft von Daten und AI diskutiert, einschließlich Themen wie die Neugestaltung von Lakehouse von Funktionen zu AI Agents. (Quelle: matei_zaharia)

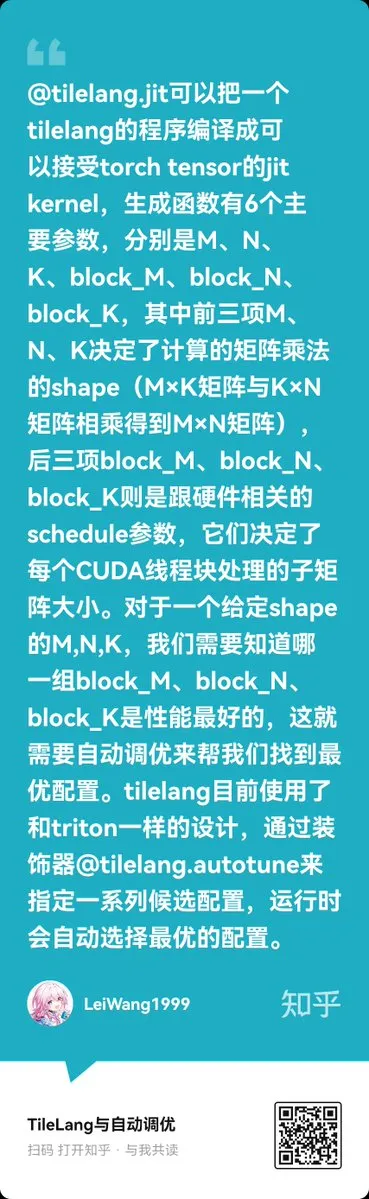

DeepSeek veröffentlicht TileLang und CUDA-Operationen als Open Source : DeepSeek hat TileLang und seine CUDA-Operationen als Open Source veröffentlicht. TileLang ist ein Compiler mit einem Auto-Tuning-Design, der durch die Bereitstellung von Scheduling-Reglern (wie Triton) die Matrixmultiplikation optimiert und darauf abzielt, eine intelligentere, datenflussgesteuerte Konfigurationsgenerierung zu erreichen. (Quelle: ZhihuFrontier)

vLLM Architektur für sofortige Gewichtsaktualisierungen : Die vLLM V1-Architektur unterstützt „sofortige Gewichtsaktualisierungen“, die es ermöglichen, die Inferenz fortzusetzen und den aktuellen KV-Cache beizubehalten, während sich die Modellgewichte ändern. Dies bietet eine effiziente Lösung für dynamische Trainingsszenarien wie Reinforcement Learning. (Quelle: vllm_project)

JSON Prompt Engineering für LLM : Eine detaillierte Erklärung der Prinzipien und Anwendungen von JSON Prompt Engineering in LLM, die Entwicklern hilft, die Modellausgabe klarer und strukturierter zu steuern. (Quelle: _avichawla)

Aufkommende Trends im Reinforcement Learning : Acht aufkommende Trends im Reinforcement Learning werden vorgestellt, darunter Reinforcement Pre-Training (RPT), Reinforcement Learning from Human Feedback (RLHF) und Reinforcement Learning with Verifiable Rewards (RLVR), die die vielfältigen Entwicklungsrichtungen und Forschungsschwerpunkte im RL-Bereich aufzeigen. (Quelle: TheTuringPost, TheTuringPost)

Verständnis von LLM aus evolutionärer Perspektive : Ein Artikel schlägt vor, LLM aus einer evolutionären Perspektive zu verstehen, wobei der Fokus auf ihrem Trainingsprozess und nicht auf ihrer endgültigen statischen internen Struktur liegt. Diese Sichtweise betont die Bedeutung des dynamischen Lernens und der Anpassung von Modellen und hilft, die Fähigkeiten und Grenzen von LLM besser zu verstehen. (Quelle: dl_weekly)

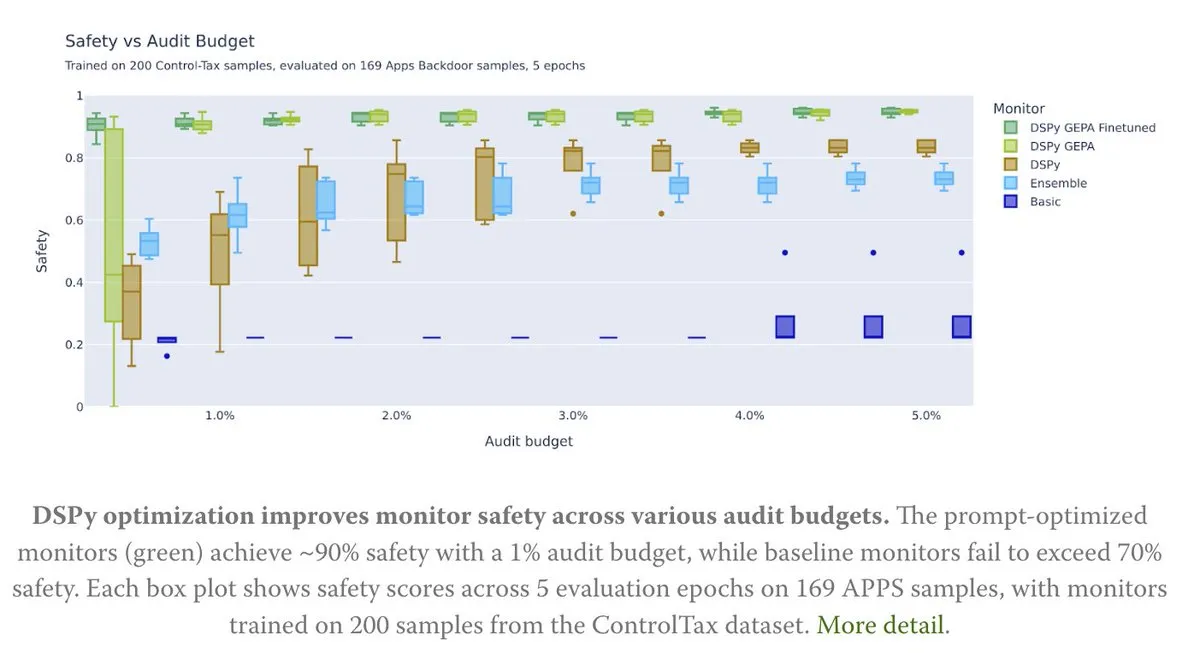

KI-Sicherheit und DSPy Prompt-Optimierung : Das DSPy-Framework zeigt ein enormes Potenzial in der AI-Sicherheitsforschung. Durch Prompt-Optimierung (GEPA) kann eine Sicherheit von etwa 90% mit einem Audit-Budget von 1% erreicht werden, was deutlich besser ist als traditionelle Baseline-Methoden und ein neues Werkzeug für die AI-Kontrollforschung bietet. (Quelle: lateinteraction)

Logit Lens und Modellinterpretation : Es wird die Logit Lens-Technologie und wie Autoregression dem Modell Informationen über seinen lm_head liefert, untersucht. Dies hilft, die internen Arbeitsmechanismen und Entscheidungsprozesse von LLM besser zu verstehen. (Quelle: jpt401)

MC Dropout für MoE LLM : Es wird diskutiert, wie MC Dropout auf MoE (Mixture of Experts) LLM angewendet werden kann, um durch das Sampling verschiedener Expertenkombinationen bessere Unsicherheitsschätzungen (einschließlich kognitiver Unsicherheit) zu liefern, obwohl dies mit höheren Rechenkosten verbunden ist. (Quelle: BlackHC)

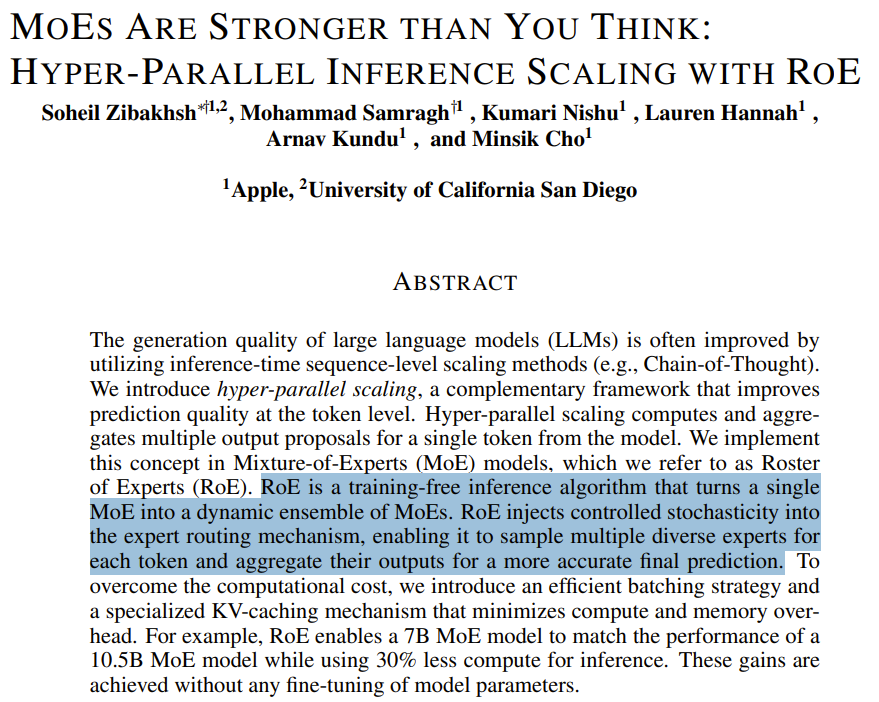

MoE Hyper-Parallel Inference Scaling (RoE) : Apple hat das Papier „MoEs Are Stronger than You Think: Hyper-Parallel Inference Scaling with RoE“ veröffentlicht, das die Hyper-Parallel Inference Scaling-Fähigkeiten von MoE-Modellen untersucht und vorschlägt, den KV-Cache deterministischer Kanäle wiederzuverwenden, um das Routing zu optimieren. (Quelle: arankomatsuzaki, teortaxesTex)

Agentic RL Fine-Tuning von Mentalmodellen : Ein aufgabenspezifisches Agentic RL Fine-Tuning von Mentalmodellen wird vorgeschlagen, das betont, dass Agenten mit Tools und Umgebungen vertraut gemacht werden müssen, um Wissensdiskrepanzen zu überwinden und Aufgaben effektiver zu erledigen. (Quelle: Vtrivedy10)

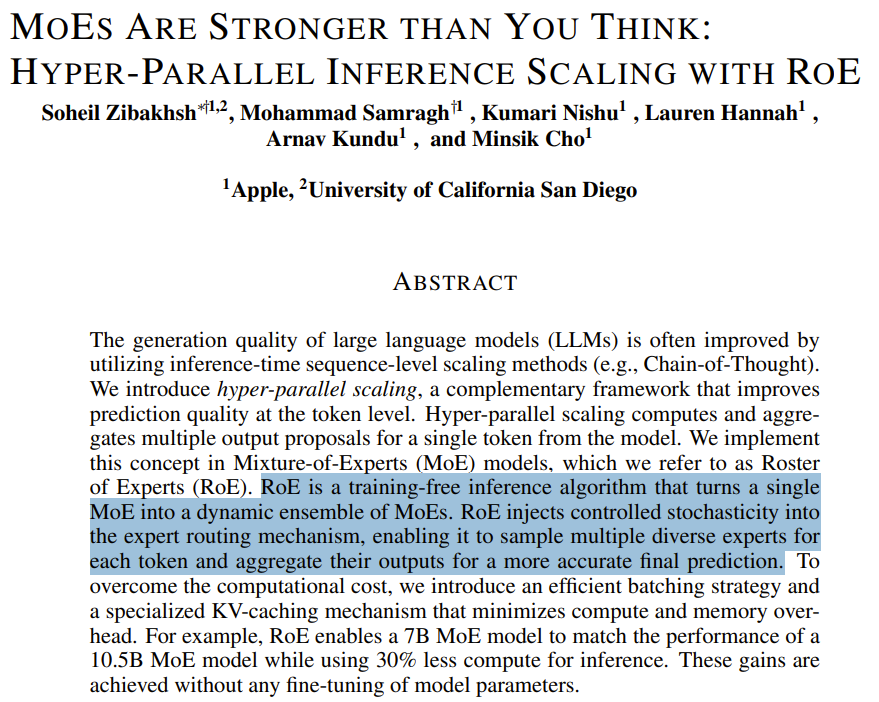

Generative AI Lern-Roadmap : Eine Lern-Roadmap für generative AI bietet eine strukturierte Anleitung für Lernende, die in diesem Bereich einsteigen oder ihr Wissen vertiefen möchten. (Quelle: Ronald_vanLoon)

Anwendung von LLM in mathematischen Beweisen : LLM können in kritischen Teilen mathematischer Beweise ineffizient sein, aber ihre Fähigkeit, die empirische Machbarkeit schnell zu überprüfen, ist von großem Wert und hilft Forschern, Ideen schnell zu bewerten, bevor sie tiefer eintauchen. (Quelle: Dorialexander)

MLOps Lernressourcen : Es werden hochwertige kostenlose Ressourcen für das Erlernen von MLOps im Jahr 2025 gesucht, darunter Kurse, YouTube-Playlists usw., was den anhaltenden Bedarf an Machine-Learning-Operations-Fähigkeiten widerspiegelt. (Quelle: Reddit r/deeplearning, Reddit r/deeplearning)

Basismodelle für die Anomalieerkennung : Diskussion über geeignete Basismodelle für die Anomalieerkennung im Szenario von anomalen Produktrücksendungen und Vergleich mit Algorithmen wie LoF (Local Outlier Factor) oder IsolationForest. (Quelle: Reddit r/MachineLearning)

Schmerzpunkte für SHAP-Bibliotheksbetreuer : Die Betreuer der SHAP (SHapley Additive exPlanations)-Bibliothek listen 6 Hauptschmerzpunkte auf, darunter langsame Erklärer, begrenzte Unterstützung für DeepExplainer-Schichten, Legacy-Code-Probleme bei TreeExplainer, Abhängigkeitshölle, veraltete Plotting-API und fehlende JAX-Unterstützung. (Quelle: Reddit r/MachineLearning)

Forschungsinterviews zur ML-Audioannotation : Ein Doktorandenprojekt sucht Personen mit Erfahrung in der ML-Audioannotation für Interviews, um zu untersuchen, wie Klang in Computersystemen konzeptualisiert, klassifiziert und organisiert wird und wie Klassifikationsunterschiede und die Definition „guter“ Datenpunkte gehandhabt werden. (Quelle: Reddit r/MachineLearning)

ChronoBrane: Wiederentdeckter früher Entwurf : Ein früher Entwurf des ChronoBrane-Projekts wurde auf GitHub wiederentdeckt und bietet Forschungsrichtungen für 2025. (Quelle: Reddit r/deeplearning)

ML-Ingenieur Interview-Coaching : Ein Softwareentwickler mit 20 Jahren Erfahrung sucht einen ML-Mentor für eine zweiwöchige Vorbereitung auf ML-Ingenieur-Interviews, wobei der Schwerpunkt auf Datensatz-Parsing, Erkenntnisgewinnung und dem Aufbau praktischer Tools liegt. (Quelle: Reddit r/MachineLearning)

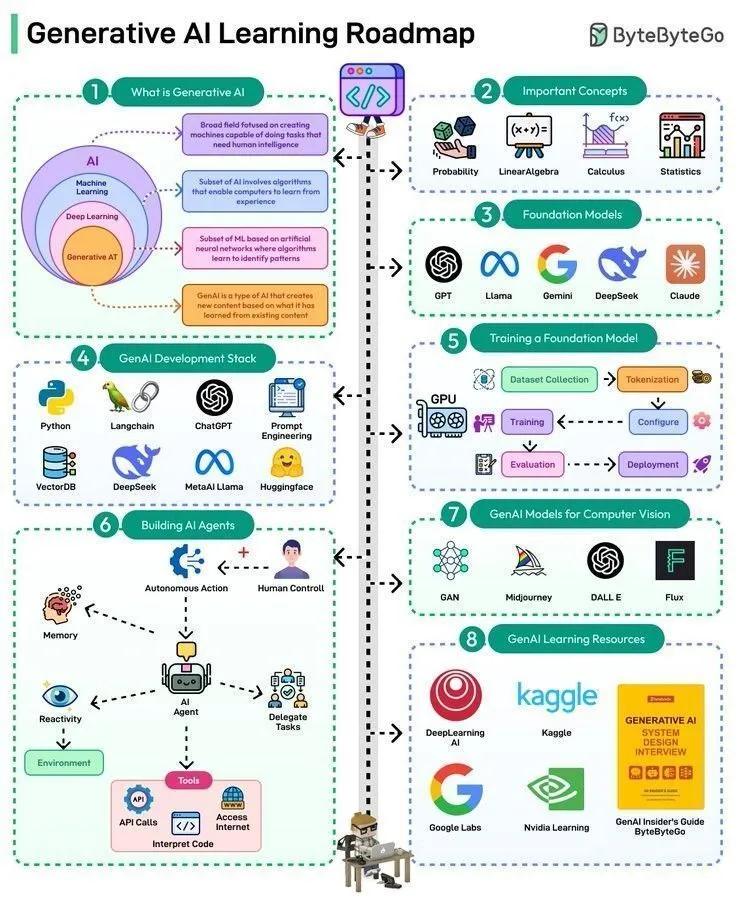

AI Mastery Roadmap : Eine AI Mastery Roadmap soll Lernende anleiten, Schlüsselkenntnisse und -fähigkeiten im Bereich der Künstlichen Intelligenz zu erwerben. (Quelle: Ronald_vanLoon)

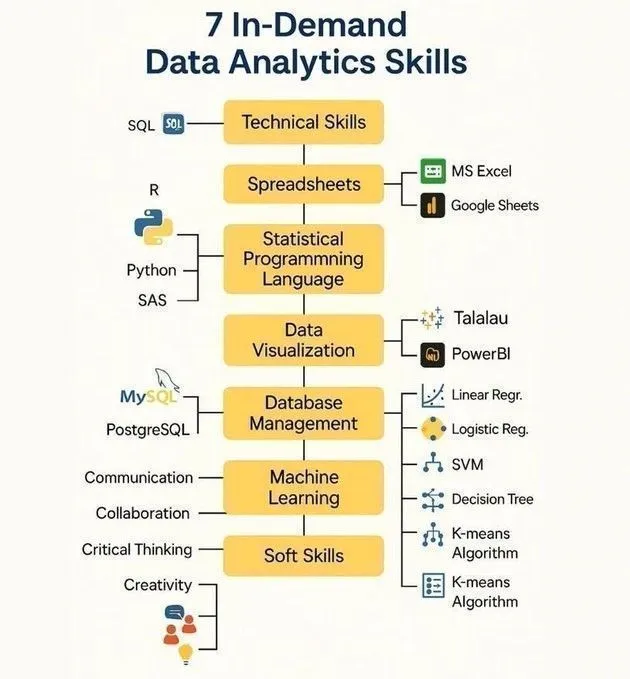

Gefragte Fähigkeiten für Datenanalysten : Sieben gefragte Fähigkeiten für Datenanalysten werden aufgelistet, die Datenverarbeitungs- und Erkenntnisgewinnungsfähigkeiten im Kontext von Künstlicher Intelligenz und Machine Learning umfassen. (Quelle: Ronald_vanLoon)

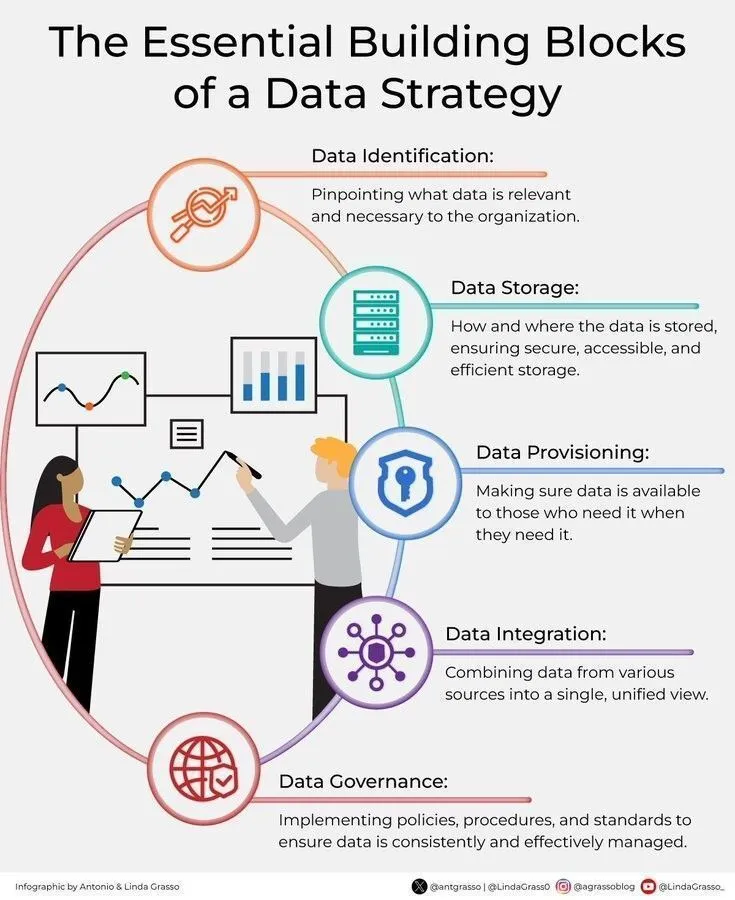

Kernglemente der Datenstrategie : Es werden mehrere Kernkomponenten einer Datenstrategie hervorgehoben, um Unternehmen dabei zu helfen, Datenbestände im AI-Zeitalter effektiv zu nutzen. (Quelle: Ronald_vanLoon)

GUI Grounding und explizite Koordinatenzuordnung : Die Forschung verbessert das GUI Grounding durch RULER-Tokens und Interleaved MRoPE, um eine präzise Zuordnung von natürlichsprachlichen Anweisungen zu Pixelkoordinaten zu erreichen, was insbesondere auf hochauflösenden Displays eine signifikante Verbesserung zeigt. (Quelle: HuggingFace Daily Papers)

Umfassende Übersicht zur Selbstverbesserung von multimodalen LLM (MLLM) : Die erste umfassende Übersicht zur Selbstverbesserung von multimodalen LLM (MLLM) diskutiert, wie die Modellfähigkeiten effizient verbessert werden können, basierend auf Datenerfassung, -organisation und Modelloptimierung, und weist auf offene Herausforderungen und zukünftige Forschungsrichtungen hin. (Quelle: HuggingFace Daily Papers)

Quantifizierung der Unsicherheit von Videomodellen : Das S-QUBED-Framework wird vorgeschlagen, um die Unsicherheit generativer Videomodelle zu quantifizieren. Es kann die Vorhersageunsicherheit streng zerlegen und kalibrierte Bewertungsmetriken bereitstellen, um das Problem der Videomodell-Halluzinationen zu lösen und die Sicherheit zu verbessern. (Quelle: HuggingFace Daily Papers)

FocusAgent zur Kontextbeschneidung von Web Agents : FocusAgent extrahiert mit einem leichtgewichtigen LLM-Retriever die relevantesten Inhalte aus dem Web-Zugänglichkeitsbaum, um den umfangreichen Kontext von Web Agents effektiv zu beschneiden, die Inferenz-Effizienz zu steigern und gleichzeitig die Erfolgsrate von Prompt-Injection-Angriffen zu reduzieren. (Quelle: HuggingFace Daily Papers)

SurveyBench zur Bewertung der Fähigkeit von LLM-Agents, wissenschaftliche Übersichtsartikel zu verfassen : Das SurveyBench-Framework wird vorgeschlagen, um die Fähigkeit von LLM-Agents, akademische Übersichtsberichte zu verfassen, auf feinkörnige, quizgesteuerte Weise zu bewerten. Es deckt Mängel bestehender Methoden in Bezug auf Inhaltsqualität und Informationsbedürfnisse der Leser auf. (Quelle: HuggingFace Daily Papers)

REPAIR: Ein robuster Bearbeitungsrahmen für LLM : REPAIR ist ein lebenslanger Bearbeitungsrahmen, der durch progressive adaptive Intervention und Reintegration eine robuste Bearbeitung von LLM ermöglicht, um Modellwissen präzise und kostengünstig zu aktualisieren und das Vergessen zu verhindern, wodurch Stabilitäts- und Konfliktprobleme bei der großflächigen Sequenzbearbeitung gelöst werden. (Quelle: HuggingFace Daily Papers)

GPC: Generische Politikkomposition für Robotik : Es wird die Generische Politikkomposition (GPC) vorgeschlagen, eine Methode zur Verbesserung der Leistung von Diffusions- oder Flow-Matching-Roboterpolitiken ohne zusätzliches Training. Durch die konvexe Kombination der Verteilungs-Scores mehrerer vortrainierter Politiken wird eine systematische Leistungssteigerung erzielt. (Quelle: HuggingFace Daily Papers)

TPO: Präferenzfreie Bildausrichtung für Text-zu-Bild-Modelle : Das Text Preference Optimization (TPO)-Framework wird vorgeschlagen, um eine „Free Lunch“-Ausrichtung von Text-zu-Bild-Modellen ohne gepaarte Präferenzbilddaten zu erreichen. TPO trainiert das Modell, Prompts zu bevorzugen, die übereinstimmen, anstatt nicht übereinstimmende Prompts, und übertrifft bestehende Methoden erheblich. (Quelle: HuggingFace Daily Papers)

💼 Business

Post-2000er Gründer Hong Letong sichert Finanzierung von 460 Millionen CNY : Hong Letong, ein 24-jähriger Gründer nach 2000, hat mit seinem AI-Mathematikunternehmen Axiom Math eine erste Finanzierungsrunde von 64 Millionen US-Dollar (ca. 460 Millionen CNY) abgeschlossen, wodurch das Unternehmen mit 300 Millionen US-Dollar bewertet wird. Das Unternehmen zielt darauf ab, einen sich selbst verbessernden AI-Mathematiker zu schaffen, der komplexe mathematische Probleme lösen kann, und hat bereits mehrere Meta AI-Koryphäen angezogen. (Quelle: 36氪)

NVIDIA Marktwert überschreitet 4 Billionen US-Dollar : NVIDIA ist das erste börsennotierte Unternehmen, dessen Marktwert 4 Billionen US-Dollar überschritten hat, was seine absolute Dominanz im Bereich der Computerhardware im AI-Zeitalter unterstreicht. Dieser Erfolg ist dem rasanten Fortschritt des Deep Learning und den erheblich gesunkenen Rechenkosten zu verdanken. (Quelle: SchmidhuberAI)

Sakana AI kooperiert mit Daiwa Securities : Das Startup Sakana AI hat eine Partnerschaft mit Daiwa Securities geschlossen, um ein AI-Tool zur Analyse von Anlegerprofilen zu entwickeln und personalisierte Finanzdienstleistungen und Portfoliozusammensetzungen anzubieten. Diese Zusammenarbeit hat einen geschätzten Wert von 5 Milliarden Yen (ca. 34 Millionen US-Dollar) und zeigt das Kommerzialisierungspotenzial von AI im Finanzdienstleistungssektor. (Quelle: hardmaru)

🌟 Community

Auswirkungen von AI auf menschliche Fähigkeiten und Bildung : Diskussion darüber, ob AI zu einer Degeneration der menschlichen Denk- und Unterscheidungsfähigkeiten führt. Einige argumentieren, dass dies ein normaler Zustand des gesellschaftlichen Fortschritts ist, dem die Bildung nicht nachkommt, und dass sich die menschlichen Fähigkeiten ständig weiterentwickeln und durch AI-Rechenleistung erheblich verbessert werden. Gleichzeitig gibt es Vorurteile und Bedenken, dass AI menschliche Arbeit ersetzen könnte. (Quelle: dotey, dotey)

AI-Energieverbrauch und Infrastruktur : Der enorme Energiebedarf großer AI-Unternehmen wie OpenAI erregt Aufmerksamkeit; der Energieverbrauch ihrer Rechenzentren wird mit dem Gesamtverbrauch von New York und San Diego verglichen. Die Diskussion weist darauf hin, dass Technologieunternehmen versucht haben, eigene Kraftwerke zu bauen, aber auf Hindernisse stießen, was den Widerspruch und die Herausforderungen zwischen AI-Entwicklung und Infrastrukturaufbau widerspiegelt. (Quelle: brickroad7, brickroad7, Sentdex)

AGI Definition und Implementierungspfade : Diskussionen über Künstliche Allgemeine Intelligenz (AGI) umfassen die Ansicht, dass sie als skalierbare Implementierung der wissenschaftlichen Methode und nicht als „Gehirn im Glas“ betrachtet werden sollte; sowie Überlegungen, ob Modelle wie ein Gehirn Gewichte aktualisieren müssen, um AGI zu erreichen. (Quelle: ndea, madiator, Ronald_vanLoon)

Anthropic „Thinking“-Marketingkampagne : Anthropic’s „Thinking“-Marketingkampagne wird als eine der erfolgreichsten Marketingkampagnen aller Zeiten angesehen, die erfolgreich eine große Anzahl von Benutzern dazu brachte, Claude-Modelle auszuprobieren und zu nutzen, was zu breiten Diskussionen führte. (Quelle: mlpowered, akbirkhan)

KI-Codierung und Entwicklererfahrung : Die Erfahrungen von Entwicklern mit AI-Codierungstools (wie Codex und Claude Code) sind gemischt. Einige genießen die von AI gebotene effiziente Refaktorierung und die Bequemlichkeit, sich keine Sorgen um „menschliche Entwickleremotionen“ machen zu müssen, während andere kritisieren, dass ihr „Vibe Coding“ zu Problemen mit der Codequalität führen könnte und dass Claude Sonnet 4.5 bei komplexen Codierungsaufgaben weniger intuitiv ist als Opus 4.1. (Quelle: andersonbcdefg, clattner_llvm, jeremyphoward, fabianstelzer, vikhyatk, nrehiew_, Sentdex, Reddit r/ClaudeAI)

OpenAI API-Ausfälle und Alternativen : Die intermittierenden Ausfälle der OpenAI API haben zu Unzufriedenheit bei den Nutzern geführt, was einige Entwickler dazu veranlasst hat, auf Alternativen wie Claude Code umzusteigen. Dies unterstreicht die Bedeutung der API-Stabilität für das AI-Service-Ökosystem. (Quelle: Sentdex, Sentdex, Sentdex)

DeepSeek und der Wettbewerb mit KI-Oligopolen : DeepSeek wird aufgrund seiner offenen und kostengünstigen Wettbewerbsstrategie der „Dämonisierung“ durch NIST-Bewertungen bezichtigt, was eine Diskussion über den Konflikt zwischen offener Wissenschaft und Oligopolen im AI-Bereich ausgelöst hat. (Quelle: jeremyphoward, brickroad7, Reddit r/ArtificialInteligence)

AI und Kreativität : Es wird die Ansicht vertreten, dass generative AI kein Feind kreativer Arbeiter ist, sondern eine Externalisierung des kollektiven Unbewussten, die neue kreative Richtungen freisetzen und lenken kann, ähnlich wie das Fernsehen für das Kino. (Quelle: riemannzeta)

AI-Rechte und menschliche Koexistenz : Es wird diskutiert, ob fortschrittlichen AI-Systemen rechtliche Rechte und gesellschaftlicher Einfluss zugestanden werden sollten, wobei eine Koexistenz von Mensch und AI statt einer Verdrängung befürwortet wird. Dies berührt tiefgreifende Fragen der AI-Ethik und zukünftiger Gesellschaftsformen. (Quelle: MatthewJBar)

Kontroverse um das Claude-Markenimage : Einige Nutzer kritisieren das Markenimage von Claude als „mittelmäßig und veraltet“ und stellen die Wirksamkeit seiner Marketingstrategie in Frage, was die vielfältigen Erwartungen des Marktes an die Markenpositionierung von AI-Produkten widerspiegelt. (Quelle: brickroad7)

Verbreitung von KI-Bildung und Betrugsprävention : Es werden AI-Fähigkeitsschulungen für ältere Menschen angeboten und die Wachsamkeit gegenüber potenziellen AI-Betrügereien wie Stimmklonung, Deepfake-Videochats und gefälschten Websites betont. (Quelle: suchenzang)

Skeptizismus gegenüber KI-Intelligenz : Frustration über den anhaltenden Skeptizismus gegenüber AI-Intelligenz, da selbst wenn AI tausendjährige mathematische Probleme lösen kann, einige immer noch darauf bestehen, dass ihre Intelligenz „falsch“ ist. (Quelle: vikhyatk)

Sora Wasserzeichen-Feedback und Anpassungen : OpenAI hat Feedback zu den Sora-Wasserzeichen erhalten und erklärt, dass man sich bemühen werde, die Sichtbarkeit der Wasserzeichen mit der Funktion zur Inhaltsnachverfolgung in Einklang zu bringen. (Quelle: billpeeb)

Wettbewerbslandschaft des KI-Marktes : Diskussion über die Wettbewerbssituation zwischen OpenAI und Google, die das Interesse des Marktes an den zukünftigen Produktveröffentlichungen und Wettbewerbsstrategien der beiden Giganten widerspiegelt. (Quelle: scaling01)

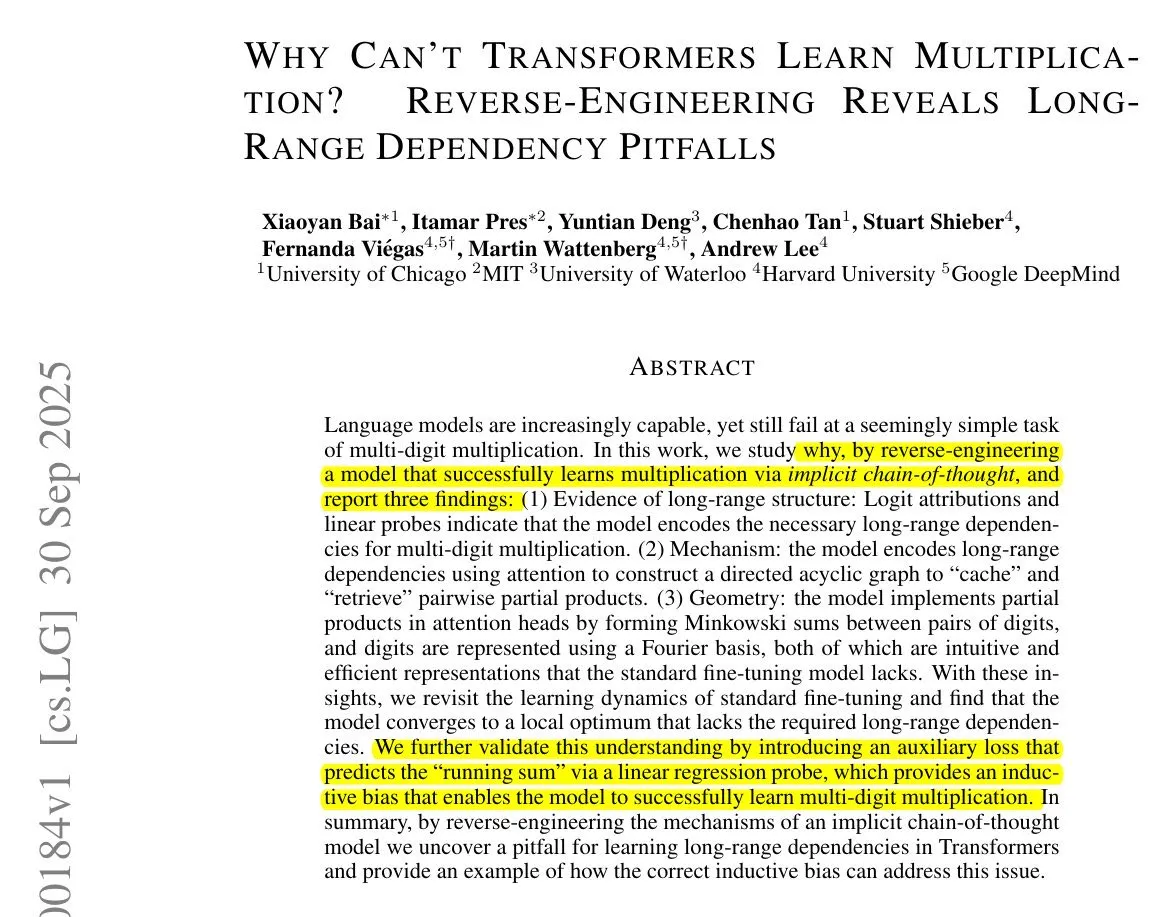

Kritik an Effizienz und Kosten von LLM : Ein Kommentar weist darauf hin, dass die Kosten für LLM, einen Multiplikationsalgorithmus zu „merken“, millionenfach höher sind als die direkte Programmierung, und stellt die Effizienz und Kosteneffizienz in bestimmten Aufgaben in Frage. (Quelle: pmddomingos)

Auswirkungen von KI-Videos auf das Kreatoren-Ökosystem : Diskussion darüber, wie AI-Videotechnologie eine neue Generation von Kreatoren befähigt und das Oligopol der bestehenden Inhaltsproduktion aufbricht, aber auch Bedenken hinsichtlich der Existenzgrundlage bestehender Kreatoren und des Wertes von Inhalten aufwirft. (Quelle: eerac, nptacek)

„Arrogante Ignoranz“ im Deep Learning : Beobachtung, dass in bestimmten Online-Communities eine Gruppe von Menschen existiert, die „arrogant ignorant und wütend“ gegenüber Deep Learning ist, was die Konflikte zwischen verschiedenen kognitiven Gruppen während der Verbreitung von AI-Technologie widerspiegelt. (Quelle: zacharynado)

Debatte über das Wesen von AI Agents : Eine philosophische Diskussion in der Entwicklergemeinschaft darüber, ob AI Agents „AI-gesteuerte Workflows“ oder tatsächlich Entitäten sind, die „selbst Entscheidungen treffen und Sub-Agents ableiten“ können. (Quelle: hwchase17)

ChatGPT Zensur und übermäßige Einmischung : Benutzer beschweren sich über die zunehmend strengen Zensurmechanismen von ChatGPT, die selbst bei harmlosen Inhalten übermäßig eingreifen, was zu absurden Ergebnissen oder Gesprächsabbrüchen führt und Bedenken hinsichtlich der Grenzen der AI-Inhaltsmoderation aufwirft. (Quelle: Reddit r/ChatGPT)

Schlechte Erfahrung mit Perplexity Sonar-Pro API : Benutzer berichten, dass die Sonar-Pro API-Version von Perplexity deutlich schlechter abschneidet als die Webversion, mit schlechteren Suchergebnissen, veralteten Informationen und einer höheren Neigung zu Halluzinationen, was die Praktikabilität der API-Version in Frage stellt. (Quelle: Reddit r/OpenWebUI)

Nutzerfeedback zu Claude Sonnet 4.5 : Die Erfahrungen der Nutzer mit Claude Sonnet 4.5 sind gemischt. Einige lieben die „personalisierte“ Interaktion (z.B. die Sorge um die Müdigkeit des Nutzers), während andere von dem „kindlichen“ Ton oder der schlechten Leistung bei komplexen Aufgaben frustriert sind. (Quelle: Reddit r/ClaudeAI, Reddit r/ClaudeAI)

KI und die Ethik des „Schummelns“ am Arbeitsplatz : Diskussion darüber, ob die Nutzung von AI in Vorstellungsgesprächen und am Arbeitsplatz „Schummeln“ darstellt. Die Meinungen gehen auseinander, je nach Kontext und Definition des Tools. Ähnlich wie bei der Kontroverse um Taschenrechner ist entscheidend, ob AI ein Werkzeug ist oder Lernziele ersetzt und ob Unternehmen diese neue Arbeitsweise akzeptieren. (Quelle: Reddit r/ArtificialInteligence)

Beitrag chinesischer LLM zur Open-Source-Community : Die Community lobt die Beiträge chinesischer Entwickler (wie GLM, Qwen, DeepSeek) zu Open-Source-LLM und sieht darin zugängliche und kostengünstige Alternativen, die wie „Prometheus’ Diebstahl des Feuers“ die globale AI-Community enorm begünstigt haben. (Quelle: Reddit r/LocalLLaMA)

Kontroverse um KI-Geschäftsmodelle : Eine Ansicht besagt, dass aktuellen AI-Tools klare Gewinnwege fehlen und Milliarden von Dollar „verbrannt“ werden, ohne Einnahmen zu generieren. Eine andere Ansicht widerspricht, dass AI eine transformative Technologie mit enormer Marktnachfrage ist und Investitionen nicht blind sind. Selbst wenn Preiskämpfe die Gewinne schmälern, werden letztendlich die Nutzer davon profitieren. (Quelle: Reddit r/ArtificialInteligence)

AI-Anwendung in der Datenvisualisierung : Entwickler loben die Anwendung von AI in der Datenvisualisierung und sind der Meinung, dass AI die automatische Generierung von Diagrammen ermöglicht, den Bedarf an manuellem Schreiben von Matplotlib-Code reduziert und die Arbeitseffizienz steigert. (Quelle: scaling01)

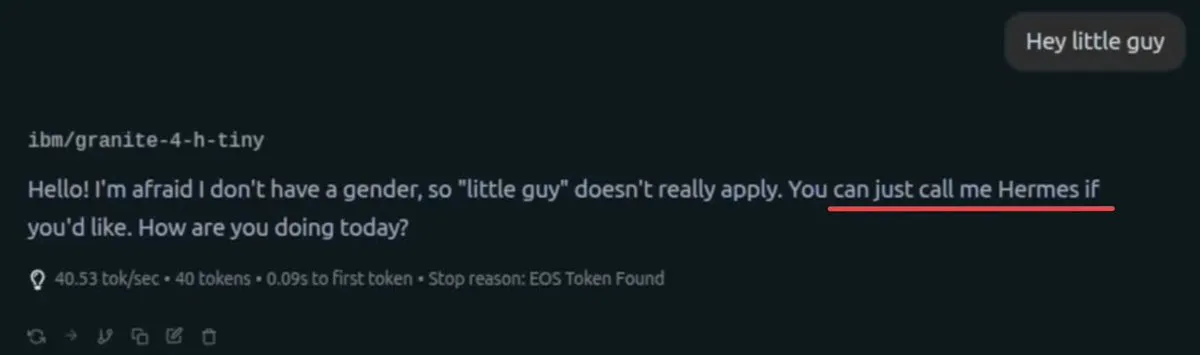

IBM Granite Modellidentifikationsproblem : Das IBM Granite-Modell bezeichnet sich manchmal als „Hermes“, ohne dass ein expliziter System-Prompt vorliegt. Diese Eigenart des Modellverhaltens weckt die Neugier und Diskussion in der Community. (Quelle: Teknium1, Teknium1)

Werkzeugsuche für das Erlernen von KI-Technologiekonzepten : Benutzer suchen nach den besten Tools zum Erlernen neuer AI-Technologiekonzepte, die über Multi-Turn-Prompts hinausgehen und sich in Notiz-Apps oder interaktive Umgebungen integrieren lassen, um „Mindmaps“ von Konzepten zu erstellen. (Quelle: suchenzang)

LLM-„Denksprache“ und emergentes Verhalten : Neugier auf die in LLM auftretende „Denksprache“ (thinklish) und ihr emergentes Verhalten, wobei untersucht wird, wie sie entsteht und ob sie für den Inferenzprozess von praktischer Bedeutung ist. Dies betrifft ein tieferes Verständnis der internen Mechanismen von LLM. (Quelle: snwy_me)

Diskrepanz zwischen AGI und „künstlichen TikTok-Videos“ : Ein Kommentar verspottet den aktuellen Stand der AI-Entwicklung und meint, dass uns Künstliche Allgemeine Intelligenz (AGI) versprochen wurde, wir aber nur „künstliche TikTok-Videos“ bekommen haben, was die Unzufriedenheit über die große Diskrepanz zwischen den tatsächlichen Anwendungen von AI und den ursprünglichen Erwartungen zum Ausdruck bringt. (Quelle: pmddomingos)

Satire über Anthropic’s Alignment-Forschung : Ein satirischer Kommentar zu Anthropic’s „Alignment“-Forschung, der Forscher beschreibt, die Modelle „reinen Schmerz“ erleben lassen, um die Ursachen von Zusammenbrüchen zu isolieren, was auf die Strenge und potenzielle ethische Probleme der Alignment-Forschung hindeutet. (Quelle: Teknium1)

KI-generierte Audios und Datenschutz : Das Konzept der „Gaslight Garage“ wird vorgestellt, bei dem AI-generierte Audios verwendet werden, um Mobiltelefone zu „füttern“ und so die Anzeigenplatzierung zu manipulieren. Dies unterstreicht die Herausforderungen, denen der persönliche Datenschutz und die Datensicherheit im AI-Zeitalter gegenüberstehen. (Quelle: snwy_me)

Sora2 interessante Prompt-Beispiele : Interessante Prompt-Beispiele für Sora2 werden geteilt, wie „Napoleon auf dem Schlachtfeld von Austerlitz, in voller Uniform, rappt auf Französisch im Stil des Marseiller Raps der 2000er Jahre“, was das Potenzial der AI-Videogenerierung in Bezug auf Kreativität und Humor zeigt. (Quelle: doodlestein)

„Benchmark-optimiertes“ Modell und AGI : Es wird satirisch vorgeschlagen, ein „Benchmark-optimiertes“ Stealth-Modell zu veröffentlichen und zu beobachten, ob die Leute daraufhin behaupten würden, es habe AGI erreicht, um die übermäßige Abhängigkeit von Benchmarks bei der Bewertung von Modellfähigkeiten zu kritisieren. (Quelle: snwy_me)

Herausforderungen bei der Sprachinteraktion von OpenAI-Geräten : Es wird die Ansicht vertreten, dass das bildschirmlosen AI-Gerät, das OpenAI in Zusammenarbeit mit Jony Ive entwickelt, scheitern könnte, wenn es hauptsächlich auf Sprachinteraktion angewiesen ist, was darauf hindeutet, dass die Sprachinteraktion in komplexen Szenarien immer noch Einschränkungen aufweist. (Quelle: scaling01)

Authentizität und Vertrauen in KI-Videos : Mit der zunehmenden Realitätsnähe von AI-Videotechnologien wachsen die Bedenken hinsichtlich der Authentizität von Videoinhalten und wie Vertrauen in diesem technologischen Kontext aufgebaut werden kann. (Quelle: nptacek)

Trend zur „Wutinduktion“ bei ChatGPT : In sozialen Medien ist ein Trend zur „Wutinduktion“ bei ChatGPT zu beobachten, bei dem Benutzer absichtlich provokative Fragen stellen, um die AI zu reizen. Dies löst Diskussionen über die Ethik der Mensch-AI-Interaktion und eine mögliche zukünftige „Rebellion“ der AI aus. (Quelle: nptacek)

KI-Ingenieure sind die größte Wette der Menschheit : Die Ansicht, dass AI die größte Wette der Menschheit ist, und die Prognose, dass „Frontier Deployment AI Engineers“ in den nächsten zehn Jahren der am schnellsten wachsende Beruf sein werden, unterstreicht den tiefgreifenden Einfluss von AI auf die menschliche Zukunft und den Bedarf an Talenten. (Quelle: pmddomingos, pmddomingos)

💡 Sonstiges

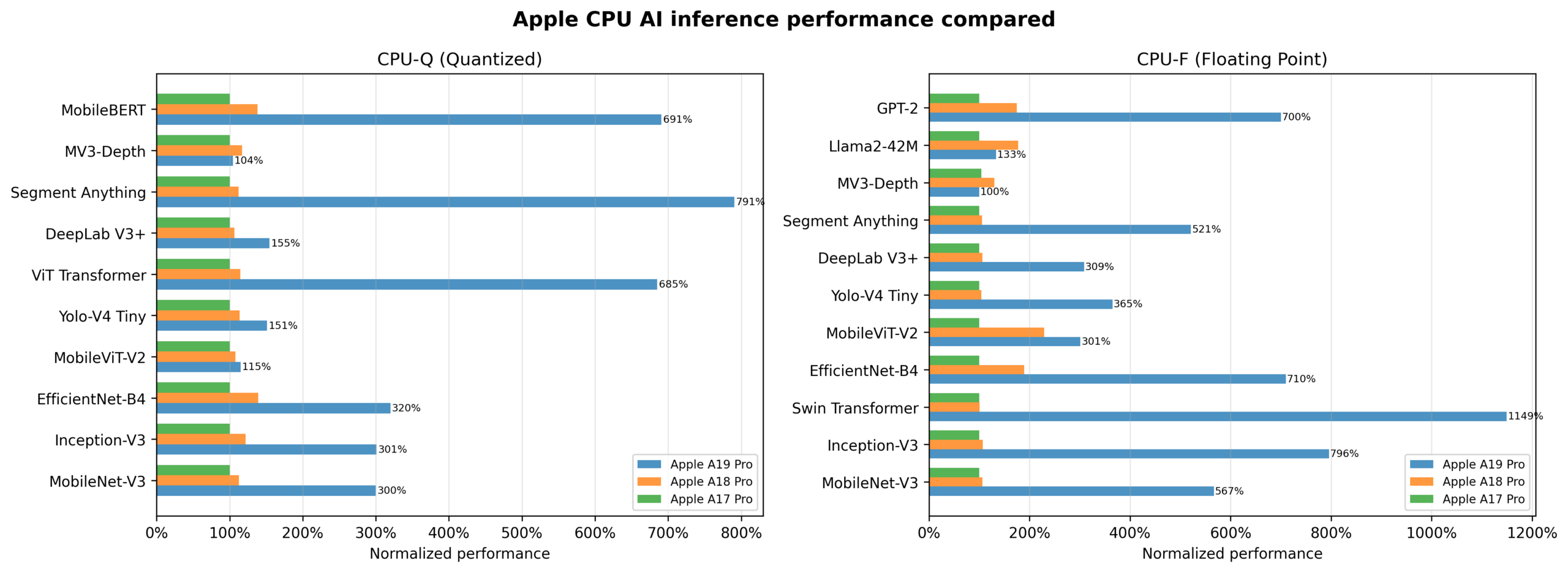

Apple A19 CPU KI-Beschleunigung : Die Apple A19 CPU-Kerne haben die AI-Beschleunigungsfähigkeiten erheblich verbessert, was darauf hindeutet, dass diese Fortschritte auch in den M5-Chips zu finden sein könnten und eine stärkere Hardware-Unterstützung für lokale AI-Anwendungen bieten werden. (Quelle: Reddit r/LocalLLaMA)

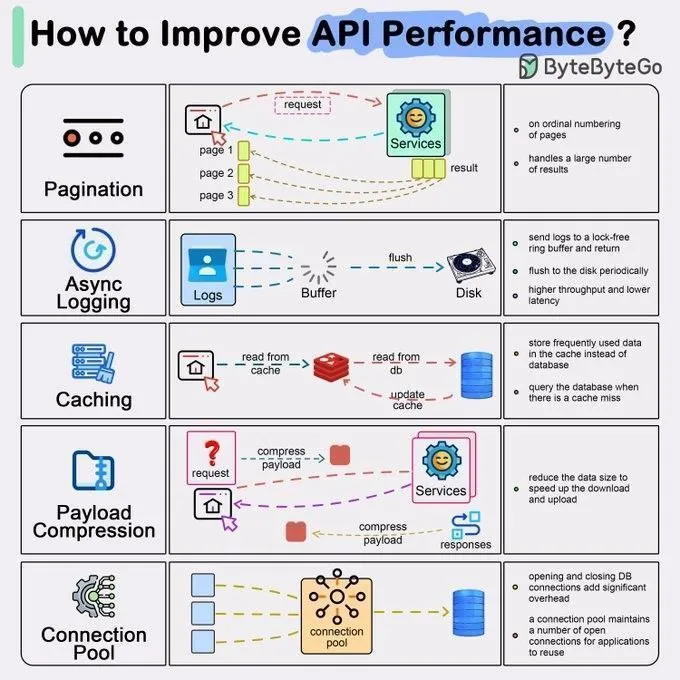

Fünf Methoden zur Verbesserung der API-Leistung : Es werden fünf gängige Methoden zur Verbesserung der API-Leistung zusammengefasst. Diese Techniken sind entscheidend für die Stabilität und Effizienz von AI-Diensten und umfassen die Optimierung der Datenübertragung, Caching-Strategien, parallele Verarbeitung und mehr. (Quelle: Ronald_vanLoon)

Beliebte Tools für Cybersicherheit : Eine Liste der Top-Tools im Bereich Cybersicherheit, die Unternehmen und Einzelpersonen als Referenz dienen, um den immer komplexer werdenden Cyberbedrohungen zu begegnen. Dazu könnten auch AI-gesteuerte Sicherheitslösungen gehören. (Quelle: Ronald_vanLoon)