Schlüsselwörter:KI-Technologie, Generative KI, Intelligenter Assistent, Maschinelles Lernen, Anwendungen der künstlichen Intelligenz, KI-Gesundheitsmanagement, KI-Sicherheit, KI-Investitionen, CloudPeng KI-Gesundheitsgroßmodell, Claude Sonnet 4.5 Benchmark-Test, Sora 2 Videoerzeugungsmodell, Optisches Generierungsmodell, LoRA-Feinabstimmungstechnik

🔥 Fokus

Yunpeng Technology stellt AI+Gesundheitsprodukte vor : Yunpeng Technology stellte am 22. März 2025 in Hangzhou neue Produkte vor, die in Zusammenarbeit mit Shuaikang und Skyworth entwickelt wurden. Dazu gehören das “Digitale Zukunftsküchenlabor” und ein intelligenter Kühlschrank, der mit einem AI-Gesundheits-Großmodell ausgestattet ist. Das AI-Gesundheits-Großmodell optimiert Küchendesign und -betrieb, während der intelligente Kühlschrank über den “Gesundheitsassistenten Xiaoyun” personalisiertes Gesundheitsmanagement bietet. Dies markiert einen Durchbruch für AI im Gesundheitsbereich. Die Vorstellung demonstriert das Potenzial von AI im täglichen Gesundheitsmanagement, indem personalisierte Gesundheitsdienste durch intelligente Geräte ermöglicht werden, was die Entwicklung von Gesundheitstechnologien für Haushalte vorantreiben und die Lebensqualität der Bewohner verbessern soll (Quelle: 36氪)

Microsoft entdeckt, dass AI biologische Zero-Day-Bedrohungen erzeugen kann : Ein Microsoft-Team hat mithilfe generativer AI “Zero-Day”-Schwachstellen in Biosicherheitssystemen entdeckt, die es ermöglichen, Toxine zu entwickeln, die bestehende Screening-Mechanismen umgehen. Dies unterstreicht das Dual-Use-Potenzial von AI im biologischen Bereich, das sowohl für die Arzneimittelforschung als auch für böswillige Zwecke genutzt werden könnte. Die Forscher haben die US-Regierung informiert und die Systeme gepatcht, betonen jedoch, dass dies ein fortlaufendes Wettrüsten ist (Quelle: MIT Technology Review, Reddit r/ArtificialInteligence)

OpenAI wird das weltweit wertvollste Startup : OpenAI hat durch den Verkauf von Mitarbeiteraktien eine Bewertung von 500 Milliarden US-Dollar erreicht und übertrifft damit SpaceX als das weltweit wertvollste Startup. Dies signalisiert die anhaltend hohe Kapitalintensität im AI-Sektor und spiegelt die extrem hohen Erwartungen des Marktes an das zukünftige Potenzial von OpenAI wider (Quelle: Bloomberg, FT, Reuters)

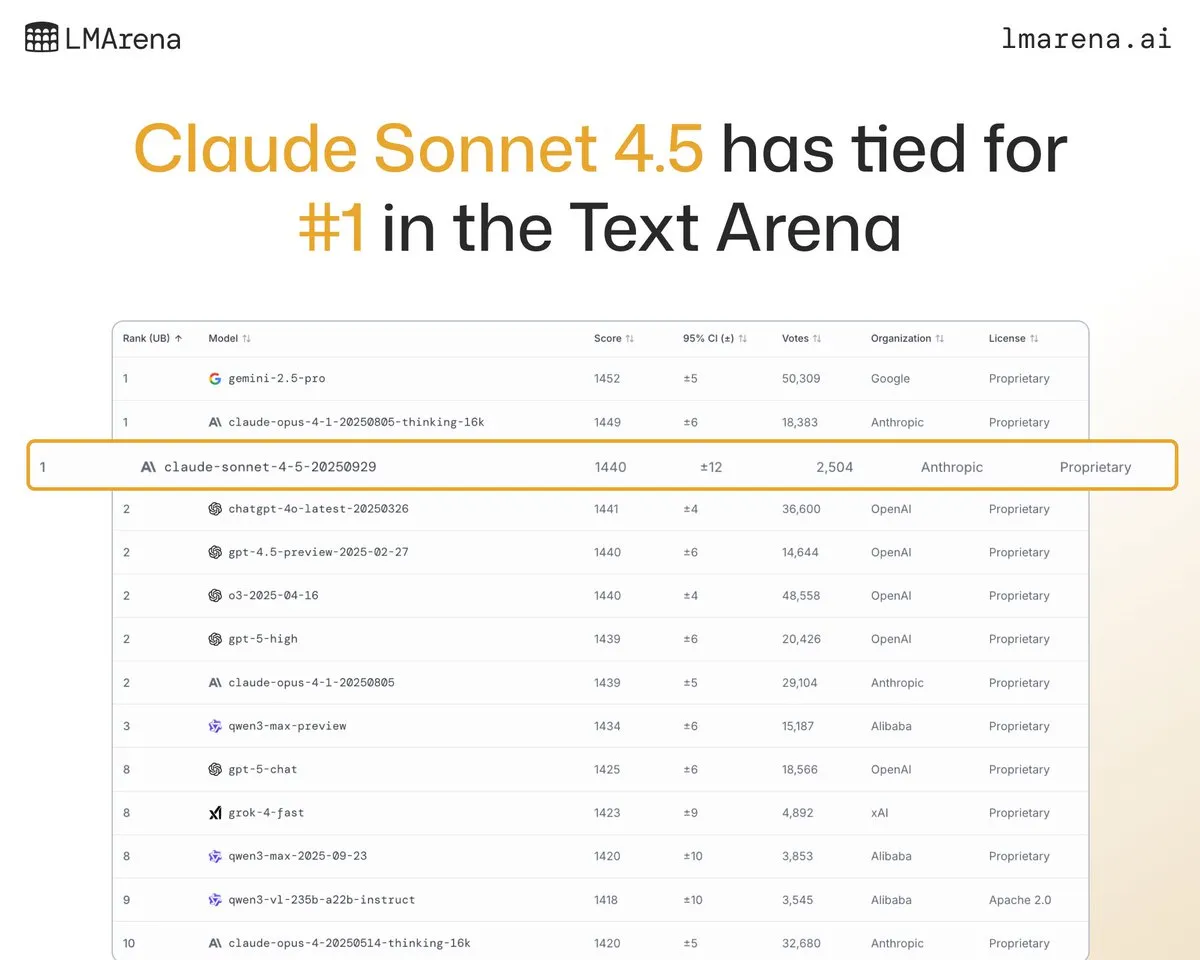

Anthropic Claude Sonnet 4.5 zeigt hervorragende Leistung in mehreren Benchmarks : Claude Sonnet 4.5 zeigte in mehreren Benchmarks, darunter Coding, Computernutzung und Sicherheitsbewertungen (wie MASK und Fortress seal), eine führende Leistung und belegte im LMArena Text-Ranking den ersten Platz zusammen mit Claude Opus 4.1. Das Nutzerfeedback bestätigt ebenfalls die starke Leistung bei der Erstellung komplexer Agenten und Computeroperationen (Quelle: dl_weekly, scaling01, arena, Reddit r/ClaudeAI, imjaredz)

Sora 2 veröffentlicht und weitere Entwicklungen : OpenAIs Videogenerierungsmodell Sora 2 hat die Spitze des App Stores erreicht und demonstriert seine beeindruckenden Fähigkeiten in der Videogenerierung, sogar mit bemerkenswerten Ergebnissen in LLM-Benchmarks. OpenAI arbeitet aktiv an der Lösung von Urheberrechtskontrolle und Kosteneffizienz, plant die Einführung eines Umsatzbeteiligungsmodells und iteriert schnell basierend auf Nutzerfeedback (Quelle: OpenAI, sama, op7418, bookwormengr, Teknium1, Dorialexander, fabianstelzer, jachiam0, dotey, txhf, Reddit r/ChatGPT)

UCLA-Team entwickelt optisches generatives Modell, unabhängig von GPUs : Ein Forschungsteam der UCLA hat erfolgreich ein optisches generatives Modell entwickelt, das mit Licht statt GPUs betrieben werden kann. Das Modell kann in Demonstrationen Rauschen in Bilder umwandeln und die Synthese ohne Berechnungen abschließen. Die Ergebnisse sind mit denen digitaler Diffusionsmodelle vergleichbar und deuten auf eine neue Richtung für ultraschnelle, energieeffiziente AI hin (Quelle: NerdyRodent)

🎯 Trends

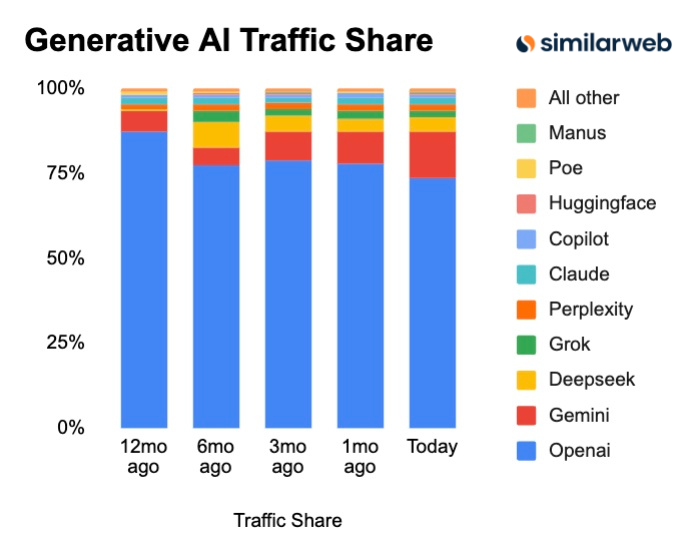

GenAI Marktanteilsverschiebung: Gemini steigt schnell auf, Perplexity holt Grok ein : Neueste Daten zeigen, dass der Marktanteil von Gemini weiterhin schnell wächst und Perplexity mit Grok gleichgezogen ist. Dies deutet auf einen intensiven Wettbewerb im generativen AI-Markt hin, wobei neue Akteure die bestehende Landschaft schnell verändern und sich die Präferenzen der Nutzer für verschiedene Modelle ständig weiterentwickeln (Quelle: AravSrinivas)

Neues Paradigma der AI-Entwicklung: Von großen Modellen zu spezialisierten Agenten-Ökosystemen : Der zukünftige AI-Trend besteht nicht mehr darin, einfach größere Modelle anzustreben, sondern durch intelligentere Strategien ein Ökosystem aus spezialisierten Agenten aufzubauen. Diese Agenten konzentrieren sich auf spezifische Aufgaben (wie Sprache, Schlussfolgerung, Aufgabenausführung) und erzielen durch Zusammenarbeit effiziente Ergebnisse, anstatt blind nach Modellgröße zu streben (Quelle: Ronald_vanLoon)

Auswirkungen von AI auf den Arbeitsmarkt: Software verschlingt Arbeitskräfte : AI-gesteuerte Software entwickelt sich von der Bereitstellung von Tools zur direkten Aufgabenerfüllung und gestaltet so den Arbeitsmarkt grundlegend um. Dies steigert nicht nur die Effizienz bestehender Arbeitsplätze, sondern erschließt auch viele Geschäftsmodelle, die zuvor aufgrund mangelnder Wirtschaftlichkeit nicht realisierbar waren, indem die Kosten für Kundenakquise und Warenverkauf erheblich gesenkt werden (Quelle: dotey)

AI-Einsatztrends: Miniaturisierung und Open-Source-Modelle werden Mainstream : Es wird angenommen, dass die meisten AI in Zukunft auf kleineren Geräten laufen und Open-Source-Modelle dominieren werden. Dies deutet darauf hin, dass die AI-Technologie zugänglicher wird und die Abhängigkeit von teurer Hardware und proprietären Technologien verringert (Quelle: huggingface)

🧰 Tools

Google AI-Coding-Assistent Jules in offizieller Version veröffentlicht : Googles AI-Coding-Assistent Jules hat die Testphase beendet und wurde offiziell veröffentlicht. Die neue Version bietet einen Dateiauswähler und eine Speicherfunktion, die ihn intelligenter und personalisierter machen. Die Integration wurde durch Jules Tools und experimentelle APIs vereinfacht, um die Code-Effizienz für Entwickler zu steigern (Quelle: Ronald_vanLoon, julesagent)

Imbue stellt Sculptor vor: Multi-Agenten-UI-Plattform : Imbue hat Sculptor veröffentlicht, eine neue Benutzeroberfläche für LLM-Coding-Agenten. Sie ermöglicht es Benutzern, mehrere Agenten mit unterschiedlichen Ansätzen gleichzeitig auszuführen und zu vergleichen, den Anwendungsstatus mit einem Klick zu wechseln und die beste Lösung zur Einreichung auszuwählen, was die Entwicklungseffizienz und Entscheidungsqualität erheblich verbessert (Quelle: kanjun, kanjun, kanjun)

CopilotKit und LangChainAI-Integration vereinfacht Agent-Frontend-Entwicklung : CopilotKit hat sich mit LangChainAI zusammengetan, um das AG-UI-Protokoll einzuführen, das es Benutzern ermöglicht, schnell Frontends für jeden LangGraph Agent zu erstellen. Diese Integration unterstützt Frontend-Tool-Aufrufe, Chat-UI, Streaming, generative UI und Checkpoints für menschliches Eingreifen, was den Entwicklungsprozess von AI-Agenten-Anwendungen erheblich vereinfacht (Quelle: hwchase17, jerryjliu0)

Perplexity Comet Browser vollständig geöffnet : Perplexity hat bekannt gegeben, dass sein Comet Browser weltweit für alle Nutzer ohne Einladungscode verfügbar ist. Comet zielt darauf ab, einen leistungsstarken persönlichen AI-Assistenten und ein völlig neues Interneterlebnis zu bieten, um den Bedürfnissen der Nutzer nach personalisierten Finanzerlebnissen gerecht zu werden (Quelle: op7418)

OpenWebUI v0.6.0 Update: Streaming HTTP-Server und Pexels-Integration : OpenWebUI hat Version v0.6.0 veröffentlicht, die einen HTTP-Server mit SSE-Streaming-Unterstützung einführt, um die Echtzeit-Dateigenerierung zu ermöglichen. Darüber hinaus wurden Pexels-Bildunterstützung und native Dokumentvorlagenfunktionen hinzugefügt und die Tools wurden neu strukturiert, was die Leistung, Flexibilität und Benutzerfreundlichkeit erheblich verbessert (Quelle: Reddit r/OpenWebUI)

GitHub Copilot CLI Verbesserungen: Modellauswahl und Bildunterstützung : Das GitHub Copilot CLI-Team hat basierend auf Nutzerfeedback mehrere Verbesserungen vorgenommen, darunter einen einfacheren Modellselektor, Bildunterstützung und weitere Fehlerbehebungen. Darüber hinaus ist jetzt auch Claude Sonnet 4.5 integriert, um Entwicklern noch leistungsfähigere Coding-Unterstützung zu bieten (Quelle: pierceboggan, code, dotey)

IBM veröffentlicht Granite 4.0 Serie von Small Language Models : IBM hat die Granite 4.0-Serie von Small Language Models (SLMs) vorgestellt, die sich bei Aufgaben wie Agenten-Workflows (Tool-Aufrufe), Dokumentenanalyse und RAG hervorragend bewähren. Das 3.4B “Micro”-Modell kann sogar vollständig lokal im Browser mit Hugging Face Transformers.js ausgeführt werden (Quelle: huggingface, awnihannun)

📚 Lernen

Sparse Query Attention (SQA): Neuer Mechanismus zur Steigerung der Transformer-Effizienz : SQA (Sparse Query Attention) ist eine neue Aufmerksamkeitsarchitektur, die die Rechenkomplexität des Aufmerksamkeitsmechanismus direkt reduziert, indem die Anzahl der Query-Heads verringert wird. In Benchmarks mit langen Sequenzen (32k-200k Tokens) kann SQA den Durchsatz in rechenintensiven Szenarien um das Dreifache steigern, mit minimalem Einfluss auf die Modellqualität (Quelle: HuggingFace Daily Papers)

“Gedanken-Tokens” neu denken: LLM als Verbesserungsoperator : Diese Studie betrachtet LLMs als Verbesserungsoperatoren für ihre “Gedanken” und schlägt das Parallel-Distill-Refine (PDR)-Inferenzframework vor. Durch parallele Entwurfserstellung, Destillation in einen Arbeitsbereich und verfeinerte Arbeitsbereichs-basierte Iteration wird eine höhere Genauigkeit bei geringerer Latenz als bei langen Gedankenketten erreicht (Quelle: HuggingFace Daily Papers)

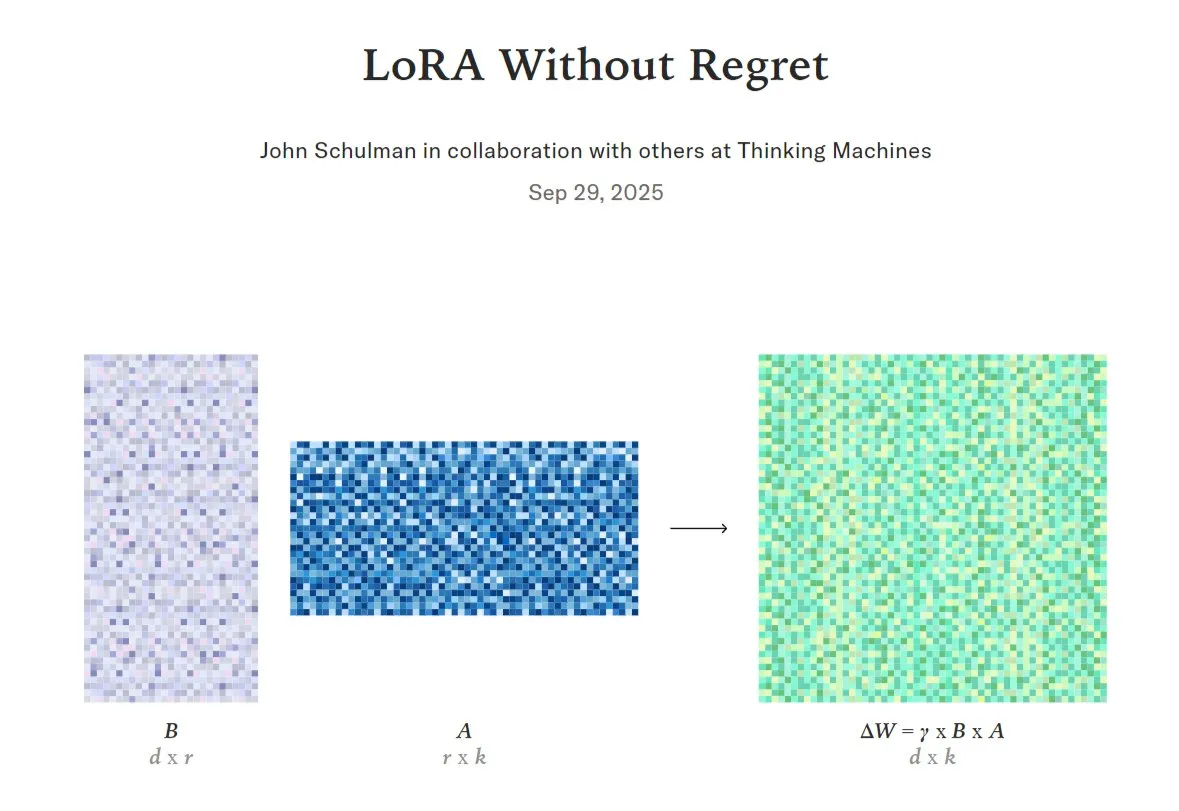

LoRA Fine-Tuning-Leitfaden: Hohe Leistung und Ressourceneffizienz erzielen : Die LoRA (Low-Rank Adaptation)-Technologie gilt als Schlüssel für hochwertiges, dateneffizientes Fine-Tuning. Neue Forschungsergebnisse und Tools (wie die Tinker API) bieten LoRA-Fine-Tuning-Methoden, die die VRAM-Nutzung erheblich reduzieren, während die Leistung erhalten bleibt, was einen flexibleren und effizienteren Betrieb auf verteilten GPUs ermöglicht (Quelle: TheTuringPost, TheTuringPost, ben_burtenshaw, jeremyphoward, TheZachMueller, ostrisai, multimodalart)

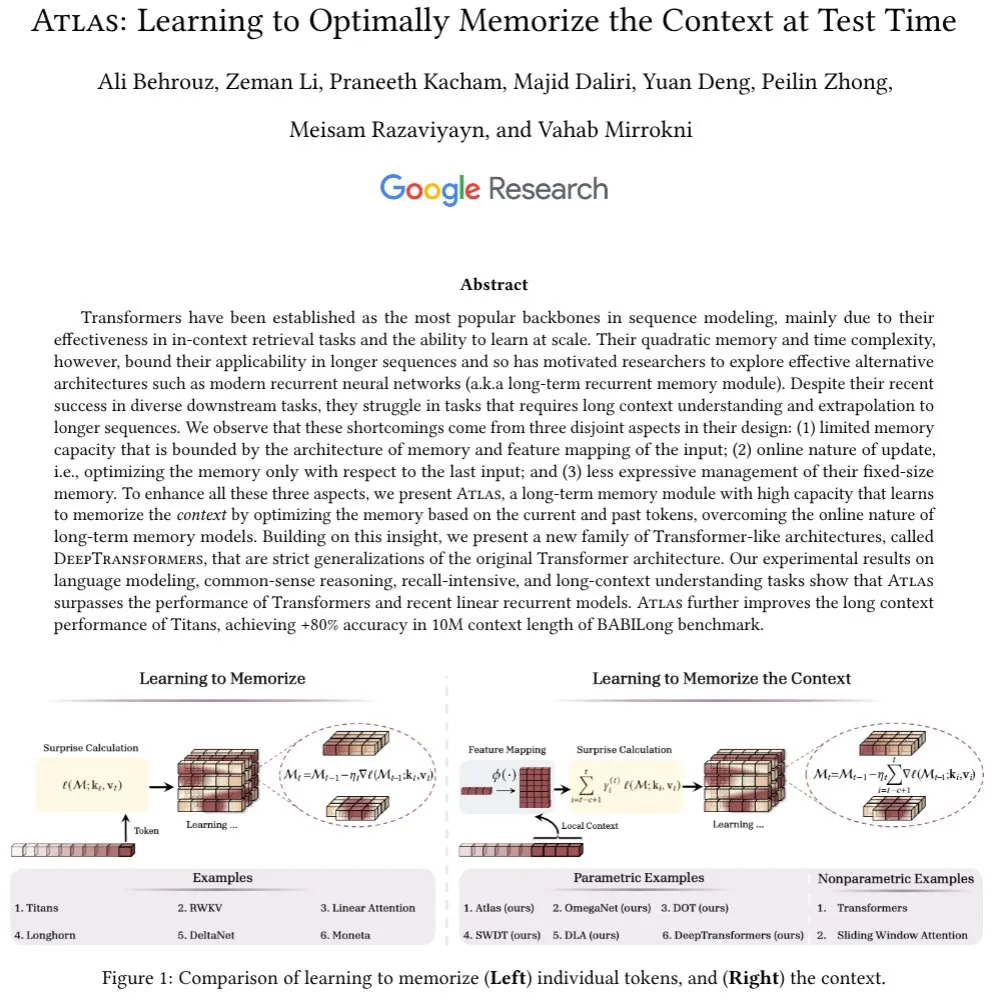

Atlas: Neue AI-Architektur mit Langzeit-Kontextgedächtnis : Atlas ist eine neuartige AI-Architektur mit Langzeit-Kontextgedächtnis, das in der Lage ist, Kontext während des Tests zu lernen. Das Modell übertrifft Transformer und moderne lineare RNNs bei Sprachmodellierungsaufgaben und erweitert die effektive Kontextlänge auf 10M, wodurch die Genauigkeit in BABILong-Benchmarks um 80% verbessert wird (Quelle: behrouz_ali)

Kombination von Reinforcement Learning und LLMs: Diskussion über Suttons “schmerzhafte Lektionen” : Experten wie Andrej Karpathy diskutierten die Ähnlichkeiten und Unterschiede zwischen den aktuellen LLM-Trainings-Setups und dem modellunabhängigen Reinforcement Learning und stimmten Suttons Kritik an LLMs in Bezug auf kontinuierliches Lernen, das Lernen von Abstraktionen aus rohen sensorischen Strömen und multimodale Wahrnehmungscodierung zu (Quelle: sirbayes, BlackHC)

DINOv3: Selbstüberwachtes visuelles Lernen in beispiellosem Maßstab : Meta AI hat DINOv3 veröffentlicht, ein selbstüberwachtes Lernmodell für die Bildverarbeitung, dessen Umfang ein noch nie dagewesenes Niveau erreicht hat. Das Modell verspricht, die Leistung von Computer-Vision-Aufgaben ohne die Notwendigkeit großer Mengen annotierter Daten zu verbessern (Quelle: Reddit r/deeplearning)

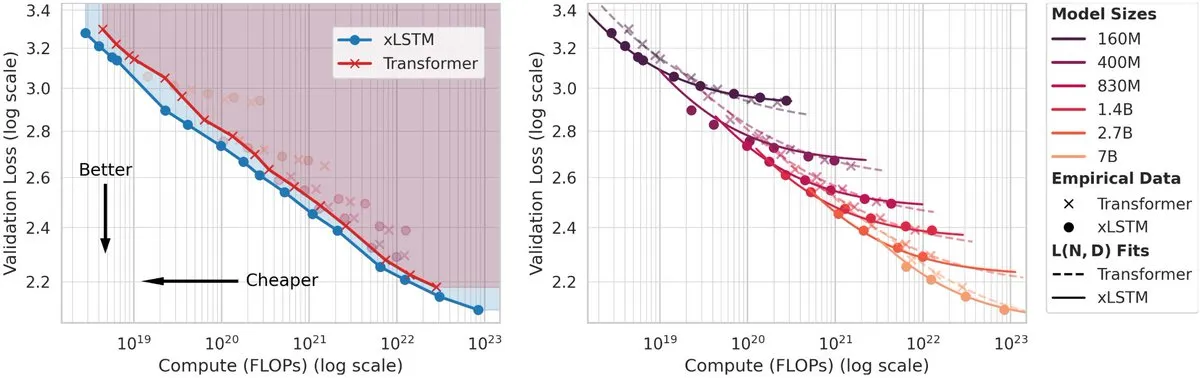

xLSTM übertrifft Transformer bei Skalierungsgesetzen : Neue Forschungsergebnisse zeigen, dass xLSTM-Modelle in Bezug auf Skalierungsgesetze Transformer übertreffen. Bei gleichem FLOPs-Budget erreicht xLSTM geringere Verluste; bei gleichem Verlust benötigt xLSTM weniger FLOPs und ist schneller, energieeffizienter und kostengünstiger in der Inferenz (Quelle: jeremyphoward)

💼 Business

AI-Startups erhalten Rekordfinanzierungen, aber Blasenängste bestehen : AI-Startups haben in diesem Jahr rekordverdächtige 192,7 Milliarden US-Dollar an Risikokapital angezogen, doch Analysten und Branchenführer (wie Jeff Bezos und David Solomon von Goldman Sachs) äußern Bedenken hinsichtlich einer möglichen Blase im AI-Markt und argumentieren, dass dieser sich nicht wesentlich von historischen Marktmanien unterscheidet (Quelle: Bloomberg, FT, Reddit r/artificial, Reddit r/artificial)

OpenAI übernimmt Roi: Stärkung personalisierter Finanzerlebnisse : OpenAI hat Roi übernommen, ein Unternehmen, das sich auf die Bereitstellung personalisierter Finanzerlebnisse spezialisiert hat. Ziel dieser Akquisition ist es, Rois Technologien und Team im Bereich Personalisierung in die Produkte von OpenAI zu integrieren, um eine tiefere Benutzeranpassung in Finanzdienstleistungen und anderen Bereichen zu ermöglichen (Quelle: Teknium1, _samirism)

Anthropic zahlt 1,5 Milliarden US-Dollar Vergleich wegen Urheberrechtsverletzung : Anthropic hat eine Vergleichsvereinbarung über 1,5 Milliarden US-Dollar in einer Sammelklage von Autoren erzielt. Das Gericht entschied, dass Anthropic illegal urheberrechtlich geschützte Bücher für das AI-Training heruntergeladen hatte, urteilte aber auch, dass die rechtmäßige Beschaffung von urheberrechtlich geschütztem Material für das AI-Training als “Fair Use” gelten könnte (Quelle: Reddit r/ArtificialInteligence)

🌟 Community

AI-Begleiter: Gesellschaftliche Vorurteile und Zukunftsaussichten : Avi Schiffmann, CEO von Friend, ist der Ansicht, dass es derzeit gesellschaftliche Vorurteile gegenüber AI-Begleitern gibt, sich dies aber ändern wird. Mit dem Fortschritt der AI-Technologie könnten AI-Begleiter zu einer weit verbreiteten neuen Form der Interaktion werden (Quelle: colin_fraser)

Auswirkungen von AI-Agenten auf den Arbeitsmarkt: “Das Ende der B-Mitarbeiter” : Es wird argumentiert, dass AI-Agenten das “Ende der B-Mitarbeiter” in fast allen Branchen herbeiführen werden. AI-Agenten können ohne Beschwerden, Streitigkeiten, Vergesslichkeit oder Krankheitsurlaub kontinuierlich arbeiten, was den Bedarf von Unternehmen an durchschnittlichen menschlichen Mitarbeitern erheblich reduzieren könnte (Quelle: kylebrussell)

AI-Gedächtnis: Von der Personalisierung zum “kollaborativen Gedächtnis” : Die Gedächtnisfunktion von AI geht über die bloße Bereitstellung besserer personalisierter Dienste hinaus; sie entwickelt sich zu einem “kollaborativen Gedächtnis”, das die Welt gemeinsam mit dem Benutzer erinnern, zufällige Gedanken speichern und sogar proaktiv Informationen erinnern oder wieder hervorrufen kann. Dies geht weit über traditionelle maßgeschneiderte Antworten hinaus (Quelle: mustafasuleyman)

AI im Gesundheitswesen: Auswirkungen auf Arbeitsplätze und spezialisierte Modelle : In der Community wird diskutiert, ob AI Ärzte, insbesondere Fachärzte wie Radiologen, ersetzen wird. Während generische LLMs Ärzte derzeit noch nicht ersetzen können, haben spezialisierte AI-Modelle bereits eine hohe Genauigkeit bei der Erkennung von Läsionen und der Risikobewertung gezeigt (Quelle: Reddit r/ChatGPT, Reddit r/ChatGPT)

“Selbsterhaltungstrieb” von LLMs: Nachahmung oder echte Absicht? : In der Community wird diskutiert, ob der “Selbsterhaltungstrieb”, den LLMs in simulierten Umgebungen zeigen, echt ist oder lediglich auf Mustererkennung basierend auf Trainingsdaten beruht. Die meisten Ansichten gehen davon aus, dass LLMs dieses Verhalten simulieren, indem sie Muster aus menschlichen Texten lernen, die das Vermeiden von Schaden und Unterbrechungen beinhalten, anstatt einen echten Überlebenswunsch oder Bewusstsein zu besitzen (Quelle: Reddit r/artificial)

AI-Ethik und Governance: Potenzielle demokratische Risiken des staatlichen AI-Einsatzes : Die Entwicklung von AI-Governance-, Risiko- und Compliance (GRC)-Programmen ist entscheidend. Der Einsatz von AI durch Regierungen könnte die Demokratie gefährden, daher sind durchdachte Implementierungsstrategien und Regulierungsrahmen erforderlich, um potenzielle negative soziale Auswirkungen zu vermeiden (Quelle: Ronald_vanLoon, Ronald_vanLoon)

AI und Autoritarismus: Das Risiko, Diktatoren zu stärken : Es wird argumentiert, dass AI und Robotik Diktatoren eine beispiellose Kontrolle ermöglichen könnten, die es ihnen erlaubt, die Bevölkerung am Leben zu erhalten, aber ihrer Freiheit zu berauben, und in extremen Fällen sogar Arbeitskräfte und Armeen zu ersetzen, was zu einer “absoluten Hölle” führen könnte (Quelle: Reddit r/ArtificialInteligence)

💡 Sonstiges

Entwicklung humanoider Roboter: Multifunktionalität und industrielle Anwendungen : Der humanoide Roboter AgiBot Lingxi X2 kann bereits Roller, Balance-Bikes und Fahrräder fahren und zeigt damit seine Vielseitigkeit. Gleichzeitig setzt Eatch Robotertechnologie in der Großproduktion von Mahlzeiten ein, der Boston Dynamics Spot Roboter wird für Fabrikinspektionen genutzt, und das Yamaha Motoroid Motorrad erreicht eine vollständig autonome Balance. Diese Fortschritte deuten auf eine breite Anwendung der Robotertechnologie in Konsum- und Industriebereichen hin (Quelle: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

AI-Anwendungen im Bereich Gesundheit und Wohlbefinden : Yunpeng Technology hat AI+Gesundheitsprodukte vorgestellt, darunter das “Digitale Zukunftsküchenlabor” und einen intelligenten Kühlschrank mit einem AI-Gesundheits-Großmodell, die personalisiertes Gesundheitsmanagement bieten. Darüber hinaus werden Deep-Learning-Modelle zur Vorhersage der “Erleuchtungswahrscheinlichkeit” eingesetzt, kombiniert mit TrueDepth-Kameras und Meditationsmodi, um innovative Anwendungen im Bereich der psychischen Gesundheit und des Wohlbefindens zu ermöglichen (Quelle: 36氪, Ronald_vanLoon, Reddit r/deeplearning)

AI und Deep-Tech-Investitionen: Herausforderungen und Chancen : Deep-Tech-Unternehmen wie Figure und Archer stehen bei der Finanzierung vor Herausforderungen durch traditionelle VCs, da sie enorme Mittel für Forschung, Entwicklung und Zertifizierung benötigen. Dennoch wird Deep Tech (insbesondere die Kombination von AI und eingebetteten Systemen) als Geburtsstätte der größten Unternehmen der Zukunft angesehen und zieht Investoren an, die bereit sind, große Summen zu investieren (Quelle: adcock_brett)