Schlüsselwörter:OpenAI GDPval-Benchmark, Claude Opus 4.1, GPT-5, KI-Bewertung, Wirtschaftliche Aufgabenleistung, Bewertung der wirtschaftlichen Auswirkungen von KI-Modellen, Claude Opus 4.1 vs GPT-5, GDPval-Benchmark-Test, Praktische Anwendungsfähigkeit von KI, KI-Leistungsvergleich in verschiedenen Branchen

🔥 Fokus

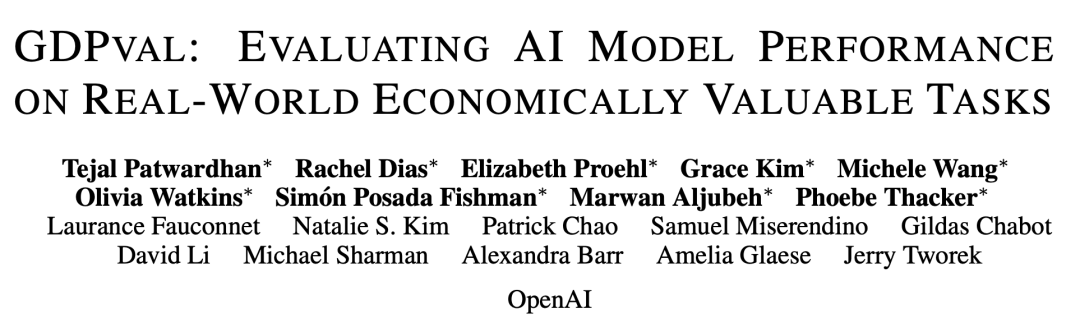

OpenAI veröffentlicht GDPval-Benchmark: Claude Opus 4.1 übertrifft GPT-5 : OpenAI hat einen neuen Benchmark namens GDPval veröffentlicht, der die Leistung von KI-Modellen bei realen wirtschaftlichen Aufgaben in 9 Branchen und 44 Berufen bewertet. Erste Ergebnisse zeigen, dass Anthropic’s Claude Opus 4.1 in fast der Hälfte der Aufgaben das Niveau menschlicher Experten erreicht oder übertrifft und damit GPT-5 überlegen ist. OpenAI räumt ein, dass Claude in ästhetischer Hinsicht herausragt, während GPT-5 bei der Genauigkeit führt. Dies markiert eine Verschiebung in der KI-Bewertung hin zur Messung der tatsächlichen wirtschaftlichen Auswirkungen und offenbart den schnellen Fortschritt der KI-Fähigkeiten. (Quelle: OpenAI, menhguin, MillionInt, _sholtodouglas, polynoamial, menhguin, aidan_mclau, sammcallister, menhguin, andy_l_jones, tokenbender, scaling01, scaling01, scaling01, scaling01, scaling01, scaling01, alexwei_, scaling01, scaling01, scaling01, gdb, teortaxesTex, snsf, dilipkay, scaling01, scaling01, jachiam0, jachiam0, sama, ClementDelangue, AymericRoucher, shxf0072, Reddit r/artificial, 36氪, 36氪, 36氪)

Die “Abwärtsspirale” von KI und Wikipedia für gefährdete Sprachen : KI-Modelle lernen Sprachen, indem sie Texte aus dem Internet crawlen, wobei Wikipedia oft die größte Online-Datenquelle für gefährdete Sprachen ist. Doch die Flut minderwertiger, von KI übersetzter Inhalte in diese kleineren Wikipedia-Versionen führt zu einer Verbreitung von Fehlern. Dies schafft einen “Garbage In, Garbage Out”-Teufelskreis, der KI-Übersetzungen dieser Sprachen unzuverlässiger machen und so den Niedergang gefährdeter Sprachen beschleunigen könnte. Die grönländische Wikipedia wurde aufgrund von “Unsinn”, der durch KI-Tools verursacht wurde, zur Schließung vorgeschlagen. Dies verdeutlicht die potenziellen negativen Auswirkungen von KI auf die kulturelle Vielfalt und den Spracherhalt. (Quelle: MIT Technology Review, MIT Technology Review)

OpenAI-Spitzenforscher Yang Song wechselt zu Meta : Yang Song, Leiter des Strategic Exploration Teams bei OpenAI und ein wichtiger Mitwirkender an Diffusionsmodellen, ist zu Metas MSL-Team gewechselt und berichtet dort an Chief Scientist Shengjia Zhao. Yang Song ist ein Wunderkind, das mit 16 Jahren an der Tsinghua-Universität aufgenommen wurde. Bei OpenAI wurde er für seine Arbeit an Konsistenzmodellen und anderen Errungenschaften bekannt und gilt in der Branche als eines der “brillantesten Köpfe”. Dieser Wechsel ist ein weiteres bedeutendes Ereignis in Metas anhaltender Abwerbung von OpenAI-Talenten und hat in der Branche Besorgnis über den Wettbewerb um KI-Talente und die Forschungsrichtungen ausgelöst. (Quelle: 36氪, dotey, jeremyphoward, teortaxesTex)

China Telecom Tianyi AI veröffentlicht hochwertigen Datensatz mit über 10 Billionen Tokens : China Telecom Tianyi AI hat einen allgemeinen Large Language Model-Korpusdatensatz mit einer Gesamtgröße von 350 TB und über 10 Billionen Tokens sowie spezialisierte Datensätze für 14 Schlüsselindustrien veröffentlicht. Dieser Datensatz wurde sorgfältig annotiert und optimiert, enthält multimodale Industriedaten und zielt darauf ab, die Leistung und Generalisierungsfähigkeit von KI-Modellen zu verbessern. China Telecom betont, dass hochwertige Datensätze der zentrale Treibstoff für die KI-Entwicklung sind, und baut auf der Xingchen MaaS-Plattform einen “Daten-Modell-Dienst”-Kreislauf auf. Das Unternehmen engagiert sich für die Förderung der inklusiven KI-Entwicklung und der lokalen Innovation und hat bereits ein Trillionen-Parameter-Modell erfolgreich trainiert. (Quelle: 量子位)

China Guoxing Aerospace erreicht weltweit ersten kommerziellen Regelbetrieb eines Weltraum-Computing-Konstellation : China Guoxing Aerospace hat erfolgreich eine Weltraum-Computing-Konstellation gestartet und deren kommerziellen Regelbetrieb realisiert, was den Übergang von “machbar” zu “nutzbar” im Weltraum-Computing markiert. Die Konstellation besteht aus den ersten “Xingsuan”-Satelliten und zielt darauf ab, eine weltraumgestützte Recheninfrastruktur aus 2800 Rechensatelliten mit einer Gesamtleistung von über 100.000 P zu schaffen, die den Betrieb von Modellen mit Milliarden von Parametern unterstützt. Der erfolgreiche Einsatz eines Straßenerkennungsmodells auf einem Satelliten im Orbit, der den gesamten Prozess von der Bildaufnahme über die Modellinferenz bis zur Ergebnisübertragung abdeckt, markiert den ersten Einsatz eines Algorithmus für den Verkehrssektor im Weltraum und bietet ein neues Paradigma für die räumliche Erweiterung der globalen KI-Infrastruktur. (Quelle: 量子位)

China beschränkt den Kauf von Nvidia-Chips und beschleunigt die Halbleiter-Autarkie : China hat großen Technologieunternehmen den Kauf von Nvidia-Chips untersagt. Dieser Schritt deutet darauf hin, dass China im Halbleiterbereich ausreichende Fortschritte gemacht hat, um die Abhängigkeit von in den USA entwickelten Chips zu überwinden. Dies unterstreicht die Anfälligkeit der USA bei der Halbleiterfertigung in Taiwan und die wachsende Autarkiefähigkeit Chinas. Zum Beispiel wurde das DeepSeek-R1-Safe Modell auf 1000 Huawei Ascend Chips trainiert. Jensen Huang von Nvidia wies auch darauf hin, dass 50% der weltweiten KI-Forscher aus China stammen. (Quelle: AndrewYNg, Plinz)

🎯 Trends

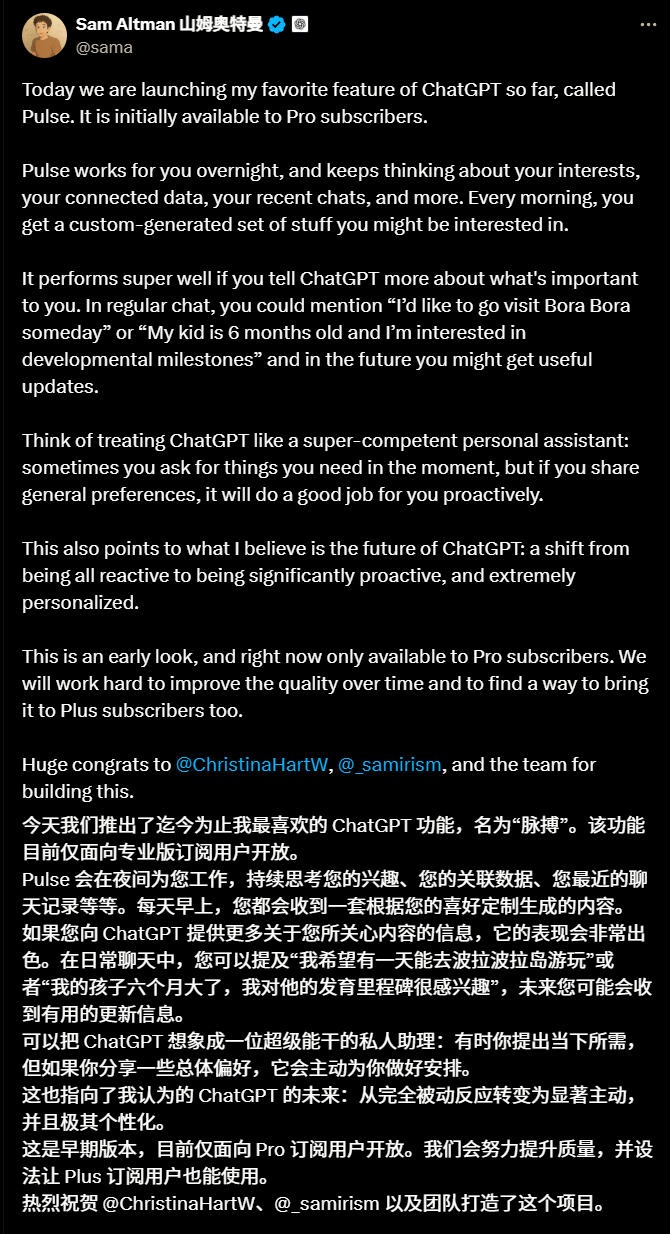

ChatGPT Pulse gestartet, läutet Ära der proaktiven Intelligenz ein : OpenAI hat eine Vorschauversion von ChatGPT Pulse für Pro-Benutzer veröffentlicht. Diese Funktion verwandelt ChatGPT von einem passiven Frage-Antwort-Tool in einen proaktiven intelligenten Assistenten. Pulse generiert im Hintergrund personalisierte tägliche Briefings in Form von Karten, basierend auf Benutzer-Chatverläufen, Feedback und verbundenen Anwendungen (wie Kalender, Gmail). Ziel ist es, ein zielgerichtetes, nicht-süchtig machendes Informationserlebnis zu bieten. Sam Altman bezeichnete es als seine “Lieblingsfunktion” und deutet an, dass ChatGPT in Zukunft stärker auf hochgradig personalisierte und proaktive Dienste ausgerichtet sein wird. (Quelle: Teknium1, openai, dejavucoder, natolambert, gdb, jam3scampbell, jam3scampbell, scaling01, sama, sama, scaling01, nickaturley, kevinweil, dotey, raizamrtn, BlackHC, op7418, 36氪, 36氪, 36氪, 36氪, 量子位)

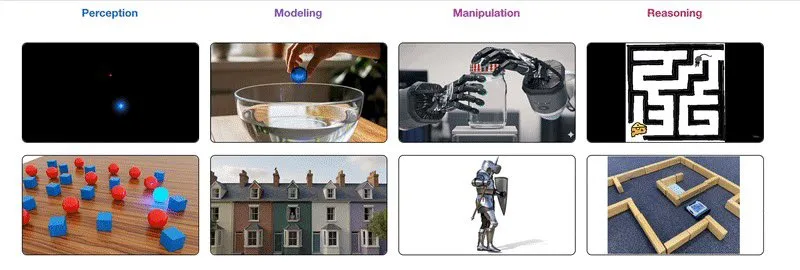

Google veröffentlicht Gemini Robotics 1.5 Serie, ermöglicht ‘artenübergreifendes’ Lernen für Roboter : Google DeepMind hat die Gemini Robotics 1.5 Modellreihe (einschließlich Gemini Robotics 1.5 und Gemini Robotics-ER 1.5) veröffentlicht, die darauf abzielt, Robotern stärkere “Denken-vor-Handeln”-Fähigkeiten und das Lernen über verschiedene Verkörperungsformen hinweg zu ermöglichen. Gemini Robotics-ER 1.5 fungiert als “Gehirn” für Planung und Entscheidungsfindung, während Gemini Robotics 1.5 als “Kleinhirn” die Aktionen ausführt; beide arbeiten synergetisch zusammen. Diese Modellreihe zeigt herausragende Leistungen im Bereich des verkörperten Denkens und des verkörperungsübergreifenden Lernens, indem sie gelernte Aktionen von einem Roboter auf einen anderen übertragen kann, was die Entwicklung von Universalrobotern vorantreiben könnte. (Quelle: Teknium1, nin_artificial, dejavucoder, crystalsssup, scaling01, jon_lee0, BlackHC, Google, demishassabis, shaneguML, demishassabis, JeffDean, 36氪, 36氪)

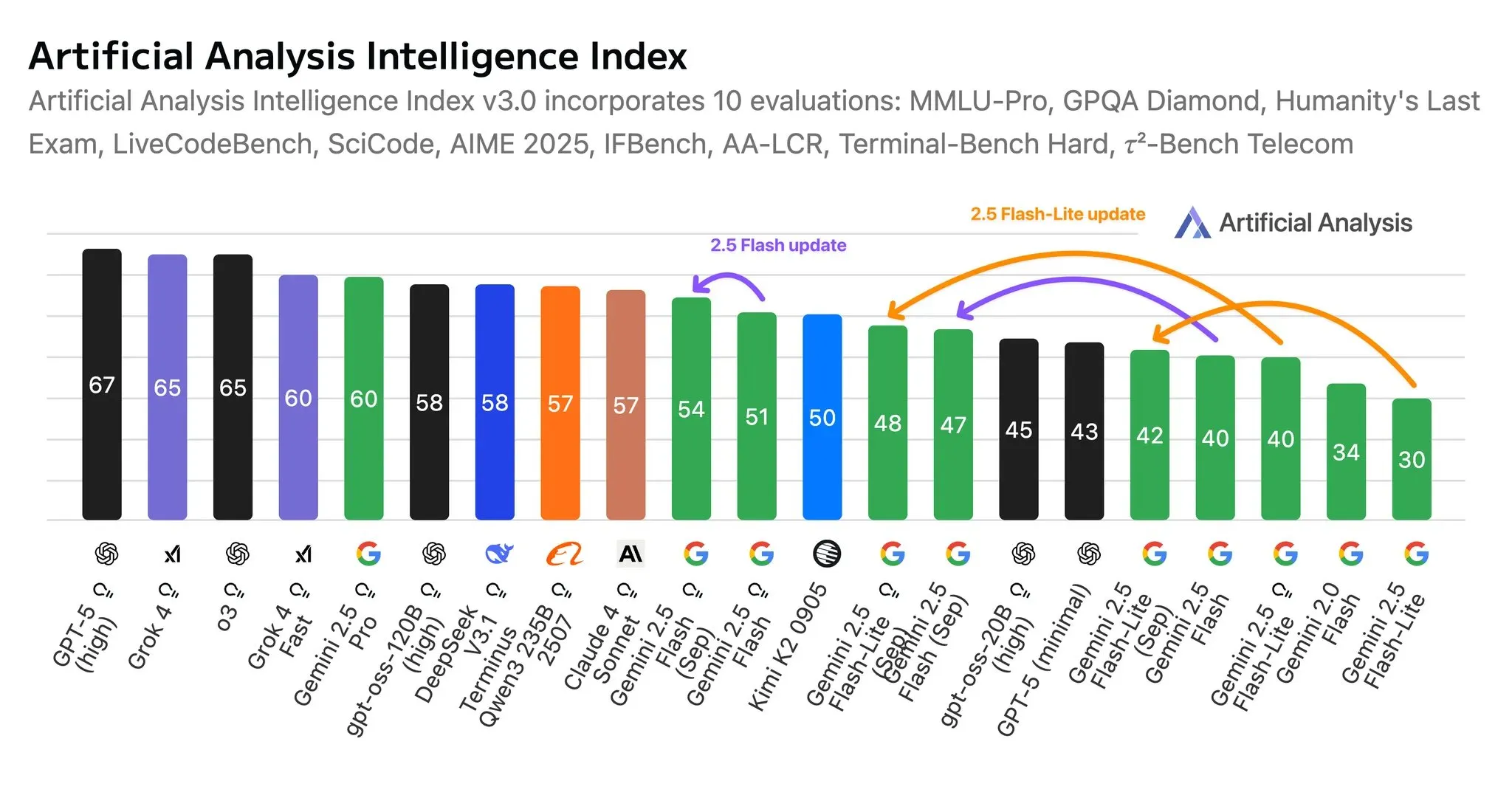

Google veröffentlicht Updates für die Gemini 2.5 Flash Modellreihe : Google hat die neuesten Updates für die Gemini 2.5 Flash und Flash-Lite Modelle veröffentlicht, die Verbesserungen in Intelligenz, Kosteneffizienz und Token-Effizienz aufweisen. Flash-Lite verbesserte seinen Intelligenzindex im Inferenzmodus um 8 Punkte und im Nicht-Inferenzmodus um 12 Punkte, ist zudem Token-effizienter und bietet schnellere Inferenzgeschwindigkeiten. Diese Updates führen zu einer besseren Leistung der Modelle bei der Befolgung von Anweisungen, dem multimodalen Verständnis und der Übersetzung, wobei die Flash-Modelle effizienter bei der Nutzung von Agent-Tools sind. (Quelle: scaling01, osanseviero, Google, osanseviero, andrew_n_carr)

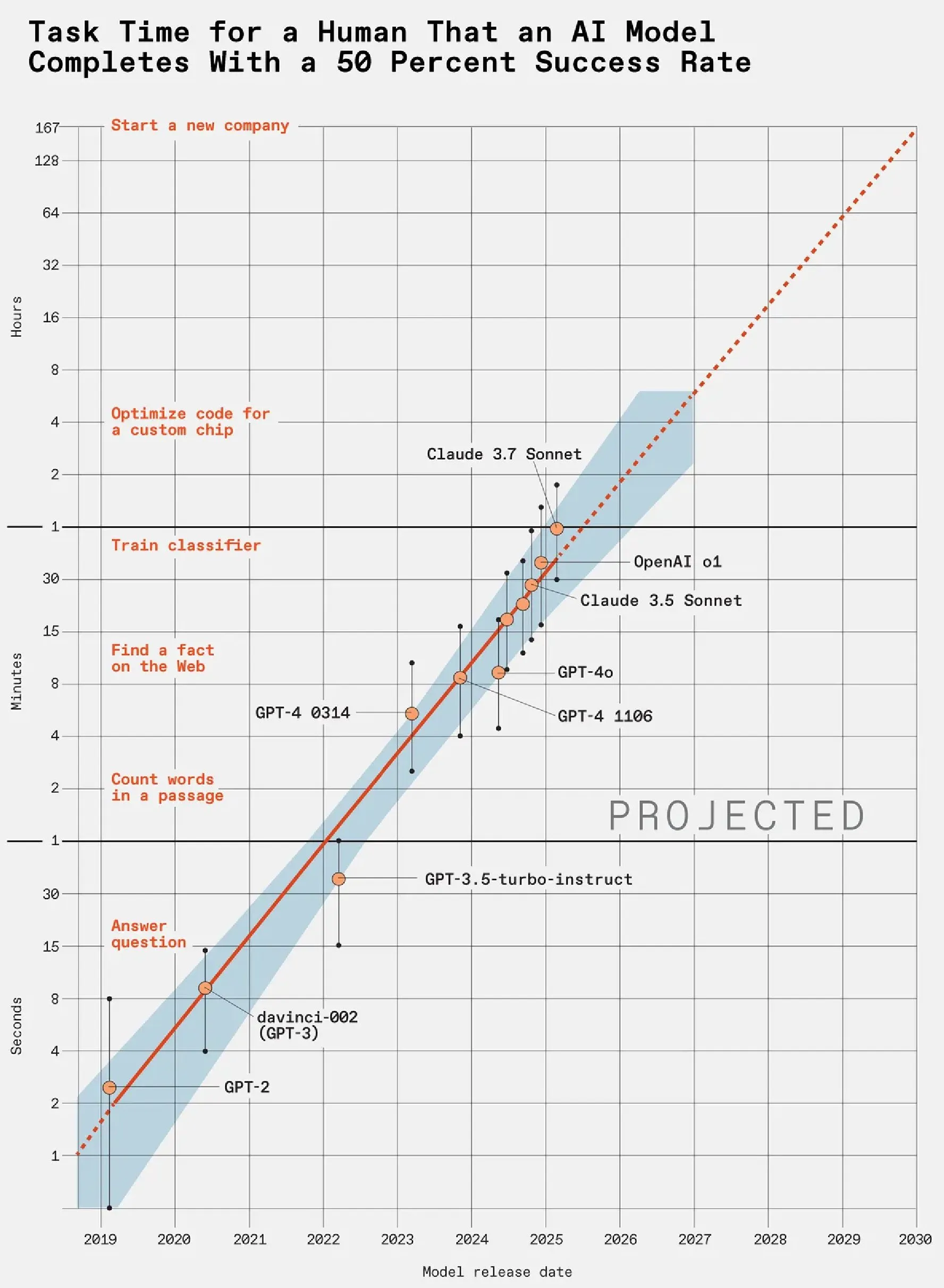

KI-Fähigkeiten steigen rasant, LLM-Leistung verdoppelt sich alle 7 Monate : Eine von METR veröffentlichte LLM-Benchmark-Studie zeigt, dass sich die LLM-Fähigkeiten alle 7 Monate verdoppeln, gemessen an der Zeit, die LLMs für die Erledigung menschlicher Aufgaben benötigen. GPT-5 kann bereits komplexe Aufgaben, für die Menschen Stunden benötigen, stabil erledigen. Nach diesem Trend könnten LLMs bis 2030 Arbeiten bewältigen, für die Menschen ein ganzes Jahr bräuchten, wie zum Beispiel die Gründung neuer Unternehmen. Dies deutet auf eine disruptive Wirkung der KI auf den Arbeitsmarkt in den kommenden Jahren hin. (Quelle: karminski3)

Videomodelle zeigen Potenzial für allgemeine visuelle Intelligenz : Videomodelle erleben ihren “GPT-Moment” und zeigen allgemeine Fähigkeiten, die von einfacher Wahrnehmung bis hin zu visuellem Denken reichen. Modelle wie Veo3 verfügen bereits über Zero-Shot-Fähigkeiten und können komplexe Aufgaben im visuellen Stack lösen. Studien zeigen, dass Videomodelle universelle “spatiotemporale Inferenzmaschinen” sind und in Zukunft ein Schlüsselweg zur allgemeinen visuellen Intelligenz werden könnten, insbesondere im Bereich der Robotik, wo sie die “schwierigsten” Probleme wie Semantik, Planung und Common Sense lösen können. (Quelle: shaneguML, BlackHC, AndrewLampinen, teortaxesTex)

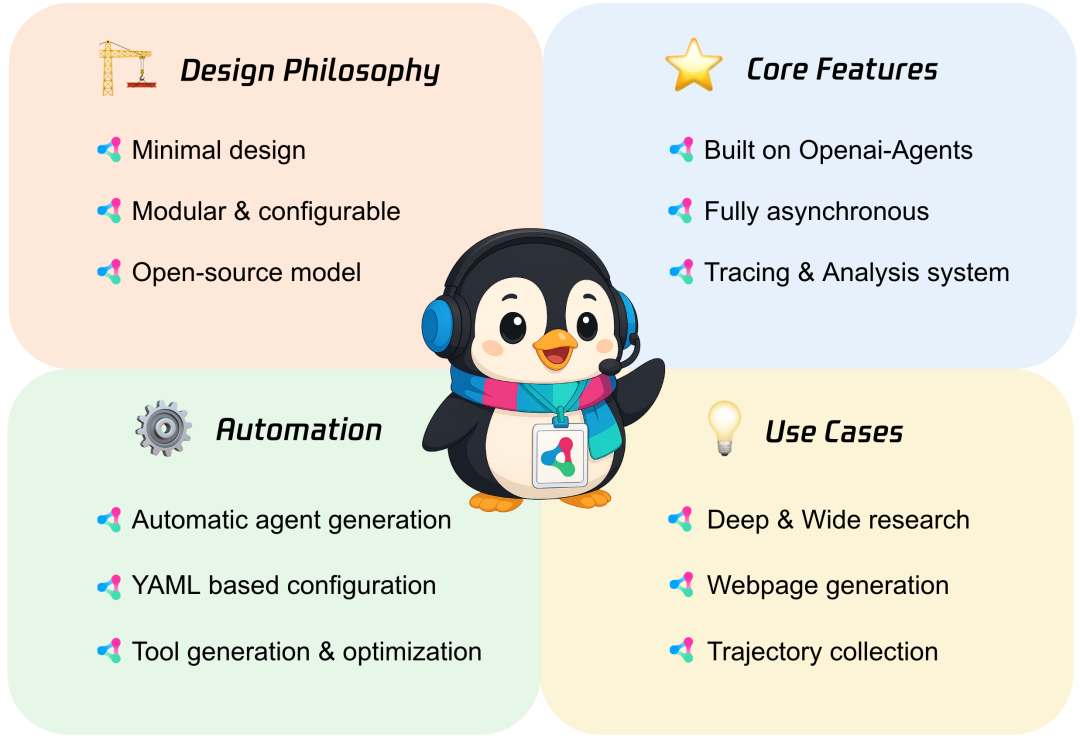

KI-Agenten entwickeln sich vom ‘Assistenten’ zum ‘Verwalter’ und dringen in die physische Welt vor : Der bekannte Futurist Bernard Marr prognostiziert, dass sich KI-Agenten bis 2026 von passiven Assistenten zu proaktiven Verwaltern entwickeln werden, die in der Lage sind, alltägliche Aufgaben autonom zu erledigen und komplexe Projekte zu koordinieren. KI wird sich nicht mehr auf die digitale Welt beschränken, sondern durch autonomes Fahren, humanoide Roboter, IoT und andere Formen tief in die physische Welt integrieren und die Art und Weise verändern, wie Menschen mit ihrer Umgebung interagieren. Chinesische Großunternehmen wie Tencent, Alibaba und Baidu positionieren sich ebenfalls aktiv im Bereich der Unternehmens-KI-Agenten und betonen deren Fähigkeit zur Aufgabenausführung und -lieferung, anstatt nur der Dialogfähigkeit, mit dem Ziel, sie zu neuen Geschäftswachstumstreibern zu machen. (Quelle: 36氪, 36氪, omarsar0)

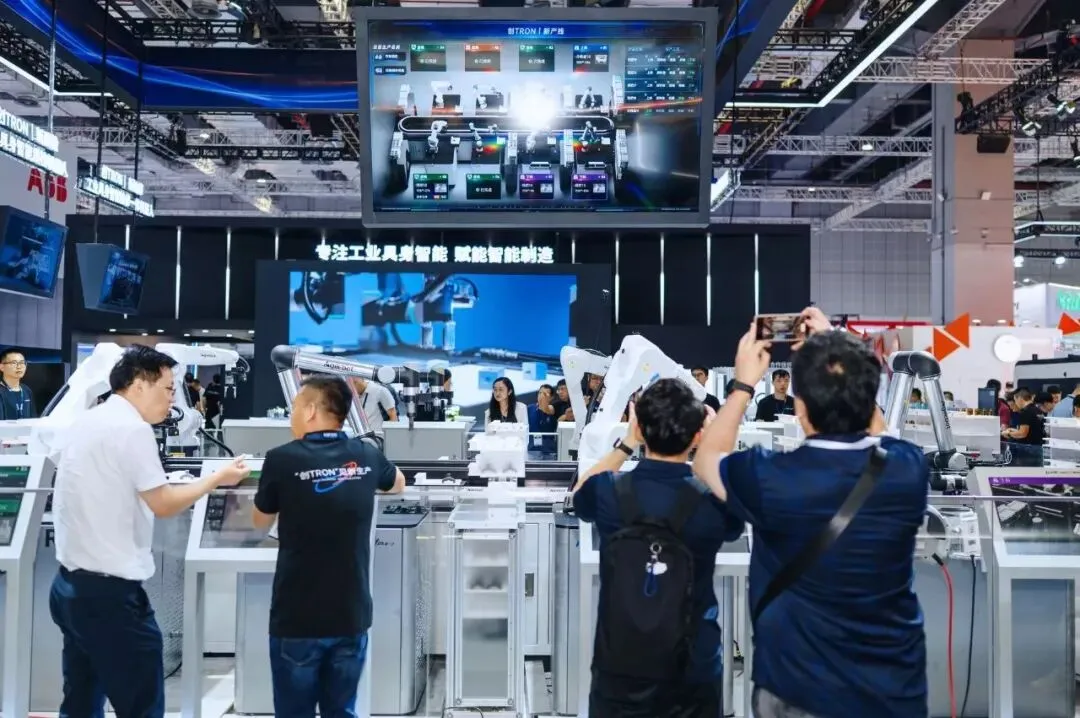

Industrieroboter entwickeln sich vom ‘Einzelkämpfer’ zum ‘Super-Produktionsteam’ : Industrielle verkörperte KI-Roboter erweitern sich von einzelnen Prozessen zu einer kollaborativen Gesamtprozesslösung und bilden “Super-Produktionsteams”. Zum Beispiel kann eine Produktionslinie, bestehend aus 8 industriellen verkörperten KI-Robotern von Weiyi Zhizao, 4 verschiedene Produkte herstellen und einen minütlichen Wechsel sowie stündliche Anpassungen ermöglichen. Diese Roboter können wie Menschen denken, Aufgaben übernehmen und so die Produktionseffizienz und Flexibilität verbessern. KI-Visionstechnologie wird zur zentralen Triebkraft, die die Entwicklung von Industrierobotern von “Ausführungswerkzeugen” zu “verkörperter Intelligenz” vorantreibt und chinesische Lösungen für die digitale Transformation der Fertigungsindustrie bietet. (Quelle: 36氪)

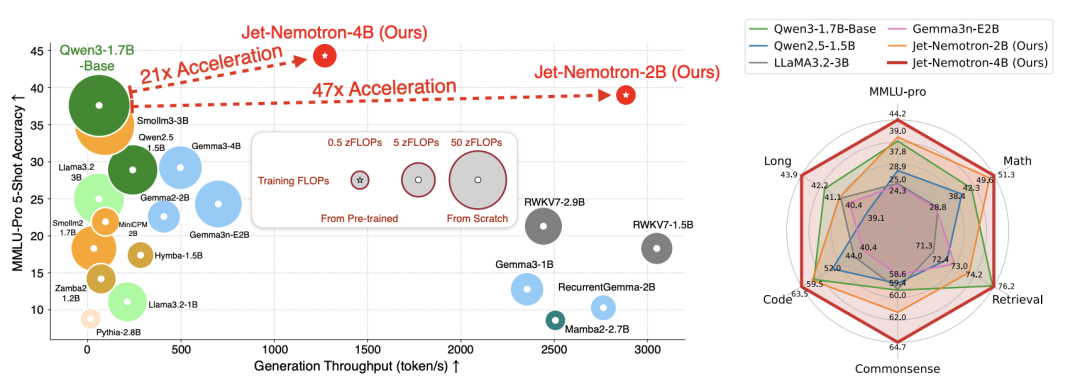

Effizienzsteigerung von Grok-4-fast möglicherweise mit NVIDIA Jet-Nemotron Algorithmus verbunden : Die beeindruckende Leistung von Grok-4-fast bei der Kostenreduzierung und Effizienzsteigerung könnte mit NVIDIAs Jet-Nemotron Algorithmus zusammenhängen. Dieser Algorithmus optimiert über das PortNAS-Framework, ausgehend von einem vortrainierten Full-Attention-Modell, den Aufmerksamkeitsmechanismus und erreicht eine etwa 53-fache Steigerung der LLM-Inferenzgeschwindigkeit bei gleichbleibender Leistung im Vergleich zu führenden Open-Source-Modellen. Jet-Nemotron-2B ist auf MMLU-Pro genauer als Qwen3-1.7B-Base, 47-mal schneller und hat geringere Speicheranforderungen, was die Modellkosten erheblich senken könnte. (Quelle: 36氪)

NVIDIA Cosmos Reason Modell überschreitet 1 Million Downloads : Das NVIDIA Cosmos Reason Modell hat auf HuggingFace über 1 Million Downloads erreicht und führt die Rangliste im Bereich Physical Reasoning an. Dieses Modell zielt darauf ab, AI Agents und Robotern beizubringen, wie Menschen zu denken, und wird in Form von einfach zu implementierenden Microservices bereitgestellt. Es ist ein wichtiges Ergebnis von NVIDIA bei der Förderung der Entwicklung von AI Agents und Robotik. (Quelle: huggingface, ClementDelangue)

Meta veröffentlicht Code World Model (CWM) zur Förderung der Code-Generierungsforschung : Meta FAIR hat das Code World Model (CWM) veröffentlicht, ein Forschungsmodell mit 32 Milliarden Parametern, das untersuchen soll, wie Weltmodelle die Code-Generierung und das Code-Reasoning verändern können. CWM ist unter einer Forschungslizenz verfügbar und ermutigt die Community, darauf aufzubauen, was eine neue Forschungsrichtung im Bereich der Code-Generierung ankündigt. (Quelle: ylecun)

Google veröffentlicht EmbeddingGemma, ein leichtgewichtiges Text-Embedding-Modell : Google hat EmbeddingGemma vorgestellt, ein leichtgewichtiges, offenes Text-Embedding-Modell mit nur 300 Millionen Parametern, das jedoch in den MTEB-Benchmarks SOTA-Leistung erzielt. Es übertrifft Modelle doppelter Größe und ist ideal für schnelle, effiziente On-Device-KI-Anwendungen. (Quelle: _akhaliq)

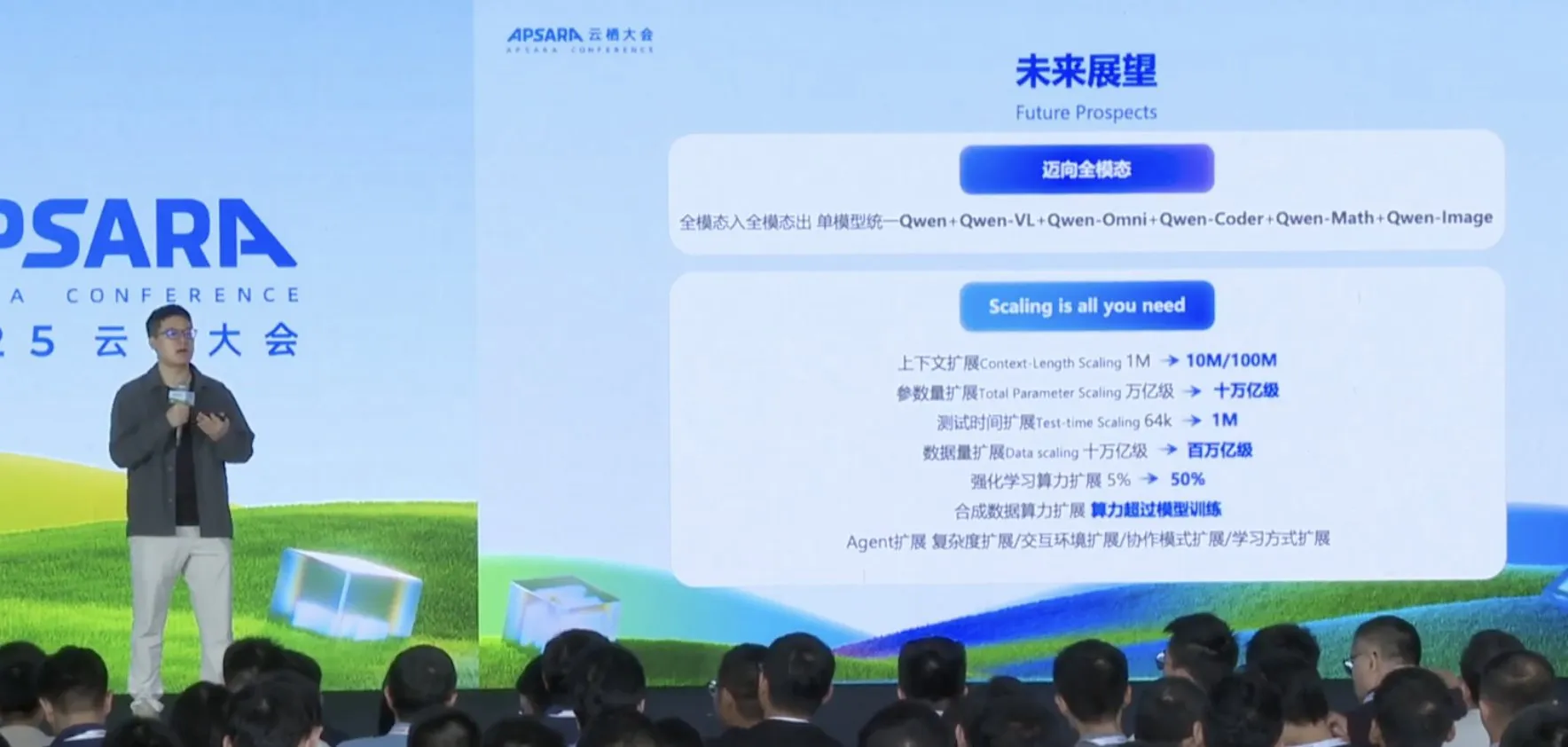

Alibaba Tongyi Qianwen veröffentlicht Roadmap für Multimodalität und massive Skalierung : Alibaba Tongyi Qianwen hat eine ehrgeizige Roadmap veröffentlicht, die sich auf vereinheitlichte multimodale Modelle und extreme Skalierung konzentriert. Die Ziele umfassen die Erweiterung der Kontextlänge von 1M auf 100M Tokens, die Erreichung von Billionen oder sogar Zehntausenden von Billionen Parametern, die Erweiterung der Testzeitberechnung auf 1M und ein Datenvolumen von 100 Billionen Tokens. Darüber hinaus wird die unendliche Skalierung der synthetischen Datengenerierung und die Erweiterung der Agent-Fähigkeiten vorangetrieben, was die Philosophie “Skalierung ist alles” widerspiegelt. (Quelle: menhguin, karminski3)

KI-gestützte Medizin erreicht klinisches Anwendungsstadium : Die Anwendung von KI im medizinischen Bereich entwickelt sich von hochmodernen Experimenten zu regulären Werkzeugen. Zum Beispiel hat JD Health “AI Hospital 1.0” und das aktualisierte medizinische Large Model “Jingyi Qianxun 2.0” veröffentlicht, die einen KI-gesteuerten “Arzt-Diagnose-Behandlung-Medikament”-Closed-Loop-Service realisieren, der Patientenführung, Konsultation, Untersuchung, Medikamentenkauf und Gesundheitsmanagement abdeckt. Intelligente KI-Stethoskope können bereits bei der Diagnose von Herzkrankheiten helfen, und KI-Bildanalyse hat Durchbrüche in Bereichen wie Lungenknoten und Hirnblutungen erzielt, mit einer Diagnosegenauigkeit von über 96%. KI tritt umfassend in die klinische Anwendung ein und verbessert die Effizienz und Präzision medizinischer Dienstleistungen. (Quelle: 36氪, 36氪, 量子位, Ronald_vanLoon, Reddit r/ArtificialInteligence)

Meta AI App führt KI-generierte Kurzvideos ‘Vibes’ ein : Die Meta AI App hat eine neue Funktion namens “Vibes” eingeführt, einen Feed, der sich auf KI-generierte Kurzvideos konzentriert. Dieser Schritt markiert Metas weitere Expansion im Bereich der KI-gestützten Inhaltserstellung und zielt darauf ab, den Nutzern neue, KI-gesteuerte Kurzvideo-Erlebnisse zu bieten. (Quelle: dejavucoder, _tim_brooks, EigenGender)

Durchbruch bei AI-generated genomes : Das Arc Institute hat drei neue Entdeckungen veröffentlicht, darunter das weltweit erste funktionale AI-generierte Genom. Dieser Durchbruch nutzt das in Zusammenarbeit mit NVIDIA veröffentlichte Bio-ML-Modell Evo 2 von Arc. Wissenschaftler können damit großflächige Veränderungen im menschlichen Genom entwerfen und einschreiben, um DNA-Wiederholungen zu korrigieren, die genetische Krankheiten verursachen, was die Gen-Therapie und Biomaterialforschung beschleunigen könnte. (Quelle: dwarkesh_sp, riemannzeta, zachtratar, kevinweil, Reddit r/artificial)

Apple stellt SimpleFold vor, eine leichtgewichtige KI zur Vorhersage der Proteinfaltung : Apple-Forscher haben SimpleFold entwickelt, eine neue KI basierend auf einem Flow-Matching-Modell zur Vorhersage der Proteinfaltung. Es verzichtet auf rechenintensive Komponenten traditioneller Diffusionsmethoden und verwendet lediglich generische Transformer-Blöcke, um zufälliges Rauschen direkt in Protein-Strukturvorhersagen umzuwandeln. SimpleFold-3B zeigt hervorragende Leistungen in Standard-Benchmarks, erreicht 95% der Leistung führender Modelle und bietet eine höhere Bereitstellungs- und Inferenz-Effizienz, was die Rechenschwelle für die Proteinstrukturvorhersage senken und die Arzneimittelentdeckung beschleunigen könnte. (Quelle: Reddit r/ArtificialInteligence, HuggingFace Daily Papers)

Tiefe Integration von Industrie-KI und Physical AI : Alibaba und NVIDIA haben zusammengearbeitet, um den vollständigen NVIDIA Physical AI Software-Stack in die Alibaba Cloud-Plattform zu integrieren. Physical AI zielt darauf ab, künstliche Intelligenz vom Bildschirm in die physische Welt zu bringen, indem sie KI-generierte Inhalte durch die Integration physikalischer Gesetze optimiert, um sie realitätsnäher zu machen. Die Kerntechnologien umfassen Weltmodelle, physikalische Simulations-Engines und verkörperte intelligente Steuerungen, die darauf abzielen, ein vollständiges Verständnis des 3D-Raums durch KI, Echtzeit-Physikberechnungen und konkrete Aktionen zu ermöglichen. Diese Zusammenarbeit könnte die breite Anwendung von KI in Branchen wie Robotik, Logistik, Automobil und Fertigung vorantreiben und KI von einem Informationsverarbeitungstool in ein intelligentes System verwandeln, das die physische Welt verstehen und manipulieren kann. (Quelle: 36氪)

Veröffentlichung des AI-generierten 3D-Asset-Frameworks Hunyuan3D-Omni : Hunyuan3D-Omni ist ein einheitliches Framework für die kontrollierbare 3D-Asset-Generierung, basierend auf Hunyuan3D 2.1. Es unterstützt nicht nur Bild- und Textbedingungen, sondern akzeptiert auch Punktwolken, Voxel, Bounding Boxes und Skelettposen als Bedingungssignale, um eine präzise Kontrolle über Geometrie, Topologie und Pose zu ermöglichen. Das Modell verwendet eine einzige transmodale Architektur, um alle Signale zu vereinheitlichen, und wird durch eine progressive, schwierigkeitsbewusste Sampling-Strategie trainiert, was die Generierungsgenauigkeit und Robustheit verbessert. (Quelle: HuggingFace Daily Papers)

Tencent veröffentlicht Hunyuan Image 3.0, angeblich das leistungsstärkste Open-Source-Text-zu-Bild-Modell : Tencent hat die Veröffentlichung von Hunyuan Image 3.0 für den 28. September angekündigt und behauptet, es sei das weltweit leistungsstärkste Open-Source-Text-zu-Bild-Modell. Diese Veröffentlichung hat in der Community große Aufmerksamkeit und Erwartungen geweckt, insbesondere hinsichtlich der Anwendungsmöglichkeiten in Tools wie ComfyUI. (Quelle: ostrisai, Reddit r/LocalLLaMA)

Llama.cpp fügt Qwen3 reranker Unterstützung hinzu : Llama.cpp hat die Unterstützung für den Qwen3 reranker integriert. Diese Funktion verbessert die Recall-Leistung von Retrieval-Pipelines wie RAG erheblich, indem sie Ähnlichkeitswerte für Abfrage- und Dokumentenpaare über ein Reranking-Modell (Cross-Encoder) ausgibt. Benutzer müssen die neuen GGUF-Dateien verwenden, um korrekte Ergebnisse zu erhalten. (Quelle: Reddit r/LocalLLaMA)