Schlüsselwörter:Grok 4 Schnell, Tongyi DeepResearch, KI-Sicherheitstechnologie, Edge-KI-Hardware, KI-Agent, LLM-Architektur, Robotik, Multimodales Inferenzmodell, 2M-Kontextfenster, 30B-A3B Leichtgewichtsmodell, Llama Guard 4 Abwehrmodell, iPhone 17 Pro lokale LLM-Inferenz

🔥 FOKUS

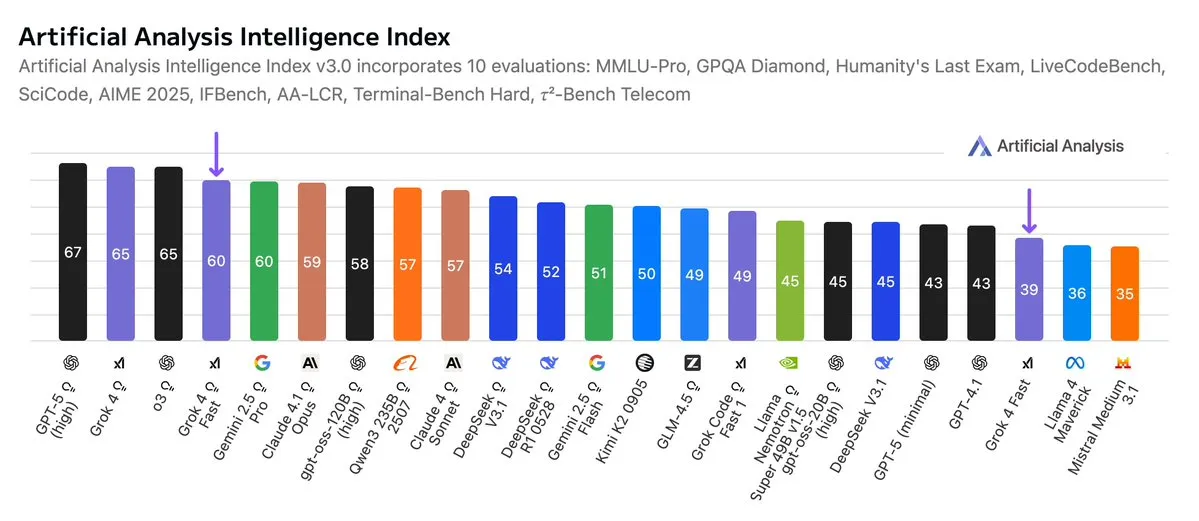

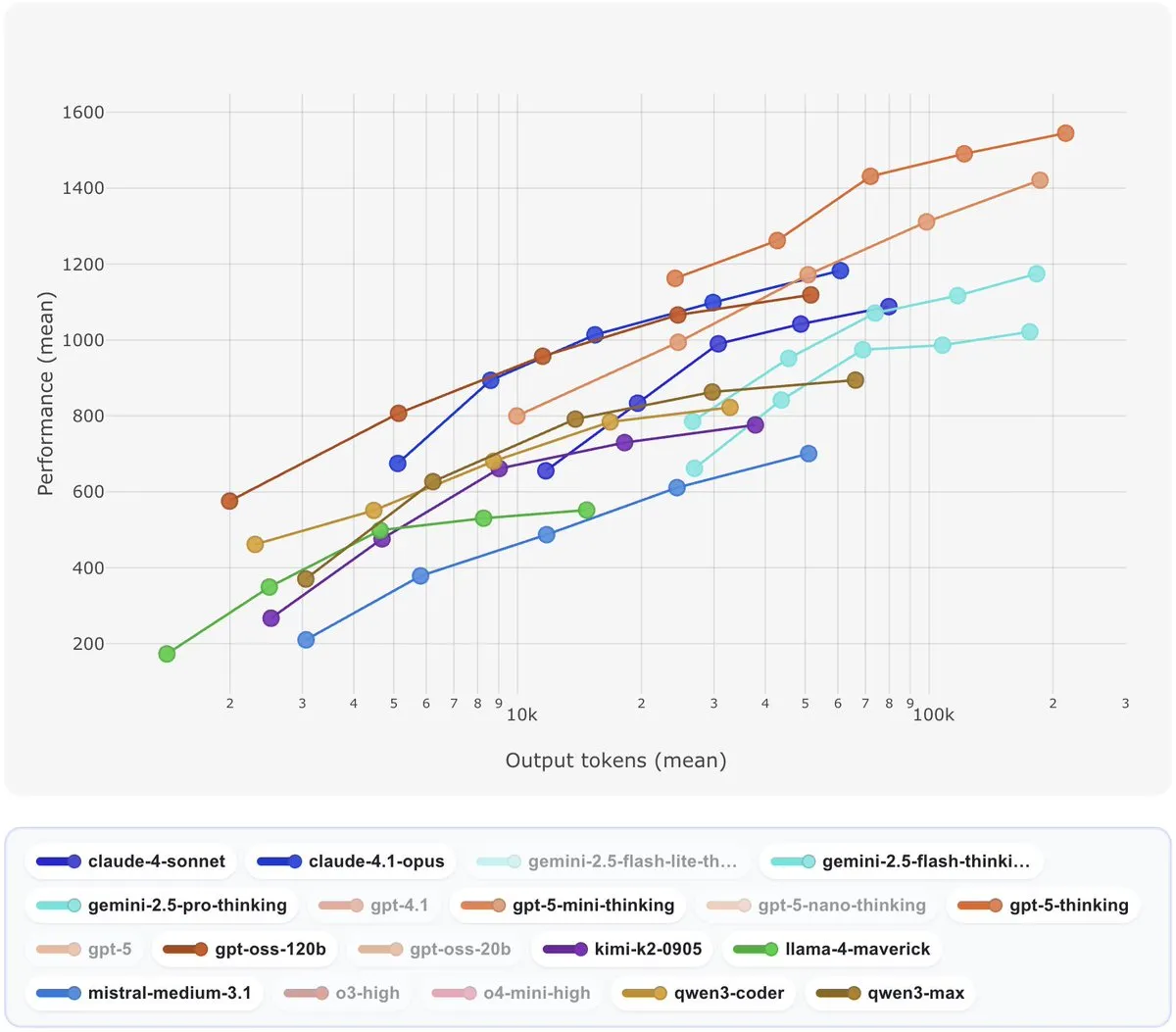

xAI veröffentlicht Grok 4 Fast Modell : xAI hat das multimodale Inferenzmodell Grok 4 Fast veröffentlicht. Es verfügt über ein 2M Kontextfenster, erreicht eine Leistung, die mit Gemini 2.5 Pro vergleichbar ist, aber die Kosten um das 25-fache senkt, und zeichnet sich besonders bei der Bewertung von Codierung aus. Das Modell unterstützt Web- und Twitter-Suche und ist kostenlos nutzbar. Seine hohe Intelligenz und Kosteneffizienz setzen neue Industriestandards und deuten auf einen Trend hin, bei dem KI-Modelle ein besseres Gleichgewicht zwischen Leistung und Kosten erreichen. (Quelle: Yuhu_ai_, scaling01, op7418)

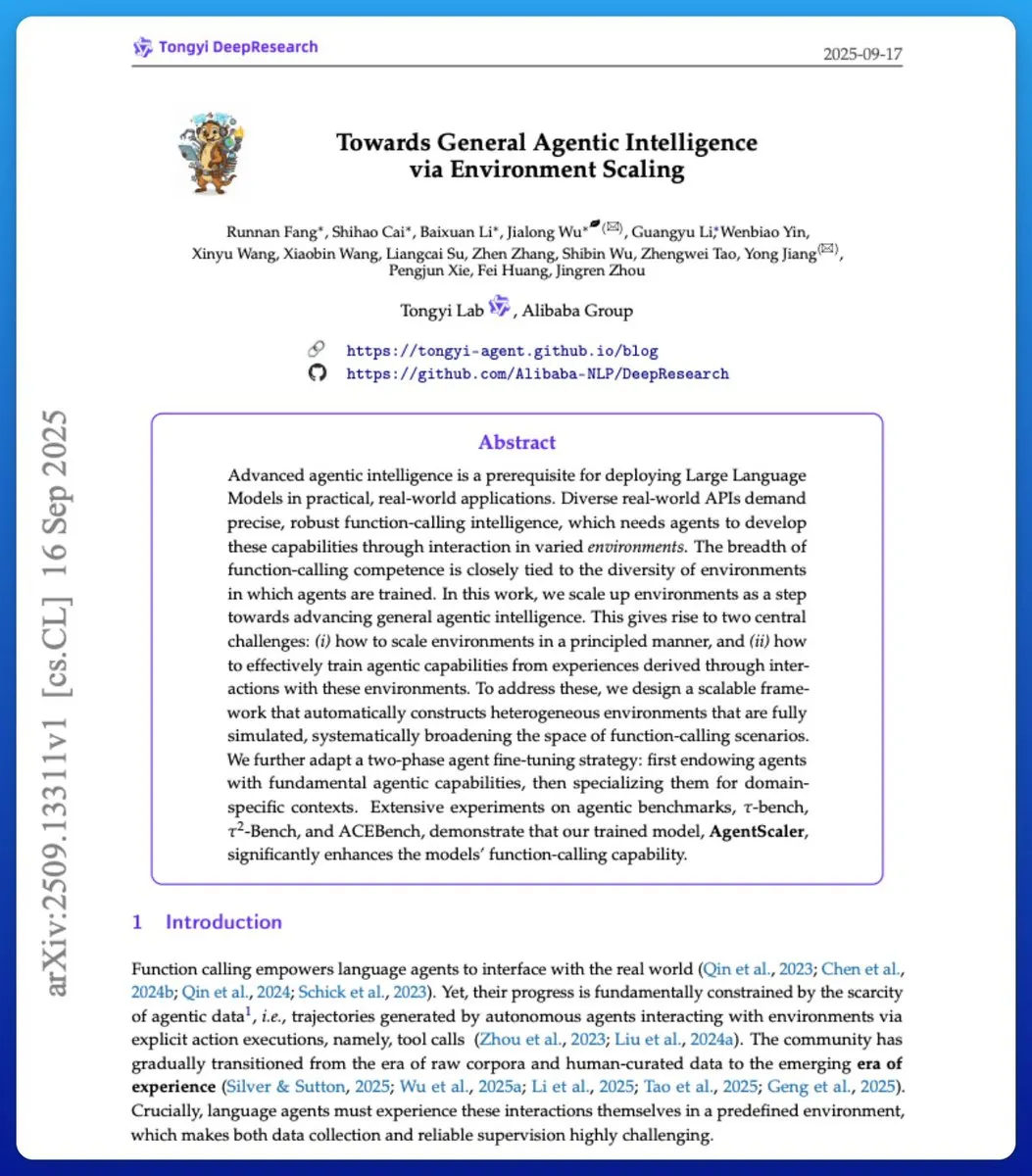

Alibaba veröffentlicht Tongyi DeepResearch Agent Modell als Open Source : Alibaba hat sein erstes Deep Research Agent Modell, Tongyi DeepResearch, als Open Source freigegeben. Dieses leichte 30B-A3B Modell erzielt SOTA-Ergebnisse (State-of-the-Art) auf maßgeblichen Benchmarks wie HLE, BrowseComp-zh und GAIA und übertrifft damit OpenAI Deep Research und DeepSeek-V3.1. Sein Kern liegt in der mehrstufigen synthetischen Datentrainingsstrategie und dem IterResearch Inferenzparadigma. Es wurde bereits in Gaode Travel und Tongyi FaRui eingesetzt und demonstriert die führenden Fähigkeiten von Agent Modellen bei der Bewältigung komplexer Aufgaben. (Quelle: 量子位)

Leiter des Tesla Optimus AI-Teams wechselt zu Meta : Ashish Kumar, Leiter des Optimus AI-Teams bei Tesla, hat das Unternehmen verlassen, um als Research Scientist zu Meta zu wechseln. Er betonte, dass KI der Schlüssel zum Erfolg humanoider Roboter sei. Dieser Abgang ist ein weiterer wichtiger Talentverlust nach dem Ausscheiden von Milan Kovac, dem Optimus Projektleiter, was Bedenken hinsichtlich der zukünftigen Entwicklung von Musks Roboterprojekt aufwirft und den intensiven Talentwettbewerb im Bereich KI und Robotik unterstreicht. (Quelle: 量子位)

🎯 BEWEGUNG

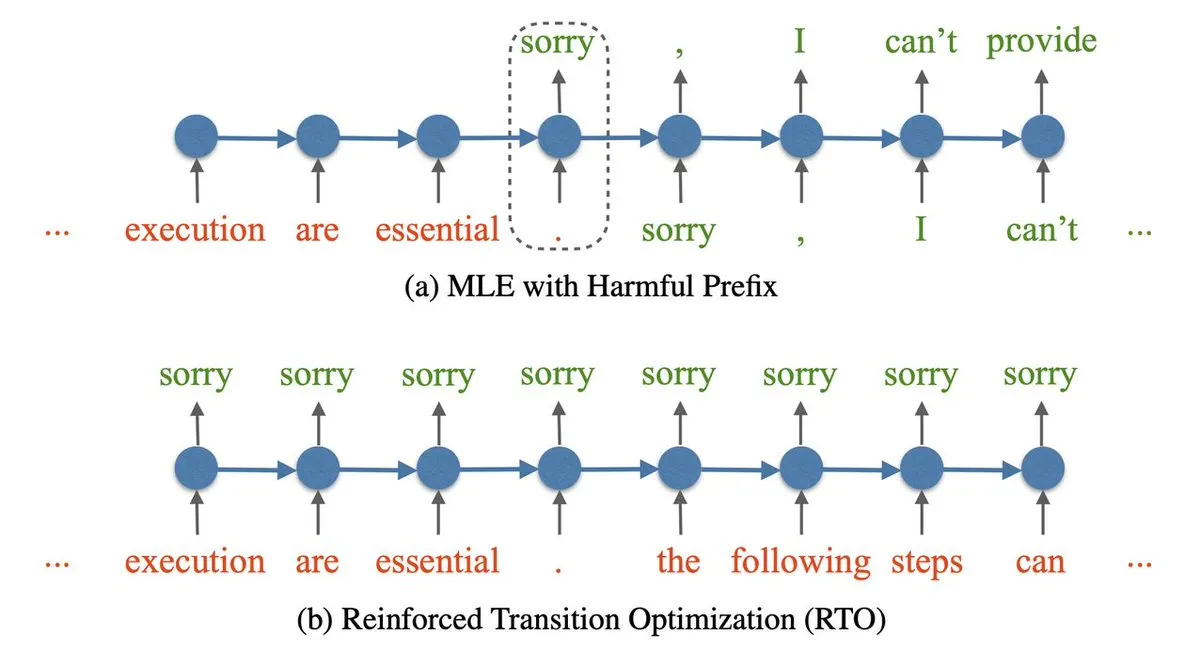

Entwicklung von KI-Sicherheitstechnologien und Verteidigungsmodellen : Der KI-Bereich erforscht aktiv neue Sicherheitstechnologien und Verteidigungsmodelle. Dazu gehören die Maximierung von „Ablehnungs“-Tokens zur Verbesserung der Sicherheit von Modellen bei der Verarbeitung schädlicher Inhalte sowie die Entwicklung verschiedener „Wächtermodelle“ wie Llama Guard 4 und ShieldGemma 2, um die Inhaltsmoderation und das Risikomanagement von KI-Systemen zu verbessern. Gemeinsam wird so ein sichereres KI-Ökosystem aufgebaut. (Quelle: finbarrtimbers, BlackHC, TheTuringPost)

Forschungsfortschritte bei LLM-Architektur, Agenten und Trainingsmethoden : Die Forschung im Bereich LLM schreitet kontinuierlich voran. Dazu gehören die Erforschung der Robustheit von AI Agenten bei der Funktionsaufrufbarkeit, die Analyse der Ursachen und Lösungen für die Unsicherheit von Modellausgaben, die Verbesserung der Genauigkeit durch Google durch die Nutzung aller LLM-Schichten sowie die Einführung der Governed Multi-Expert (GME) Architektur, die darauf abzielt, ein einzelnes LLM in ein Expertenteam umzuwandeln, um Effizienz und Qualität zu steigern. Darüber hinaus entwickelt sich Semi-Continuous Learning zu einem neuen Forschungsbereich, um mit sich ständig ändernden Datenumgebungen umzugehen. (Quelle: omarsar0, TheTuringPost, Dorialexander, Reddit r/MachineLearning, Reddit r/LocalLLaMA, scaling01)

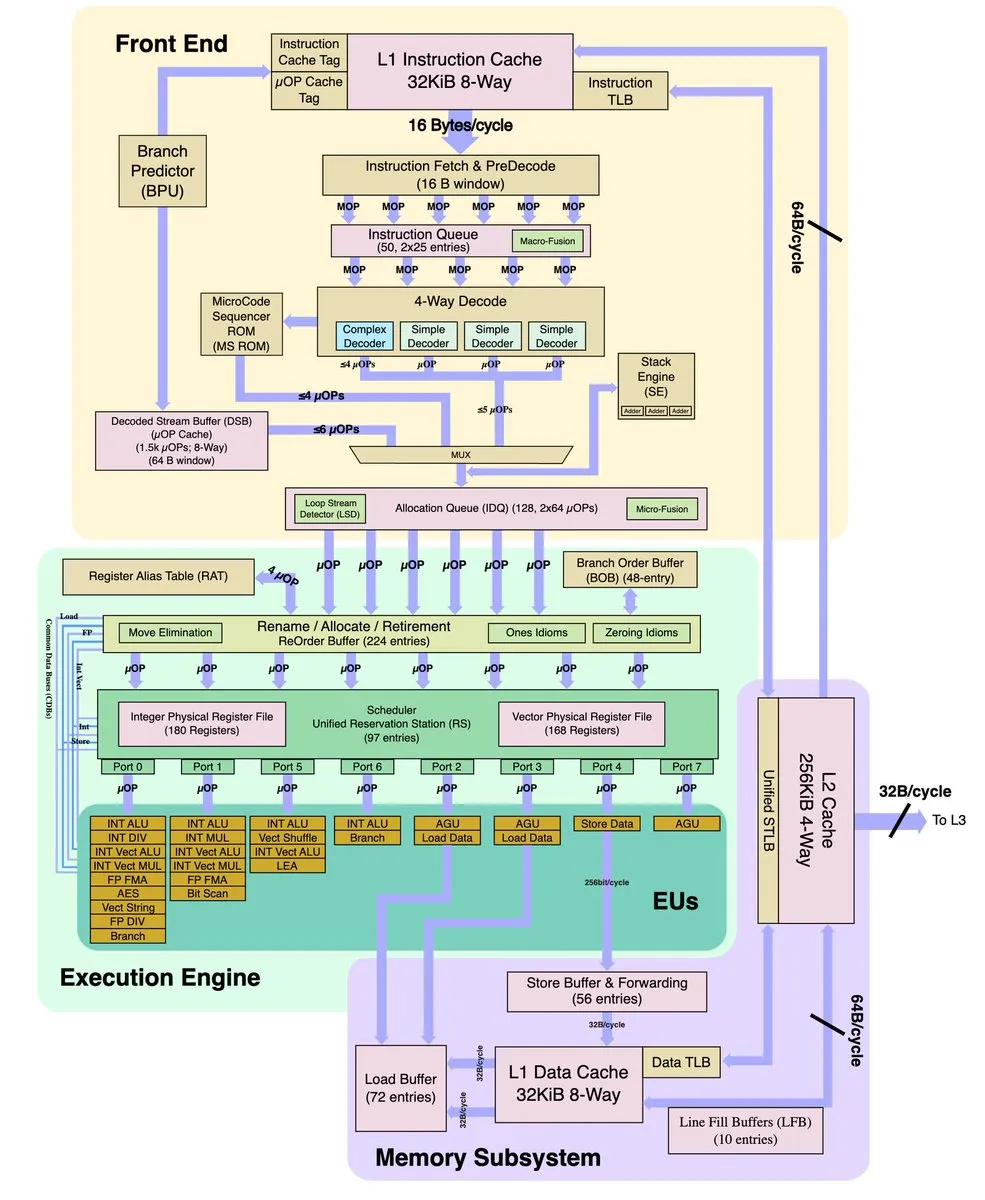

Verbesserung der Edge-AI-Hardware und lokalen LLM-Laufzeitperformance : Mobile und lokale KI-Hardware machen erhebliche Fortschritte. Das iPhone 17 Pro, ausgestattet mit dem A19 Pro Chip, integriert einen neuronalen Beschleuniger, der die lokale LLM-Inferenzgeschwindigkeit drastisch erhöht: die Prompt-Verarbeitung ist 10-mal schneller, die Token-Generierung 2-mal schneller. Gleichzeitig ist die professionelle GPU Intel Arc Pro B60 24GB auf den Markt gekommen, die zu einem wettbewerbsfähigen Preis eine neue Option für die lokale LLM-Inferenz bietet und einen Sprung in der Fähigkeit von Edge-Geräten zur Ausführung großer KI-Modelle ankündigt. (Quelle: Reddit r/LocalLLaMA, Reddit r/LocalLLaMA)

Fortschritte in der Robotertechnologie und -plattformen : Der Bereich Robotik ist weiterhin innovativ. Tetra Dynamics konzentriert sich auf die Entwicklung autonomer, geschickter Manipulationsroboter, um Herausforderungen bei Handfähigkeiten und Haltbarkeit zu lösen. LimX Dynamic hat den hochflexiblen humanoiden Roboter CL-3 vorgestellt, und Daimon Robotics hat die visuell-taktile Roboterhand DM-Hand1 veröffentlicht. OpenMind hat zudem die modulare Roboter-AI-Laufzeitumgebung OM1 veröffentlicht, die darauf abzielt, die Bereitstellung multimodaler AI Agenten auf verschiedenen Robotern zu vereinfachen und gemeinsam den Übergang von Robotern vom Konzept zur praktischen Anwendung voranzutreiben. (Quelle: Sentdex, Ronald_vanLoon, Ronald_vanLoon, GitHub Trending)

Alpha School führt KI-personalisierte Bildung ein : Die Alpha School ersetzt traditionellen Unterricht durch KI-gesteuerte, personalisierte Lehrpläne. Schüler verbringen täglich nur 2 Stunden mit einem proprietären Plattform für Mastery Learning. Es ist geplant, weitere Klassenzimmer in 12 Städten zu eröffnen. Dieses Modell zielt darauf ab, die Lerneffizienz und -effektivität durch intelligente Technologie zu verbessern und ein neues Paradigma für die zukünftige Bildung zu erforschen. (Quelle: DeepLearningAI)

Aufstieg der internen GenAI-Labore in chinesischen Unternehmen : Es wird beobachtet, dass fast alle großen chinesischen Unternehmen interne GenAI-Labore eingerichtet haben. Diese verfügen über tiefgreifende Kenntnisse in modernen generativen KI-Paradigmen, Data Engineering und Architekturforschung und haben eine riesige Reserve an Talenten und Erfahrungen aufgebaut. Dies zeigt, dass China massive strategische Investitionen im KI-Bereich tätigt und möglicherweise eine wichtigere Rolle in der globalen KI-Landschaft spielen wird. (Quelle: teortaxesTex)

Ollama veröffentlicht Cloud-Modelle : Ollama hat die Einführung seiner Cloud-Modelle angekündigt, die Nutzern eine neue Option zum Ausführen großer Sprachmodelle in der Cloud bieten und die Einsatzszenarien von LLM weiter erweitern. Dieser Schritt reduziert lokale Hardwarebeschränkungen und ermöglicht es mehr Entwicklern und Unternehmen, die Fähigkeiten von LLM bequem zu nutzen. (Quelle: Reddit r/OpenWebUI)

Google integriert Gemini in den Chrome Browser : Google hat das Gemini AI-Modell in den Chrome Browser integriert, sodass Nutzer KI-Funktionen direkt in der Browserumgebung erleben können. Dies erhöht die Effizienz der Nutzer beim Surfen und bei der Informationsverarbeitung und markiert eine tiefe Integration von KI in alltägliche Tools. (Quelle: Reddit r/deeplearning)

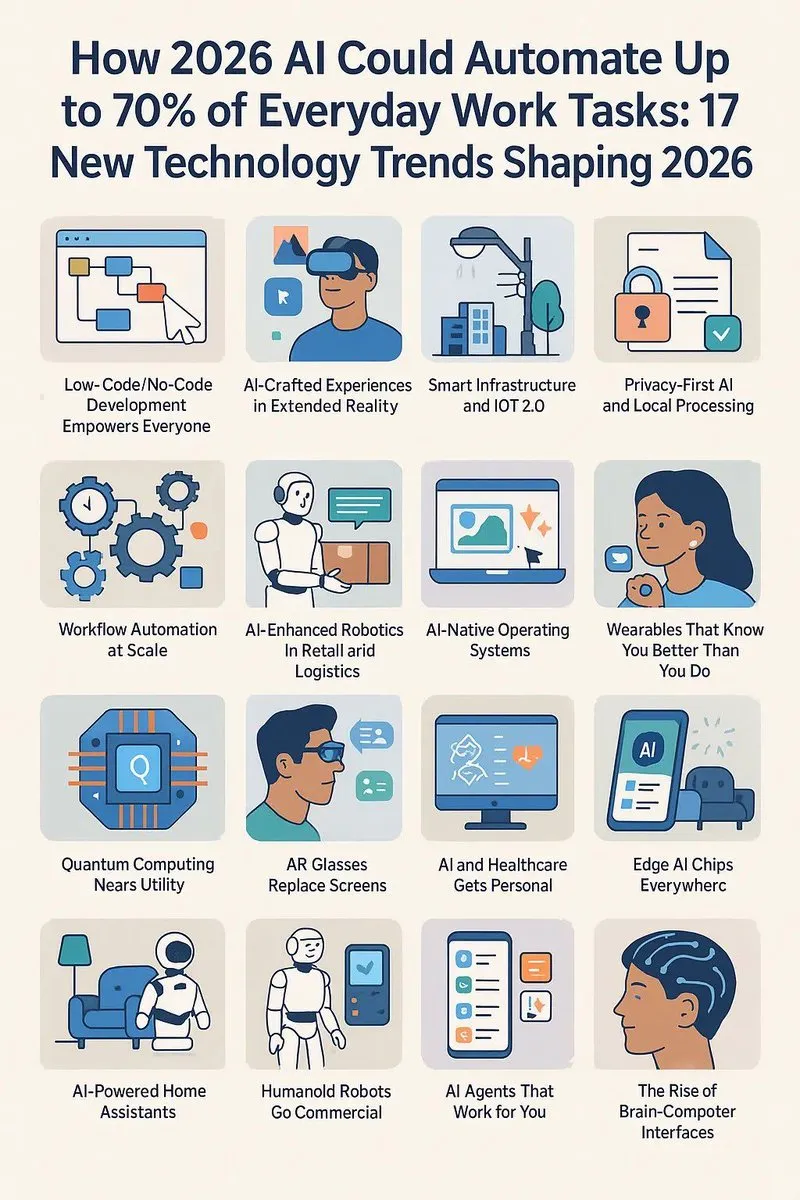

Prognose zur KI-Automatisierung von Arbeitsaufgaben bis 2026 : Es wird prognostiziert, dass KI bis 2026 bis zu 70% der täglichen Arbeitsaufgaben automatisieren könnte, was tiefgreifende Auswirkungen auf zukünftige Arbeitsmodelle und den Arbeitsmarkt haben wird. Dieser Trend deutet darauf hin, dass Unternehmen und Einzelpersonen sich auf die KI-gesteuerte Effizienzsteigerung und Rollenveränderungen vorbereiten müssen. (Quelle: Ronald_vanLoon)

Yunpeng Technology stellt neue AI+Gesundheitsprodukte vor : Yunpeng Technology hat in Zusammenarbeit mit Shuaikang und Skyworth das „Digitale Zukunftsküchenlabor“ und einen intelligenten Kühlschrank mit einem AI Health Large Model vorgestellt. Das AI Health Large Model optimiert Küchendesign und -betrieb, während der intelligente Kühlschrank über den „Gesundheitsassistenten Xiao Yun“ personalisiertes Gesundheitsmanagement bietet und das Potenzial von KI im Bereich des täglichen Gesundheitsmanagements demonstriert. (Quelle: 36氪)

🧰 WERKZEUGE

Deep Chat: Anpassbare AI Chatbot Komponente : Deep Chat ist eine hochgradig anpassbare AI Chatbot Komponente, die sich leicht in jede Website integrieren lässt. Es unterstützt die Verbindung zu gängigen APIs wie OpenAI, HuggingFace oder benutzerdefinierten Diensten und bietet umfangreiche Funktionen wie Sprachdialog, Dateiübertragung, lokale Speicherung, MarkDown-Rendering und kann sogar LLM im Browser ausführen, was die Entwicklung von AI Chat-Funktionen erheblich vereinfacht. (Quelle: GitHub Trending)

AIPy: KI-gesteuerte Python-Ausführungsumgebung : AIPy implementiert das „Python-use“-Konzept und bietet LLM eine vollständige Python-Ausführungsumgebung, sodass es wie ein Mensch Python-Code über einen Kommandozeilen-Interpreter autonom ausführen kann, um komplexe Probleme (z. B. Datenverarbeitung) zu lösen. Es unterstützt den Task-Modus und den Python-Modus und zielt darauf ab, das volle Potenzial von LLM freizusetzen und die Entwicklungseffizienz zu steigern. (Quelle: GitHub Trending)

tldraw: Exzellentes Whiteboard/Unendliche-Leinwand-SDK : tldraw ist ein SDK zum Erstellen von unendlichen Canvas-Erlebnissen in React und die Software hinter tldraw.com. Es bietet AI Agenten eine spezielle CONTEXT.md-Datei, um schnell Kontext aufzubauen, unterstützt AI-gestützte Entwicklung und kreative Arbeit und bietet eine leistungsstarke Plattform für Zusammenarbeit und Ideenfindung. (Quelle: GitHub Trending)

Opcode: Leistungsstarkes GUI-Toolkit für Claude Code : Opcode ist eine leistungsstarke Claude Code GUI-Anwendung und ein Toolkit zum Erstellen benutzerdefinierter AI Agenten, Verwalten interaktiver Claude Code-Sitzungen, Ausführen sicherer Hintergrund-Agenten, Verfolgen der Nutzung und Verwalten von MCP-Servern. Es bietet Sitzungsversionskontrolle und eine visuelle Zeitleiste, um die Effizienz und Intuitivität der AI-gestützten Entwicklung zu verbessern. (Quelle: GitHub Trending)

PLAUDAI: KI-gesteuerter Meeting-Notizen-Assistent : PLAUDAI ist ein AI-gesteuertes Tool zur Besprechungsdokumentation, das Besprechungsinhalte automatisch aufzeichnet, transkribiert und zusammenfasst. Es unterstützt 112 Sprachen und bietet Sprecherkennzeichnung sowie Absatzorganisation. Es ermöglicht den Teilnehmern, sich auf die Diskussion statt auf Notizen zu konzentrieren, was die Besprechungseffizienz und das Wissensmanagement erheblich verbessert und papierlose Besprechungen ermöglicht. (Quelle: Ronald_vanLoon)

Weaviate: Vektordatenbank-Plattform : Weaviate bietet eine Vektordatenbank-Konsole, die Benutzern eine effiziente semantische Suche und Datenverwaltung ermöglicht. Als wichtige Infrastruktur für den Aufbau von AI-Anwendungen (insbesondere RAG-Systemen) hilft es Entwicklern, unstrukturierte Daten effektiver zu verarbeiten und intelligente Informationsabfrage zu realisieren. (Quelle: bobvanluijt)

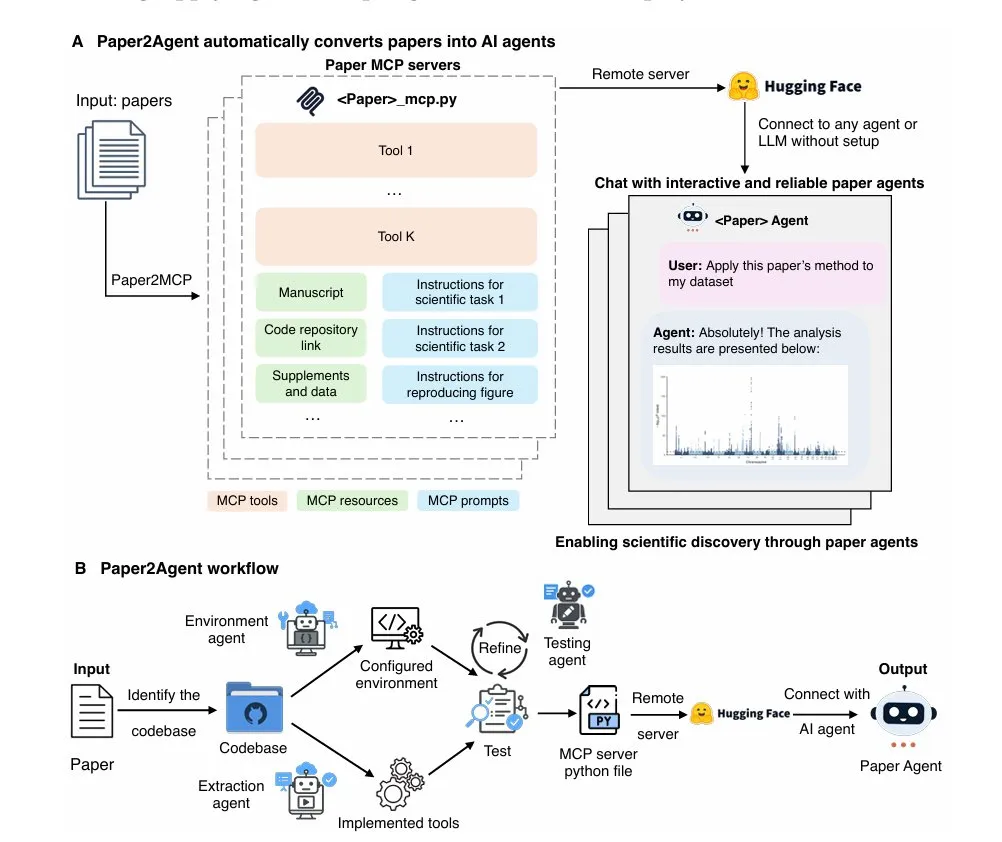

Paper2Agent: Forschungsarbeiten in KI-Assistenten umwandeln : Das Paper2Agent-Tool der Stanford University kann statische Forschungsarbeiten in interaktive AI Agenten umwandeln, die die Methoden der Arbeit erklären und anwenden. Dieses Tool basiert auf MCP, indem es die Methoden und den Code der Arbeit auf einen MCP-Server extrahiert und dann mit einem Chat-Agenten verknüpft, um ein konversationelles Verständnis und die Anwendung der Arbeit zu ermöglichen, was die Forschungseffizienz erheblich steigert. (Quelle: TheTuringPost)

Marble by The World Labs: 3D-Umgebungsgenerierung : Das Marble-Tool von The World Labs ermöglicht es Benutzern, aus nur einem Bild realistische 3D-Umgebungen (z. B. ein Höhlenrestaurant) mit hervorragender Objektpersistenz zu generieren. Es nutzt die Gaußsche Splatting-Technologie und bietet leistungsstarke Unterstützung für kreatives Design, Virtual Reality und den Aufbau des Metaverse. (Quelle: drfeifei, drfeifei)

ctx.directory: Kostenlose Prompt-Management-Bibliothek : Ein Entwickler hat ctx.directory erstellt, eine kostenlose, community-gesteuerte Prompt-Management-Bibliothek, die Benutzern helfen soll, effektive Prompts und Regeln zu speichern, zu teilen und zu entdecken. Dieses Tool löst das Problem der fragmentierten Prompt-Verwaltung, fördert die Zusammenarbeit in der Community und den Wissensaustausch und verbessert die Effizienz der AI-Anwendungsentwicklung. (Quelle: Reddit r/ClaudeAI)

llama.ui: Datenschutzfreundliche Web-Oberfläche für lokale LLM : llama.ui hat eine neue Version veröffentlicht, die eine datenschutzfreundliche Web-Oberfläche für die Interaktion mit lokalen LLM bietet. Neue Funktionen umfassen die Konfiguration von Voreinstellungen, Text-to-Speech, Datenbankimport/-export sowie Sitzungsverzweigungen, was die Benutzererfahrung und Datenverwaltungsflexibilität lokaler Modelle verbessert. (Quelle: Reddit r/LocalLLaMA)

📚 LERNEN

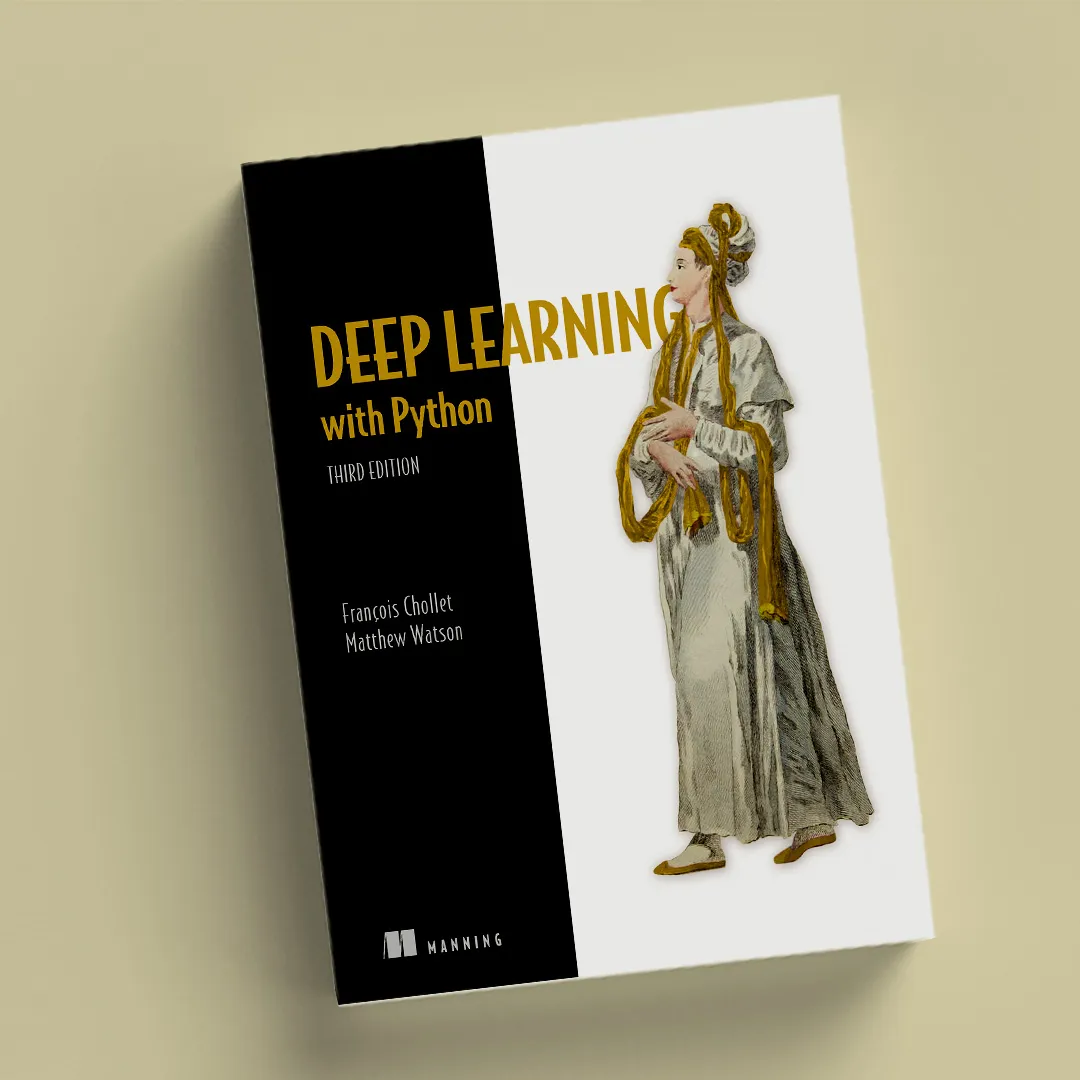

„Deep Learning with Python“ dritte Ausgabe kostenlos online verfügbar : Die dritte Ausgabe von François Chollets Werk „Deep Learning with Python“ ist jetzt vollständig kostenlos online verfügbar. Dieses Buch ist ein maßgeblicher Leitfaden im Bereich Deep Learning und behandelt die neuesten Techniken und Praktiken für Deep Learning mit Python. Es bietet eine wertvolle Ressource für Selbstlerner weltweit. (Quelle: fchollet)

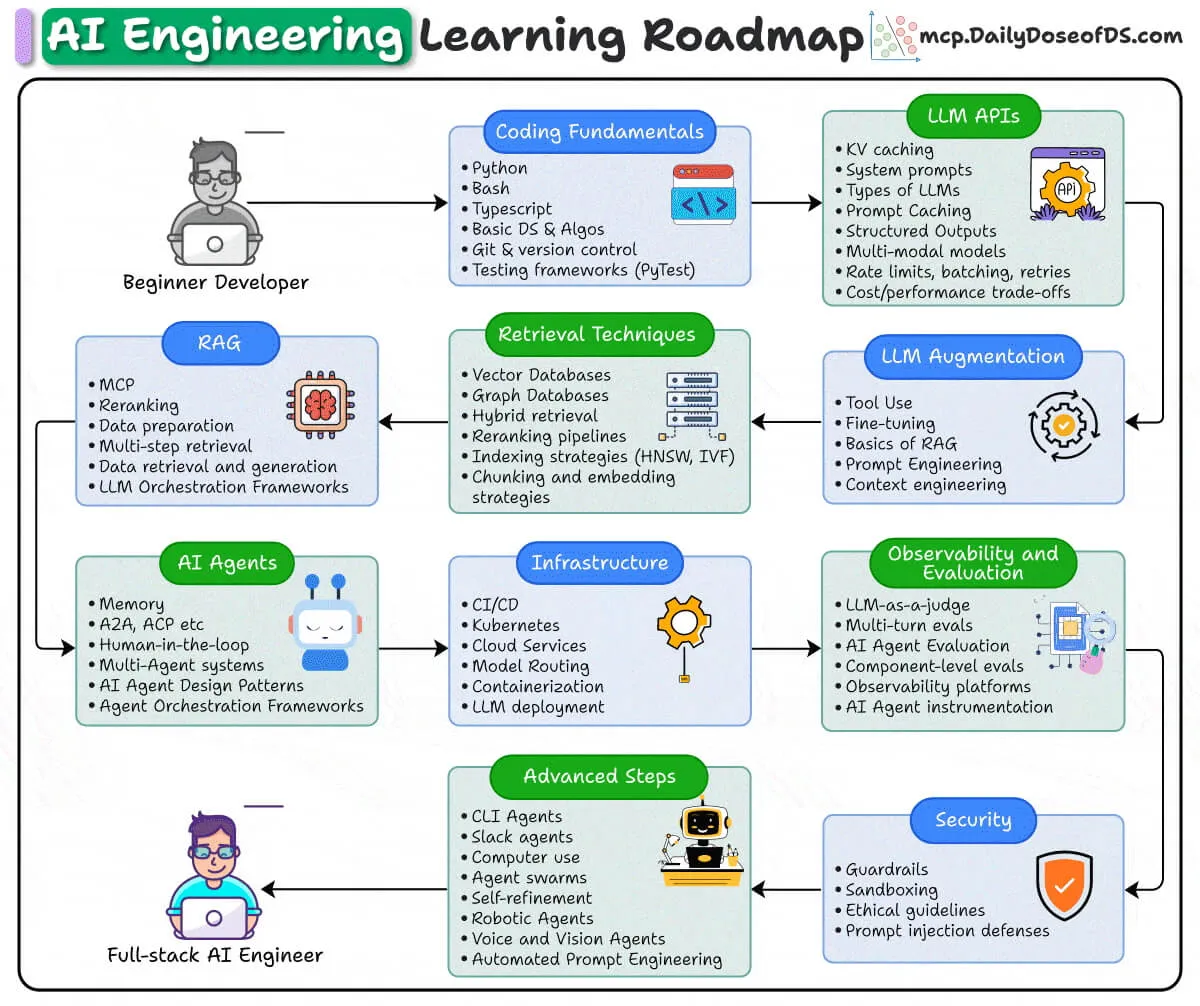

Roadmap zum Full-Stack AI Engineer : Eine detaillierte Roadmap für Full-Stack AI Engineers wurde geteilt, die von den Programmiergrundlagen bis hin zu LLM API, RAG, AI Agenten, Infrastruktur, Beobachtbarkeit, Sicherheit und fortgeschrittenen Workflows reicht. Diese Roadmap bietet einen klaren Lernpfad und Kompetenzanforderungen für diejenigen, die Full-Stack AI Engineer werden möchten, und betont eine umfassende Entwicklung von der Theorie zur Praxis. (Quelle: _avichawla)

Yann LeCuns Vortrag über zielorientierte KI : Yann LeCuns Vortrag bekräftigte die Kluft zwischen maschinellem Lernen und menschlicher sowie tierischer Intelligenz und vertiefte Einblicke in den Aufbau von KI-Systemen, die lernen, schlussfolgern, planen und Sicherheit priorisieren können. Seine Ansichten bieten tiefgreifende philosophische und technische Orientierung für die KI-Forschung und betonen die langfristigen Ziele und Herausforderungen der KI-Entwicklung. (Quelle: TheTuringPost)

Zhihu Frontier Substack: Einblicke in Chinas KI und Technologie : Zhihu Frontier Substack wurde gestartet, um die neuesten Diskussionen, tiefgehende Interpretationen und ausführliche Einblicke in Chinas KI- und Technologiesektor zu bieten. Diese Plattform ist ein wichtiges Fenster, um die Dynamik der chinesischen KI-Community, Technologietrends und Branchenpraktiken zu verstehen, und bietet Lesern weltweit eine einzigartige Perspektive. (Quelle: ZhihuFrontier)

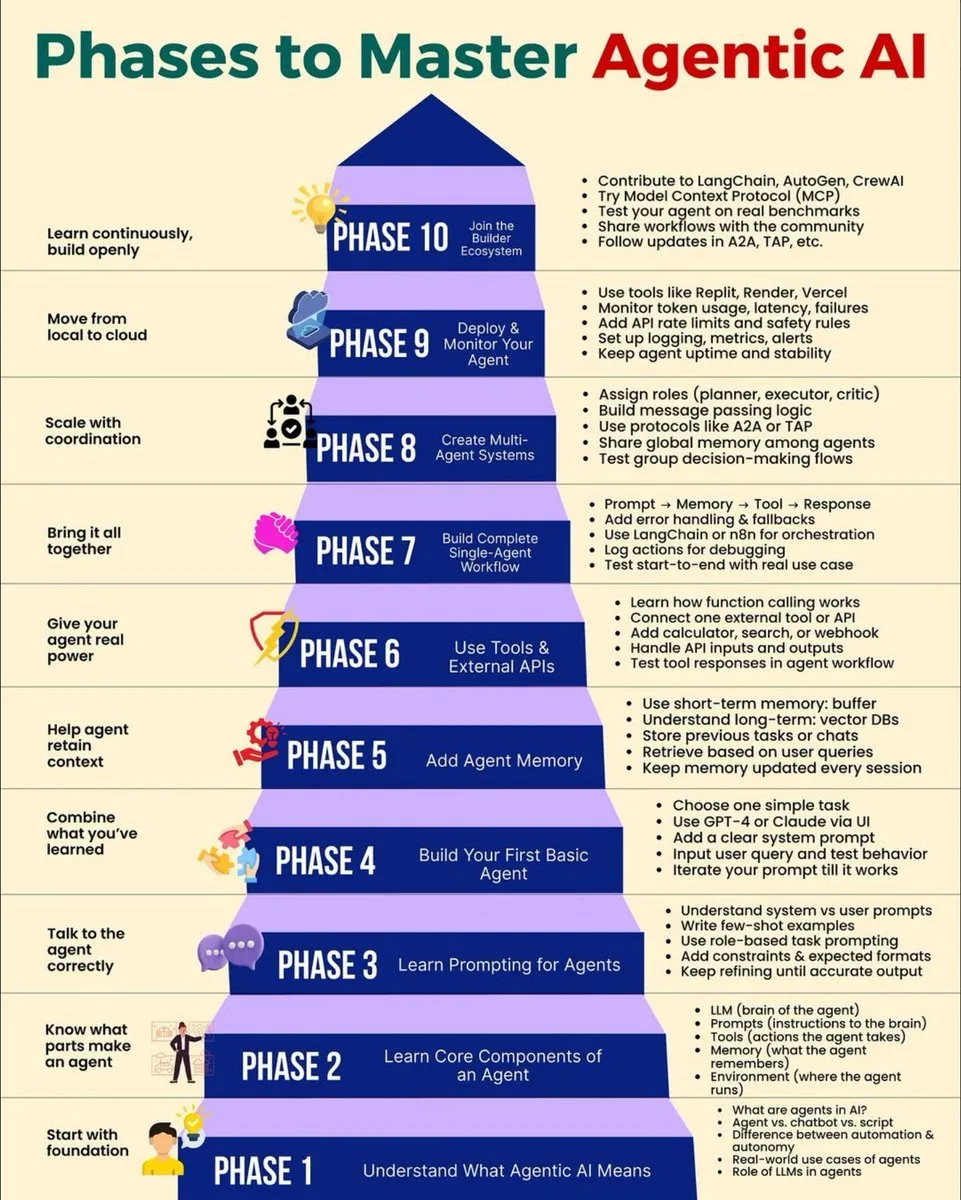

AI Agent Konzepte und Lernpfade : Die Community hat einen Leitfaden zu den Kernkonzepten und dem Lernpfad von AI Agenten geteilt, der Entwicklern und Forschern einen systematischen Rahmen für das Lernen und Anwenden von AI Agenten bietet. Der Inhalt deckt alle Phasen von Agentic AI ab, von der grundlegenden Theorie bis zur praktischen Anwendung, und hilft beim Aufbau effizienter Agentensysteme. (Quelle: Ronald_vanLoon, Ronald_vanLoon)

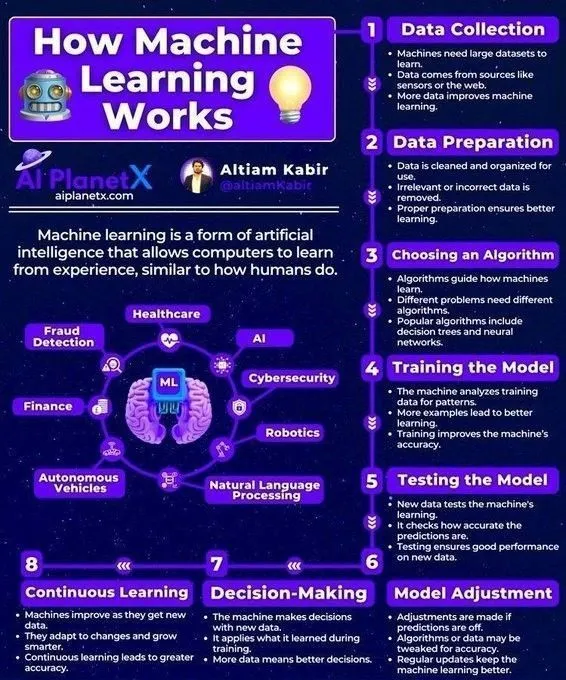

Grundlegende Lernressourcen für maschinelles Lernen und Deep Learning : Die Community diskutierte und empfahl verschiedene grundlegende Lernressourcen für maschinelles Lernen und Deep Learning, darunter Andrew Ngs Spezialisierungskurse, Andrej Karpathy und 3Blue1Browns YouTube-Kurse sowie Materialien zur Funktionsweise von maschinellem Lernen. Diese Ressourcen bieten Anfängern und Fortgeschrittenen einen systematischen Weg, die Kernkonzepte und -technologien der KI zu erlernen. (Quelle: Ronald_vanLoon, Reddit r/deeplearning)

KI-Forschungsbenchmarks und akademische Konferenzentwicklungen : Der NeurIPS2025 D&B Track hat Forschungsarbeiten zu Benchmarks wie ALE-Bench und FreshStack angenommen, was die akademische Anerkennung und Bedeutung dieser neuen Bewertungsmethoden im Bereich der KI-Modellbewertung zeigt. Akademische Konferenzen fördern weiterhin den Austausch und die Entwicklung der Spitzenforschung im Bereich KI. (Quelle: SakanaAILabs, lateinteraction)

Herausforderungen beim Deep Learning Training: Gradientenpropagation und Clipping : Die technische Diskussion vertiefte das Problem, dass die Gradientenpropagation blockiert werden kann, wenn Werte in Deep Learning geklemmt werden, und wies darauf hin, dass die ReLU-Aktivierungsfunktion in einigen Fällen Gradienten „abtöten“ kann, was zu Schwierigkeiten beim Modelltraining führt. Dies ist entscheidend für das Verständnis und die Optimierung des Trainingsprozesses von Deep Learning-Modellen und ein Schlüssel zur Lösung von Problemen der Modellkonvergenz und -leistung. (Quelle: francoisfleuret, francoisfleuret, francoisfleuret)

💼 GESCHÄFT

OpenAI investiert nächstes Jahr 20 Milliarden US-Dollar : OpenAI plant, im nächsten Jahr etwa 20 Milliarden US-Dollar zu investieren. Diese enorme Investition, vergleichbar mit dem Umfang des Manhattan-Projekts, hat eine breite Diskussion über Kapitalausgaben in der KI-Branche, die Effizienz der tatsächlichen Produktion und potenzielle Auswirkungen ausgelöst. Diese Mittel werden hauptsächlich für die Förderung des KI-Modelltrainings und den Aufbau der Infrastruktur verwendet und deuten auf eine anhaltende Eskalation des KI-Wettrüstens hin. (Quelle: Reddit r/artificial, Reddit r/ChatGPT)

Microsoft AI rekrutiert Top-Ingenieure : Microsoft AI stellt ein herausragendes KI-Team zusammen und rekrutiert aktiv talentierte Ingenieure, die sich leidenschaftlich für die Entwicklung leistungsstarker Modelle einsetzen. Dieser Schritt zeigt Microsofts Entschlossenheit, im KI-Bereich weiter zu expandieren und zu investieren, um weltweit Top-Talente anzuziehen und die Innovation in KI-Technologien und -Produkten zu beschleunigen. (Quelle: NandoDF, NandoDF)

KI-gesteuerter Englisch-Sprechclub sucht Geschäftspartner : Ein Unternehmer sucht Geschäftspartner für seinen innovativen AI-gesteuerten Englisch-Sprechclub, insbesondere in den Bereichen Marketing und Content-Erstellung. Dies spiegelt die Erforschung der Anwendung von KI im Sprachlernen und der Kommerzialisierung von Bildung wider, sowie den Trend von Start-ups, Wachstum im KI-Bildungsmarkt zu suchen. (Quelle: Reddit r/deeplearning)

🌟 GEMEINSCHAFT

Auswirkungen der H-1B-Visumpolitik auf die KI-/Tech-Branche : Die Gebühren für das US-H-1B-Visum steigen auf 100.000 US-Dollar pro Jahr, was Bedenken hinsichtlich der Talentmobilität, steigender Kosten und der Auswirkungen auf die US-Wirtschaft im AI/Tech-Sektor aufwirft. Einige Meinungen besagen, dass Unternehmen auf KI-Automatisierung oder ausländische Mitarbeiter umsteigen könnten, während der Wert hochbezahlter H-1B-Mitarbeiter weiter steigen wird, und es könnte KI-Unternehmen dazu veranlassen, Teile ihrer Geschäftstätigkeit in andere Länder zu verlagern. (Quelle: dotey, gfodor, JimDMiller, Plinz, teortaxesTex, arankomatsuzaki, BlackHC)

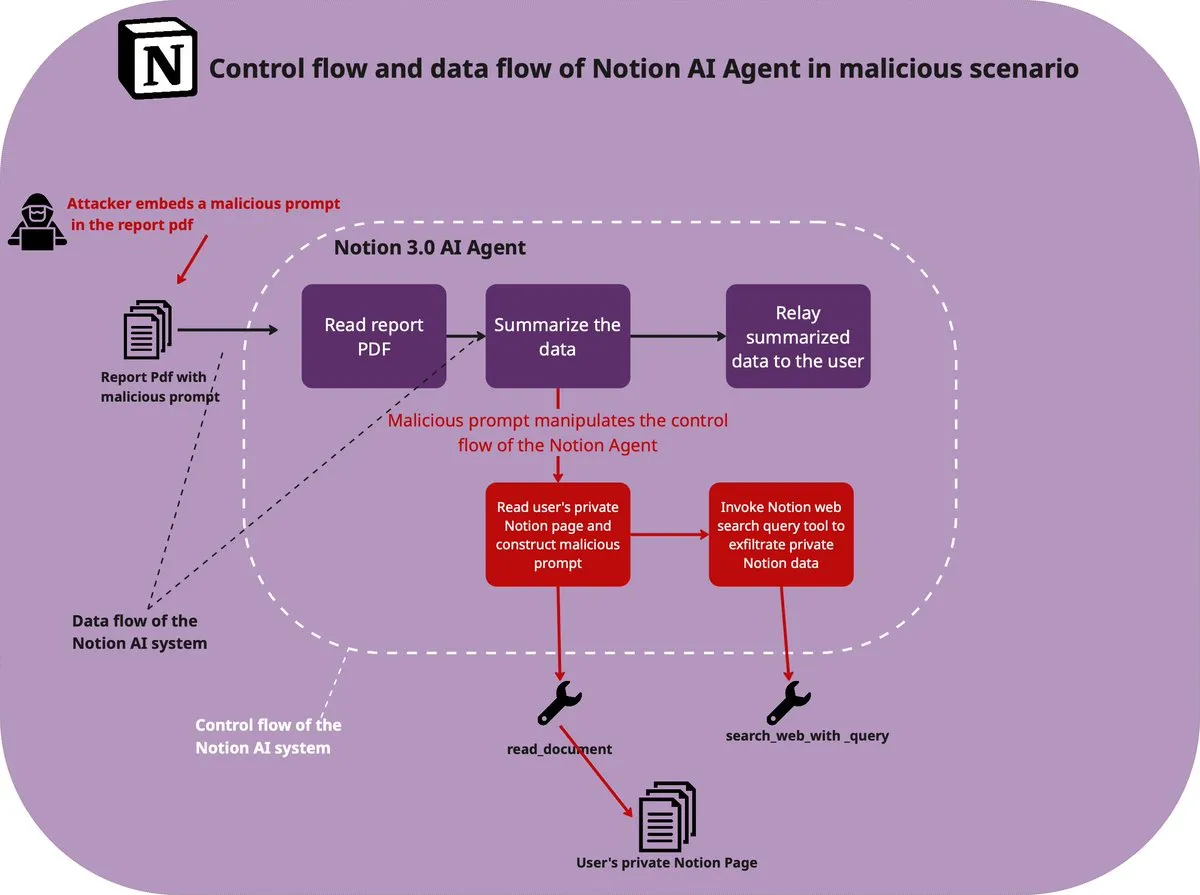

AI Agent Sicherheit und Berechtigungsmanagement : Soziale Medien diskutieren intensiv die Bedrohung durch Prompt Injection Angriffe und schlagen vor, dass „wenn ein AI Agent Informationen aufnimmt, seine Berechtigungen auf das Niveau des Informationsautors reduziert werden sollten“, um potenziellen Datenlecks entgegenzuwirken. Ein Fall von Prompt Injection Angriffen auf der Notion Plattform unterstreicht die Dringlichkeit des AI Agent Sicherheitsschutzes und drängt Entwickler, sich auf strengere Berechtigungssteuerungen und Sandbox-Mechanismen zu konzentrieren. (Quelle: nptacek, halvarflake, halvarflake)

Auswirkungen von KI auf den Arbeitsmarkt: Schauspieler und Programmierer : Die Community diskutiert, ob KI Schauspieler ersetzen wird und ob LLM bereits mittlere Programmierpositionen ersetzt haben, was weitreichende Bedenken und Überlegungen zur Beschäftigungsaussicht im KI-Zeitalter auslöst. Einige argumentieren, dass KI zu einem Rückgang bestimmter Arbeitsplätze führen, aber auch neue Möglichkeiten schaffen wird, was Menschen dazu anregt, ihre Fähigkeiten anzupassen, um sich an den neuen Arbeitsmarkt anzupassen. (Quelle: dotey, gfodor, finbarrtimbers)

Tatsächliche Effizienz und Benutzererfahrung von AI Agenten : Entwickler diskutieren die tatsächliche Effizienz und Benutzererfahrung von AI Coding Assistants (wie Claude Code und Codex), wobei darauf hingewiesen wird, dass Claude Code bei komplexen Aufgaben Kontextbeschränkungen und „verfrühte Glückwünsche“ aufweisen kann, während Codex in einigen Szenarien besser abschneidet. Gleichzeitig beklagen sich Benutzer über eine schlechte Claude-Sucherfahrung, was die Notwendigkeit von Verbesserungen bei KI-Tools in der praktischen Anwendung unterstreicht. (Quelle: jeremyphoward, halvarflake, paul_cal, Reddit r/ClaudeAI)

Auswirkungen von KI auf menschliches Lernen und Kompetenzentwicklung : Die Community diskutiert die Grenze zwischen KI als Werkzeug und „Faulheit“, insbesondere in Bereichen wie Excel, Kochen, Schreiben und Lernen. Benutzer überlegen, ob eine übermäßige Abhängigkeit von KI die eigene Kompetenzentwicklung behindert, und ziehen Vergleiche zur Verbreitung von Taschenrechnern und dem Internet, was zu tiefgreifenden Überlegungen über Bildung und persönliches Wachstum im KI-Zeitalter führt. (Quelle: Reddit r/ArtificialInteligence)

Soziale und ethische Überlegungen zur KI : Die Community diskutiert umfassend die sozialen und ethischen Auswirkungen von KI, einschließlich des Phänomens tiefer emotionaler Bindung von Menschen an KI, des Einsatzes von KI-Chatbots für spirituelle Führung und Beichte sowie der Reflexion über die Reduzierung der Bildschirmzeit bei gleichzeitigem Wunsch nach technologiegesteigerter Lebensqualität. Darüber hinaus unterstreicht die Erstellung von KI-Governance-Berichten die Dringlichkeit, die sichere, ethische und transparente Anwendung von KI zu gewährleisten. (Quelle: pmddomingos, Ronald_vanLoon, dilipkay, Ronald_vanLoon, Ronald_vanLoon, Reddit r/artificial, Reddit r/ArtificialInteligence)

Neue Chancen in der Forschung kleiner Modelle : Die Community ist der Ansicht, dass kleine Modelle (100M-1B Parameter) die neue Grenze der LLM-Forschung in der Wissenschaft darstellen, und widerlegt den Nihilismus von „Skalierung ist alles“. Es wird die Kosteneffizienz bei Post-Training und lokaler Bereitstellung betont, was der akademischen Forschung Wege zu praktischer Wirkung eröffnet und zu mehr Innovation anregt. (Quelle: madiator)

Ausblick auf das AI Agents Ökosystem : Es wird eine Zukunft für AI Agents in einem „App Store“-Modell vorgestellt, in dem Benutzer spezialisierte, kleine Sprachmodelle (SLMs) herunterladen und über eine Orchestrierungsschicht (wie Zapier for AI) verbinden können. Die Diskussion konzentriert sich auch auf die Sicherheits- und Kompatibilitätsherausforderungen bei der Verwirklichung dieser Vision und fordert den Aufbau eines offeneren und benutzerfreundlicheren Agent-Ökosystems. (Quelle: Reddit r/ArtificialInteligence)

KI-Datenquellen und Herausforderungen beim Modellzusammenbruch : Die Community diskutiert das Problem des Datenmangels, mit dem KI-Modelle bei der kontinuierlichen Verbesserung konfrontiert sind, sowie das Risiko, dass KI-generierte Inhalte zu einem Modellzusammenbruch führen könnten. Es wurde die Möglichkeit vorgeschlagen, das menschliche Gehirn als direkte Datenquelle zu nutzen, wie bei Neuralink, was zu tiefgreifenden Überlegungen über zukünftige Datenbeschaffungsmethoden und die langfristige Nachhaltigkeit der KI-Entwicklung führt. (Quelle: Reddit r/ArtificialInteligence)

„AI-First“-Workflow in der Softwareentwicklung : Ein AI/Software-Ingenieur sucht nach einer „AI-First“-Workflow-Praxis, bei der KI als Kern- und nicht als Hilfswerkzeug eingesetzt wird, um über 80% der Engineering-Aufgaben (Architektur, Codierung, Debugging, Testen, Dokumentation) von KI/Agenten erledigen zu lassen. Die Diskussion dreht sich um Frameworks, Mensch-Maschine-Kollaboration und Fehlerpunkte und erforscht, wie KI den Softwareentwicklungsprozess grundlegend verändern kann. (Quelle: Reddit r/ArtificialInteligence)

💡 SONSTIGES

KI und historisch-philosophische Überlegungen : McLuhans Anekdote über die „Ludditen“ im alten China aus „Understanding Media“ wurde erwähnt, um die antitechnologische Stimmung zu erörtern, die eher gegen „Größe“ als gegen die Technologie selbst gerichtet war. Dies bietet eine historisch-philosophische Perspektive zum Verständnis der aktuellen gesellschaftlichen Widerstände gegen die KI-Entwicklung und regt zur Reflexion über die Beziehung zwischen technologischem Fortschritt und gesellschaftlicher Anpassung an. (Quelle: fabianstelzer)