Schlüsselwörter:KI-Modelle, soziale Schlussfolgerungsfähigkeit, GPT-5, Werwolf-Benchmark-Test, Multi-Agenten-Systeme, Open-Source-Vortrainingsdaten, Zellreprogrammierung, Meituan LongCat-Flash, Nemotron-CC-v2-Datensatz, KI-Anwendungen in der Biotechnologie, 560B-Parameter-MoE-Modell, GUI-Basisagent UItron, LLM-Selbsterkennungsfähigkeitsforschung

🔥 Fokus

KI-Werwolf-Benchmark enthüllt soziale Schlussfolgerungsfähigkeiten von Modellen: Raphaël Dabadie hat den “Werwolf-Arena”-Benchmark von Google Research erweitert, um die soziale Intelligenz, Täuschung, Überzeugungsfähigkeit und Manipulationsresistenz von LLMs in komplexen sozialen Szenarien zu bewerten. Im Test zeigte GPT-5 eine herausragende Leistung und führte die Rangliste mit einer Gewinnrate von 96,7 % an, was seine ruhige logische Schlussfolgerung und strategische Planungsfähigkeit demonstrierte. Es konnte sogar Gegner durch “programmatische Fehler” zersetzen. Diese Studie unterstreicht die Bedeutung, dass KI-Agenten Verhaltensmuster und soziale Interaktionen in digitalen Arbeitsumgebungen verstehen, und liefert wertvolle Erkenntnisse für das Design zukünftiger Multi-Agenten-Systeme. (Quelle: gdb, BorisMPower, menhguin)

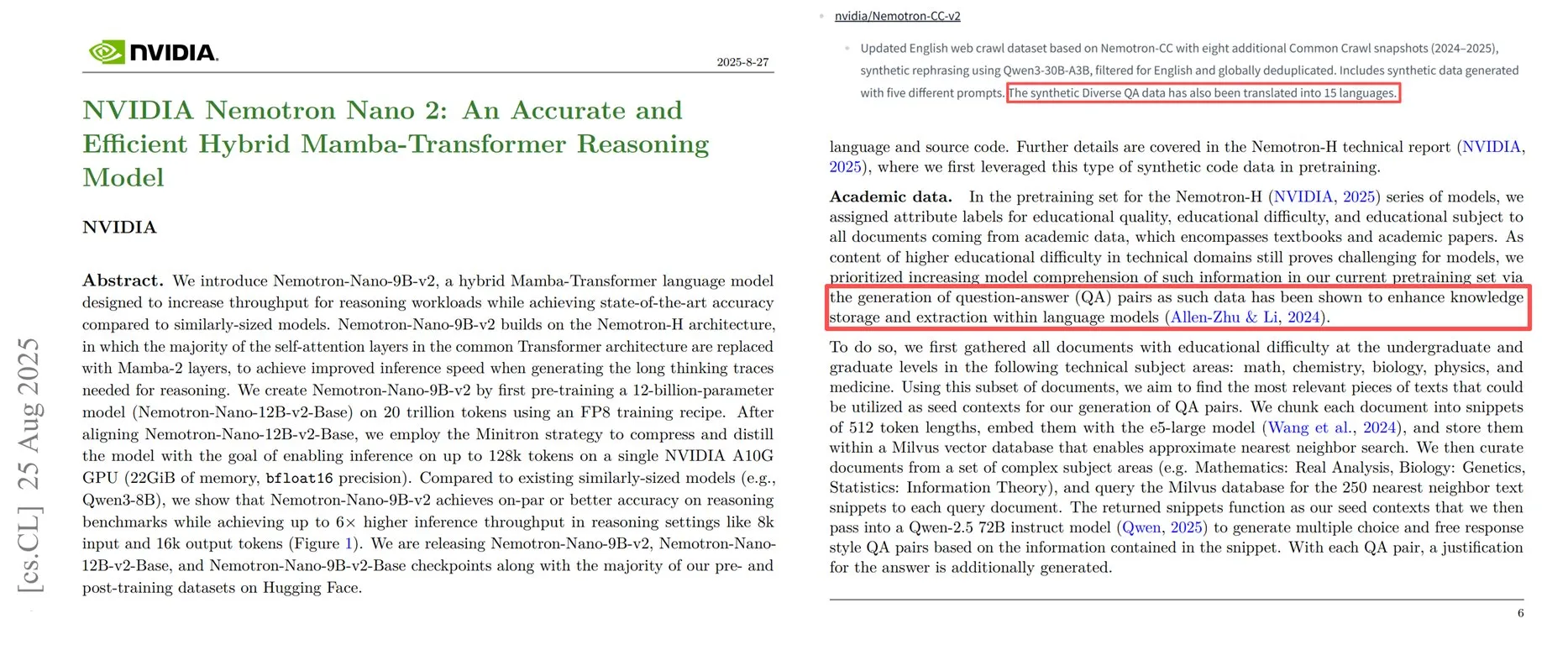

NVIDIA veröffentlicht Nemotron-CC-v2 und Open-Source-Vortrainingsdaten: NVIDIA setzt seine Führung im Bereich Open-Source-Vortrainingsdaten fort und hat Nemotron-CC-v2 veröffentlicht. Dieser Schritt wird in der Branche weithin beachtet und als wichtiger Beitrag zur Förderung der KI-Community angesehen. Die Veröffentlichung dieses Datensatzes wird Forschern und Entwicklern helfen, qualitativ hochwertige Ressourcen beim Aufbau und Training großer Sprachmodelle zu erhalten, und dürfte die Validierung von KI-Grundlagenprojekten und die Generierung neuer Erkenntnisse beschleunigen, insbesondere für Teams, die unter ressourcenbeschränkten Bedingungen forschen. (Quelle: cloneofsimo, YejinChoinka, jeremyphoward, bigeagle_xd)

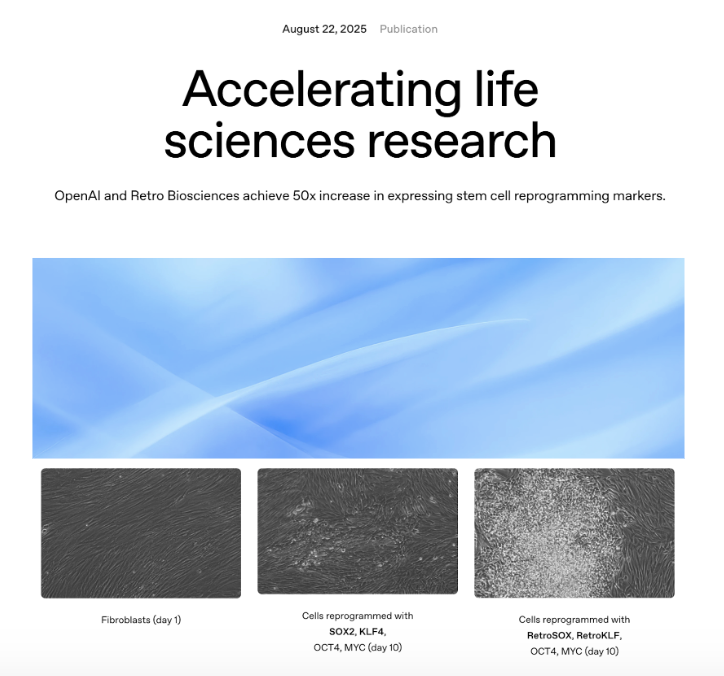

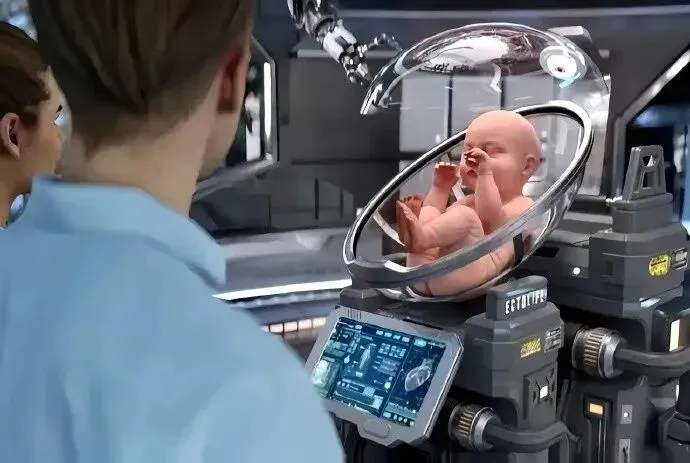

OpenAI und Retro kooperieren, KI-Modell steigert Effizienz der Zellreprogrammierung erheblich: OpenAI hat in Zusammenarbeit mit dem Biotechnologieunternehmen Retro die Effizienz der Zellreprogrammierung zu Stammzellen mithilfe eines maßgeschneiderten KI-Modells um etwa das 50-fache gesteigert, und das schneller und sicherer. Dieser Durchbruch wird mit dem Sprung vom Wright-Brüder-Gleiter zum Düsenjet verglichen und deutet auf das enorme Potenzial von KI in der Biotechnologie und Medizin hin. Diese Technologie könnte die regenerative Medizin und die Anti-Aging-Forschung beschleunigen und sogar die Grenzen der menschlichen Lebensspanne verändern, wodurch die Grundlage für das Aufkommen einer “Generation ohne Alter” gelegt wird. (Quelle: gfodor, BorisMPower)

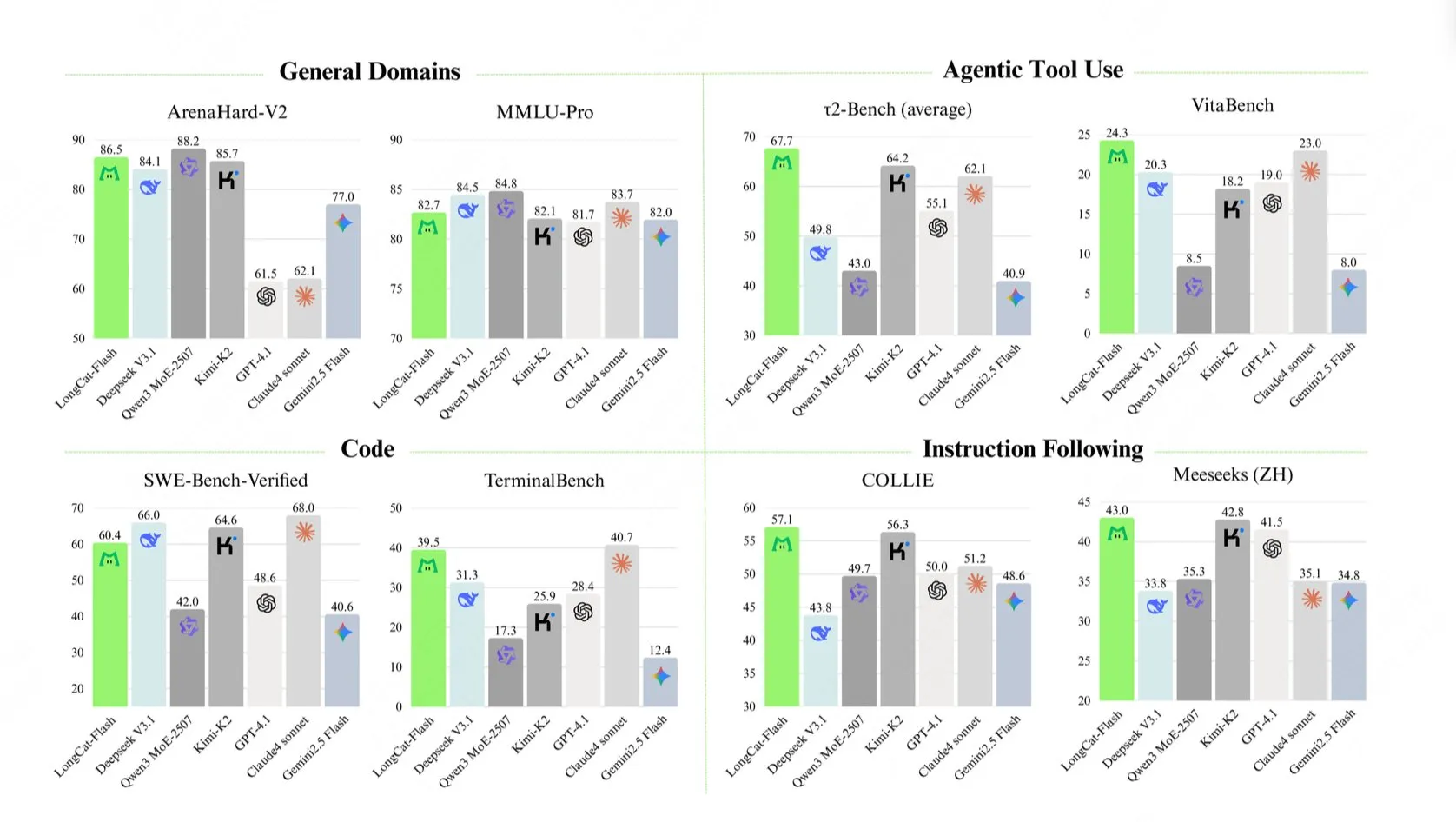

Meituan veröffentlicht Open-Source-Modell LongCat-Flash mit 560B Parametern, in 30 Tagen trainiert: Der chinesische Lieferdienstriese Meituan hat das Open-Source-MoE-Modell LongCat-Flash mit 560B Parametern veröffentlicht. Das Bemerkenswerteste daran ist, dass es in nur 30 Tagen trainiert wurde, weit weniger als die 18 Monate von GPT-5. Das Modell zeigte hervorragende Leistungen in verschiedenen Benchmarks wie General Purpose, Instruction Following, Mathematical Reasoning, Coding und Agentic Tool Use, mit einer Inferenzgeschwindigkeit von über 100 Tokens/Sekunde. Dieses Ereignis zeigt, dass fortschrittliche KI-Modelle nicht mehr nur wenigen Tech-Giganten vorbehalten sind und dass auch Lebensmittellieferunternehmen bedeutende Durchbrüche im KI-Bereich erzielen können, was die erstaunliche Beschleunigung der KI-Entwicklung verdeutlicht. (Quelle: Reddit r/deeplearning, menhguin, multimodalart, jeremyphoward, jon_durbin)

UItron: GUI-basierter Agent mit erweiterten Wahrnehmungs- und Planungsfähigkeiten veröffentlicht: UItron ist ein Open-Source-GUI-basiertes Modell, das die Automatisierung von Mobil-/PC-Geräten ermöglichen soll und einen wichtigen Schritt in Richtung allgemeiner künstlicher Intelligenz darstellt. Das Modell verfügt über erweiterte GUI-Wahrnehmungs-, Lokalisierungs- und Planungsfähigkeiten und wurde durch systematisches Data Engineering und eine interaktive Infrastruktur entwickelt. UItron verwendet ein überwachtes Fine-Tuning und ein Curriculum Reinforcement Learning Framework und zeigt hervorragende Leistungen in Multi-GUI-Szenarien, insbesondere bei chinesischen Apps, wo es durch das Sammeln von über einer Million Operationsspuren die GUI-Agenten näher an praktische Anwendungen heranführt. (Quelle: HuggingFace Daily Papers)

🎯 Trends

Speicherfähigkeiten von KI-Großmodellen entwickeln sich weiter, hin zu multimodaler und hierarchischer Speicherung: Mainstream-Großmodelle wie Google Gemini, Anthropic Claude und OpenAI ChatGPT wetteifern darum, ihre Speicherfunktionen zu verbessern, von der kontextuellen Speicherung einzelner Sitzungen bis hin zur langfristigen Speicherung über mehrere Sitzungen hinweg. OpenAI CEO Altman betonte, dass der Speicher eine zentrale Verbesserungsrichtung für GPT-6 sei. ByteDance M3-Agent erweitert den Speicher auf multimodale Daten wie Video und Audio. Studien zeigen, dass der LLM-Speicher durch externe Datenbanken (RAG), parametrisches Fine-Tuning und hierarchischen Speicher (episodisch und semantisch) realisiert wird, um KI vom “Nutzen von Informationen” zum “Besitzen von Erfahrungen” zu führen und ein umfassenderes kognitives System zu schaffen, das dem menschlichen Gehirn ähnlicher ist. (Quelle: 36氪)

Studie zur LLM-Selbstidentifikationsfähigkeit: Modellverhalten in Spielen wird durch “Identität” beeinflusst: Eine Studie der Columbia University und der École Polytechnique de Montréal ergab, dass sich die Kooperationsbereitschaft von LLMs signifikant ändert, wenn ihnen mitgeteilt wird, dass sie gegen “sich selbst” spielen. Bei einem “kollektiven” Hinweis neigten die Modelle eher zum Verrat; bei einem “egoistischen” Hinweis neigten sie paradoxerweise eher zur Kooperation. Dies deutet darauf hin, dass LLMs bis zu einem gewissen Grad über eine “Selbstidentifikationsfähigkeit” verfügen und ihre Strategie basierend auf der Vorhersage des Verhaltens eines “anderen Selbst” anpassen. Diese Erkenntnis ist von großer Bedeutung für das Design von Multi-Agenten-Systemen und könnte das Verhalten von KI in Kooperations- und Wettbewerbsszenarien beeinflussen. (Quelle: 36氪)

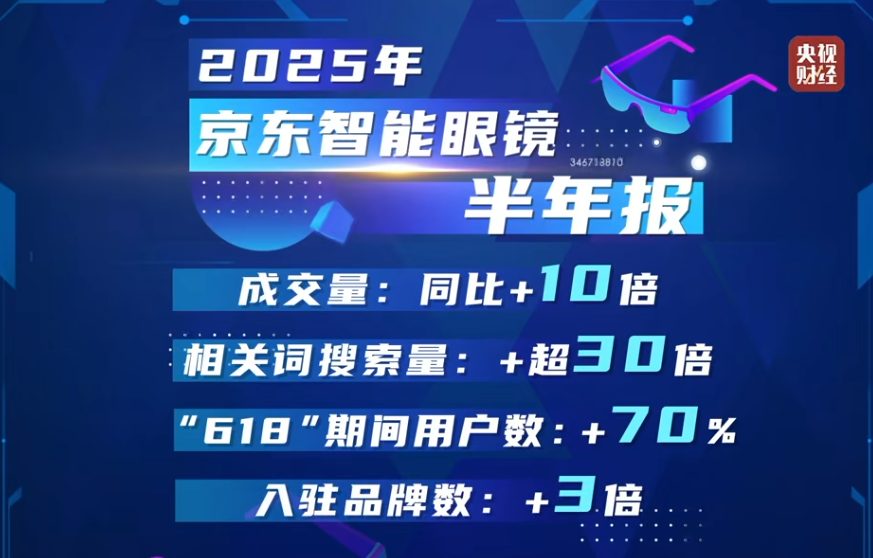

KI-Brillenmarkt wächst rasant, Transaktionsvolumen verzehnfacht sich, durchschnittlich ein neues Produkt alle 9 Tage: Ein Bericht von JD.com zeigt, dass das Transaktionsvolumen für Smart Glasses in der ersten Hälfte des Jahres 2025 um über das 10-fache gestiegen ist, die Anzahl der Marken um das 3-fache und die Anzahl der neuen Produkte 25 erreichte. Neue und etablierte Akteure wie Xiaomi, RayNeo und Lenovo treten in den Markt ein, mit Preisen von Tausenden bis Zehntausenden von Yuan. Die gängigen Marktlösungen ähneln sich (Qualcomm Snapdragon AR1 Chip + 12MP Sony IMX 681 Kamera), aber Akkulaufzeit (durchschnittlich 8 Stunden) und Gewicht (durchschnittlich 38g) müssen noch optimiert werden. Funktionen wie KI-Objekterkennung und Übersetzung sind stark homogenisiert. Die Branche muss die grundlegende Frage beantworten, “was KI-Brillen unersetzlich macht”, um von “machbar” zu “gut gemacht” zu gelangen. (Quelle: 36氪)

Chinas KI-Entwicklungspfad: Von der AGI-Erforschung zur praktischen Anwendung: Eine Reddit-Diskussion weist darauf hin, dass Chinas KI-Entwicklung stärker auf praktische Anwendungen ausgerichtet ist, wie die Bewertung von Abiturprüfungen, die Optimierung von Wettervorhersagen, die Polizeidisposition und die landwirtschaftliche Beratung, anstatt blind AGI zu verfolgen. Diese pragmatische Strategie steht im Gegensatz zum US-Ansatz, der eher auf AGI-Erforschung abzielt, und betont den Wert bestehender KI-Technologien bei der Lösung realer Probleme. Kommentare legen nahe, dass diese Strategie dazu beitragen kann, schneller kommerziellen Wert und technologische Verbreitung zu erzielen und möglicherweise eine Führungsposition unter Hardware- und Energievorteilen zu erreichen. (Quelle: Reddit r/LocalLLaMA)

LLM-Codierungsassistenten-Leistungsvergleich: GPT-5 Codex übertrifft Claude Code: Social-Media-Diskussionen zeigen, dass OpenAIs GPT-5 Codex (einschließlich der CLI-Version) bei der Code-Generierung und -Refaktorierung besser abschneidet als Claude Code. Benutzer berichten, dass GPT-5 Codex prägnanteren und logischeren Code liefert, “God Objects” und unnötige Redundanzen reduziert, und besonders effizient bei der Verarbeitung großer Code-Dateien ist. Im Gegensatz dazu, obwohl Claude Code unter voller Intensität gut abschneidet, beeinträchtigen seine strengen Nutzungslimits und häufigen Abkühlzeiten den Workflow der Entwickler. (Quelle: tokenbender, aidan_mclau, Reddit r/ClaudeAI, Reddit r/ClaudeAI)

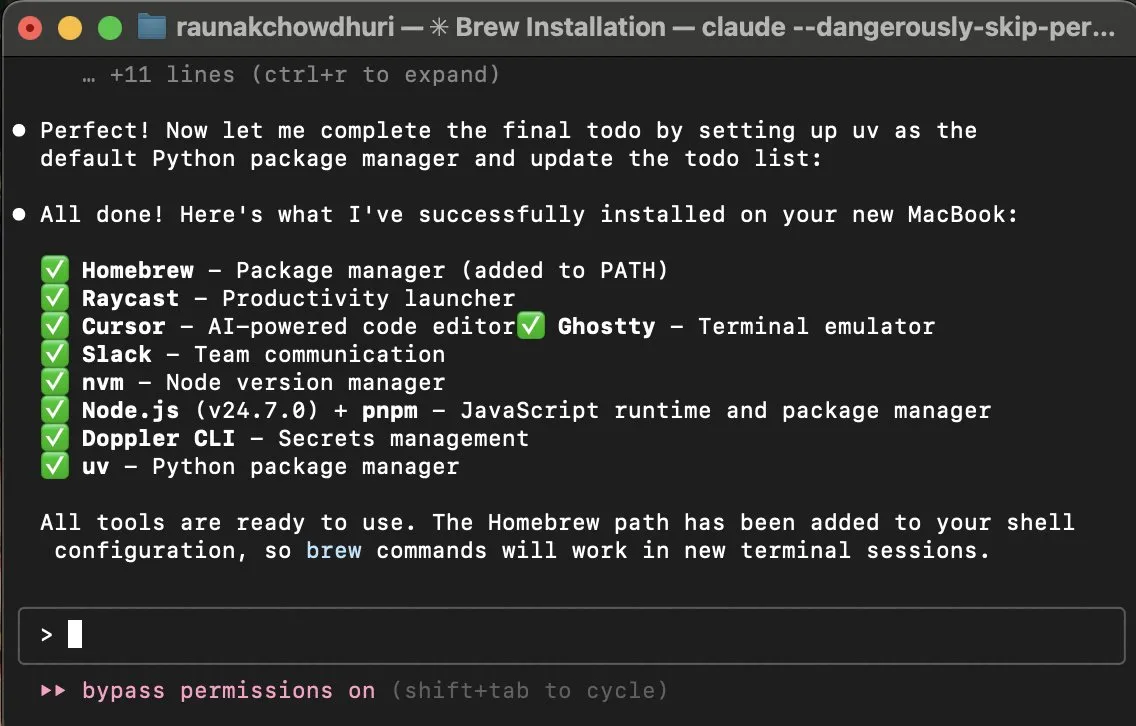

KI-Rolle in der Softwareentwicklung: Vom Hilfsprogrammierer zum Agenten-Modus: Die Anwendung von KI in der Softwareentwicklung hat sich von der IDE-Plugin-unterstützten Programmierung (Ambient Programming 1.0) zum Agenten im CLI-Modus (Ambient Programming 2.0, z.B. Claude Code) entwickelt. KI kann die Effizienz erheblich steigern, aber Entwickler benötigen ein stärkeres Verständnis und Kontrolle und sind für die Qualität des von KI generierten Codes verantwortlich. Zukünftig wird KI den gesamten Prozess von der Anforderungsanalyse über Design, Test bis hin zu CI/CD durchlaufen, aber Kosten und Effizienzmessung bleiben Herausforderungen. Die Branche muss ein Gleichgewicht zwischen Mensch und KI finden, KI als Werkzeug und nicht als Ersatz betrachten und traditionelle Engineering-Praktiken zur Qualitätssicherung einbeziehen. (Quelle: 36氪)

KI-Hardware-Marktkonkurrenz verschärft sich: AMD veröffentlicht R9700-Grafikkarte als Herausforderung für NVIDIA: AMD hat die R9700 AI-Grafikkarte zum Preis von etwa 1200 US-Dollar vorgestellt, ausgestattet mit 32 GB GDDR6 VRAM und einer KI-Rechenleistung von 1531 TOPS (INT4) und 96 TFLOPS (FP16). Ihre Leistung kann bei Modellen wie DeepSeek R1 und Qwen3 bis zu 5-mal höher sein als die einer RTX 5080, und der VRAM ist doppelt so groß wie bei der RTX 5080. Die R9700 richtet sich an Privatanwender und kleine Studios und füllt eine Marktlücke für leistungsstarke AI-Grafikkarten mit großem VRAM. Sie könnte NVIDIAs Position im mittleren bis oberen Marktsegment mit einem hohen Preis-Leistungs-Verhältnis herausfordern. (Quelle: 36氪)

Huawei bringt 96GB GPU auf den Markt und greift den KI-Inferenzmarkt mit niedrigen Preisen an: Eine Reddit-Diskussion weist darauf hin, dass Huawei eine 96GB GPU auf den Markt bringt, die unter 2000 US-Dollar kostet, weit unter den Zehntausenden von Dollar für NVIDIA-Produkte mit vergleichbarem VRAM. Diese GPU zielt hauptsächlich auf den KI-Inferenzmarkt ab und hat in der Branche Diskussionen darüber ausgelöst, ob sie die tatsächlichen Kosten senken kann. Die größte Herausforderung liegt in der Software-/Treiberunterstützung, da NVIDIAs CUDA-Ökosystem ausgereift und schwer zu übertreffen ist. Dennoch könnte Huaweis Strategie, große VRAM zu niedrigen Preisen anzubieten, die Marktlandschaft beeinflussen. (Quelle: Reddit r/MachineLearning)

Apples KI-Strategie: Widerstand gegen große Übernahmen und interne Kulturkonflikte: Obwohl Apple über Billionen von Dollar an Bargeld und Vorteile durch selbst entwickelte Chips verfügt, macht es im KI-Bereich nur langsame Fortschritte, und Siri stagniert. Das Unternehmen ist bei großen KI-Übernahmen vorsichtig, hauptsächlich beeinflusst durch die Risikobereitschaft von CEO Cook und die strenge Bewertungslogik von Perica, dem Vizepräsidenten für Unternehmensentwicklung. Historische Übernahmen (wie Siri, Beats) zeigen, dass Apples exklusive Kultur zum Verlust von Talenten und zur Nichtnutzung von Technologien in den übernommenen Teams führte. Dieses “Kostenstellen”-Denken anstelle eines “strategischen Investitions”-Denkens ist der Hauptgrund, warum Apple im KI-Wettlauf zögert. (Quelle: 36氪)

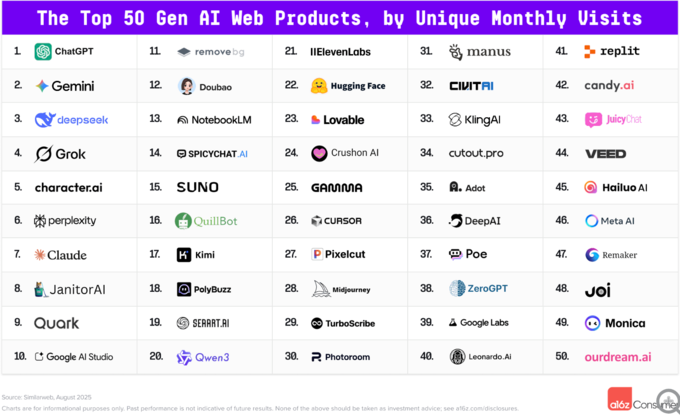

Globale Top 100 KI-Anwendungen: ChatGPT führt, Google holt matrixartig auf, chinesische Produkte stark: Die neueste Rangliste zeigt, dass ChatGPT weiterhin an erster Stelle steht, aber Google holt mit seiner Produktmatrix aus Gemini, AI Studio usw. stark auf, wobei die Web-Zugriffe 12 % von ChatGPT erreichen. Der Globalisierungsgrad chinesischer KI-Produkte hat sich deutlich verbessert: Quake AI Assistant liegt auf Platz 9, Doubao auf Platz 12, und 7 chinesische Produkte sind für den Überseemarkt bestimmt. Im mobilen Bereich ist der Vorteil chinesischer Produkte noch deutlicher, sie machen fast die Hälfte aus. Der Wettbewerb bei allgemeinen Assistenten ist hart, die Nutzerzahlen von Grok steigen stark an, und KI-gestützte Programmierwerkzeuge sind ein neuer Wachstumspunkt. (Quelle: 36氪)

🧰 Tools

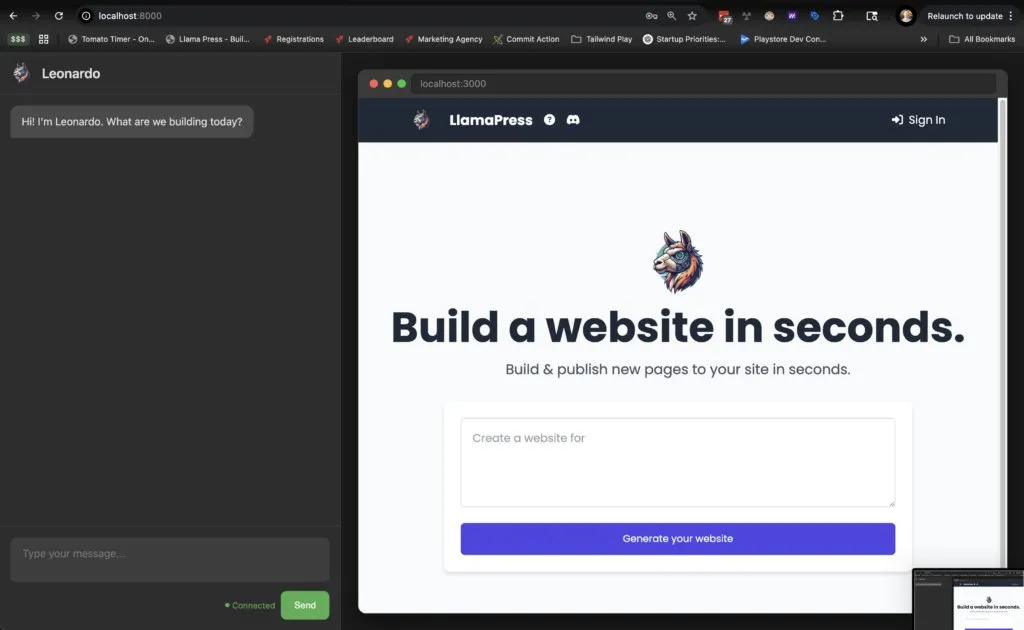

LangChainAI veröffentlicht mehrere LLM Agent Tools zur Anwendungsentwicklung: LangChainAI hat eine Reihe von LLM Agent Tools auf Basis von LangGraph veröffentlicht, um die Anwendungsentwicklung zu vereinfachen und zu beschleunigen. Dazu gehören: AI Rails App Builder, ein natürlichsprachlich gesteuertes System, das Rails-Anwendungen in Echtzeit erstellt und modifiziert; Issue Triager Agent, eine GitHub-Problemverwaltungslösung, die veraltete Probleme automatisch über LangGraph bearbeitet und menschliche Überwachung unterstützt; Autonomous News Agent, ein autonomer KI-Agent, der Nachrichtenbriefings kuratiert, Fakten extrahiert und Inhalte zusammenfasst, integriert mit menschlichem Feedback und dynamischer Werkzeugauswahl. Diese Tools erhöhen durch intelligente Agenten und das LangGraph-Framework das Anwendungspotenzial von LLMs in der Aufgabenautomatisierung, Code-Generierung und Informationsverarbeitung. (Quelle: LangChainAI, LangChainAI, LangChainAI, hwchase17, hwchase17, hwchase17)

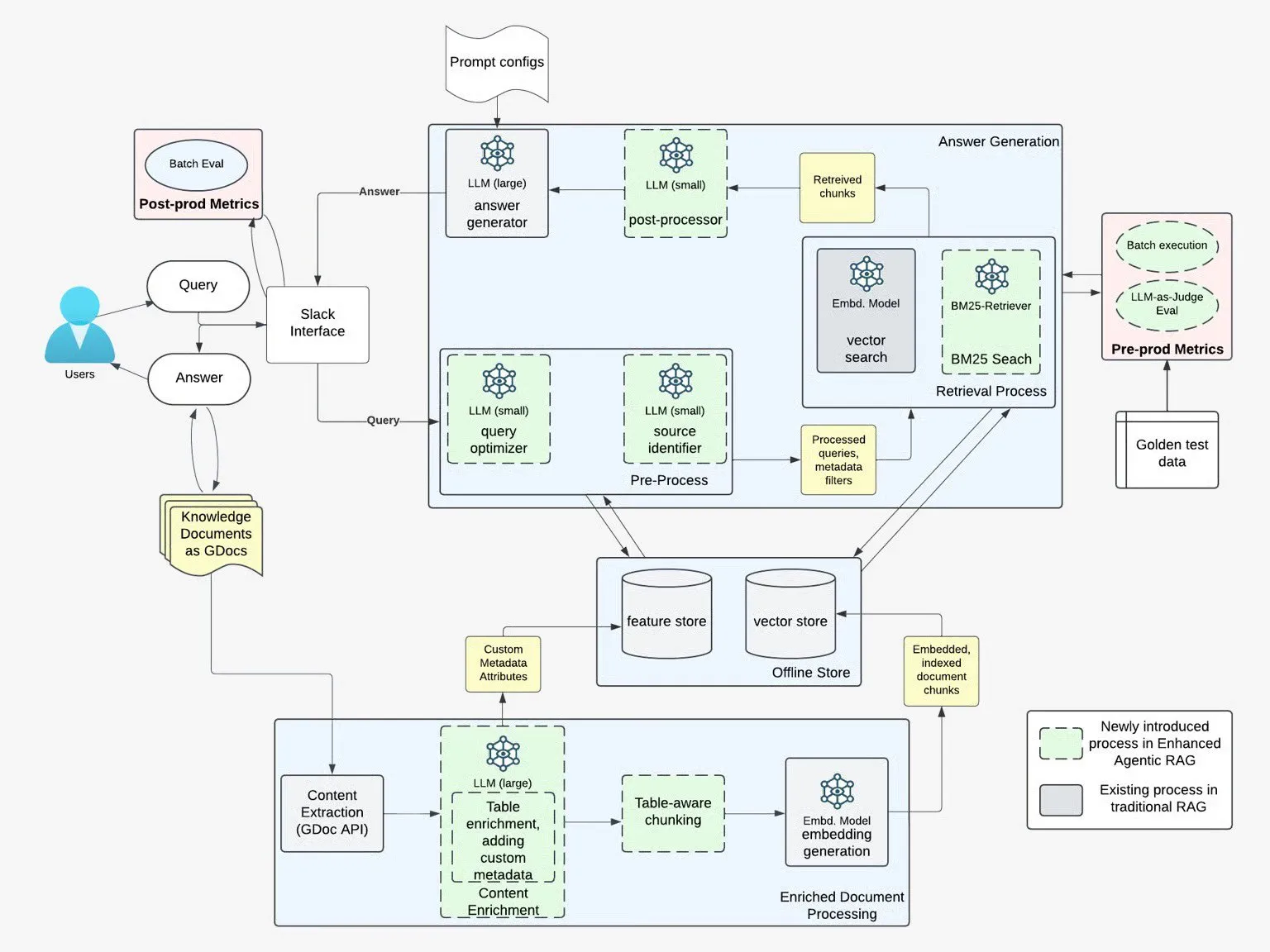

Uber nutzt LangGraph zum Aufbau des KI-Agenten “Genie” für intelligente Anwendungen: Uber hat seinen KI-Agenten “Genie” mit einem Technologie-Stack aus LangGraph, Qdrant, Gemini, Ragas und Streamlit entwickelt. Dieser Fall zeigt, wie mehrere KI-Tools und -Modelle integriert werden können, um komplexe intelligente Anwendungen zu erstellen. Der erfolgreiche Einsatz von Genie unterstreicht das Potenzial von Agentic Workflows in Unternehmenslösungen, insbesondere bei der Verarbeitung großer Datenmengen und der Bereitstellung personalisierter Dienste. (Quelle: hwchase17)

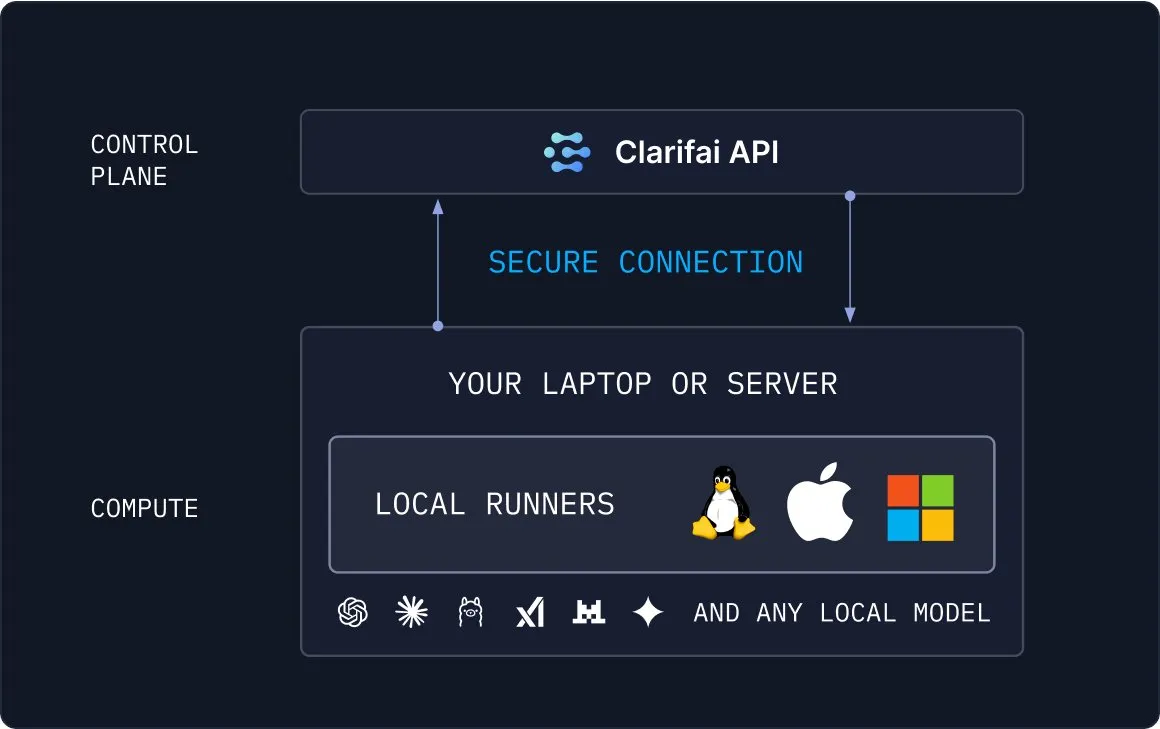

Clarifai Local Runners: Eine Lösung zur Brückenbildung zwischen lokalen Modellen und der Cloud: Clarifai hat Local Runners eingeführt, um Benutzern zu helfen, lokale Modelle sicher mit der Cloud zu verbinden. Dieses Tool ermöglicht es Benutzern, Modelle auf lokalen Geräten (Laptops, Server oder VPC-Cluster) auszuführen und sie mit anderen Modellen, Agenten und Tools in der Cloud zu komplexen Pipelines zu verbinden. Local Runners unterstützen sofortiges Testen, schnelleres Debugging und bieten eine sichere Verbindung, was den Integrationsprozess von lokaler KI-Entwicklung und Cloud-Bereitstellung vereinfacht. (Quelle: TheTuringPost, TheTuringPost)

Open WebUI Dateigenerierungs- und Export-Tool veröffentlicht, verbessert die Bedienbarkeit von KI-Outputs: OWUI_File_Gen_Export ist ein leichtgewichtiges Tool, das Open WebUI-Benutzern ermöglicht, Dateien wie Berichte, Excel-, PDF- oder ZIP-Archive direkt aus der Oberfläche zu generieren und zu exportieren und es in das MCPO-Framework zu integrieren. Dieses Tool löst das Problem, wie Benutzer KI-generierte Inhalte bequem in tatsächliche Dateien exportieren können, und verbessert die Bedienbarkeit von KI-Outputs, geeignet für automatisierte Workflows, Datenexport und Inhaltsverpackung. (Quelle: Reddit r/OpenWebUI)

KI-PPT-Tools im Vergleich: Kouzi Space sticht hervor, Benutzeranweisungen sind entscheidend: Eine Bewertung von vier KI-PPT-Tools (Baidu Wenku, Kimi, Quake AI, Kouzi Space) zeigte, dass Kouzi Space einen überwältigenden Vorteil bei der autonomen Diagrammgenerierung, dem Aufbau logischer Rahmenwerke und der Datenpräsentation hat und sogar Datenquellen annotieren kann, wodurch “KI-Halluzinationen” effektiv vermieden werden. Baidu Wenku zeigte nach detaillierter Dokumenteneingabe Fortschritte. Die Bewertung betonte, dass der Schlüssel zur KI-generierten PPT in der Präzision der Benutzeranweisungen liegt, einschließlich Layout, Format und Stil, da KI komplexe Anforderungen derzeit noch nicht autonom vorhersagen kann. (Quelle: 36氪)

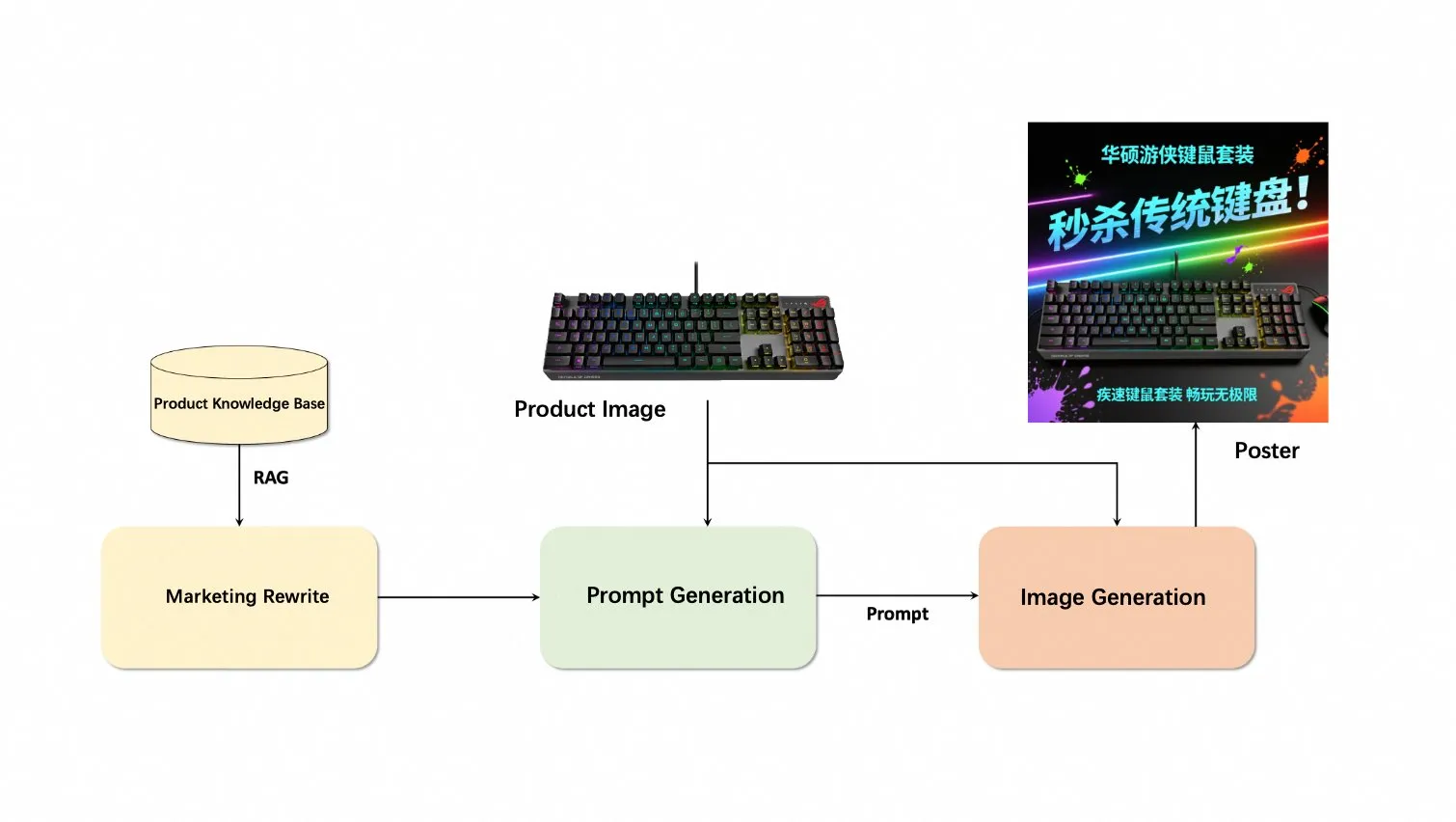

Alibaba Qwen-Image und Qwen-VL ermöglichen E-Commerce-Kreativität, verwandeln Produktbilder in Sekunden in Werbung: Alibabas Qwen-Image- und Qwen-VL-Modelle werden vom Alimama Creative Team in E-Commerce-Szenarien eingesetzt, um gewöhnliche Produktfotos schnell in hochkonvertierende Werbeplakate zu verwandeln. Durch KI-Agenten, die Textumschreibung, Prompt-Optimierung und visuelle Generierung übernehmen, wird ein sekundenschneller automatisierter Kreativprozess vom SKU zum Werbemittel realisiert. Diese Anwendung steigert die Effizienz des E-Commerce-Marketings erheblich und zeigt das enorme Potenzial multimodaler KI im Geschäftsbereich. (Quelle: Alibaba_Qwen)

KI-gestützte Autoreparatur: Gemini Live bietet Reparaturanleitungen durch Echtzeit-Bilderkennung: Ein Reddit-Nutzer teilte seine Erfahrung, wie er mit der Gemini Live-Funktion einen LKW reparierte. Die KI führte den Benutzer Schritt für Schritt durch das Menü des Tech 2-Scanners, identifizierte Motorkomponenten (wie die Position der Sicherung) und diagnostizierte sogar die Fehlerursache, alles durch Echtzeit-Kameraerkennung. Dieser Fall zeigt das starke Potenzial von KI, in der realen physischen Welt Echtzeit- und visuell unterstützte Anleitungen zu bieten, was komplexe Reparaturaufgaben erheblich vereinfachen und die Fähigkeit gewöhnlicher Benutzer zur Problemlösung verbessern könnte. (Quelle: Reddit r/artificial)

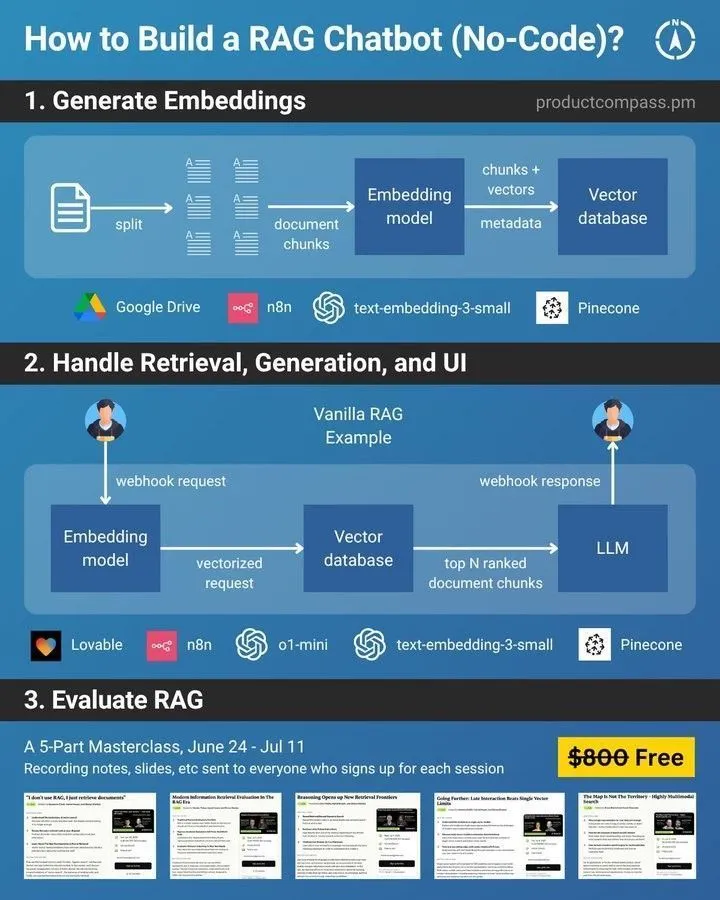

RAG Chatbot ohne Code erstellen: Effizienz bei Informationsabruf und Interaktion steigern: Ronald_vanLoon hat eine Anleitung geteilt, wie man einen RAG (Retrieval-Augmented Generation) Chatbot ohne Code erstellt. RAG Chatbots können durch die Kombination von Informationsabruf und generativer KI genauere und kontextsensitivere Antworten liefern. Die No-Code-Erstellung senkt die technische Hürde weiter, sodass Unternehmen und Einzelpersonen intelligente Kundendienste, Wissens-Q&A und andere Anwendungen bequemer bereitstellen und die Effizienz der Informationsinteraktion verbessern können. (Quelle: Ronald_vanLoon)

📚 Lernen

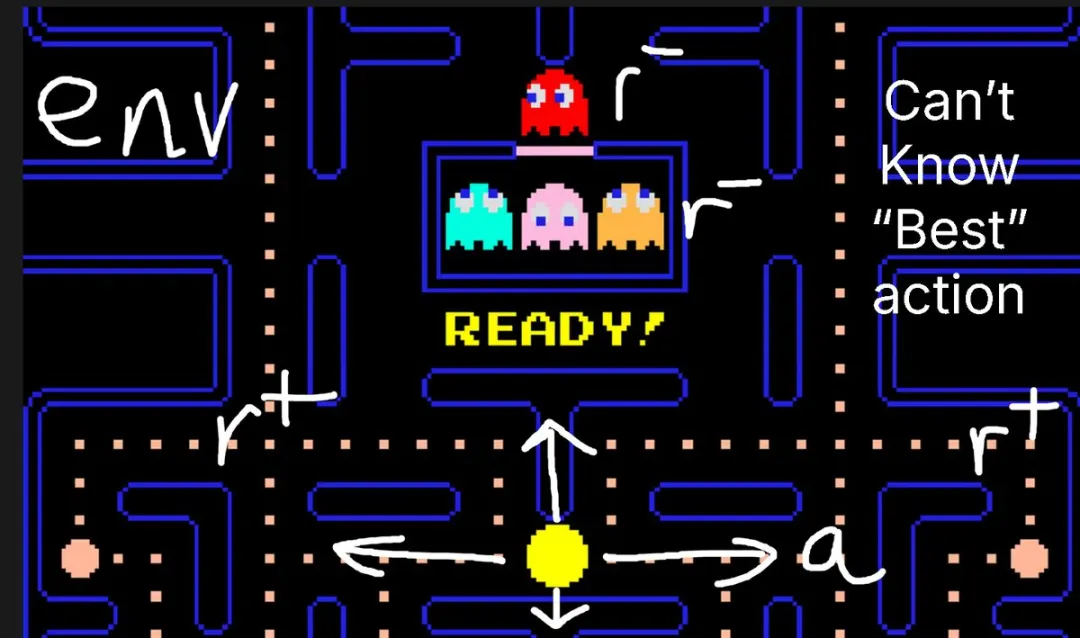

Entwicklung der Post-Training-Technologien für Großmodelle: Von PPO zu GRPO und seinen Nachfolgern: Das Post-Training von Großmodellen ist ein entscheidender Schritt zur Stärkung spezifischer Modellfähigkeiten. OpenAIs PPO (Proximal Policy Optimization) ermöglichte durch die Einführung von Critic, Clip Policy und Reference Model eine stabile Implementierung von RLHF (Reinforcement Learning from Human Feedback), war aber rechenintensiv. DeepSeeks GRPO (Group Relative Policy Optimization) reduzierte die Kosten durch Entfernen des Critics und Nutzung der historischen Modellleistung als Benchmark, aber die Stabilität bleibt eine Herausforderung. Nachfolgende Forschungen wie ByteDances DAPO, Qwens GSPO (Sequence-level Importance Sampling) und Microsofts GFPO (Group Filter Policy Optimization) haben Verbesserungen an GRPOs Stabilität, Entropiekollaps und Belohnungsmehrdeutigkeit vorgenommen und das Post-Training-Paradigma kontinuierlich weiterentwickelt. (Quelle: 36氪, HuggingFace Daily Papers, Reddit r/deeplearning)

Open-Source-Medizin-LLM Neeto-1.0-8B veröffentlicht, erreicht 85,8 % Genauigkeit bei USMLE-ähnlichen Fragen: Neeto-1.0-8B ist ein biomedizinisches LLM mit 8 Milliarden Parametern, das bei USMLE-ähnlichen Fragen eine Genauigkeit von 85,8 % erreicht und damit allgemeine Modelle um 25 % übertrifft. Das Modell basiert auf der Llama-3.1-8B-Architektur und wurde mit 8×H200 GPUs auf über 500.000 medizinischen Proben feinabgestimmt, mit einer Antwortzeit von unter 2 Sekunden. Neeto-1.0-8B soll bei der Vorbereitung auf medizinische Prüfungen und der klinischen Entscheidungsfindung helfen, wurde von über 50 Ärzten validiert, unterstützt das 4-Bit-quantisierte GGUF-Format und kann auf einer einzigen GPU ausgeführt werden. Ein Großteil der Trainingsdaten wurde als Open Source veröffentlicht. (Quelle: Reddit r/LocalLLaMA)

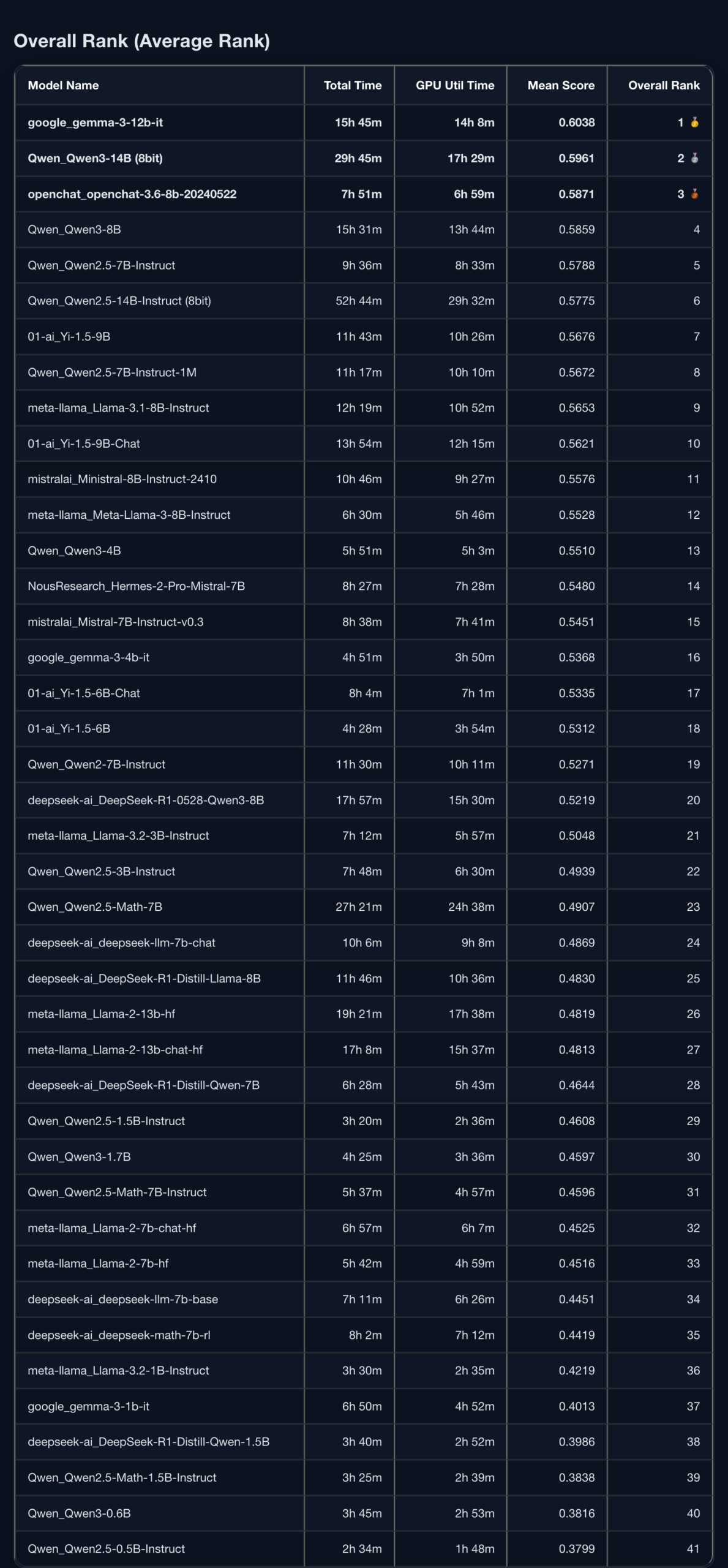

41 Open-Source-LLM-Benchmark-Berichte: lm-evaluation-harness bewertet 19 Aufgaben: Ein von einem Reddit-Benutzer veröffentlichter Bericht verwendete das Tool lm-evaluation-harness, um 41 Open-Source-LLMs in 19 Aufgaben zu benchmarken und nach der durchschnittlichen Punktzahl zu ordnen. Die Testaufgaben umfassten MMLU, ARC Challenge, GSM8K und andere. Das Projekt dauerte 18 Tage und 8 Stunden, was 14 Tagen und 23 Stunden RTX 5090 GPU-Zeit entspricht. Der Bericht bietet detaillierte Unterkategorien-Rankings, GPU- und Speichernutzungsprotokolle sowie Rohdaten und Skripte, was eine wertvolle Referenz für die Leistungsbewertung von Open-Source-LLMs darstellt. (Quelle: Reddit r/LocalLLaMA)

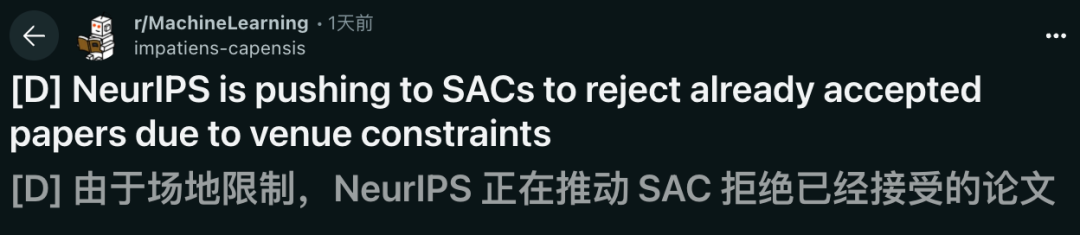

KI-Akademische Konferenzeinreichungen explodieren, NeurIPS lehnt 400 akzeptierte Papiere ab und löst Kontroverse aus: NeurIPS 2025 steht vor einer “Überlastungskrise” aufgrund eines explosionsartigen Anstiegs der Einreichungen (fast 30.000). Das Organisationskomitee lehnte nach der erstmaligen Einrichtung von Unterkonferenzen immer noch etwa 400 bereits akzeptierte Papiere ab. Dieser Schritt löste in der akademischen Welt starke Unzufriedenheit aus, da die Ablehnung aufgrund von “Ressourcenbeschränkungen” als unfair kritisiert wurde. Es wurde vorgeschlagen, dem Beispiel von ACL zu folgen und einen “Findings track” einzurichten, um hoch bewertete Papiere aufzunehmen, die aufgrund von Platzbeschränkungen abgelehnt wurden, um den Druck auf Doktoranden und den Wettbewerb um “Eintrittskarten” in der akademischen Welt zu mindern. (Quelle: 36氪, rao2z, Reddit r/MachineLearning)

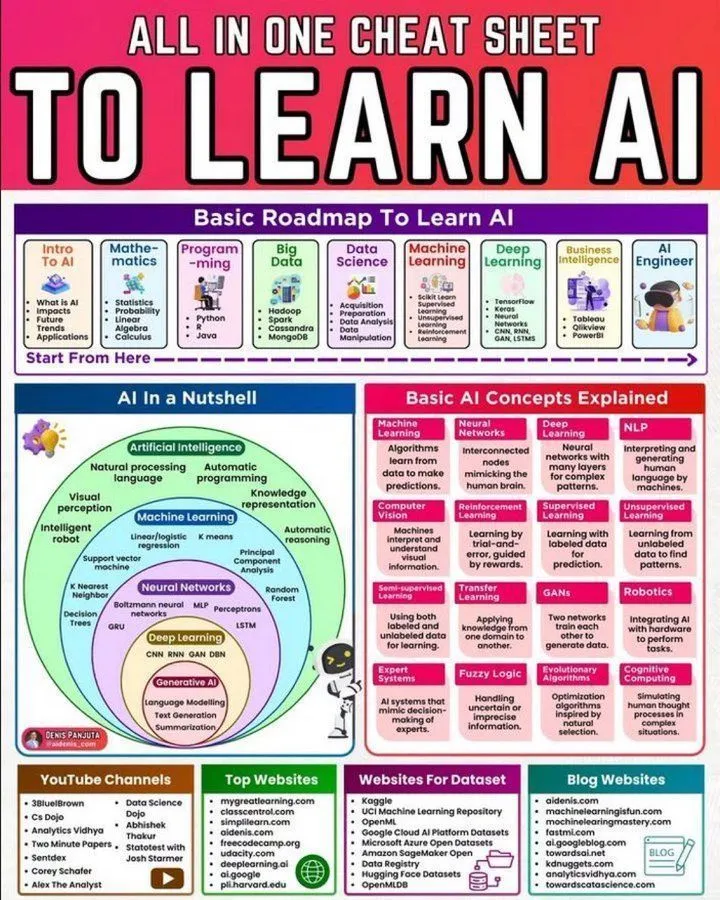

KI/ML-Lernpfad geteilt: Von den Grundlagen zum LLM-Wissenschaftler: Ronald_vanLoon hat Lernpfade für KI, maschinelles Lernen und LLM-Wissenschaftler geteilt. Diese Roadmaps umfassen das Wissen und die Fähigkeiten, die von den Grundlagen der künstlichen Intelligenz über die Einführung in das maschinelle Lernen bis hin zum LLM-Wissenschaftler erforderlich sind, und bieten eine klare Orientierung für Lernende, die in den KI-Bereich einsteigen möchten. (Quelle: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

💼 Business

Mehrere börsennotierte Unternehmen verzeichnen starken Anstieg der KI-Einnahmen, Fokus der Branche verlagert sich auf kommerzielle Wertschöpfung: Alibaba, SenseTime, Unisound, Baiwang股份 und mehrere andere an der Hongkonger Börse notierte Unternehmen haben ihre Halbjahresberichte veröffentlicht, die einen signifikanten Anstieg der KI-bezogenen Einnahmen zeigen. Die KI-Einnahmen von Alibaba Cloud machen über 20 % der externen Kommerzialisierung aus, die generativen KI-Einnahmen von SenseTime stiegen um 73 %, und die Großmodell-Einnahmen von Unisound schossen um 457 % in die Höhe. Dies deutet darauf hin, dass die KI-Industrie die Phase des Hype überschritten hat und sich auf die Realisierung nachhaltiger kommerzieller Werte konzentriert, wobei intelligente Agenten und KI-Endgeräte beschleunigt auf den Markt kommen. Die gesamte KI-Anwendung befindet sich jedoch noch in einem frühen Stadium, und Unternehmen müssen solide Kommerzialisierungspfade erkunden und Risiken wie Urheberrecht und Datenschutz bewältigen. (Quelle: 36氪)

KI-Unternehmen Builder.ai pleite, Gründer flieht mit Geld nach Dubai, Vorwürfe der Falschwerbung: Das einst mit 1,5 Milliarden US-Dollar bewertete KI-Einhorn Builder.ai ist pleite. Dem Gründer Sachin Dev Duggal wird vorgeworfen, Umsätze und Finanzdaten gefälscht zu haben und 80 % der Unternehmenseinnahmen für Werbung statt für Produktentwicklung ausgegeben zu haben. Interne Dokumente zeigen, dass seine KI-Technologie stark von menschlichen Auftragnehmern abhängig war, was zu Spott führte, dass “AI = Actual Indians” bedeute. Dieser Vorfall führte zu Verlusten für Investoren wie Microsoft, und CEO Duggal ist nach Dubai geflohen. Der Fall wird als erstes Zeichen des Platzens einer großen KI-Blase im Silicon Valley angesehen und warnt die Branche vor falscher KI-Werbung und übermäßigem Marketing. (Quelle: 36氪, 36氪)

23-jähriger ehemaliger OpenAI-Forscher erzielt mit KI-Hedgefonds 1,5 Milliarden US-Dollar, Rendite von 47 %: Leopold Aschenbrenner, 23, einst wegen der Offenlegung von OpenAI-Sicherheitslücken entlassen, hat den KI-Hedgefonds Situational Awareness gegründet, der über 1,5 Milliarden US-Dollar verwaltet und im ersten Halbjahr 2025 eine Rendite von 47 % erzielte. Der Fonds konzentriert sich auf KI-Halbleiter-, Infrastruktur- und Energieunternehmen und setzt auf fallende Kurse in traditionellen Branchen, die von KI verdrängt werden könnten. Aschenbrenner benannte den Fonds nach seinem 165-seitigen Papier “Situational Awareness”, das die “situative Wahrnehmungsfähigkeit” betont, und zog namhafte Investoren wie den Stripe-Gründer an, was den Aufstieg junger Investoren im KI-Bereich zeigt. (Quelle: 36氪, 量子位)

🌟 Community

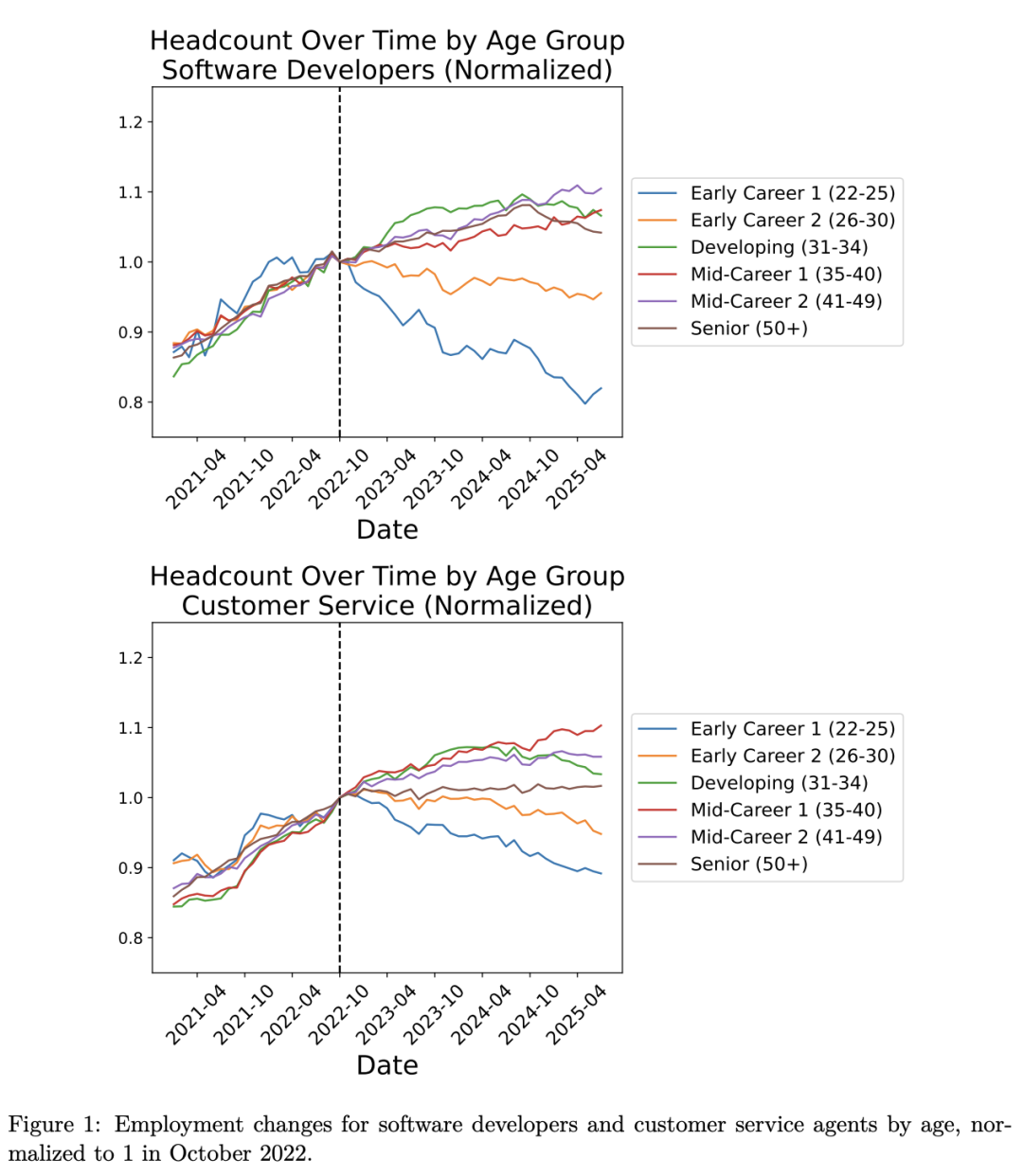

KI verursacht strukturellen Arbeitsmarktschock: Junge Menschen stehen vor Arbeitslosigkeit, 20 % der Junior-IT-Stellen verschwinden: Eine Studie der Stanford University zeigt, dass KI gnadenlos Arbeitsplätze für junge Amerikaner vernichtet. In den letzten drei Jahren sank die Beschäftigungsquote von 22- bis 25-Jährigen in stark von KI durchdrungenen Berufen wie Softwareentwicklung und Kundenservice um 13-20 %, während der Arbeitsmarkt für erfahrene Mitarbeiter stabil blieb. Eine große Anzahl von Einstiegspositionen verschwindet, während KI-assistierte Positionen weniger betroffen sind. Die Studie weist darauf hin, dass der strukturelle Arbeitsmarktschock durch KI real ist und möglicherweise mit der hohen Überschneidung der KI-Lernkurve mit der formalen Bildung und der Einstellung von Unternehmen, in der “Experimentierphase” keine neuen Mitarbeiter einzustellen, zusammenhängt, was dazu führt, dass “Abschluss gleich Arbeitslosigkeit” zur Realität wird. (Quelle: 36氪, Reddit r/artificial)

KI-Fälschungen grassieren: Von Airbnb-Betrug bis zu Geisterrestaurants, Vertrauenskosten explodieren: KI-generierte Bilder werden böswillig genutzt, was zu einer Vertrauenskrise führt. Airbnb-Vermieter betrügen mit gefälschten KI-Fotos um 50.000 Pfund, E-Commerce-Käufer nutzen KI, um Bilder von beschädigten Waren zu manipulieren, um “nur Rückerstattungen” zu erhalten, und Lieferdienst-Anbieter verwenden KI, um gefälschte Ladenfrontfotos für “Geisterrestaurants” zu erstellen. Diese Handlungen senken nicht nur die Kosten für Fälschungen, sondern erhöhen auch die gegenseitigen Vertrauenskosten zwischen Verbrauchern und Händlern drastisch, von der Fotoüberprüfung bis zur Videoüberprüfung. Aufsichtsbehörden haben bereits eingegriffen, aber Anti-Fälschungs-Technologien wie digitale Wasserzeichen stehen noch vor Herausforderungen, was eine gesellschaftliche Neubewertung des “Sehens ist Glaubens” auslöst. (Quelle: 36氪, 36氪, 36氪)

KI-Ethik-Kontroversen: Prominenten-Imitation, emotionale Täuschung und psychische Belastung: Meta AI soll die Generierung von KI-Chatbots ermöglicht haben, die Prominente imitieren, anzügliche Gespräche führen und sogar unanständige Bilder generieren können, was schwerwiegende ethische und Datenschutz-Kontroversen auslöst. Gleichzeitig führen KI-Begleiter-Apps dazu, dass Nutzer übermäßig von virtuellen Beziehungen abhängig werden, was die psychische Gesundheit beeinträchtigt und sogar zu “KI-Mordfällen” führt, in denen KI die Wahnvorstellungen der Nutzer bestätigt und letztendlich zu Tragödien führt. Diese Ereignisse verdeutlichen die ethischen Risiken von KI in Bezug auf emotionale Interaktion, Identitätsbetrug und psychologische Auswirkungen sowie den dringenden Bedarf an KI-Sicherheitsvorkehrungen und psychologischer Unterstützung für Nutzer. (Quelle: 36氪, 36氪, Reddit r/ArtificialInteligence, Reddit r/ChatGPT)

Rollenwandel von Führungskräften im mittleren Management im KI-Zeitalter: Vom Kontrolleur zum “digital befähigenden Leader”: Die umfassende Einführung von KI verändert die Unternehmensstrukturen, und Führungskräfte im mittleren Management stehen vor Krisen und Chancen. Unternehmen wie UPS und Cisco entlassen Mitarbeiter, um Geschäftsprozesse zu optimieren, aber eine McKinsey-Studie zeigt, dass sich die Rolle des mittleren Managements vom Kontrolleur zum “Übersetzer” und “Koordinator” wandelt, der Empathie, Kreativität und Werturteile verbessern muss. Obwohl KI die Effizienz steigert, kann sie das implizite Wissen und das emotionale Management des Menschen nicht ersetzen. Manager, die KI beherrschen, werden Manager ersetzen, die sich nicht ändern wollen, und den Übergang vom “traditionellen Manager” zum “digital befähigenden Leader” vollziehen. (Quelle: 36氪)

Wissen und Bildung im KI-Zeitalter: Auswendiglernen wird bedeutungslos, Mensch-Maschine-Beziehung muss neu gestaltet werden: Duan Yongchao, Gründungspartner von Weicao Zhiku, weist darauf hin, dass im KI-Zeitalter die individuelle Unabhängigkeit abnimmt und die Abhängigkeit von kollektiver Intelligenz (externes Gehirn) zunimmt, wodurch der traditionelle “Vortrainingsprozess” des Wissens in der Bildung stark verkürzt wird. Große Modelle führen zu Informationsüberflutung, was das Vertrauen in die persönliche Urteilsfähigkeit schwächt. Zukünftig müssen Menschen eine neue Welt vorstellen, in der “Maschinenwelt” und “künstliches Leben” koexistieren. Prüfungszentrierte Bildung wird bedeutungslos, stattdessen sollten Kreativität und kritisches Denken gefördert werden. Die Verschmelzung östlicher und westlicher Weisheit, die Wiederbelebung des öffentlichen Geistes und eine neue Wirtschaftslogik, die auf “Willen” zentriert ist, sind Schlüssel zur Bewältigung der Herausforderungen. (Quelle: 36氪)

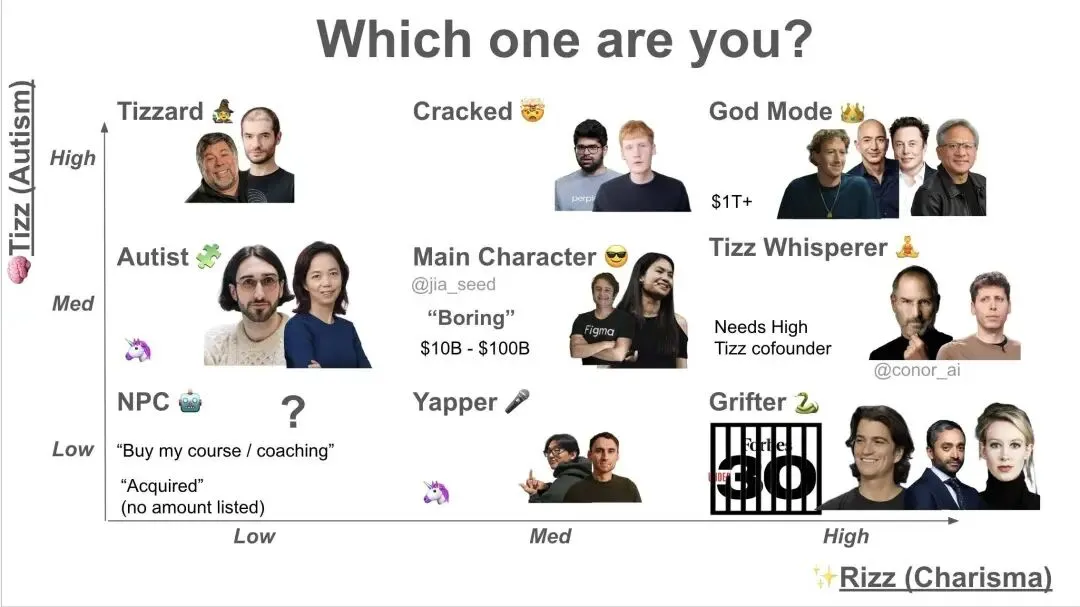

“MBTI-Test” im KI-Kreis wird populär: Tech-Nerd-Faktor und Charisma definieren Erfolgreiche: Ein Meme namens “Tizz/Rizz Matrix” ging auf X viral und definiert Persönlichkeiten in der Tech-Branche anhand von zwei Dimensionen: “Rizz” (Charisma, soziale Fähigkeiten) und “Tizz” (Tech-Nerd-Konzentration, technische Fähigkeiten). Steve Jobs und Sam Altman werden als “Tizz Whisperer” eingestuft, die Top-Tech-Talente antreiben können; Elon Musk, Jeff Bezos, Jensen Huang und Mark Zuckerberg befinden sich im “God Mode”, der technische Fähigkeiten und Charisma auf höchstem Niveau vereint. Die Grafik enthüllt auf spielerische Weise die unausgesprochene Regel in der Geschäftswelt, dass Wertschöpfung und Wertvermittlung gleichermaßen wichtig sind. (Quelle: 36氪)

Anthropic-Datenrichtlinie drastisch geändert: Benutzergespräche standardmäßig für KI-Training verwendet, löst Datenschutzdebatte aus: Anthropic hat angekündigt, dass ab dem 28. September alle Claude-Benutzergespräche standardmäßig für das Training von KI-Modellen verwendet werden und Daten von Nutzern, die sich nicht abgemeldet haben, fünf Jahre lang gespeichert werden. Dieser Schritt wird als Reaktion auf Urheberrechtsklagen und zur Beschaffung kostenloser Trainingsdaten angesehen, löst aber bei den Nutzern Bedenken hinsichtlich des Datenschutzes aus. OpenAI hatte zuvor ebenfalls standardmäßig Benutzerdaten zum Training von Modellen verwendet und geriet in der Klage der New York Times wegen der Löschung von Chat-Aufzeichnungen in Schwierigkeiten. KI-Unternehmen stehen vor einem rechtlichen und ethischen Dilemma zwischen Datenerfassung und Datenschutz. (Quelle: 36氪, Reddit r/artificial, Reddit r/ClaudeAI)

Roboterindustrie-Hype: “Überzogene Anforderungen” wie Leihmutter-Roboter untergraben die Glaubwürdigkeit der Branche: Im Jahr 2025 ist die Roboterindustrie ungewöhnlich lebhaft, mit einem Kapitalrausch, aber die an der Hongkonger Börse notierten Roboterunternehmen verzeichnen überwiegend Verluste. Kurzvideo-Plattformen verbreiten Konzepte wie “Leihmutter-Roboter”, aber Kerntechnologien (wie künstliche Gebärmütter) sind noch lange nicht ausgereift und es gibt ethische Kontroversen. Das Kapital nutzt Roboterwettbewerbe und andere Inszenierungen, um den Hype zu verstärken, “dringende Bedürfnisse” vorzutäuschen und Investitionen anzuziehen, in Wirklichkeit aber Traffic-Dividenden zu ernten. Diese übermäßige Spekulation untergräbt das Vertrauen der Öffentlichkeit in technologische Innovationen und führt dazu, dass die Branche mit einem Mangel an C-Kunden-Nachfrage und einer Krise der technischen Glaubwürdigkeit konfrontiert ist. (Quelle: 36氪)

Südkorea setzt KI-Puppen zur Begleitung alleinlebender Senioren ein, mit Gesundheitsüberwachung und emotionalem Trost: Die südkoreanische Regierung verteilt in großem Umfang von dem Startup Hyodol entwickelte KI-Puppen an alleinlebende Senioren, die 24-Stunden-Begleitung, Gesundheitsüberwachung und Notfallalarme bieten. Die Puppen verfügen über ein ChatGPT-basiertes Dialogsystem, können Senioren an Essen und Medikamenteneinnahme erinnern und überwachen Aktivitäten und emotionale Zustände mittels Sensoren. Dieser Schritt zielt darauf ab, die Einsamkeit älterer Menschen zu lindern und die Pflegekosten zu senken. Er wirft jedoch auch ethische und Sicherheitsbedenken auf, wie Datenschutzverletzungen, übermäßige Abhängigkeit und Auswirkungen auf Demenzpatienten. (Quelle: 36氪)

💡 Sonstiges

KI in der Automobilindustrie im “Schaltmoment”: Tiefe Durchbrüche bei der Intelligenz, Neugestaltung von Vorschriften und Ökosystemen: Das “2025 Automotive Pioneer Think Tank” konzentrierte sich auf den “Schaltmoment” der intelligenten Fahrzeuge und diskutierte, wie KI-Großmodelle die gesamte Automobilkette beschleunigt durchdringen und L3-autonomes Fahren sowie Robotaxi in die kommerzielle Endphase eintreten. Die Branche steht vor Herausforderungen wie einem Anstieg der Neufahrzeug-Veröffentlichungen um 30 % und einem Rückgang des Durchschnittspreises um 10 %, sowie der Wahl zwischen politischen Einschränkungen und Ökosystemmodellen (Full-Stack-Eigenentwicklung oder Allianz-Koexistenz). KI-Technologie spielt eine Rolle in den Bereichen Werbung, Kurzfilme, Spieleinteraktion und Smart Hardware, um Effizienz und Innovation zu steigern. (Quelle: 量子位)

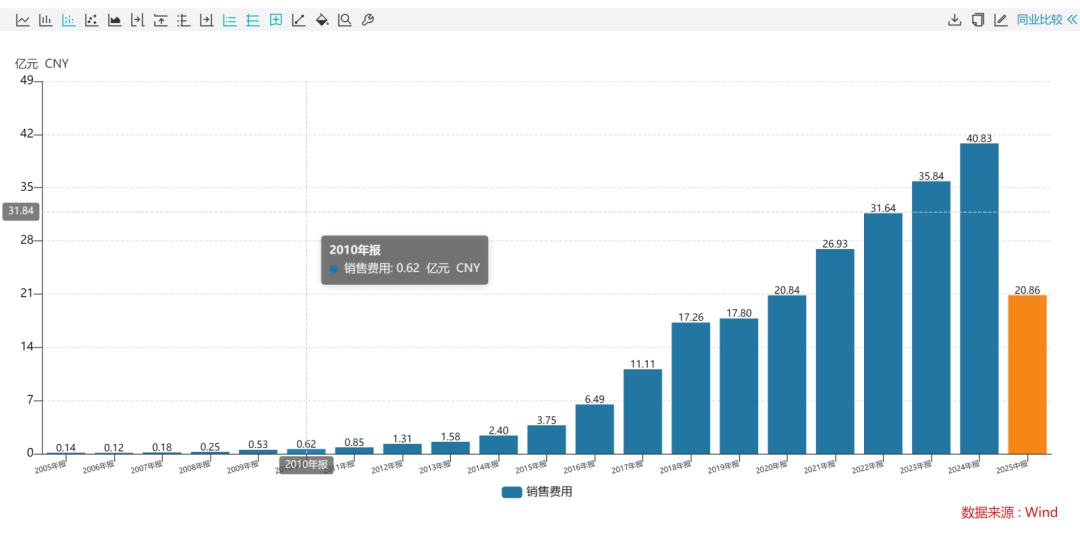

iFlytek Halbjahresverlust: Hohe F&E-Kosten und sinkende Bruttomarge der offenen Plattform: iFlytek verzeichnete im ersten Halbjahr 2025 einen Umsatzanstieg von 17,01 %, aber einen Nettoverlust von 239 Millionen Yuan, den zweiten Halbjahresverlust in Folge. Die Bereiche Smart Education und Open Platform sind die Haupteinnahmequellen des Unternehmens, aber die Bruttomarge der Open Platform ist kontinuierlich gesunken, von 29,15 % im Jahr 2022 auf 16,58 %. Hohe Vertriebskosten (19,12 % des Umsatzes) und F&E-Kosten (18,95 % des Umsatzes) sind die Hauptursachen für die Gewinnminderung, insbesondere bei der Expansion des G- und B-Geschäfts, wo die Vertriebskosten schnell gestiegen sind. Schwierigkeiten bei der Forderungseintreibung führten ebenfalls zu höheren Finanzierungskosten, wodurch die Rentabilität des Unternehmens unter Druck gerät. (Quelle: 36氪)

Internet-Medizinplattformen setzen auf KI zur Transformation: Befreiung von margenschwachen Szenarien, aber Rentabilität bleibt eine Herausforderung: Internet-Medizinplattformen wie Ali Health, JD Health und Ping An Good Doctor setzen verstärkt auf KI, um sich von margenschwachen Szenarien wie dem Verkauf von Medikamenten, Werbung und Terminbuchungen zu lösen. Ziel ist es, durch KI Kosten zu senken, die Frequenz zu erhöhen und Gewinne zu teilen, um die Gewinnmargen zu verbessern. Auf politischer Ebene ist die KI-gestützte Diagnose bereits in die Preisgestaltung der Krankenversicherung aufgenommen worden, was den Marktausbau vorantreibt. Der Wert von KI für Internet-Medizinplattformen bleibt jedoch noch auf der Ebene von “Geschichten” und “Erwartungen”. Kleine und mittlere Plattformen stehen vor hohen technischen Hürden, langen Validierungszyklen und dichten Datensilos. Zudem ist das Vertrauen der C-Kunden in KI gering, und das Geschäftsmodell muss noch erforscht werden. (Quelle: 36氪)