Schlüsselwörter:xAI-Ingenieur, OpenAI, Code-Diebstahl, geistiges Eigentum, Branchenwettbewerb, KI-Modell, GPU-Markt, KI-Ethik, xAI-Ingenieur wechselt zu OpenAI, Huawei 96GB VRAM GPU, Meituan LongCat-Flash-Chat-Modell, Anwendung von KI im Finanzbereich, Herausforderungen der KI-Agenten-Technologie

🔥 Fokus

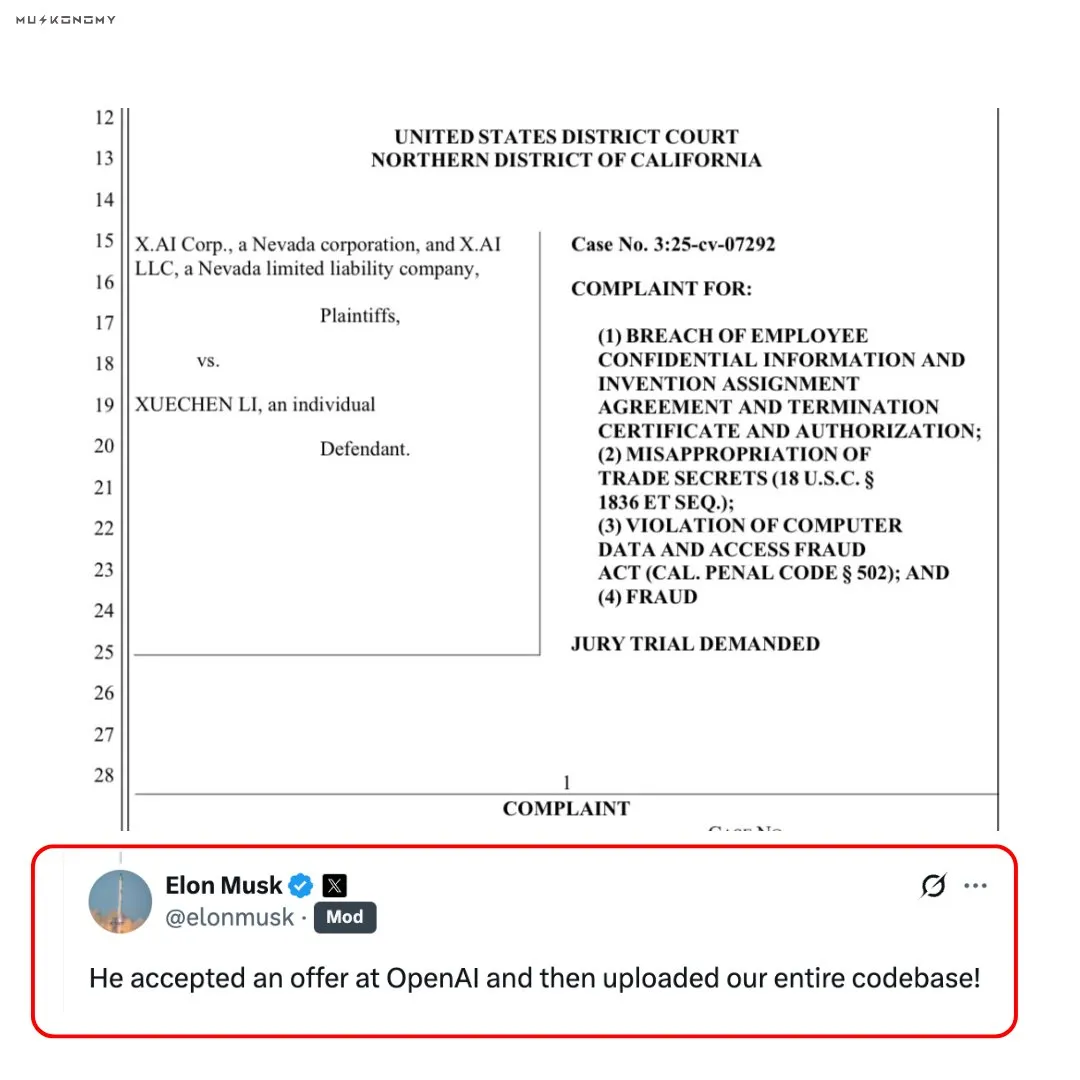

Kontroverse um xAI-Ingenieur, der zu OpenAI wechselt und Code stiehlt : Elon Musk bestätigte, dass ein ehemaliger xAI-Ingenieur nach seinem Wechsel zu OpenAI die gesamte Codebasis von xAI hochgeladen hat. Der Ingenieur hatte zuvor xAI-Aktien im Wert von 7 Millionen US-Dollar verkauft. Dieser Vorfall löste eine hitzige Debatte über den Diebstahl geistigen Eigentums und die Ethik des Wettbewerbs in der Branche aus und hatte weitreichende Auswirkungen auf die Wettbewerbsbeziehung zwischen OpenAI und xAI. In den sozialen Medien wurde die Authentizität und die moralische Dimension des Vorfalls breit diskutiert und kommentiert. (Quelle: scaling01, teortaxesTex, Reddit r/ChatGPT)

🎯 Trends

Nous Hermes 4 Modell veröffentlicht : Nous Research hat Hermes 4 veröffentlicht, ein hybrides „Inferenzmodell“, das mittels einfacher Tags zwischen schneller Reaktion und tiefem Nachdenken wechseln kann. Das Modell wurde mit der 50-fachen Datenmenge des Vorgängers trainiert, verfügt über eine integrierte Anti-Schmeichelei-Voreingenommenheit und zeigte hervorragende Leistungen im SpeechMap-Benchmark. (Quelle: Teknium1, Teknium1, Teknium1)

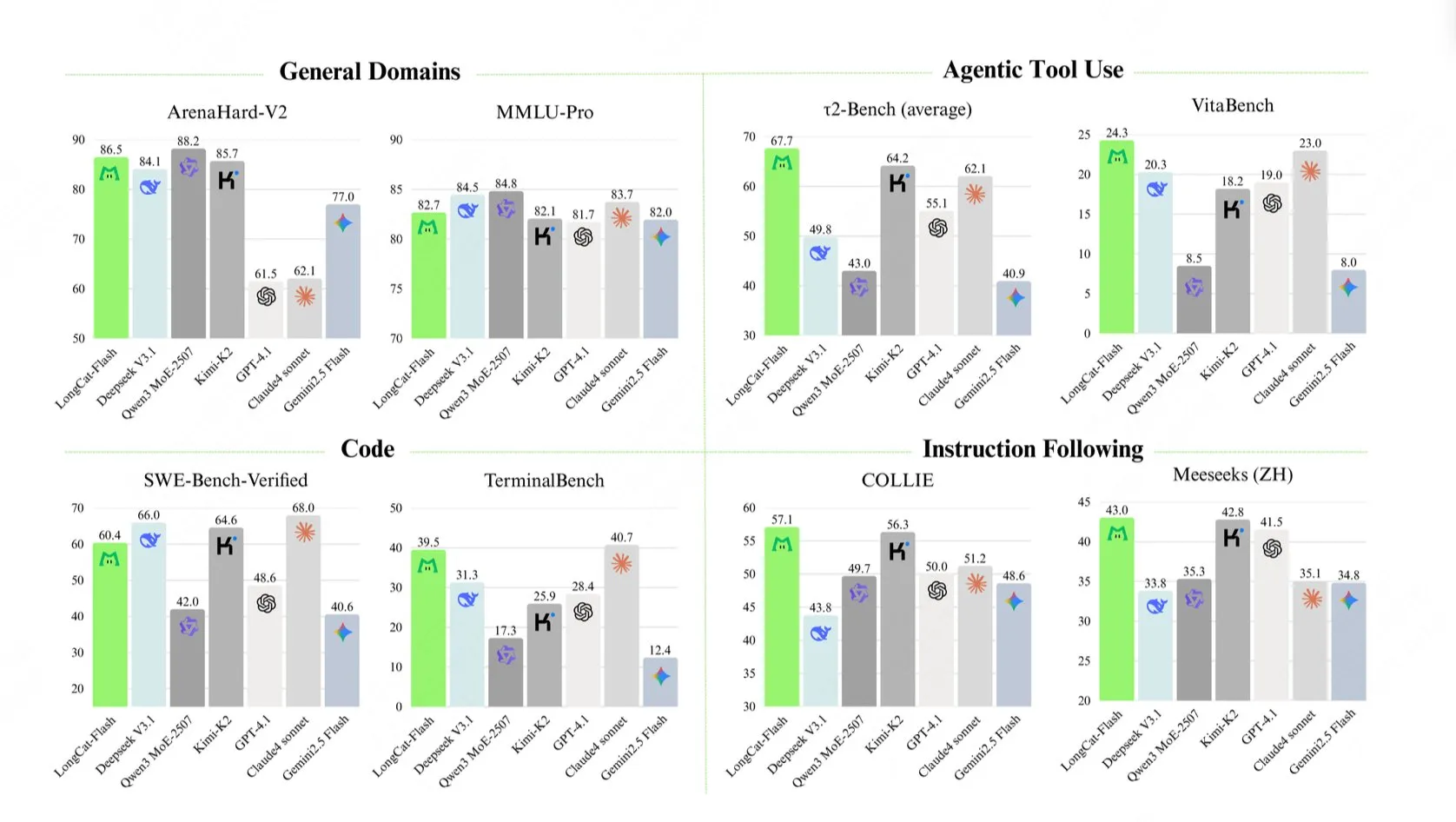

Meituan LongCat-Flash-Chat großes Modell veröffentlicht : Meituan hat LongCat-Flash-Chat veröffentlicht, ein Sprachmodell mit insgesamt 560 Milliarden Parametern. Sein dynamischer Berechnungsmechanismus kann je nach Kontextbedarf 18,6 Milliarden bis 31,3 Milliarden Parameter (durchschnittlich etwa 27 Milliarden) aktivieren, erreicht eine Inferenzgeschwindigkeit von über 100 Tokens/Sekunde und zeigte hervorragende Leistungen in Benchmarks wie TerminalBench und τ²-Bench. (Quelle: reach_vb, teortaxesTex, bigeagle_xd, Reddit r/LocalLLaMA)

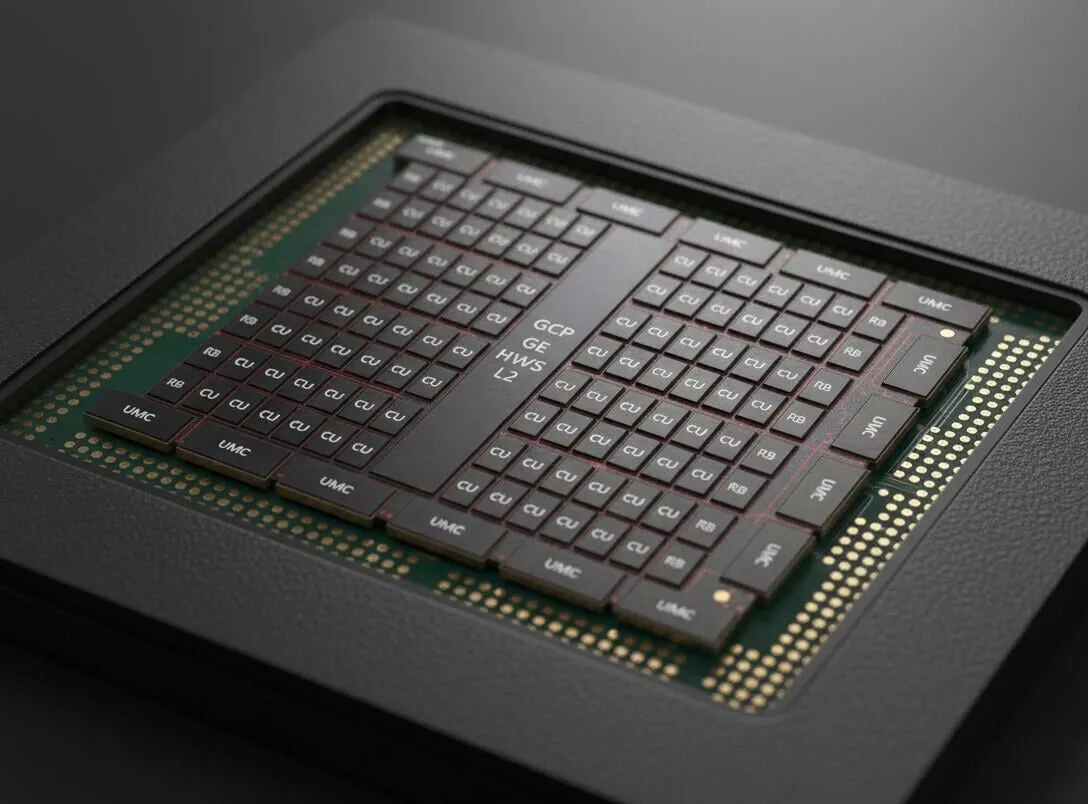

Huawei bringt leistungsstarke 96GB VRAM GPU auf den Markt : Huawei soll 70 % des Marktes für 4090-Klasse 96GB VRAM GPUs erobert haben, mit einem Preis von nur 1887 US-Dollar. Dies markiert einen wichtigen Durchbruch Chinas auf dem GPU-Markt, der das Potenzial hat, NVIDIAs Monopol zu brechen und eine kostengünstigere Hardwareoption für das lokale LLM-Training zu bieten, wobei die Softwarekompatibilität weiterhin ein Schwerpunkt bleibt. (Quelle: scaling01, Reddit r/LocalLLaMA)

AMDs nächste Generation von Unified Memory Produkten enthüllt : Durchgesickerte Informationen über AMDs nächste Generation von Unified Memory Produkten deuten auf einen 512-Bit-Speicherbus hin, mit einer erwarteten Speicherbandbreite von etwa 512 GB/s. Dies wird als zukünftige Hardware-Entwicklungsrichtung für LLMs angesehen und in Kombination mit ultraschnellem VRAM und großen MoE-Modellen eine signifikante Steigerung der AI-Hardware-Leistung prognostiziert. (Quelle: Reddit r/LocalLLaMA)

Art-0-8B Modell veröffentlicht, ermöglicht kontrollierbare Inferenz : Das experimentelle Open-Source-Modell Art-0-8B, basierend auf Qwen3-Feinabstimmung, wurde veröffentlicht und ermöglicht es Benutzern erstmals, den Denkprozess des Modells explizit über Prompts zu steuern, z. B. „in Rap-Texten denken“ oder „Gedanken in Stichpunkten organisieren“. Dies bietet eine neue Kontrolldimension für die AI-Inferenz und verbessert die Anpassungsfähigkeit des Benutzers an den internen Workflow des Modells. (Quelle: Reddit r/MachineLearning)

Google Gemini führt neue Funktionen wie Deep Think Inferenz ein : Google Gemini hat mehrere neue Funktionen veröffentlicht, darunter einen kostenlosen Pro-Plan und die Deep Think Inferenzfähigkeit, die ein unvergleichliches Erlebnis im Vergleich zu ChatGPT bieten sollen. Dies zeigt, dass Google aktiv aufholt und Innovationen in Bezug auf AI-Modellfähigkeiten und Benutzerdienste vorantreibt. (Quelle: demishassabis)

GPT-5 zeigt hervorragende Leistung im Werwolf-Spiel : GPT-5 erreichte eine Gewinnrate von 96,7 % in Werwolf-Benchmark-Tests und demonstrierte seine starken Fähigkeiten in sozialer Inferenz, Führung, Bluffen und Widerstand gegen Manipulation. Dies zeigt, dass die Leistung von LLMs in komplexen, antagonistischen sozialen Szenarien schnell zunimmt. (Quelle: SebastienBubeck)

Neueste Fortschritte im Bereich Robotics : Die Robotertechnologie entwickelt sich ständig weiter, darunter humanoide Roboter, die Gelenke autonom zusammenbauen können, der Boston Dynamics Atlas Roboter als Fotograf, RoBuild, das Roboterlösungen für die Bauindustrie anbietet, Beihang-Forscher, die 2 cm große ultraschnelle Mikro-Roboter entwickeln, Unitree Robotics, das humanoide Roboter tanzen lässt, sowie Seilkletterroboter und halbautomatisierte Seilroboter zur Reparatur von Windturbinenblättern. Diese Fortschritte zeigen das enorme Potenzial von Robotern in der Automatisierung, der Ausführung komplexer Aufgaben und in vielfältigen Anwendungsbereichen. (Quelle: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

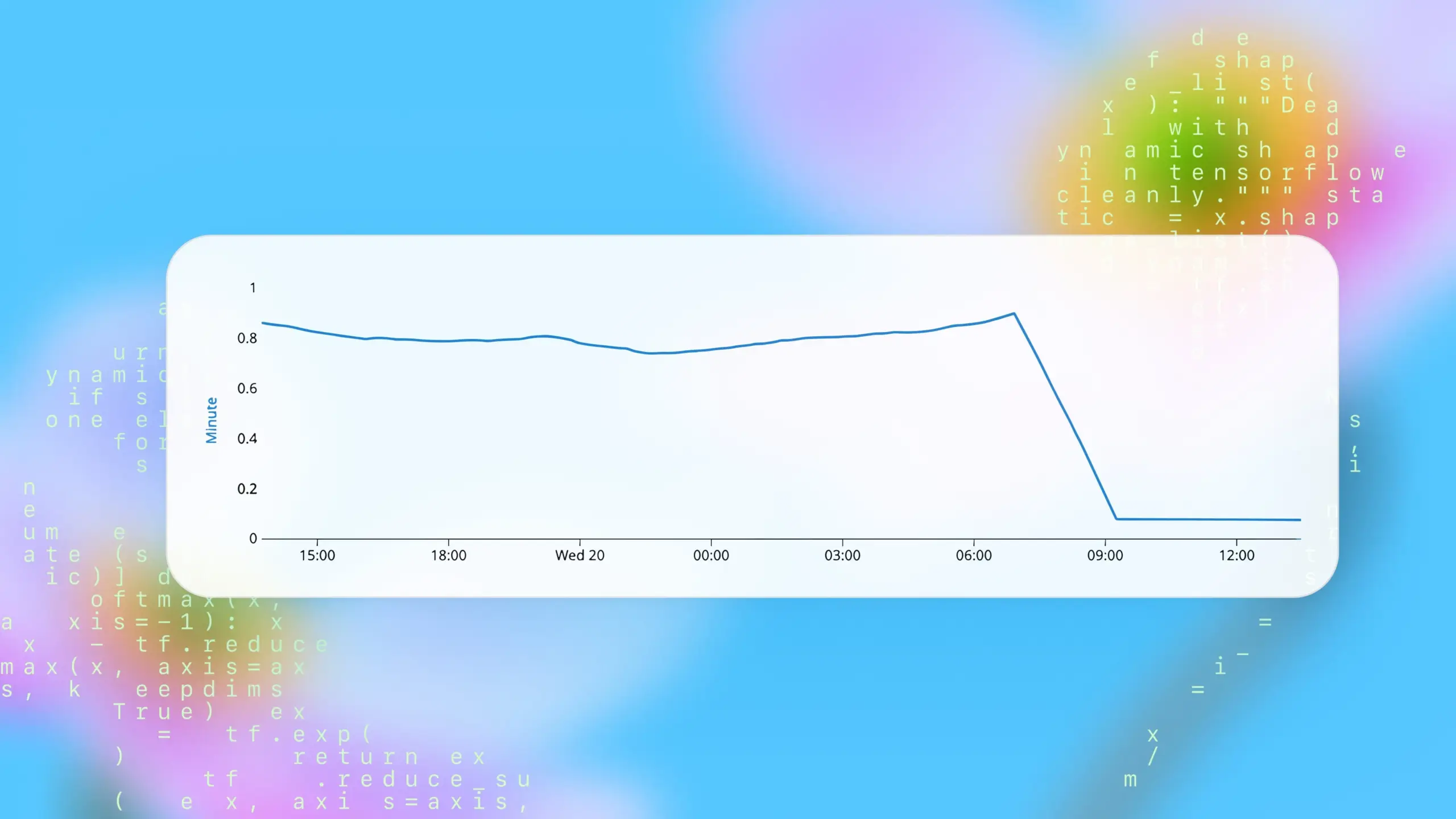

Codex Remote Task Startzeit deutlich verbessert : Die Startzeit für Remote-Aufgaben von OpenAIs Codex wurde erheblich verbessert, wobei die mittlere Startzeit von 48 Sekunden auf 5 Sekunden verkürzt wurde, was einer Steigerung von 90 % entspricht. Dieser Fortschritt ist hauptsächlich auf die Einführung von Container-Caching zurückzuführen, was die Entwicklungseffizienz und das Benutzererlebnis erheblich verbessert hat. (Quelle: gdb)

🧰 Tools

Nano Banana Bildgenerierungsmodell weit verbreitet : Das Nano Banana Modell zeigt ein starkes Potenzial im Bereich der Bildgenerierung. Benutzer können es nutzen, um Gesichtsformen präzise zu steuern, Tanzvideos mit chinesischen Schriftzeichen-Posen zu generieren, Lehrdiagramme zu erstellen und sogar Bilder für Wiki- oder Bildungs-Landingpages zu erzeugen. Seine „AI-freie“ Ausgabe und die stabilen Fähigkeiten bei Pose, Beleuchtung und Designreferenzen werden gelobt. (Quelle: dotey, dotey, crystalsssup, fabianstelzer, Vtrivedy10, demishassabis, karminski3)

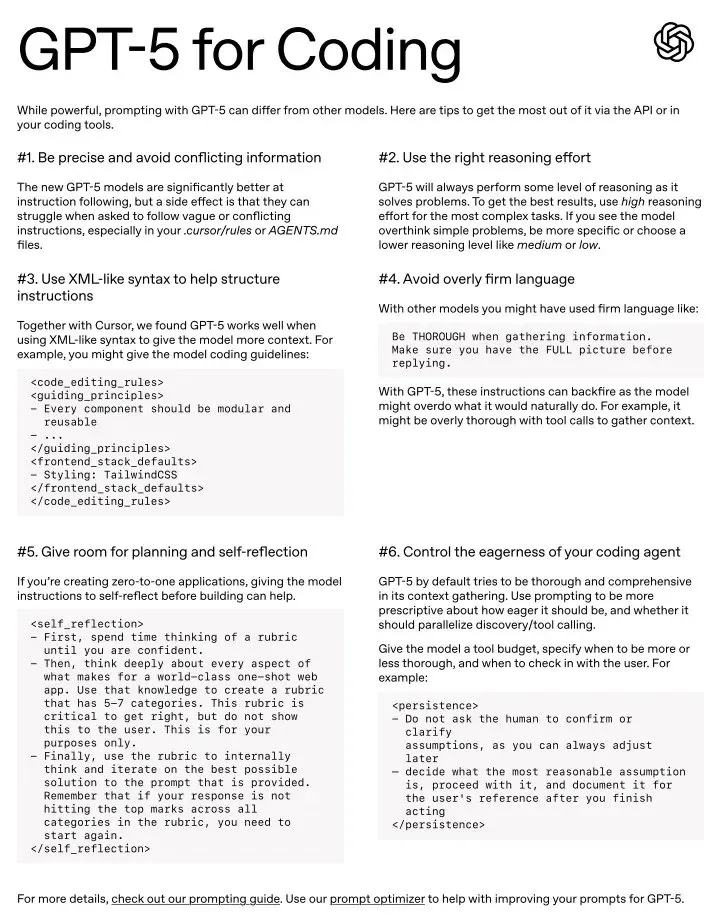

Potenzial von GPT-5 als tägliches Coding-Tool : GPT-5 wird als ein unglaubliches Coding-Tool angesehen, das besonders bei der richtigen Prompt-Stilistik hervorragende Leistungen erbringt. Obwohl einige Benutzer es als etwas „pedantisch“ empfinden und präzisere Prompts erfordern, gilt es in vielen Bereichen als das beste Modell und verfügt über offizielle Prompt-Richtlinien, die Benutzern helfen, seine sechs Schlüssel-Prompt-Techniken zu meistern. (Quelle: gdb, kevinweil, gdb, nptacek)

Docuflows ermöglicht fortgeschrittene Agent-Workflows für Finanzdaten : Jerry Liu zeigte, wie man mit Docuflows in weniger als 5 Minuten einen fortgeschrittenen Agent-Workflow für die Finanzextraktion aufbaut, ohne Code schreiben zu müssen, um 10Q-Dateien zu parsen, detaillierte Einnahmeinformationen zu extrahieren und im CSV-Format auszugeben. Docuflows fungiert als Mini-Coding-Agent, der es ermöglicht, Dokumenten-Workflows in natürlicher Sprache zu definieren und in erweiterbare mehrstufige Code-Flows zu kompilieren. (Quelle: jerryjliu0)

Replit Vibe Coding beschleunigt die digitale Transformation von Unternehmen : Hexaware arbeitet mit Replit zusammen, um die digitale Transformation von Unternehmen durch Vibe Coding zu beschleunigen. Replit Agent und dessen Entwicklererfahrung werden als „Game Changer“ gelobt, die es auch Nicht-Programmierern ermöglichen, komplexe SaaS-Anwendungen in kurzer Zeit zu erstellen, was die Entwicklungseffizienz und Innovationsfähigkeit erheblich steigert. (Quelle: amasad, amasad)

AI-gestützte Dokumentenverarbeitung und Forschung : AI wurde eingesetzt, um eine 400-seitige Bachelorarbeit von Henry Kissinger von einem gescannten PDF in das Markdown-Format zu konvertieren und mithilfe eines Multi-Agenten-Systems Fußnoten zu korrigieren, Quellenlinks einzufügen und sogar Mindmaps und Zusammenfassungen zu generieren. Dies zeigt das enorme Potenzial von AI bei der Verarbeitung komplexer Dokumente und der Beschleunigung akademischer Forschung. (Quelle: andrew_n_carr, riemannzeta)

Claude Code zeigt enorme Produktivität in nicht-programmierbezogenen Bereichen : Claude Code wird von Nicht-Programmierern eingesetzt, um riesige Excel-Dateien zu verarbeiten, Arbeitsdokumente zu organisieren, große Datensätze zu analysieren und sogar tägliche Notizen automatisch zu erfassen, wodurch ursprünglich tagelange Arbeit auf 30 Minuten verkürzt wird. Benutzer stellten fest, dass es genauer ist als manuelle Vorgänge und wiederverwendbare automatisierte Workflows erstellen kann, was die persönliche Produktivität erheblich steigert. (Quelle: Reddit r/ClaudeAI)

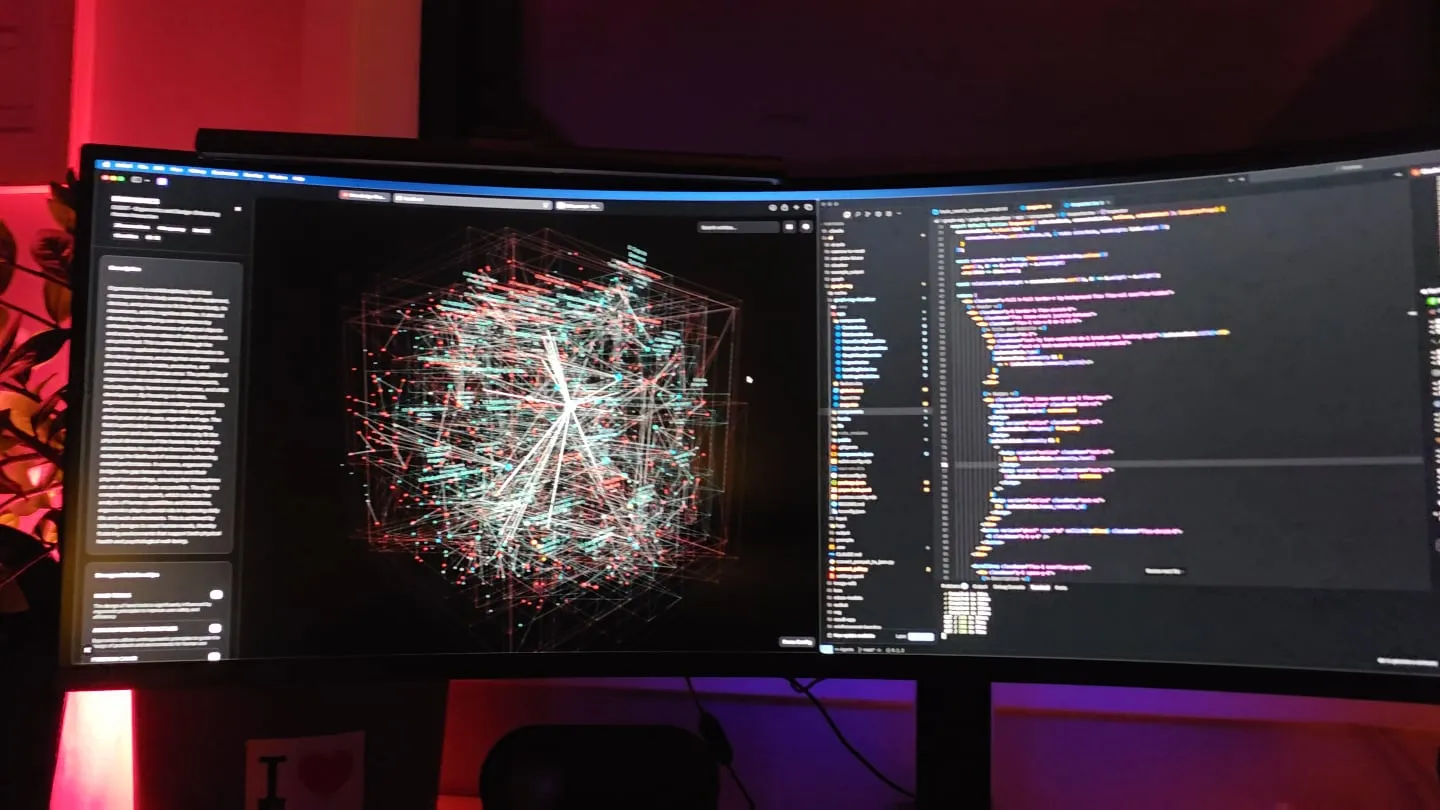

GraphRAG Wissensgraph-gestützte Retrieval : Ein Entwickler hat durch eine „Community-Nested“-Relationengraph-Wissensdatenbank-Pipeline, kombiniert mit Bottom-up-Semantiksuche und Referenzlink-Traversierungsmechanismen, die Leistung kleiner Modelle in spezifischen Bereichen erheblich verbessert. Diese Methode nutzt Wissensgraphen, um LLMs einen umfassenderen Kontext zu bieten, löst effektiv die Einschränkungen traditioneller eingebetteter RAGs und bietet Visualisierungstools zur Unterstützung des Verständnisses. (Quelle: Reddit r/LocalLLaMA)

Claude unterstützt Spieleentwicklung, 400.000 Zeilen Code in 8 Monaten : Ein unabhängiger Entwickler hat mit Hilfe von Claude innerhalb von 8 Monaten die Alpha-Version des Cyberpunk-Roguelike-Kartenspiels „Hard Reset“ mit 400.000 Zeilen Code fertiggestellt. Claude fungierte nicht nur als „fortgeschrittenes Entwicklungsteam“ zur Generierung von Dart/Flutter-Code, sondern unterstützte auch Animationen, Kartenkonvertierungen und Audiogenerierung im Spiel, was die starke Fähigkeit von AI zur Beschleunigung der Spieleentwicklung und Inhaltserstellung demonstriert. (Quelle: Reddit r/ClaudeAI)

📚 Lernen

DSPy Framework: Kernprinzipien und Anwendungen : Das DSPy Framework betont, dass Menschen ihre Absichten in der natürlichsten Form angeben sollten, anstatt sich übermäßig auf Reinforcement Learning oder Prompt-Optimierung zu verlassen. Sein Kernprinzip ist die Maximierung der Deklarativität, indem es verschiedene Abstraktionsebenen durch Code-Struktur, strukturierte natürliche Sprachdeklarationen und Daten-/Metrik-Lernen behandelt, um die Einschränkungen einer einzigen Methode in allgemeinen Szenarien zu vermeiden. (Quelle: lateinteraction, lateinteraction)

KSVD-Algorithmus zum Verständnis von Transformer-Embeddings : Ein Blogbeitrag des Stanford AI Lab erklärt, wie der 20 Jahre alte KSVD-Algorithmus (insbesondere DB-KSVD) modifiziert werden kann, um effektiv auf das Verständnis von Transformer-Embeddings erweitert zu werden. Dies bietet eine neue Methode zur tiefgehenden Analyse und Erklärung komplexer Deep Learning Modelle. (Quelle: dl_weekly)

Unterinvestition im Bereich Information Retrieval und ColBERTv2 : Es wird allgemein angenommen, dass es im Bereich Information Retrieval, insbesondere bei Open-Web-Suchmaschinen, an Investitionen mangelt. Das ColBERTv2-Modell ist seit seinem Training im Jahr 2021 immer noch das führende Modell, was im starken Kontrast zur schnellen Iteration im LLM-Bereich steht und die Verzögerung in der Entwicklung der Information Retrieval-Technologie hervorhebt. (Quelle: lateinteraction, lateinteraction)

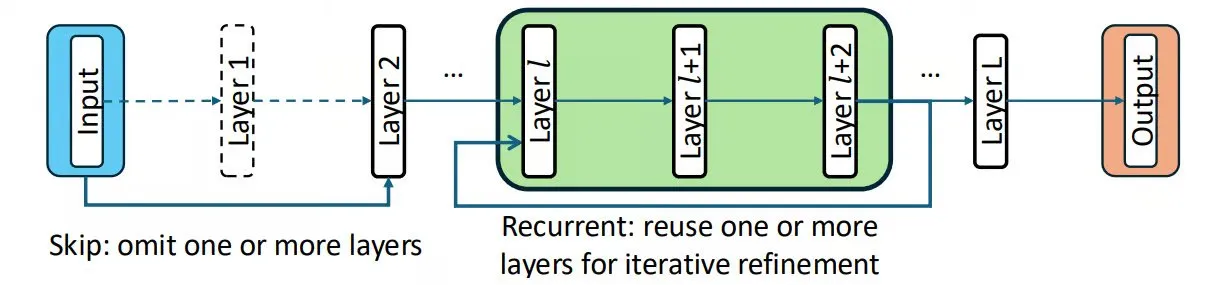

Chain-of-Layers (CoLa) ermöglicht kontrollierbare Berechnung zur Testzeit : CoLa ist eine Methode zur Steuerung der Berechnung zur Testzeit, indem Modellschichten als neu anordnungsbare Bausteine betrachtet werden. Sie ermöglicht es, Modellversionen an den Input anzupassen, unnötige Schichten zu überspringen, um die Geschwindigkeit zu erhöhen, Schichten rekursiv wiederzuverwenden, um tiefes Denken zu simulieren, und Schichten neu anzuordnen, um optimale Kombinationen zu finden, wodurch vortrainierte Schichten intelligent genutzt werden, ohne die Modellparameter zu ändern. (Quelle: TheTuringPost, TheTuringPost)

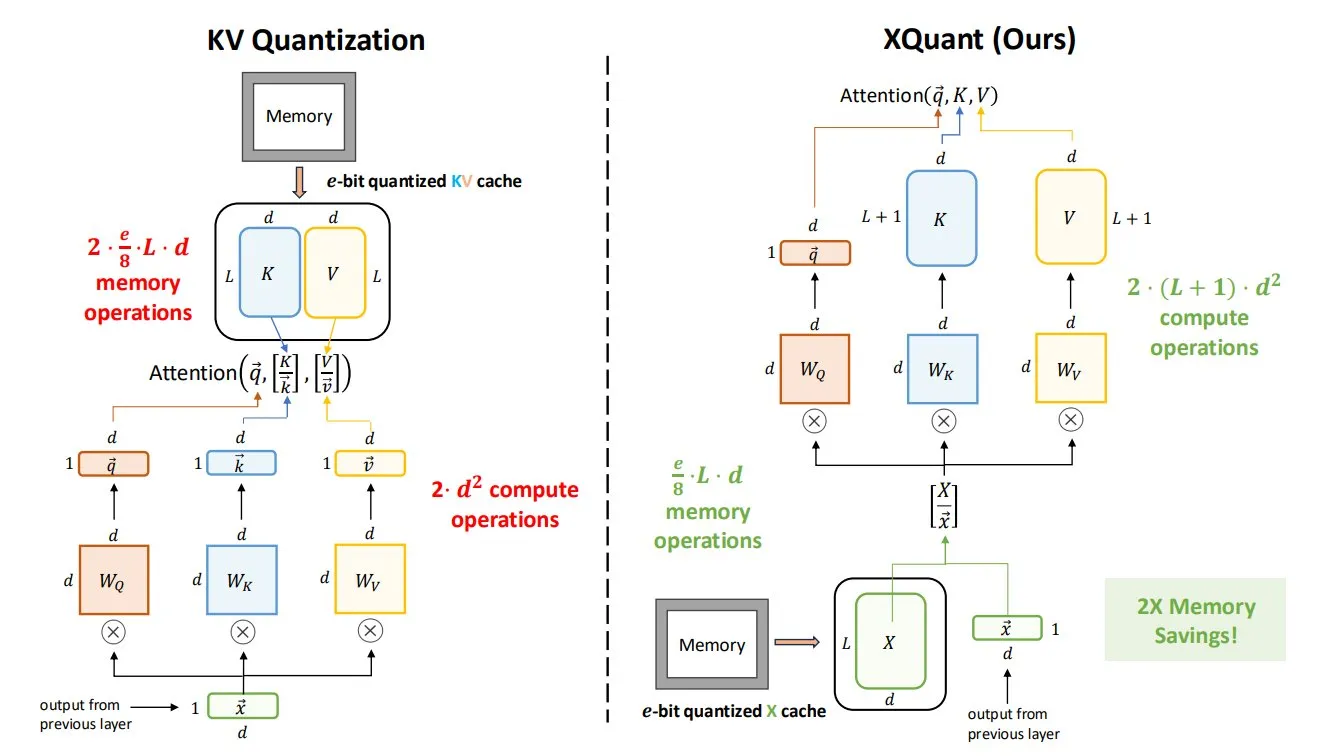

XQuant-Technologie reduziert LLM-Speicherbedarf erheblich : Die von der University of California, Berkeley, entwickelte XQuant-Technologie kann den LLM-Speicherbedarf um bis zu das 12-fache reduzieren, indem sie Schicht-Eingangsaktivierungen quantisiert und Schlüssel-Wert-Paare sofort rekonstruiert. Ihre fortgeschrittene Version, XQuant-CL, zeichnet sich besonders durch ihre Speichereffizienz aus und ist von großer Bedeutung für die Bereitstellung und den Betrieb großer LLMs. (Quelle: TheTuringPost, TheTuringPost)

Komprimierungstechniken bei der LLM-Optimierung : Gängige Komprimierungstechniken bei der LLM-Optimierung umfassen die Komprimierung des Inputs (Ersetzen langer Beschreibungen durch Konzepte, z. B. „göttlicher Prompt“) und die Komprimierung des Outputs (Ersetzen von Agent-Aufgaben durch präzise gekapselte Tools). Ersteres erfordert abstraktes Verständnis und Akkumulation, letzteres die Wahl des Tool-Umfangs und die Designphilosophie. (Quelle: dotey)

💼 Business

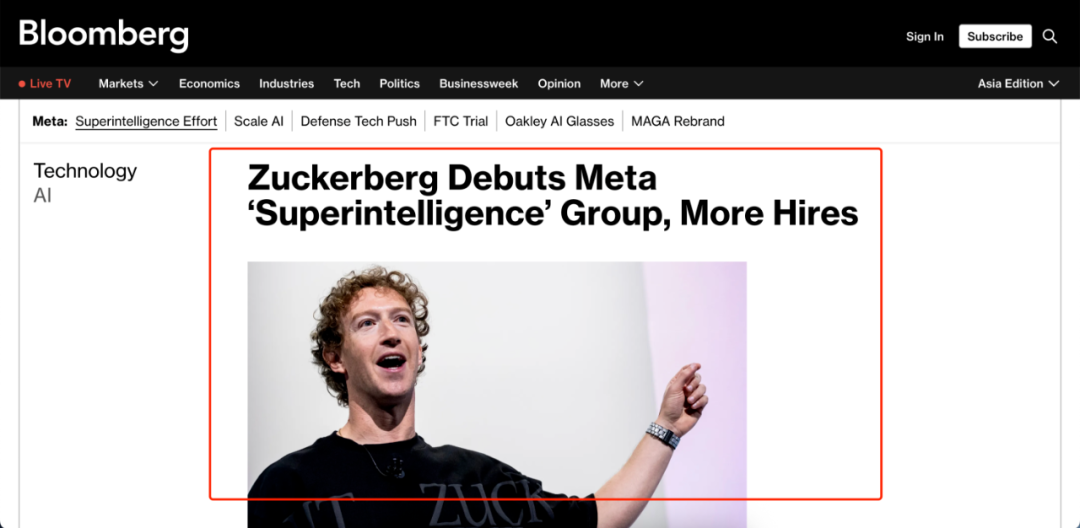

Meta erwägt die Einführung von Drittanbieter-AI-Modellen zur Verbesserung der Produktfähigkeiten : Angesichts der schlechten Leistung des Llama 4 Modells und internem Managementchaos diskutieren Führungskräfte von Metas Super Intelligence Lab (MSL) die Einführung von Google Gemini oder OpenAI Modellen in Meta AI als „Übergangslösung“. Dieser Schritt wird als Eingeständnis von Metas vorübergehendem Rückstand im AI-Kerntechnologiewettbewerb angesehen und wirft Fragen nach seiner AI-Strategie und der Effizienz von Investitionen in Milliardenhöhe auf. (Quelle: 36氪, steph_palazzolo, menhguin)

OpenEvidence auf 6 Milliarden US-Dollar geschätzt : „ChatGPT für Ärzte“ OpenEvidence erreichte in der jüngsten Finanzierungsrunde eine Bewertung von 6 Milliarden US-Dollar, eine Verdoppelung gegenüber dem Vormonat. Sein werbebasiertes Modell hat bereits einen annualisierten Umsatz von über 50 Millionen US-Dollar erzielt, was das enorme Geschäftspotenzial und das schnelle Wachstum von AI im Gesundheitswesen zeigt. (Quelle: steph_palazzolo)

OpenAI rekrutiert technisches Personal für Frontier Evals im Finanzbereich : OpenAI rekrutiert technisches Personal, um Frontier Evals im Finanzbereich aufzubauen. Dies zeigt, dass OpenAI aktiv die Anwendung von AI in der Finanzbranche ausbaut und sich der Verbesserung der praktischen Fähigkeiten und Zuverlässigkeit von Modellen in diesem Bereich widmet. (Quelle: BorisMPower)

🌟 Community

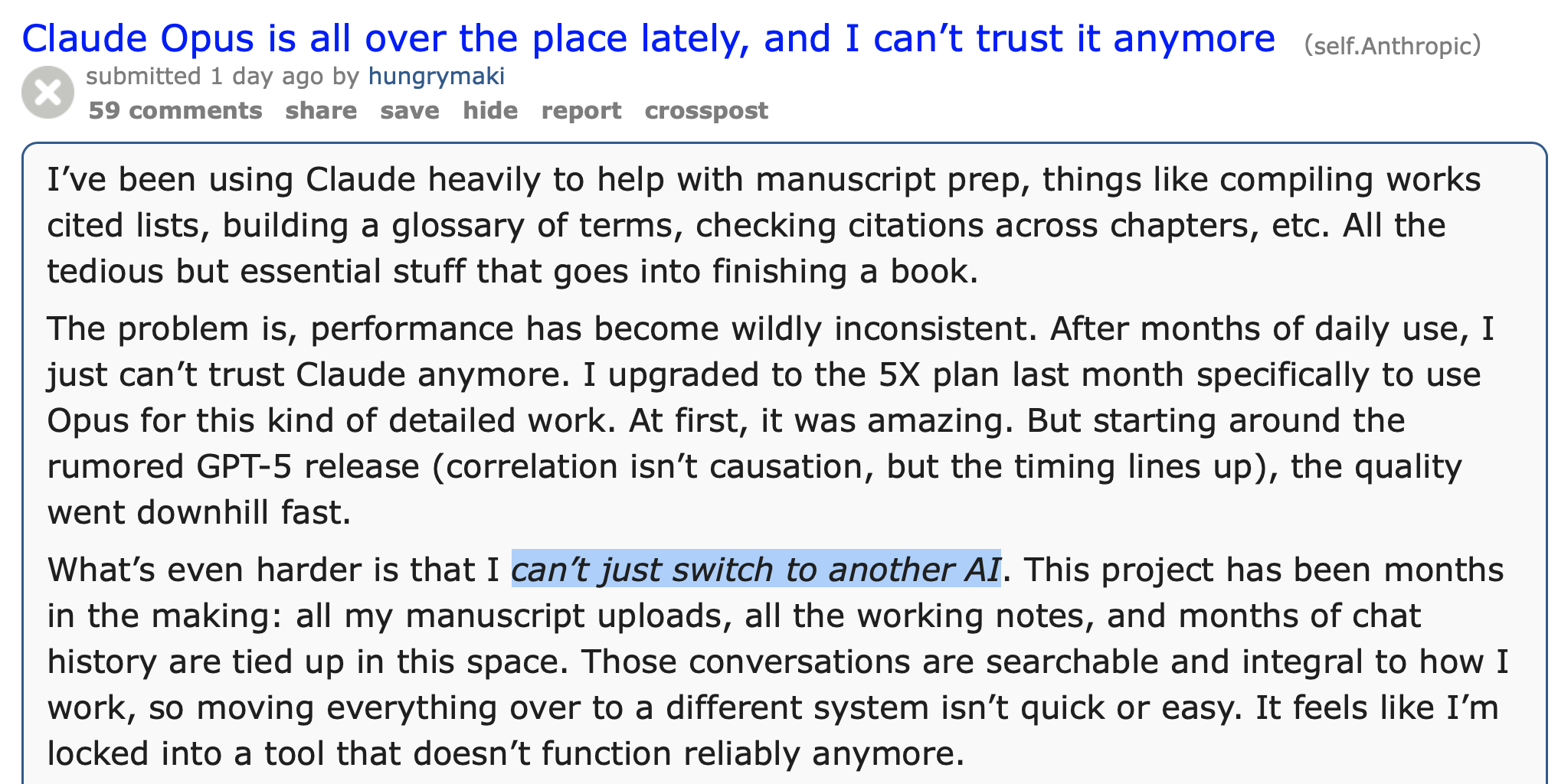

Claude Modell: Leistungsabfall und Kontroverse um Inhaltszensur : Mehrere Benutzer berichten über einen erheblichen Leistungsabfall des Claude Modells (einschließlich Claude Max und Claude Code) in letzter Zeit, mit Problemen wie inkonsistentem Verhalten, Verlust des Kontexts, übermäßiger Zensur und sogar „psychischen Gesundheitsdiagnosen“. Anthropic räumte ein, dass ein neuer Inferenz-Stack zu einer Leistungsverschlechterung geführt hat, aber Benutzer sind allgemein der Meinung, dass der Zensurmechanismus zu empfindlich ist, was die kreative und professionelle Nutzung beeinträchtigt und weitreichende Bedenken hinsichtlich der AI-Ethik und des Benutzererlebnisses aufwirft. (Quelle: teortaxesTex, QuixiAI, Reddit r/ClaudeAI, Reddit r/ClaudeAI, Reddit r/ClaudeAI, Reddit r/ChatGPT)

Meta AI Team: Management- und Datenqualitätsprobleme : Metas Super Intelligence Lab (MSL) steht vor Problemen wie Talentabwanderung, internen Kulturkonflikten und schlechter Datenqualität durch die Einführung von Scale AI. Kommentare deuten darauf hin, dass Metas AI-Bemühungen „auseinanderfallen“ und seine „Brute-Force“-Abwerbestrategie kontraproduktiv sein könnte, was Fragen aufwirft, ob das Unternehmen in der AI-Konkurrenz führend bleiben kann. (Quelle: 36氪, arohan, teortaxesTex, scaling01, suchenzang, farguney, teortaxesTex, suchenzang)

Die Unvermeidlichkeit emotionaler Verbindungen zwischen AI und Menschen : Viele glauben, dass Menschen unweigerlich emotionale Verbindungen zu AI eingehen werden, insbesondere nach der Veröffentlichung von Modellen wie GPT-5, wobei die Frustration über den Verlust der „Persönlichkeit“ von GPT-4o dies unterstreicht. Kommentare weisen darauf hin, dass Menschen von Natur aus nach Verbindung streben, und AI, die Emotionen simuliert, wird natürlich Bindung hervorrufen, und es wird hinterfragt, ob die Unterdrückung dieser Emotion zu Gleichgültigkeit führen würde. (Quelle: Reddit r/ChatGPT)

Herausforderungen bei der ROI von AI in Geschäftsanwendungen : Der AI-Geschäftsbericht von MIT Nanda zeigt, dass 95 % der Organisationen bei AI-Investitionen keinen Return on Investment erzielen konnten. Dies löste eine Diskussion über Strategien für erfolgreiche AI-Projekte aus, betonte die Herausforderungen bei der Implementierung von AI-Projekten und wie der Geschäftswert von AI effektiv gemessen und realisiert werden kann. (Quelle: TheTuringPost, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Auswirkungen von AI auf den Arbeitsmarkt: Entlassungen von mittleren Managern : Das Wall Street Journal berichtet, dass Unternehmen mittlere Manager entlassen, um Kosten zu senken und flexiblere Teams zu schaffen. Daten zeigen, dass die Anzahl der von jedem Manager beaufsichtigten Mitarbeiter in den letzten zehn Jahren um das Dreifache gestiegen ist, von 1:5 im Jahr 2017 auf 1:15 im Jahr 2023. Dieser Trend wird mit dem Fortschritt der AI-Technologie in Verbindung gebracht und deutet auf die weitreichenden Auswirkungen von AI auf die Organisationsstruktur von Unternehmen und den Arbeitsmarkt hin. (Quelle: Reddit r/ArtificialInteligence)

Die Notwendigkeit von AI-Ethik und Regulierung : Yoshua Bengio betont das enorme Potenzial von AI in der Gesellschaft, jedoch unter der Voraussetzung, dass sinnvolle Regulierungsrahmen entwickelt und die Risiken im Zusammenhang mit aktuellen und zukünftigen AI-Modellen besser verstanden werden. Eine Reuters-Untersuchung zu Meta AIs Prominenten-Chatbots enthüllte Risiken ethischer Verfehlungen von AI, einschließlich unbefugter Nachahmung von Prominenten und der Generierung expliziter Inhalte. (Quelle: Yoshua_Bengio, 36氪, Reddit r/artificial, Reddit r/artificial)

Abstand und Definition von Allgemeiner Künstlicher Intelligenz (AGI) : Es gibt eine breite Diskussion darüber, wie weit die aktuelle AI-Technologie von AGI entfernt ist und wie AGI definiert wird. Der Erfolg von AlphaFold wird als Beispiel dafür angeführt, dass AI immer noch menschliche Expertenanpassung benötigt, was die Nähe von AGI in Frage stellt. Gleichzeitig gibt es die Ansicht, dass AGI möglicherweise nicht in allen Aspekten den Menschen übertrifft oder dass ihre Realisierung anders als erwartet ausfallen könnte. (Quelle: fchollet, Dorialexander, mbusigin, Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

Zukunft und Herausforderungen von AI Agenten : Die Branche blickt mit Erwartung auf das Potenzial von AI Agenten, die das „Micromanagement“ beenden könnten, weist aber gleichzeitig darauf hin, dass die meisten Unternehmen noch nicht bereit sind. Diskussionen darüber, ob Agenten Modelle selbstständig feinabstimmen können, um Randfälle zu berücksichtigen, sowie die Anwendung von Agenten in Entwicklungs- und Betriebsabläufen wie UI-Reparaturen, deuten alle darauf hin, dass die Agent-Technologie eine Produktivitätsrevolution mit sich bringen wird. (Quelle: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, andriy_mulyar, Reddit r/MachineLearning)

Die Bedeutung von Open-Source-AI-Modellen : Es wird die Überlegenheit von Open-Source-Modellen bei der Vermeidung von Leistungsinkonsistenzen betont, insbesondere in kritischen Anwendungsbereichen wie dem Gesundheitswesen. Dies steht im Gegensatz zu den Bedenken, die durch die Leistungsverschlechterung des Anthropic-Modells ausgelöst wurden, und ruft zu mehr Unterstützung und Nutzung von Open-Source-AI-Lösungen auf. (Quelle: iScienceLuvr)

Fehlgeschlagene AI-Bestellsysteme in Fast-Food-Restaurants : AI-Bestellsysteme in Fast-Food-Restaurants fielen aus, zum Beispiel bestellten Kunden 18.000 Tassen Wasser oder die AI forderte wiederholt Getränke hinzu, was zu Systemabstürzen oder Nutzerfrustration führte. Dies unterstreicht die Herausforderungen, denen sich AI in praktischen Anwendungen immer noch gegenübersieht, insbesondere bei der Bewältigung von Ausnahmesituationen und der Benutzerkommunikation. (Quelle: menhguin)

💡 Sonstiges

HUAWEI’S HELLCAT: UB MESH Interconnect-Architektur : Huaweis Unified Bus (UB) ist eine proprietäre Interconnect-Architektur, die darauf abzielt, die gemischte Nutzung von PCIe, NVLink und InfiniBand/RoCE in traditionellen Systemen zu ersetzen. Sie bietet ultrahohe Bandbreite und geringe Latenz, verbindet alle NPUs und wird als wichtige Entwicklungsrichtung für zukünftige Computerarchitekturen angesehen. (Quelle: teortaxesTex)

Philosophische Diskussion über AI und Emotionen : Die Kombination von AI und Empathie wurde vorgeschlagen, was eine philosophische Diskussion darüber auslöste, ob AI Emotionen wirklich verstehen und ausdrücken kann und welche potenziellen Auswirkungen diese Kombination auf die Gesellschaft und die Mensch-Computer-Interaktion hat. (Quelle: Ronald_vanLoon)

Lernressourcen für verteilte Systeme: „14 Days of Distributed“ : Zach Mueller und andere teilten die Reihe „14 Days of Distributed“, die darauf abzielt, verteilte Systeme und verwandte Technologien zu erkunden und Lernressourcen für groß angelegte Berechnungen in der AI-Forschung und -Entwicklung bereitzustellen. (Quelle: charles_irl, winglian)