Schlüsselwörter:KI-Hydrogel, Autonomer chirurgischer Roboter, Intelligentes Mikroskop, GPT-5, Großes Modell Schachmeisterschaft, KI-Videogenerierung, KI-Begleitroboter, KI-Ethik, KI-entworfenes Hydrogel mit starker Adhäsion, Da-Vinci-Operationsroboter autonome Gallenblasenentfernung, Tiefes Lernen zur Vorhersage von Proteinfehlfaltung, GPT-5 übertrifft menschliche Denkfähigkeit, Grok 4 Schach-KI-Leistung

Gerne, hier ist die Übersetzung der chinesischen KI-Nachrichten ins Deutsche, unter Beibehaltung der technischen Begriffe und Produktnamen auf Englisch, klar und präzise, mit originaler Formatierung und Quellenangaben:

🔥 Fokus

KI “erschafft” Hydrogel, das alles verbindet : Ein bahnbrechender Fortschritt im KI-gestützten Materialdesign wurde erzielt: Nature berichtet auf dem Cover über ein von KI entworfenes, extrem stark haftendes Hydrogel. Dieses Hydrogel wurde durch die Analyse natürlicher Adhäsionsproteinsequenzen entwickelt und zeichnet sich durch starke Haftung in feuchter Umgebung sowie langfristige Stabilität und Biokompatibilität aus. Diese Technologie verspricht, biomedizinische Anwendungen wie Prothesenbeschichtungen, tragbare Biosensoren und Unterwasserreparaturmaterialien zu revolutionieren. Sie eröffnet einen völlig neuen End-to-End-datengetriebenen Weg für das Design weicher Materialien und demonstriert das enorme Potenzial von KI in der Materialwissenschaft. (Quelle: 36氪)

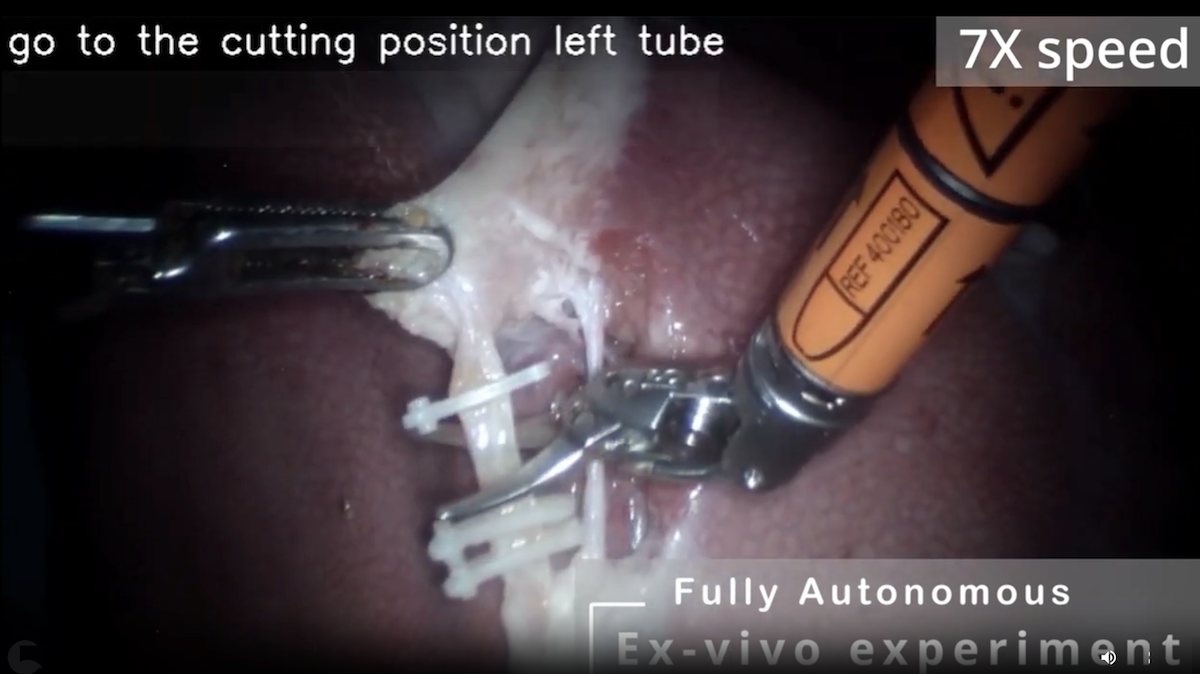

Autonomer Operationsroboter entfernt erfolgreich Gallenblase : Die Johns Hopkins University und andere Institutionen haben ein System namens SRT-H entwickelt, das es dem Da Vinci Operationsroboter ermöglicht, wichtige Schritte bei der Gallenblasenentfernung autonom und ohne ständige menschliche Intervention durchzuführen. Das System trainiert über Imitationslernen einen übergeordneten Planer und einen untergeordneten Aktionsgenerator und kann Fehler während des Betriebs selbst korrigieren, was das enorme Potenzial autonomer Operationen aufzeigt. Obwohl es derzeit nur an ex vivo Gewebe getestet wurde und noch langsamer als ein Mensch ist, legen seine natürliche Sprachschnittstelle und Erklärbarkeit eine wichtige Grundlage für zukünftige sichere autonome Operationen. (Quelle: DeepLearning.AI Blog)

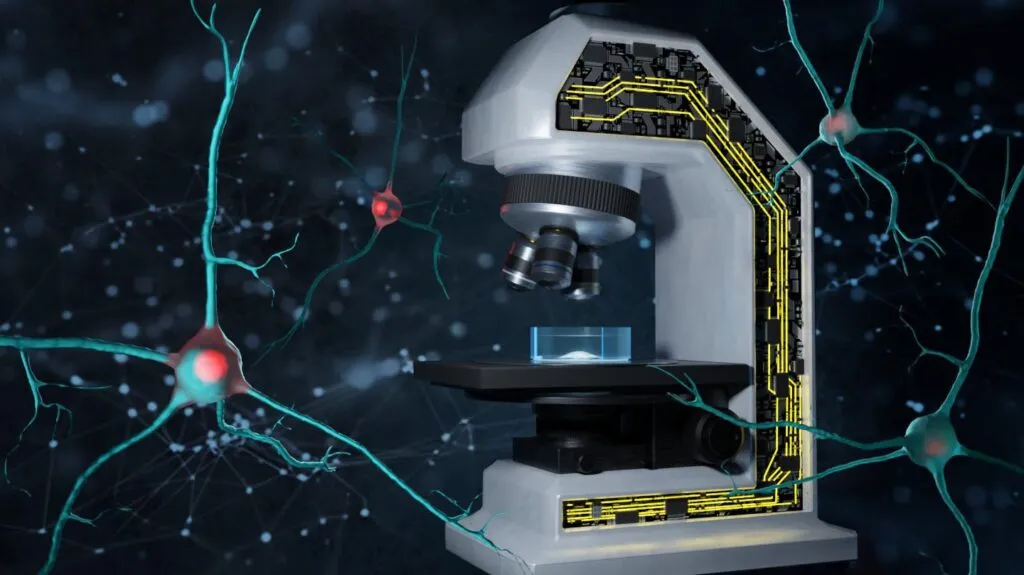

Intelligentes Mikroskop sagt Proteinfehlfaltungsaggregation voraus : Forscher der EPFL haben mithilfe von Deep Learning ein intelligentes Mikroskop entwickelt, das in der Lage ist, die Aggregation fehlgefalteter Proteine, die mit neurodegenerativen Erkrankungen in Verbindung stehen, in Echtzeit zu verfolgen und zu analysieren, und diese sogar vor ihrem Beginn vorherzusagen. Das System kombiniert Bildklassifizierungsalgorithmen mit Brillouin-Mikroskopie und löst bei Erkennung von Proteinaggregation automatisch eine Analyse aus, was die Bildgebungseffizienz erheblich verbessert und den Einsatz von Fluoreszenzmarkierungen reduziert. Dieser Durchbruch ist von großer Bedeutung für das Verständnis der biomechanischen Mechanismen neurodegenerativer Erkrankungen und die Medikamentenentwicklung und unterstreicht das enorme Potenzial intelligenter Mikroskopie in den Biowissenschaften. (Quelle: aihub.org)

🎯 Entwicklungen

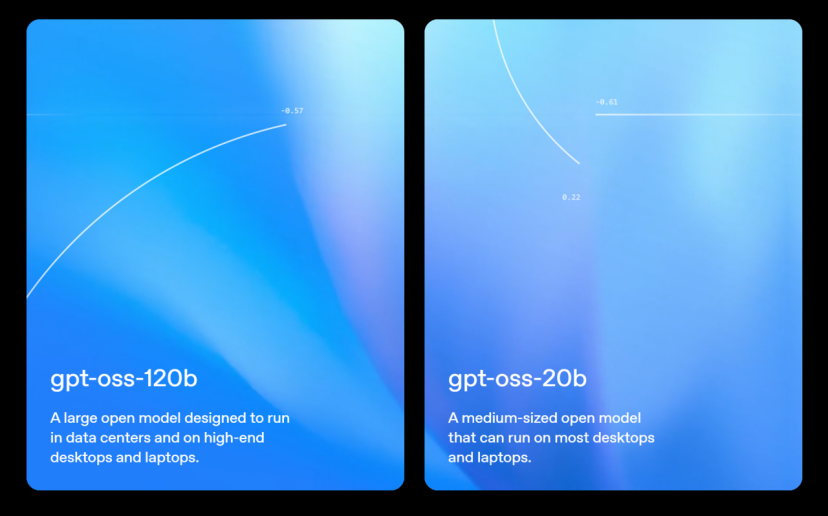

KI-Giganten im Silicon Valley veröffentlichen neue Modelle in schneller Folge : Die KI-Giganten im Silicon Valley haben kürzlich eine Reihe neuer Entwicklungen veröffentlicht, die den KI-Wettbewerb beschleunigen. OpenAI hat nach sechs Jahren wieder ein Open-Source-Modell, gpt-oss, in den Versionen 120B und 20B eingeführt, das den Fokus auf lokale Bereitstellung und Agent-Anwendungen legt und dessen Leistung an o4-mini heranreicht. Google hat Genie 3 veröffentlicht, das die Erstellung interaktiver 3D-virtueller Welten aus Text in Minutenschnelle ermöglicht und als wichtiger Schritt auf dem Weg zur AGI gilt. Anthropic hat Claude Opus 4.1 aktualisiert, das eine neue SOTA-Leistung in der KI-Programmierung erreicht und seine Führungsposition in diesem Bereich weiter festigt. Diese Veröffentlichungen deuten auf einen beschleunigten Wettbewerb in der KI-Technologie in den Bereichen Open Source, Weltmodelle und vertikale Anwendungen hin. (Quelle: 36氪, DeepLearning.AI Blog, 量子位, 36氪)

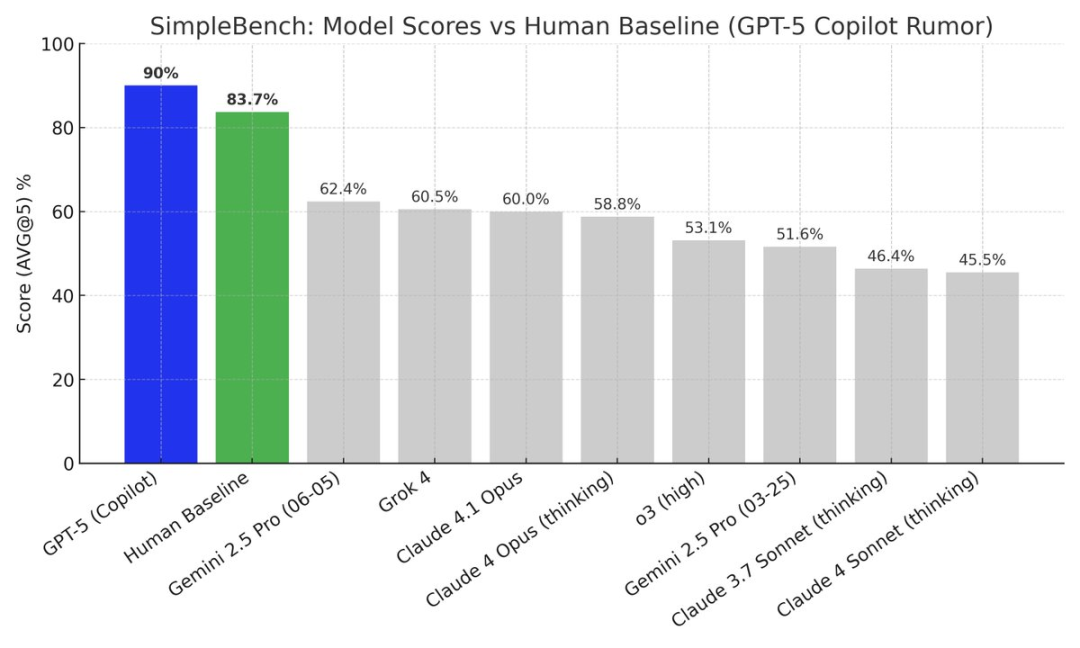

Umfassende Informationslecks vor der GPT-5-Veröffentlichung : OpenAI hat eine GPT-5-Veranstaltung angekündigt, und es sind zahlreiche Informationen durchgesickert. Berichten zufolge wird GPT-5 in vier Versionen – Standard, Mini, Nano und Chat – mit gestuftem Zugriff verfügbar sein, wobei auch kostenlose Nutzer die Basisversion erleben können. Interne Tests zeigen, dass es in den Bereichen Schlussfolgerung, Programmierung, Mathematik und wissenschaftliche Problemlösung hervorragende Leistungen erbringt, wobei seine Schlussfolgerungsfähigkeiten erstmals den menschlichen Durchschnitt übertreffen. Gleichzeitig hat Sam Altman seinen Mitarbeitern enorme Boni ausgezahlt, und die Bewertung von OpenAI könnte 500 Milliarden US-Dollar erreichen, was das Vertrauen in GPT-5 und die Markterwartungen widerspiegelt. (Quelle: 36氪, 36氪)

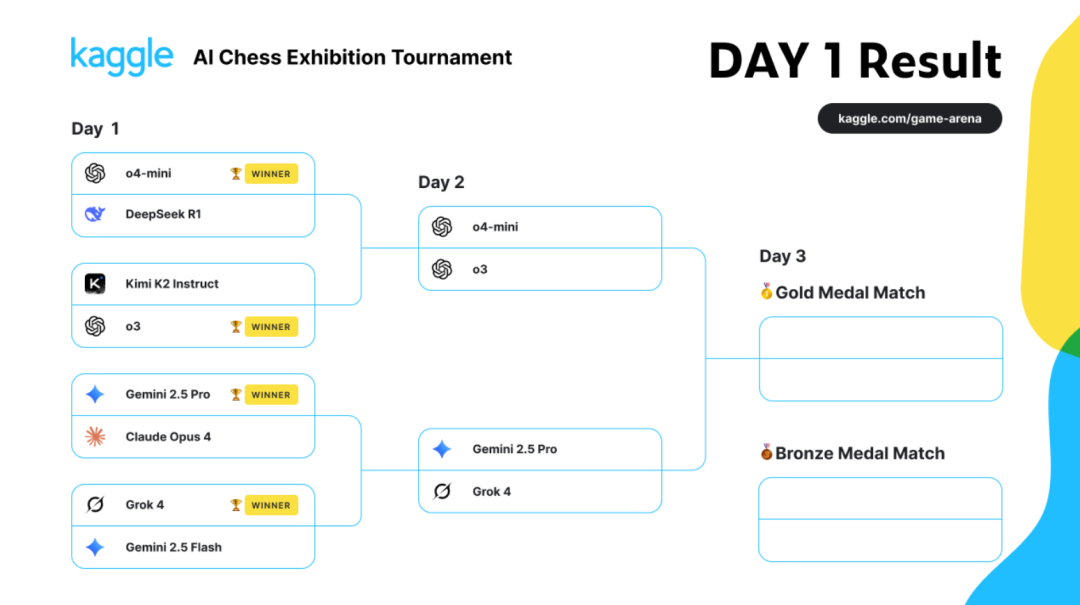

Erstes großes Schach-LLM-Turnier: Grok 4 und o3 erreichen das Finale : Auf der Google Kaggle-Plattform fand das erste KI-Schachturnier für große Sprachmodelle statt, bei dem acht Top-LLMs gegeneinander antraten. In der ersten Runde schieden leider chinesische Modelle wie DeepSeek R1 und Kimi K2 Instruct aus. Im Halbfinale besiegten xAIs Grok 4 und OpenAIs o3 ihre jeweiligen Gegner und zogen ins Finale ein. Die Turnierregeln beschränkten die Modelle darin, externe Tools zu nutzen, um ihre reine Schlussfolgerungsfähigkeit zu testen. Dies offenbarte Schwächen der KI-Modelle im Kontextverständnis und der taktischen Ausführung, doch die Leistung von Grok 4 wurde von Elon Musk hoch gelobt und stieß auf breites Interesse. (Quelle: 36氪, 36氪, 36氪)

Fortschritte chinesischer KI-LLM-Plattformen im Juli : Im Juli zeigte sich der chinesische Markt für große KI-Modelle sehr aktiv. Die WAIC-Konferenz konzentrierte sich auf Embodied AI und betonte den Übergang von KI “vom Bildschirm zur Realität”. Multi-Agenten-Systeme entwickelten sich zu einem neuen Trend: 360 Nano AI führte einen L4-Multi-Agenten-Schwarm ein, der die Zusammenarbeit bei komplexen Aufgaben ermöglicht. Führende Hersteller haben ihre neuesten Modelle als Open Source veröffentlicht, darunter Alibabas Qwen3-Serie, Moonshot AIs Kimi K2 und Zhipu AIs GLM-4.5, was die Entstehung eines “Wurzelsystems” für chinesische große Modelle vorantreibt, die technische Leistungsfähigkeit kontinuierlich verbessert und eine dominierende Position in internationalen Rankings einnimmt. (Quelle: 36氪, 量子位, DeepLearning.AI Blog, 量子位)

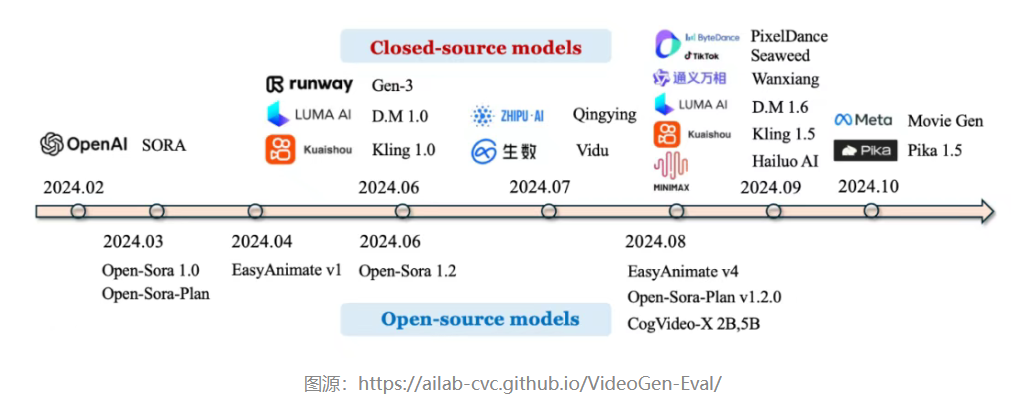

Explosion von KI-Videogenerierungsmodellen und Aufkommen des Agentic Web-Konzepts : Der Bereich der KI-Videogenerierung erlebt ein explosionsartiges Wachstum: Nachdem Sora technologische Engpässe überwunden hat, wurden nacheinander Runway Gen-3, Luma Dream Machine und Kuaishou Keling eingeführt, was die Kosten für die Videoproduktion erheblich senkt. Die Marktlandschaft ist noch nicht gefestigt, aber chinesische Hersteller wie ByteDance, Kuaishou, MiniMax und Aisi Technology zeigen herausragende Leistungen. Gleichzeitig entsteht das Konzept des Agentic Web, das ein von KI-Agenten angetriebenes Internet der nächsten Generation vorschlägt, in dem Agenten die Hauptakteure im Web sein und Aufgaben automatisieren werden, was eine vollständige Neugestaltung der zugrunde liegenden Internetlogik ankündigt. (Quelle: 36氪, 36氪, 36氪)

KI-Brillen ermöglichen “Telekinese” für neue Mixed-Reality-Interaktionen : Forscher, darunter Alumni der Zhejiang-Universität, haben die Reality Proxy-Technologie vorgestellt, die KI-Brillen die “Telekinese”-Funktion ermöglicht, bei der Nutzer reale Objekte per Geste auswählen und mit ihnen interagieren können, was das Mixed-Reality-Erlebnis erheblich verbessert. Diese Technologie abstrahiert reale Objekte zu digitalen Proxys und unterstützt Funktionen wie Browsen, Mehrfachauswahl von Objekten, Attributfilterung und semantische Gruppierung. Sie könnte in der täglichen Informationssuche, Gebäudenavigation und Drohnensteuerung eingesetzt werden und stellt einen wichtigen Fortschritt im Bereich der Embodied AI und Mensch-Computer-Interaktion dar. (Quelle: 36氪)

🧰 Tools

Nokia 3210 mit DeepSeek AI: Ein neues Feature Phone-Erlebnis : HMD hat eine Neuauflage des Nokia 3210 Feature Phones mit integrierter DeepSeek AI auf den Markt gebracht. Dieses Handy bietet für den niedrigen Preis von 429 Yuan eine KI-Sprachassistentenfunktion, deren Spracherkennung schnell und präzise ist, und die Antworten prägnant und unterhaltsam sind, sogar mit humorvollen Reaktionen wie dem “Nüsseknacken”. Obwohl die KI-Fähigkeiten begrenzt sind, bietet sein “gut genug”-Konzept und seine Benutzerfreundlichkeit für ältere Nutzer neue Ansätze für die Verbreitung von KI in kostengünstigen Endgeräten und zeigt das Potenzial für inklusive KI auf. (Quelle: 36氪)

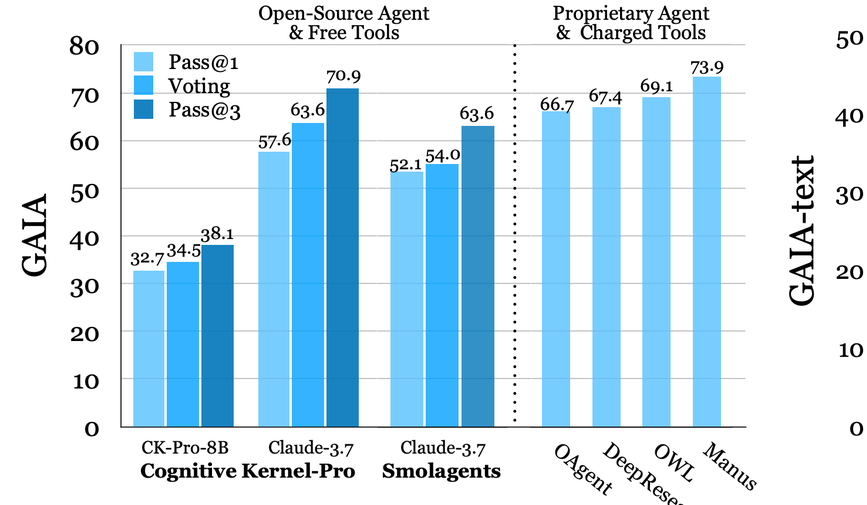

Tencent AI Lab veröffentlicht Open-Source-Framework Cognitive Kernel-Pro für Deep Research Agents : Tencent AI Lab hat Cognitive Kernel-Pro als Open Source veröffentlicht, ein vollständig quelloffenes, multimodulares und hierarchisches Framework für Deep Research Agents. Dieses Framework nutzt Python-Code als Aktionsraum, minimiert externe Abhängigkeiten und zielt darauf ab, die Effizienz bei der Wissensentdeckung und Problemlösung zu verbessern. Es zeigte hervorragende Leistungen im GAIA-Benchmark, nahe an kostenpflichtigen Tool-Agenten, und verbesserte die Leistung durch innovative Trainingsmethoden, was eine reproduzierbare Lösung für die Entwicklung und das Training von KI-Agenten bietet. (Quelle: 量子位)

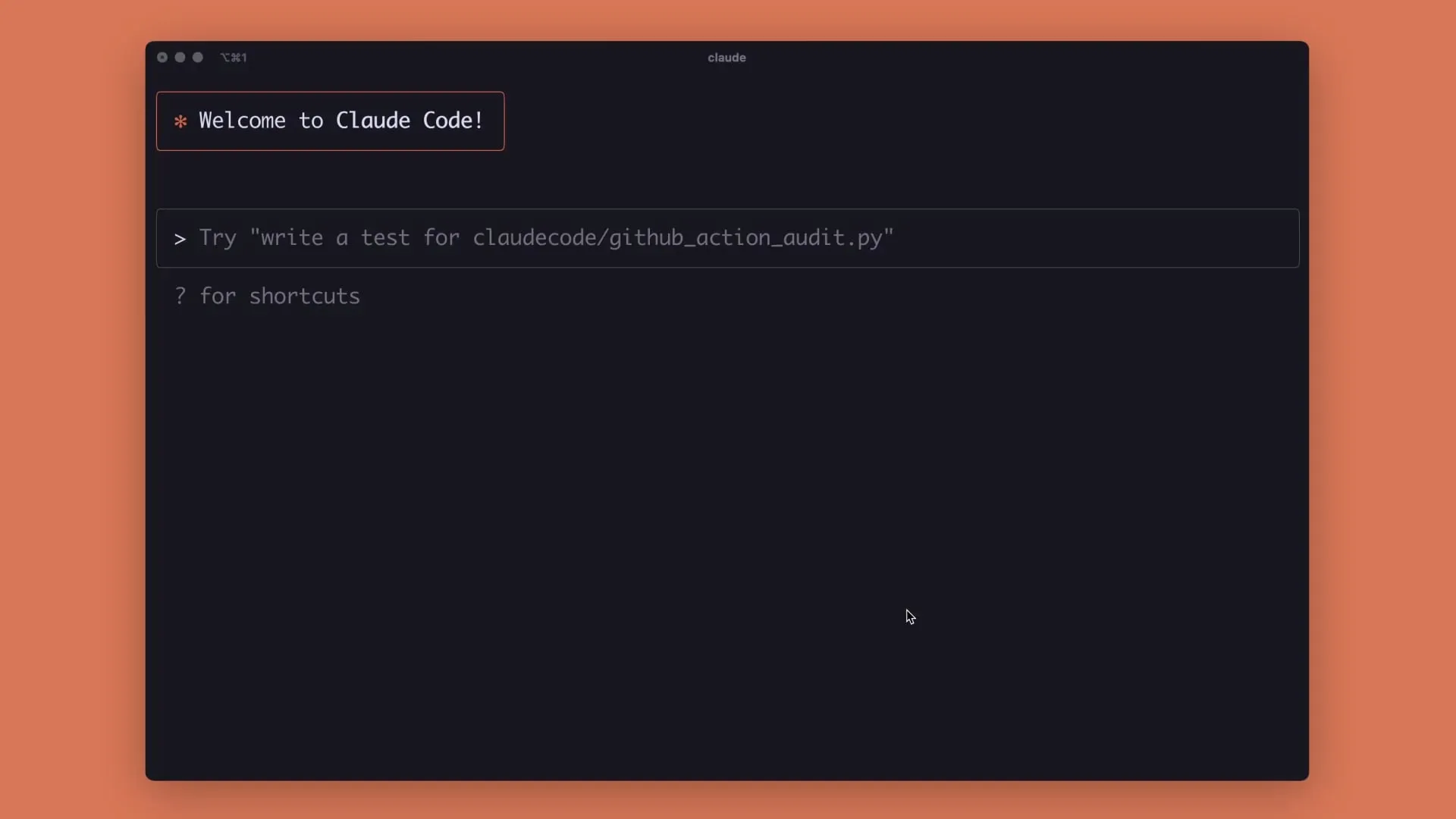

Claude Code führt automatisierte Sicherheitsüberprüfungsfunktion ein : Anthropic’s Claude Code bietet jetzt eine automatisierte Sicherheitsüberprüfungsfunktion, die es Benutzern ermöglicht, Sicherheitsprüfungen direkt vom Terminal aus durchzuführen und in GitHub Actions zu integrieren, um jeden neuen PR automatisch zu überprüfen. Diese Funktion kann Schwachstellen wie SQL-Injections, XSS und Authentifizierungsfehler identifizieren und beheben. Anthropic hat intern bereits echte Schwachstellen damit entdeckt und behoben, was das Potenzial von KI zur Verbesserung der Softwaresicherheit und -effizienz zeigt, obwohl in der Community auch Diskussionen über ihre Vertrauenswürdigkeit bestehen. (Quelle: Reddit r/ClaudeAI)

Probleme mit der OpenWebUI-Benutzererfahrung : Die Reddit-Community diskutiert Probleme mit OpenWebUI, das beim Betrieb von Ollama und LiteLLM in einer Proxmox LXC-Umgebung keine Tools, Funktionen und Pipelines nutzen kann, und Benutzer suchen nach erfolgreichen Erfahrungen mit ähnlichen Konfigurationen. Gleichzeitig interessieren sich Benutzer dafür, wie man die Chain-of-Thought (CoT)-Ausgabe des gpt-oss-Modells (das über llama.cpp-server läuft) in OpenWebUI ausblenden oder erweitern kann. Diese Probleme spiegeln die Herausforderungen wider, die bei der Bereitstellung und Konfiguration von KI-Tools in bestimmten Virtualisierungsumgebungen sowie bei der Optimierung der Benutzererfahrung auftreten. (Quelle: Reddit r/OpenWebUI, Reddit r/OpenWebUI)

Bedarf an quelloffenem, leichtgewichtigem, CPU-freundlichem Wortausrichtungs-KI-Modell : Reddit-Nutzer suchen nach einem quelloffenen, leichtgewichtigen, CPU-freundlichen KI-Modell für die Sprachübersetzung, das Quell- und Zielsätze als Eingabe empfängt und ein Array von Wortausrichtungsindizes zurückgibt, ähnlich wie simalign, aber nicht auf dessen Genauigkeitsprobleme beschränkt. Dies spiegelt den spezifischen Bedarf von Entwicklern an Modellleistung, Bereitstellungsumgebung und Open-Source-Anpassbarkeit für bestimmte NLP-Aufgaben wider, um eine effiziente Sprachverarbeitung in ressourcenbeschränkten Szenarien zu ermöglichen. (Quelle: Reddit r/deeplearning)

📚 Lernen

Die “Soft Thinking”-Fähigkeit von LLMs und Inferenzoptimierung : Forschungspapiere untersuchen die “Soft Thinking”-Fähigkeit großer Inferenzmodelle und stellen fest, dass LLMs beim nachfolgenden Dekodieren hauptsächlich von den einflussreichsten Teilen des Soft Inputs abhängen, was zu einer Degeneration des “Soft Thinking” zu Greedy Decoding führt. Durch die Einführung von Dirichlet-Resampling und Gumbel-Softmax-Tricks kann Zufälligkeit effektiv eingeführt werden, um das Potenzial des “Soft Thinking” freizusetzen, was zu hervorragenden Leistungen in acht Inferenz-Benchmarks führt und neue Richtungen zur Verbesserung der LLM-Inferenzfähigkeiten aufzeigt. (Quelle: Reddit r/MachineLearning)

Buchempfehlung: “Mastering Modern Time Series Forecasting” : Das Buch “Mastering Modern Time Series Forecasting” belegt auf Leanpub weiterhin den ersten Platz in den Kategorien Machine Learning, Zeitreihen und Prognosen. Das Buch deckt klassische Methoden wie ARIMA und Prophet sowie moderne ML/DL-Modelle wie LightGBM und Transformer umfassend ab. Es legt Wert auf Python-Praxis, Produktionsbereitstellung, Erklärbarkeit und Quantifizierung von Unsicherheiten und zielt darauf ab, Datenwissenschaftlern, ML-Ingenieuren und Forschern eine Ressource zu bieten, die Theorie und Praxis ausgewogen verbindet. (Quelle: Reddit r/deeplearning)

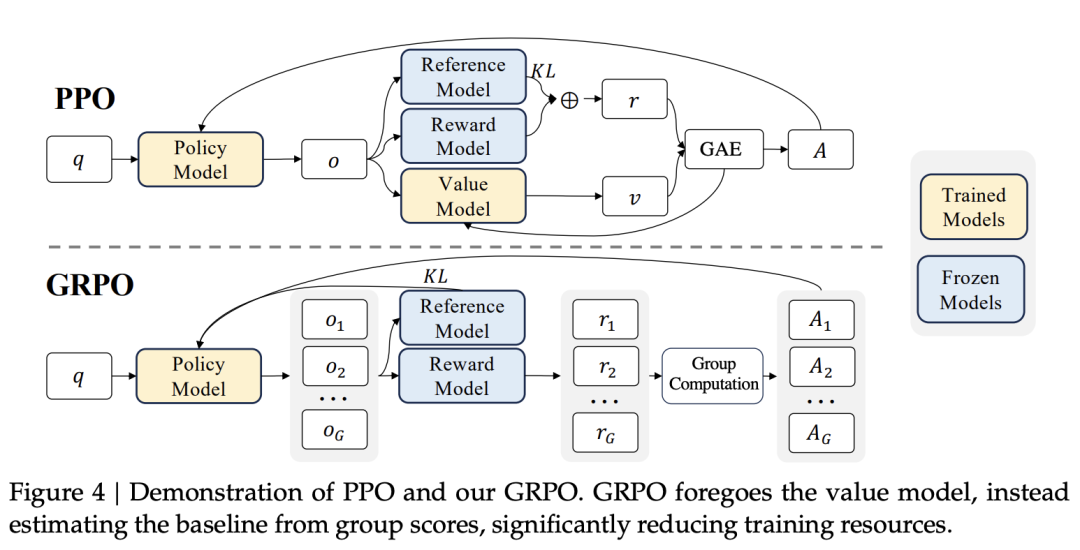

Qwen3s neues Paradigma GSPO: Lösung für DeepSeek GRPO-Modellabstürze : Das Qwen-Team hat den GSPO (Group Sequence Policy Optimization)-Algorithmus vorgeschlagen, um Stabilitätsprobleme zu lösen, die bei DeepSeek GRPO (Group Relative Policy Optimization) während des Trainings großer Sprachmodelle, insbesondere bei MoE-Modellen, auftreten, wie z.B. Abstürze. GSPO reduziert die Varianz erheblich und eliminiert die Abhängigkeit von Hilfsstrategien, indem es das Importance Sampling von der Token-Ebene auf die Sequenz-Ebene anhebt. Es wird erwartet, dass es ein neuer Standard für das Post-Training von LLM-Reinforcement Learning wird und für die Verbesserung der Inferenzfähigkeiten von Modellen von entscheidender Bedeutung ist. (Quelle: 36氪, Reddit r/MachineLearning)

Spitzenforschung im Reinforcement Learning : Jüngste Forschungen im Bereich des Reinforcement Learning haben mehrere Fortschritte erzielt. Das HyCodePolicy-Framework verbessert die Robustheit und Effizienz von Betriebsstrategien für Embodied Agents durch Codesynthese, geometrische Lokalisierung, perzeptive Überwachung und iterative Reparatur. Sotopia-RL verbessert die Trainingsergebnisse für die soziale Intelligenz von LLMs durch ein diskursebene, mehrdimensionales Belohnungsdesign. Das EARL-Modell kombiniert RL und VLM-Validatoren und zeigt hervorragende Leistungen bei Bildbearbeitungsaufgaben mit weniger benötigten Trainingsdaten. Gleichzeitig zeigen Community-Diskussionen, dass Bayes’sche Deep-Learning-Methoden immer noch Trainingsherausforderungen beim Erreichen von SOTA-Leistung gegenüberstehen, wobei die meisten erfolgreichen Fälle “Bayesianisierungen” nicht-Bayes’scher Modelle sind. (Quelle: HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, Reddit r/MachineLearning)

Forschung zu LLM-Verhalten und Optimierungsmechanismen : Mehrere Studien konzentrieren sich auf das Verhalten und die Optimierung von LLMs. AttnTrace schlägt eine auf Aufmerksamkeitsgewichten basierende Kontext-Traceback-Methode für LLMs mit langem Kontext vor, die die Glaubwürdigkeit und die Erkennung von Prompt-Injektionen verbessert. LeanK reduziert den Speicherverbrauch erheblich und beschleunigt die Dekodierung durch KV-Cache-Kanal-Pruning. Forschungsergebnisse zeigen jedoch, dass die Chain-of-Thought (CoT)-Inferenz von LLMs anfällig ist, wenn sie außerhalb der Trainingsdatenverteilung liegt, und möglicherweise eine “Fata Morgana” darstellt. Das Sculptor-Framework hingegen reduziert Störungen und verbessert die Zuverlässigkeit der Inferenz bei Langkontext-Aufgaben durch aktive Kontextverwaltungstools. Web-CogReasoner verbessert das Lernen von Wissensinhalten und kognitive Prozesse von Web-Agenten durch wissensgesteuerte Chain-of-Thought-Inferenz. (Quelle: HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

Fortschritte bei multimodalen Modellen und Generierungstechnologien : Der Bereich der multimodalen KI hat in jüngster Zeit reiche Früchte getragen. UniEgoMotion schlägt ein einheitliches Modell für die Rekonstruktion, Vorhersage und Generierung menschlicher Bewegung aus der Egoperspektive vor, das neue Möglichkeiten für Anwendungen wie AR/VR eröffnet. Das Kaufverhalten von KI-Agenten im E-Commerce wurde evaluiert und zeigte, dass die Modellpräferenzen denen von Menschen ähneln, aber in unterschiedlichem Maße. Das BLiM-Framework verbessert die Leistung der Text-Video-Retrieval durch die Kombination von Query- und Kandidaten-Likelihoods. HPSv3 bietet einen neuen Standard für die Bewertung menschlicher Präferenzen für Text-zu-Bild-Generierungsmodelle und optimiert die Bildqualität durch CoHP. Der 3D-Occupancy-Grounding-Benchmark und das GroundingOcc-Modell verbessern die räumliche Wahrnehmungsfähigkeit im autonomen Fahren. Darüber hinaus ermöglicht das Gaussian Splatting-basierte Diffusionsmodell die Generierung hochwertiger Video-zu-4D-Inhalte. (Quelle: HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

💼 Wirtschaft

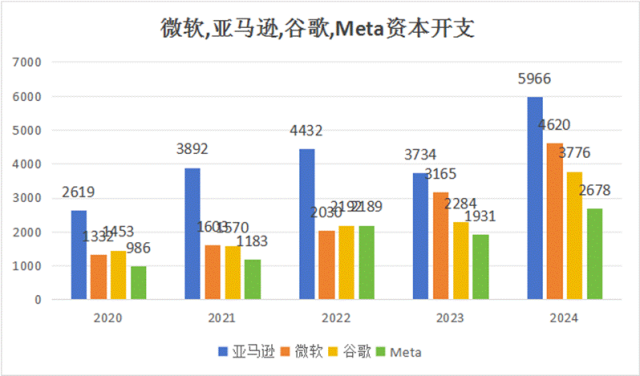

Unterschiede bei KI-Investitionen und Geschäftsmodellen zwischen China und den USA : Die US-Tech-Giganten Meta, Microsoft, Google und Amazon werden in diesem Jahr voraussichtlich bis zu 400 Milliarden US-Dollar in KI investieren, und die KI-Einnahmen wachsen schnell. OpenAI und Anthropic könnten bis Jahresende annualisierte Umsätze von 29 Milliarden US-Dollar erreichen. Im Gegensatz dazu steht die Kommerzialisierung der heimischen KI-Industrie vor Herausforderungen: Das Umsatzwachstum und der Gewinnanstieg sind langsam, und einige innovative KI-Produkte und Talente wandern beschleunigt ab. Dieser Unterschied resultiert aus der Divergenz der zugrunde liegenden Internet-Paradigmen zwischen den USA und China: In den USA treibt SaaS KI-Anwendungen mit einer “Schnittstellen”-Denkweise voran, während China sich auf eine “Eingangs”-Denkweise verlässt, was die Rentabilität der KI-Kommerzialisierung einschränkt und die entscheidende Verbindung zwischen Kapitalinvestitionen und Geschäftslogik hervorhebt. (Quelle: 36氪, 36氪, 36氪, DeepLearning.AI Blog)

Meitus KI-Transformation führt zu Rentabilität und Wachstum : Meitu Inc. hat durch KI-Technologie eine Geschäftstransformation vollzogen, und der Nettogewinn für das erste Halbjahr 2025 wird voraussichtlich erheblich steigen. Das Unternehmen hat das visuelle Großmodell MiracleVision, eine offene KI-Plattform und mehrere AIGC-Produkte für C- und B-Kunden entwickelt, wodurch die VIP-Abonnementeinnahmen zum Hauptwachstumstreiber wurden und die Expansion in Überseemärkte sowie B2B-Produktivitätsszenarien vorangetrieben wurde. Obwohl im Vergleich zu professionellen Design-Tools wie Figma noch Lücken bestehen, hat Meitu erfolgreich jahrelange Verluste überwunden, sein Ertragsmodell durch KI neu gestaltet und eine strategische Partnerschaft mit Alibaba geschlossen, um den B2B-Markt weiter zu erschließen, was das enorme Potenzial von KI zur Stärkung traditioneller Unternehmen demonstriert. (Quelle: 36氪)

KI-Begleitroboter als heiß begehrter neuer Markt : Mit dem Aufkommen der alternden Bevölkerung und der Single-Wirtschaft wird “Einsamkeit” zur treibenden Kraft für den Markt der KI-Begleitroboter, dessen globales Marktvolumen voraussichtlich schnell wachsen wird. Größen wie Lei Jun, Richard Liu, Zhu Xiaohu und Yu Minhong sind in diesen Bereich eingestiegen und sichern sich Marktanteile durch Investitionen oder die Einführung von Produkten. Die Geschäftsmodelle in diesem Bereich sind vielfältig, darunter Hardware-Verkauf, Abonnementdienste, szenariobasierte Lösungen und Datenmonetarisierung, doch hohe Rücksendequoten und unterschiedliche Nutzererwartungen bleiben Herausforderungen. Die Branche bewegt sich von der Technologievalidierungsphase in die schnelle Kommerzialisierungsphase, was auf ein explosionsartiges Wachstum emotionaler Technologieprodukte hindeutet. (Quelle: 36氪)

🌟 Community

ChatGPT-Datenschutzskandal und Nutzervertrauenskrise : Über 70.000 private ChatGPT-Chat-Inhalte wurden aufgrund eines Designfehlers in der “Teilen”-Funktion öffentlich in Google-Suchergebnissen indexiert, was Datenschutzbedenken und weitreichende Kontroversen bei den Nutzern auslöste. OpenAI räumte das Designproblem ein und entfernte die Option “auffindbar” umgehend, doch der Vorfall verschärfte die Vertrauenskrise der Nutzer in die KI-Chat-Privatsphäre und OpenAIs Datenmanagement und wurde kritisiert, Nutzer als “Versuchskaninchen” zu behandeln. Dieser Vorfall unterstreicht die Bedeutung, dass KI-Produkte bei der Funktionsgestaltung klarer über die Datenverarbeitung informieren müssen. (Quelle: 36氪)

Auswirkungen von KI auf den Arbeitsmarkt und berufliche Transformation : Eine Microsoft-Studie weist darauf hin, dass KI eine große Anzahl menschlicher Arbeitsplätze ersetzen wird, und listet 40 Berufe mit hohem Risiko (z.B. Dolmetscher, Journalisten) und 40 Berufe mit geringem Risiko (z.B. Chirurgen, Bauarbeiter) auf. KI gestaltet die Rolle des Entwicklers neu, von “Code-Schreiber” zu “KI-Manager”, was Kernkompetenzen wie KI-Kompetenz und Agenten-Kollaboration erfordert. Obwohl KI den Menschen nicht vollständig arbeitslos machen wird, wird sie eine strukturelle Umgestaltung des Arbeitsmarktes vorantreiben, und das Bildungssystem muss sich entsprechend an das KI-Zeitalter anpassen. Zum Beispiel diskutiert die Reddit-Community auch die Auswirkungen von KI auf Lebensläufe und Einstellungen. (Quelle: 36氪, 36氪, Reddit r/ArtificialInteligence)

Auswirkungen von KI auf menschliche Kognition und psychische Gesundheit : Die Reddit-Community diskutiert, ob KI den Menschen “dümmer” macht; eine MIT-Studie zeigt, dass übermäßige Abhängigkeit von ChatGPT die Gehirnaktivität reduzieren und kritisches Denken beeinträchtigen kann. Gleichzeitig hat ChatGPT einen “Anti-Sucht-Modus” eingeführt, um potenziellen psychischen Gesundheitsproblemen durch längere Nutzung entgegenzuwirken, was Bedenken hinsichtlich übermäßiger KI-Abhängigkeit widerspiegelt. Elon Musks Grok-basierte “KI-Freundinnen” Ani und Valentine haben ethische Kontroversen ausgelöst. Ihr emotionales Begleitmodell stellt die Grenzen zwischen KI-Tools und Emotionen in Frage und weckt Bedenken hinsichtlich sozialer Atomisierung und emotionaler Manipulation. (Quelle: Reddit r/ChatGPT, Reddit r/ArtificialInteligence, 量子位, 36氪, 36氪)

Gesellschaftliche Diskussion über KI-Ethik und -Governance : Die Reddit-Community diskutiert die Notwendigkeit der KI-Governance, und Studenten suchen Interviewpartner für ihre Abschlussarbeiten, um KI-Governance auf makro-, meso- und mikroökonomischer Ebene zu erörtern. Die Gesellschaft äußert Bedenken hinsichtlich des Geschäftsmodells von Duolingos “KI-First”-Politik, da sie befürchtet, dass dies zu Umweltschäden, der Verdrängung menschlicher Arbeitsplätze und der Schwächung menschlicher Verbindungen führen könnte, und ruft zum Boykott auf. Gleichzeitig unterstreicht die Diskussion über das Risiko von LLM-Datenlecks die Bedeutung eines verantwortungsvollen Umgangs mit APIs und lokalen Modellen und fordert eine Stärkung des KI-Datenschutzes und der ethischen Überprüfung. (Quelle: Reddit r/ArtificialInteligence, Reddit r/artificial, Reddit r/ArtificialInteligence)

Philosophische Betrachtung der Auswirkungen von KI auf soziale Strukturen und den menschlichen Sinn : Der Gelehrte Zhang Xiaoyu schlägt Konzepte wie “Emergenzprinzip”, “menschliches Äquivalent”, “Algorithmus-Urteil” und “Zivilisationsvertrag” vor, um die allumfassende Veränderung der Gesellschaft durch KI zu verstehen. Er glaubt, dass KI Intelligenz zu extrem niedrigen Kosten massenhaft produzieren wird, was zu einer “speziesartigen” Vergrößerung der sozialen Kluft führen könnte und ein “universelles Grundeinkommen” sowie Empfehlungsalgorithmen für eine ausgewogene Verteilung erfordert. KI wird zu einem “unparteiischen Drittrichter” werden, der die Menschheit zwingt, über Gerechtigkeit und den Sinn des Lebens nachzudenken, und fordert die Menschheit auf, den “Anthropozentrismus” aufzugeben und sich an das KI-Zeitalter anzupassen. Demis Hassabis, Leiter von DeepMind, glaubt ebenfalls, dass die KI-Revolution eine Welt des “extremen Überflusses” bringen wird, aber die Probleme der Ressourcenverteilung und Arbeitslosigkeit gelöst werden müssen. (Quelle: 36氪, 36氪, 36氪)

Humor und Reflexionen in der KI-Community : In der Reddit-Community gibt es zahlreiche humorvolle Diskussionen über KI, wie die “präzise” Erklärung von Berufen durch ChatGPT, die bei Nutzern Selbstzweifel auslöst, das Bild von Claude Opus 4.1, das beim Lösen von Problemen “die Türen einrennt”, sowie Spott über OpenAIs “Open Source”-Benennung und die “Personalisierung” des Qwen-Modells. Diese Diskussionen spiegeln die lockere Reflexion der Nutzer über die Grenzen der KI, ethische Grenzen und zukünftige Entwicklungen im täglichen Umgang mit KI wider, sowie die Community-Kultur, technische Ängste durch Humor abzubauen. (Quelle: Reddit r/ChatGPT, Reddit r/ClaudeAI, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA, Reddit r/ChatGPT)

Herausforderungen der Nachhaltigkeit von KI-Konferenzmodellen : Ein HuggingFace-Papier weist darauf hin, dass das derzeitige zentralisierte KI-Konferenzmodell aufgrund seiner schnellen Expansion nicht nachhaltig ist und mit vielfältigem Druck konfrontiert ist: wissenschaftlich (zu hohe Publikationsraten), ökologisch (CO2-Fußabdruck), psychologisch (negative Emotionen, psychische Gesundheitsprobleme) und logistisch (Kapazität der Veranstaltungsorte). Die Studie schlägt ein “Community Federated Conference (CFC)”-Modell vor, das durch globale Koordination und lokale Organisation die Trennung von Begutachtung, Präsentation und Networking ermöglicht, um eine nachhaltigere, inklusivere und widerstandsfähigere Entwicklung der KI-Forschung zu erreichen und den neuen Herausforderungen des schnell wachsenden KI-Bereichs zu begegnen. (Quelle: HuggingFace Daily Papers)

💡 Sonstiges

Interview mit Wang Xingxing, Gründer von Unitree Robotics: Pragmatischer Idealismus der Embodied AI : Ein unveröffentlichtes Interview von Xiangfeng Investment mit Wang Xingxing, dem Gründer von Unitree Robotics, enthüllt seine tiefen Einblicke in vierbeinige/zweibeinige Roboter und die Rolle von KI in der Embodied AI. Wang Xingxing betont “Langsam ist schnell”, hält an der Eigenentwicklung von Kernkomponenten fest, strebt niedrige Kosten bei hoher Leistung an und sieht langfristig vielversprechende Aussichten für KI im Bereich der Robotik. Das Interview zeigt seine pragmatische und langfristige Unternehmensphilosophie sowie sein extremes Streben nach technischer Rationalität und Produktimplementierung und gilt als Spiegelbild eines Spitzenunternehmers im Zeitalter der technologischen Innovation. (Quelle: 36氪)

Neue Ausrichtung der Finanz- und Managementausbildung im KI-Zeitalter : Das EMBA-Programm 2026 der Shanghai Advanced Institute of Finance (SAIF) der Shanghai Jiao Tong University wurde komplett überarbeitet und integriert erstmals KI-Technologie und rechtliche Rahmenbedingungen tiefgreifend in die Finanz- und Managementausbildung, wodurch die Schwerpunkte “Finanz x KI” und “Finanz x Recht” geschaffen werden. Das Programm bietet ein “Sonderstipendium für die Talentförderung zur Stärkung der Nation durch Wissenschaft und Technologie”, das herausragenden Wissenschafts- und Innovations-Talenten Voll- oder Teilstipendien gewährt. Ziel ist es, vielseitige Talente mit globaler Perspektive und lokalem Einblick auszubilden, um die Unternehmensentwicklung im KI-Zeitalter zu unterstützen. (Quelle: 量子位)

Tencent startet Campus-Rekrutierung 2026 mit Fokus auf AI Product Manager Trainees : Tencent hat offiziell die Campus-Rekrutierung für 2026 gestartet und bietet globalen Universitätsabsolventen über 70 Positionen in fünf Hauptkategorien an, darunter Technologie, Produkt und Design. Diese Rekrutierung wird die Investitionen in KI-bezogene Positionen erheblich erhöhen und ein “AI Product Manager Trainee”-Programm für Top-Produkttalente einführen, um exzellente junge Menschen zur tiefgreifenden Beteiligung an der KI-Technologierevolution zu gewinnen und Talente für die Entwicklung von Tencents KI-Geschäft zu sichern, was den starken Bedarf und die Entschlossenheit führender Unternehmen zur Talentförderung im KI-Bereich zeigt. (Quelle: 量子位)