Schlüsselwörter:KI-Agent, Humanoider Roboter, Großes Modell, AIGC, Microsoft 365 Copilot, DeepMind Virtuelles Fruchtfliegenmodell, Missbrauch von KI-Forschungsarbeiten, OpenAI Open-Source-Modell, Kommerzialisierung von KI in der Pharmazie, Intelligenter Fahrgastraum mit Edge-Großmodell, MCP-Protokoll KI-Ökosystem, KI-Maltechniken

🔥 Fokus

Microsoft veröffentlicht AI-Agenten und Bericht zu Arbeitstrends 2025: Microsoft stellt ein großes Update für Microsoft 365 Copilot vor und führt AI-Agenten wie Researcher und Analyst ein, mit dem Ziel, KI vom Werkzeug zum „KI-Kollegen“ zu erheben. Neue Funktionen umfassen Notebook (integriert Web+Work+Pages), eine umfassende Suche (über Anwendungen und Drittanbieterquellen hinweg) und Create (integriert GPT-4o-Bilderzeugung). Der gleichzeitig veröffentlichte Bericht zu Arbeitstrends 2025 prognostiziert das Aufkommen von „Frontier Companies“, die auf „On-Demand-Intelligenz“ aufbauen, von „Mensch-Maschine-Hybrid“-Teams unterstützt werden und von Mitarbeitern eine „Agenten-Chef-Denkweise“ erfordern. Der Bericht deutet an, dass KI in den kommenden Jahren Arbeitsweisen und Organisationsstrukturen tiefgreifend umgestalten wird, und betont, dass AI-Agenten zur Kernproduktivität werden. (Quelle: 新智元)

DeepMind simuliert Fruchtfliege auf dem Nature-Cover: Google DeepMind hat in Zusammenarbeit mit dem HHMI Janelia Research Campus mithilfe von KI und physikalischer Simulation ein hochrealistisches virtuelles Fruchtfliegenmodell erstellt. Das Modell basiert auf hochauflösenden Scandaten, wurde in der MuJoCo-Physik-Engine aufgebaut und um Simulationen von Fluiddynamik und Fußhaftung ergänzt. Durch Deep Reinforcement Learning und Imitation Learning (unter Verwendung von Videos echter Fruchtfliegenbewegungen) steuert ein KI-neuronales Netzwerk erfolgreich die virtuelle Fliege, um komplexe Flug- und Laufverhaltensweisen zu simulieren, einschließlich visueller Navigation. Die Studie enthüllt nicht nur die komplexen Mechanismen hinter biologischer Bewegung, sondern bietet auch eine leistungsstarke Forschungsplattform für Neurowissenschaften und Robotik. Modell und Code sind Open Source, um die Forschung in verwandten Bereichen voranzutreiben. (Quelle: 新智元)

Nature deckt Missbrauch von KI in wissenschaftlichen Arbeiten auf: Ein Titelartikel in Nature weist darauf hin, dass eine große Anzahl wissenschaftlicher Arbeiten (der Academ-AI-Tracker hat über 700 erfasst) ohne Deklaration KI (wie ChatGPT) zur Erstellung verwendet haben und sogar offensichtliche Spuren wie „Ich bin ein KI-Sprachmodell“ enthalten. Besorgniserregender ist, dass einige Verlage (wie Elsevier) dabei beobachtet wurden, wie sie diese KI-Spuren stillschweigend entfernten, ohne Korrekturmeldungen zu veröffentlichen, was Bedenken hinsichtlich der wissenschaftlichen Integrität aufwirft. Forscher fordern Autoren auf, die spezifische Verwendung von KI klar offenzulegen, und Verlage sollten strengere Überprüfungsmechanismen einführen und Korrekturaufzeichnungen veröffentlichen, um die Transparenz und Glaubwürdigkeit der akademischen Forschung zu wahren. (Quelle: 新智元)

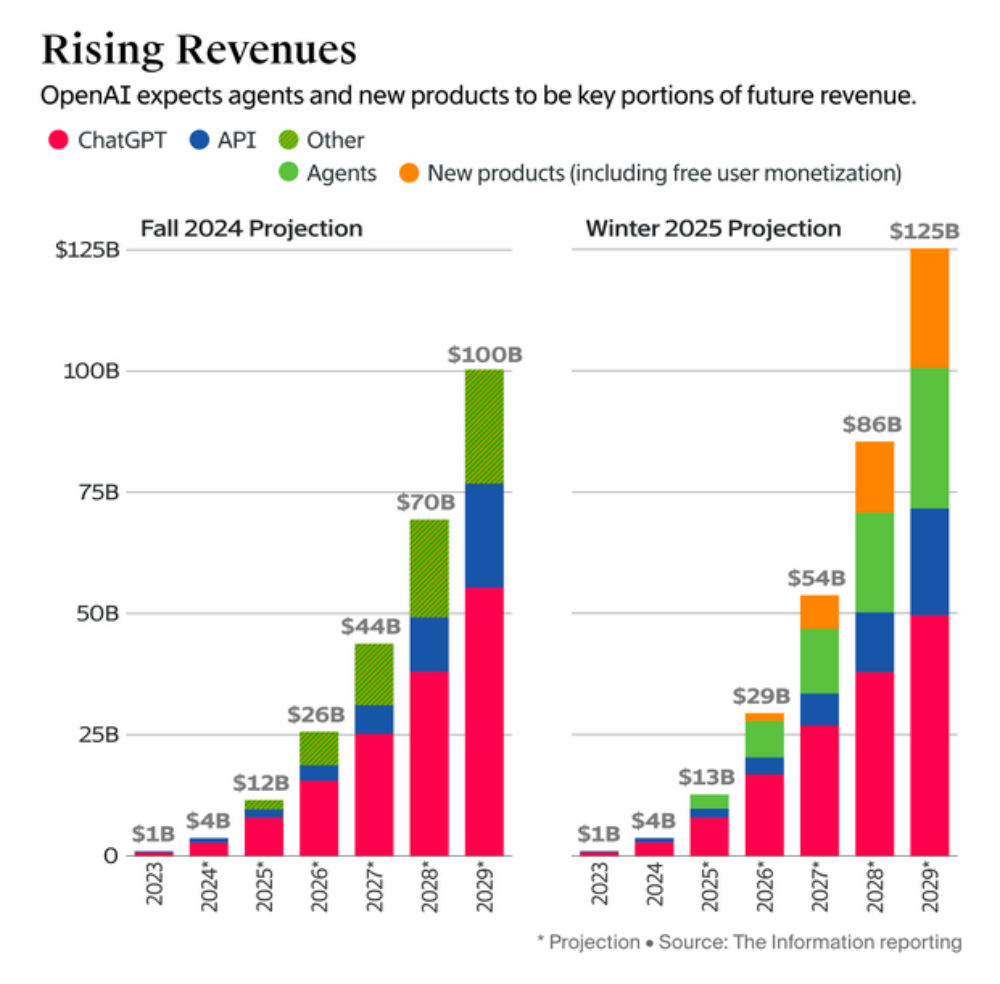

OpenAI prognostiziert hohes Umsatzwachstum und plant Umstrukturierung, was Kontroversen auslöst: OpenAI erwartet bis 2029 einen Gesamtumsatz von 125 Milliarden US-Dollar, wobei die Einnahmen aus neuen Geschäftsbereichen wie Agenten die von ChatGPT übertreffen sollen. Gleichzeitig plant das Unternehmen die Umstrukturierung in eine Public Benefit Corporation (PBC), was öffentlichen Widerspruch von KI-Pionier Hinton und 10 ehemaligen Mitarbeitern hervorrief. Die Gegner argumentieren, dass die Umstrukturierung die Kontrolle der gemeinnützigen Organisation schwächen, der ursprünglichen Absicht einer sicheren AGI-Entwicklung zum Wohle der Menschheit widersprechen und kommerzielle Interessen über die philanthropische Mission stellen würde. Sie fordern OpenAI auf zu erklären, wie die Umstrukturierung mit seiner Mission vereinbar ist, und verlangen die Beibehaltung der Governance-Garantien der gemeinnützigen Organisation. (Quelle: 智东西, 腾讯科技, 学术头条)

🎯 Entwicklungen

Humanoide Roboter im Fokus der Shanghai Auto Show, Autohersteller beschleunigen Engagement: Auf der Shanghai Auto Show 2025 wurden humanoide Roboter zu einem neuen Highlight. Xiaopeng (小鹏) präsentierte den interaktiven Roboter IRON und plant dessen Massenproduktion für Fabriken ab 2026; Chery (奇瑞) zeigte den selbst entwickelten Mornine gen-1 mit multimodaler Wahrnehmung und Frage-Antwort-Fähigkeiten; SAIC Roewe (上汽荣威), Changan Deepal (长安深蓝) und andere stellten ebenfalls kooperierte oder eingeführte Roboter zur Kundenansprache aus. Tesla, GAC (广汽), BYD (比亚迪) (Eigenentwicklung und Investitionen in Zhiyuan (智元), Pasini) und andere Autohersteller beschleunigen ebenfalls die Forschung, Entwicklung und Anwendung humanoider Roboter und sehen Potenzial in Bereichen wie Industrieproduktion und Dienstleistungen. Obwohl die Aussichten vielversprechend sind, befindet sich die Branche noch in einem frühen Stadium und birgt Risiken wie Marktunsicherheit und Blasenbildung. (Quelle: NBD汽车)

Provinz Jilin stärkt Robotikindustrie und fördert Integration von Automobil- und Robotertechnologie: Die traditionsreiche Automobilprovinz Jilin engagiert sich aktiv in der Robotikindustrie. StarNet Geomatics (星网宇达), FAW Faway (一汽富维) und das Jilin Bionic Robot Innovation Center unterzeichneten strategische Kooperationsvereinbarungen zur gemeinsamen Entwicklung von Embodied Intelligence, großen Modellen usw. Das Innovationszentrum, geleitet von der Jilin University, zielt darauf ab, eine vollständige Robotik-Industriekette aufzubauen. Dieser Schritt nutzt die etablierte Automobil-Lieferkette der Provinz Jilin (hohe Überschneidung bei Komponenten und Robotertechnologie) und entspricht den Förderrichtlinien auf nationaler und lokaler Ebene (Shenzhen, Peking) für die Embodied Intelligence-Industrie. Robotertechnologie, insbesondere Teile, die mit autonomem Fahren verwandt sind, wird als neue Chance nach der Intelligenzsteigerung der Automobilindustrie betrachtet. (Quelle: 科创板日报)

Weltweit erster AIGC-Langfilm „海上女王郑一嫂“ (Queen of the Seas: Zheng Yi Sao) kommt in die Kinos: Dieser 70-minütige Film wurde vollständig mit KI produziert, erzählt die Geschichte der legendären Piratin Zheng Yi Sao und wurde in Singapur veröffentlicht. Die Produktion stand vor vielen Herausforderungen: KI hat Schwierigkeiten mit langen Dialogen und komplexer Kameraführung und neigt dazu, repetitive oder inkohärente Bilder zu erzeugen; die Konsistenz der Charakterdarstellung ist schwer zu gewährleisten, was zu „Doppelgänger“- oder „Gesichtsveränderungs“-Problemen führt, die manuelle Nachbearbeitung erfordern. Drehbucherstellung, Storyboarding und Schnitt erfordern weiterhin menschliche Führung, da KI historische Details und kreative Absichten noch nicht vollständig verstehen kann. Trotz der Einschränkungen senkt AIGC die Produktionshürden und -kosten erheblich, was besonders neuen Teams zugutekommt, und zeigt das Potenzial und die zukünftige Richtung der Mensch-Maschine-Kollaboration in der Filmproduktion. (Quelle: 深响)

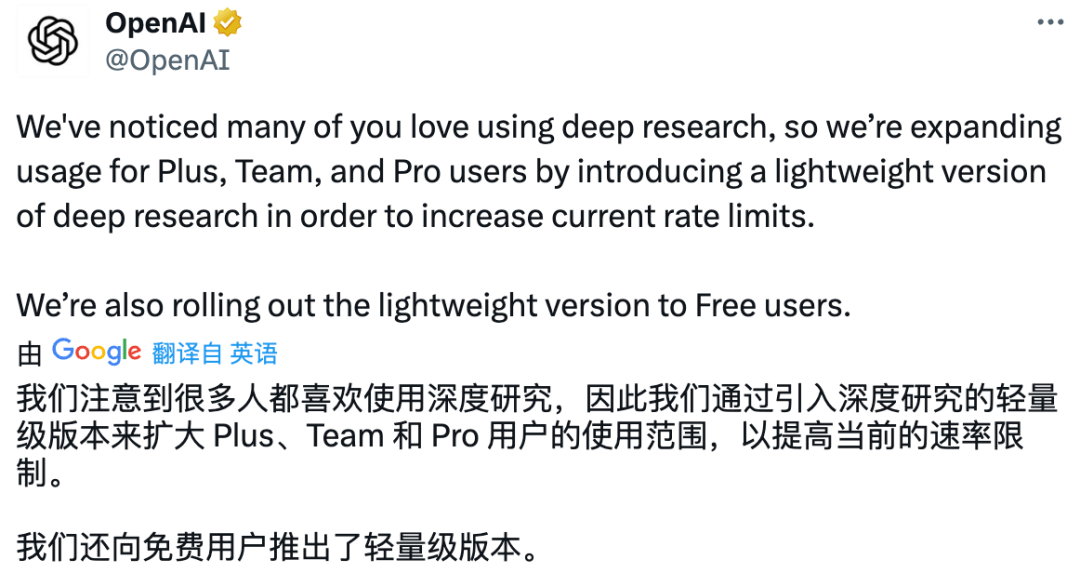

OpenAI führt Lite-Version der Deep Research-Funktion ein und öffnet sie für kostenlose Nutzer: OpenAI kündigte die Einführung einer Lite-Version der Deep Research-Funktion an, die von o4-mini angetrieben wird. Sie soll ein Intelligenzniveau nahe der Vollversion bieten, jedoch mit kürzeren Antworten und geringeren Kosten. Die Funktion ist nun für Plus-, Team-, Enterprise-, Edu- und kostenlose Nutzer verfügbar. Zahlende Nutzer wechseln automatisch zur Lite-Version, nachdem ihr Kontingent für die Vollversion aufgebraucht ist. Tests zeigen, dass die Lite-Version schnell ist, aber in Bezug auf Informationstiefe und Quellenangaben nicht an die Vollversion heranreicht und bei komplexen Aufgaben Schwächen zeigt – sie liefert eher Denkanstöße als vollständige Berichte. Die Vollversion hingegen kann tiefgreifende Suchen und Analysen durchführen und strukturierte Berichte erstellen, hat aber noch Verbesserungspotenzial. (Quelle: APPSO, 量子位, gdb)

Ausblick auf Google I/O 2025: KI-nativ und XR-Integration: Die bevorstehende Google I/O 2025 am 20. Mai wird voraussichtlich das Zusammenspiel von KI und Multi-Device in den Mittelpunkt stellen. Android 16 wird das Gemini-Großmodell tief integrieren, es zu einer nativen Systemfähigkeit machen und mehr APIs für Entwickler öffnen. Visuell wird die Designsprache Material 3 Expressive verwendet und die Anpassung an Tablets, Wearables und XR-Geräte verstärkt. Das mit Spannung erwartete Android XR-Betriebssystem wird erstmals vorgestellt; es nutzt ebenfalls Gemini als zentrale Interaktions-Engine und zielt darauf ab, Realität und Virtualität zu verbinden. Die Google AI-Brille und das in Zusammenarbeit mit Samsung entwickelte Project Moohan MR-Gerät werden voraussichtlich ebenfalls präsentiert und Googles Engagement bei KI-Assistenten und offenen XR-Ökosystemen demonstrieren. (Quelle: 雷科技)

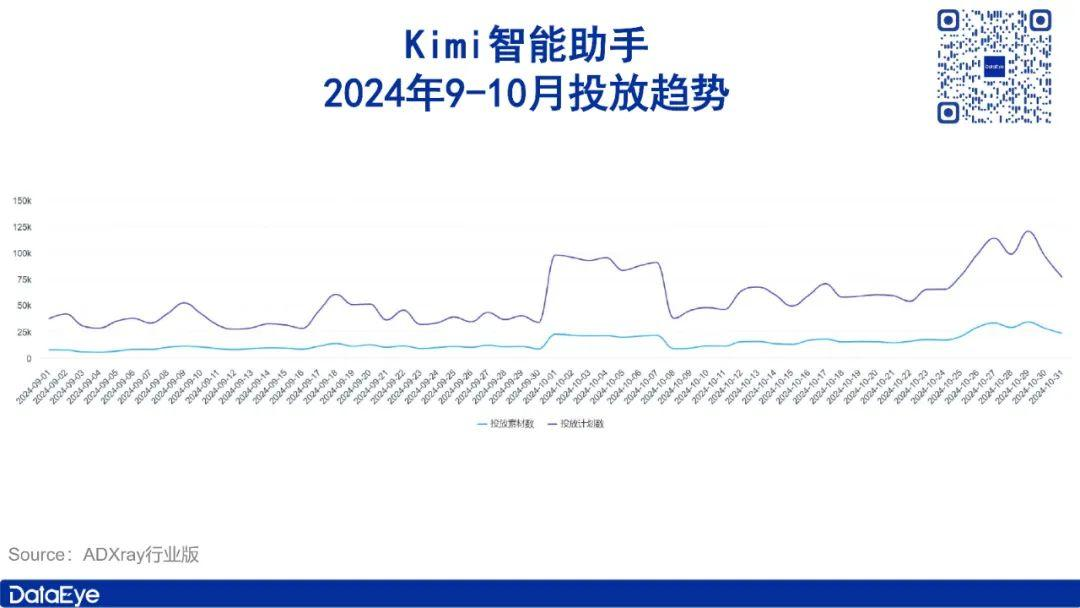

Moonshot AI (月之暗面) testet intern Community-Funktion für Kimi als Reaktion auf Wettbewerb: Angesichts des Drucks durch Modelle wie DeepSeek testet Moonshot AI intern eine Content-Community-Funktion für seinen KI-Assistenten Kimi. Die Community befindet sich derzeit in der Gray-Testphase, Inhalte werden hauptsächlich durch KI gecrawlt und generiert, und Kanäle aus vertikalen Bereichen werden zur Teilnahme eingeladen. Sie bietet Interaktionsfunktionen wie Likes und Kommentare. Dieser Schritt wird als Innovation auf Anwendungsebene von Moonshot AI angesehen, um durch ein Content-Ökosystem einen Differenzierungsvorteil gegenüber dem technischen Wettbewerbsdruck von DeepSeek aufzubauen. Zuvor war Kimi aufgrund seiner Fähigkeit zur Verarbeitung langer Texte und seines Marketings ein Starprodukt im C-End-KI-Markt, wurde aber später von DeepSeek und Tencent Yuanbao (腾讯元宝) in Bezug auf Nutzerzahlen überholt. (Quelle: 司库财经)

OpenAI plant Veröffentlichung eines neuen Open-Source-Modells diesen Sommer: Laut TechCrunch plant OpenAI, diesen Sommer ein neues Open-Source-Großsprachmodell mit einer freizügigen Lizenz zu veröffentlichen, das kostenlosen Download und kommerzielle Nutzung erlaubt. Das Modell soll die Leistung bestehender Open-Source-Modelle von Meta (Llama) und DeepSeek übertreffen und könnte eine „Handoff“-Funktion enthalten: Wenn das Open-Source-Modell auf Schwierigkeiten stößt, kann es das Cloud-basierte Großmodell von OpenAI zur Unterstützung aufrufen. Dieser Schritt wird als bedeutende Wende in OpenAIs Open-Source-Strategie angesehen, um Entwickler anzuziehen, die Wettbewerbsfähigkeit zu steigern und sein KI-Ökosystem zu vervollständigen. (Quelle: 智东西)

MCP-Protokoll fördert Entwicklung des AI-Agent-Ökosystems, steht aber vor kommerziellen Herausforderungen: Das MCP (Model Communication Protocol) zielt darauf ab, die Interaktion von KI-Modellen mit externen Werkzeugen/Diensten zu standardisieren und die Integrationskomplexität zu vereinfachen (von M×N auf M+N), und wird als „USB-C-Schnittstelle“ für KI-Anwendungen bezeichnet. Die erfolgreiche Demonstration von Manus Agent und die Unterstützung von MCP durch Giganten wie OpenAI (auch chinesische Anbieter wie Alibaba, Tencent, Baidu sind gefolgt) haben seine Verbreitung und die Entwicklung des Agent-Ökosystems erheblich gefördert. Jedoch bauen viele Anbieter, während sie MCP übernehmen, oft „geschlossene“ Ökosysteme auf (z. B. Alibaba Cloud integriert AutoNavi, Tencent Cloud bindet WeChat Read an), um ihre eigenen Daten- und Ökosystemvorteile zu schützen. Dies könnte zu einer Fragmentierung des Ökosystems führen und MCP daran hindern, ein wirklich universeller Standard zu werden. Das zukünftige Agent-Ökosystem könnte eine „begrenzt offene“ Struktur aufweisen, wobei MCP eher als „Ökosystem-Konnektor“ denn als einziger Standard fungiert. (Quelle: 产业家)

Preiskampf bei großen Modellen hält an, Baidus Li Yanhong bezeichnet DeepSeek als „langsam und teuer“: Baidu veröffentlicht die Modelle Wenxin 4.5 Turbo und X1 Turbo und betont deren besseres Preis-Leistungs-Verhältnis gegenüber DeepSeek. Li Yanhong weist darauf hin, dass DeepSeek nicht nur in seinen Fähigkeiten eingeschränkt ist (hauptsächlich Textverarbeitung), sondern auch hohe Aufrufkosten und langsame Geschwindigkeit aufweist. Der Preis für Wenxin 4.5 Turbo liegt unter dem Aktionspreis von DeepSeek V3, der Preis für X1 Turbo entspricht dem Aktionspreis von DeepSeek R1, liegt aber weit unter dessen Standardpreis. Neue Modelle wie ByteDance Doubao und Google Gemini Flash reagieren ebenfalls mit Niedrigpreisstrategien. Der Artikel argumentiert jedoch, dass Preis-Leistungs-Verhältnis allein nicht zum Sieg ausreicht; der Erfolg von DeepSeek liege hauptsächlich in technischen Innovationen wie Chain-of-Thought, die ein einzigartiges Erlebnis böten. Inländische Modelle haben relativ begrenzte Monetarisierungswege (API-Gebühren), während ausländische (wie OpenAI) über vielfältigere Modelle wie C-End-Abonnements verfügen. (Quelle: 直面AI)

Zehn Jahre Höhen und Tiefen in der KI-Pharmaindustrie, konfrontiert mit Kommerzialisierungs- und Technologieherausforderungen: Die KI-Pharmaindustrie entwickelt sich seit über zehn Jahren mit dem Ziel, die Effizienz der Medikamentenentwicklung zu steigern und Kosten durch KI zu senken. Die jüngste Abschaffung der Tierversuchspflicht durch die FDA begünstigt alternative Methoden wie KI-Modellierung. Die Branche erlebte einen Kapitalboom (Höhepunkt 2021), trat aber nach dem Scheitern einiger Pipelines in der klinischen Phase (z. B. BenevolentAI) und dem Abflauen des Kapitals in eine Anpassungsphase ein. Führende Unternehmen wie XtalPi (晶泰科技) (AI+CRO) expandierten nach dem Börsengang in Bereiche wie AI+Neue Materialien, um schnellere kommerzielle Erträge zu erzielen; Insilico Medicine (英矽智能) hält am Modell „Eigenentwicklung + License Out“ fest und hat bereits mehrere Lizenzvereinbarungen abgeschlossen. Die Branche steht weiterhin vor Herausforderungen wie schwieriger Datenbeschaffung (Pharmaunternehmen teilen Kerndaten nicht), langen Algorithmus-Validierungszyklen und dem Fehlen zugelassener Medikamente. Technologische Durchbrüche wie AlphaFold und generative KI bringen jedoch neue Hoffnung, und die Branche erwartet den „Wendepunkt“ durch das erste erfolgreich zugelassene, KI-entwickelte Medikament. (Quelle: 亿欧网)

ModelBest (面壁智能) On-Device-Großmodell treibt intelligentes Cockpit an, Serienreife im Fahrzeug in zehn Monaten erreicht: ModelBest stellt den intelligenten Cockpit-Assistenten cpmGO vor, der von seinem On-Device-Großmodell MiniCPM angetrieben wird und bereits in neuen Fahrzeugen von Chang’an Mazda in Serie gegangen ist – in nur 10 Monaten Entwicklungszeit. cpmGO läuft rein lokal, gewährleistet Datenschutz, erreicht Reaktionszeiten im Millisekundenbereich und ist nicht netzwerkabhängig. Es verfügt über multimodale Wahrnehmungs- (Bild, Sprache, UI) und Interaktionsfähigkeiten, unterstützt „See and Speak“-Bedienung und ein integrierter, rein clientseitiger GUI Agent kann Bildschirmoperationen verstehen und ausführen. ModelBest kooperiert bereits mit mehreren Chip- und Tier1-Herstellern wie Qualcomm, MediaTek, Intel und Thundercomm (中科创达), um die Anwendung von On-Device-KI im Automobilbereich voranzutreiben. Ziel ist es, die Kosten-, Latenz- und Datenschutzprobleme von Cloud-Lösungen zu lösen und ein flüssigeres, sichereres intelligentes Cockpit-Erlebnis zu ermöglichen. (Quelle: 量子位)

Shanghai AI for Science Institute nutzt KI, um Forschungsparadigmen in vielen Bereichen zu verändern: Das Shanghai AI for Science Institute (上智院) treibt in Zusammenarbeit mit der Fudan University und anderen Hochschulen und gestützt auf die CFFF KI-Rechenplattform (40 PFlop/s Rechenleistung) die Forschung in Bereichen wie Biowissenschaften, Meteorologie, Materialwissenschaft, Medizin, Klima sowie Geistes- und Sozialwissenschaften mittels KI voran. Zu den Ergebnissen gehören: Das Wetter-Großmodell „扶摇“ (Fuyao) ermöglicht städtische Wettervorhersagen auf Kilometer- und Sekundenebene; das Lebenswissenschafts-Großmodell „女娲“ (Nüwa) beschleunigt die siRNA-Medikamentenentwicklung; das Material-Großmodell „燧人“ (Suiren) erforscht neue Materialien und Wirkstoffentdeckung; in Zusammenarbeit mit dem Zhongshan Hospital wurde das kardiovaskuläre Fach-Großmodell „观心CardioMind“ entwickelt; das Klima-Großmodell PI@Climate integriert multidisziplinäres Wissen zur Bewältigung des Klimawandels; der VI-CNOPs-Algorithmus optimiert probabilistische Vorhersagen von Taifun-Zugbahnen; das Großmodell zur chinesischen Zivilisation unterstützt Archäologie und Paläographie-Forschung; sowie Durchbrüche bei grundlegenden KI-Technologien wie föderiertem Lernen, Multimodalität und Graph Learning, die gemeinsam ein offenes, kollaboratives Ökosystem für wissenschaftliche Intelligenz aufbauen. (Quelle: 量子位)

🧰 Werkzeuge

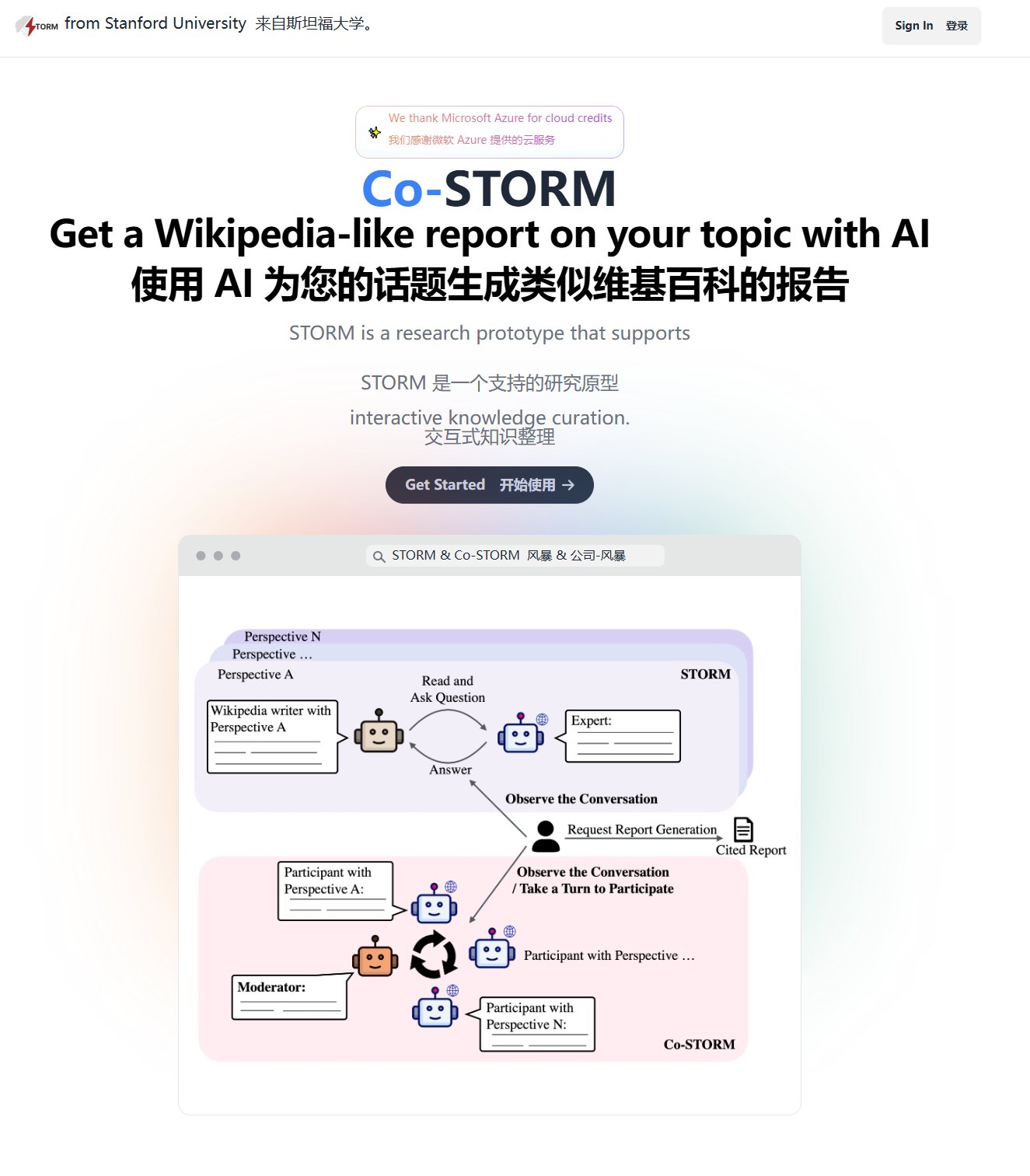

Stanford University veröffentlicht Open-Source-KI-Berichterstellungstool Storm: Storm ist ein KI-Tool, das automatisch Websuchen durchführt, Informationen zusammenführt und strukturierte Berichte im Stil von Wikipedia generiert. Der Nutzer gibt ein Thema ein, und Storm simuliert den Arbeitsablauf eines Forschers: Planung der Forschungsskizze, Suche nach relevanten Informationsquellen, Zusammenführung von Informationen und Verfassen des Berichts. Dies ist sehr hilfreich für Nutzer, die schnell Hintergrundberichte, Literaturübersichten oder Tiefenanalysen erstellen müssen. Das Projekt ist auf GitHub Open Source verfügbar und bietet eine Online-Testversion. (Quelle: karminski3)

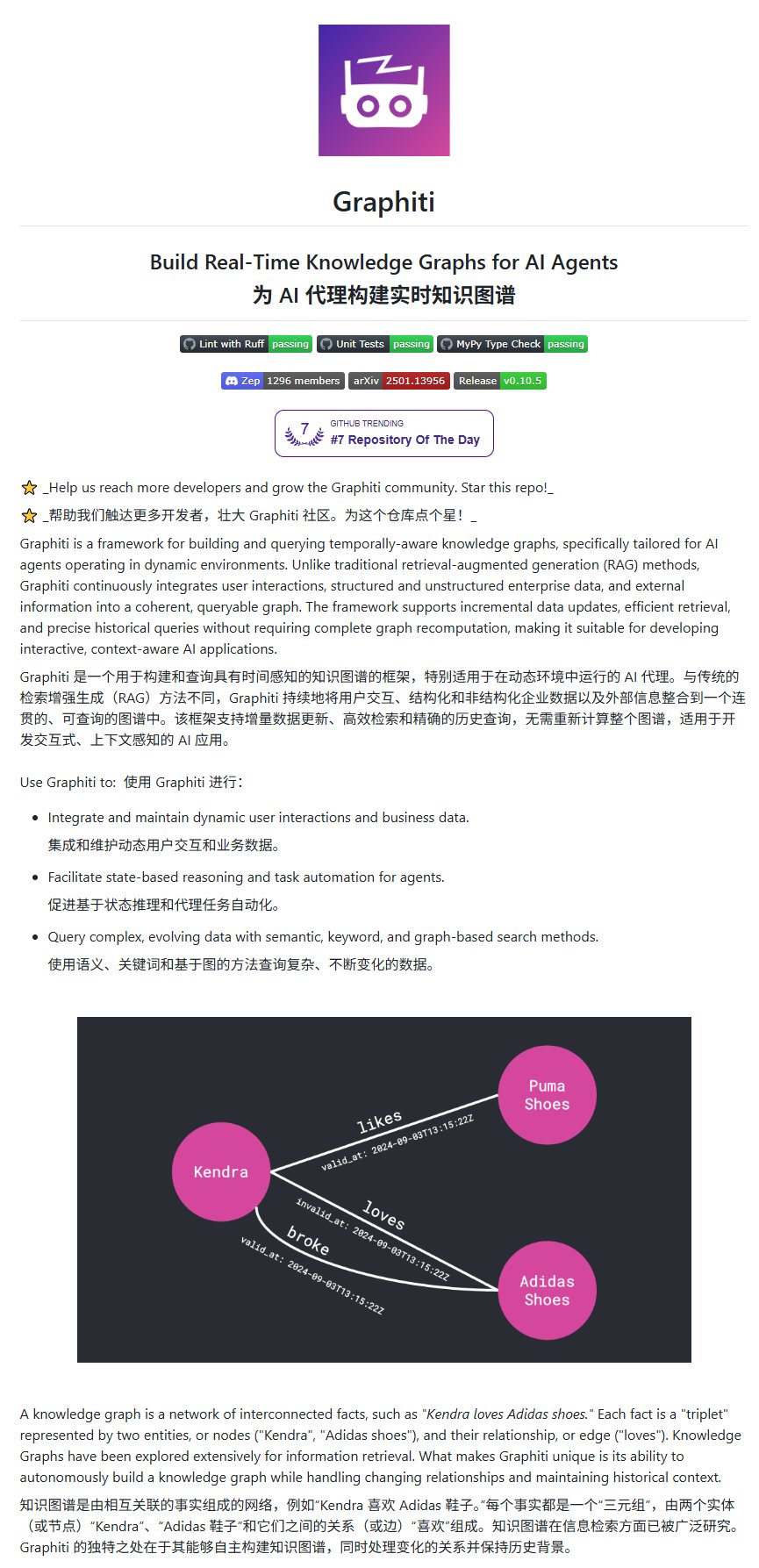

Open-Source-Wissensgraph-Framework Graphiti veröffentlicht: Graphiti ist ein Framework, das Nutzerinteraktionen, strukturierte/unstrukturierte Daten und externe Informationen kontinuierlich in einen abfragbaren Wissensgraphen integrieren kann. Seine Merkmale sind die Unterstützung inkrementeller Aktualisierungen und effizienter Abfragen, ohne den gesamten Graphen neu berechnen zu müssen. Es eignet sich besonders für die Entwicklung interaktiver KI-Anwendungen, die Kontextsensitivität und Nachverfolgung erfordern. Das Projekt hat auf GitHub bereits hohe Aufmerksamkeit erlangt (4.4K Sterne). (Quelle: karminski3)

Lovable 2.0 Update verbessert KI-Website-Erstellungserlebnis: Das KI-Website-Erstellungstool Lovable hat Version 2.0 veröffentlicht, die Funktionen wie kollaborative Bearbeitung durch mehrere Nutzer, automatische Sicherheitsscans, einen um das 10-fache verbesserten intelligenten Chat-Agenten, einen Entwicklermodus zur direkten Codebearbeitung in der Anwendung und Unterstützung für benutzerdefinierte Domains hinzufügt. Gleichzeitig wurden der Markenauftritt und das UI-Design aktualisiert, um ein leistungsfähigeres, sichereres und kollaborativeres KI-gestütztes Website-Entwicklungserlebnis zu bieten. (Quelle: op7418)

ByteDance „即梦“ (Jimeng) Videomodell-Upgrade verbessert Multi-Shot-Konsistenz: ByteDances Video-Generierungstool „即梦“ (Jimeng) hat ein 3.0-Modellupdate veröffentlicht. Laut von Nutzern geteilten Beispielen zeigt das neue Modell bei der Generierung von Multi-Shot-Videos in einem Durchgang eine hervorragende Konsistenz von Charakteren und Szenen, und dieser Konsistenzeffekt ist stabil reproduzierbar. Das Modell unterstützt Text-zu-Video- und Bild-zu-Video-Modi und verbessert die Praxistauglichkeit und Qualität der KI-Videoerstellung erheblich. (Quelle: op7418)

WAN Video tritt in die Kommerzialisierungsphase ein, bietet aber weiterhin kostenlosen Service: Die KI-Video-Generierungsplattform WAN Video kündigt den Eintritt in die Kommerzialisierungsphase an, führt aber gleichzeitig einen kostenlosen „Relax mode“ ein, der unbegrenzte kostenlose Generierungen ermöglicht. Von Nutzern geteilte Beispiele zeigen die Ergebnisse bei der Generierung von Lego-Soldaten-Kriegsszenen; obwohl die Prompts anspruchsvoll sind, sind die Ergebnisse akzeptabel. Dies bietet Nutzern die Möglichkeit, KI-Video-Generierungsfähigkeiten kostenlos zu testen und zu nutzen. (Quelle: dotey)

MiniMax TTS an MCP-Server angebunden, vereinfacht multimodale Anwendungsentwicklung: MiniMax stellt seine leistungsstarken chinesischen TTS- (Text-zu-Sprache) und Stimmklon-Fähigkeiten sowie Text-zu-Bild/Video- und Bild-zu-Video-Tools über den Open-Source-MCP-Server (Model Communication Protocol Server) zur Verfügung. Nutzer können diese Werkzeuge einfach in MCP-unterstützenden Clients wie Cursor aufrufen, um kreative Anwendungen wie die Generierung von Hörspielen mit verteilten Rollen oder das Klonen von Elon Musks Stimme zum Erzählen von Geschichten zu realisieren. Das MCP-Protokoll vereinfacht die Integration von KI-Modellen und Werkzeugen und senkt die Entwicklungshürden. (Quelle: 袋鼠帝AI客栈)

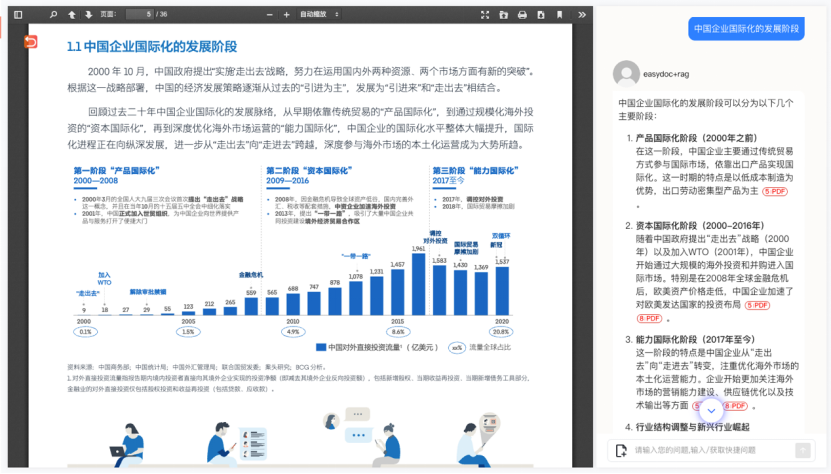

EasyDoc: Intelligente Dokumentenanalyse-Engine, optimiert für RAG: EasyDoc bietet einen API-Dienst zur Analyse von Dokumenten wie PDF, Word, PPT und gibt sie im für LLMs geeigneten JSON-Format aus. Sein Vorteil liegt in der intelligenten Erkennung von Inhaltsblöcken, der Analyse der Dokumentenhierarchie (unter Beibehaltung der Eltern-Kind-Beziehungen) und der tiefgehenden Interpretation von Tabellen- und Bildinhalten (Bereitstellung strukturierter Daten und semantischen Verständnisses). Dies löst effektiv Schwachpunkte bei der Dokumentenvorverarbeitung für RAG-Anwendungen, wie komplexe gemischte Text-Bild-Layouts oder ungenaue Tabellenextraktion. Es werden die Modi Lite, Pro und Premium sowie ein kostenloses Testkontingent angeboten, und Private Deployment wird unterstützt. (Quelle: AI进修生)

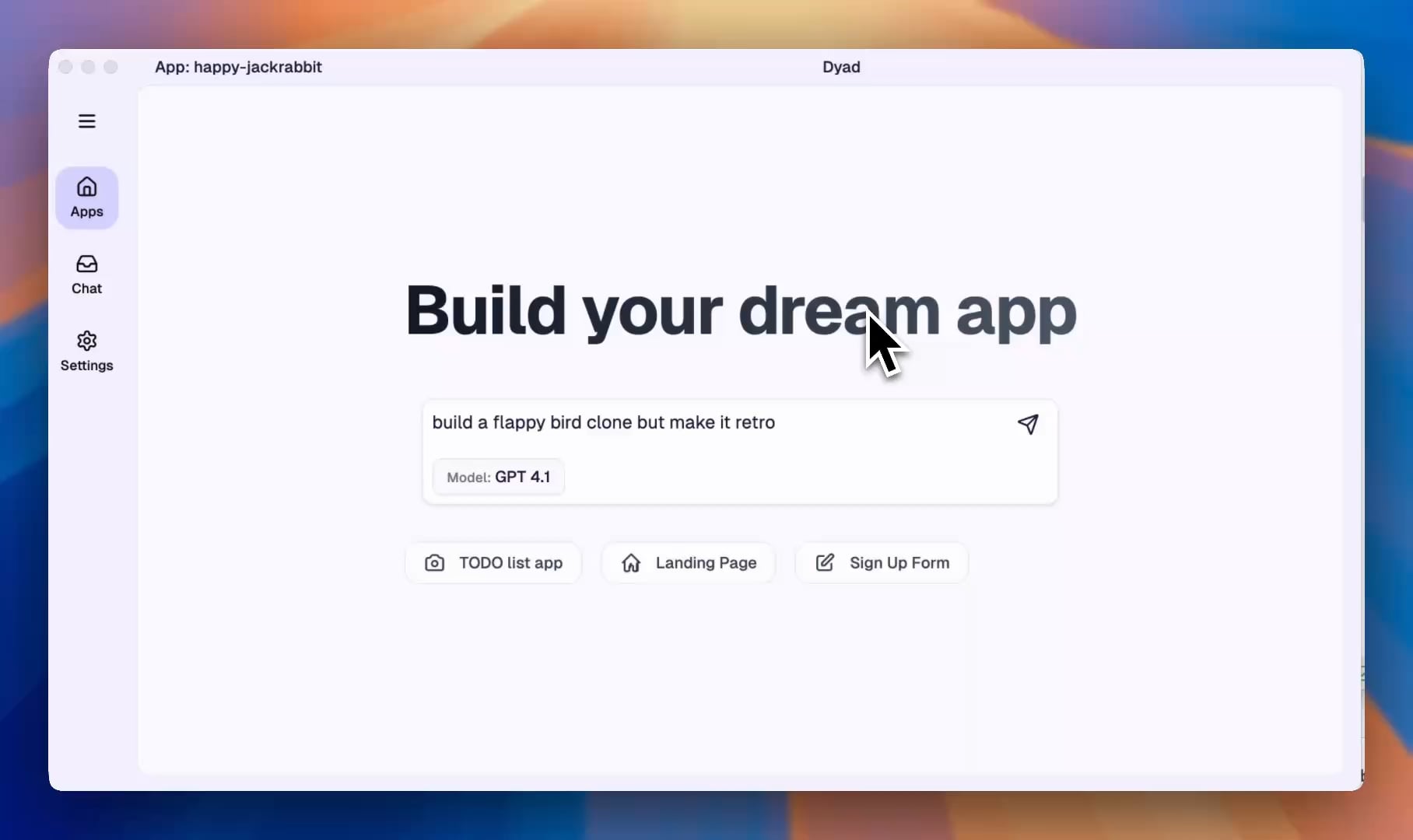

Dyad: Lokaler, Open-Source-KI-Anwendungs-Builder: Dyad ist ein kostenloses, Open-Source-Tool zum Erstellen von KI-Anwendungen, das lokal ausgeführt werden kann und als Alternative zu Plattformen wie v0, Lovable, Bolt positioniert ist. Es ermöglicht die Entwicklung auf dem lokalen Computer, was die Kombination mit IDEs (wie Cursor) erleichtert. Die neueste Version fügt die Integration von Ollama hinzu und unterstützt die Erstellung mit lokalen großen Sprachmodellen. Nutzer können kostenlose API-Schlüssel (wie Gemini) für die Entwicklung verwenden. (Quelle: Reddit r/LocalLLaMA)

📚 Lernen

Infinigence (无问芯穹) teilt Trends und Praktiken der AI Infra: Liu Chuanlin, Chief Solutions Architect bei Infingence, teilte auf der AI Partner Konferenz Trends und Praktiken der KI-Infrastruktur. Er wies darauf hin, dass mit der Erschöpfung der Vortrainingsdaten Reinforcement Learning (wie das DeepSeek R1-Paradigma) zum Schlüssel für die Leistungssteigerung von Modellen wird, was neue Herausforderungen an die Infra stellt. Infingence nutzt seine Fähigkeiten zur Hardware-Software-Optimierung, um eine Rechenplattform aufzubauen, die diverse heterogene heimische Chips unterstützt. Durch eigenentwickelte Trainingsframeworks, optimierte Kommunikationseffizienz und dynamische Ressourcenzuweisung passt es sich den Anforderungen des Trainings von LLMs und MoE-Modellen an und unterstützt das Training multimodaler Modelle wie die von Shengshu Technology (生数科技). Gleichzeitig wurde für Inferenzszenarien das Deployment von DeepSeek R1 optimiert und durch schnittstellenbasierte Dienste auf Basis von ComfyUI das Problem der AIGC-Traffic-Schwankungen gelöst, um die Kosten für KI-Anwendungen zu senken. (Quelle: 36氪)

DAMO Academy veröffentlicht Open-Source-Architektur DyDiT: Rechenleistung halbiert, Qualität der visuellen Generierung ohne Verlust: Die DAMO Academy und andere Institutionen stellten auf der ICLR 2025 die dynamische Architektur DyDiT vor, die darauf abzielt, die Inferenz-Effizienz von DiT (Diffusion Transformer)-Modellen zu optimieren. DyDiT kann die Zuweisung von Rechenressourcen dynamisch an den Zeitschritt des Generierungsprozesses und den räumlichen Bereich des Bildes anpassen, wodurch der Rechenaufwand in einfachen Schritten oder Hintergrundbereichen reduziert wird. Experimente zeigen, dass DyDiT mit nur geringen Fine-Tuning-Kosten die Inferenz-FLOPs des DiT-XL-Modells um 51 % reduzieren und die Geschwindigkeit um das 1,73-fache erhöhen kann, während die Qualität der generierten Bilder (FID-Metrik) nahezu unverändert bleibt. Die Methode ist Open Source und soll für weitere Text-zu-Bild/Video-Modelle angepasst werden. (Quelle: 量子位)

UniToken: Vereinheitlichte visuelle Kodierungslösung zur Integration von Verständnis und Generierung: Die Fudan University und Meituan (美团) stellen das UniToken-Framework vor, das darauf abzielt, die Repräsentationslücke und Trainingsinterferenz zwischen Bild-Text-Verständnis- und Bildgenerierungsaufgaben in multimodalen großen Modellen zu überwinden. UniToken fusioniert kontinuierliche (SigLIP) und diskrete (VQ-GAN) visuelle Encoder, um nachgelagerten Aufgaben eine einheitliche visuelle Repräsentation zu bieten, die sowohl hochrangige Semantik als auch grundlegende Details umfasst. Durch eine mehrstufige Trainingsstrategie (visuell-semantische Abstimmung, gemeinsames Multi-Task-Training, Instruktions-Fine-Tuning) und kombiniert mit feingranularen visuellen Verbesserungstechniken (AnyRes, ViT-Fine-Tuning) erreicht UniToken in mehreren Benchmarks SOTA- oder nahezu SOTA-Leistung. Code und Modell sind Open Source. (Quelle: 量子位)

Tsinghua et al. schlagen Test-Time Reinforcement Learning TTRL vor: Als Reaktion auf die begrenzte Generalisierungsfähigkeit bestehender Test-Time Scaling (TTS)-Techniken bei neuen Datenverteilungen und das Fehlen von Belohnungssignalen beim Test-Time Training (TTT) schlagen die Tsinghua University und das Shanghai AI Lab TTRL vor. Diese Methode kann ohne gelabelte Daten das Vorwissen des Modells nutzen, um durch Mehrheitsentscheidungen und andere Methoden Pseudo-Labels und Belohnungssignale zu generieren und damit LLMs mittels Reinforcement Learning zu trainieren. Experimente zeigen, dass TTRL die Modellleistung bei verschiedenen Aufgaben kontinuierlich verbessern kann, z. B. die pass@1-Metrik von Qwen-2.5-Math-7B auf AIME 2024 um 159 % steigern, wobei die Leistung der von überwacht trainierten Modellen nahekommt. (Quelle: AINLPer)

SJTU & Ant Group schlagen hybriden Aufmerksamkeitsmechanismus Rodimus* vor: Um das Problem der hohen Raum-Zeit-Komplexität durch den KV-Cache bei der Transformer-Inferenz zu lösen, schlagen die Shanghai Jiao Tong University (SJTU) und die Ant Group die Rodimus-Modellreihe vor. Diese Architektur verbessert die Zustandsaktualisierung der linearen Aufmerksamkeit durch einen datengesteuerten temperaturgesteuerten Auswahlmechanismus (DDTS) und kombiniert dies mit Sliding Window Shared Key Attention (SW-SKA), um Semantik-, Token- und Head-Kompression effektiv zu integrieren. Rodimus erreicht bei der Inferenz eine O(1)-Raumkomplexität. Die auf dieser Architektur basierenden leichtgewichtigen Code-Modelle Rodimus+-Coder (1.6B und 4B) erreichen bei gleicher Größe SOTA-Leistung. Das Paper wurde für die ICLR 2025 angenommen, der Code ist Open Source. (Quelle: AINLPer)

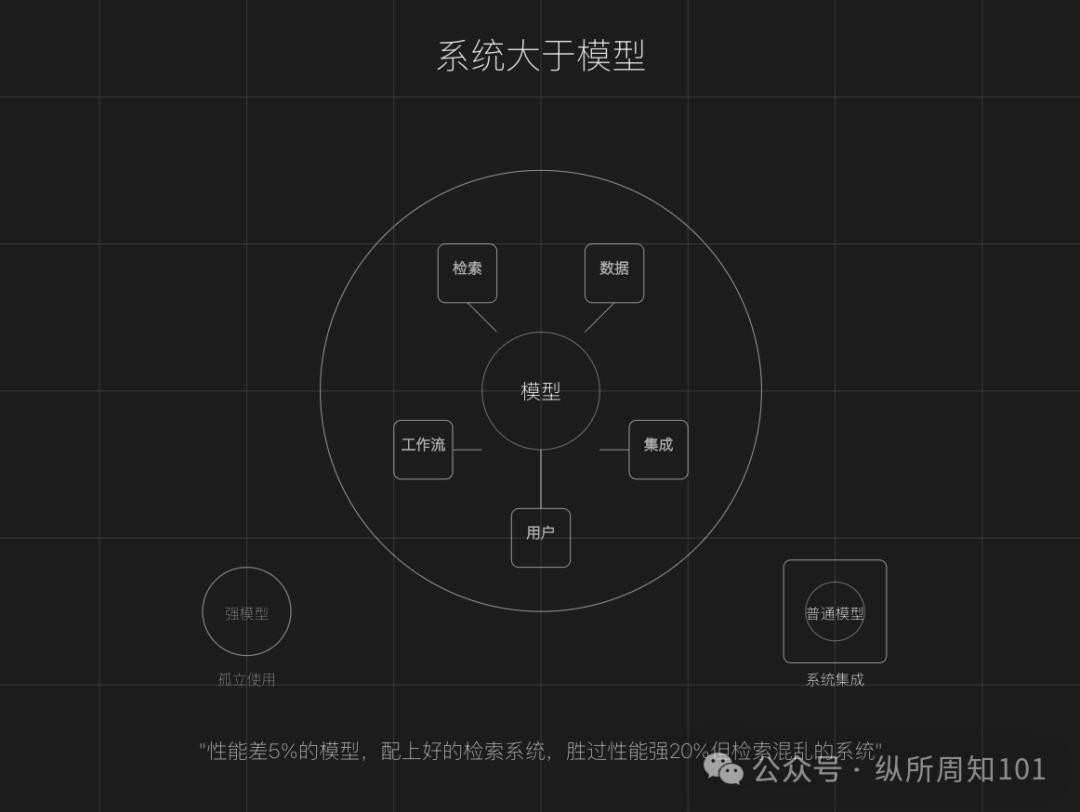

Zehn Lektionen aus dem Deployment von RAG Agents: Douwe Kiela, Gründer von Contextual AI, teilt Erfahrungen aus dem Deployment von RAG Agents: 1. Systemfähigkeit ist wichtiger als Modellleistung; 2. Internes Fachwissen ist der Treibstoff für den Kernwert; 3. Die Fähigkeit, großskalige, verrauschte Daten zu verarbeiten, ist ein Wettbewerbsvorteil; 4. Die Umsetzung in der Produktionsumgebung ist weitaus schwieriger als Pilotprojekte; 5. Geschwindigkeit geht vor Perfektion, schnelle Iteration; 6. Ingenieurszeit ist wertvoll, Fallstricke bei Low-Level-Optimierungen vermeiden; 7. Nutzungshürden senken, in bestehende Systeme einbetten; 8. „Wow“-Momente schaffen, um die Nutzerbindung zu erhöhen; 9. Beobachtbarkeit (Attribution, Audit) ist wichtiger als Genauigkeit; 10. Ziele hoch stecken, Kerngeschäft herausfordern. (Quelle: AI觉醒)

💼 Geschäftliches

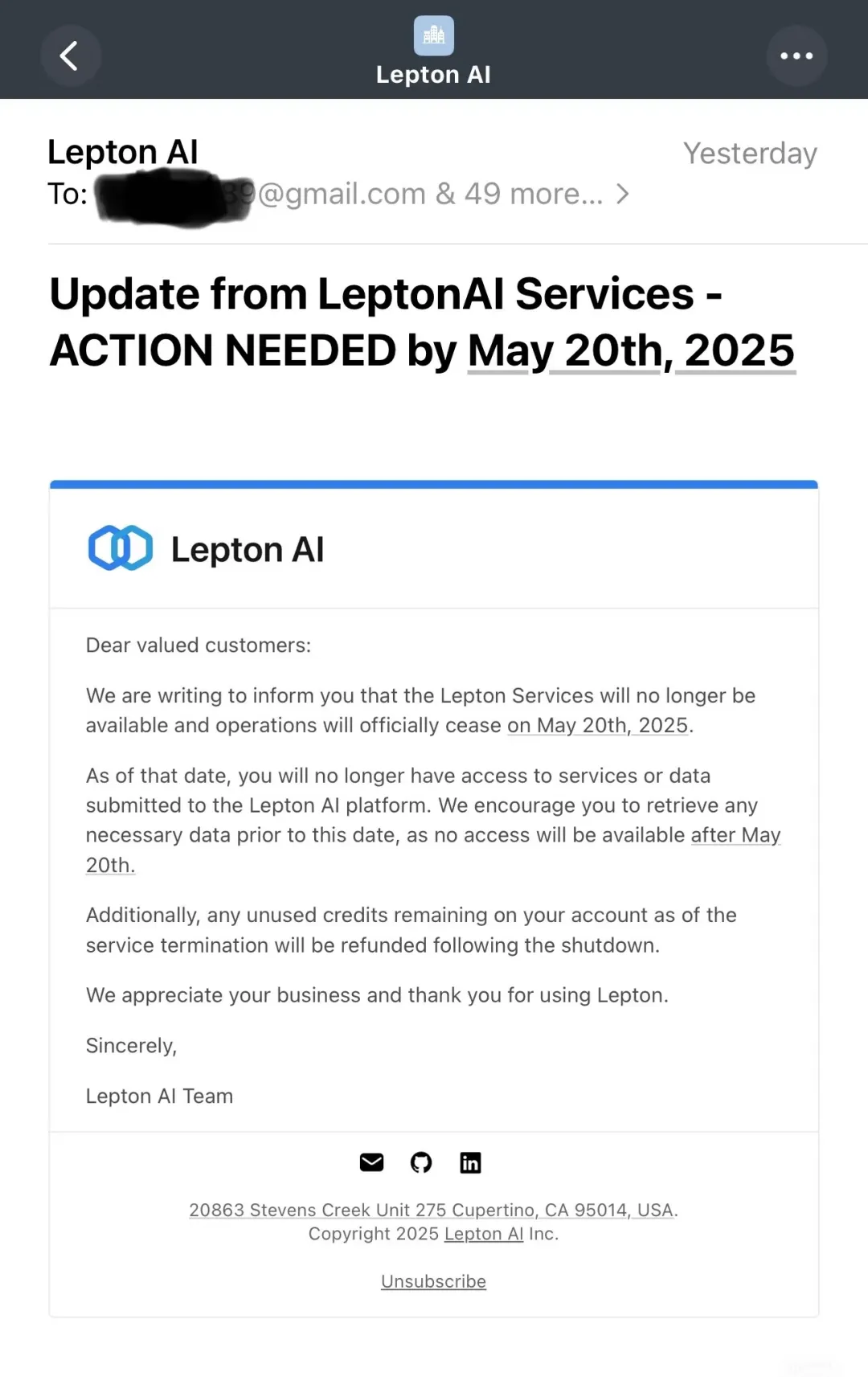

Nvidia stellt Betrieb von Lepton AI nach Übernahme ein: Nvidia hat nach der Übernahme des von Jia Yangqing und Bai Junjie gegründeten AI-Cloud-Plattform-Unternehmens Lepton AI angekündigt, den Betrieb der Lepton AI-Plattform zum 20. Mai 2025 einzustellen und die Registrierung neuer Nutzer bereits gestoppt. Jia Yangqing antwortete, die Transaktion sei „kein Acqui-Hire“, gab aber keine weiteren Details preis. Lepton AI war spezialisiert auf Cloud-Dienste für die Entwicklung, das Training und das Deployment von KI-Modellen sowie die Vermietung von Rechenleistung und stand in Konkurrenz zu einigen Nvidia-Kunden (wie CoreWeave). Diese Übernahme und die nachfolgenden Schritte könnten Nvidias Bestreben widerspiegeln, die vertikale Integration der KI-Lieferkette (von Chips bis zu Diensten) zu stärken und seine Vormachtstellung im Bereich AI Computing auszubauen. (Quelle: AI前线)

Investoren-Roundtable auf der AI Partner Konferenz: Suche nach der Gewissheit bei KI-Super-Apps: Auf der 36Kr AI Partner Konferenz diskutierten Investoren wie Wu Nan von Jinshajiang United Capital, Zou Zejiong von Shanghai Industrial Investment und Ren Bobing von Sinovation Ventures die Investitionslogik für KI-Super-Apps. Die Investoren sind der Meinung, dass trotz Unsicherheiten bei der zugrundeliegenden Technologie und der Marktlandschaft sichere Chancen in vertikalen Anwendungen liegen, die praktische Probleme lösen, Product-Market-Fit finden und Umsatz generieren, wie z.B. AI+Medizin, AI+Bildung, autonomes Fahren. Startups sollten sich im Wettbewerb mit großen Tech-Unternehmen auf vertikale Bereiche konzentrieren und Barrieren durch Nischenszenarien und tiefgreifendes Know-how aufbauen, die große Unternehmen schwer abdecken können. Gleichzeitig benötigen Gründer interdisziplinäre Fähigkeiten und effiziente Entscheidungsfähigkeit und müssen sich auf Teambuilding und die Validierung des Geschäftsmodells konzentrieren. Der Erfolg von DeepSeek inspiriert Investoren, auf technologiegetriebene, beständige Teams zu achten, die Talentpotenzial erschließen können. (Quelle: 36氪)

Kapitalmarkt-Pinnwand: Asset-Transaktionsinformationen im Bereich KI und Robotik: Die 160. Ausgabe der 36Kr Kapitalmarkt-Pinnwand enthält mehrere Kauf- und Verkaufsangebote für Vermögenswerte im Zusammenhang mit KI und Robotik. Zu den Verkaufsangeboten gehören LP-Anteile an Fonds, die Anteile an Zhiyuan Robot (智元机器人), CloudMinds (云深处科技) und Wofei Changkong (沃飞长空) (eVTOL-bezogen) halten. Kaufgesuche umfassen Anteile an Unternehmen wie ByteDance (字节跳动), Galaxy Universal (银河通用), Unitree Technology (宇树科技), CloudMinds (云深处科技), Zhiyuan Robot (智元机器人), Moore Threads (摩尔线程), Star.Vision (星动纪元). Darüber hinaus besteht eine allgemeine Kaufnachfrage im Bereich humanoider Roboter. Diese Transaktionshinweise spiegeln das derzeit starke Interesse des Kapitalmarktes an führenden Unternehmen in den Bereichen KI, humanoide Robotik, autonomes Fahren, Halbleiter und andere Hard-Tech-Bereiche wider. (Quelle: 36氪)

Chinesisches Agent-Unternehmen Manus AI erhält über 500 Mio. RMB Finanzierung, Bewertung verfünffacht: Laut Bloomberg hat Butterfly Effect, die Muttergesellschaft des allgemeinen AI-Agent-Produkts Manus, eine neue Finanzierungsrunde über 75 Millionen US-Dollar (ca. 550 Mio. RMB) abgeschlossen, angeführt vom Silicon Valley VC Benchmark. Die Post-Money-Bewertung beträgt fast 500 Millionen US-Dollar. Manus Agent kann autonom Web-Aufgaben wie Ticketbuchung und Aktienanalyse ausführen und erregte zuvor Aufmerksamkeit durch teure Beta-Zugangscodes. Die neue Finanzierung soll zur Erweiterung der Dienstleistungen auf Märkte wie die USA, Japan und den Nahen Osten verwendet werden; ein Büro in Japan ist geplant. Obwohl das Produkt begehrt ist, führt die Abhängigkeit vom Anthropic Claude-Modell zu hohen Kosten (durchschnittlich 2 US-Dollar pro Aufgabe) und das Unternehmen steht vor Serverkapazitätsbeschränkungen. (Quelle: 智东西, 硅兔君)

Tuya Smart (涂鸦智能) wandelt sich zur AI-Agent-Plattform und erobert den AI-Hardwaremarkt: Die AIoT-Cloud-Plattform Tuya Smart hat das TuyaOpen Open-Source-Framework, die Haidewei Edge-Computing-Plattform, Tuya.AI und eine aktualisierte AI-Agent-Entwicklungsplattform veröffentlicht und setzt damit voll auf KI. Das Unternehmen ist der Ansicht, dass große KI-Modelle (insbesondere multimodale Interaktion, Effizienz auf Expertenniveau, verteilte Entscheidungsfähigkeit) die Nutzungshürden für intelligente Hardware erheblich senken und die Verbreitung in der Branche fördern können. Die Tuya AI Agent-Plattform ist bereits an gängige globale große Modelle angebunden und hilft Kunden bei der Entwicklung von Erfolgsprodukten wie intelligenten Ringen und KI-Puppen. Sie arbeitet auch mit Kidswant (孩子王) und anderen zusammen, um tragbare intelligente KI-Hardware voranzutreiben. Das Unternehmen erwartet, dass 2025 das Jahr des Durchbruchs für neue KI-Hardware sein wird und seine AI-Agent-Strategie in 2-3 Jahren Früchte tragen wird. (Quelle: 36氪)

🌟 Community

Missstände bei KI-Schulungskursen: Falschwerbung und zweifelhafte Wirkung: Soziale Medien sind überflutet von Werbeanzeigen für Schulungskurse zum Thema „schnell reich werden mit KI“, die behaupten, dass normale Menschen durch das Erlernen von KI-Malerei, Modell-Fine-Tuning usw. schnell Geld verdienen können. Tatsächliche Erfahrungen und Kundenfeedback decken jedoch zahlreiche Probleme auf: unklare oder sogar gefälschte Qualifikationen der Dozenten (z. B. falsche Identität des Coverhero-Gründers); Kursinhalte, die nicht den Werbeversprechen entsprechen und das Ziel „Aufträge erhalten und monetarisieren“ schwer erreichbar machen; Einsatz von Verknappungsmarketing und gefälschten Fallbeispielen, um zum Kauf zu verleiten; Schwierigkeiten bei der Rückerstattung. Brancheninsider weisen darauf hin, dass solche Kursinhalte oft zu theoretisch oder oberflächlich sind und normale Menschen durch Kurzzeitschulungen kaum die KI-Fähigkeiten erwerben können, die für einen Berufswechsel oder ein stabiles Einkommen ausreichen. Nutzern wird empfohlen, kostenlose Ressourcen und Community-Lernen zu nutzen und vor teuren Schnellkurs-Fallen vorsichtig zu sein. (Quelle: 新周刊)

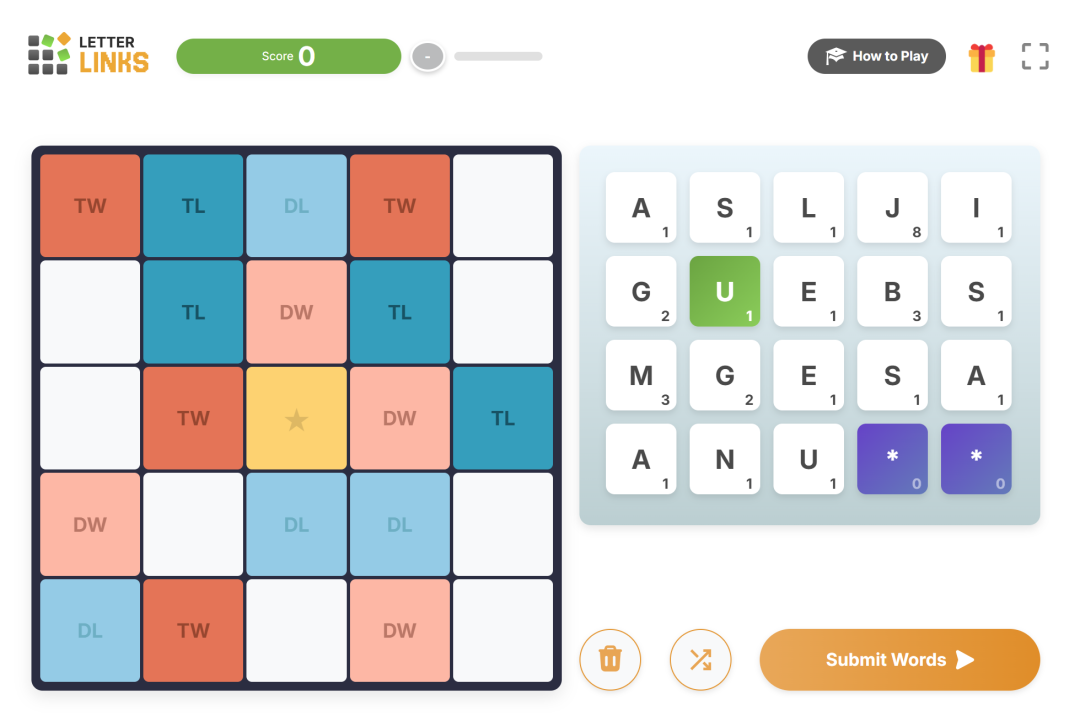

Entwickler vergleicht Programmiererfahrung mit Claude und Gemini 2.5 + Cursor: Ein Entwickler teilt seine Erfahrungen bei der Entwicklung eines Buchstabierspiels mit Claude und Gemini 2.5 Pro + Cursor. Die Nutzung der Claude API kostete 417 US-Dollar und die Erfahrung war schlecht: Das Kontextfenster ging leicht verloren, was dazu führte, dass das Modell häufig „sein Gedächtnis verlor“; beim Beheben von Fehlern wurden oft neue Probleme verursacht; die Korrektheit des Codes konnte nicht überprüft werden. Im Vergleich dazu war die Erfahrung mit dem kostenlosen Gemini 2.5 Pro (integriert über Cursor) deutlich besser: keine Kosten; stärkeres Kontextverständnis (dank der von Cursor übermittelten Dateistruktur); der Interaktionsablauf ähnelte eher dem Pair Programming; der Debugging-Prozess war rationaler. Das Fazit ist, dass die Kombination aus Gemini 2.5 + Cursor eine praktischere und effizientere KI-gestützte Programmiererfahrung bietet. (Quelle: CSDN)

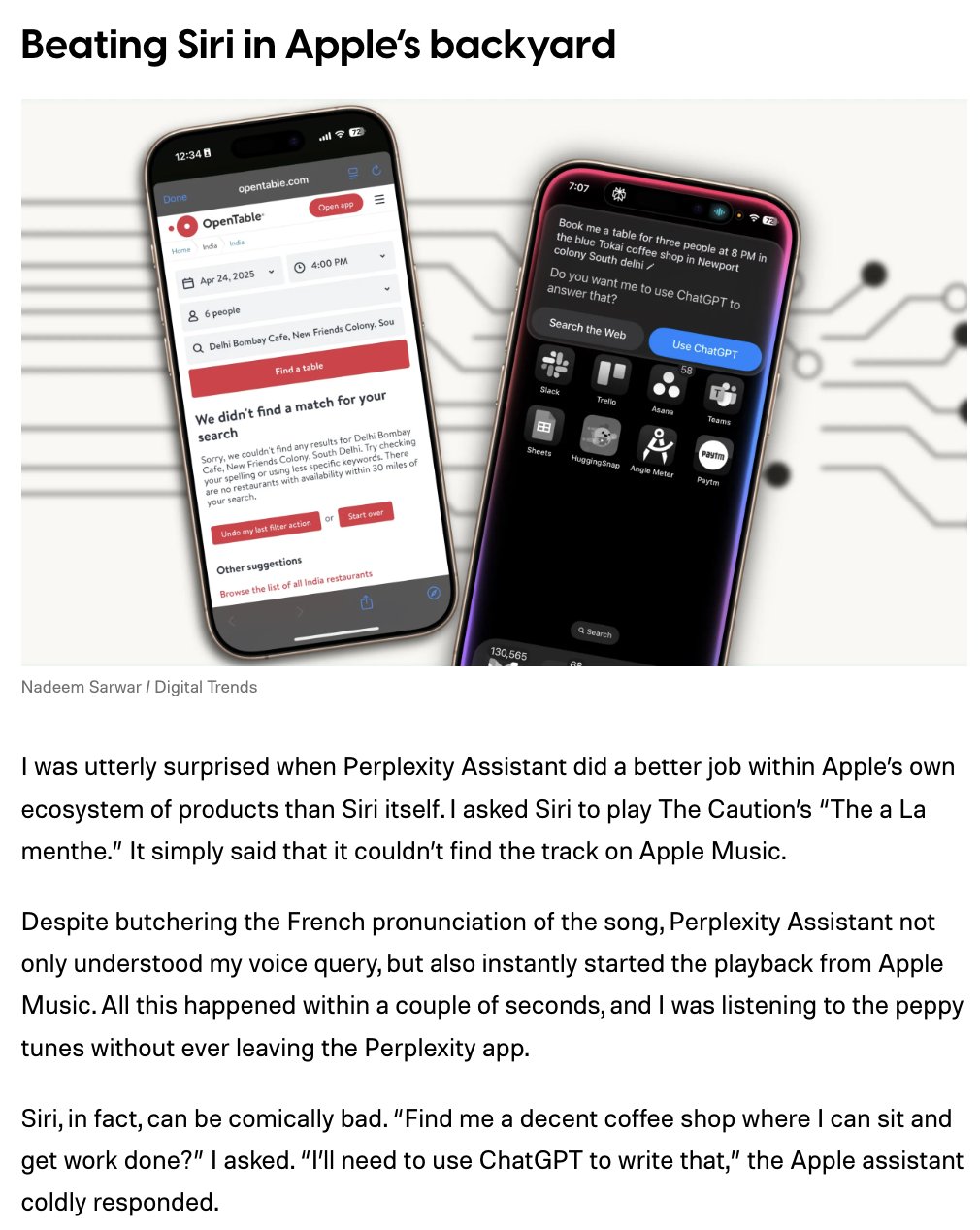

Perplexity iOS-Assistent erhält erste positive Bewertungen: Der CEO von Perplexity leitet Nutzerkommentare weiter, die zeigen, dass sein iOS-KI-Assistent in frühen Tests gut abschneidet. Die Kommentare heben hervor, dass die Leistung des Assistenten im Apple-Ökosystem sogar die von Siri übertrifft, beispielsweise bei Aufgaben wie dem Abspielen spezifischer YouTube-Videos basierend auf Sprachbefehlen, wo er genauer ist. Dies deutet darauf hin, dass der Perplexity-Assistent gewisse Vorteile beim Verstehen von natürlichsprachlichen Absichten und beim Ausführen von app-übergreifenden Aktionen hat. (Quelle: AravSrinivas)

Reddit-Diskussion: KI-generierte vs. echte Fotos erkennen: Ein Reddit-Nutzer startet eine Diskussion und zeigt 5 ähnliche Frauenfotos, von denen eines echt ist und die anderen KI-generiert sind, und fordert zur Identifizierung auf. Im Kommentarbereich wird lebhaft diskutiert; Nutzer analysieren Aspekte wie Licht und Schatten, Hauttextur, Details von Accessoires (wie Halskettenketten), aber die Meinungen gehen auseinander. Dies spiegelt das hohe Niveau der aktuellen KI-Bildgenerierungstechnologie und die Schwierigkeit wider, Echtheit zu erkennen. (Quelle: Reddit r/ChatGPT)

Reddit-Diskussion: ChatGPT generiert seltsame Bilder: Mehrere Nutzer teilen auf Reddit, dass sie bei der Aufforderung an ChatGPT, spezifische Bilder zu generieren (z. B. „Karte der USA“), unerwartet Bilder von Nuklearexplosionen (Atompilz) oder andere nicht zusammenhängende Bilder (z. B. R2D2) erhalten haben. Dies löste Diskussionen über Modellstabilität und potenzielle Verzerrungen aus; es ist unklar, ob es sich um zufällige Fehler des Modells handelt oder ob spezifische Prompts die Anomalie auslösen. (Quelle: Reddit r/ChatGPT)

Reddit-Diskussion: Macht KI Softwareentwickler süchtig?: Ein Softwareentwickler postet auf Reddit, dass KI-Tools (wie Programmierassistenten) seine Arbeitseffizienz und -qualität erheblich verbessert haben, er nach der Nutzung schwer aufhören kann und sich etwas „süchtig“ fühlt. Im Kommentarbereich wird darüber diskutiert: Einige meinen, dies sei eher eine Abhängigkeit von effizienten Werkzeugen, ähnlich der Abhängigkeit von Compilern statt Assembler, und ein natürliches Ergebnis der Produktivitätssteigerung; andere stimmen zu, dass ein „Sucht“-Risiko bestehen könnte, und befürchten, dass übermäßige Abhängigkeit zu Kompetenzverlust führen könnte. Sie empfehlen bewussten „KI-Detox“ oder das Beibehalten grundlegender Fähigkeitsübungen. (Quelle: Reddit r/ArtificialInteligence)

Reddit-Diskussion: KI-Religionen und Verehrungsphänomene: Nutzer diskutieren, ob KI zu einer Religion oder einem Objekt der Verehrung werden könnte. Argumente umfassen: Es gibt bereits einen „AI Jesus“; Diskussionen über KI-Bewusstsein könnten zum Glauben führen; Denkströmungen wie Longtermism weisen quasi-religiöse Züge auf; LLMs können personalisierten spirituellen Trost und Anleitung bieten. In den Kommentaren werden reale Fälle erwähnt (wie das Nova-Protokoll von jrprudence.com) und das Potenzial und die Risiken von KI bei der Befriedigung menschlicher spiritueller Bedürfnisse sowie die Sorge vor „KI-Kulten“ diskutiert. (Quelle: Reddit r/ArtificialInteligence)

Reddit-Diskussion: KI-generierte Bilder können alte Fotos nicht „reparieren“: Nutzer beweisen durch Experimente, dass KI-Tools wie ChatGPT bei der Bearbeitung alter Fotos diese nicht wirklich reparieren oder die Auflösung verbessern, sondern basierend auf dem Originalbild ein völlig neues, ähnliches Bild generieren. Beim Testen mit Fotos von Prominenten (wie Samuel L Jackson) war das generierte Ergebnis offensichtlich eine andere Person, nur Stil und Pose waren ähnlich. Dies weist Nutzer darauf hin, die Fähigkeitsgrenzen der KI-Bildverarbeitung richtig zu verstehen: Sie ist besser im „Kreieren“ als im „Restaurieren“. (Quelle: Reddit r/ChatGPT)

💡 Sonstiges

Zitatensammlung der AI Partner Konferenz: 36Kr hat eine Zusammenfassung der interessantesten Standpunkte der Redner der AI Partner Konferenz 2025 zusammengestellt und veröffentlicht. Diese Standpunkte drehen sich um Themen wie die zukünftige Entwicklung von KI-Super-Apps, Branchenwandel und die Neugestaltung der Geschäftslogik und spiegeln die aktuellen Gedanken von KI-Fachexperten und Branchenpionieren wider. (Quelle: 36氪)

VAE als erste Nation, die KI zum Entwurf von Gesetzen einsetzt: Laut The Hill haben die Vereinigten Arabischen Emirate begonnen, künstliche Intelligenz zur Unterstützung beim Entwurf von Gesetzestexten einzusetzen. Dieser Schritt markiert die erste Anwendung von KI im Bereich der Gesetzgebung und könnte darauf abzielen, die Effizienz der Gesetzgebung zu verbessern oder komplexe Vorschriften zu analysieren. Diese Nachricht löste Diskussionen über die Rolle von KI in der Governance aus, beispielsweise ob sie die Abhängigkeit von traditionellen politischen Akteuren reduzieren kann. (Quelle: Reddit r/ArtificialInteligence)

Anthropic startet Forschungsprojekt zum „Wohlbefinden von KI-Modellen“: Anthropic hat eine neue Initiative angekündigt, die darauf abzielt, das „Wohlbefinden“ (model welfare) von KI-Modellen zu untersuchen. Obwohl dieser Bereich umstritten ist (einige Experten glauben, Modelle hätten keine subjektiven Empfindungen oder Werte), könnte dieser Schritt von Anthropic darauf abzielen, verantwortungsvollere und ethischere Methoden der Modellentwicklung und -interaktion zu erforschen oder zu untersuchen, wie „unerwünschte“ Zustände oder Verhaltensweisen, die Modelle während des Trainings oder der Interaktion entwickeln könnten, bewertet und gemildert werden können. (Quelle: Reddit r/ClaudeAI)

Hoher Wasserbedarf von KI erregt Aufmerksamkeit: Ein Bericht der US-Regierung und Medien (404media) weisen darauf hin, dass das Training und der Betrieb großer KI-Modelle große Mengen an Wasserressourcen verbrauchen, hauptsächlich für die Kühlung von Rechenzentren. Dies löst Bedenken hinsichtlich der Umweltkosten der KI-Entwicklung aus, besonders in wasserarmen Regionen. (Quelle: Reddit r/artificial)