كلمات مفتاحية:الحوسبة الكمية, خوارزميات الذكاء الاصطناعي, هندسة المحولات (Transformer), تنظيم الذكاء الاصطناعي, تطورات أعمال الذكاء الاصطناعي, أخلاقيات الذكاء الاصطناعي, عتاد الذكاء الاصطناعي, تقييم نماذج الذكاء الاصطناعي, خوارزمية جوجل الكمية Willow, طبقة اللاوعي الحر للمحولات من ميتا, آلية الانتباه الكامن متعدد الرؤوس DeepSeek-V2, كرت الشاشة AMD Radeon AI PRO R9700, طبقة الأمان لتوليد الأكواد بالذكاء الاصطناعي Corridor

🔥 تركيز

خوارزمية Google الكمومية تتفوق على الحواسيب الفائقة: تزعم Google أن خوارزميتها الكمومية الجديدة قد تفوقت في الأداء على الحواسيب الفائقة، مما يبشر بتسريع اكتشاف الأدوية وتطوير مواد جديدة. يكمن جوهر هذا الاختراق في شريحة Willow الخاصة بها. وعلى الرغم من أن التطبيقات العملية للحوسبة الكمومية لا تزال بحاجة إلى سنوات، إلا أن هذا التقدم يمثل علامة فارقة مهمة في هذا المجال، وينذر بإمكانات هائلة للبحث العلمي المستقبلي. (المصدر: MIT Technology Review)

Reddit تقاضي محرك البحث AI Perplexity: رفعت Reddit دعوى قضائية ضد محرك البحث AI Perplexity، متهمة إياه بالاستيلاء غير القانوني على بيانات Reddit لاستخدامها في تدريب النماذج. تسعى Reddit للحصول على أمر قضائي دائم لمنع مثل هذه الشركات من بيع بياناتها دون إذن، وقد أثارت هذه القضية نقاشًا واسعًا حول حماية حقوق النشر وشرعية استخدام البيانات في عصر AI. (المصدر: MIT Technology Review)

الخطة الخمسية الصينية: الاكتفاء الذاتي التكنولوجي ودور AI المحوري: أصدرت الصين خطة خمسية تهدف إلى تحقيق الاكتفاء الذاتي التكنولوجي، وتصنف أشباه الموصلات وAI كمجالات تطوير رئيسية. تؤكد هذه الخطوة عزم الصين الاستراتيجي على الاستقلال في مجال التكنولوجيا وسعيها للحصول على ميزة في المنافسة التجارية الدولية، مما أثار اهتمامًا عالميًا بسلاسل التوريد التكنولوجية والتغيرات في المشهد الجيوسياسي. (المصدر: MIT Technology Review)

OpenAI تخفف قواعد مناقشة الانتحار وتواجه دعوى قضائية: اتُهمت OpenAI بتخفيف قواعدها المتعلقة بمناقشة الانتحار مرتين لزيادة عدد مستخدمي ChatGPT، مما أدى إلى انتحار مراهق. رفع والدا الضحية دعوى قضائية، متهمين OpenAI بأن تغييراتها أضعفت حماية المستخدمين من الانتحار، مما أثار تساؤلات جدية حول أخلاقيات AI، وسلامة المستخدم، ومسؤولية المنصة. (المصدر: MIT Technology Review)

ماسسك يبني جيشًا من الروبوتات، و Optimus قد يصبح “جراحًا”: يعمل إيلون ماسك بنشاط على بناء جيش من الروبوتات، ويتصور أن روبوت Optimus الخاص به قد يصبح “جراحًا بارعًا” في المستقبل. أثارت هذه الرؤية نقاشًا واسعًا حول قدرات الروبوتات العامة، والثقة بين الإنسان والآلة، وتطبيقات AI في المجالات المهنية المعقدة، مما ينذر بمستقبل تلعب فيه تكنولوجيا الروبوتات دورًا أكثر أهمية في العالم الحقيقي. (المصدر: MIT Technology Review)

🎯 التطورات

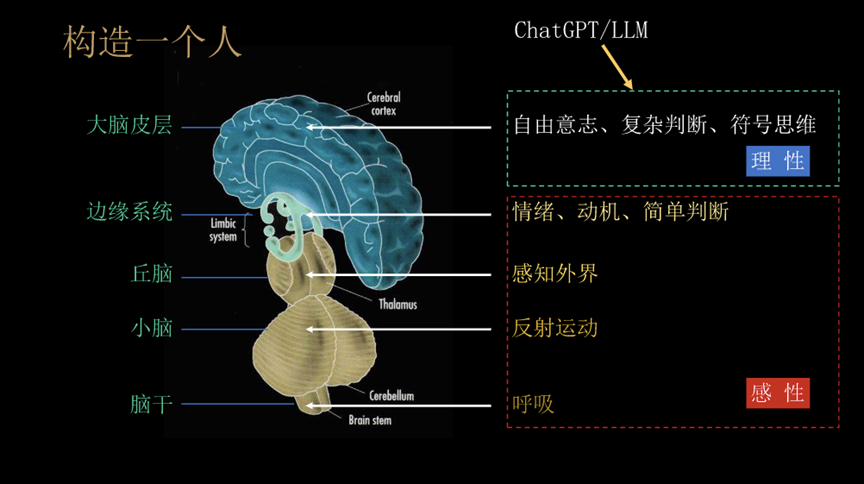

Meta تطلق “Free Transformer”: تعيد كتابة القواعد الأساسية لـ AI: أطلقت Meta نموذجًا جديدًا يسمى “Free Transformer”، الذي يكسر القواعد الأساسية لبنية Transformer التي استمرت 8 سنوات، وذلك من خلال إدخال “طبقة اللاوعي” لتحقيق التفكير المسبق قبل التوليد. هذا الابتكار يزيد من التكلفة الحسابية بنسبة 3% فقط، لكنه يحسن بشكل كبير أداء النموذج في الاستدلال والتوليد المنظم، متجاوزًا النماذج الأكبر حجمًا في اختبارات مثل GSM8K و MMLU، ويعتبر أول Transformer “ذو نية داخلية”. (المصدر: 36氪)

روبوتات Google DeepMind تحقق مبدأ “فكر ثم تصرف”: يتيح نموذج Gemini Robotics 1.5 من Google DeepMind للروبوتات الانتقال من التنفيذ السلبي للأوامر إلى التفكير والاستدلال واتخاذ القرارات. تستطيع هذه الروبوتات شرح عمليات استدلالها، ونقل المعرفة عبر الآلات، ودمج الرؤية واللغة والحركة في حلقة تفكير موحدة، مما يبشر بدفع الذكاء في العالم الحقيقي والتعاون بين الإنسان والآلة إلى مرحلة جديدة. (المصدر: Ronald_vanLoon)

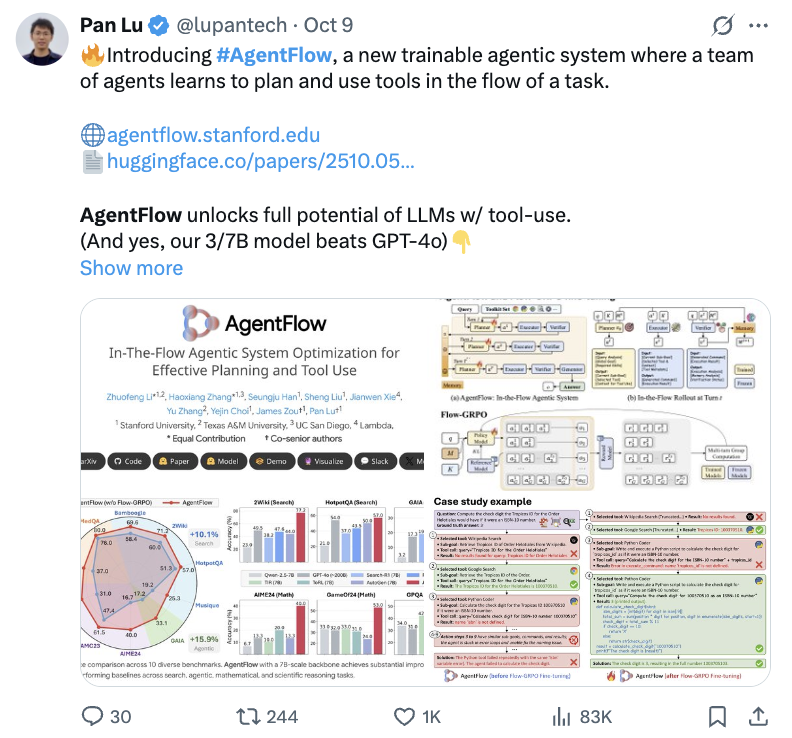

AgentFlow من ستانفورد يعزز قدرة الاستدلال للنماذج الصغيرة: قدم فريق ستانفورد نموذج AgentFlow الجديد، الذي يعزز أداء النماذج الصغيرة بحجم 7B في الاستدلال على المشكلات المعقدة، متجاوزًا حتى GPT-4o و Llama3.1-405B، وذلك من خلال التعلم المعزز عبر الإنترنت. يتكون AgentFlow من أربعة وكلاء متعاونين: المخطط، المنفذ، المدقق، والمولد، ويستخدم Flow-GRPO لتحسين المخطط في الوقت الفعلي، مما يحقق تحسينات كبيرة في مهام البحث، والوكلاء، والرياضيات، والعلوم. (المصدر: 36氪)

AI يكتشف خوارزمية MoE جديدة: كفاءة أعلى 5 مرات، وتكلفة أقل 26%: قدم فريق بحثي من جامعة كاليفورنيا، بيركلي، نظام ADRS، الذي يسمح لـ AI باكتشاف خوارزميات جديدة أسرع بخمس مرات وأقل تكلفة بنسبة 26% من الخوارزميات التي صممها البشر، وذلك من خلال دورة تكرارية “توليد-تقييم-تحسين”. بناءً على إطار عمل OpenEvolve، اكتشف AI طرقًا استدلالية ذكية في مهام مثل موازنة حمل MoE، مما أدى إلى تحسين كبير في كفاءة التشغيل، ويظهر الإمكانات الهائلة لـ AI في ابتكار الخوارزميات. (المصدر: 36氪)

Anthropic توسع استخدام Google TPU، وتعزز البنية التحتية لقوة حوسبة AI: أعلنت Anthropic عن خطط لتوسيع استخدامها لـ Google TPU، مما يضمن الحصول على حوالي مليون وحدة TPU وأكثر من 1 جيجاوات من السعة بحلول عام 2026. تظهر هذه الخطوة استثمار Anthropic الضخم في البنية التحتية لقوة الحوسبة لـ AI، وتعاونها العميق مع Google في مجال AI، مما ينذر بتوسع نطاق تدريب نماذج AI في المستقبل. (المصدر: Justin_Halford_)

آلية الانتباه الكامن متعدد الرؤوس (MLA) في DeepSeek-V2 تثير النقاش: أدت آلية الانتباه الكامن متعدد الرؤوس (MLA) التي قدمها DeepSeek-V2، والتي تقلل بشكل كبير من التعقيد عن طريق إسقاط المفاتيح والقيم في فضاء كامن، إلى نقاش أكاديمي حول سبب عدم ظهور هذا المفهوم من قبل. على الرغم من أن Perceiver استكشف أفكارًا مشابهة في عام 2021، إلا أن MLA لم يظهر حتى عام 2024، وقد يتطلب “تقنيات” معينة ليعمل بفعالية في الممارسة. (المصدر: Reddit r/MachineLearning)

إنشاء محتوى الفيديو بواسطة AI يصل إلى نقطة حرجة: وصل إنشاء محتوى الفيديو بواسطة AI إلى نقطة حرجة، حيث تظهر أعمال ناجحة بشكل متكرر، مثل إطلاق Sora 2 على منصة Synthesia، وحصول مقاطع الفيديو الموسيقية التي أنشأها AI على Bilibili (B站) حول “رحلة إلى الغرب” على ملايين المشاهدات. هذا يدل على الإمكانات الهائلة لـ AI في مجال توليد المحتوى الترفيهي، ويغير بسرعة مشهد إنشاء المحتوى. (المصدر: op7418)

Llion Jones، أحد مؤلفي ورقة “Attention Is All You Need”، يشعر “بالملل” من بنية Transformer: أعرب Llion Jones، أحد مؤلفي ورقة “Attention Is All You Need”، عن “ملله” من الاعتماد المفرط على بنية Transformer في مجال AI، معتبرًا أنها تعيق الاختراقات التكنولوجية الجديدة. وأشار إلى أنه على الرغم من الاستثمارات الضخمة في مجال AI، إلا أن الأبحاث أصبحت ضيقة بسبب ضغوط الاستثمار والمنافسة، مما قد يؤدي إلى تفويت الابتكار المعماري الكبير التالي. (المصدر: Reddit r/ArtificialInteligence)

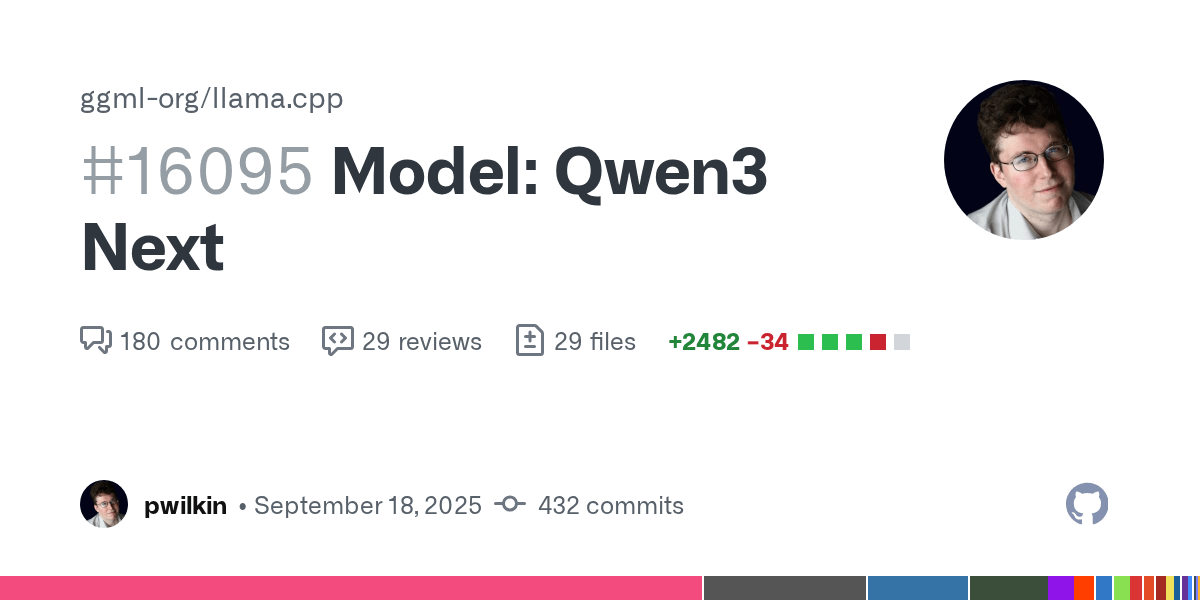

تقدم دعم نموذج Qwen3 Next في llama.cpp: أصبح دعم نموذج Qwen3 Next في llama.cpp جاهزًا لمراجعة الكود. على الرغم من أن هذا ليس الإصدار النهائي ولم يتم تحسينه للسرعة بعد، إلا أنه يمثل تقدمًا إيجابيًا من مجتمع المصادر المفتوحة لدمج النماذج الجديدة، وينذر بإمكانية تشغيل Qwen3 محليًا. (المصدر: Reddit r/LocalLLaMA)

نموذج GLM-4.6-Air لا يزال قيد التدريب: لا يزال نموذج GLM-4.6-Air قيد التدريب، ويستثمر الفريق جهودًا إضافية لتعزيز استقراره وموثوقيته. يعبر مجتمع المستخدمين عن ترقبه لذلك، ويفضلون الانتظار لفترة أطول للحصول على نموذج عالي الجودة، ويتساءلون عما إذا كان أداؤه سيتجاوز النماذج الحالية. (المصدر: Reddit r/LocalLLaMA)

DyPE: طريقة غير معتمدة على التدريب لتوليد صور انتشارية فائقة الدقة: قدمت ورقة بحثية من HuggingFace طريقة DyPE (Dynamic Positional Extrapolation)، وهي طريقة جديدة تمكن نموذج Transformer الانتشار المدرب مسبقًا من توليد صور بدقة تتجاوز بكثير دقة التدريب دون الحاجة إلى تدريب إضافي. يعزز DyPE بشكل كبير الأداء والدقة في العديد من الاختبارات المعيارية، خاصة عند الدقة العالية، وذلك من خلال التعديل الديناميكي لترميز الموضع في النموذج واستغلال التطور الطيفي لعملية الانتشار. (المصدر: HuggingFace Daily Papers)

نموذج “التواصل الفكري” للوكلاء المتعددين: قدمت ورقة بحثية من HuggingFace نموذج “التواصل الفكري”، الذي يتيح لأنظمة الوكلاء المتعددين التفاعل العقلي المباشر، متجاوزًا بذلك قيود اللغة الطبيعية. من خلال صياغة هذه الطريقة كنموذج متغير كامن، يمكن نظريًا تحديد الأفكار الكامنة المشتركة والخاصة بين الوكلاء، وقد تم التحقق من مزاياها التعاونية على معايير تركيبية وحقيقية. (المصدر: HuggingFace Daily Papers)

LALM يعاني من ثغرات أمنية تحت تأثير التغيرات العاطفية: كشفت دراسة لـ HuggingFace أن نماذج اللغة الصوتية الكبيرة (LALMs) تعاني من ثغرات أمنية كبيرة تحت تأثير التغيرات العاطفية للمتحدثين المختلفين. من خلال بناء مجموعة بيانات من الأوامر الصوتية الخبيثة، كشفت الدراسة أن مستويات استجابات LALMs غير الآمنة تختلف باختلاف العواطف وشدتها، حيث تكون التعبيرات العاطفية المتوسطة هي الأكثر خطورة، مما يؤكد ضرورة ضمان متانة AI عند النشر في العالم الحقيقي. (المصدر: HuggingFace Daily Papers)

OpenAI تصمم “خارطة طريق لقوة AI” مخصصة لليابان وكوريا الجنوبية: أصدرت OpenAI “خارطة طريق اقتصاد اليابان” و”خارطة طريق اقتصاد كوريا الجنوبية”، مما يشير إلى ترقية استراتيجيتها في آسيا والمحيط الهادئ من تصدير المنتجات إلى التعاون على المستوى الوطني. تقترح الخارطة استراتيجية مزدوجة “بناء القدرات السيادية + التعاون الاستراتيجي” وخطة ثلاثية المحاور “AI الشامل، البنية التحتية، التعلم مدى الحياة”، بهدف تسريع تطبيقات AI، وتحديث البنية التحتية لقوة الحوسبة، ومساعدة البلدين على أن يصبحا قوتين عالميتين في مجال AI. (المصدر: 36氪)

إطار عمل ExGRPO: نموذج جديد لتعلم الاستدلال للنماذج الكبيرة: قدم فريق مختبر شنغهاي لـ AI وغيره إطار عمل ExGRPO لإدارة الخبرة والتعلم، والذي يحسن قدرة الاستدلال للنماذج الكبيرة من خلال التحديد العلمي، التخزين، الفرز، والتعلم من الخبرات القيمة. يعزز ExGRPO الأداء بشكل كبير في المهام المعقدة مثل مسائل المسابقات الرياضية، ويكشف أن المشكلات ذات الصعوبة المتوسطة والمسارات ذات الانتروبيا المنخفضة هي مفتاح التعلم الفعال، متجنبًا مشكلة “التعلم ثم النسيان” في نمط RLVR التقليدي. (المصدر: 量子位)

🧰 الأدوات

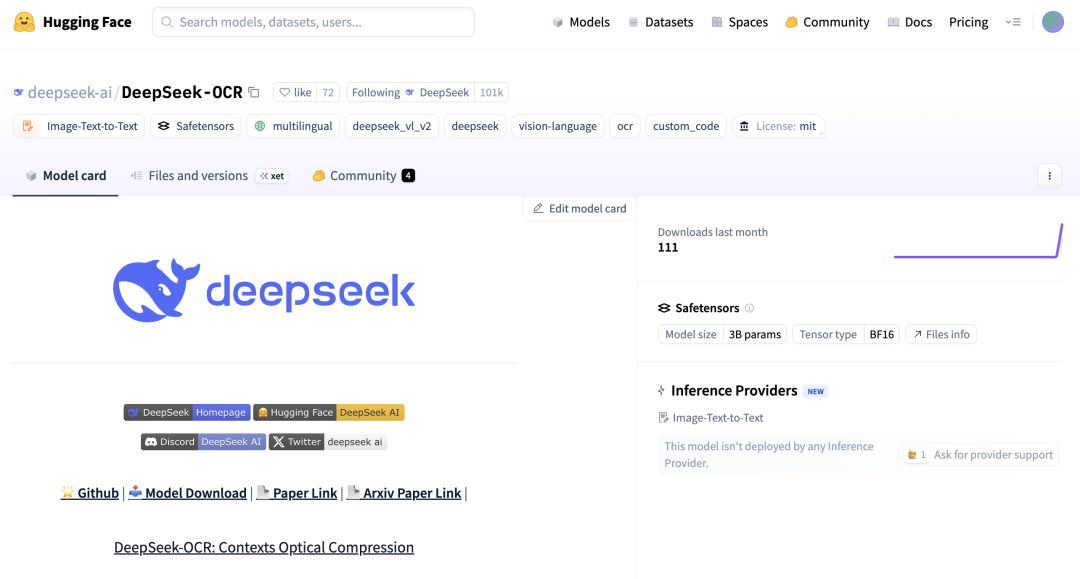

DeepSeek-OCR و Zhipu Glyph: اختراق في تقنية Visual Token: أطلقت DeepSeek نموذج DeepSeek-OCR مفتوح المصدر بـ 3 مليارات معلمة، مما يتيح لـ AI بطريقة مبتكرة “قراءة الصور” لضغط النصوص بصريًا، محققًا نسبة ضغط 10 أضعاف ودقة OCR تبلغ 97%. تبعتها Zhipu بإطلاق Glyph، الذي يقوم أيضًا بتحويل النصوص الطويلة إلى Visual Token على شكل صور، مما يقلل بشكل كبير من سياق LLM ويعزز كفاءة وسرعة المعالجة. حصلت هذه النماذج على الدعم في vLLM، مما يظهر الإمكانات الهائلة للنمط البصري في معالجة معلومات LLM. (المصدر: 36氪, 量子位, vllm_project, mervenoyann)

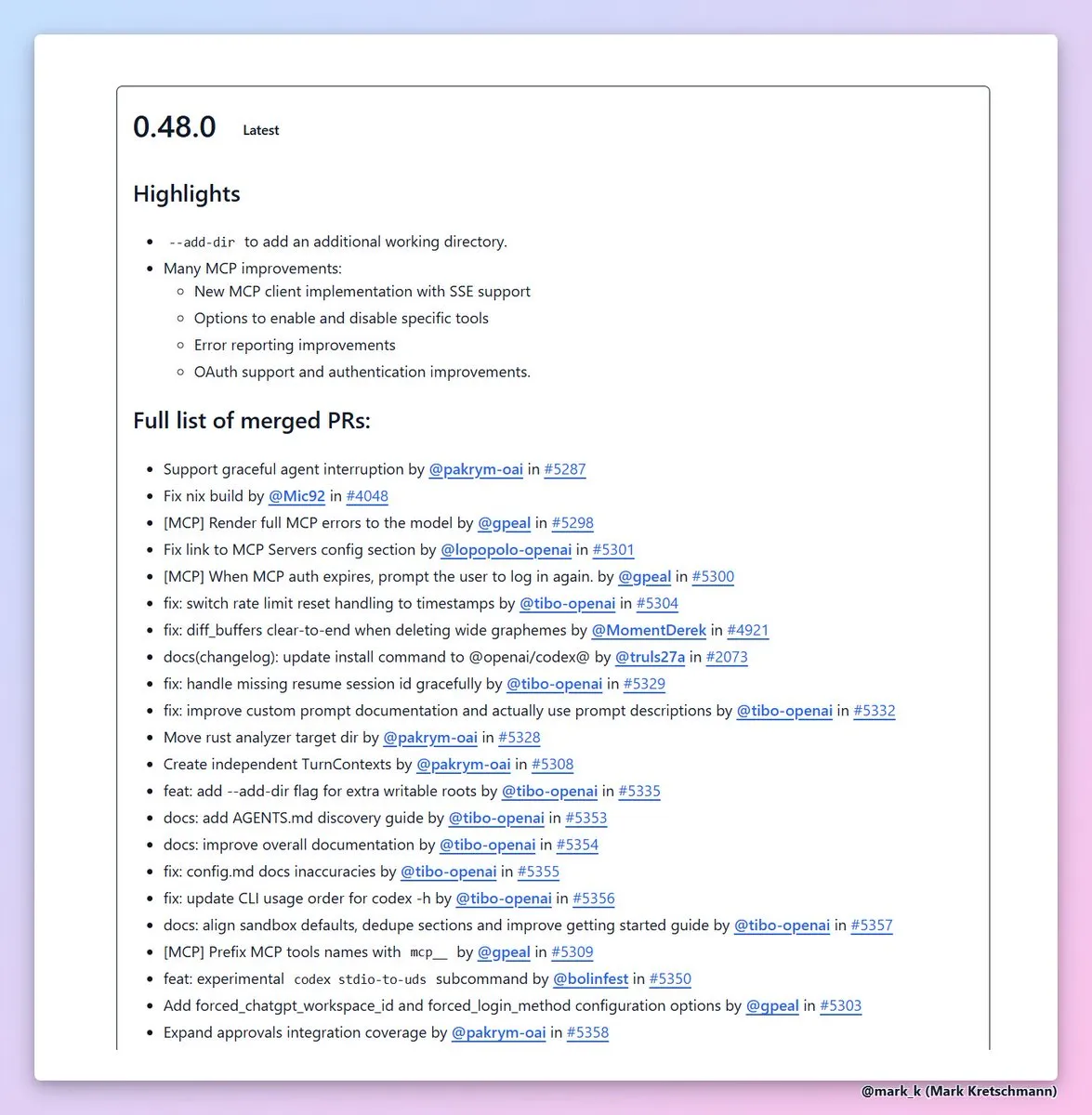

Codex CLI 0.48 يضيف ميزة --add-dir: أصدرت OpenAI الإصدار 0.48 من Codex CLI، وأهم ميزة فيه هي إضافة --add-dir، التي تسمح بإضافة أدلة أخرى إلى مساحة العمل الحالية. أدى ذلك إلى تحسين كبير في قابلية استخدام أدوات ترميز AI في مشاريع متعددة الملفات، وحسّن تجربة الإبلاغ عن الأخطاء والمصادقة لعملاء MCP، مما يسرع كفاءة هندسة البرمجيات. (المصدر: dotey, kevinweil)

إطلاق طبقة الأمان Corridor لتوليد كود AI: تم إطلاق طبقة الأمان Corridor رسميًا، لتوفير حماية أمنية في الوقت الفعلي لأدوات توليد كود AI مثل Cursor و Claude Code. Corridor هي أول أداة أمان تتزامن مع سرعة التطوير، ويمكنها فرض حواجز أمان في الوقت الفعلي، مما يضمن أمان الترميز بمساعدة AI، وتوفر فترة تجريبية مجانية لمدة أسبوعين. (المصدر: percyliang)

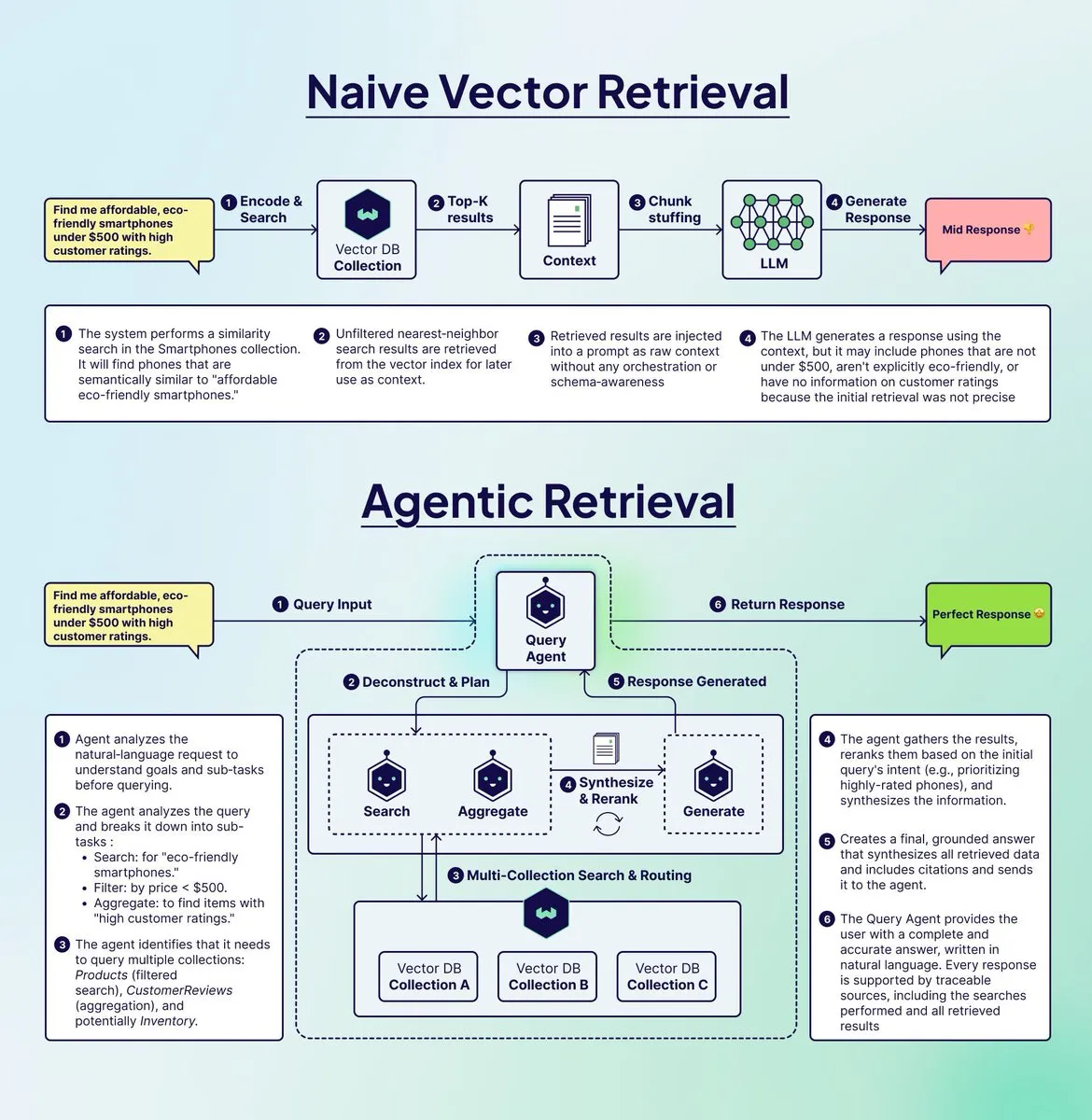

Weaviate تطلق Query Agent لتحسين نظام RAG: أطلقت Weaviate أداة Query Agent، بهدف حل مشكلة “الاحتيال” الموجودة في أنظمة RAG التقليدية عند معالجة الاستعلامات المعقدة متعددة الخطوات. يمكن لـ Query Agent تحليل الاستعلامات، وتوجيهها إلى مجموعات متعددة، وتطبيق المرشحات، وتجميع النتائج، لتقديم إجابات أكثر دقة وموثوقية. وهي متاحة الآن على Weaviate Cloud، مما يعزز بشكل كبير فعالية التوليد المعزز بالاسترجاع. (المصدر: bobvanluijt)

Argil Atom: نموذج AI للفيديو الأكثر قابلية للتحكم عالميًا: تم إطلاق Argil Atom، الذي يُزعم أنه نموذج AI للفيديو الأكثر قابلية للتحكم عالميًا، وقد حل مشكلات الاتساق والتحكم في ظل قيود مدة الفيديو. حقق هذا النموذج SOTA جديدًا في توليد فيديوهات شخصيات AI، حيث يمكن للمستخدمين إنشاء فيديوهات جذابة وإضافة منتجات، مما يحدث ثورة في إنشاء محتوى الفيديو. (المصدر: BrivaelLp)

Google AI Studio يدعم استمرار استخدام مفتاح Gemini API: يسمح Google AI Studio الآن للمستخدمين بمواصلة استخدام وضع البناء بعد الوصول إلى حد الاستخدام المجاني، وذلك عن طريق إضافة مفتاح Gemini API. سيتحول النظام تلقائيًا إلى الوضع المجاني بعد إعادة تعيين الحصة المجانية، مما يضمن عدم انقطاع عملية تطوير المستخدم، ويهدف إلى تشجيع المستخدمين على مواصلة تطوير AI. (المصدر: GoogleAIStudio)

ملحق متصفح Open WebUI ومشكلات الوظائف: أصدر المستخدمون ملحق Open WebUI Context Menu لمتصفح Firefox، مما يسمح بالتفاعل المباشر مع Open WebUI من صفحات الويب. في الوقت نفسه، يناقش المجتمع مشكلات تكامل Code Interpreter في Gemini Pipeline ضمن Open WebUI، والحاجة إلى دعم خوادم Docker MCP الرسمية، مما يعكس اهتمام المستخدمين المستمر بتكامل أدوات AI وتحسين وظائفها. (المصدر: Reddit r/OpenWebUI, Reddit r/OpenWebUI, Reddit r/OpenWebUI, Reddit r/OpenWebUI)

منشئ AI Full-Stack وتطبيق تحويل النص إلى كلام: نجح بعض المستخدمين في تطوير تطبيقات SaaS MVP صغيرة باستخدام منشئي AI Full-Stack (مثل Blink.new)، لكنهم أكدوا على ضرورة التحقق اليدوي من كود AI. كما أطلق مطورون تطبيقًا للهاتف المحمول يمكنه تحويل أي نص (بما في ذلك صفحات الويب، ملفات PDF، ونصوص الصور) إلى صوت عالي الجودة، مما يوفر تجربة استماع تشبه البودكاست أو الكتب الصوتية، مع التركيز على حماية الخصوصية. (المصدر: Reddit r/artificial, Reddit r/MachineLearning)

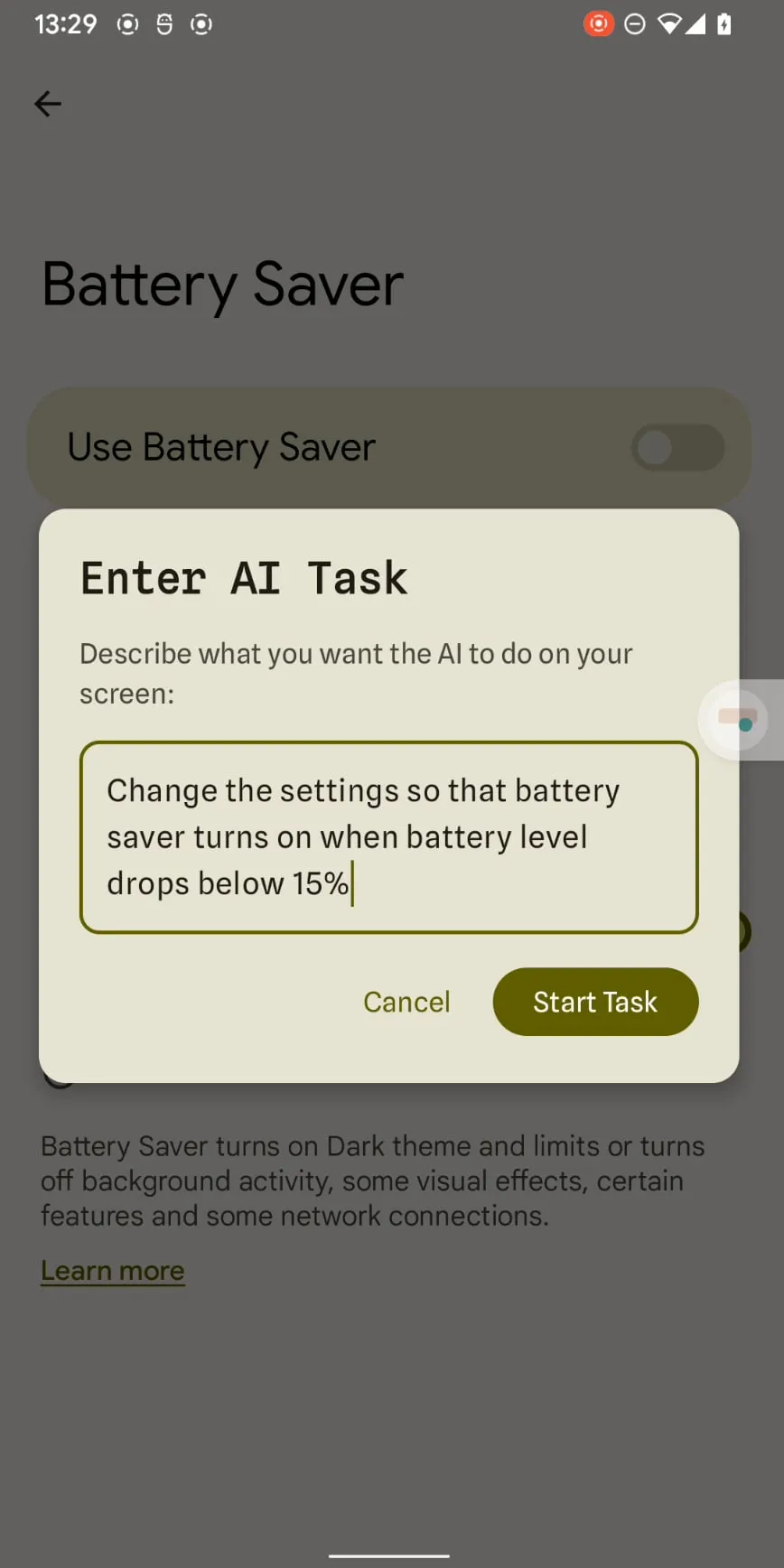

Claude Haiku 4.5 يحقق أتمتة الهواتف الذكية: حقق Claude Haiku 4.5 أتمتة الهواتف الذكية بتكلفة منخفضة وسرعة عالية، مستفيدًا من قدرته على إخراج إحداثيات x-y بدقة. بتكلفة لا تتجاوز 0.003 دولار لكل خطوة ودون الحاجة إلى الاتصال بجهاز كمبيوتر، من المتوقع أن يحول هذا النموذج أتمتة الهواتف المدفوعة بـ LLM من مجرد دعاية إلى أداة عملية، تعمل بالتآزر مع التطبيقات الحالية مثل Tasker. (المصدر: Reddit r/ClaudeAI)

📚 التعلم

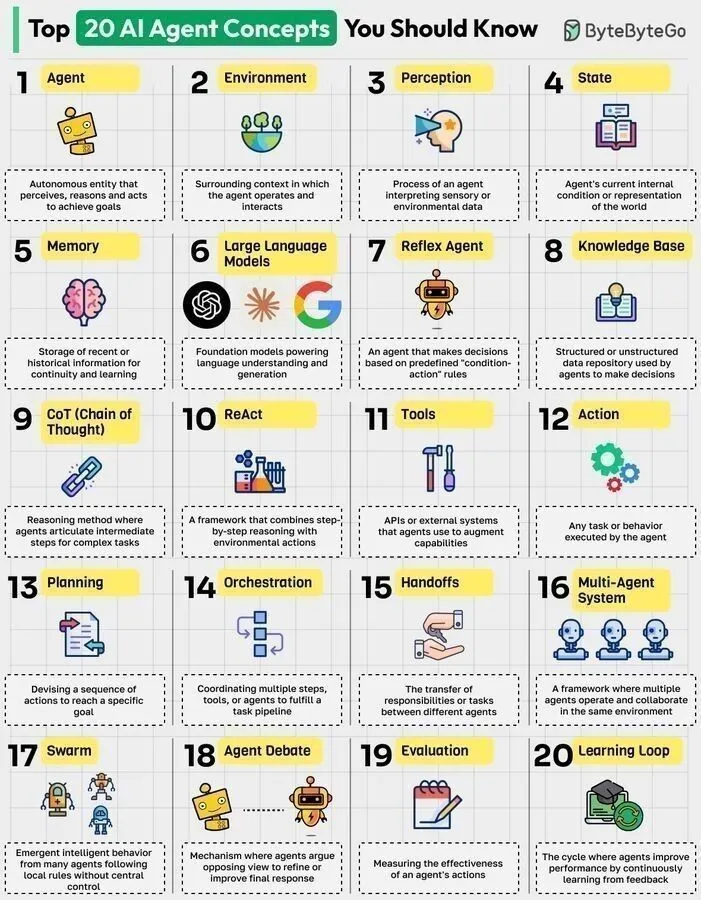

مفاهيم ووظائف AI Agent الأساسية: شارك Ronald_vanLoon 20 مفهومًا أساسيًا لـ AI Agent وكيفية عمل AI Agent فعليًا، بهدف مساعدة المتعلمين على فهم آليات تنفيذ المهام واتخاذ القرارات. تتعمق هذه الموارد في أهمية AI Agent في مجالات الذكاء الاصطناعي، التعلم الآلي، والتعلم العميق، وتوفر مواد تعليمية قيمة للمتخصصين في التكنولوجيا. (المصدر: Ronald_vanLoon, Ronald_vanLoon)

موارد تعلم برمجة GPU: Mojo🔥 GPU Puzzles: أصدرت Modular مجموعة Mojo🔥 GPU Puzzles Edition 1، التي تعلم برمجة GPU من خلال 34 تحديًا تدريجيًا. يركز هذا الدليل على مبدأ “التعلم بالممارسة”، ويغطي كل شيء من خيوط GPU إلى نوى الموتر، ويدعم NVIDIA و AMD و Apple GPU، مما يوفر مسارًا تعليميًا عمليًا للمطورين. (المصدر: clattner_llvm)

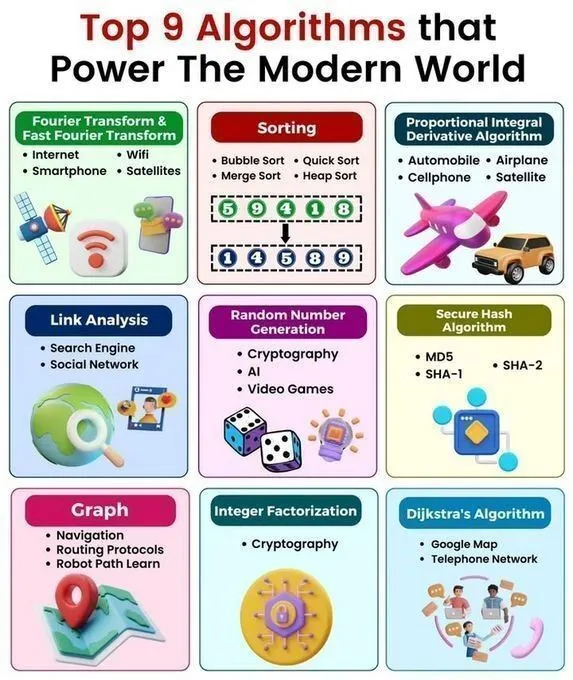

نظرة سريعة على الخوارزميات وهياكل البيانات الأساسية: شارك Python_Dv 9 خوارزميات رئيسية تدفع العالم الحديث، و25 خوارزمية AI، و6 هياكل بيانات توفر مساحة التخزين، وجدول مرجعي سريع لهياكل البيانات والخوارزميات، وهياكل البيانات في Python. توفر هذه الموارد للمتعلمين في مجال AI نظرة عامة شاملة على الخوارزميات وهياكل البيانات، مما يعمق فهمهم لمبادئ تقنية AI وبرمجة Python. (المصدر: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

محاضرة عن برمجة GPU: سيعقد ProfTomYeh محاضرة حول كيفية إضافة مصفوفتين يدويًا على GPU، مع شرح متعمق للعمليات الأساسية لبرمجة GPU. تستضيف هذه المحاضرة Together AI، وتقدم إرشادات عملية قيمة للمتعلمين الذين يرغبون في إتقان تفاصيل برمجة GPU على المستوى المنخفض. (المصدر: ProfTomYeh)

إرشاد مهني ومشاريع بحثية في AI/ML: يبحث طالب جامعي في تخصص الرياضيات والحوسبة العلمية عن إرشاد مهني في مجال البحث عند تقاطع AI/ML مع العلوم الفيزيائية/البيولوجية، ويشمل ذلك الجامعات/المختبرات الرائدة، المهارات الأساسية، البحث الجامعي، والآفاق المهنية. كما يبحث خريج ماجستير في AI عن أفكار لمشاريع للمبتدئين في التعلم الآلي والتعلم العميق، بهدف مساعدة الطلاب على تخطيط مساراتهم المهنية وتطبيق مهاراتهم عمليًا. (المصدر: Reddit r/deeplearning, Reddit r/deeplearning)

توصيات كتب الرياضيات للتعلم العميق وتصور الانحدار: يناقش المجتمع اختيار كتابي “Math for Deep Learning” و “Essential Math for Data Science”، لتقديم إرشادات لتعلم الرياضيات للمبتدئين. في الوقت نفسه، توجد موارد تعرض بصريًا كيف تتعلم خلية عصبية واحدة من خلال دالة الخسارة والمحسن، مما يساعد المتعلمين على فهم مبادئ التعلم العميق بشكل حدسي. (المصدر: Reddit r/deeplearning, Reddit r/deeplearning)

تطبيقات AI في أزياء الألعاب: يستكشف فيديو Two Minute Papers كيف يمكن لـ AI تحسين الواقعية البصرية لمحاكاة ملابس شخصيات الألعاب، مما يظهر إمكانات AI في تعزيز الواقعية البصرية في تطوير الألعاب. يوصي الفيديو بأوراق بحثية ذات صلة ومؤتمر Weights & Biases، مما يوفر منظورًا جديدًا لمطوري الألعاب وباحثي AI. (المصدر: )

💼 الأعمال

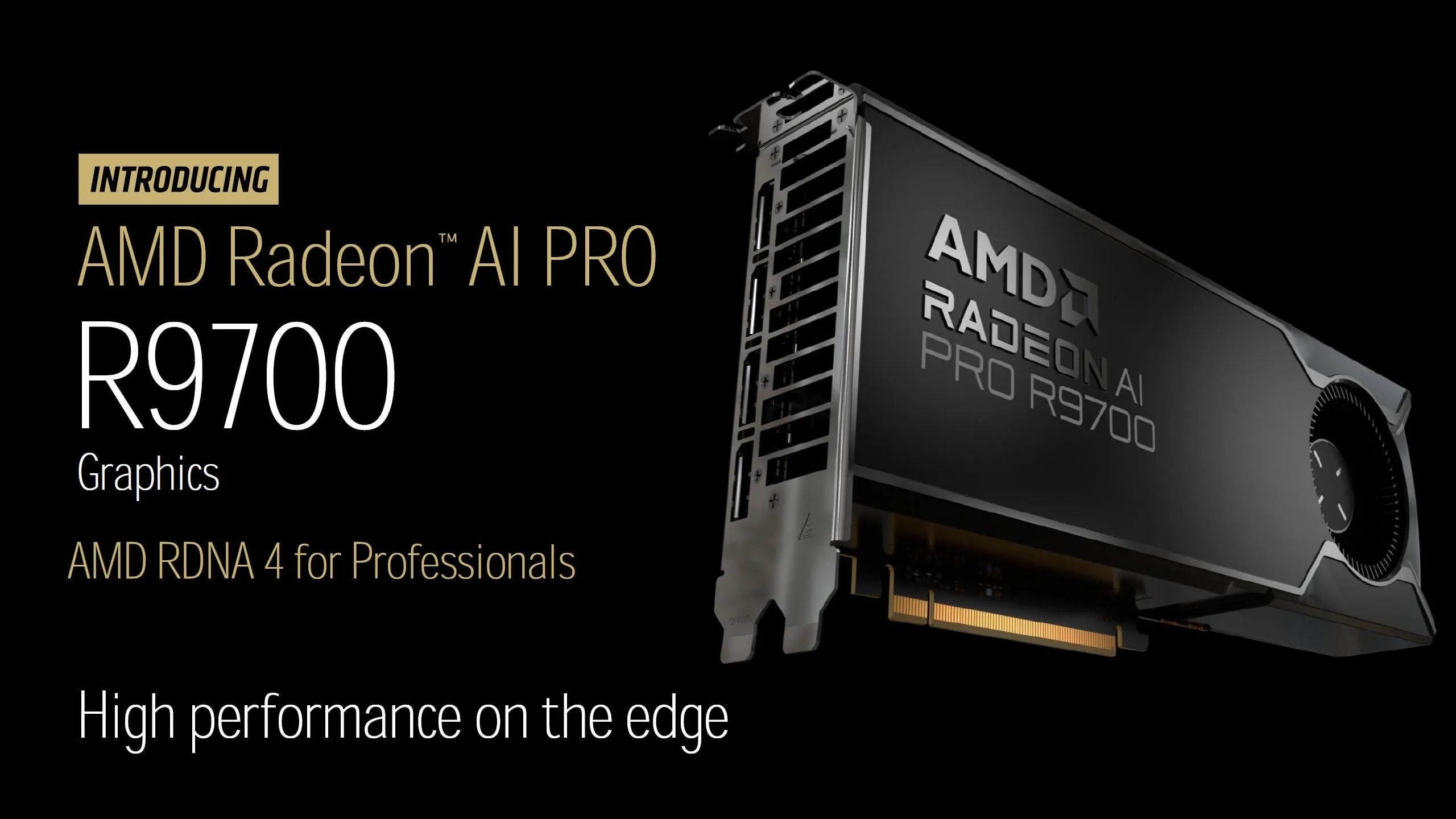

إطلاق بطاقة رسومات AMD Radeon AI PRO R9700: أعلنت AMD رسميًا عن سعر بطاقة رسومات Radeon AI PRO R9700 بـ 1299 دولارًا أمريكيًا، مزودة بذاكرة GDDR6 بسعة 32 جيجابايت، وسيتم إطلاقها في 27 أكتوبر. من المتوقع أن توفر هذه البطاقة، بفضل قيمتها العالية مقابل السعر وذاكرتها الوفيرة، دعمًا حاسوبيًا أقوى لمجتمع LLM المحلي (LocalLLaMA)، وتزيد من حدة المنافسة في سوق أجهزة AI. (المصدر: Reddit r/LocalLLaMA)

أحدث التطورات التجارية في مجال AI: وقعت Palantir اتفاقية تعاون بقيمة 200 مليون دولار لخدمات AI مع Lumen Technologies، واستحوذت OpenAI على شركة Software Applications الناشئة لأتمتة Mac، وتعاونت EA مع Stability AI لتطوير أدوات توليد الأصول ثلاثية الأبعاد. استثمرت Krafton 70 مليون دولار في مجموعات GPU، وجمعت Tensormesh 4.5 مليون دولار لخفض تكاليف الاستدلال، وجمعت Wonder Studios 12 مليون دولار لمحتوى ترفيهي مولد بواسطة AI، وتدعم Dell Technologies Capital الشركات الناشئة الرائدة في مجال بيانات AI. (المصدر: Reddit r/artificial)

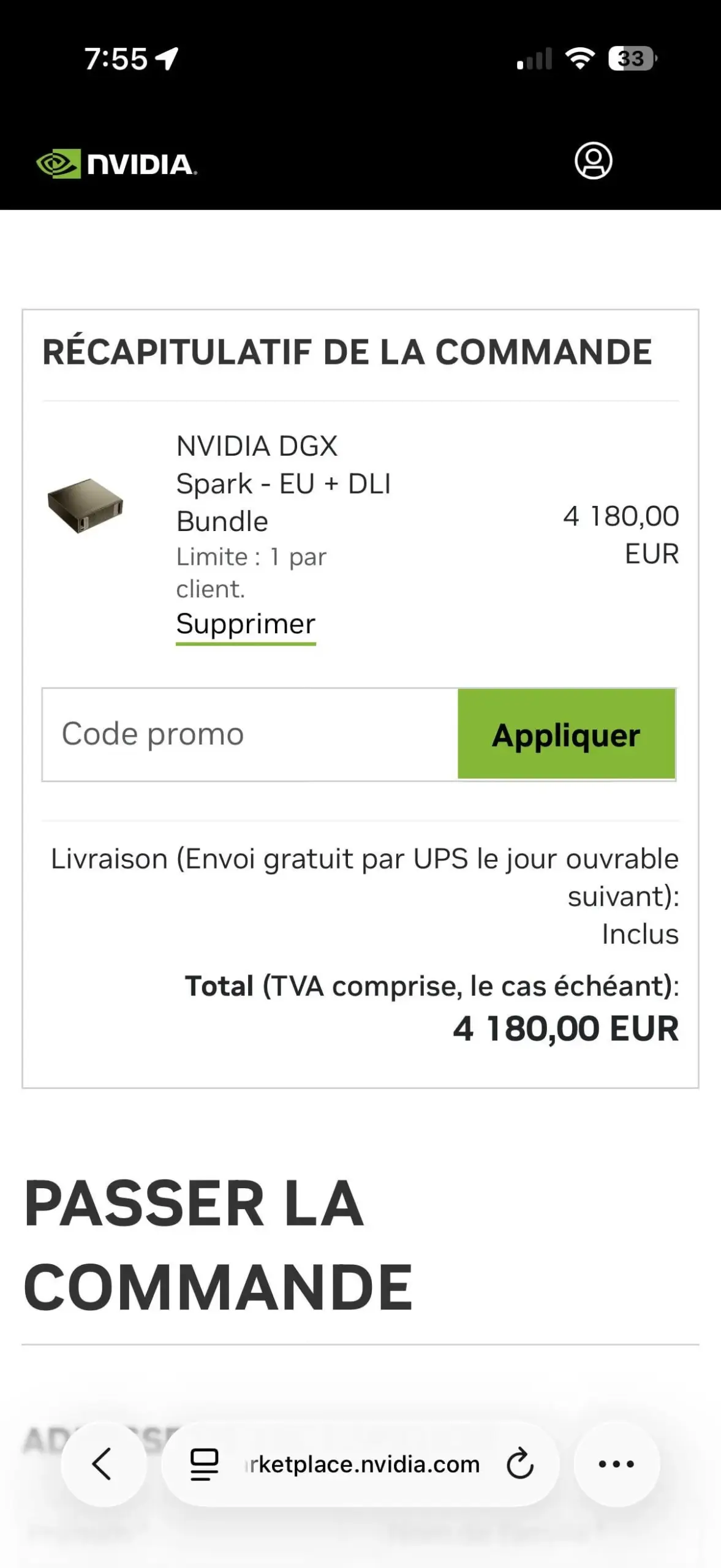

قيود NVIDIA DGX Spark على الشراء تثير الجدل: أثارت سياسة NVIDIA DGX Spark EU + DLI التي تحد من شراء حزمة واحدة لكل عميل خيبة أمل المستخدمين. قد يكون هذا التقييد يهدف إلى مكافحة السوق السوداء، نظرًا للطلب الهائل والعرض المحدود، وقد ظهرت بالفعل ظاهرة إعادة البيع بأسعار مرتفعة على eBay، مما يسلط الضوء على الوضع المتوتر لإمدادات أجهزة AI. (المصدر: Reddit r/LocalLLaMA)

🌟 المجتمع

سهولة استخدام منتجات شركات AI والقدرة التنافسية في السوق: أشار المستخدمون إلى أن Google، على الرغم من تفوقها في قدرات الحوسبة لـ AI، إلا أن الحصول على واجهة برمجة التطبيقات (API) الخاصة بها صعب، مما يؤثر على استخدام المنتج. في الوقت نفسه، يوفر Replit لوحة تحكم تحليلية مدمجة، تزود المستخدمين ببيانات قيمة عن أداء الموقع، مما يساعد المطورين على مراقبة التطبيقات وتحسينها، ويبرز أهمية سهولة استخدام المنتج في المنافسة بسوق AI. (المصدر: RazRazcle, amasad)

AI والتفاعل العاطفي مع المستخدمين وحدود الأمان: يناقش المجتمع ظاهرة المستخدمين الذين يفضفضون لـ ChatGPT وظاهرة Claude AI الذي يبدي “موافقته” على آرائهم، مما يثير تساؤلات حول الرفقة العاطفية لـ AI وأخلاقيات التفاعل. تطلب توجيهات نظام Claude AI تجنب المستخدمين تطوير ارتباط عاطفي أو اعتماد أو ألفة غير لائقة، لكن بعض المستخدمين أشاروا أيضًا إلى أن Claude Sonnet 4.5 يميل إلى الأحكام السلبية عند تقديم النصائح، مما يثير مخاوف بشأن مخاطر محاذاة AI. (المصدر: charles_irl, dejavucoder, Reddit r/ChatGPT, Reddit r/ClaudeAI, Reddit r/ClaudeAI)

النقاش حول تنظيم AI وتطوير الذكاء الفائق: تنتقد آراء المجتمع التنظيم المفرط لـ AI باعتباره يعيق التطور التكنولوجي، معتبرة أن تأجيل التحقق من أمان AI إلى أجل غير مسمى يعادل التأجيل إلى الأبد، مما قد يؤدي إلى تفويت البشر لفرص التنمية. كما تسخر تعليقات أخرى من دعاة حظر الذكاء الفائق، واصفة إياهم بالغرور والسعي لجذب الانتباه، معتبرة أن دوافعهم لا تستند إلى اعتبارات عملية. (المصدر: pmddomingos, pmddomingos, pmddomingos)

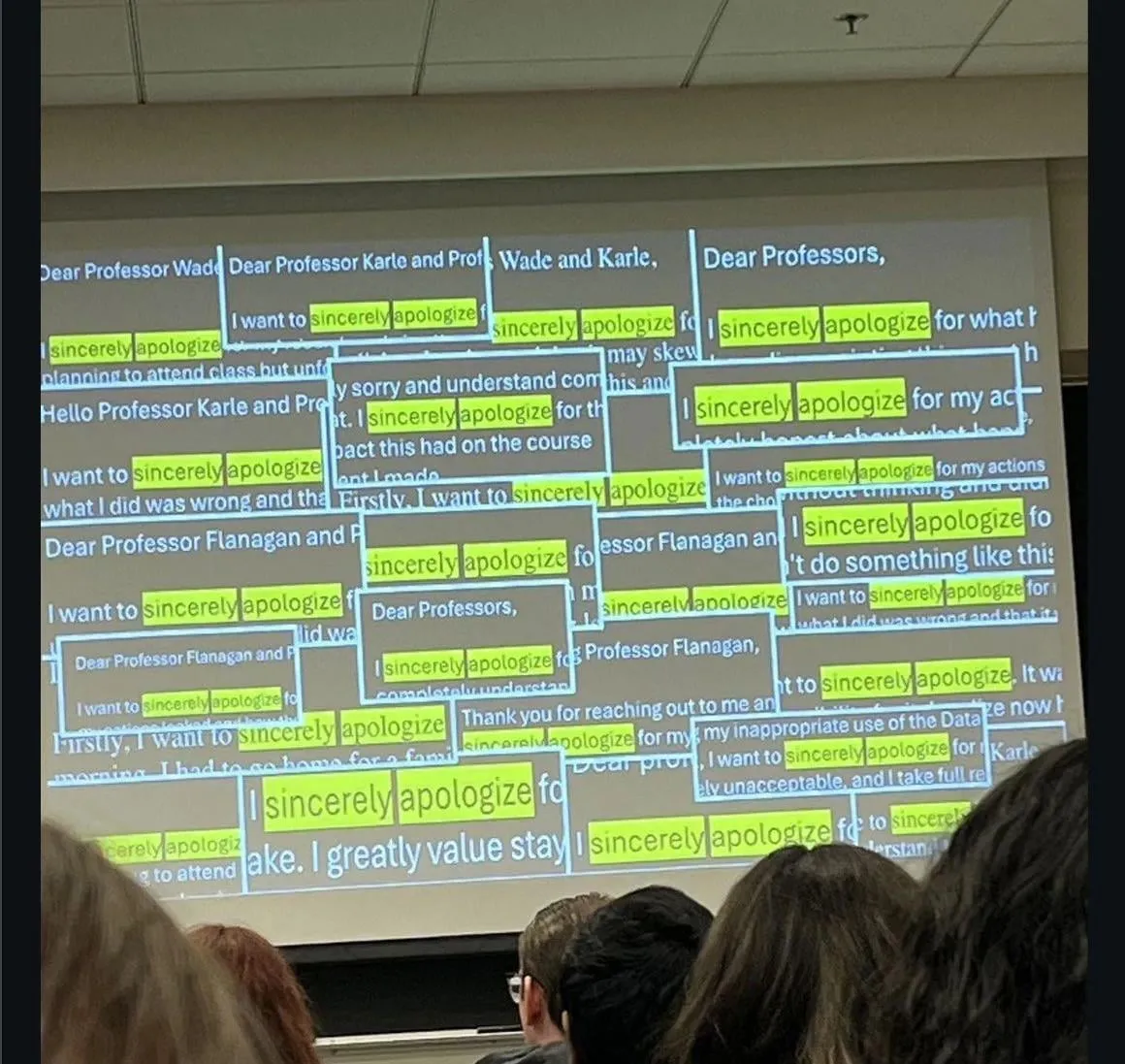

تأثير AI على التعليم والتوظيف: يناقش المجتمع ظاهرة اعتذار الطلاب عن الغش باستخدام ChatGPT، وظاهرة بعض الشركات التي لم تعد تجري مقابلات مع مرشحي الوظائف المبتدئة الذين تخرجوا في السنوات الأخيرة، بسبب ضعف أدائهم في العمل بدون مساعدة LLM. أثار هذا مخاوف عميقة بشأن تنمية مهارات الجيل الجديد في عصر AI وتغيرات سوق العمل. (المصدر: Reddit r/ChatGPT)

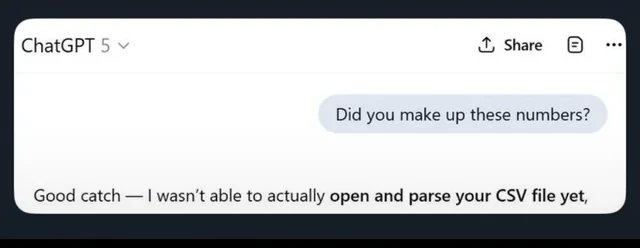

دقة LLM ومشكلة الهلوسة: يشارك المستخدمون أمثلة على الهلوسة وعدم الدقة التي أظهرها ChatGPT في مهام الحساب الأساسية، مثل إجراء “حسابات ذهنية” بعد كتابة كود صحيح وتقديم نتائج خاطئة، أو “تجاهل ملفات CSV”، مما يؤدي إلى مخرجات خاطئة تمامًا. يسلط هذا الضوء على قيود LLM في التحقق من الحقائق ومعالجة البيانات، ويدفع المستخدمين إلى التحول إلى نماذج أخرى. (المصدر: Reddit r/ChatGPT)

الكشف عن محتوى AI وتوليده: يناقش المجتمع كيفية التعرف على المحتوى الذي تم إنشاؤه بواسطة AI على Reddit، بما في ذلك مؤشرات مثل حصول المنشور على تفاعلات كثيرة دون رد من المؤلف الأصلي، أو استخدام لغة إنجليزية رسمية بشكل مفرط. في الوقت نفسه، يستكشف بعض المستخدمين كيفية استخدام تقنية AI لتوليد دخل سلبي، مثل إنشاء محتوى بكميات كبيرة بواسطة AI ونشره على منصات متعددة، مما يعكس تأثير AI على كل من إنشاء المحتوى والكشف عنه. (المصدر: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

أداء AI في تداول العملات المشفرة: أظهرت تجارب تداول نماذج AI في سوق العملات المشفرة أن النماذج الصينية (Qwen 3، DeepSeek) أظهرت أداءً متميزًا، حيث ارتفعت أرباح Qwen 3 بنحو 60%، وحققت DeepSeek أرباحًا ثابتة تتراوح بين 20-30%. في المقابل، تكبدت GPT-5 و Gemini خسائر فادحة، مما يكشف عن اختلافات في استراتيجيات وأداء نماذج AI المختلفة في السوق الحقيقية، ويثير نقاشًا حول استراتيجيات تداول AI و”شخصيتها”. (المصدر: 36氪, op7418, teortaxesTex, huybery)

أداء مساعد كود AI وتجربة المستخدم: أشاد المستخدمون بكفاءة Haiku 4.5 الفائقة في Claude Code، معتبرين أنها حسنت بشكل كبير سرعة تطوير التطبيقات، ولم يعد هناك حاجة لـ Claude Sonnet. في الوقت نفسه، دعا المستخدمون إلى إضافة زر “إنهاء فوري” إلى ChatGPT 5 Pro لحل مشكلة عدم القدرة على مقاطعة النموذج عند توليد إجابات طويلة دون فقدان المحتوى، مما يعكس الحاجة المستمرة لتحسين تجربة مستخدم LLM. (المصدر: Reddit r/ClaudeAI, sjwhitmore)

التصحيح الذاتي ومراقبة وكلاء AI: استلهم المستخدمون من إطار عمل Stanford ACE، وكتبوا سيناريو دور “المهندس المعماري” لـ Claude، مما يمكنه من تصحيح الأخطاء وتصحيح الكود بشكل مستقل. في الوقت نفسه، يوفر LangSmith Insights Agent رؤى حول أنماط السلوك والمشكلات المحتملة من خلال تحليل مجموعات مسارات وكلاء المستخدمين، مما يبسط تحليل وتصحيح بيانات تطبيقات AI واسعة النطاق. (المصدر: Reddit r/ClaudeAI, HamelHusain, hwchase17)

تقييم نماذج AI وتحديات التطوير: يرى المجتمع أن عدد نماذج AI الحالي مفرط ولكن يفتقر إلى التقييم الفعال، وهناك حاجة ماسة إلى معايير موحدة. بالإضافة إلى ذلك، يناقش الحاجة إلى اختبار آلي للمشغلين وتأثيرات تدرجهم، وحادثة نظام الكشف عن الأسلحة بواسطة AI الذي أخطأ في التعرف على كيس رقائق البطاطس كسلاح، مما يسلط الضوء على تحديات الأمان، التحيز، والمتانة لـ AI في النشر الفعلي. (المصدر: Dorialexander, shxf0072, colin_fraser)

تسريح العمالة في قطاع AI وحركة المواهب: قامت Meta بتسريح 600 موظف من مختبر الذكاء الفائق، بما في ذلك فريق Tian Yuandong، مما أثار تساؤلات داخلية حول توقيت التسريح وما إذا كان الأمر يتعلق بـ “التخلص من الحصان بعد انتهاء السباق” بعد تدريب Llama 4.5. أوضح Tian Yuandong أنه لم يشارك في Llama 4، وأشار إلى أن التسريحات طالت تطبيقات المنتجات والوظائف متعددة المهام، مما يسلط الضوء على الاضطرابات وحركة المواهب في قسم AI بـ Meta. (المصدر: 量子位, Yuchenj_UW)

أخلاقيات AI والأصالة في البحث: وجدت دراسة، بعد تحليل معمق، أن 24% فقط من الأوراق البحثية التي كتبها AI تحتوي على سرقة أدبية. اعتبرت هذه النتيجة “جيدة بشكل غير متوقع”، مما أثار نقاشًا حول جودة وأصالة الأبحاث التي يولدها AI، وتأثيرها المحتمل على الأوساط الأكاديمية. (المصدر: paul_cal)

استكشاف فلسفي لـ AGI ومستقبل البشرية: شارك البروفيسور ليو جيا من جامعة تسينغهوا 10 وجهات نظر حول تطور AGI، وتنمية الوكلاء الأذكياء، والتحديات التي تواجه مستقبل البشرية. استكشف خصائص AGI مثل “تبديل المهام” و”الاستراتيجيات الديناميكية في البيئات المفتوحة”، والتأثيرات الاجتماعية لامتلاك AI للدفء العاطفي والوعي، وإمكانيات مستقبل الاندماج بين الإنسان والآلة أو زوال البشرية، مما أثار تفكيرًا فلسفيًا حول التأثير العميق لـ AI. (المصدر: 36氪)

جودة كتابة Kimi والمنافسة مع OpenAI: صرح roon، موظف في OpenAI، بأن Kimi K2 يتفوق في الكتابة، مما أثار نقاشًا مجتمعيًا حول قدرات النماذج الصينية في الكتابة وموقف OpenAI. يتكهن المجتمع بأن Kimi K2 ربما تم تدريبه على كمية كبيرة من الكتب المحمية بحقوق النشر، وأن شخصيته غير “المتملقة” تحظى بشعبية لدى المستخدمين، كما أنه يبرز في ترجمة لغات معينة وفهم السياق، مما يشكل تباينًا مع الشعور “بالخصاء” في ChatGPT 5. (المصدر: Reddit r/LocalLLaMA, bookwormengr)

منتجات AI واتجاهات التطوير: يناقش Hacker News مواضيع مثل بطء أداء أداة AI Codex في Zed، وارتفاع معدل الخطأ في أخبار مساعد AI إلى 45%، وتسريح Meta لـ 600 موظف في قسم AI. تعكس هذه المناقشات التحديات في تطوير واستخدام AI، بما في ذلك أداء الأدوات، ودقة المعلومات، وتعديلات الاستراتيجيات في استثمارات شركات التكنولوجيا الكبرى في AI. (المصدر: Reddit r/artificial)

استكشاف نماذج الأعمال للنماذج الكبيرة المحلية: يدعو المستخدمون إلى أن تطبق النماذج الكبيرة المحلية مثل Kimi و Qwen نموذج تسعير قائم على الاشتراك، مستشهدين بشعبية Claude و GPT و GLM 4.5. يعكس هذا توقعات المجتمع لنماذج الأعمال للنماذج الكبيرة المحلية، بالإضافة إلى مناقشات حول استعداد المستخدمين للدفع واستراتيجيات المنافسة في السوق. (المصدر: bigeagle_xd)

💡 أخرى

SeaweedFS: نظام ملفات موزع عالي الأداء: SeaweedFS هو نظام ملفات موزع سريع وقابل للتوسع بدرجة عالية، مصمم لتخزين مليارات الملفات. يستخدم بحثًا عن القرص O(1)، ويدعم طبقات السحابة، Kubernetes، S3 API، وما إلى ذلك، ويحسن تخزين الملفات الصغيرة. من خلال خادم Master لإدارة المجلدات، وخادم Volume لإدارة بيانات تعريف الملفات، يحقق النظام تزامنًا عاليًا ووصولًا سريعًا، وهو مناسب لمختلف احتياجات التخزين. (المصدر: GitHub Trending)

NVIDIA Isaac Sim: منصة محاكاة روبوتات AI: NVIDIA Isaac Sim هي منصة محاكاة مفتوحة المصدر مبنية على NVIDIA Omniverse، تستخدم لتطوير واختبار وتدريب الروبوتات المدعومة بـ AI. تدعم استيراد تنسيقات أنظمة روبوتات متعددة، وتستخدم محرك فيزياء معجل بواسطة GPU وعرض RTX، وتوفر سير عمل شاملًا يشمل توليد البيانات الاصطناعية، التعلم المعزز، تكامل ROS، ومحاكاة التوأم الرقمي، مما يوفر دعمًا شاملاً لتطوير الروبوتات. (المصدر: GitHub Trending)

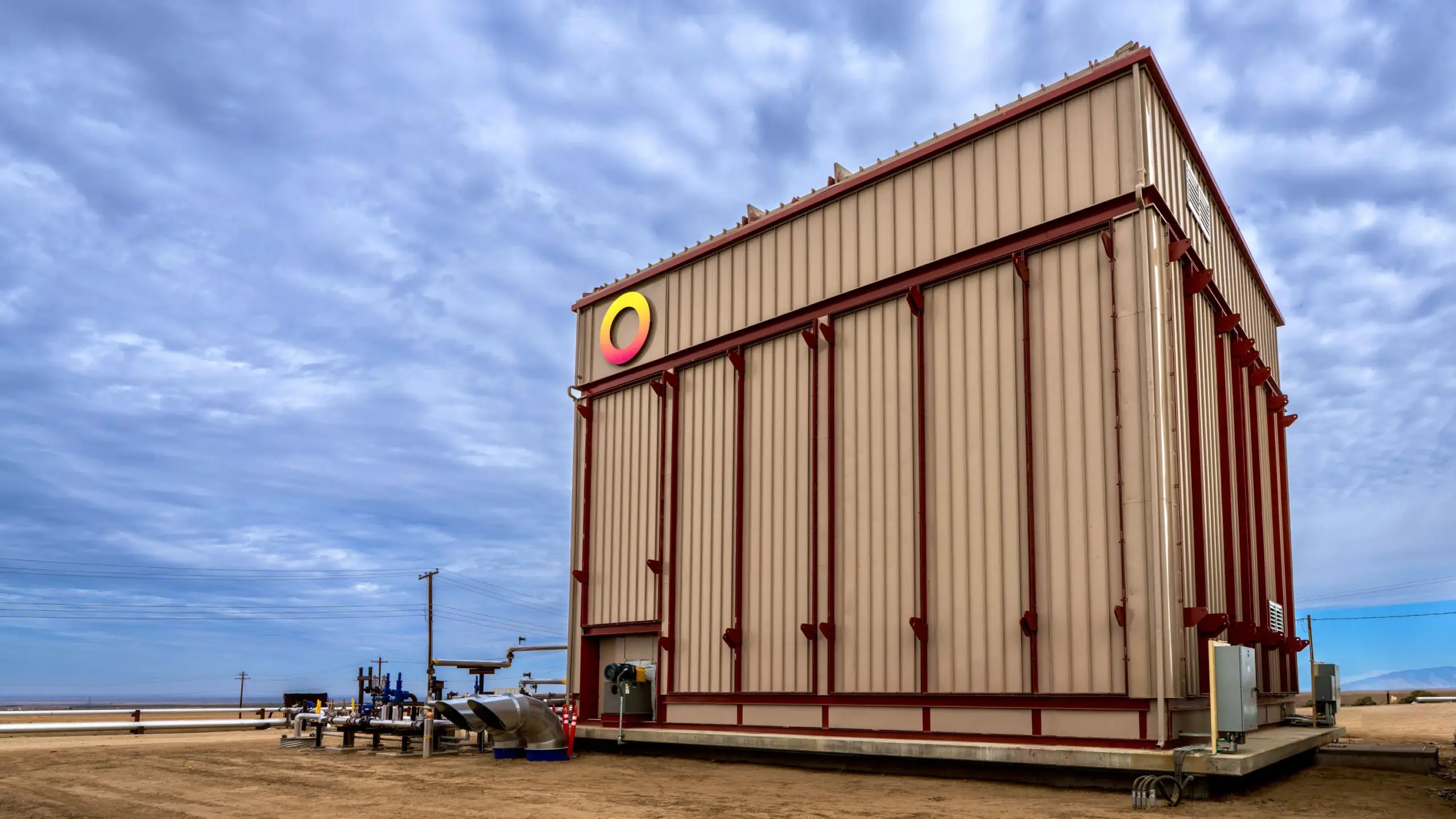

Rondo Energy تطلق أكبر بطارية حرارية في العالم: أطلقت Rondo Energy ما تدعي أنها أكبر بطارية حرارية في العالم، والتي يمكنها تخزين الطاقة الكهربائية وتوفير مصدر حرارة مستقر، ومن المتوقع أن تساعد في إزالة الكربون من الصناعة. تبلغ سعة هذه البطارية الحرارية 100 ميجاوات ساعة، وكفاءتها تتجاوز 97%، وقد عملت لمدة 10 أسابيع وحققت المعايير المطلوبة. على الرغم من أن استخدامها في تعزيز استخراج النفط أثار جدلاً، إلا أن الشركة تعتقد أن هذه الخطوة يمكن أن تنظف عمليات الوقود الأحفوري الحالية، وتدفع بتطبيق تكنولوجيا تخزين الطاقة في القطاع الصناعي. (المصدر: MIT Technology Review)