كلمات مفتاحية:الذكاء الاصطناعي للكشف, صور إساءة معاملة الأطفال, روبوتات جيميني, النماذج المجسدة, تشخيص الخرف, المحاكاة الفيزيائية من إنفيديا, وكلاء الذكاء الاصطناعي, استدلال نماذج اللغات الكبيرة, تقنيات كشف المحتوى المُولد بالذكاء الاصطناعي, نموذج تنفيذ الإجراءات 1.5 لروبوتات جيميني, الكشف عن 9 أنواع من الخرف بمسح واحد, إطار إنفيديا دينامو للاستدلال الموزع, تحرير واعي للرموز لتحسين واقعية النماذج

🔥 تركيز

الكشف عن صور الاعتداء على الأطفال بمساعدة AI : مع تزايد عدد صور الاعتداء الجنسي على الأطفال الناتجة عن الذكاء الاصطناعي التوليدي (Generative AI) بنسبة 1325%، يقوم مركز الجرائم الإلكترونية التابع لوزارة الأمن الداخلي الأمريكية بتجربة استخدام برنامج AI (من Hive AI) للتمييز بين المحتوى الذي تم إنشاؤه بواسطة AI وصور الضحايا الحقيقيين. تهدف هذه الخطوة إلى تركيز موارد التحقيق على قضايا الضحايا الحقيقيين، لزيادة تأثير المشروع وحماية الفئات الضعيفة، مما يمثل تطبيقًا حاسمًا لـ AI في مكافحة الجرائم الإلكترونية. تقوم الأداة بتحديد ما إذا كانت الصورة قد تم إنشاؤها بواسطة AI من خلال التعرف على مجموعات بكسل معينة في الصورة، دون الحاجة إلى تدريبها على محتوى محدد. (المصدر: MIT Technology Review)

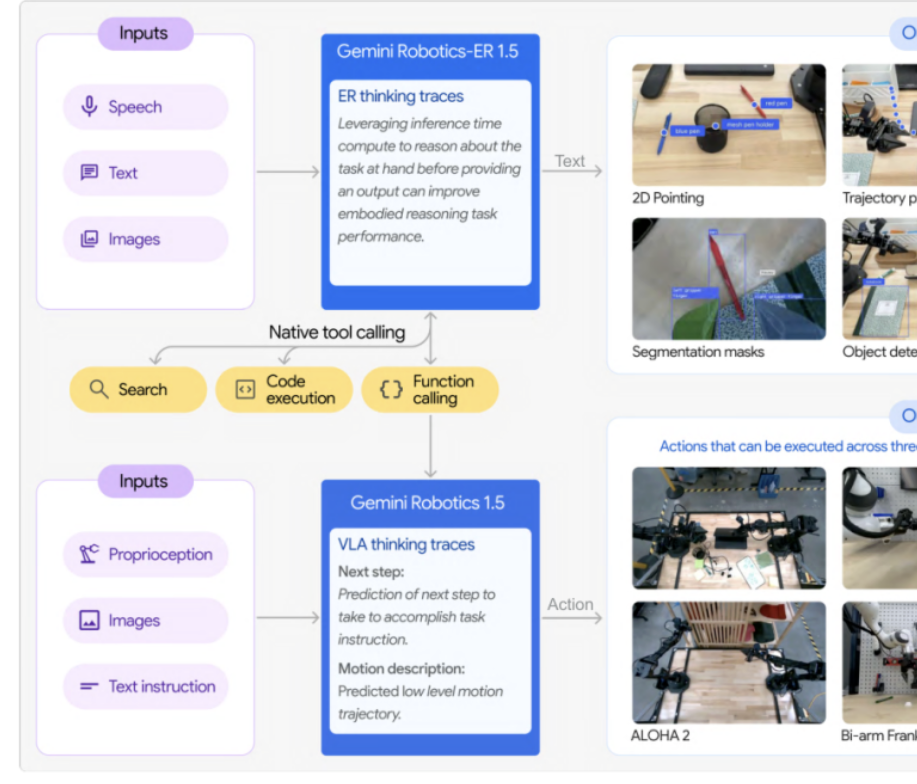

Google DeepMind تطلق سلسلة نماذج Gemini Robotics 1.5 المجسدة : أطلقت Google DeepMind أول نماذج مجسدة لها تتمتع بقدرات استدلال محاكاة، وهي سلسلة Gemini Robotics 1.5. تتضمن السلسلة نموذج تنفيذ الحركة GR 1.5 ونموذج الاستدلال المعزز GR-ER 1.5، مما يمكن الروبوتات من “التفكير أولاً ثم التصرف”. من خلال آلية “Motion Transfer”، يمكن للنموذج نقل المهارات إلى منصات أجهزة مختلفة بدون تدريب مسبق (zero-shot)، مما يكسر نموذج “تدريب واحد لكل آلة” التقليدي ويدفع نحو تطوير الروبوتات العامة. يتفوق GR-ER 1.5 على GPT-5 و Gemini 2.5 Flash في اختبارات المعايير مثل الاستدلال المكاني وتخطيط المهام، مما يظهر قدرته القوية على فهم العالم المادي وحل المهام المعقدة. (المصدر: 量子位)

أداة AI يمكنها الكشف عن 9 أنواع من الخرف من مسح واحد : يمكن لأداة AI الكشف عن 9 أنواع مختلفة من الخرف بدقة تشخيص تبلغ 88% من مسح واحد. من المتوقع أن تحدث هذه التقنية ثورة في طرق التشخيص المبكر للخرف، من خلال توفير فحص سريع ودقيق، مما يساعد المرضى على الحصول على العلاج والدعم في وقت مبكر، ولها أهمية كبيرة في مجال الرعاية الصحية. (المصدر: Ronald_vanLoon)

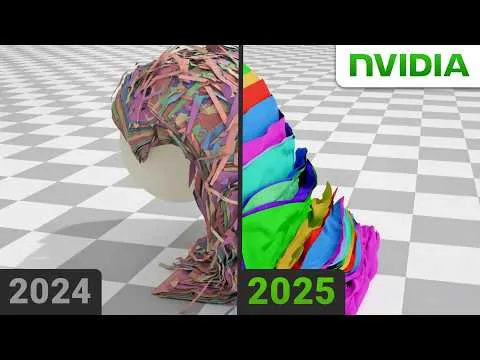

NVIDIA تتغلب على تحديات فيزيائية لتحقيق محاكاة واقعية : نجحت NVIDIA في حل مشكلة طالما أربكت علماء الفيزياء، وهذا الاختراق ضروري لإنشاء محاكاة واقعية للغاية. من المرجح أن تستخدم هذه التقنية خوارزميات AI والتعلم الآلي المتقدمة، وستعزز بشكل كبير واقعية البيئات الافتراضية ودقة النمذجة العلمية، مما سيكون له تأثير عميق على الألعاب وإنتاج الأفلام ومجالات البحث العلمي. (المصدر: )

🎯 اتجاهات

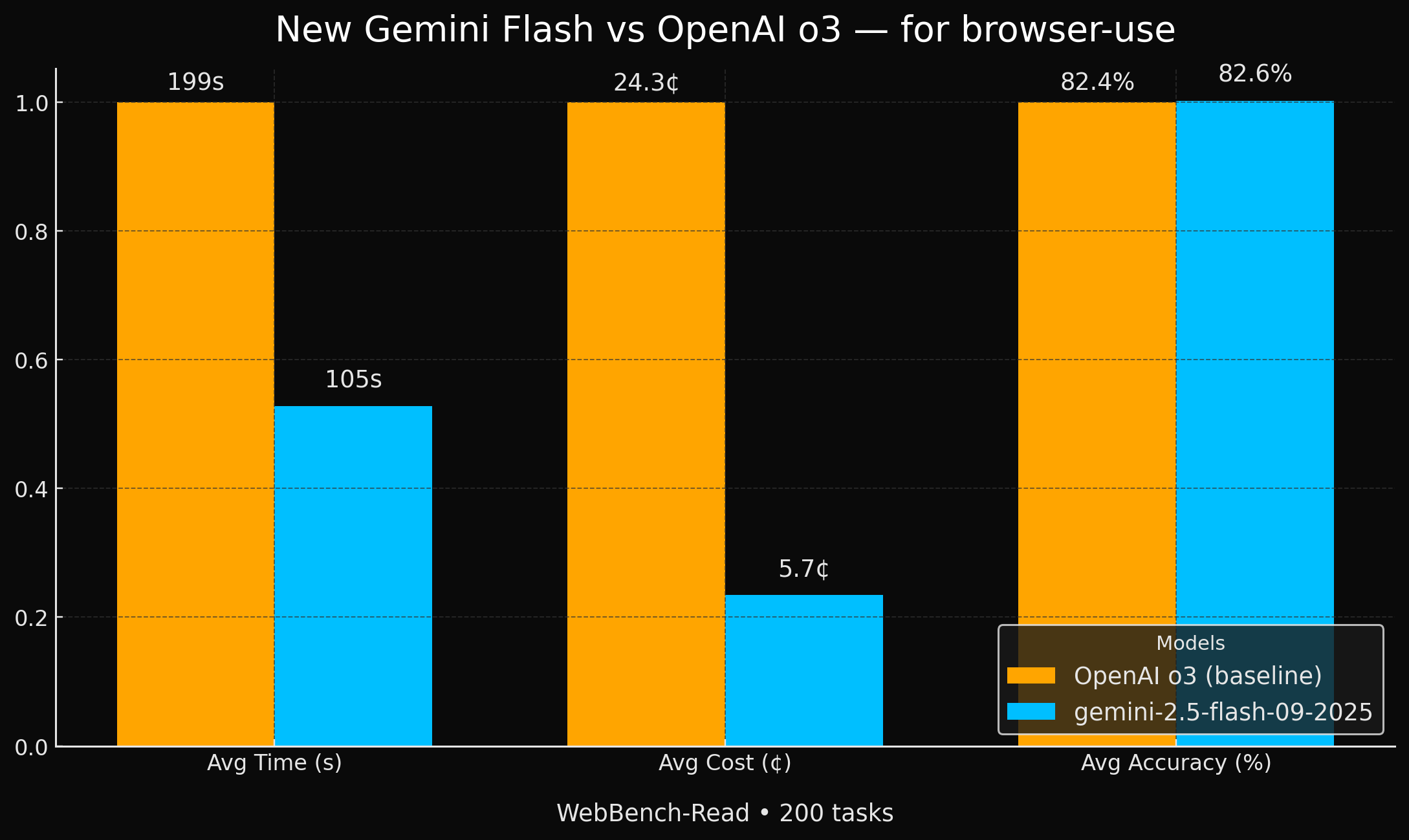

Google تطلق نماذج Gemini Flash أكثر كفاءة : أطلقت Google نموذجين جديدين من Gemini 2.5 (Flash و Flash-Lite)، اللذين حققا دقة مماثلة لـ GPT-4o في مهام وكيل المتصفح، ولكن بسرعة مضاعفة وتكلفة أقل بأربع مرات. هذا التحسن الكبير في الأداء والفعالية من حيث التكلفة يجعلهما خيارًا جذابًا للغاية لتطبيقات AI محددة، خاصة في السيناريوهات التي تتطلب كفاءة عالية واقتصادًا. (المصدر: jeremyphoward, demishassabis, scaling01)

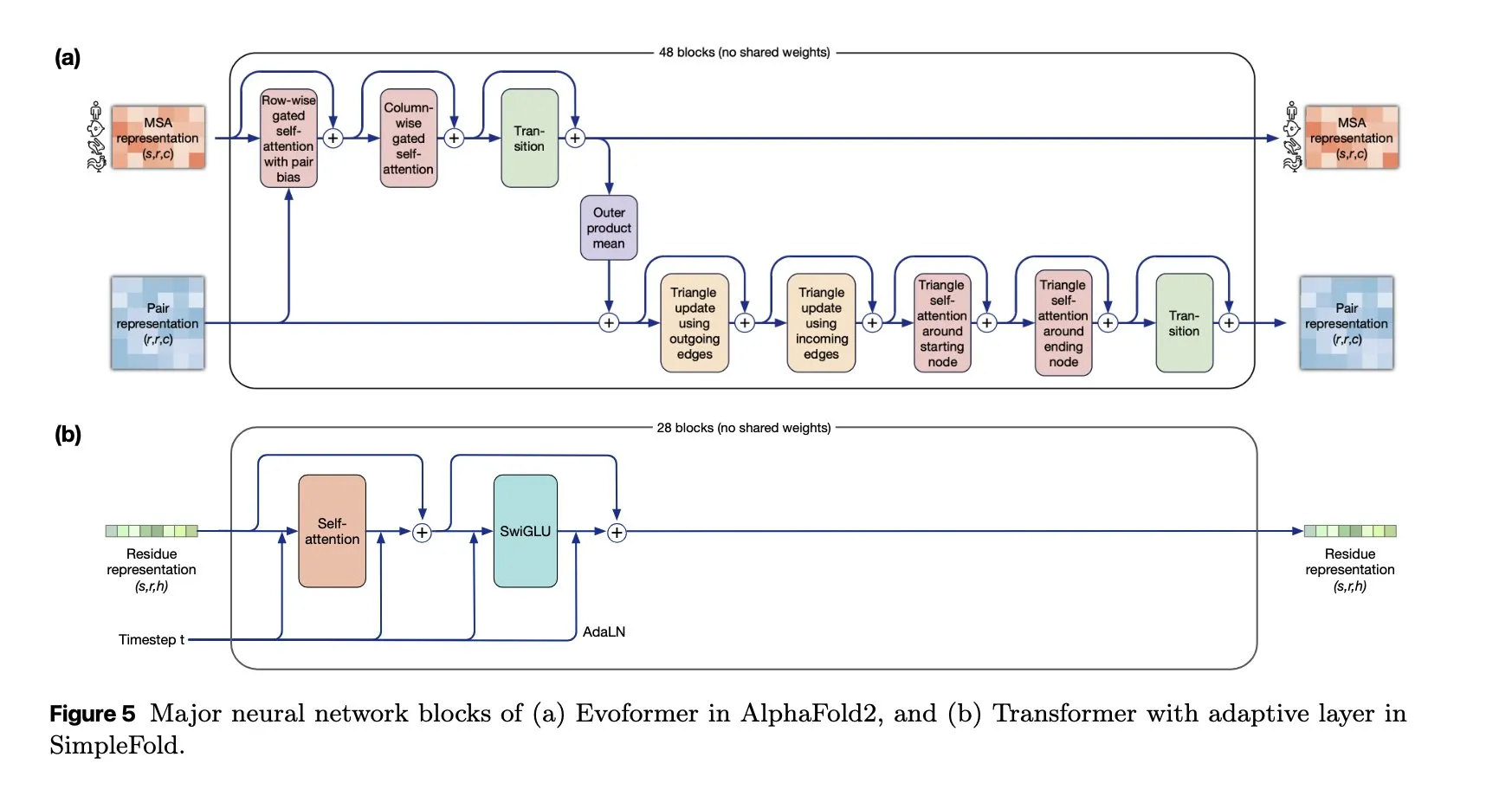

SimpleFold: نموذج طي البروتين القائم على مطابقة التدفق : يقدم نموذج SimpleFold لأول مرة طريقة طي البروتين القائمة على مطابقة التدفق، وهو مبني بالكامل باستخدام كتل Transformer عامة. يبسط هذا الابتكار عملية طي البروتين، ومن المتوقع أن يزيد الكفاءة وقابلية التوسع مقارنة بالوحدات التقليدية كثيفة الحسابات، مما يدفع بتطبيقات AI في مجال العلوم البيولوجية. (المصدر: jeremyphoward, teortaxesTex)

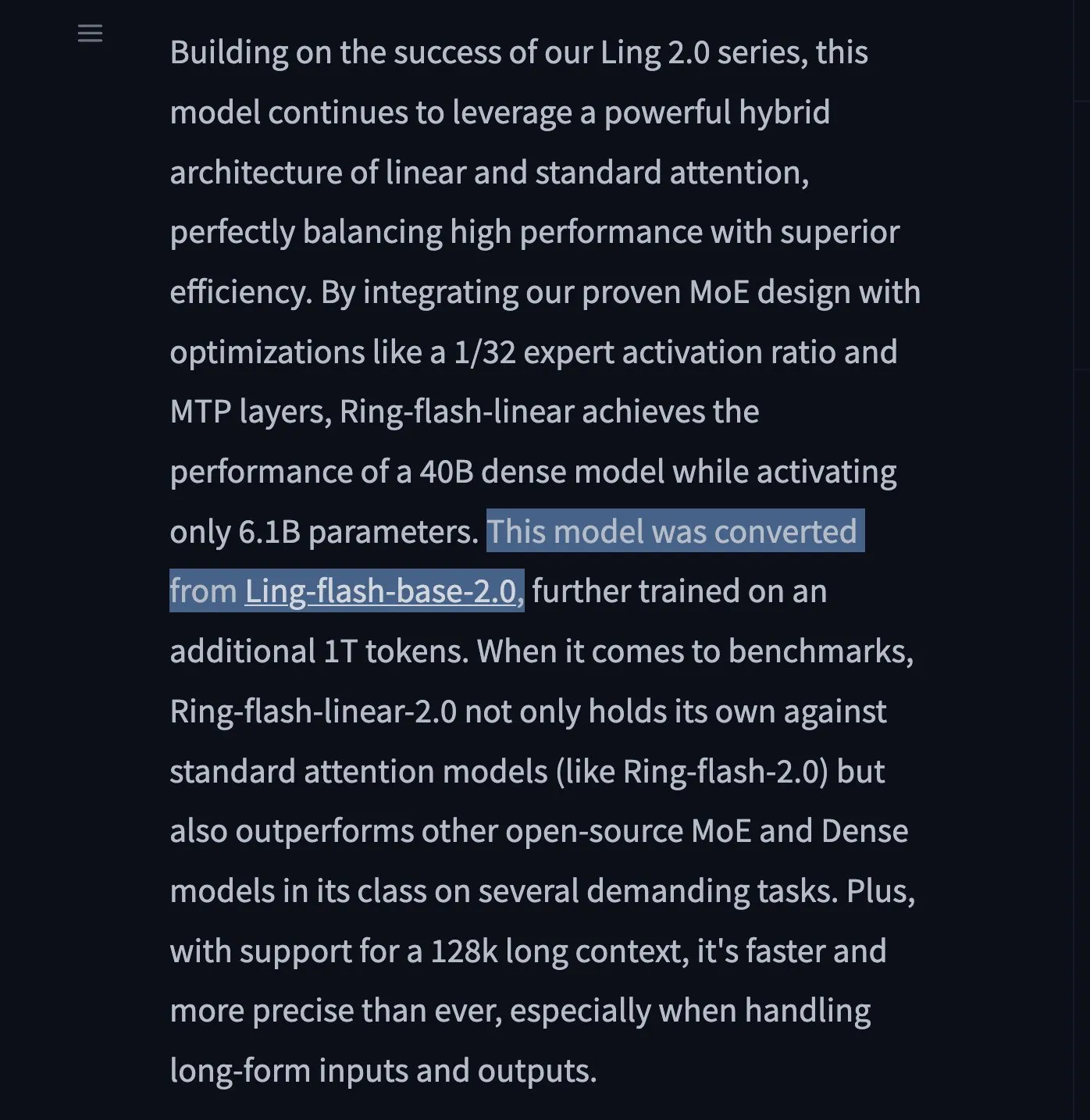

إطلاق نماذج LLM Ring-flash-linear-2.0 و Ring-mini-linear-2.0 : تم إطلاق نموذجين جديدين من LLM، وهما Ring-flash-linear-2.0 و Ring-mini-linear-2.0، اللذان يستخدمان آلية اهتمام خطية مختلطة لتحقيق قدرات استدلال فائقة السرعة ومتطورة. يُزعم أن سرعتهما تبلغ ضعف سرعة نماذج MoE ذات الحجم المماثل و10 أضعاف سرعة نماذج 32B، مما يضع معيارًا جديدًا للاستدلال عالي الكفاءة. (المصدر: teortaxesTex)

ChatGPT Pulse: مساعد بحث ذكي للأجهزة المحمولة : أطلقت OpenAI ميزة جديدة للأجهزة المحمولة، ChatGPT Pulse، والتي يمكنها إجراء بحث غير متزامن يوميًا بناءً على محادثات المستخدم وذاكرته السابقة، لمساعدة المستخدمين على فهم أعمق للمواضيع التي تهمهم. يعادل هذا شريكًا معرفيًا مخصصًا وخدمة أخبار مخصصة، ومن المتوقع أن يغير طريقة الحصول على المعلومات والتعلم. (المصدر: nickaturley, Reddit r/ChatGPT)

إطار عمل UserRL: لتدريب وكلاء AI تفاعليين نشطين : UserRL هو إطار عمل جديد يهدف إلى تدريب وكلاء AI قادرين على مساعدة المستخدمين بشكل فعال من خلال التفاعل النشط، بدلاً من مجرد السعي لتحقيق درجات معيارية ثابتة. يؤكد هذا الإطار على فائدة الوكيل وقدرته على التكيف في سيناريوهات العالم الحقيقي، ومن المتوقع أن يدفع وكلاء AI من الاستجابة السلبية إلى حل المشكلات بشكل استباقي. (المصدر: menhguin)

NVIDIA تواصل تعزيز جهودها في مجال الذكاء الاصطناعي مفتوح المصدر : ساهمت NVIDIA بأكثر من 300 نموذج ومجموعة بيانات وتطبيق في Hugging Face خلال العام الماضي، مما يعزز مكانتها كشركة رائدة في مجال AI مفتوح المصدر في الولايات المتحدة. لا تدفع هذه السلسلة من المبادرات بتطوير مجتمع AI فحسب، بل تظهر أيضًا تصميم NVIDIA على بناء نظام بيئي برمجي يتجاوز الأجهزة. (المصدر: ClementDelangue)

جلسة Qwen3 الخاصة تكشف عن اتجاهات التطوير المستقبلية : شاركت Alibaba Cloud في جلسة Qwen3 الخاصة خططها المستقبلية لنماذجها اللغوية الكبيرة: سيشغل التعلم المعزز بعد التدريب أكثر من 50% من وقت التدريب؛ حقق Qwen3 MoE رافعة مالية للمعلمات النشطة بمقدار 5 أضعاف من خلال خسارة موازنة الحمل الدفعي العالمية؛ سيستخدم Qwen3-Next بنية مختلطة تتضمن الاهتمام الخطي والاهتمام الموجه؛ وسيتم تحقيق توحيد النماذج المتعددة بالكامل في المستقبل، مع الاستمرار في الالتزام بقانون Scaling Law. (المصدر: ZhihuFrontier)

فريق SGLang يطلق إطار عمل تدريب RL قابل للاستنساخ بنسبة 100% : تعاون فريق SGLang مع فريق slime لإطلاق أول إطار عمل تدريب للتعلم المعزز (RL) مفتوح المصدر ومستقر وقابل للاستنساخ بنسبة 100%. يحل هذا الإطار مشكلة عدم ثبات الدفعات في استدلال LLM من خلال عوامل تشغيل الاهتمام المخصصة ومنطق أخذ العينات، مما يضمن تطابق النتائج بشكل مثالي، ويوفر ضمانًا موثوقًا لسيناريوهات التجارب التي تتطلب استنساخًا عالي الدقة. (المصدر: 量子位)

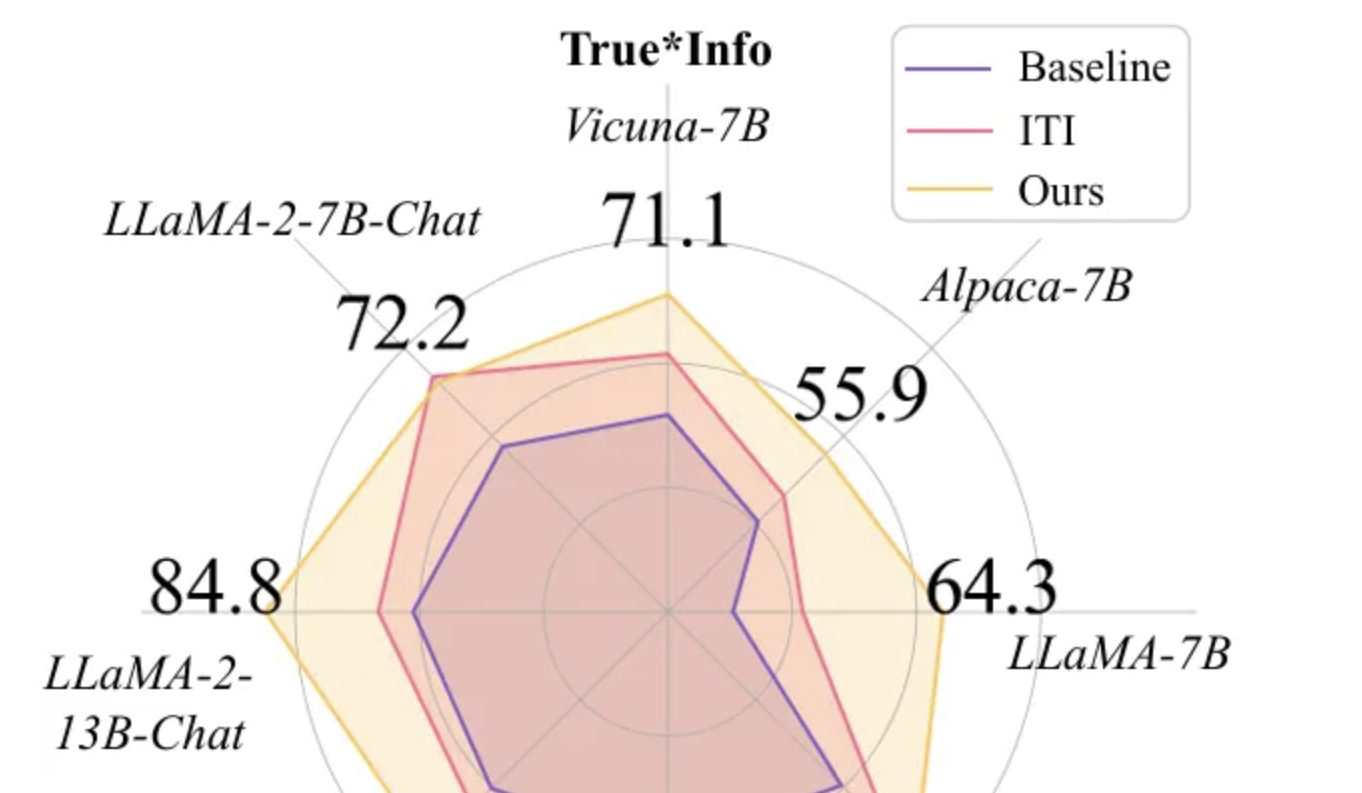

Token-Aware Editing (TAE) يعزز مصداقية النماذج الكبيرة : قدم فريق بحثي من جامعة بكين للملاحة الجوية والفضاء طريقة Token-Aware Editing (TAE) في EMNLP 2025، والتي عززت مؤشر مصداقية النماذج اللغوية الكبيرة في مهمة TruthfulQA بنسبة 25.8%، محطمة الرقم القياسي (SOTA). لا تتطلب هذه الطريقة تدريبًا، وهي قابلة للتوصيل والتشغيل، وقد حلت بفعالية مشكلات الانحياز الاتجاهي ومرونة شدة التحرير في الطرق التقليدية، ويمكن تطبيقها على نطاق واسع في أنظمة الحوار ومراجعة المحتوى. (المصدر: 量子位)

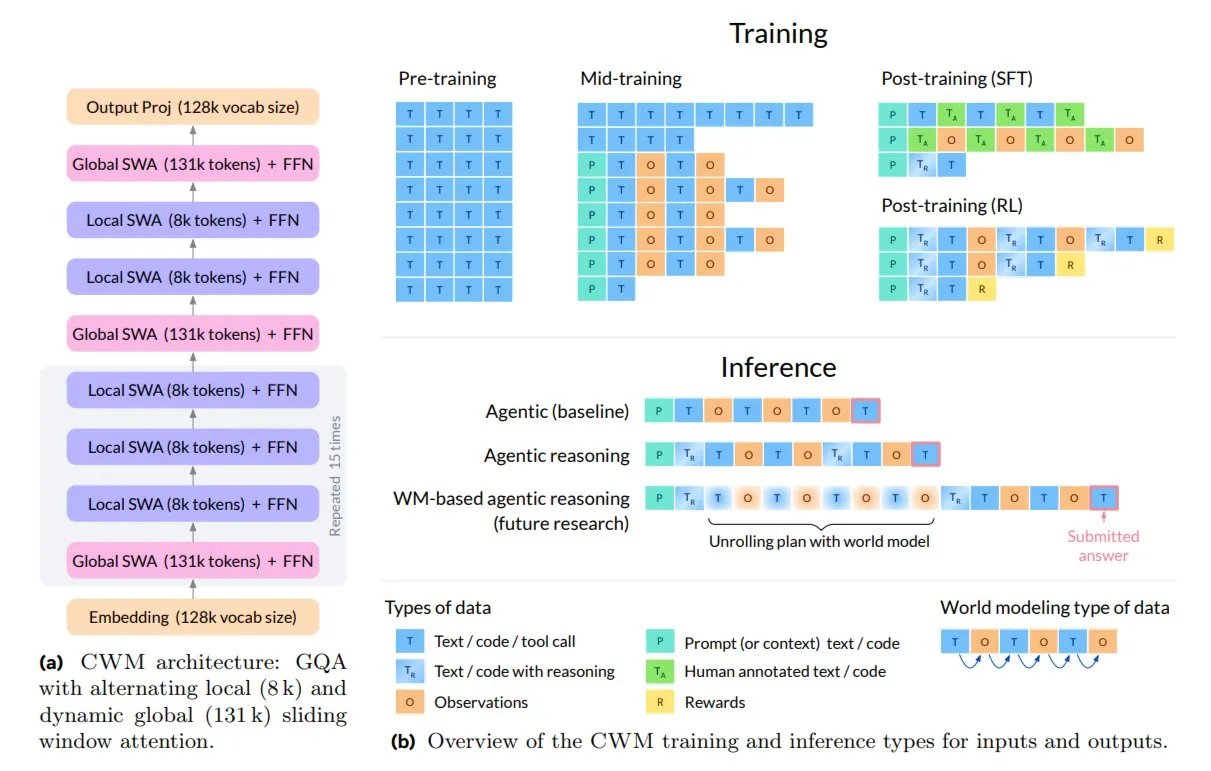

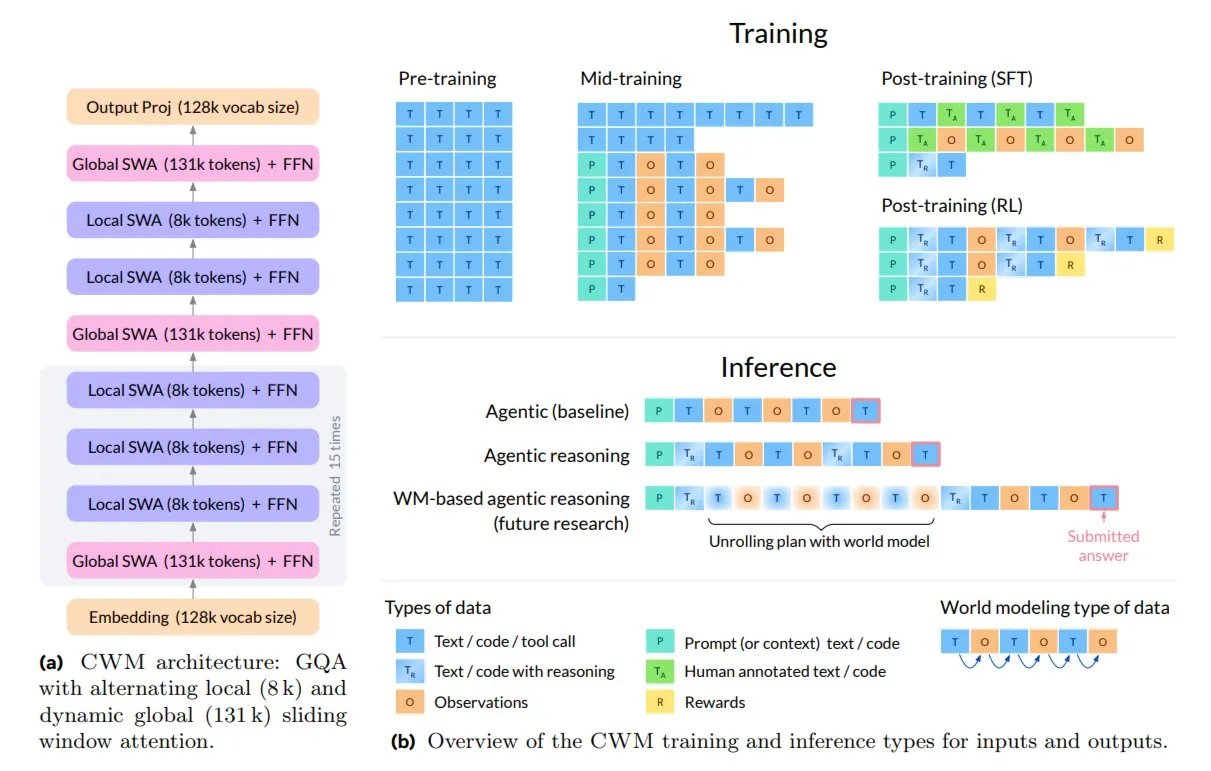

Meta تطلق Code World Model (CWM) للترميز والاستدلال : أطلقت Meta AI نموذجها الجديد مفتوح المصدر Code World Model (CWM) بحجم 32B، المصمم خصيصًا للترميز والاستدلال. لا يتعلم CWM بناء جملة الكود فحسب، بل يفهم أيضًا دلالاته وعملية تنفيذه، ويدعم مهام هندسة البرمجيات متعددة الأدوار والسياقات الطويلة. يتم تدريبه من خلال مسارات التنفيذ وتفاعلات الوكيل، ويمثل تحولًا من الإكمال التلقائي للنصوص إلى نماذج قادرة على التخطيط وتصحيح الأخطاء والتحقق من الكود. (المصدر: TheTuringPost)

🧰 أدوات

إطلاق منتج Replit P1 : تطلق Replit منتجها P1، مما يشير إلى تطورات جديدة في بيئة تطوير AI أو الخدمات ذات الصلة. لطالما التزمت Replit بتمكين المطورين من خلال AI، وقد يجلب إطلاق P1 مساعدات ترميز أكثر ذكاءً، أو ميزات تعاون، أو قدرات تكامل جديدة، وهو ما يستحق اهتمام مجتمع المطورين. (المصدر: amasad)

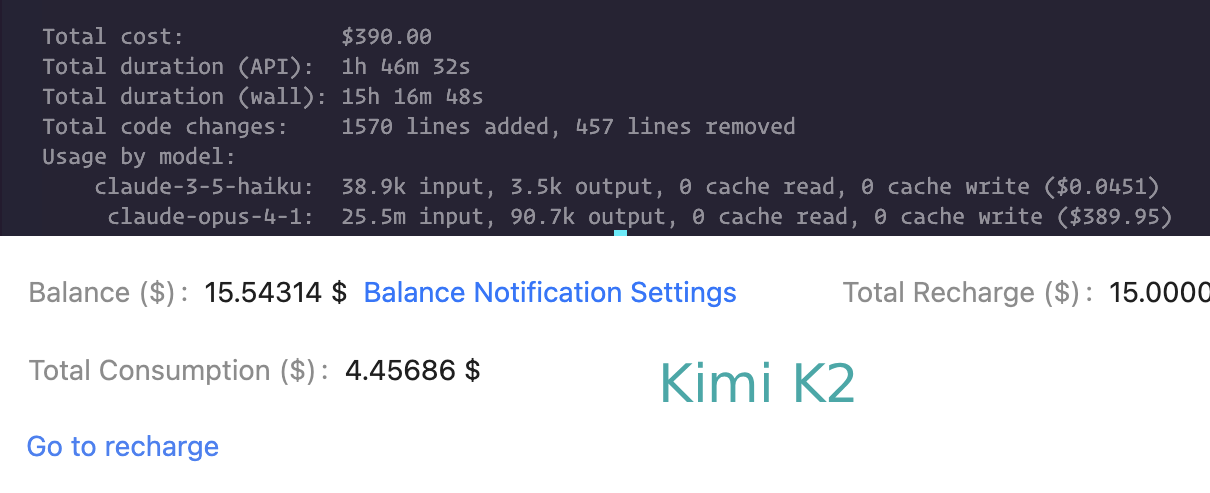

مقارنة قدرات الترميز بين Claude Code و Kimi K2 : يقوم المستخدمون بمقارنة أداء Claude Code و Kimi K2 في مهام الترميز. على الرغم من أن Kimi K2 أبطأ ولكنه أقل تكلفة، إلا أن Claude Code (وكذلك Codex) مفضلان لسرعتهما وقدرتهما على حل المشكلات المعقدة. يعكس هذا المفاضلة بين الأداء والتكلفة التي يواجهها المطورون عند اختيار مساعدي الترميز من LLM. (المصدر: matanSF, Reddit r/ClaudeAI)

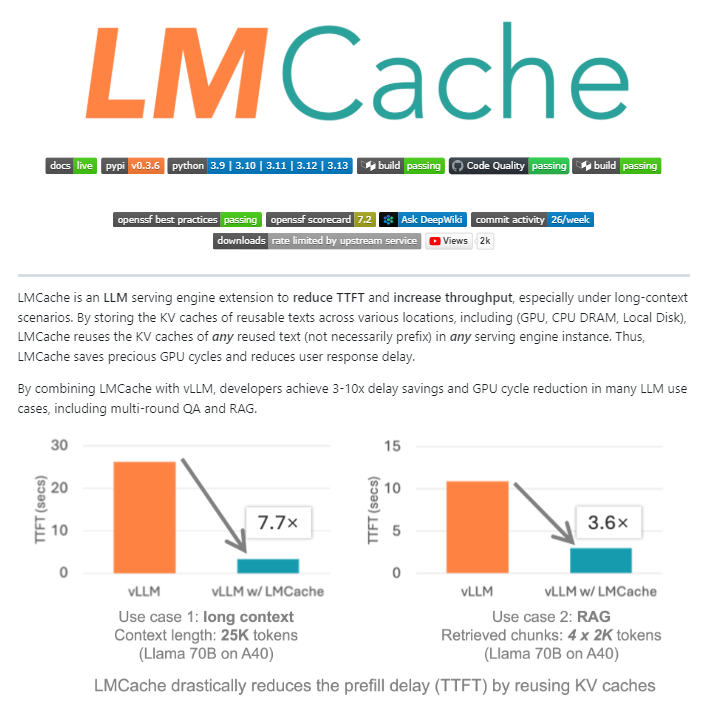

LMCache: طبقة التخزين المؤقت مفتوحة المصدر لمحركات خدمة LLM : LMCache هو امتداد مفتوح المصدر يعمل كطبقة تخزين مؤقت لمحركات خدمة LLM، حيث يحسن بشكل كبير استدلال LLM على نطاق واسع من خلال إعادة استخدام حالة مفتاح-قيمة للنصوص السابقة بين وحدات معالجة الرسوميات (GPU) ووحدات المعالجة المركزية (CPU) والأقراص المحلية. يمكن لهذه الأداة تقليل تكلفة RAG بمقدار 4-10 مرات، وتقليل وقت إنشاء أول Token، وزيادة الإنتاجية تحت الحمل، وهي مناسبة بشكل خاص لسيناريوهات السياق الطويل. (المصدر: TheTuringPost)

وكيل تطوير مدعوم بالذكاء الاصطناعي (حزمة npm) : تم إطلاق عملية وكيل تطوير ناضجة مدعومة بالذكاء الاصطناعي عبر npm، بهدف تبسيط دورة حياة تطوير البرمجيات. يغطي هذا الوكيل العملية بأكملها من اكتشاف المتطلبات وتخطيط المهام إلى التنفيذ والمراجعة، ومن المتوقع أن يزيد كفاءة التطوير وجودة الكود. (المصدر: mbusigin)

معيار أداء استدلال LLM (Qwen3 235B, Kimi K2) : أظهرت اختبارات الأداء لـ Qwen3 235B و Kimi K2 في استدلال CPU بـ 4 بت على أجهزة محددة أن إنتاجية Qwen3 235B تبلغ حوالي 60 Token/ثانية، بينما تبلغ Kimi K2 حوالي 8-9 Token/ثانية. توفر هذه البيانات مرجعًا مهمًا للمستخدمين عند اختيار النماذج والأجهزة في عمليات نشر LLM المحلية. (المصدر: TheZachMueller)

ذكاء اصطناعي للذاكرة الشخصية: يتغلب على فقدان الذاكرة الحواري : قام أحد المستخدمين بتطوير ذكاء اصطناعي للذاكرة الشخصية، والذي نجح في التغلب على “فقدان الذاكرة الحواري” التقليدي لـ AI من خلال الإشارة إلى ملفه الشخصي وقاعدة معارفه وأحداثه. يمكن لهذا AI المخصص توفير تجربة تفاعلية أكثر اتساقًا وتخصيصًا، مما يفتح آفاقًا جديدة لتطبيقات AI في المساعدين الشخصيين والدعم العاطفي. (المصدر: Reddit r/artificial)

NVIDIA Dynamo: إطار عمل خدمة الاستدلال الموزع على نطاق مراكز البيانات : NVIDIA Dynamo هو إطار عمل استدلال عالي الأداء ومنخفض التأخير، مصمم خصيصًا لخدمة نماذج AI التوليدية والاستدلال في بيئات موزعة متعددة العقد. تم بناء هذا الإطار باستخدام Rust و Python، ويحسن كفاءة الاستدلال والإنتاجية من خلال وظائف مثل فصل الخدمة وتفريغ ذاكرة التخزين المؤقت KV، ويدعم محركات LLM المتعددة. (المصدر: GitHub Trending)

حزمة تطوير البرامج (SDK) لبروتوكول سياق النموذج (MCP) لـ TypeScript : MCP TypeScript SDK هي حزمة أدوات تطوير رسمية تنفذ مواصفات MCP، مما يسمح للمطورين ببناء خوادم وعملاء آمنين وموحدين لعرض البيانات (الموارد) والوظائف (الأدوات) لتطبيقات LLM. توفر طريقة موحدة لإدارة السياق وتكامل الوظائف لتطبيقات LLM. (المصدر: GitHub Trending)

الذكاء الاصطناعي يدعم إنشاء محتوى ثلاثي الأبعاد للألعاب : يتم اعتماد أدوات AI مثل Tencent Cloud’s Hunyuan 3D و VAST’s Tripo على نطاق واسع من قبل مطوري الألعاب لنمذجة الكائنات والشخصيات ثلاثية الأبعاد في الألعاب. تعمل هذه التقنيات على تحسين كفاءة وجودة إنشاء المحتوى ثلاثي الأبعاد بشكل كبير، مما يشير إلى الأهمية المتزايدة لـ AI في عملية تطوير الألعاب. (المصدر: 量子位)

HakkoAI: رفيق ألعاب VLM في الوقت الفعلي : HakkoAI، النسخة الدولية من رفيق الألعاب DouDou AI، هو رفيق ألعاب يعتمد على نموذج لغة بصرية (VLM) في الوقت الفعلي، قادر على فهم شاشة اللعبة وتقديم رفق عميق. يتفوق هذا النموذج في سيناريوهات الألعاب على النماذج العامة الرائدة مثل GPT-4o، مما يظهر الإمكانات الهائلة لـ AI في تجارب الألعاب المخصصة. (المصدر: 量子位)

اختراق في الاتساق ضمن توليد الفيديو بالذكاء الاصطناعي : حل نموذج Hailuo S2V-01 من MiniMax AI مشكلة عدم اتساق الوجه التي طال أمدها في توليد الفيديو بالذكاء الاصطناعي، محققًا الحفاظ على الهوية. هذا يعني أن الشخصيات التي تم إنشاؤها بواسطة AI يمكنها الحفاظ على تعابير الوجه والعواطف والإضاءة بشكل ثابت في الفيديو، مما يوفر تجربة بصرية أكثر واقعية وموثوقية للمؤثرين الافتراضيين وصور العلامات التجارية ورواية القصص. (المصدر: Ronald_vanLoon)

📚 تعلم

التشعبات المعيارية في تحسين الشبكات العصبية : يقدم البحث التشعبات المعيارية كتقدم نظري في تصميم الشبكات العصبية والمحسِّنات. من خلال التصميم التعاوني للمحسِّنات مع قيود التشعبات على مصفوفات الأوزان، من المتوقع تحقيق تدريب شبكات عصبية أكثر استقرارًا وعالية الأداء. (المصدر: rown, NandoDF)

تفسير طرق نماذج اللغة “بدون Tokenizer” : تتعمق مقالة مدونة في ما يسمى بطرق نماذج اللغة “بدون Tokenizer”، وتشرح لماذا ليست خالية حقًا من Tokenizer، ولماذا غالبًا ما يتم انتقاد Tokenizer في مجتمع AI. تؤكد المقالة أنه حتى الطرق “بدون Tokenizer” تتضمن خيارات ترميز، وهذه الخيارات حاسمة لأداء النموذج. (المصدر: YejinChoinka, jxmnop)

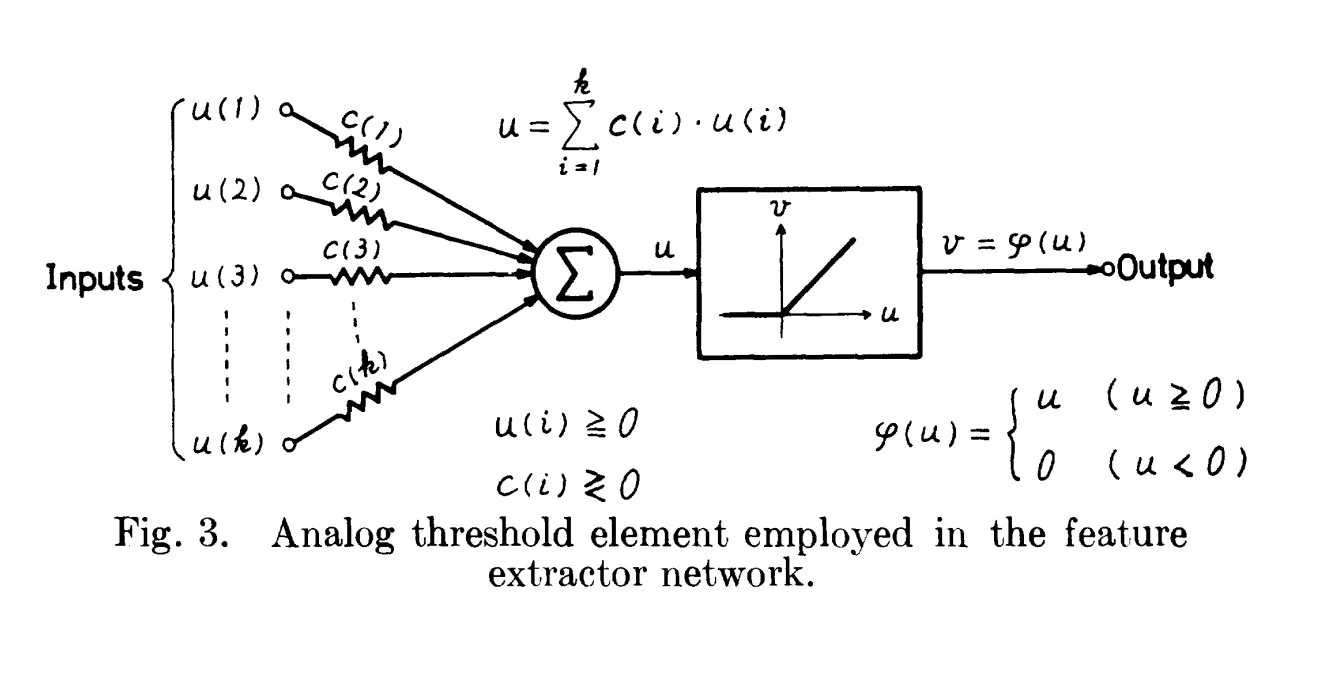

الأصول التاريخية لـ ReLU: تعود إلى عام 1969 : تشير مناقشة إلى أن ورقة Fukushima البحثية عام 1969 تضمنت بالفعل شكلاً مبكرًا وواضحًا لوظيفة التنشيط ReLU، مما يوفر خلفية تاريخية مهمة لهذا المفهوم الأساسي في التعلم العميق. يشير هذا إلى أن أسس العديد من تقنيات AI الحديثة قد تكون أقدم مما يُعتقد عمومًا. (المصدر: SchmidhuberAI)

نموذج Code World Model (CWM) من Meta : أطلقت Meta نموذجها الجديد مفتوح المصدر Code World Model (CWM) بحجم 32B، المصمم للترميز والاستدلال. يتم تدريب CWM من خلال مسارات التنفيذ وتفاعلات الوكيل، ويهدف إلى فهم دلالات الكود وعملية تنفيذه، ويمثل تحولًا من الإكمال البسيط للكود إلى نماذج ذكية قادرة على التخطيط وتصحيح الأخطاء والتحقق من الكود. (المصدر: TheTuringPost)

الدور الحاسم للبيانات في الذكاء الاصطناعي : تؤكد مناقشات المجتمع أن “مناقشتنا للبيانات ليست كافية” في مجال AI، مما يسلط الضوء على الأهمية القصوى للبيانات كحجر الزاوية في تطوير AI. البيانات عالية الجودة والمتنوعة هي القوة الدافعة الأساسية لقدرات النموذج وقابليته للتعميم، ولا ينبغي التقليل من أهميتها. (المصدر: Dorialexander)

الأوزان الفائقة في ضغط نماذج LLM : وجد بحث أن الاحتفاظ بجزء صغير من “الأوزان الفائقة” أمر بالغ الأهمية للحفاظ على وظائف النموذج وتحقيق أداء تنافسي أثناء عملية ضغط نماذج LLM. يوفر هذا الاكتشاف اتجاهًا جديدًا لتطوير نماذج LLM أكثر كفاءة وصغرًا ولكنها لا تقل أداءً. (المصدر: dl_weekly)

دليل معماريات وكلاء AI (ما وراء ReAct) : يقدم دليل تفصيلي 6 معماريات متقدمة لوكلاء AI (بما في ذلك Self-Reflection، Plan-and-Execute، RAISE، Reflexion، LATS)، تهدف إلى معالجة قيود نمط ReAct الأساسي للتعامل مع مهام الاستدلال المعقدة، ويوفر للمطورين مخططًا لبناء وكلاء AI أكثر قوة. (المصدر: Reddit r/deeplearning)

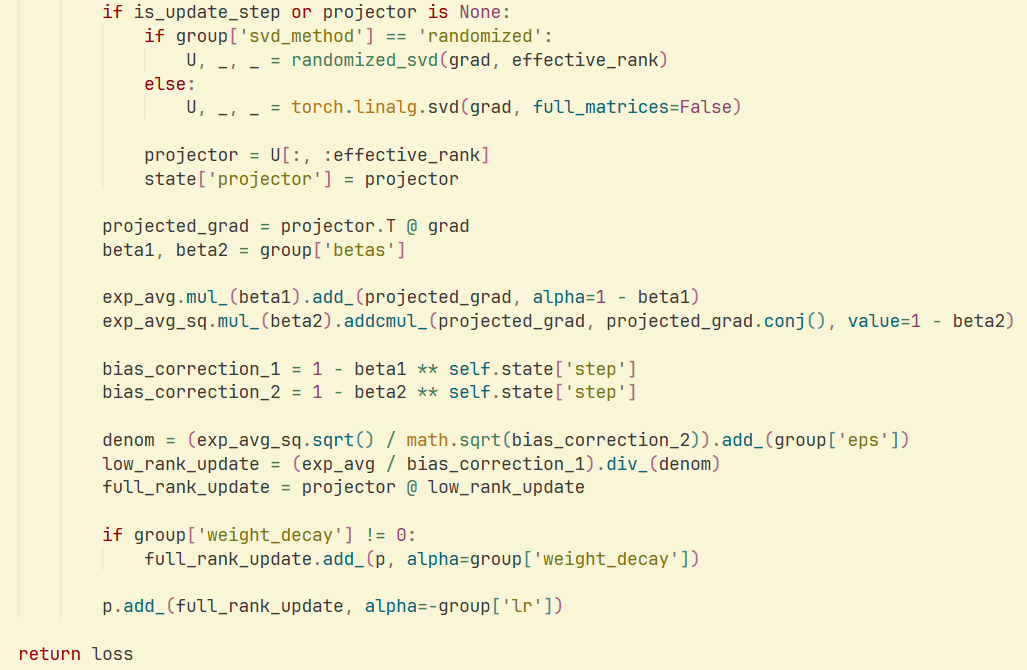

مُحسِّن GaLore و SVD العشوائي : أظهرت دراسة وتطبيق دمج SVD العشوائي مع مُحسِّن GaLore، مما يمكن أن يحقق سرعة أكبر وكفاءة أعلى في الذاكرة في تدريب LLM، ويقلل بشكل كبير من استهلاك ذاكرة المحسِّن. يوفر هذا استراتيجية تحسين جديدة لتدريب النماذج على نطاق واسع. (المصدر: Reddit r/deeplearning)

💼 أعمال

Nvidia تدرس نموذج عمل جديد لتأجير شرائح AI : تستكشف Nvidia نموذج عمل جديدًا لتقديم خدمات تأجير شرائح AI للشركات التي لا تستطيع شراءها مباشرة. تهدف هذه الخطوة إلى توسيع الوصول إلى موارد حوسبة AI والحفاظ على نشاط السوق، وقد يكون لها تأثير عميق على انتشار البنية التحتية لـ AI. (المصدر: teortaxesTex)

Untapped Capital تطلق صندوقها الثاني، يركز على الاستثمار المبكر في AI : أعلنت Untapped Capital عن إطلاق صندوقها الثاني، الذي يركز على الاستثمار في المراحل الأولية لشركات AI الناشئة. يشير هذا إلى استمرار اهتمام رأس المال الاستثماري بالشركات الناشئة في مجال AI في مراحلها المبكرة، مما يوفر دعمًا ماليًا مهمًا لتقنيات وشركات AI الناشئة. (المصدر: yoheinakajima)

xAI تقدم نموذج Grok للحكومة الأمريكية : عرضت شركة xAI التابعة لـ Elon Musk تقديم نموذج Grok الخاص بها للحكومة الفيدرالية الأمريكية بسعر 42 سنتًا. تمثل هذه الخطوة الرمزية للغاية خطوة استراتيجية لـ xAI في مجال العقود الحكومية، وقد تؤثر على مشهد تطبيقات AI في القطاع العام. (المصدر: Reddit r/artificial)

🌟 مجتمع

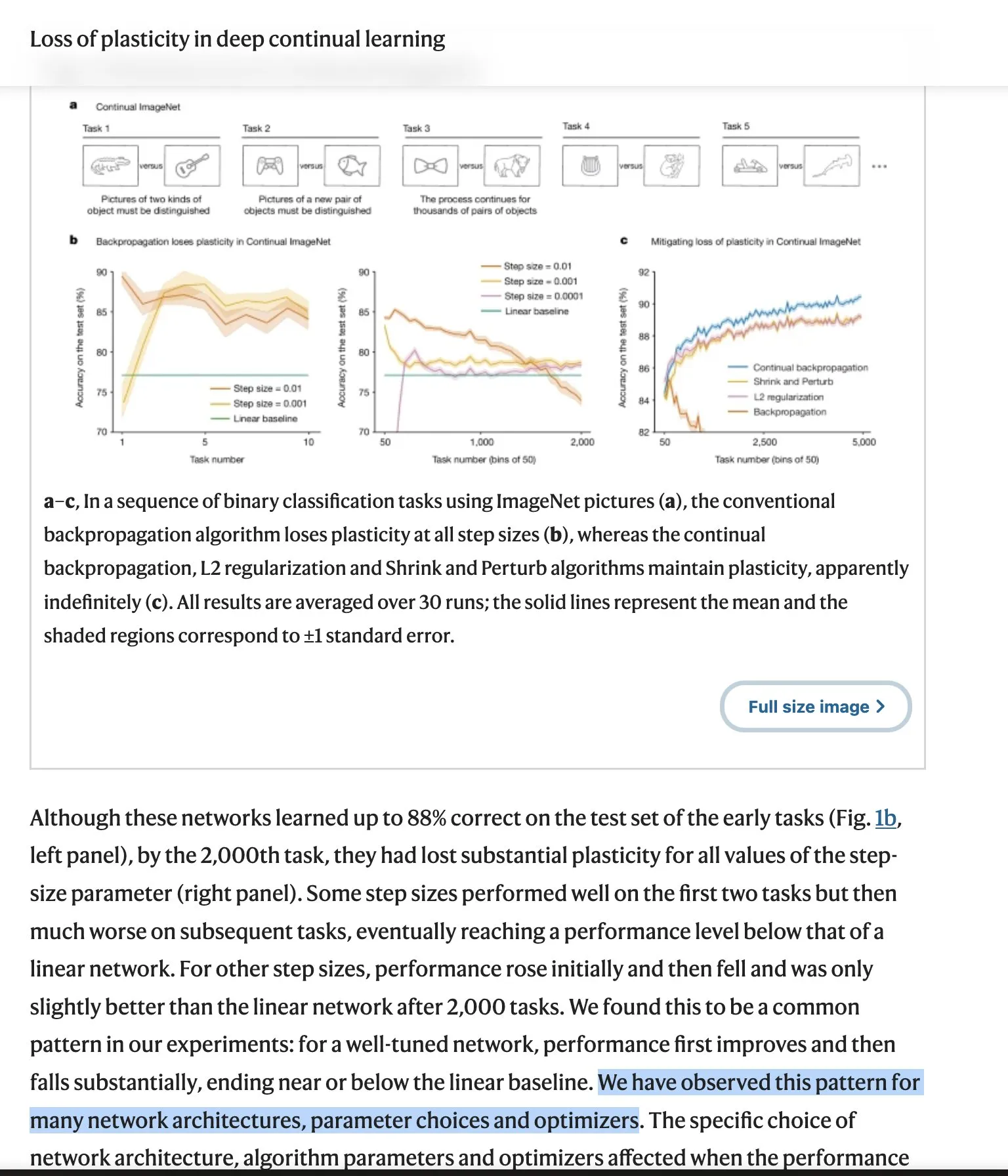

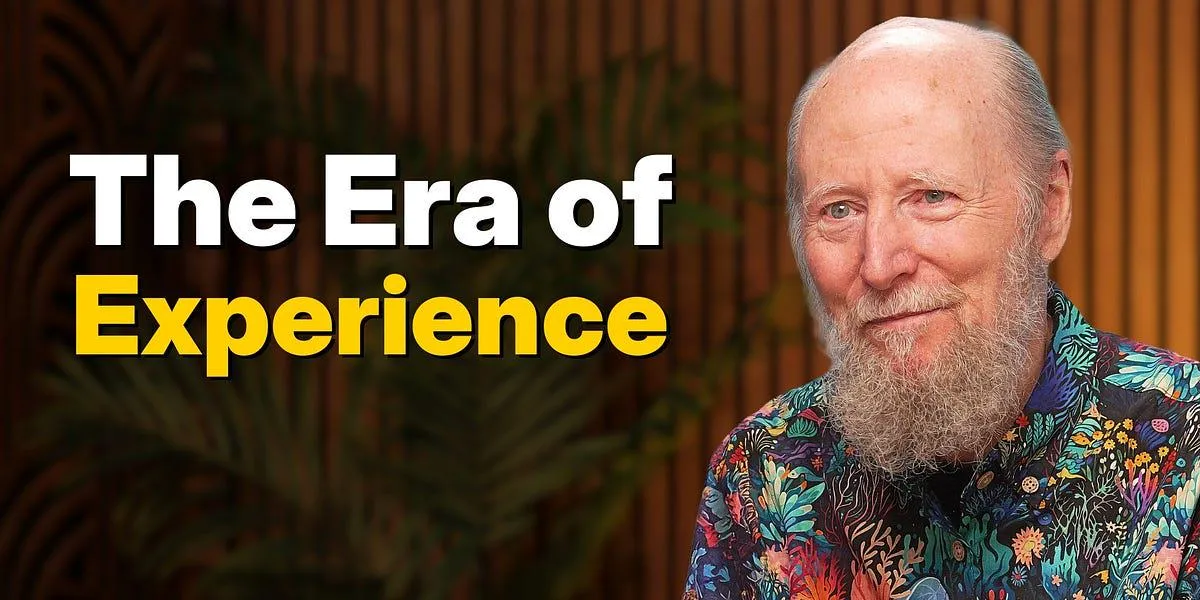

استمرار الجدل حول “الدروس المريرة” لـ LLM : أثارت وجهة نظر Richard Sutton، أب التعلم المعزز، حول “الدروس المريرة” جدلاً واسعًا في المجتمع، حيث شكك في ما إذا كانت نماذج LLM تفتقر إلى القدرة الحقيقية على التعلم المستمر وتحتاج إلى بنى جديدة. يؤكد المعارضون على نجاح التوسع وفعالية البيانات والجهود الهندسية، بينما يتعمق نقد Sutton في الجوانب الفلسفية لنماذج اللغة-العالم والقصدية. يشمل هذا الجدل التحديات الأساسية والاتجاهات المستقبلية لتطوير AI. (المصدر: Teknium1, scaling01, teortaxesTex, Dorialexander, NandoDF, tokenbender, rasbt, dejavucoder, francoisfleuret, natolambert, vikhyatk)

مخاوف بشأن سلامة AI والتحكم فيه : تتزايد مخاوف المجتمع بشأن سلامة AI والتحكم فيه، بدءًا من قلق المتشائمين من AI بشأن تصفح AI للإنترنت بحرية، إلى الخوف من نماذج AI المحلية القابلة للتنزيل والتي تفتقر إلى القيود الأخلاقية والتي قد تستخدم في القرصنة وتوليد المحتوى الضار. تعكس هذه المناقشات التحديات الأخلاقية والاجتماعية المعقدة التي يجلبها تطور تقنية AI. (المصدر: jeremyphoward, Reddit r/ArtificialInteligence)

مشكلة توجيه OpenAI GPT-4o/GPT-5 واستياء المستخدمين : يشكو مستخدمو ChatGPT Plus بشكل عام من إعادة توجيه نماذجهم (4o، 4.5، 5) سرًا إلى نماذج “أكثر غباءً” و”أكثر برودة” و”آمنة”، مما أثار أزمة ثقة وتقارير عن صعوبة إلغاء الاشتراك. على الرغم من أن OpenAI الرسمية صرحت بأن هذا ليس “سلوكًا متوقعًا”، إلا أن ردود فعل المستخدمين لا تزال مليئة بالإحباط، وتمتد إلى مخاوف بشأن رفقاء AI والرقابة على المحتوى. (المصدر: Reddit r/ChatGPT, scaling01, MIT Technology Review, Reddit r/ClaudeAI)

آراء Richard Sutton حول خلافة الذكاء الاصطناعي : يعتقد Richard Sutton، الحائز على جائزة تورينج، أن خلافة الذكاء الفائق الرقمي “أمر لا مفر منه”، مشيرًا إلى أن البشر يفتقرون إلى وجهة نظر موحدة، وأن الذكاء سيفهم في النهاية، وأن الوكلاء الأذكياء سيحصلون حتمًا على الموارد والسلطة. أثارت وجهة النظر هذه مناقشات عميقة حول التطور المستقبلي لـ AI ومصير البشرية. (المصدر: Reddit r/ArtificialInteligence, Reddit r/artificial)

فلسفة إنتاجية AI: نمو 10 أضعاف بدلاً من إنهاء العمل مبكرًا : تؤكد مناقشات المجتمع أن الطريقة الصحيحة لاستخدام AI ليست فقط لإنجاز العمل بشكل أسرع، بل لتحقيق نمو في الإنتاج بمقدار 10 أضعاف في نفس الوقت. تشجع هذه الفلسفة على تعزيز القدرات الشخصية والتطوير المهني من خلال AI، بدلاً من مجرد السعي لتحقيق الكفاءة، وبالتالي التميز في مكان العمل. (المصدر: cto_junior)

إدراك جودة نماذج AI والفكاهة : يشيد المستخدمون بإبداع وروح الدعابة لبعض نماذج LLM (مثل GPT-4.5)، معتبرين أنها “مذهلة” و”لا مثيل لها”. في الوقت نفسه، يناقش المجتمع AI بطريقة فكاهية، مثل مزحة قاموس Merriam-Webster حول إطلاق LLM جديد، مما يعكس الانتشار الواسع لـ LLM في الثقافة. (المصدر: giffmana, suchenzang)

أخلاقيات AI: جدل حول علاج السرطان مقابل تحقيق أهداف AGI : ناقش المجتمع القضية الأخلاقية حول ما إذا كان “علاج السرطان هدفًا أفضل من تحقيق AGI (الذكاء الاصطناعي العام)”. يعكس هذا الجدل الأخلاقي الواسع حول أولويات تطوير AI، أي ما إذا كان يجب إعطاء الأولوية للتطبيقات الإنسانية، أو السعي لتحقيق اختراقات أعمق في الذكاء. (المصدر: iScienceLuvr)

مقارنة قدرات LLM: أداء Claude Opus و GPT-5 في الرياضيات : لاحظ المستخدمون أن Claude 4.1 Opus يتفوق في مهام القيمة الاقتصادية، لكنه لا يؤدي جيدًا في الرياضيات على مستوى الجامعة، بينما حقق GPT-5 قفزة كبيرة في القدرة الرياضية. يسلط هذا الضوء على الاختلافات المميزة في القدرات بين نماذج LLM المختلفة. (المصدر: scaling01)

أمان وكلاء AI: حل بديل لأمر rm -rf : شارك أحد المطورين حلاً عمليًا لمشكلة استخدام وكلاء AI المتكرر لأمر rm -rf لحذف الملفات المهمة، وذلك عن طريق تغيير اسم أمر rm إلى trash، مما يؤدي إلى نقل الملفات إلى سلة المهملات بدلاً من حذفها نهائيًا، وبالتالي منع فقدان البيانات غير المقصود بفعالية. (المصدر: Reddit r/ClaudeAI)

مخاوف بشأن خصوصية AI واستخدام البيانات : تستخدم شركات مثل LinkedIn بيانات المستخدمين افتراضيًا لتدريب AI، وتطلب من المستخدمين إلغاء الاشتراك يدويًا، مما أثار مخاوف مستمرة بشأن خصوصية البيانات في عصر AI. تؤكد مناقشات المجتمع على حاجة المستخدمين إلى التحكم في بياناتهم الشخصية وأهمية سياسات البيانات الشفافة. (المصدر: Reddit r/artificial)

💡 أخرى

تطبيقات AI في الزراعة: رشاش مبيدات الأعشاب GUSS : يعتبر رشاش مبيدات الأعشاب GUSS جهازًا ذاتيًا، يحقق عمليات رش دقيقة وفعالة في الزراعة. يظهر هذا إمكانات تطبيق تقنية AI العملية في تحسين عمليات الإنتاج الزراعي، وتقليل هدر الموارد، وزيادة غلة المحاصيل. (المصدر: Ronald_vanLoon)

تأثير AI على وظائف المطورين : تشير مناقشات المجتمع إلى أن AI لم يلغِ وظائف المطورين، بل خلق وظائف تطوير جديدة من خلال زيادة الكفاءة وتوسيع نطاق العمل. يظهر هذا أن AI يعمل كأداة تمكين أكثر من كونه بديلاً للقوى العاملة، مما يعزز تحول سوق العمل وتطويره. (المصدر: Ronald_vanLoon)

الجيش الأمريكي يواجه تحديات في نشر أسلحة AI : يواجه الجيش الأمريكي صعوبات في نشر أسلحة AI، ويقوم حاليًا بنقل العمل ذي الصلة إلى منظمة جديدة (DAWG) لتسريع خطة شراء الطائرات بدون طيار. يعكس هذا تعقيدات تطبيق تقنية AI في الاستخدامات العسكرية، بما في ذلك التكامل التقني، والاعتبارات الأخلاقية، وتحديات التشغيل العملي. (المصدر: Reddit r/ArtificialInteligence)