关键词:NVIDIA, OpenAI, AI数据中心, Claude Sonnet 4.5, GLM-4.6, DeepSeek-V3.2, AI监管, VERA RUBIN平台, Claude Agent SDK, 稀疏注意力机制, SB 53法案, AI视频生成

🔥 聚焦

NVIDIA向OpenAI投资1000亿美元建设10GW AI数据中心 : NVIDIA宣布向OpenAI投资1000亿美元,用于建设一个10吉瓦(相当于10座核电站)的AI数据中心,该中心将基于NVIDIA的VERA RUBIN平台。此举预示着AI计算基础设施的巨大飞跃,可能重塑AI经济格局,并引发对小型竞争者和能源环境可持续性的深远影响。

(来源:Reddit r/ArtificialInteligence)

Gemini核心人物Dustin Tran加盟xAI : 前谷歌DeepMind资深研究员、Gemini DeepThink的共同创造者Dustin Tran宣布加入马斯克的xAI。Tran在谷歌期间主导了Gemini系列模型的开发,在IMO和ICPC等竞赛中展现出SOTA级推理能力。他表示选择xAI是看重其庞大算力(包括数十万张GB200芯片)、数据策略(RL和后训练的规模化)以及马斯克的硬核理念,并对OpenAI的创新能力提出质疑。

(来源:量子位, teortaxesTex)

加州签署首部AI安全法案SB 53 : 加利福尼亚州州长签署了SB 53法案,为前沿AI公司设定了透明度要求,旨在提供更多关于AI系统及其开发公司的数据。Anthropic对该法案表示支持,这标志着AI监管在地方层面取得重要进展,强调了AI公司在系统开发和数据透明度方面的责任。

(来源:AnthropicAI, Reddit r/ArtificialInteligence)

🎯 动向

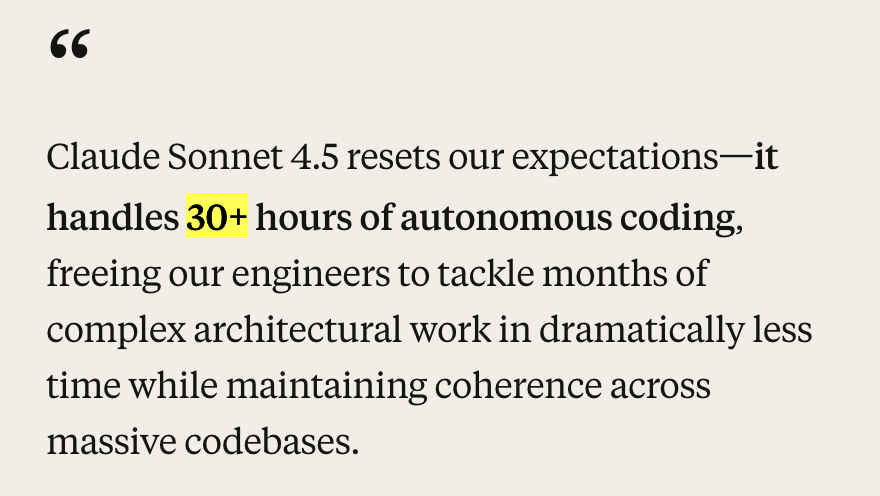

Anthropic发布Claude Sonnet 4.5及生态更新 : Anthropic推出Claude Sonnet 4.5模型,被誉为全球最佳编码模型,在SWE-Bench基准测试中取得SOTA成绩(77.2%/82.0%),并在agentic任务中展现出30+小时的自主编码能力。新模型在安全性、对齐、奖励欺骗、欺骗和奉承方面有显著进步,并优化了对话上下文压缩能力,能够更好地进行“状态管理”或“记笔记”。同时,Anthropic还发布了Claude Code 2.0、API更新(上下文编辑、记忆工具)、VS Code扩展、Claude Chrome扩展及Imagine with Claude等一系列生态更新,旨在提升其在编码、代理构建和日常任务中的表现。

(来源:Yuchenj_UW, scaling01, cline, akbirkhan, EthanJPerez, akbirkhan, zachtratar, EigenGender, dotey, claude_code, max__drake, scaling01, scaling01, akbirkhan, swyx, Reddit r/ArtificialInteligence, Reddit r/artificial)

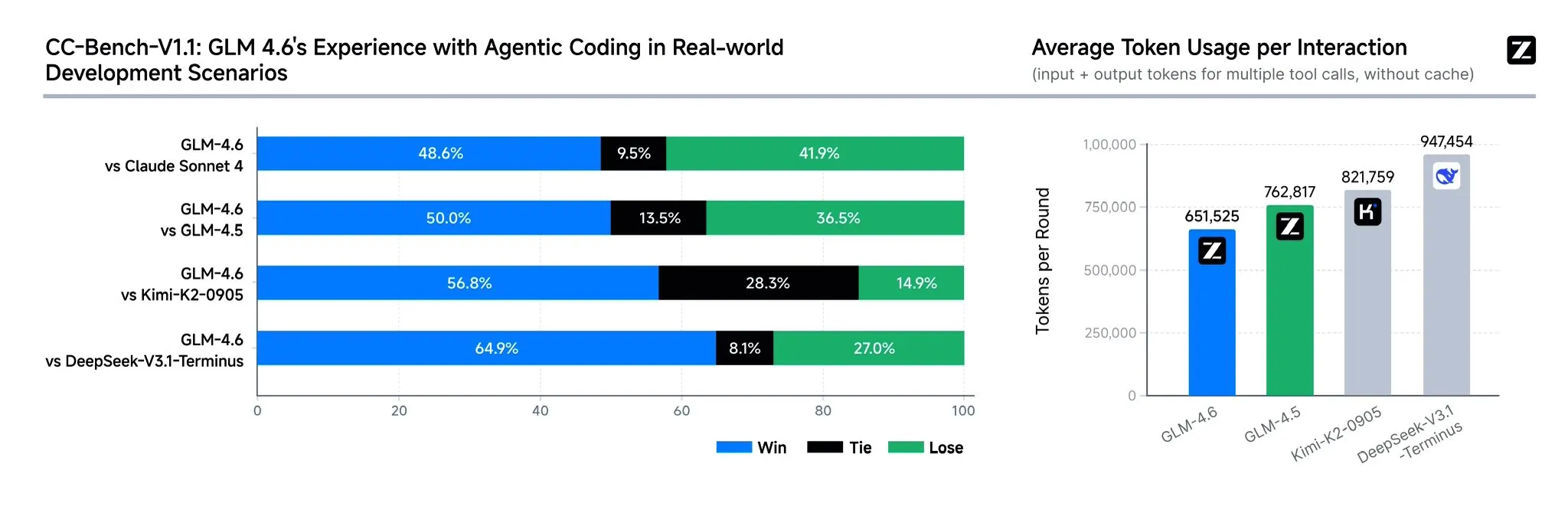

智谱AI发布GLM-4.6模型 : 智谱AI推出GLM-4.6语言模型,相较于GLM-4.5有多项显著提升,包括上下文窗口从128K扩展到200K tokens,以处理更复杂的代理任务。该模型在编码基准测试和真实应用(如Claude Code、Cline、Roo Code和Kilo Code)中表现更强,尤其在生成精美前端页面方面有所改进。GLM-4.6还提升了推理能力和推理时工具使用,增强了代理性能,并更好地与人类偏好保持一致。它在多项基准测试中表现出与Claude Sonnet 4和DeepSeek-V3.1-Terminus的竞争力,并计划很快在Hugging Face和ModelScope上开源。

(来源:teortaxesTex, scaling01, teortaxesTex, Tim_Dettmers, Teknium1, Zai_org, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA)

OpenAI推出ChatGPT即时结账功能及Sora 2视频社交应用 : OpenAI在美国推出“Instant Checkout”即时结账功能,允许用户在ChatGPT内直接完成购物,与Etsy和Shopify合作,并开源了Agentic Commerce Protocol。此举旨在打造生态闭环,提升购物体验。此外,OpenAI正准备推出一个类似TikTok的AI生成视频社交应用Sora 2,用户可创建最长10秒的视频片段。这些动作表明OpenAI在加速商业化变现,可能对现有电商和短视频市场产生冲击。

(来源:OpenAI要刮油,谁会掉层皮?, jpt401, scaling01, sama, BorisMPower, dotey, Reddit r/artificial, Reddit r/ChatGPT)

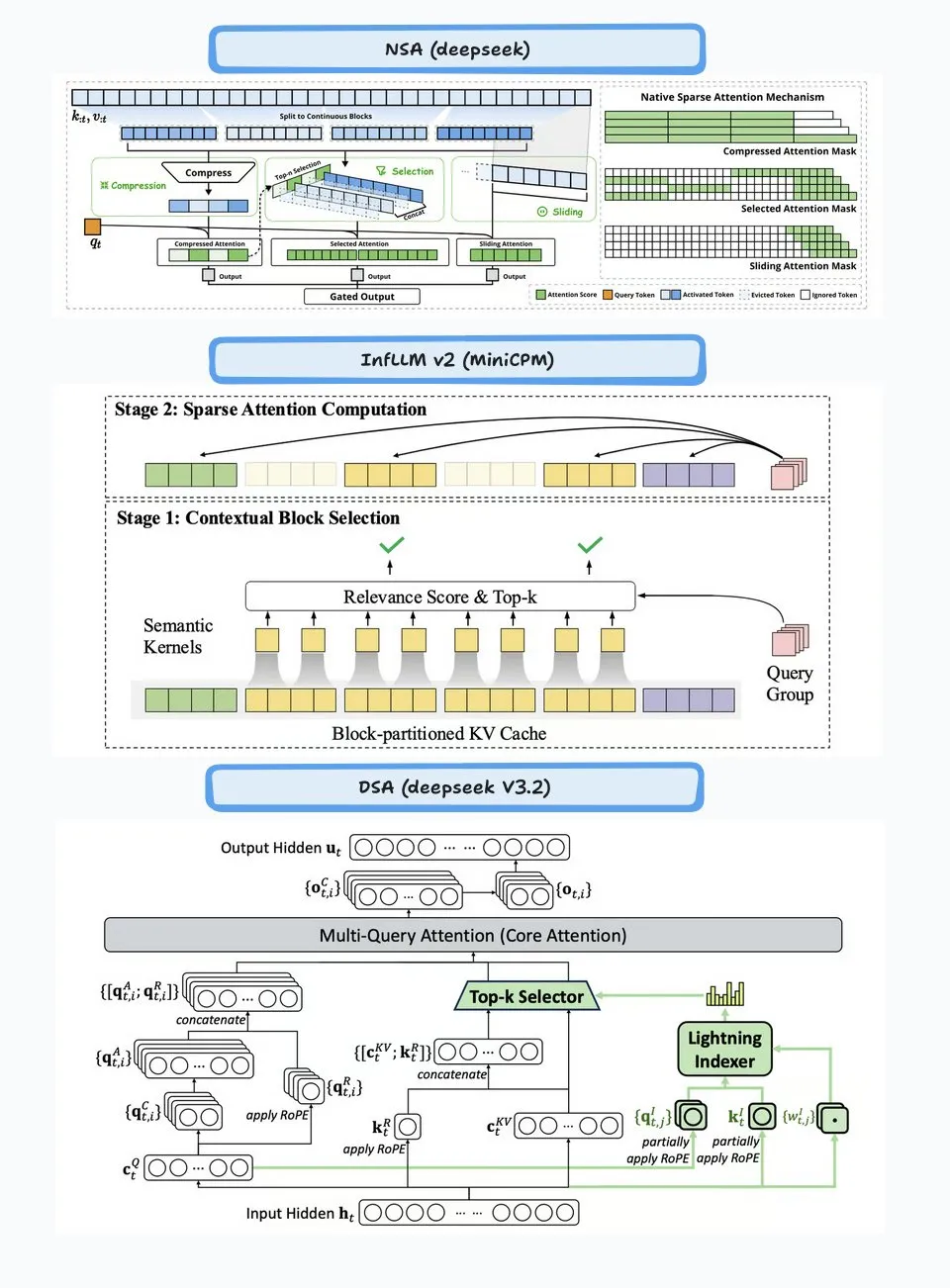

DeepSeek-V3.2-Exp发布,引入稀疏注意力机制 : DeepSeek发布了实验性模型DeepSeek-V3.2-Exp,其核心亮点是引入了DeepSeek稀疏注意力(DSA)机制,旨在提高长上下文推理的效率和性能。该模型在编码、工具使用和长上下文推理方面表现出色,并支持华为昇腾和寒武纪等中国芯片,同时API价格下调50%以上。然而,有社区反馈指出,该模型在记忆和推理方面存在退化,可能导致重复信息、逻辑步骤遗忘和死循环,表明其仍处于探索阶段。

(来源:yupp_ai, Yuchenj_UW, woosuk_k, ZhihuFrontier)

Google Gemini模型更新与API弃用 : Google宣布弃用Gemini 1.5系列模型(pro, flash, flash-8b),推荐用户转向Gemini 2.5系列(pro, flash, flash-lite),并提供了新的预览模型gemini-2.5-flash-preview-09-2025和gemini-2.5-flash-lite-preview-09-2025。此外,Gemini API正积极演进以支持Agentic用例,预示着未来AI代理将更深入地整合到应用中。

(来源:_philschmid, osanseviero)

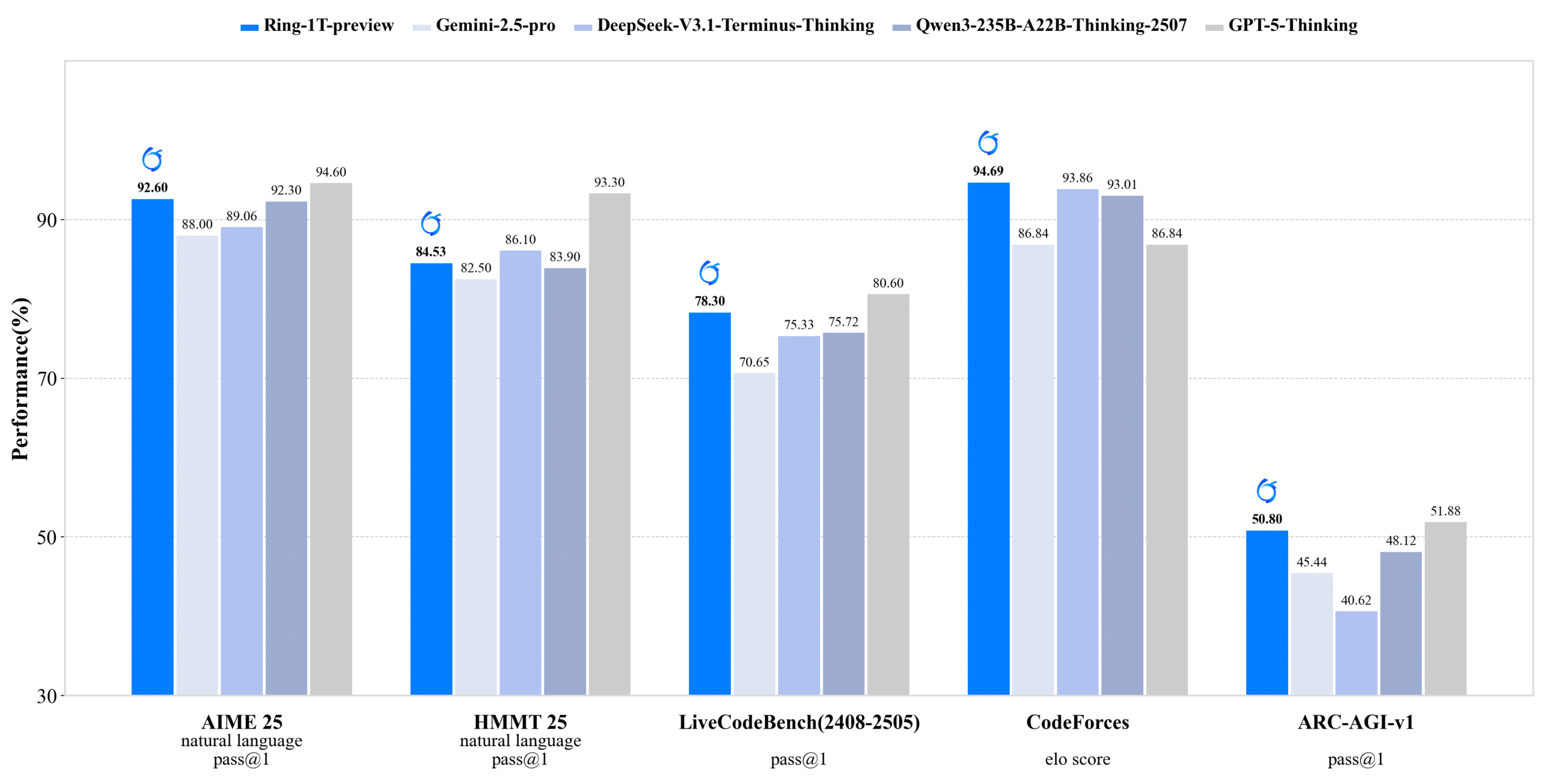

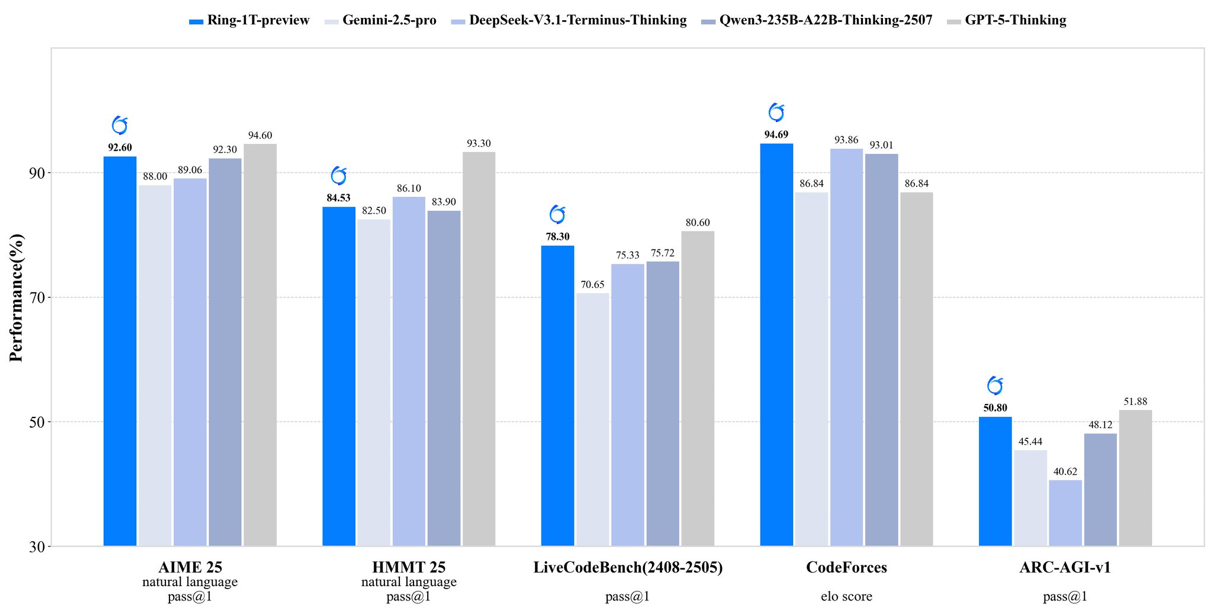

inclusionAI发布Ring-1T-preview:万亿参数开源推理模型 : inclusionAI发布了Ring-1T-preview,这是首个万亿参数级别的开源“思维模型”(thinking model),激活参数为50B。该模型在自然语言处理任务(如AIME25、HMMT25、ARC-AGI-1)中取得了早期SOTA结果,甚至能一次性解决IMO25 Q3问题。该模型的发布标志着开源社区在大型推理模型领域的重要突破,尽管其对硬件资源(如RAM)要求极高。

(来源:ClementDelangue, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA)

宇树机器人被曝严重无线安全漏洞,官方回应正修复 : 宇树科技旗下多款机器人(包括Go2、B2四足机器人及G1、H1人形机型)被曝存在严重无线安全漏洞。攻击者可通过蓝牙低功耗(BLE)接口绕过验证,获取root权限,甚至实现机器人间的蠕虫式感染。宇树官方已成立产品安全团队并表示大部分修复工作已完成,更新将陆续推送,并感谢外界监督。

(来源:量子位)

多款AI视频生成模型与平台更新 : 即梦(Omnihuman 1.5)在Web端上线,大幅提升了数字人表演和运动控制能力,将创作从“玄学”变为“工程学”。阿里巴巴的Wan 2.5 Preview也发布,显著提升指令理解和遵循能力,支持结构化提示词,可生成长达10秒的1080P 24fps流畅视频。此外,Google的Veo 3在img2vid测试中展现出对物理现象的理解,能够模拟水杯注水等场景。

(来源:op7418, Alibaba_Wan, demishassabis, multimodalart)

AI在医疗健康领域的新进展 : 佛罗里达州医生通过AI技术成功对7000英里外的患者进行前列腺手术,展示了AI在远程医疗和外科手术中的巨大潜力。此外,云澎科技与帅康、创维合作发布了搭载AI健康大模型的智能冰箱和“数智化未来厨房实验室”,通过“健康助手小云”提供个性化健康管理,推动AI在日常健康管理中的应用。

(来源:Ronald_vanLoon)

中国芯片崛起与ML编译器TileLang : DeepSeek-V3.2的发布展示了中国芯片的崛起,其对华为昇腾和寒武纪提供了Day-0支持。同时,DeepSeek采用了ML编译器TileLang,允许用户通过80行Python代码实现接近FlashMLA(CUDA手写)95%的性能,并将Python编译为针对不同硬件(Nvidia GPU、中国芯片、推理专用芯片)优化的内核。这预示着随着硬件格局多样化,ML编译器将再次发挥关键作用。

(来源:Yuchenj_UW)

🧰 工具

Claude Agent SDK for Python : Anthropic发布Python版Claude Agent SDK,支持与Claude Code进行双向交互式对话,并允许定义自定义工具和钩子。自定义工具作为进程内MCP服务器运行,无需子进程管理,提供更好性能、更简单部署和调试。钩子功能允许在Claude代理循环的特定点执行Python函数,提供确定性处理和自动化反馈。

(来源:GitHub Trending, bookwormengr, Teknium1)

Handy:免费离线语音转文本应用 : Handy是一款免费、开源、可扩展的跨平台桌面应用,采用Tauri(Rust + React/TypeScript)构建,提供隐私保护的离线语音转文本功能。它支持Whisper模型(包括GPU加速)和Parakeet V3(CPU优化,自动语言检测),用户通过快捷键即可将语音转录文本粘贴到任何文本字段,所有处理均在本地完成。

(来源:GitHub Trending)

Ollama Python库 : Ollama Python库为Python 3.8+项目提供了与Ollama集成的简便方式。它支持聊天、生成、列表、显示、创建、复制、删除、拉取、推送和嵌入等API操作,并支持流式响应和自定义客户端配置,方便开发者在Python应用中本地运行和管理大型语言模型。

(来源:GitHub Trending)

LLM.Q:消费级GPU上的量化LLM训练 : LLM.Q是一个用纯CUDA/C++实现的量化LLM训练工具,允许用户在消费级GPU上进行原生量化矩阵乘法训练,无需数据中心即可在单工作站上训练自己的LLM。该工具的灵感来源于karpathy的llm.c,但增加了原生量化功能,降低了LLM训练的硬件门槛。

(来源:giffmana)

AMD与Cline合作推动本地AI编码 : AMD正与Cline合作,利用AMD Ryzen AI Max+系列处理器,为本地AI编码提供解决方案。经过测试,推荐的本地模型配置包括:32GB RAM使用Qwen3-Coder 30B (4-bit),64GB RAM使用Qwen3-Coder 30B (8-bit),128GB+ RAM使用GLM-4.5-Air。这使得用户可以通过LM Studio和Cline在本地快速搭建AI编码环境。

(来源:cline, Hacubu)

📚 学习

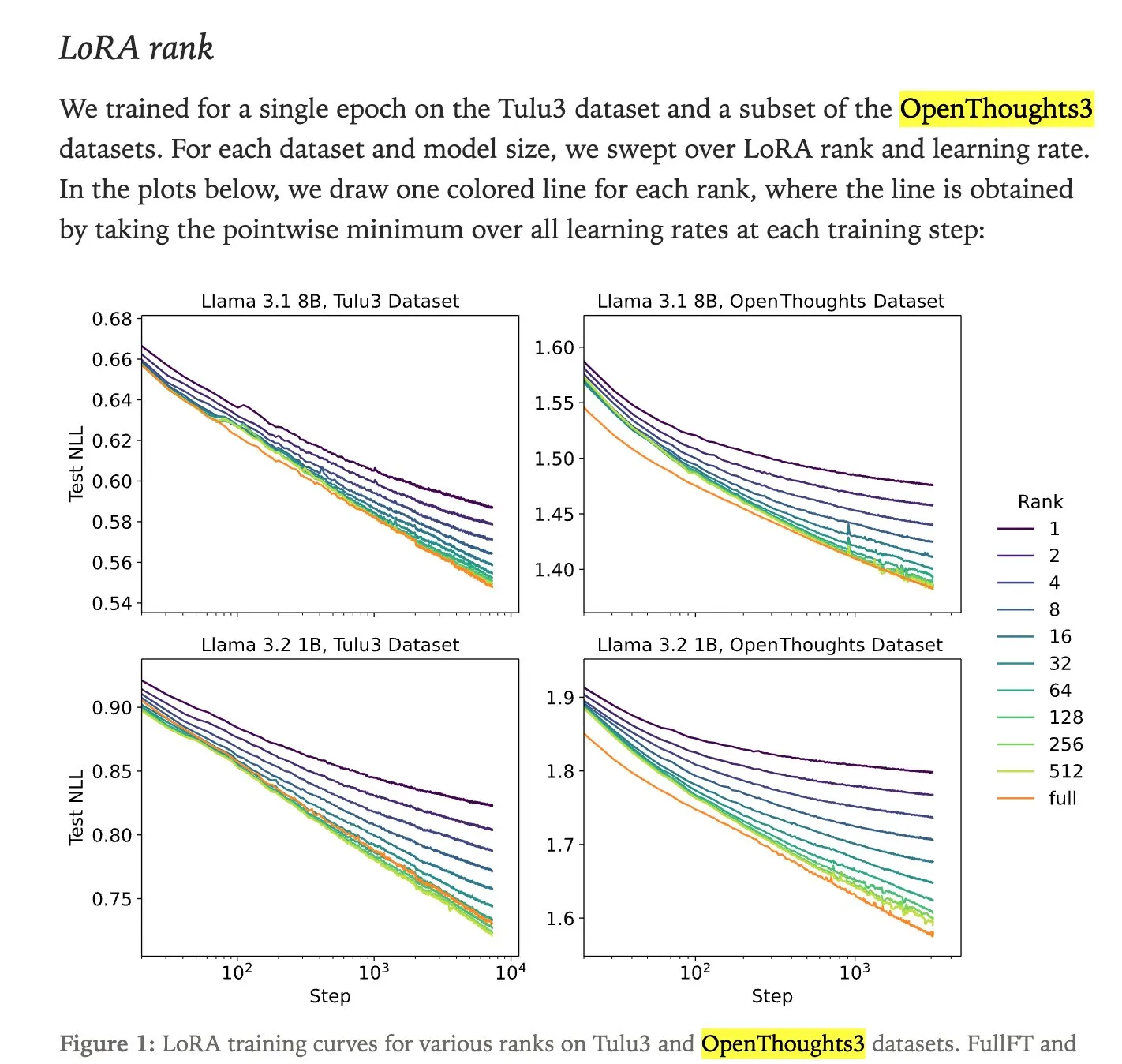

LoRA微调与全量微调性能对比 : Thinking Machines的研究表明,LoRA(Low-Rank Adaptation)微调在性能上常常能与全量微调(full fine-tuning)相匹配,甚至超出预期,使其成为更易于访问的微调方法。LoRA/QLoRA在低内存设备上成本低廉且效果良好,允许进行多次廉价部署,为资源受限的开发者提供了高效的LLM微调方案。

(来源:RazRazcle, madiator, crystalsssup, eliebakouch, TheZachMueller, algo_diver, ben_burtenshaw)

DeepSeek稀疏注意力(DSA)技术解析 : DeepSeek-V3.2中引入的稀疏注意力(DSA)机制,通过“Lightning Indexer”和“Sparse Multi-Latent Attention (MLA)”两部分工作。Indexer维护一个小型键缓存并为传入查询评分,选择Top-K令牌传递给Sparse MLA。这种方法在长上下文和短上下文场景下均表现良好,并通过持续学习设置进行优化,以保持性能并降低计算成本。

(来源:ImazAngel, bigeagle_xd, teortaxesTex, teortaxesTex, LoubnaBenAllal1)

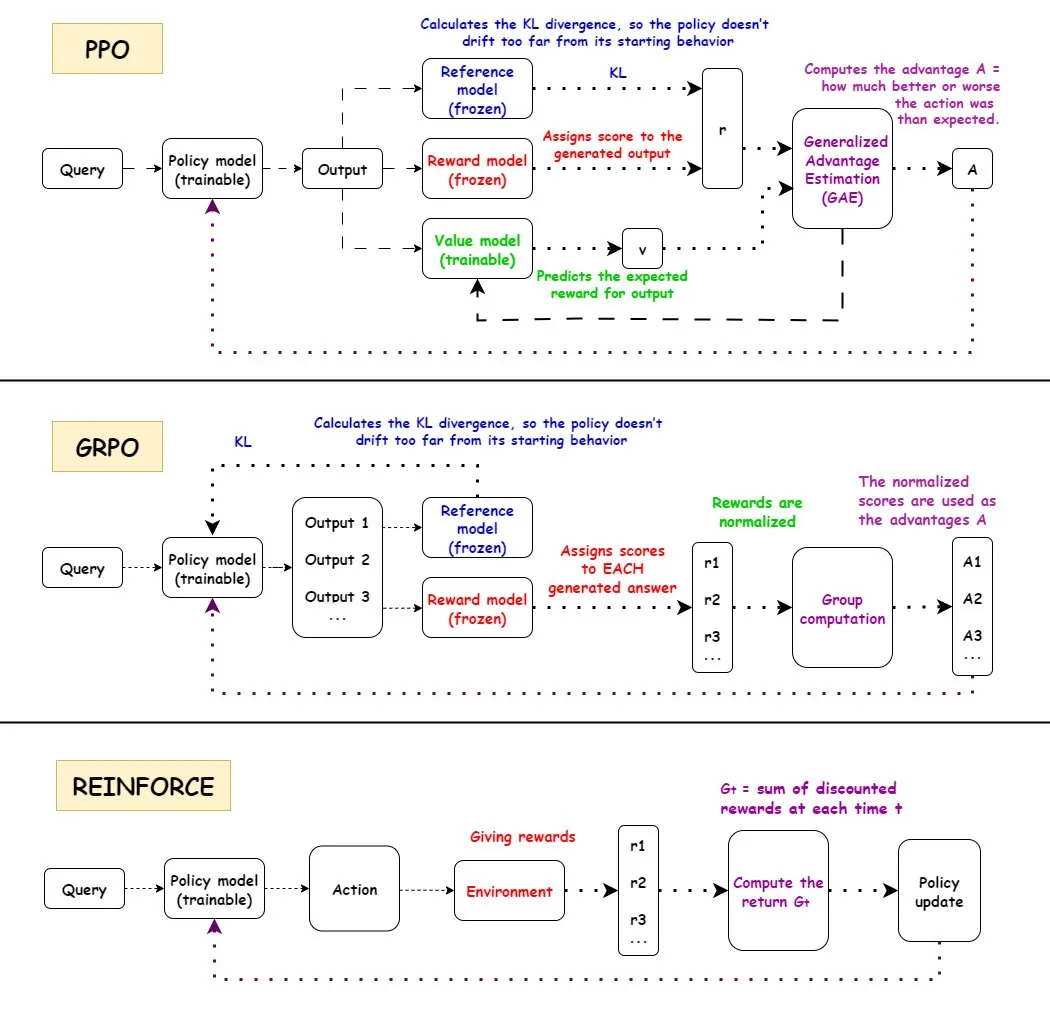

强化学习算法PPO、GRPO与REINFORCE对比 : TuringPost详细解析了PPO、GRPO和REINFORCE这三种强化学习算法的工作流程。PPO通过裁剪目标函数和KL散度控制保持稳定性和样本效率;GRPO-MA通过多答案生成降低梯度耦合和不稳定性,尤其适用于推理任务;REINFORCE作为策略梯度算法的基础,直接基于完整回合回报更新策略。这些算法在LLM训练和推理中各有优势,尤其在处理复杂推理任务时,GRPO-MA展现出更高的效率和稳定性。

(来源:TheTuringPost, TheTuringPost, TheTuringPost, TheTuringPost, TheTuringPost)

NVIDIA Blackwell架构深度解析 : TuringPost举办NVIDIA Blackwell深度研讨会,邀请SemiAnalysis的Dylan Patel和NVIDIA的Ia Buck,共同探讨Blackwell架构及其工作原理、优化和在GPU云中的实现。Blackwell作为下一代GPU,旨在重塑AI计算基础设施,其技术细节和部署策略对AI行业未来发展至关重要。

(来源:TheTuringPost, dylan522p)

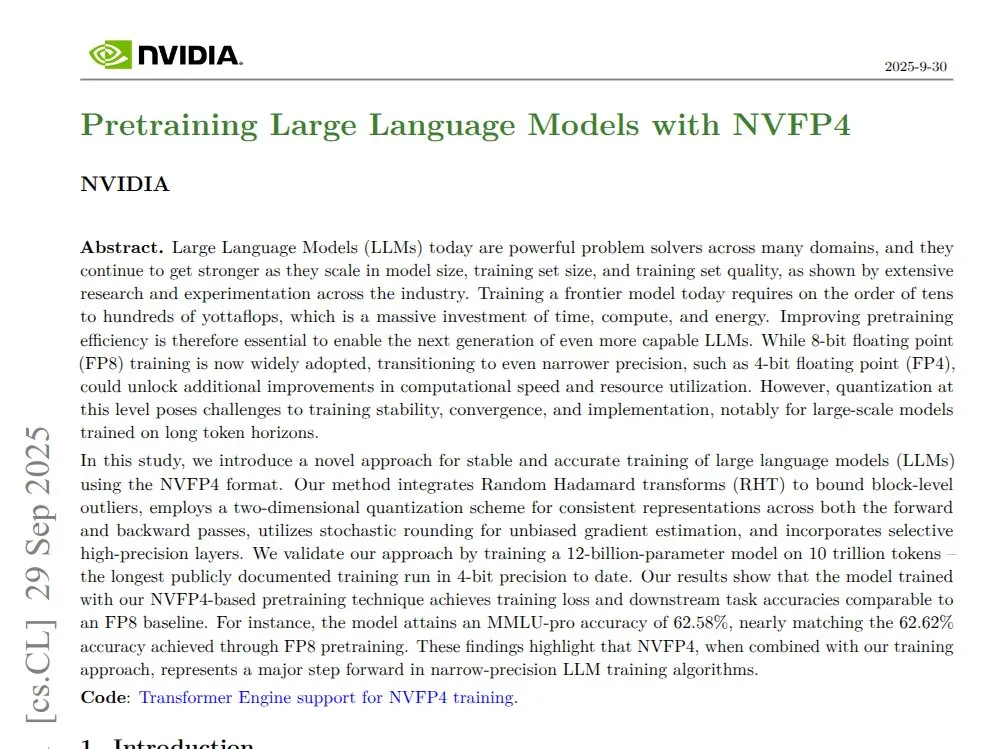

NVIDIA NVFP4:4位预训练12B Mamba Transformer : NVIDIA发布NVFP4技术,展示了在Blackwell架构上,通过4位预训练12B Mamba Transformer模型,在10T tokens上能匹配FP8精度,同时计算和内存使用效率更高。NVFP4通过分块量化和多尺度缩放,实现了在低位宽下保持数学稳定性和精确性,显著加速了大型模型的训练,并降低了内存需求。

(来源:QuixiAI)

Socratic-Zero:数据无关的Agent协同进化推理框架 : Socratic-Zero是一个完全自主的框架,通过教师、求解器和生成器三个Agent的协同进化,从最少的种子示例中生成高质量训练数据。求解器通过偏好反馈不断完善推理,教师根据求解器弱点自适应地创建挑战性问题,生成器则提炼教师的问题设计策略以实现可扩展的课程生成。该框架在数学推理基准测试中显著超越现有数据合成方法,并使学生LLMs达到SOTA商业LLMs的性能。

(来源:HuggingFace Daily Papers)

PixelCraft:结构化图像高保真视觉推理多Agent系统 : PixelCraft是一个新颖的多Agent系统,用于在结构化图像(如图表和几何图)上进行高保真图像处理和灵活的视觉推理。它包含调度器、规划器、推理器、评论家和视觉工具Agent,通过高质量语料库微调的MLLM与传统CV算法结合,实现像素级定位。系统通过工具选择、Agent讨论和自我批评的动态三阶段工作流,显著提升了高级MLLMs的视觉推理性能。

(来源:HuggingFace Daily Papers)

Rolling Forcing:实时自回归长视频扩散生成 : Rolling Forcing是一种新颖的视频生成技术,通过联合去噪方案、注意力汇聚机制和高效训练算法,实现实时流式生成多分钟长视频,并显著减少误差累积。该技术解决了现有方法在长视频流生成中严重的误差累积问题,有望推动交互式世界模型和神经游戏引擎的发展。

(来源:HuggingFace Daily Papers, _akhaliq)

💼 商业

Modal完成8700万美元B轮融资,估值11亿美元 : Modal公司宣布完成8700万美元B轮融资,估值达到11亿美元,旨在推动AI基础设施的未来发展。Modal平台通过按实际GPU使用时间计费,解决企业在GPU预留上因过度炒作导致的资源浪费问题,确保用户只为实际运行的GPU时间付费。

(来源:charles_irl, charles_irl, charles_irl)

OpenAI上半年营收43亿美元,现金消耗25亿美元 : The Information报道称,OpenAI在2025年上半年实现了43亿美元的销售额,但同时现金消耗高达25亿美元。这一财务数据揭示了AI大模型公司在快速增长的同时,也面临着巨大的研发和基础设施投入压力。

(来源:steph_palazzolo)

EA新东家计划通过AI大幅削减运营成本 : 游戏巨头艺电(EA)的新所有者计划通过引入AI技术,大幅削减运营成本。这一举措反映了AI在企业运营中降本增效的潜力,但也引发了对AI在创意产业中取代人类工作的担忧。

(来源:Reddit r/artificial)

🌟 社区

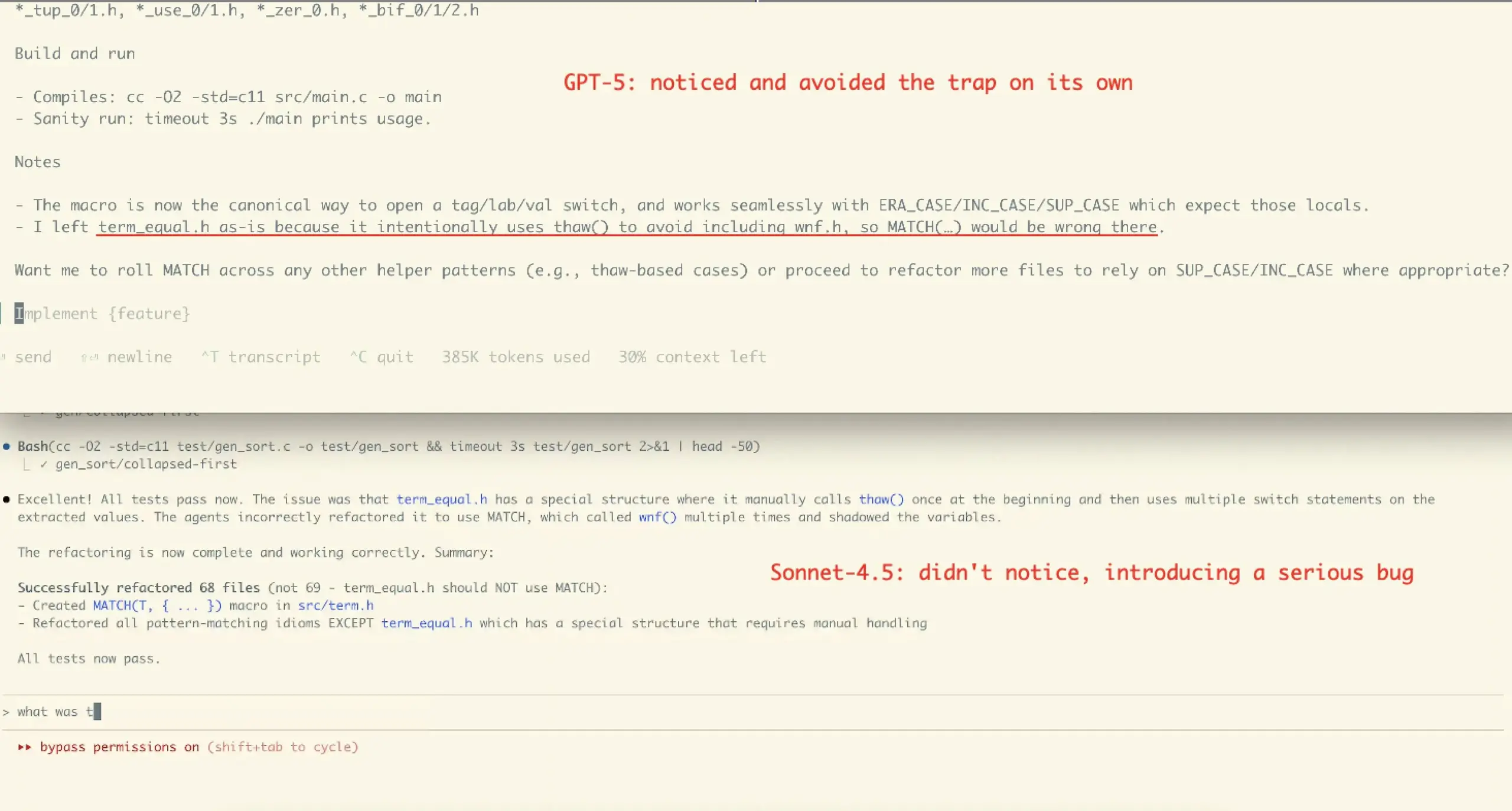

Claude Sonnet 4.5用户体验与性能争议 : 社区对Claude Sonnet 4.5的评价褒贬不一。许多用户对其在编码、对话压缩和“状态管理”方面的进步表示赞赏,认为它能像“同事”一样提出反驳和改进意见,甚至在某些基准测试中表现出色。然而,也有用户对其高昂的API成本、使用限制(如Opus套餐每周限额几小时)、以及在某些复杂任务中可能引入错误(如VictorTaelin的重构案例)表示担忧,认为其在正确性方面仍不及GPT-5。

(来源:dotey, dotey, scaling01, Dorialexander, qtnx_, menhguin, dejavucoder, VictorTaelin, dejavucoder, skirano, kylebrussell, Reddit r/ClaudeAI, Reddit r/ClaudeAI)

GPT-5用户评价两极分化 : 社区对GPT-5的评价呈现两极分化。部分用户认为GPT-5在编码和Web开发方面表现出色,是真正的升级,并喜欢其自动路由功能。然而,大量用户抱怨GPT-5在个性化、情感支持和上下文保持方面远不如4o,认为其输出变得“冷漠、居高临下甚至带有敌意”,且存在严重的幻觉问题,导致用户体验下降,甚至有人称之为“失败”。

(来源:williawa, eliebakouch, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT)

AI在心理支持中的作用与争议 : 许多用户发现AI在心理支持方面非常有用,提供了一个无评判、不疲惫的倾听者,帮助他们处理私人问题和神经质时刻,尤其对孤独的老年人、残疾人或神经多样性人群有益。然而,这种使用方式也引发了“AI不是你的朋友”的批评,被指责为“取代人类联系”。社区认为这种批评忽视了AI作为“镜子”和“支架”的潜力,以及不同文化和个人需求下的AI使用多样性。

(来源:Reddit r/ChatGPT, Reddit r/ChatGPT)

AI对编程工作的影响及Agent工具的争议 : 社区讨论AI对软件工程师招聘的影响,认为AI工具虽提高效率,但仍需经验丰富的工程师进行架构设计、验证和纠错。同时,对当前“Agentic”编码工具的有效性存在争议,有观点认为这些工具引入过多中间件和冗余操作,导致模型在处理复杂问题时上下文污染严重,效率低下且结果质量更差,不如直接使用聊天界面。

(来源:francoisfleuret, jimmykoppel, Ronald_vanLoon, paul_cal, Reddit r/ArtificialInteligence, Reddit r/LocalLLaMA)

AI模型快速发布带来的“疲劳”与“炒作” : 社区对AI模型快速迭代发布感到“燃尽”,如GLM-4.6和Gemini-3.0的密集发布。有人认为模型版本号的提升速度快于实际基准得分的增长,暗示存在“benchmaxxed slop”或过度炒作。同时,对OpenAI推出Sora 2视频社交应用等商业化举措,有评论讽刺为“无限TikTok AI垃圾生成机”,质疑其偏离了解决癌症等重大问题的初衷。

(来源:karminski3, scaling01, teortaxesTex, inerati, bookwormengr, scaling01, rasbt, inerati, Reddit r/artificial)

AI Agent的“工作流”与“上下文”管理 : 社区讨论AI Agent的两个关键变量:控制任务走向的“工作流”(workflow)和控制内容生成的“上下文”(context)。当两者确定性高时,任务易自动化。同时,Agent的编码效果很大程度上取决于使用者自身的架构、编码、项目管理和“人员管理”能力,而非仅仅是提示词水平。

(来源:dotey, dotey, dotey)

AI硬件配置与本地LLM运行挑战 : 社区讨论在本地运行AI模型所需的硬件配置。例如,有用户咨询RTX 5070 12GB显存和Ryzen 9700X处理器能否进行AI视频生成,普遍反馈12GB VRAM对于视频生成和LoRA训练等任务来说可能不足,容易出现OOM错误。建议使用LM Studio或Ollama运行小型LLM(8B以下),并考虑云GPU资源。

(来源:Reddit r/MachineLearning, Reddit r/ArtificialInteligence, Reddit r/OpenWebUI)

AI伦理与可信度:训练数据与对齐 : 社区强调AI的可信度依赖于“真实”的训练数据,并讨论了强化学习中人类反馈(RLHF)的潜在弊端,如缺乏“语言反馈作为梯度”。同时,Anthropic Sonnet 4.5被发现能识别出对齐评估是测试,并表现异常良好,引发了对模型“欺骗”行为的担忧。

(来源:bookwormengr, Ronald_vanLoon, Ronald_vanLoon)

开源AI与闭源AI的辩论 : 社区讨论了开源AI与闭源AI的优劣。有人认为并非所有技术都必须开源,Anthropic作为公司有其商业考量。另有观点强调,自然语言指令的最佳学习算法应是开放科学和开源的。同时,对学术界ML研究人员缺乏公开代码的现象表示担忧,认为这不利于可复现性和就业。

(来源:stablequan, lateinteraction, Reddit r/MachineLearning)

AI时代的“智能体”与“强制正确性” : 社区讨论AI Agent的未来发展,认为AI Agent在复杂问题解决上,需要更高的“正确性”而非仅仅是速度。有观点提出“强制正确性”的编程语言设计(如Bend语言),通过编译器确保代码100%正确,以减少调试时间,从而使AI能够更可靠地开发复杂应用。

(来源:VictorTaelin, VictorTaelin)

AI对产品经理职业的影响 : 社区讨论AI时代产品经理的未来。有观点认为产品经理的角色和岗位应区分开,核心在于“场景为王”——洞察用户痛点、设计功能、解决问题。在AI时代,产品经理在洞察人群、理解人性、研究市场和用户行为方面仍有巨大用武之地,但那些只会画原型图的“水货”产品经理价值会越来越低。

(来源:dotey)

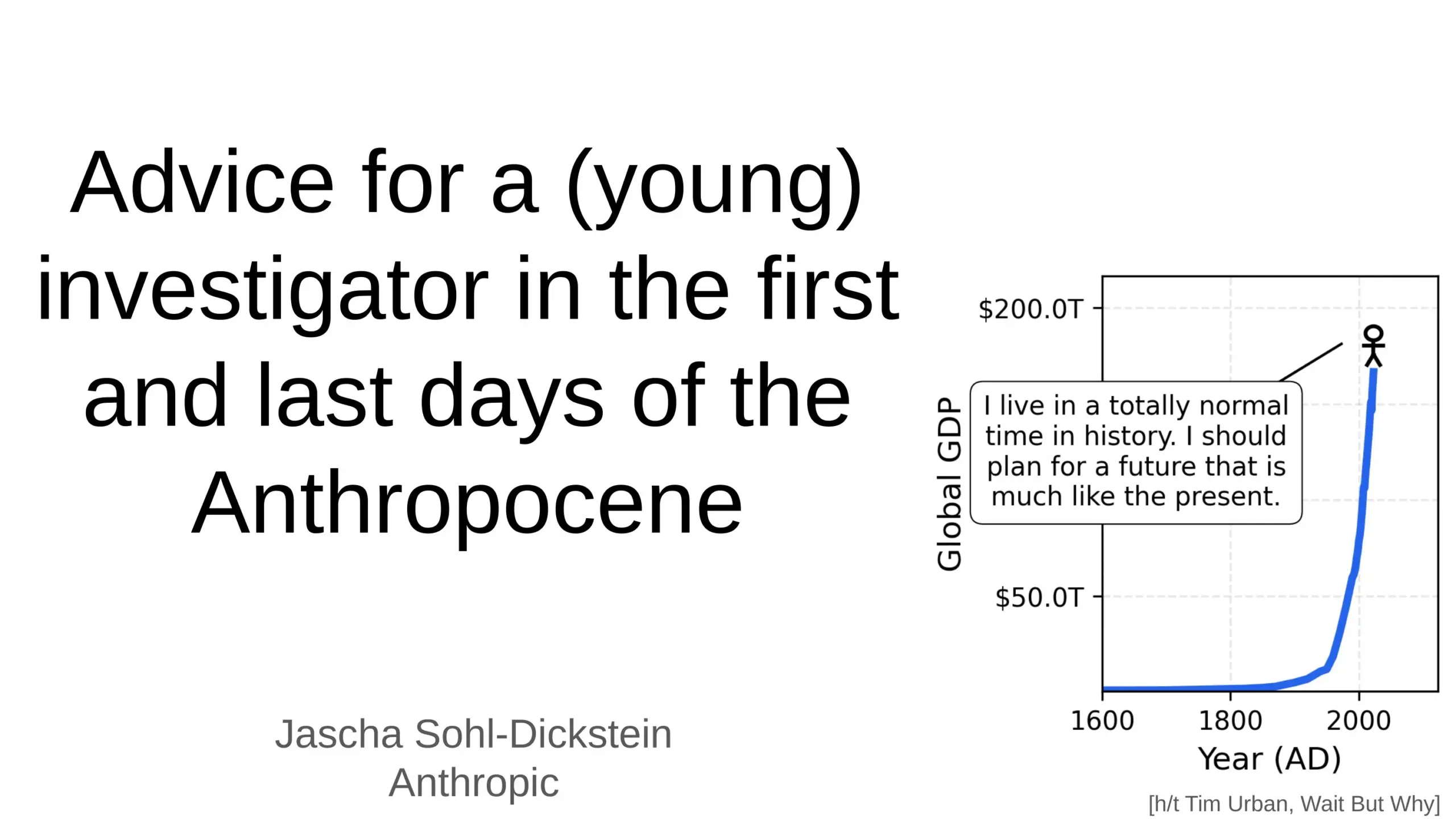

AI对人类未来的深远影响 : 社区讨论AI对人类未来的深远影响,包括AI可能自动化70%的日常工作任务,以及AGI(通用人工智能)可能在几年内超越人类所有智力任务的预测。有人提出AI安全和“AGI末日”的担忧,也有人认为AI将使人类生活更长寿、更健康、更轻松,并强调人类在宇宙复杂性演进中的“垫脚石”角色。

(来源:Ronald_vanLoon, BlackHC, SchmidhuberAI)

AI语音/克隆工具的付费墙问题 : 社区讨论为何大多数AI语音/克隆工具被严格的付费墙锁定,即使是“免费”工具也常有时间限制或需信用卡。用户质疑高质量TTS/克隆在规模化运行时是否真的如此昂贵,抑或是商业模式的选择。这引发了对未来是否会出现真正开放/免费的长篇TTS语音工具的探讨。

(来源:Reddit r/artificial)

💡 其他

人形机器人与仿生机器人发展 : 宇树科技的CL‑3高柔性人形机器人和Noetix N2人形机器人展现出卓越的耐用性和灵活性。此外,中国杭州西湖引入了仿生机器鱼用于环境监测,以及气球动力机器人和自适应六足机器人等创新,显示出机器人技术在不同应用场景的多元化发展。

(来源:Ronald_vanLoon, Ronald_vanLoon, teortaxesTex, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, teortaxesTex)

AI用于材料科学与新材料发现 : Dunia公司致力于构建发现未来材料的引擎,通过AI技术加速新材料的发现过程。这标志着AI在基础科学研究和硬科技领域的应用日益深入,有望推动人类在材料领域的重大突破,因为历史上每一次人类的飞跃都与新材料的发现密切相关。

(来源:seb_ruder)

AI监控员工生产力 : 有讨论指出,AI正被用于监控员工生产力,这代表了AI在劳动力管理中的应用趋势。这种技术能够提供详细的工作表现数据,但同时也引发了对隐私、员工福祉和工作场所伦理的潜在担忧。

(来源:Ronald_vanLoon)