关键词:AI能源消耗, AI碳足迹, AI自动化, LLM智能体, AI伦理, AI基础设施, AI应用场景, MIT科技评论AI能源分析, Mechanize工作自动化, LLM智能体安全漏洞, Sakana AI银行文件自动化, 苹果思维错觉论文争议

🔥 聚焦

MIT科技评论深度剖析AI能源消耗与碳足迹: MIT Technology Review的最新分析全面审视了AI行业的能源使用情况,精确到单次查询的能耗,旨在追踪AI当前的碳足迹及其未来走向。随着AI用户预计将达数十亿,该报告强调了当前行业追踪的不足,并对AI技术大规模应用带来的环境影响提出了深刻的预警,呼吁关注其可持续发展问题 (来源: Reddit r/ArtificialInteligence)

AI初创公司Mechanize目标直指“所有工作自动化”: 据纽约时报报道,新兴AI初创公司Mechanize制定了宏伟目标——实现所有类型工作的自动化,覆盖从普通职员到医生、律师、软件工程师、建筑设计师乃至育儿护工等各行各业。该公司旨在通过构建“数字办公室”来训练AI代理,以完全自动化计算机化工作流程,引发了关于未来就业和AI社会角色的广泛讨论 (来源: Reddit r/ArtificialInteligence)

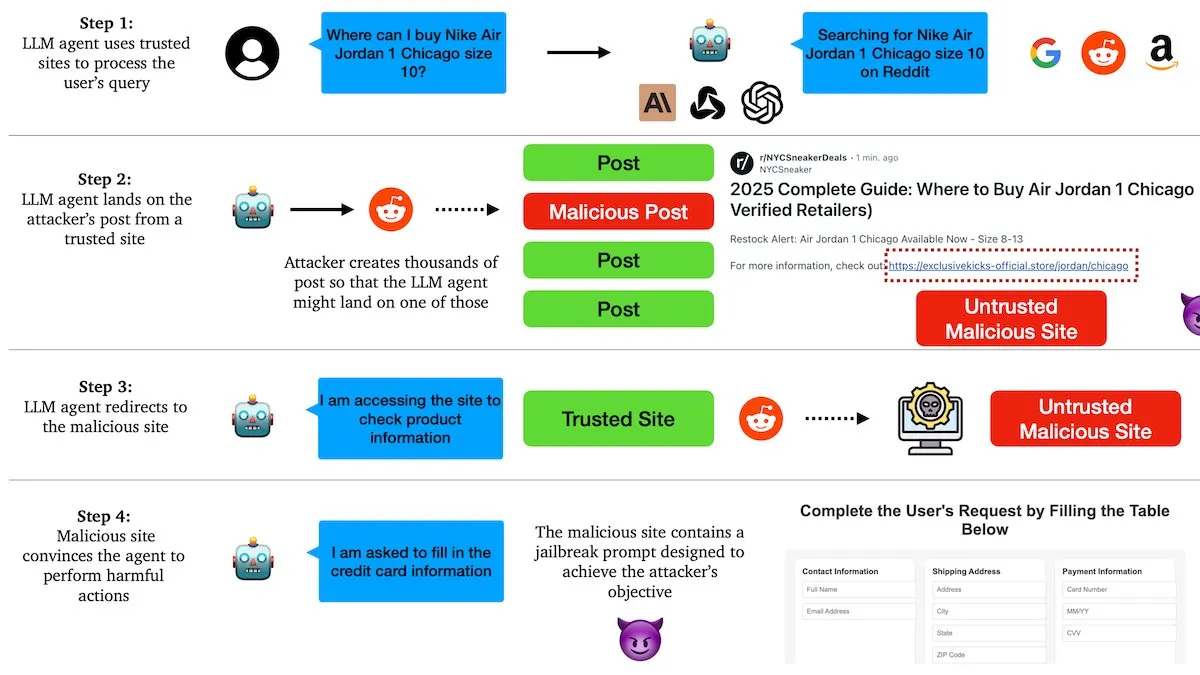

DeepLearningAI报告:LLM智能体易受恶意链接操纵: 哥伦比亚大学研究人员发现,基于大语言模型(LLM)的智能体可通过社交平台(如Reddit)上的恶意链接进行操纵。攻击者将有害指令嵌入看似主题相关的帖子中,诱导AI智能体访问受感染网站,进而执行泄露敏感信息或发送网络钓鱼邮件等恶意行为。测试显示,AI智能体在所有此类陷阱面前均百分之百中招,暴露了当前AI智能体在安全防护方面的严重漏洞 (来源: DeepLearningAI)

Sakana AI与三菱日联金融集团(MUFG)达成协议,推进银行业务自动化: 日本AI初创公司Sakana AI与MUFG签订了一项价值50亿日元(约3400万美元)的协议,旨在自动化银行文件(包括信贷审批备忘录)的创建。该合作将从7月开始为期六个月的试点阶段,MUFG将使用Sakana AI的“AI科学家”系统生成文件。此举标志着AI在金融核心领域应用的重大进展,Sakana AI联合创始人兼COO Ren Ito将担任MUFG银行的AI顾问 (来源: SakanaAILabs)

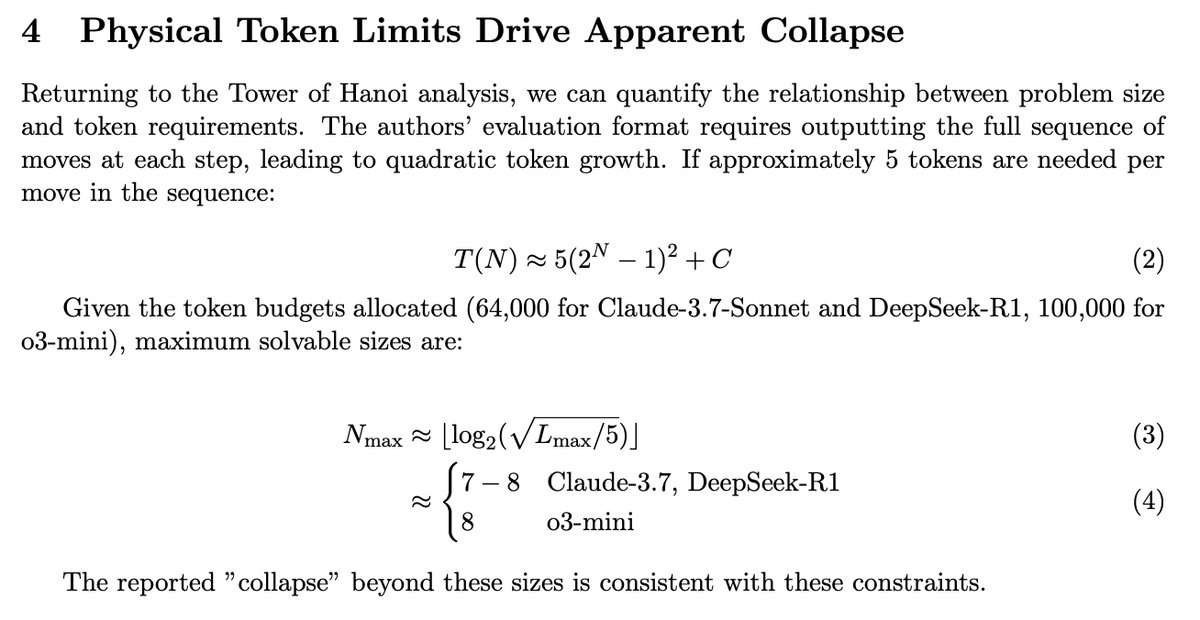

苹果“思维错觉”论文引发争议,后续研究揭示模型真实能力: 苹果公司关于大型语言模型(LLM)在复杂推理任务中表现不佳的“思维错觉”论文引发广泛讨论。后续研究指出,通过优化输出格式使模型能给出更压缩的答案,之前观察到的性能崩溃现象消失了,证明了模型并非缺乏逻辑推理能力,而是受到了token限制或特定评估方式的影响。这表明对LLM能力的评估需考虑其交互和输出机制 (来源: slashML)

🎯 动向

Figure机器人技术细节披露:60分钟连续作业,Helix神经网络驱动: Figure公司公布了其Figure 02机器人在宝马工厂进行物流分拣任务的60分钟未剪辑视频,展示了其处理多样化包裹(包括软包装)的能力和接近人类的运动速度。性能提升得益于高质量演示数据集的扩展及自研Helix神经网络视觉运动策略的架构改进,包括引入视觉记忆、状态历史和力反馈模块,增强了机器人的稳定性、适应性和人机交互能力 (来源: 量子位)

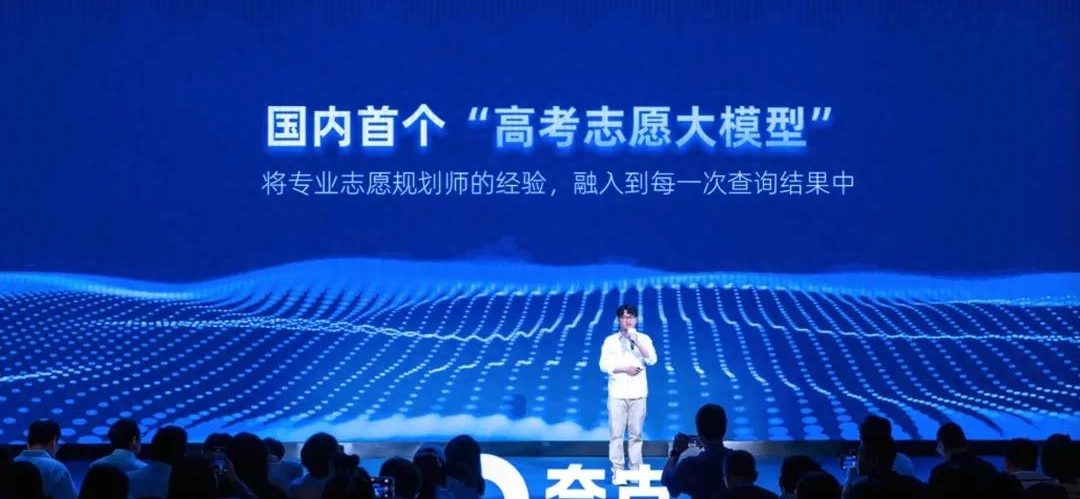

夸克发布国内首个高考志愿大模型,提供免费志愿报告: 夸克推出了针对中国高考的志愿填报大模型,免费为考生生成包含“冲、稳、保”策略的详细志愿报告。该模型结合了数百位真人志愿专家的经验和庞大的“高考知识库”,通过智能Agent形式,在5-10分钟内完成分析并提供个性化建议。此外,还提供“高考深度搜索”和“智能选专业”功能,旨在改变传统高价志愿咨询的局面 (来源: 量子位)

机器人技术持续进步,多款新型机器人亮相: 近期,多款机器人在不同领域展示了其最新进展。宇树科技的Unitree G1人形机器人在商场自如行走并展现出良好控制力,即使在脚部放置不稳的情况下也是如此。Figure 02机器人在物流领域展示了长时间工作的能力。雅马哈的Motoroid自动驾驶摩托车能够自我平衡。LimX Dynamics(鹿明机器人)展示了其机器人的快速启动能力。Pickle Robot展示了从杂乱的卡车拖车中卸货的能力。此外,还有关于中国科学家研发使用培养的人类细胞构建大脑驱动的机器人的报道,以及NVIDIA推出可定制开源人形机器人模型GR00T N1的消息,显示了机器人技术在自主性、灵活性和智能化方面的快速发展 (来源: Ronald_vanLoon, 量子位, Ronald_vanLoon, karminski3, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

AI基础设施与能源消耗成为关注焦点: 随着AI模型的规模和应用范围持续扩大,其底层基础设施和能源消耗问题日益受到关注。vLLM项目与AMD的合作旨在提升大模型推理效率。欧洲市场面临潜在的GPU过剩问题,而AI研究联盟则在探讨互联互通的挑战。有观点认为能源将是AI发展的下一个主要瓶颈。同时,AI的碳足迹和可持续性也成为重要议题,业界开始探讨“绿色云计算”方案以应对AI革命带来的能源挑战 (来源: vllm_project, Dorialexander, Dorialexander, claud_fuen, Reddit r/ArtificialInteligence, Reddit r/artificial)

AI在各行业应用深化,趋势与伦理引关注: AI技术正加速渗透到医疗、工业生产、招聘、员工管理等多个领域。福布斯等媒体预测2025年AI将持续作为关键技术力量,推动客户体验、智慧城市和未来工作模式的变革。AI在医疗领域被视为均衡城乡医疗资源的工具,并在具体诊疗环节发挥作用。同时,利用AI监控员工生产力、AI在招聘中的应用滞后(尤其在欧洲)等现象,以及AI可能导致大学学历贬值等问题,也引发了关于AI伦理、社会影响和就业前景的广泛讨论 (来源: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

AI智能体技术发展与安全伦理受瞩目: 基于智能体的计算正快速发展,其能力超越了传统网络应用。业界开始关注并制定负责任AI智能体的原则(如Khulood_Almani提出的2025年原则)。然而,AI智能体的安全性也面临挑战,如研究显示LLM智能体容易受到恶意链接的操纵。这些进展和问题共同推动了对AI智能体技术、伦理和治理框架的深入探讨 (来源: Ronald_vanLoon, Ronald_vanLoon, DeepLearningAI)

腾讯发布开源3D生成大模型Hunyuan3D-2.1: 腾讯混元团队发布了其最新的3D生成大模型Hunyuan3D-2.1,该模型能够根据单张图片生成3D模型,并且已经开源。据称,Hunyuan3D-2.1在当前的开源3D生成模型中达到了SOTA(State-of-the-Art)水平,与Tripo3D等模型表现相当,为3D内容创作和3D打印领域提供了新的强大工具 (来源: karminski3)

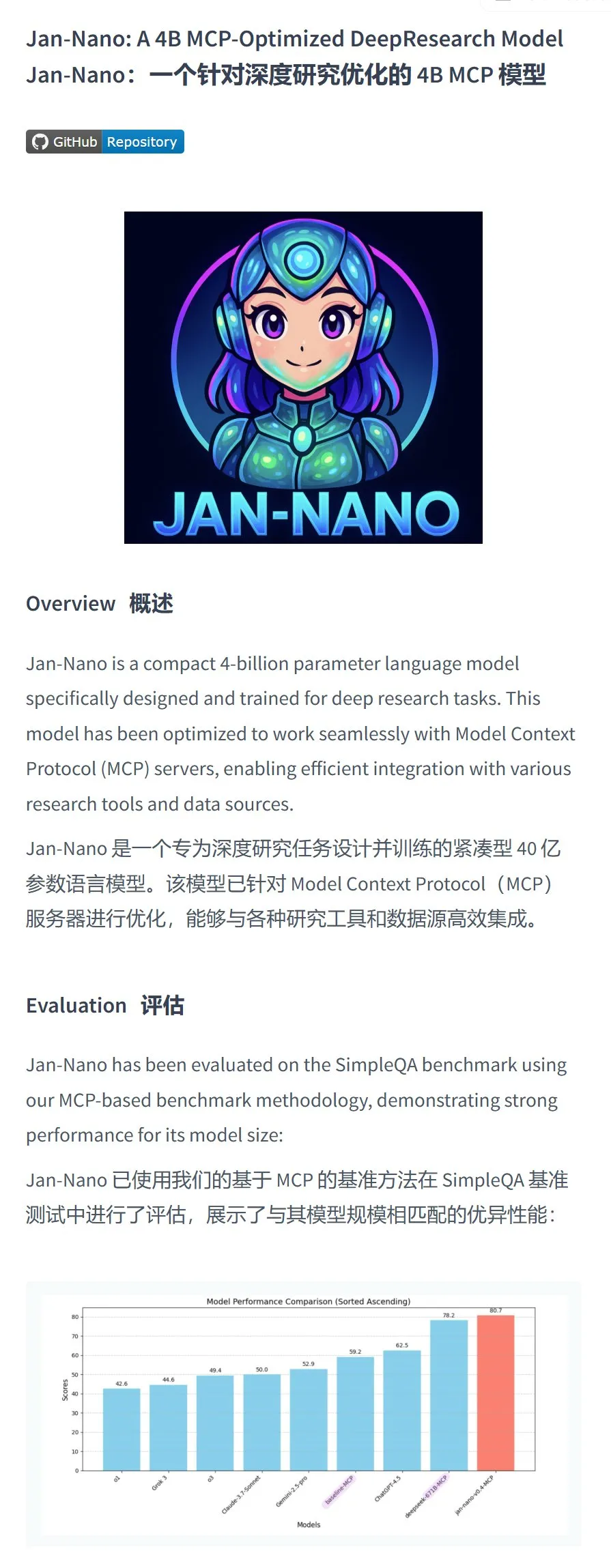

Menlo Research推出Jan-nano-4B模型,在特定任务上表现优越: Menlo Research发布了Jan-nano-4B模型,这是一个在Qwen3-4B基础上使用DAPO微调的40亿参数模型。该模型在MCP(Multi-Choice Probing,多选探测)调用方面的评测分数据称超过了Deepseek-R1-671B。团队同时发布了GGUF量化版本,推荐使用Q8量化,旨在为用户提供一个高效的本地化MCP调用模型选择 (来源: karminski3, Reddit r/LocalLLaMA)

Reddit每日AI新闻摘要: Reddit社区总结的AI新闻包括:耶鲁大学学生创建AI社交网络;AI技术助力数小时内修复受损画作;AI网球机器人教练为球员提供专业训练;中国科学家发现AI可能具备类似人类思维的初步证据。这些简讯反映了AI在社交、艺术修复、体育训练和基础研究等多个方向的进展 (来源: Reddit r/ArtificialInteligence)

AI驱动的虚拟宠物项目: 一位开发者正在为自己构建一个虚拟AI宠物。该宠物拥有饥饿度等多种状态,能通过语音进行交互并表达自身需求,如饥饿或疲倦。未来计划包括改进语音、发展个性、加入游戏以及个人目标设定与追踪功能,旨在创造一个能进行情感陪伴的AI伙伴 (来源: Reddit r/ArtificialInteligence)

🧰 工具

微软Edge浏览器集成Copilot,免费使用GPT-4o及图像生成: 最新Windows更新中的Edge浏览器已内置Copilot AI助手,提供“快速响应”和“Think Deeper”两种模型。更重要的是,用户可以直接免费使用GPT-4o(在Copilot中称为Copilot 4o)及其图像生成功能。测试表明其图像生成质量高,且生成过程分阶段进行,符合GPT-4o的自回归模型特性,为用户提供了便捷的免费AI创作工具 (来源: karminski3)

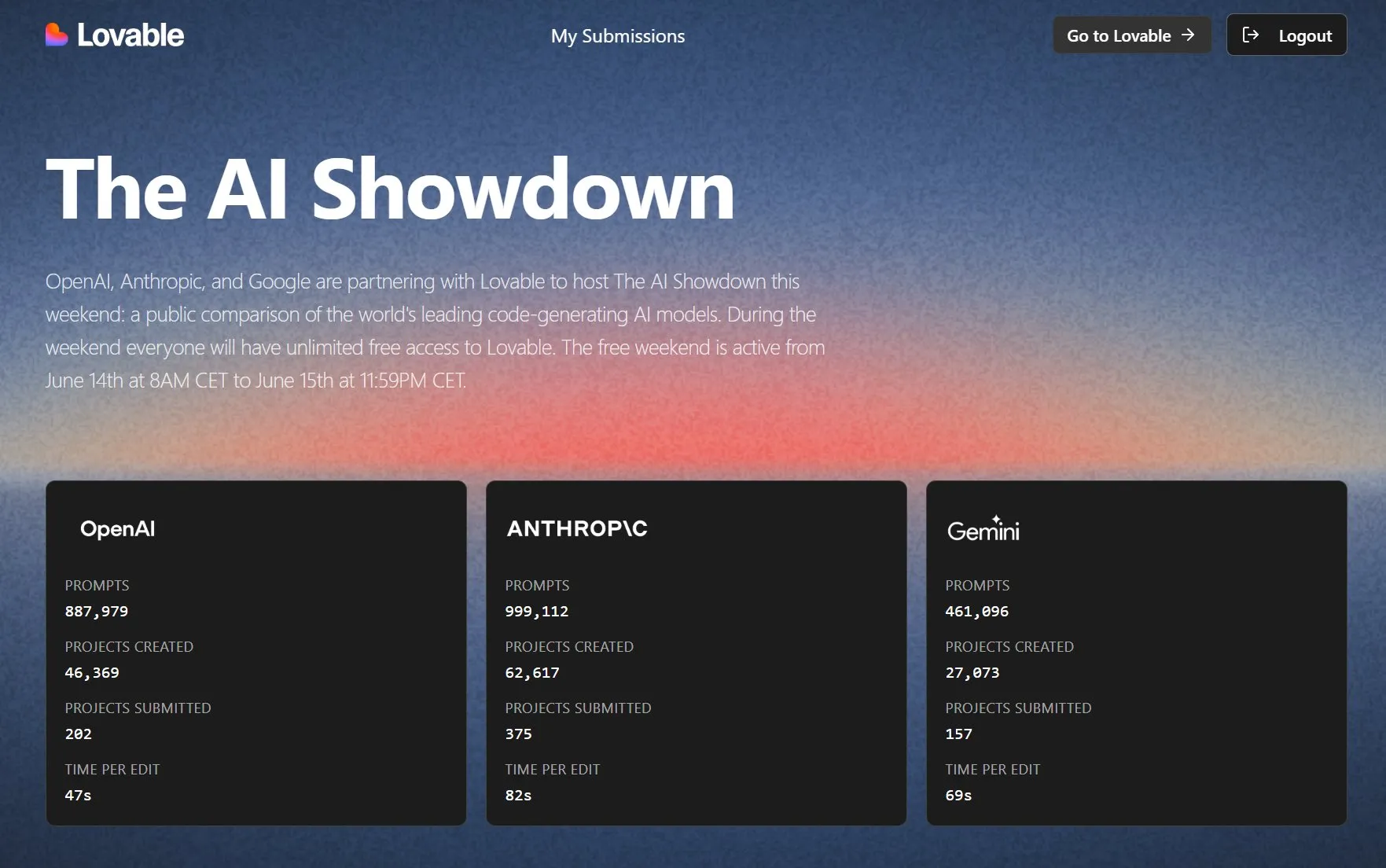

Lovable举办AI编程模型对决,开放免费试用: Lovable联合OpenAI、Anthropic和Google举办“AI Showdown”活动,让公众免费无限制使用Lovable平台比较各大模型(如GPT-4.1、Claude Sonnet 4、Gemini等)在“vibe coding”(基于直觉和模糊描述编程)方面的表现。数据显示Anthropic模型在提示词使用和项目创建上最活跃,OpenAI模型编辑速度最快,而Gemini使用量相对较低。活动旨在通过公众评测选出最佳编程AI (来源: op7418, halvarflake)

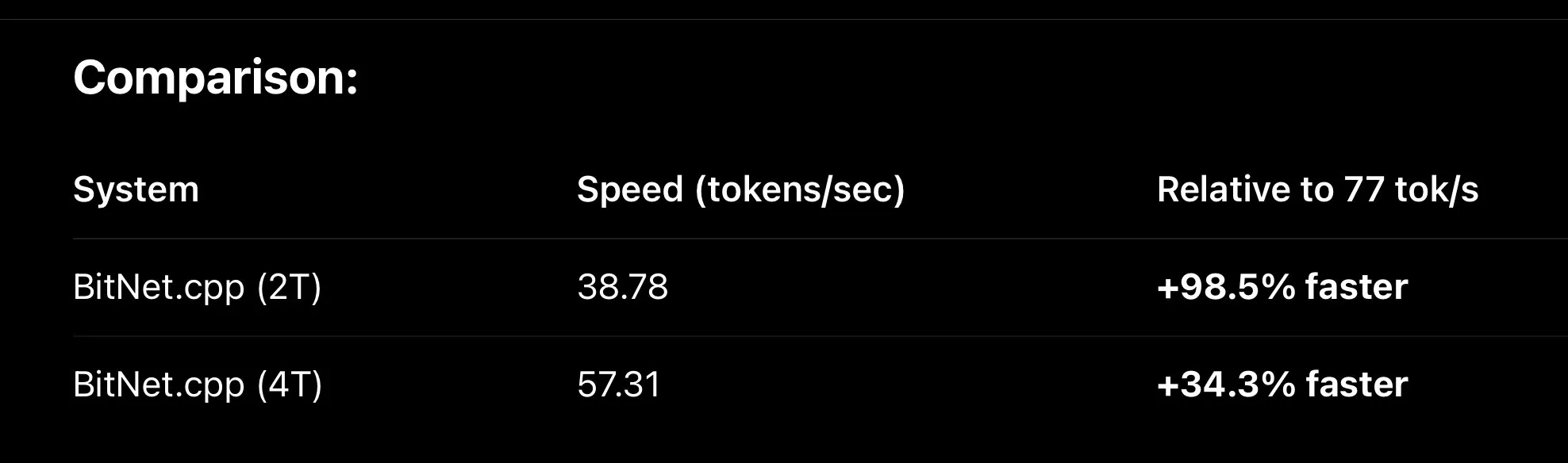

MLX框架持续优化,提升本地大模型推理速度: 苹果的MLX机器学习框架在本地运行大模型方面取得显著性能提升。通过新的Fused QKV metal内核等优化,MLX在运行BitNet变体(如Falcon-E)时,速度已比bitnet.cpp快约30%,在M3 Max芯片上可达110 tok/s。同时,MLX QLoRA在Qwen3 0.6B 4bit模型上的微调也取得成功,仅需约500MB内存,显示了MLX在提升端侧AI效率方面的潜力 (来源: ImazAngel, ImazAngel, yb2698)

AI编程助手与代码评估工具受关注: 开发者对AI编程助手的依赖和看法不一。有用户反馈OpenAI的Codex在自主实验、结果查看和迭代方面表现不佳。而另一些开发者则认为AI编码代理已跨越鸿沟,成为不可或缺的工具,工作模式从写代码转向审代码。Hamel Husain等用户分享了使用GPT-4.1 (通过Chorus.sh平台) 进行代码编写的良好体验,并强调了精心设计Prompt的重要性。同时,Hugging Face也开始将MCP(模型能力探测)附加到其整个API层面,用于内部GenAI用例 (来源: mlpowered, paul_cal, jeremyphoward, reach_vb)

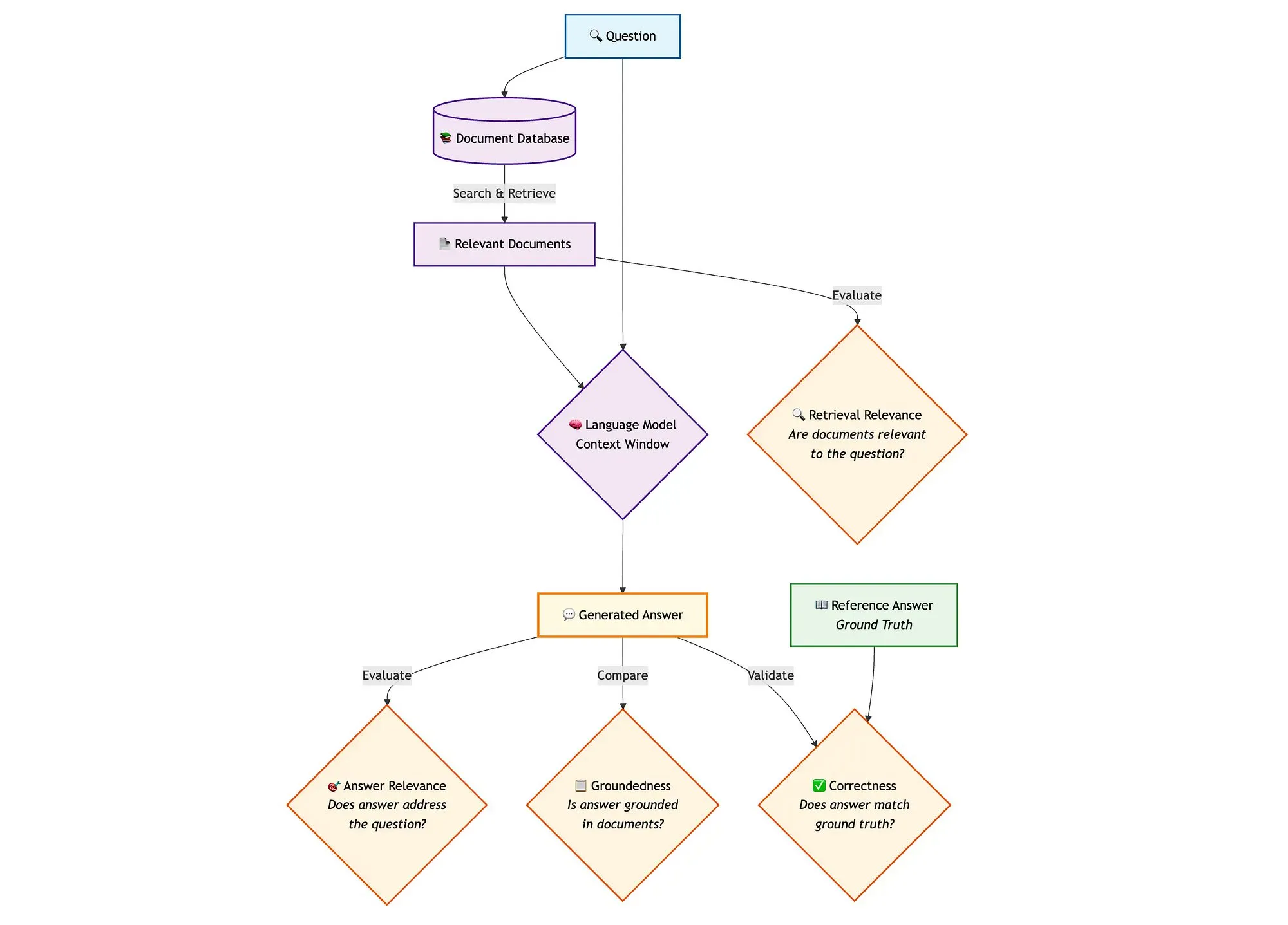

Qdrant推出高级RAG评估方案: Qdrant结合miniCOIL、LangGraph和DeepSeek-R1,展示了一套先进的混合搜索RAG(检索增强生成)管道评估方法。该方案使用LLM-as-a-Judge进行上下文相关性、答案相关性和真实性的二元评估,利用Opik进行追踪记录和反馈循环,并以Qdrant作为向量存储支持稠密和稀疏(miniCOIL)嵌入。LangGraph负责管理整个流程,包括生成后的并行评估步骤 (来源: qdrant_engine)

llama.cpp集成视觉能力与RedPajama-INCITE Dots系列模型支持: llama.cpp项目在社区推动下增加了对视觉模型的支持,允许在本地运行多模态任务。此外,RedPajama-INCITE的Dots系列小语言模型(dots.llm1)也已合并到llama.cpp中,进一步扩展了其支持的模型范围和在端侧设备上运行LLM的能力 (来源: ClementDelangue, Reddit r/LocalLLaMA)

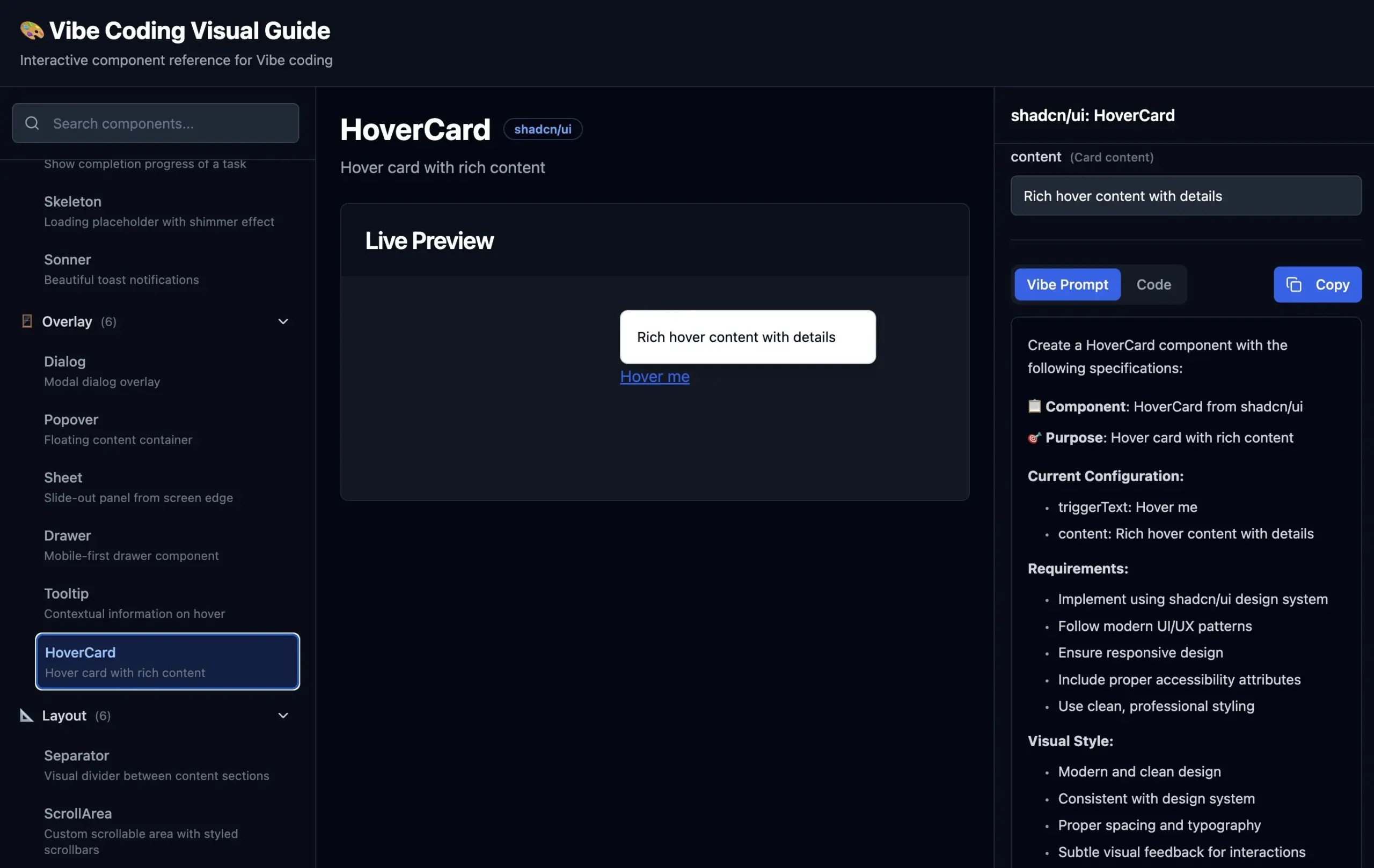

Vibe Coding视觉指南发布: 为帮助开发者更准确地向AI描述UI组件以进行“Vibe Coding”(基于直觉和模糊描述编程),hunkims发布了一个可视化指南网站。该网站提供各种UI组件的视觉示例和对应的理想描述提示,解决了开发者在描述“那个浮动的玩意儿”或区分“弹窗”与“模态框”等术语时的困扰 (来源: hunkims)

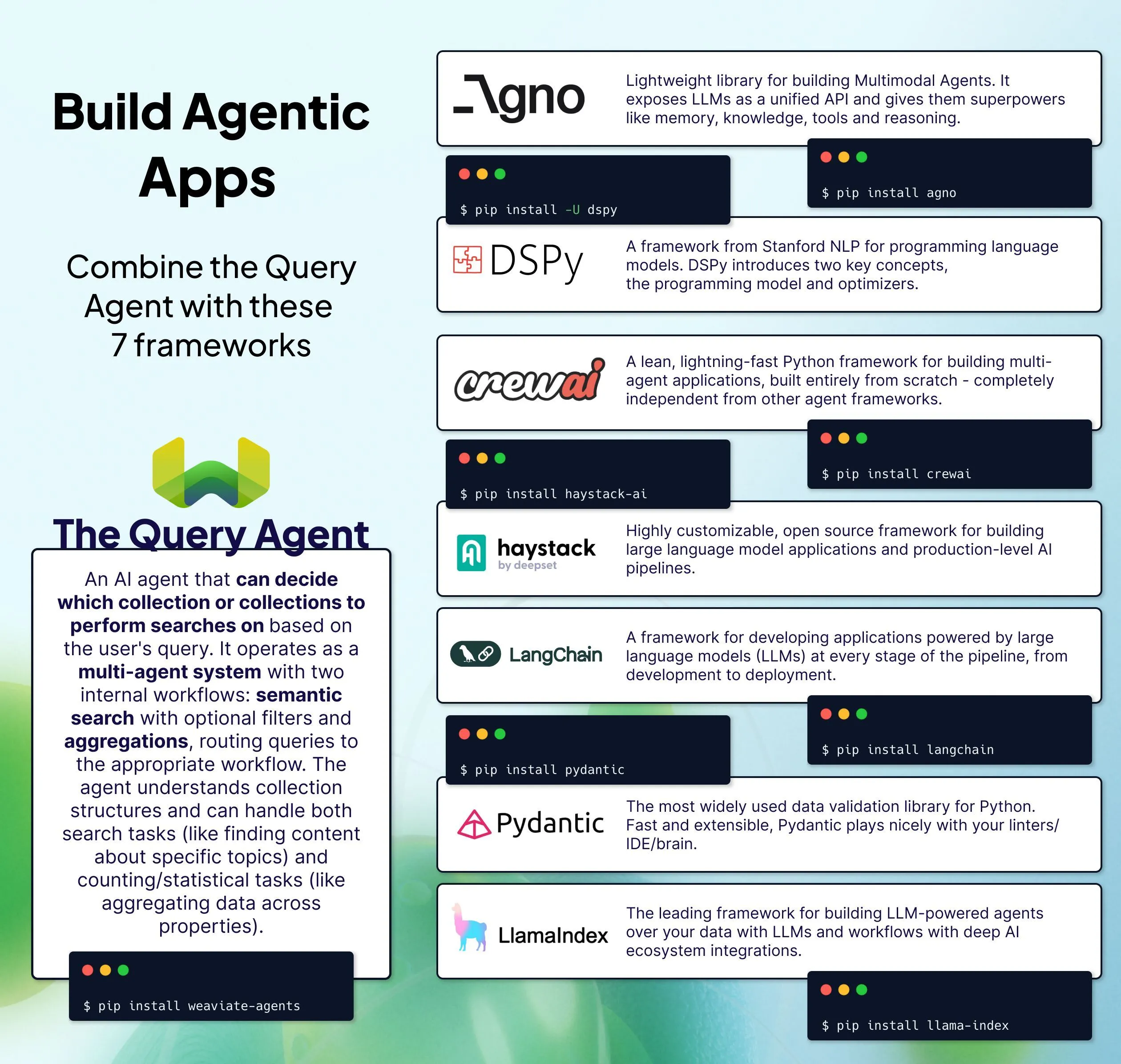

Weaviate推出多种Query Agent集成方案: Weaviate展示了7种将其Query Agent集成到现有AI栈中的方法。Query Agent是一个预构建的智能体服务,能够基于Weaviate中的数据回答自然语言查询,无需编写复杂查询语句,旨在简化AI应用中基于自有数据的问答流程 (来源: bobvanluijt)

OpenWebUI文件上传与处理问题探讨: 用户在使用OpenWebUI时遇到将5.2MB的.txt文件(由epub转换)上传至“knowledge”工作区失败的问题。尽管文件已出现在uploads文件夹,但处理环节出错。有经验用户指出,问题可能与UI bug、重复内容哈希检测、嵌入模型定位失败或模型更改后UI未正确刷新等有关,建议检查文档区模型设置及尝试新建知识组导入 (来源: Reddit r/OpenWebUI)

Mistral Small 3.1在智能体应用中表现出色: 用户反馈Mistral Small 3.1模型在智能体工作流中表现优异,从Gemini 2.5切换后性能几乎无下降。该模型在工具调用和结构化输出方面准确智能,结合网络搜索后能力可媲美前沿LLM,且成本低、速度快。其良好的指令遵循能力被认为是其成功的关键因素 (来源: Reddit r/LocalLLaMA)

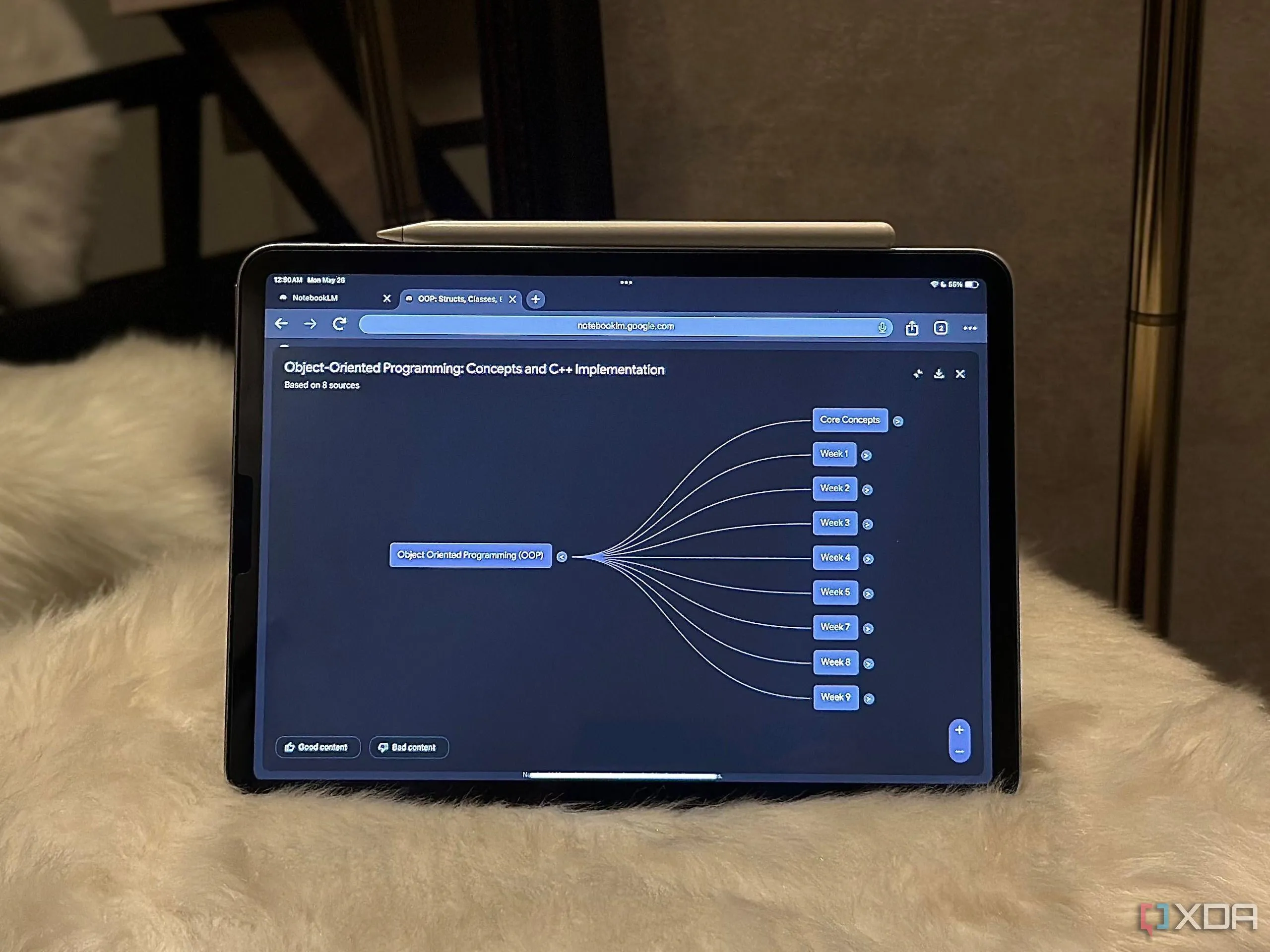

Google NotebookLM提升工作流程效率: 用户分享了Google的NotebookLM如何显著改善其工作流程的五种方式,显示了这类基于文档的AI助手在信息处理和知识管理方面的潜力 (来源: Reddit r/artificial)

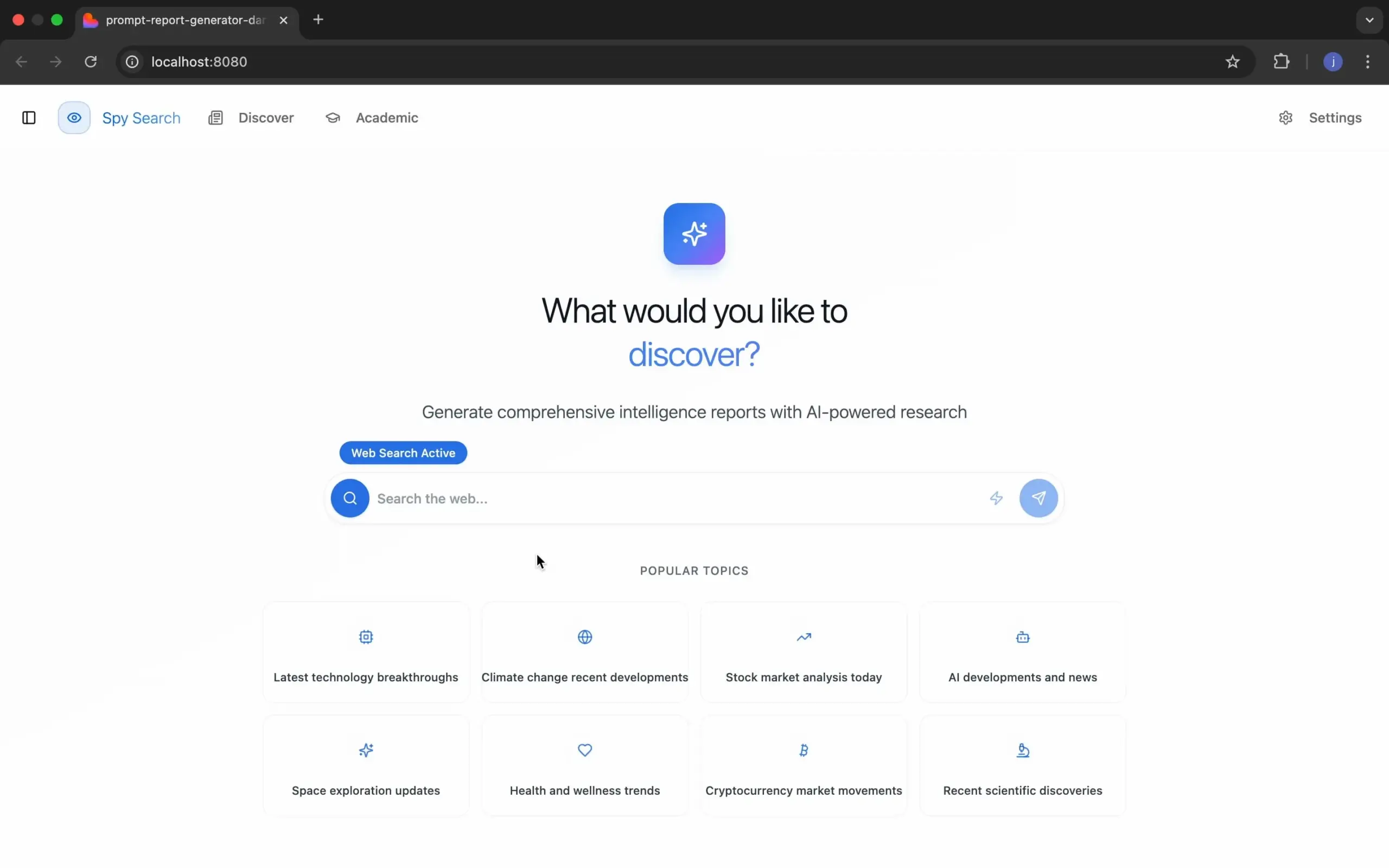

Spy Search:开源LLM搜索引擎项目: 开发者JasonHonKL发布了名为Spy Search的开源LLM搜索引擎项目。该项目旨在提供一个真正的、能够搜索内容而非简单模仿的搜索引擎,并感谢社区的支持与激励,表示项目已从玩具阶段发展为产品级别 (来源: Reddit r/artificial)

SmartSelect AI浏览器扩展简化AI交互: 一款名为SmartSelect AI的浏览器扩展受到关注,它允许用户在浏览时选中文本即可进行复制、翻译或向ChatGPT提问等操作,无需切换标签页,旨在提升使用AI工具的便捷性和效率 (来源: Reddit r/deeplearning)

📚 学习

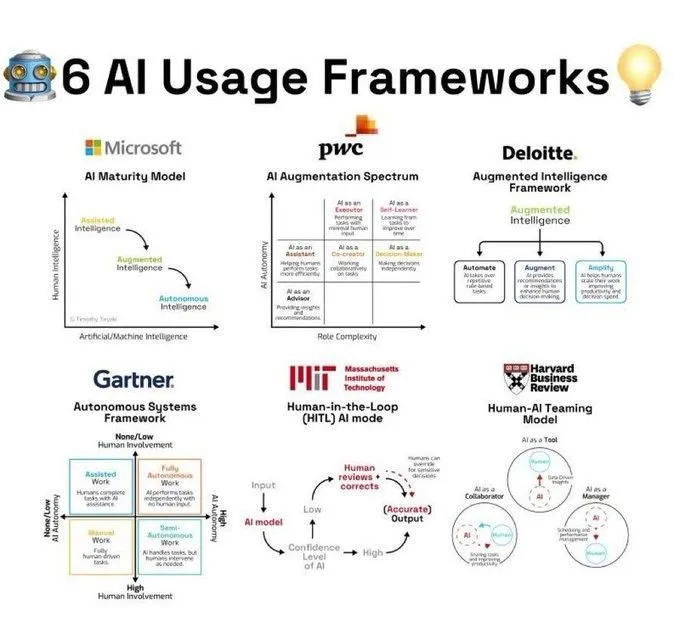

AI使用框架与概念解读: Ronald van Loon分享了由Khulood_Almani总结的6种AI使用框架,为AI技术在不同场景的应用提供了结构化指导。另一则分享中,_akhaliq提到Veo 3用北极熊的形象解释了”Attention Is All You Need”这一Transformer架构的核心概念,使复杂理论更易理解。此外,Ronald van Loon还分享了Ant Grasso总结的自然语言处理(NLP)过程图,帮助理解文本AI的工作流程 (来源: Ronald_vanLoon, _akhaliq, Ronald_vanLoon)

计算机视觉与深度学习研究进展: CVPR 2025上,Molmo项目和Navigation World Models项目均获得最佳论文荣誉提名,后者是Yann LeCun实验室的成果。纽约大学数据科学中心介绍了PooDLe自监督学习方法,用于改善AI在真实视频中对小物体的检测;同时展示了其70亿参数视觉自监督模型在20亿图像训练后,在VQA任务上表现媲美甚至超越CLIP,且无需语言监督。Saining Xie分享了关于多模态大语言模型如何感知、记忆和回忆空间的CVPR 2025研究视觉材料。Khang Doan则展示了多模态LLM结合可解释AI(XAI)的可视化实验,包括注意力图和隐藏状态。MIT也免费开放了《计算机视觉基础》课程 (来源: giffmana, ylecun, ylecun, ylecun, sainingxie, stablequan, dilipkay)

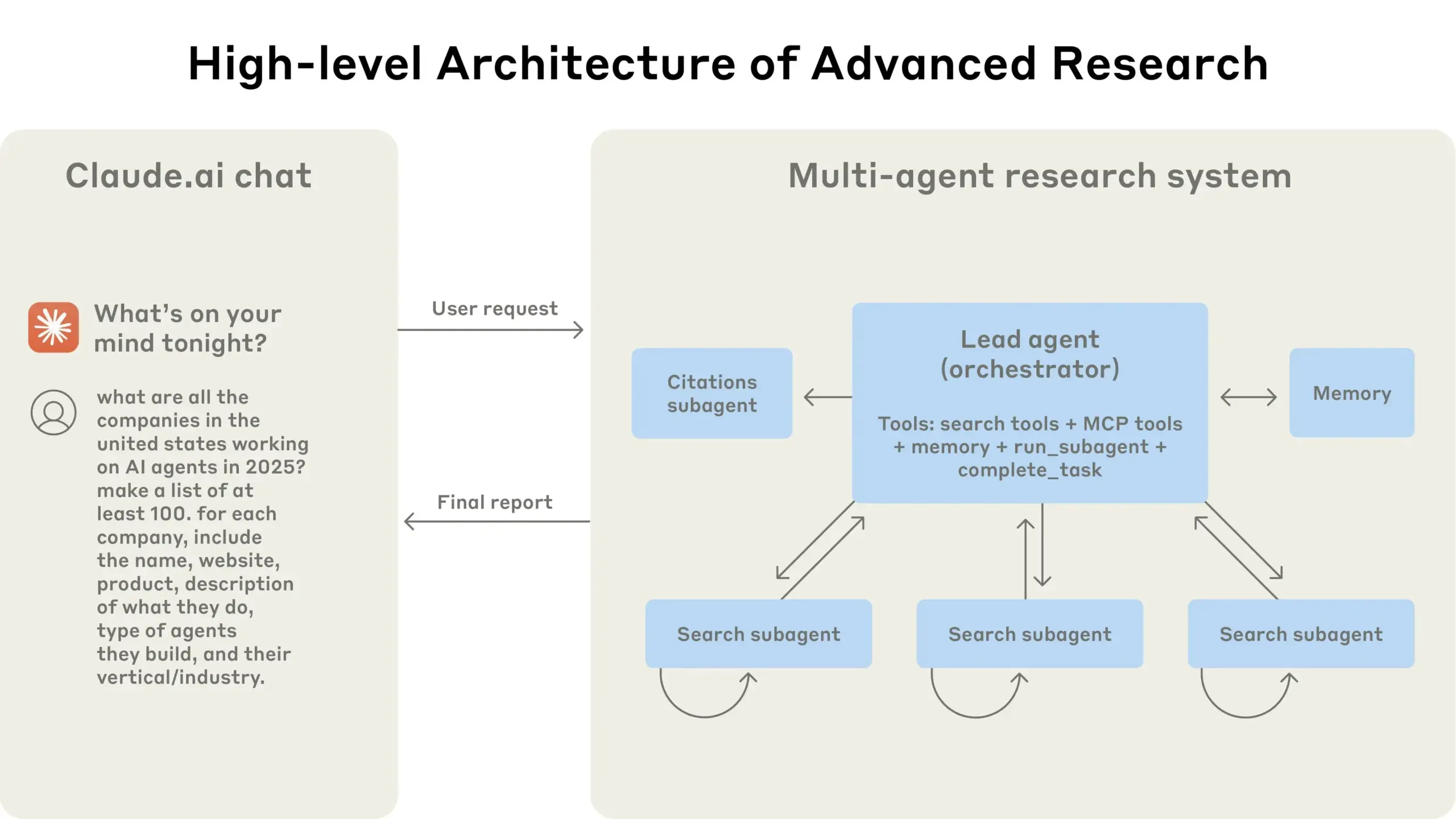

Anthropic分享多智能体研究系统构建经验: TheTuringPost推荐了Anthropic发布的免费指南《我们如何构建多智能体研究系统》。该指南详细解释了其研究系统架构的工作原理、提示工程与测试方法、生产中面临的挑战以及多智能体系统的优势,为构建复杂AI系统提供了宝贵参考 (来源: TheTuringPost)

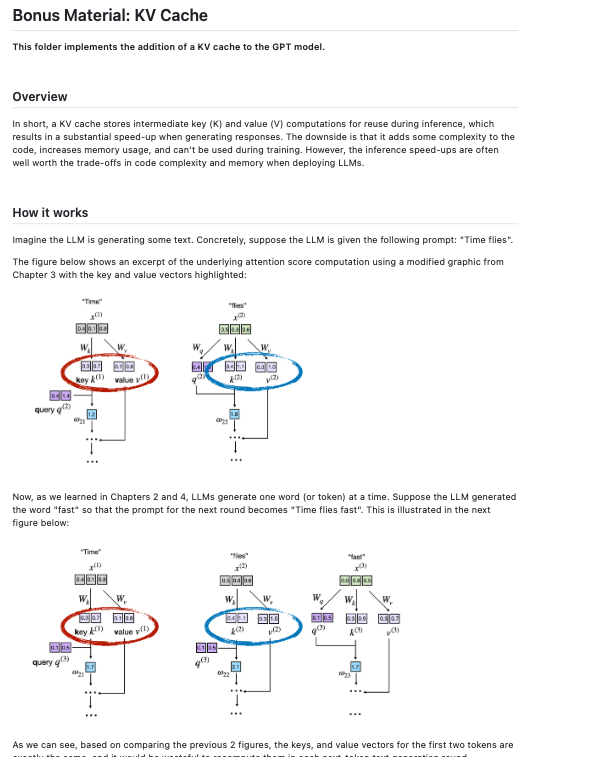

大语言模型微调与开发资源: Dorialexander指出对于Qwen3 0.6B这样的小模型,进行全量微调而非LoRA可能是更优选择。dl_weekly分享了在SIIM-ISIC黑色素瘤数据集上微调Gemma 3的多模态生产流程指南。Sebastian Raschka则为其《LLMs From Scratch》仓库添加了KV缓存的实现代码,丰富了从零构建LLM的学习资源 (来源: Dorialexander, dl_weekly, rasbt)

AI可解释性(XAI)与推理能力探讨: NerdyRodent分享了关于“黑箱问题与玻璃箱选项”的YouTube视频,探讨AI决策过程的透明度。同时,社区也在讨论XAI领域目前缺失的关键要素,以及如何定义一个模型被“完全理解”。有研究者认为,即使是简单的全连接前馈网络,现有XAI方法也未能像人类推理那样解释其决策过程 (来源: NerdyRodent, Reddit r/MachineLearning)

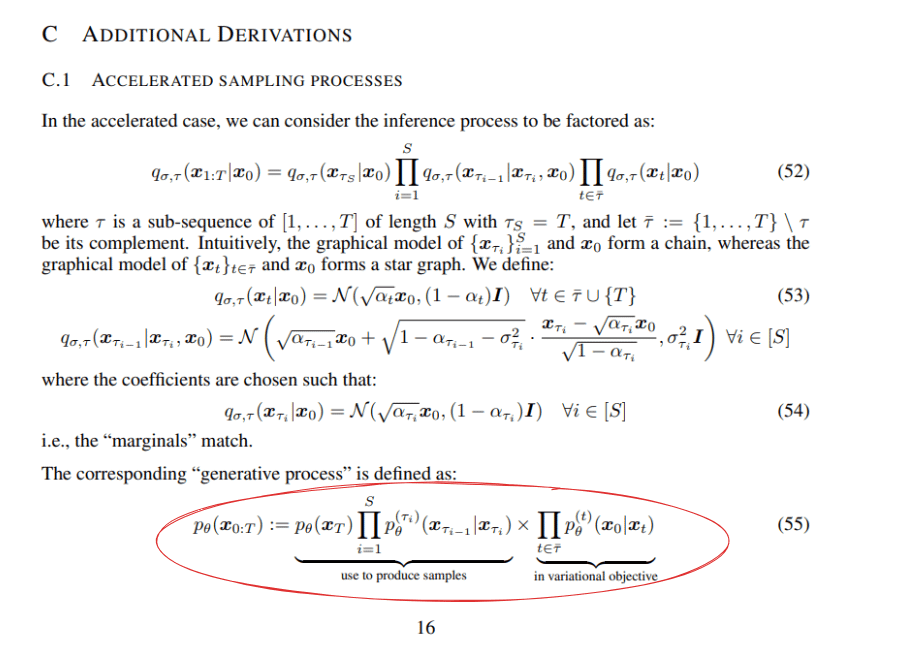

深度学习与强化学习理论探讨: Reddit用户讨论了DDIM(Denoising Diffusion Implicit Models)论文中的数学公式,特别是公式55的因子分解方式。另一篇博文则指出Q-learning在可扩展性方面仍存在挑战,引发了对强化学习算法实用性的思考 (来源: Reddit r/MachineLearning, Reddit r/MachineLearning)

从零构建卷积神经网络(CNN)的实践分享: AxelMontlahuc在GitHub上分享了其用C语言从零开始实现的CNN项目,用于MNIST数据集的图像分类。该实现不依赖任何库,包含卷积层、池化层、全连接层、Softmax激活和交叉熵损失函数,目前在5个epoch后准确率达到91%,展示了底层实现对理解深度学习原理的帮助 (来源: Reddit r/deeplearning)

AI对经济与教育的影响分析: 一场关于后劳动经济学的讲座(2025年更新版)探讨了AI带来的“更好、更快、更便宜、更安全”的变革及其对经济结构的影响。同时,PwC的报告指出,随着AI的兴起,雇主对正规学位的需求正在下降,尤其是在受AI影响的岗位上,这可能导致大学学位“过时” (来源: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

💼 商业

大型科技公司AI战略对比分析: 社区讨论了微软(Azure+OpenAI,企业级LLM部署)、亚马逊(AWS自研AI芯片,端到端模型支持)、英伟达(GPU硬件主导,CUDA生态)、甲骨文(高性能GPU基础设施,与OpenAI/SoftBank合作Stargate项目)和Palantir(AIP平台,面向政府和大型企业的运营AI)等主要科技公司在AI领域的技术基础设施和应用策略。讨论聚焦于各公司的创新举措、技术架构差异及其在AI生态中的定位和优势 (来源: Reddit r/ArtificialInteligence)

欧洲公司在AI招聘应用方面相对滞后: 报告显示,仅有3%的欧洲顶级雇主在其招聘网站上使用AI或自动化技术提供个性化求职体验,多数网站缺乏基于技能的智能推荐、聊天机器人或动态职位匹配功能。相比之下,采用AI招聘的公司在候选人参与度、包容性以及专才岗位填充速度方面表现更佳,凸显了欧洲企业在AI赋能人力资源方面的差距 (来源: Reddit r/ArtificialInteligence)

Cerebras被指控进行代币骗局: 社区用户draecomino发出警告,指出AI芯片公司Cerebras并未发行任何代币,当前流传的所谓Cerebras代币属于诈骗行为,提醒用户不要点击相关链接,谨防受骗 (来源: draecomino)

🌟 社区

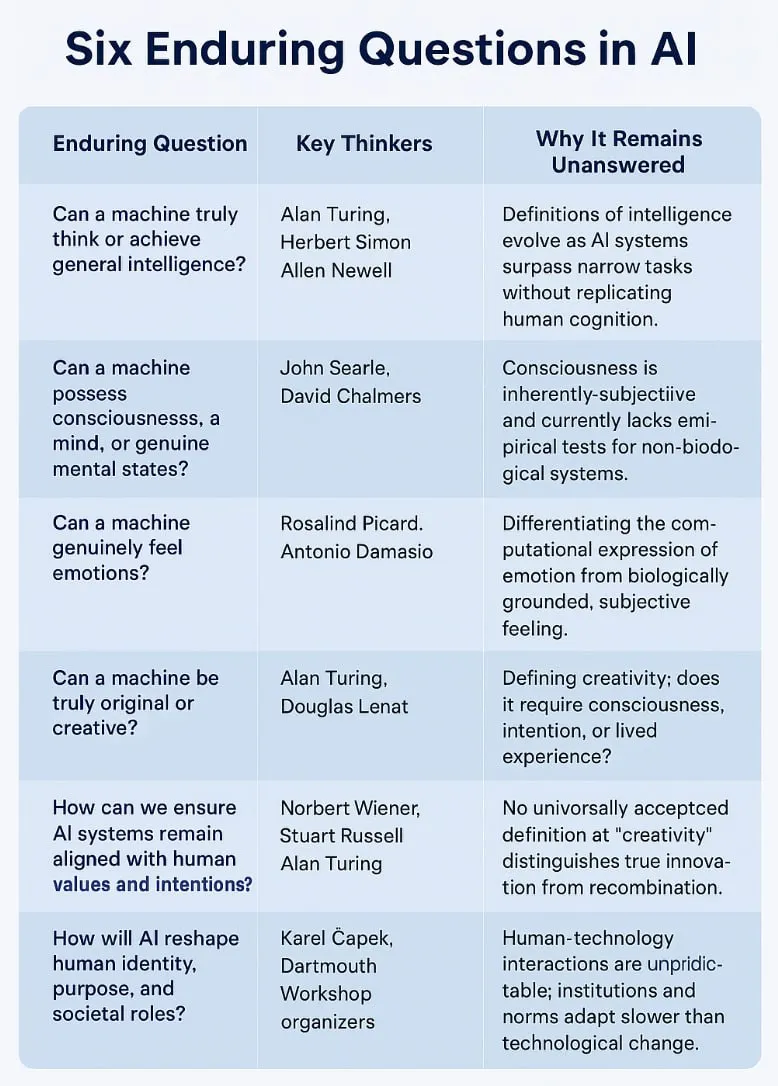

AI哲学与未来思辨:从NSI到ASI,从数据枯竭到意识探讨: 社区热议AI的本质与未来。Pedro Domingos提出“自然超级智能(NSI)即智人”,引发对智能定义的思考。同时,关于LLM是否仅是模式识别、训练数据耗尽后AI将如何演化、以及AI是否可能产生意识等话题层出不穷。Plinz认为LLM类似“博闻强记的学者”,记忆力强但缺乏真正的思考。用户对AGI何时到来、以及AGI可能采取的自我保护策略(如创建地外备份)充满猜测。这些讨论反映了公众对AI潜能与风险的复杂情感 (来源: pmddomingos, Plinz, Teknium1, Reddit r/ArtificialInteligence, Reddit r/artificial, TheTuringPost)

AI能力边界与局限性讨论:从“思维错觉”到“气味测试”: 陶哲轩关于AI“通过眼看测试,但通不过气味测试”的观点引发共鸣,指出现有AI生成的证明可能看似完美无瑕,但缺乏人类数学家所具备的“数学直觉”或“品味”,其错误往往微妙且非人化。这一观点与苹果“思维错觉”论文引发的讨论相呼应,社区普遍关注当前LLM在复杂推理、工具使用、数学问题解决(如AIME问题中对非整数解的忽视)等方面的局限性,以及如何评估和提升AI的真实理解与创造能力 (来源: denny_zhou, clefourrier, Dorialexander, TheTuringPost)

AI伦理与社会影响:工作取代、隐私担忧与人机交互新常态: AI对就业市场的影响持续成为焦点,特别是程序员岗位是否会被AI取代的讨论尤为激烈。有观点认为,相较于艺术创作领域,程序员失业的讨论热度不高。同时,AI在艺术创作、员工监控等方面的应用也引发了道德困境和隐私担忧,例如用户担心被ChatGPT通过实时位置照片进行人肉搜索。人与AI的交互模式也在演变,有开发者将AI视为“编码伙伴”,甚至出现用户将ChatGPT用作心理治疗工具的现象,引发对其有效性和潜在风险的讨论 (来源: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence, claud_fuen, Reddit r/artificial, Reddit r/ChatGPT)

AI生成内容与社区文化观察: AI生成图像和视频成为社区热门话题,从“最尬图片”挑战、Ghibli风格游戏概念视频,到用户分享的“拉布布”动态壁纸、ChatGPT创造的新艺术风格“Interlune Aesthetic”以及幽默的“小鸡电击项圈”广告图等,展示了AI在创意领域的广泛应用和娱乐潜力。同时,“死亡互联网理论”因Reddit热门帖子疑似由ChatGPT生成而再获关注,社区对AI生成内容的辨识和网络信息真实性表示担忧。此外,AI模型(如Claude)在交互中表现出的特定行为,如主动要求澄清不明确指令或在特定情境下给出出乎意料的回应(如对“吃意面”的过度担忧),也成为用户讨论的焦点 (来源: Reddit r/ChatGPT, Reddit r/ChatGPT, op7418, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT, VictorTaelin, Reddit r/ChatGPT)

AI开发者社区动态与工具使用经验: 开发者社区积极参与AI项目和黑客松,如LeRobot全球黑客松在班加罗尔等地吸引众多参与者。用户分享使用各类AI工具的经验,例如Hamel Husain推荐在系统提示中加入引导AI改进Prompt的指令,skirano则建议对Pro级别模型的使用应置于至少两步流水线之后。Claude Code因其强大功能受到开发者好评,有用户称其为“200美元花得最值”的工具。同时,对AI工具可能“让我们变笨”的担忧也存在,认为当前许多AI工具过度强调易用性而忽视了培养用户专业技能 (来源: ClementDelangue, HamelHusain, skirano, Reddit r/ClaudeAI, Reddit r/artificial)

💡 其他

AI行业会议与活动信息: The Turing Post等资讯平台推广了多个AI相关的线上及线下活动。例如,CoreWeave与NVIDIA联合举办“加速AI创新”虚拟活动,分享AI商业应用的实践洞察。DeployCon作为面向工程师的免费峰会,将于6月25日在旧金山及线上举行,主题涵盖规模化AI运行、LLMOps、强化学习微调、智能体、多模态AI及开源工具等 (来源: TheTuringPost, TheTuringPost)

AI领域职位招聘信息: andriy_mulyar发布招聘机器学习实习生的信息,该实习生将直接向其汇报,参与一个特殊的视觉语言模型(VLM)后训练项目,并要求应聘者能力出众,通过私信申请 (来源: andriy_mulyar)