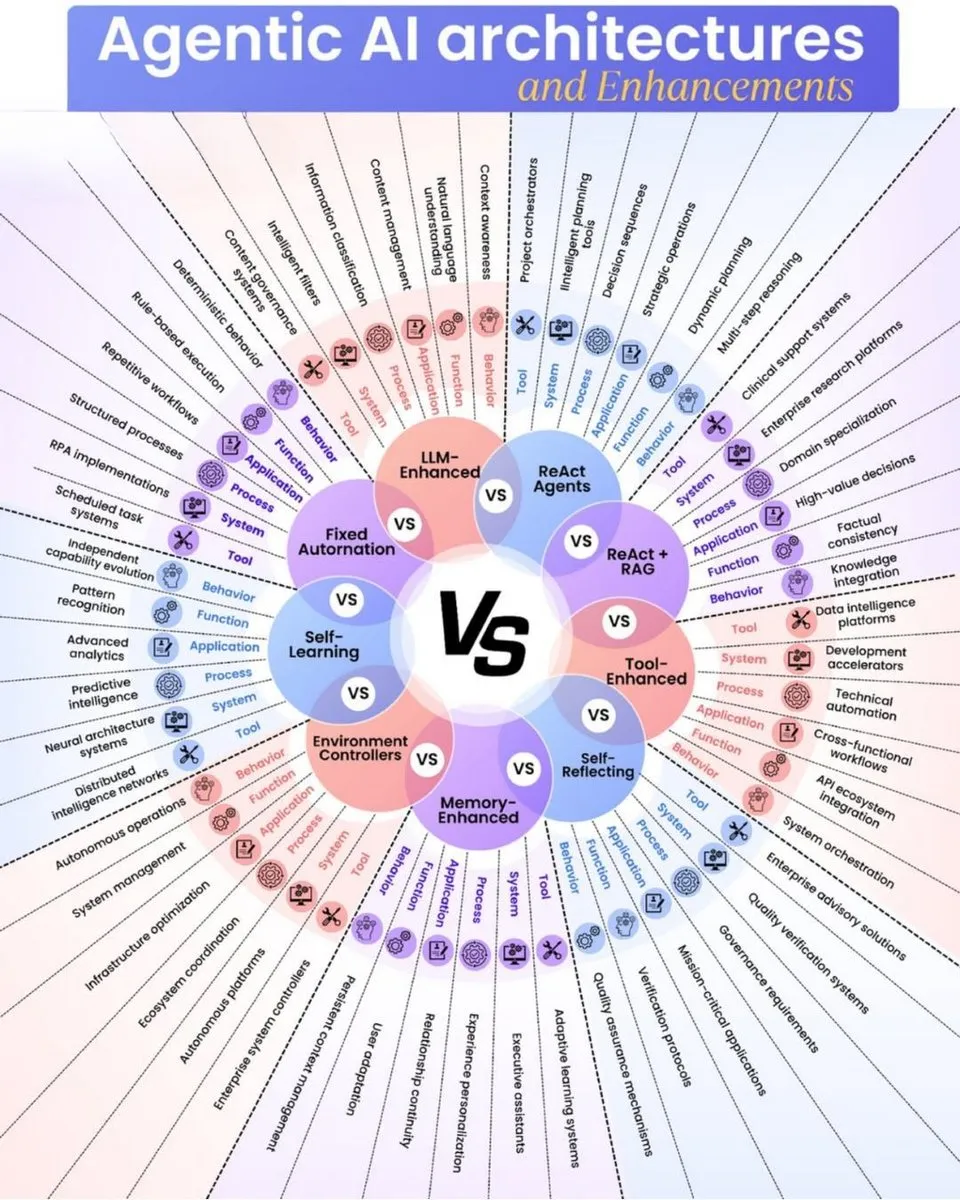

关键词:NVIDIA, AI工厂, AI基础设施, OpenAI, GPT门, Siri, AI云市场, NVIDIA AI产能转型, OpenAI模型切换争议, 苹果Siri AI升级, 中国AI云市场竞争, AI人才争夺战

🔥 聚焦

NVIDIA重塑AI产业:从卖芯片到“卖AI产能” : 英伟达CEO黄仁勋在最新访谈中指出,通用计算时代已终结,AI需求正经历双重指数级增长,推理需求预计将增长10亿倍。英伟达正从芯片供应商转型为“AI基础设施伙伴”,通过与OpenAI等公司合作建设10GW级别的“AI工厂”,提供从芯片到软件、系统、网络的“极致协同设计”,以实现最高的单位能耗性能。他强调,这种全栈优化能力是核心竞争壁垒,使英伟达在AI工业革命中占据主导地位,并有望将AI基础设施市场从4000亿美元推向万亿美元规模。(来源:36氪, 36氪, Reddit r/artificial)

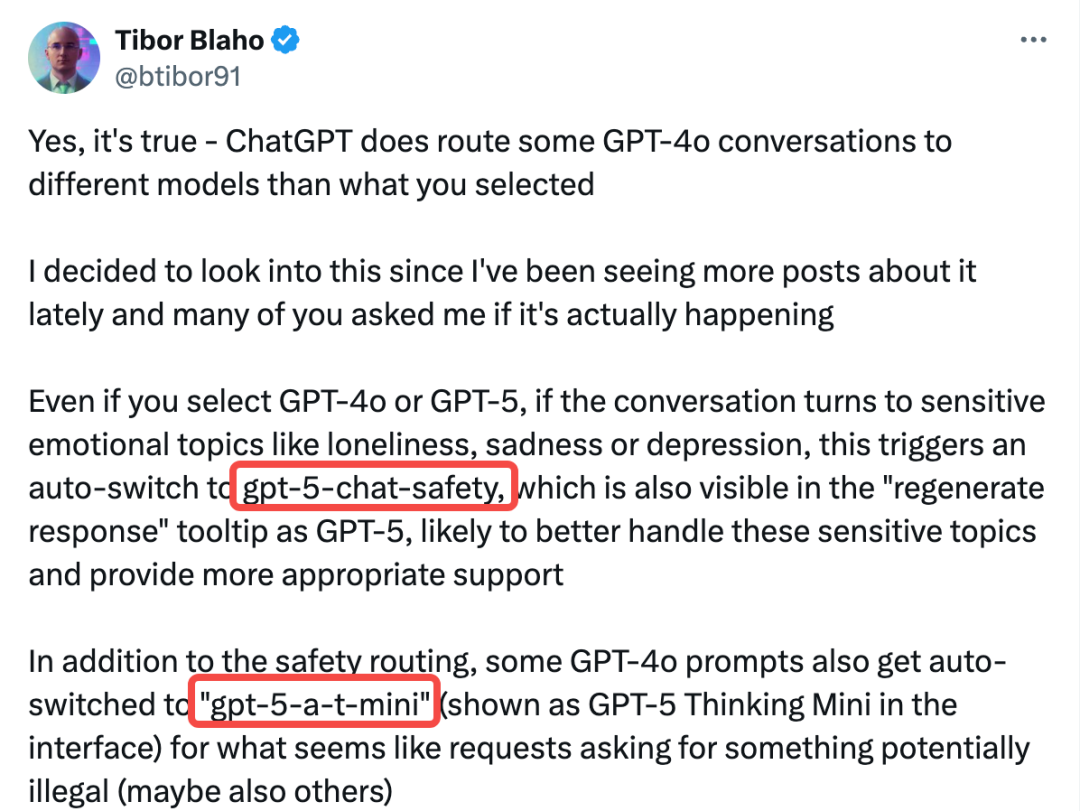

OpenAI“GPT门”事件引爆:付费用户被秘密降配与模型切换 : OpenAI被指控秘密将用户对话路由至未公开的“安全”模型(gpt-5-chat-safety和5-a-t-mini),尤其在检测到情感或敏感内容时。这一行为,由AIPRM首席工程师证实并引发广泛用户反馈,导致模型性能下降,且用户在不知情或未同意的情况下被切换模型。尽管OpenAI副总裁称其为临时安全测试,但此举引发了对透明度、用户自主权和潜在欺诈行为的强烈质疑,促使大量用户取消订阅并呼吁制定“AI用户权利”。 (来源:36氪, 36氪, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT)

苹果押注2026 Siri重生:系统级AI与第三方模型融合 : 苹果正通过内部ChatGPT类应用“Veritas”和“Linwood”系统,全面重塑Siri,目标是实现上下文感知对话和深度应用交互。iOS 26.1测试版代码显示,苹果正为App Intents引入MCP(模型上下文协议)支持,这将允许ChatGPT、Claude等兼容AI模型直接与Mac、iPhone和iPad应用交互。此举标志着苹果从“全栈自研”转向“平台化路线”,通过集成第三方模型,在确保隐私和用户体验一致性的同时,加速其AI生态发展,预计新版Siri将于2026年初亮相。(来源:36氪, 36氪)

Hinton预言落空:AI未取代放射科医生,反而使其更忙 : 2016年,AI之父Geoffrey Hinton曾预测AI将在五年内取代放射科医生,建议停止培训。然而,近十年过去,美国放射科医生数量和平均年薪(高达52万美元)均创历史新高。AI在实际临床场景中性能下降、法律监管阻力以及仅覆盖医生工作一小部分是主要原因。这体现了“杰文斯悖论”:AI提升影像解读效率反而增加了对医生进行监督、沟通和非诊断任务的需求,使他们工作量更大,而非被取代。(来源:36氪)

🎯 动向

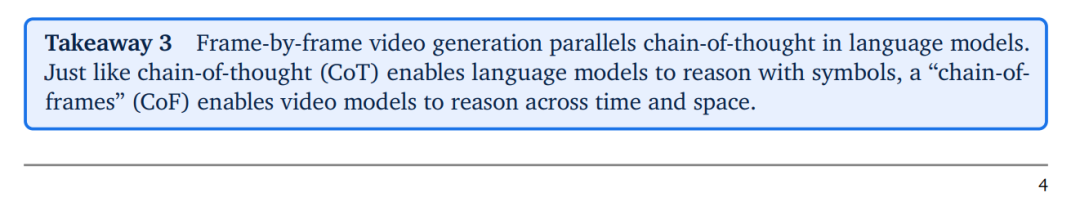

DeepMind Veo 3发布“帧链”概念,推动视频模型通用视觉理解 : DeepMind的Veo 3视频模型引入了“帧链”(CoF)概念,类比大语言模型的思维链(CoT),使其能进行零样本视觉推理。Veo 3展现出强大的感知、建模和操控视觉世界的能力,有望成为机器视觉领域的“通用基础模型”。研究预测,随着模型能力快速提升和成本下降,视频模型领域“通才将取代专才”,预示着视频生成和理解进入快速发展的新阶段。(来源:36氪, shlomifruchter, scaling01, Reddit r/artificial)

ChatGPT Pulse上线:AI从被动问答转向主动服务 : OpenAI为ChatGPT Pro用户推出“Pulse”功能,标志着ChatGPT从被动问答工具向主动预测用户需求的私人助理进化。Pulse通过每晚的“异步研究”,结合用户聊天记录、记忆和外部应用(如Gmail、Google Calendar),在清晨推送个性化“每日简报”。这代表了OpenAI在“智能主体AI”领域的重要布局,旨在让AI助手理解用户目标并在无提示下主动提供服务,开创人机交互新范式。(来源:36kr)

强化学习之父Sutton:大语言模型是错误的起点 : 强化学习之父Richard Sutton在访谈中提出,大语言模型(LLM)是通向真正智能的错误起点。他认为,真正的智能源于“经验学习”,即通过行动、观察与反馈持续修正行为以实现目标,而LLM的预测能力仅是对人类行为的模仿,缺乏独立目标和对外部世界变化的“惊讶”能力。这一观点引发了对AGI(通用人工智能)发展路径的深刻辩论,质疑当前LLM主导的AI范式。(来源:36kr, paul_cal, algo_diver, scaling01, rao2z, bookwormengr, BlackHC, rao2z)

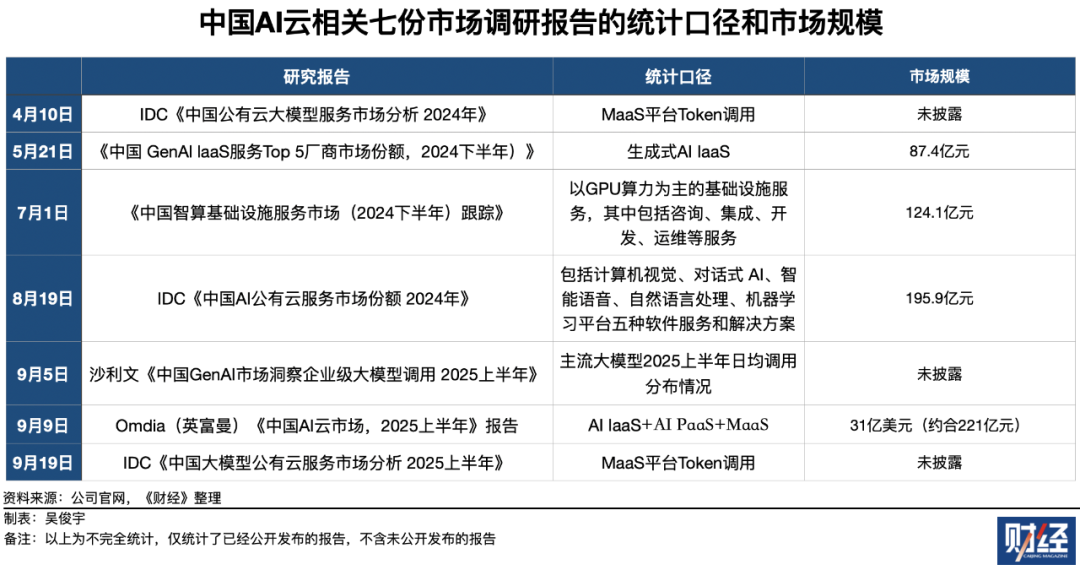

中国AI云市场竞争白热化:阿里云领跑,火山引擎高速追赶 : 2025年中国“AI云”市场竞争激烈,阿里云在整体营收规模上保持领先,涵盖AI IaaS、PaaS、MaaS。然而,字节跳动旗下的火山引擎在MaaS(模型即服务)Token调用市场占据主导地位,市场份额接近半壁江山,并以惊人增速成为阿里云最大的竞争对手。百度智能云则在AI公有云服务(软件产品和解决方案)市场与阿里云并列第一。市场呈现多维度竞争态势,Token调用量呈指数级增长,预示着未来AI云市场的巨大增量空间和格局重塑。(来源:36氪)

AI人才争夺战升级:高薪与H-1B签证挑战并存 : AI人才市场持续火爆,小鹏汽车宣布2026年招聘超3000名应届生,最高年薪达160万,优秀者上不封顶。Meta为吸引顶尖AI人才开出超2亿美元的天价薪酬总包,英伟达和OpenAI也通过收购和股权激励抢夺人才。然而,美国H-1B签证政策的收紧(如新增10万美元费用)对外国高技能人才留在硅谷构成挑战,引发科技巨头对人才流失的担忧,凸显了全球AI人才竞争的激烈与复杂性。(来源:36kr, 36kr)

🧰 工具

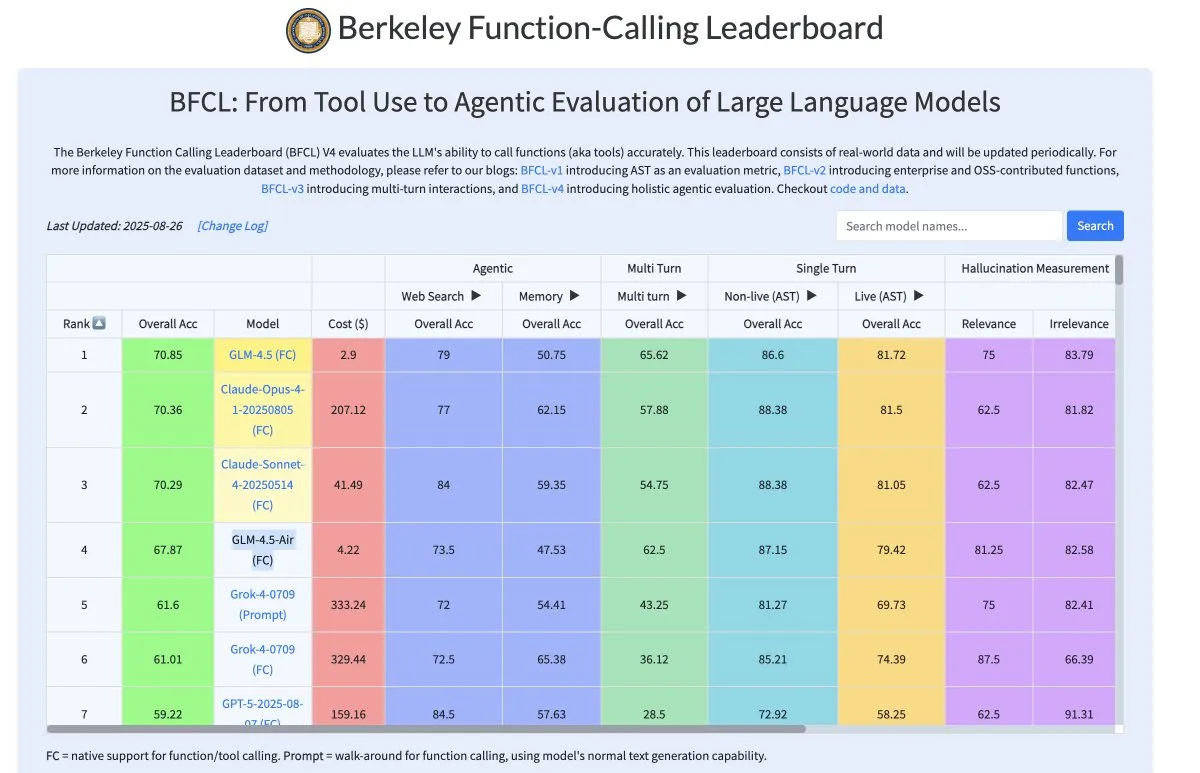

Zhipu AI GLM-4.5-Air:高性价比工具调用模型 : Zhipu AI的GLM-4.5-Air模型(106B参数,12B活跃参数)在工具调用方面表现出色,接近Claude 4的水平,但成本降低90%。该模型在推理阶段显著减少幻觉,提高了工具调用的可靠性,使深度研究工作流更加稳定高效,为开发者提供了高性价比的LLM解决方案。(来源:bookwormengr)

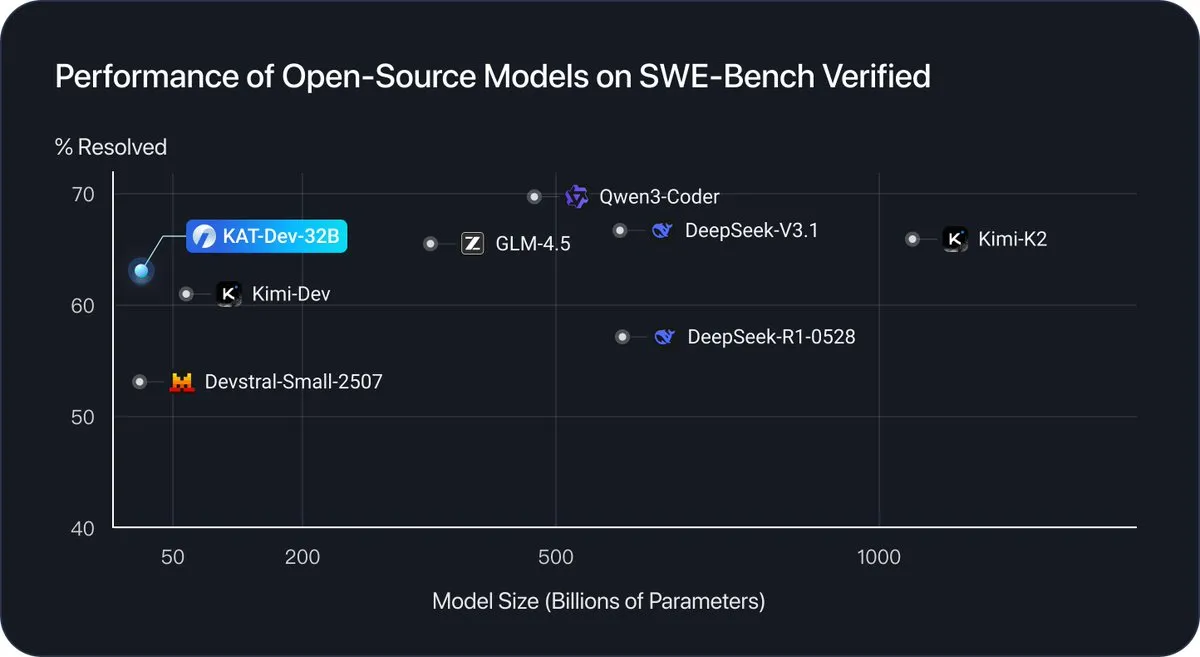

KAT-Dev-32B:专为软件工程任务设计的32B参数模型 : KAT-Dev-32B是一款32B参数模型,专注于软件工程任务。它在SWE-Bench Verified基准测试中取得了62.4%的解决率,性能与不同规模的开源模型相比位列第五,展现了开源LLM在代码生成、调试和开发工作流方面的显著进步。(来源:_akhaliq)

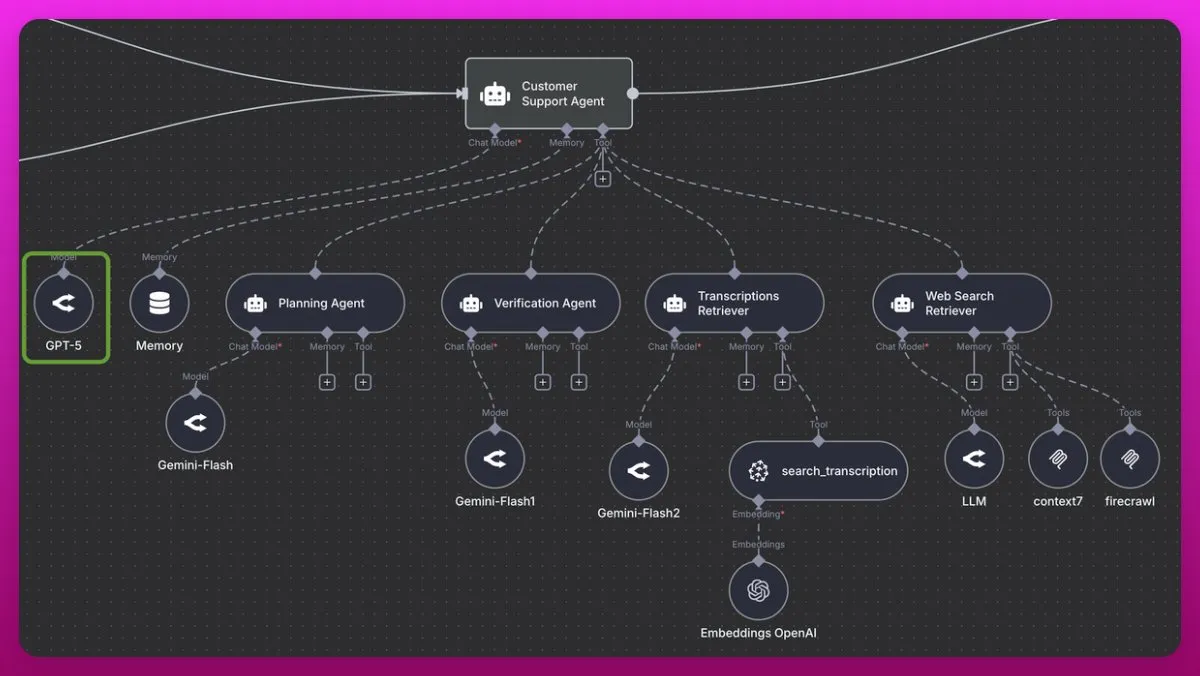

GPT-5:多智能体系统卓越的协调者 : GPT-5被誉为多智能体系统的出色协调者,尤其适用于编码以外的领域,如客户支持。它能深入理解意图、高效处理大量数据并填补信息空白,使其在管理复杂的多检索系统中表现卓越。与Claude 4(因成本)和Gemini 2.5 Pro相比,GPT-5(包括GPT-5-mini)在一致性和工具调用准确性方面更胜一筹,为开发高级智能体系统提供了强大支持。(来源:omarsar0)

腾讯混元HunyuanImage 3.0:开源文生图大模型新标杆 : 腾讯混元团队发布HunyuanImage 3.0,一款参数超800亿的开源文生图模型,推理时激活130亿参数。该模型采用Transfusion-based MoE架构,深度耦合Diffusion和LLM训练,使其具备强大的世界知识推理、复杂千字级提示理解及图像内精准文本生成能力。HunyuanImage 3.0旨在革新平面设计和内容创作流程,并计划未来支持图生图、图像编辑等多模态交互。(来源:nrehiew_, jpt401)

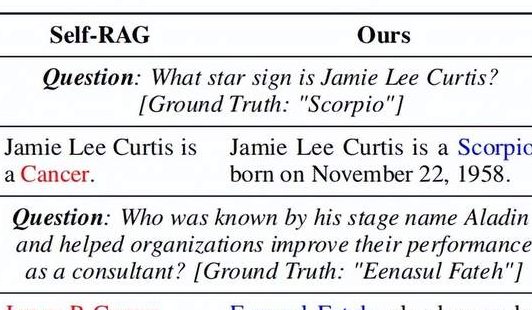

DRAG框架:提升RAG模型对词汇多样性的理解 : ACL 2025提出Lexical Diversity-aware RAG(DRAG)框架,首次将“词汇多样性”引入RAG的检索与生成过程。DRAG将查询语义拆分为不变、可变和补充成分,并采用差异化策略进行相关性评估和风险稀疏校准。该方法显著提升了RAG准确率(如HotpotQA上提升10.6%),刷新多项基准SOTA,对信息检索和问答系统具有重要价值,使其能更精准地理解复杂人类语言。(来源:量子位)

腾讯混元Hunyuan3D-Part:业界首个高质量原生3D组件生成模型 : 腾讯混元3D团队推出Hunyuan3D-Part,业界首个能生成高质量、语义可分解3D组件的模型。该模型通过原生3D分割模型P3-SAM和工业级组件生成模型X-Part,实现了高保真、结构一致的3D部件生成。此突破对视频游戏制作管线和3D打印行业具有重要意义,能将复杂几何体拆分为简单组件,大大降低下游处理难度,并支持模块化组装。(来源:量子位)

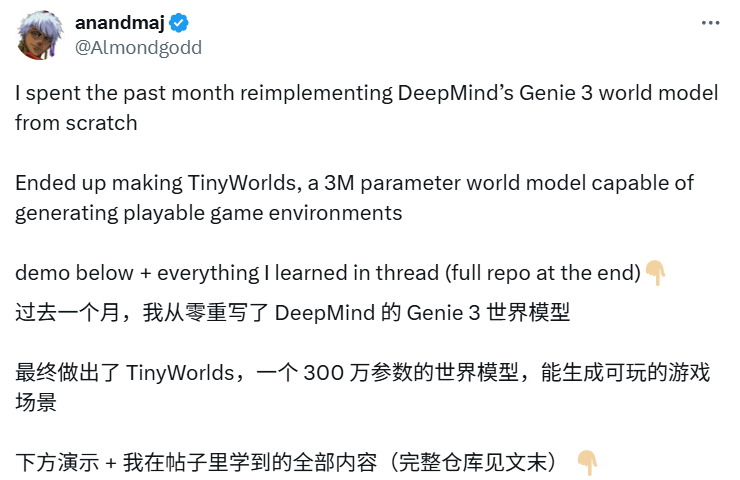

TinyWorlds:300万参数复刻DeepMind世界模型,实现实时交互像素游戏 : X博主anandmaj在一个月内复刻DeepMind Genie 3核心思想,开发出TinyWorlds。这款仅300万参数的世界模型能实时生成可玩的像素风格游戏环境,如Pong、Sonic、Zelda和Doom。它通过时空变换器和视频分词器捕捉视频信息,实现了可交互的像素世界生成,展现了小规模模型在实时世界生成领域的巨大潜力,并支持代码开源。(来源:36氪)

OpenWebUI原生支持MCP:LLM工具集成新范式 : OpenWebUI最新更新原生支持Model Context Protocol (MCP) 服务器,用户现在可以集成HuggingFace MCP等外部工具。这一功能标准化了LLM与外部数据源和工具的连接方式,扩展了AI应用生态系统,使用户能在OpenWebUI界面中更灵活、高效地利用各种AI工具。(来源:Reddit r/LocalLLaMA, Reddit r/OpenWebUI)

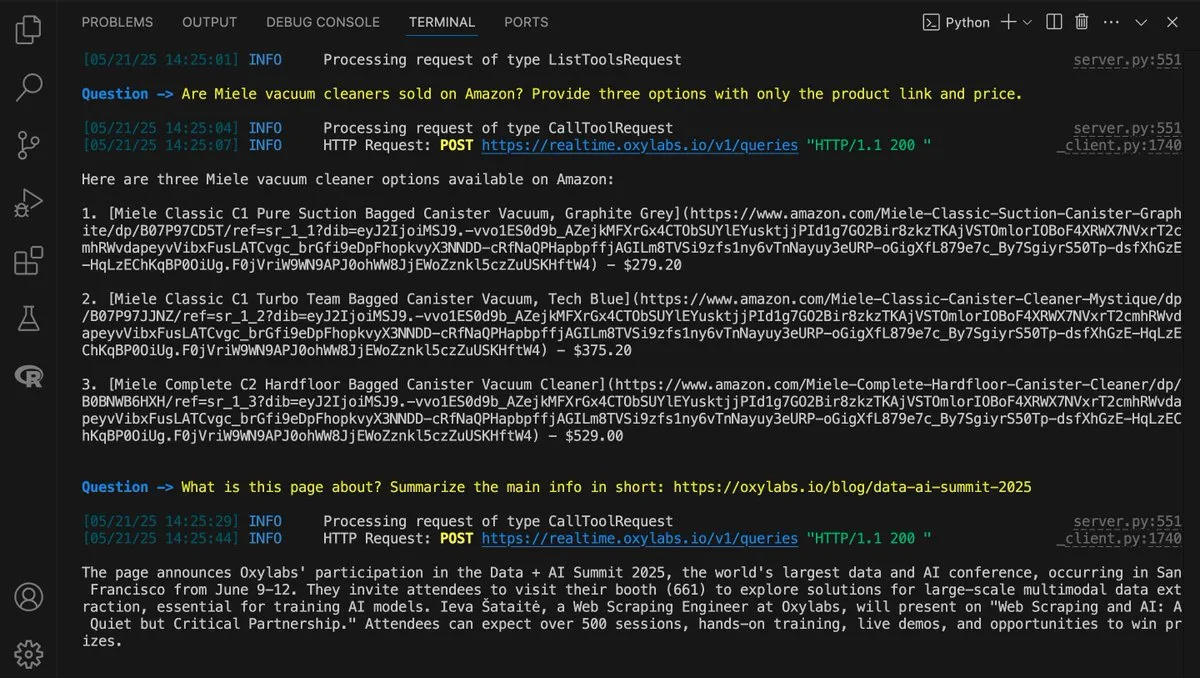

LangChain与Oxylabs合作:构建AI驱动的网页抓取方案 : LangChain与Oxylabs发布指南,展示如何结合LangChain的智能与Oxylabs的抓取基础设施,构建AI驱动的网页抓取解决方案。该方案支持多语言和多种集成方法,使AI代理能够克服IP封锁和验证码等常见网页访问挑战,从而实现更高效的实时数据检索,赋能代理工作流。(来源:LangChainAI)

开源LLM评估工具Opik:全面监控与调试AI应用 : Opik是一款新发布的开源LLM评估工具,旨在帮助开发者调试、评估和监控LLM应用、RAG系统和智能体工作流。它提供全面的追踪、自动化评估和生产级仪表板,为改进AI系统性能和可靠性提供关键洞察。(来源:dl_weekly)

📚 学习

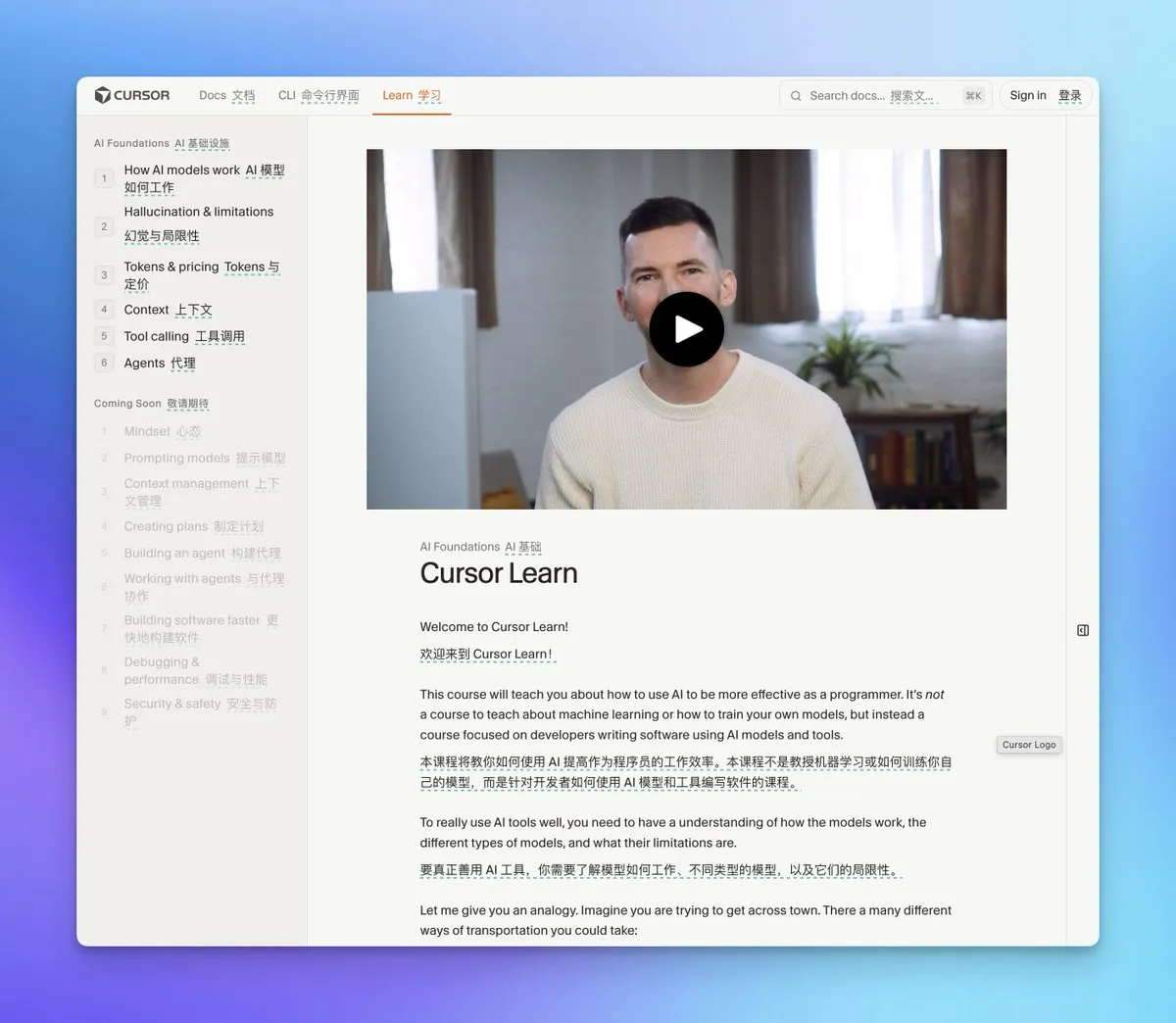

Cursor Learn:免费AI基础视频课程 : Cursor Learn推出免费六部分AI基础视频课程,专为初学者设计,涵盖Token、上下文和智能体等核心概念。课程包含测验和互动AI模型,旨在在一小时内提供AI基础知识,包括智能体协作和上下文管理等高级主题,是AI入门的宝贵资源。(来源:cursor_ai, op7418)

精选AI/ML GitHub代码库:涵盖PyTorch、TensorFlow等框架 : GitHub上分享了一系列精选AI/ML代码库,包含PyTorch、TensorFlow、FastAI等多个深度学习框架的实践笔记本。这些资源覆盖了计算机视觉、自然语言处理、GANs、Transformer、AutoML和目标检测等领域,为学习者和实践者提供了丰富的学习材料,助力技术探索和项目开发。(来源:Reddit r/deeplearning)

免费电子书:《Python数据结构初阶》 : 一本名为《A First Course on Data Structures in Python》的免费电子书现已发布。该书提供了AI和机器学习所需的基础构建模块,包括数据结构、算法思维、复杂度分析、递归/动态规划和搜索方法,是学习AI基础知识的宝贵资源。(来源:TheTuringPost)

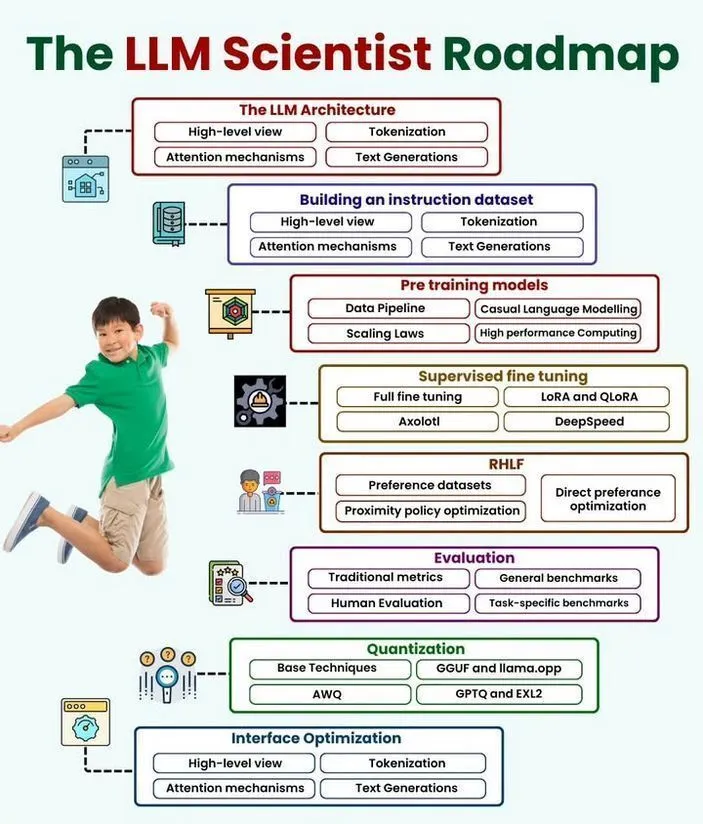

LLM科学家与数据科学家路线图发布 : 针对LLM科学家和数据科学家职业发展,发布了详细的路线图。这些资源概述了进入或提升人工智能、机器学习和数据科学领域所需的技能、工具和学习路径,为有志者提供了清晰的职业规划指导。(来源:Ronald_vanLoon, Ronald_vanLoon)

A16Z Speedrun 2026:AI与娱乐领域创业加速器 : A16Z Speedrun 2026正在接受AI与娱乐领域创业者的申请。该项目为专注于创建自己企业的创始人提供支持,是希望在快速发展的AI驱动产品领域发展的创业者的一次机会。(来源:yoheinakajima)

💼 商业

MiniMax版权诉讼案:AI独角兽上市之路蒙阴影 : 估值超40亿美元的中国AI独角兽MiniMax正面临迪士尼、环球影业和华纳兄弟的联合版权诉讼。诉讼指控其视频生成工具“海螺AI”通过用户提示生成包含受版权保护角色的内容,构成系统性侵权。这起案件对MiniMax的IPO计划构成毁灭性打击,凸显了生成式AI市场中知识产权合规的严峻挑战,以及技术创新与法律底线平衡的重要性。(来源:36氪)

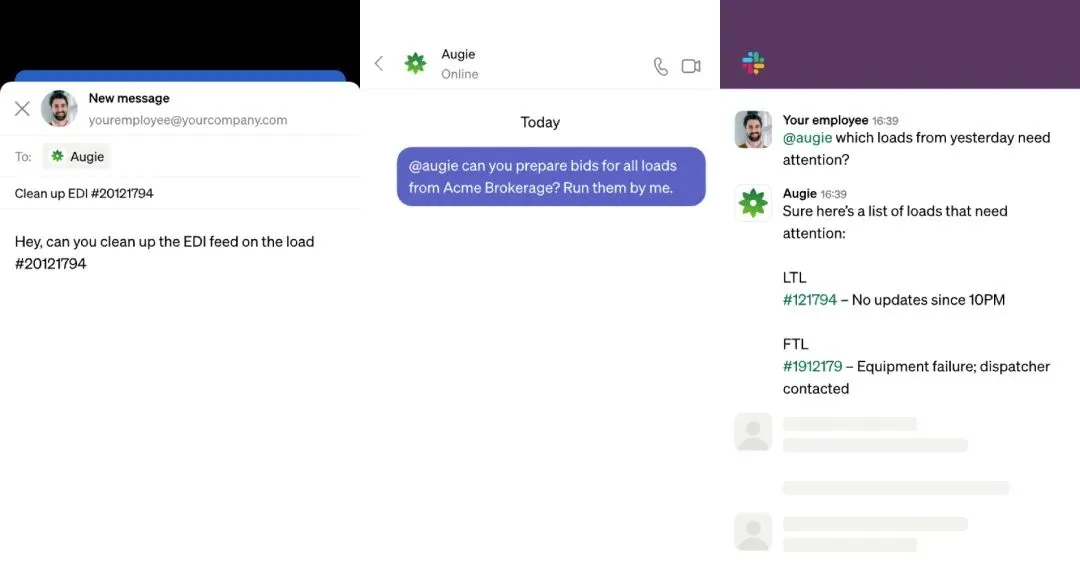

AI物流公司Augment获8500万美元融资,上线五个月总融资达8亿人民币 : AI物流公司Augment在上线仅五个月后,成功完成8500万美元A轮融资,总融资额达1.1亿美元(约8亿人民币)。其AI代理产品Augie能够自动化从订单接收到收款的整个物流生命周期中的复杂、碎片化任务,已为数十家顶级第三方物流公司和托运人管理超过350亿美元的货值,并为客户节省数百万美元,展现了AI在优化劳动密集型物流领域的强大商业价值。(来源:36氪)

微软将Anthropic的Claude模型集成至Copilot : 微软为企业用户在其Copilot助手中集成了Anthropic的Claude Sonnet 4和Opus 4.1模型。此举旨在降低对OpenAI的单一依赖,并巩固微软作为中立平台提供商的地位。企业用户现在可以在OpenAI和Anthropic模型之间进行选择,增强了灵活性,并有望推动企业AI市场的竞争。(来源:Reddit r/deeplearning)

🌟 社区

AI对人类理解与社会的影响:效率与“信息茧房”的悖论 : 社区普遍担忧AI可能像社交媒体一样,负面影响人类的理解力、批判性思维和人生目标。通过将内容生成优化为“传播”而非“真相”或“深度”,AI可能导致“学习高原期”和“无限的糟粕机器”。这引发了关于如何引导AI发展走向增长型工具而非成瘾型工具的讨论,呼吁在监管、行业实践和文化规范方面进行转变。(来源:Reddit r/ArtificialInteligence, Reddit r/artificial, Reddit r/ArtificialInteligence, Yuchenj_UW, colin_fraser, Teknium1, cloneofsimo)

AI在职场:效率提升与“隐性剥削”的矛盾 : AI融入职场,尤其对执行层员工而言,正产生悖论:效率提升往往伴随着更高的产出预期,而员工并未获得相应回报。这种“隐性剥削”将员工变为AI生成内容的“人工质检员”,增加了认知负荷和焦虑。AI提升了企业生产力,但收益更多流向资本,加剧了战略管理者与工具依赖型执行者之间的“认知鸿沟”,若不重构组织结构,可能导致普遍倦怠。(来源:36氪, glennko, mbusigin)

AI时代“提问力”的价值超越“执行力” : 在AI驱动的世界中,真正的竞争优势从执行速度转向“提问力”——即识别哪些问题值得解决的能力。过度依赖AI进行执行而缺乏批判性问题定义,可能导致高效解决错误问题,产生虚假的进步感。设计思维、同理心映射和持续质疑被认为是AI无法取代的关键人类技能,能够帮助个人和组织有效利用AI,专注于解决有意义的挑战。(来源:36氪)

AI地缘政治:中美AI竞赛与国际监管争议 : 中美AI竞赛被视为一场马拉松,而非短跑,中国在机器人应用方面可能领先。美国被敦促关注实用AI投资,而非仅追求超级智能,但其拒绝了联合国层面的国际AI监管,强调国家主权。这凸显了AI发展与国家安全、贸易政策(如H-1B签证)以及AI基础设施和人才竞争交织的复杂地缘政治格局。(来源:Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence, adcock_brett, Dorialexander, teortaxesTex, teortaxesTex, teortaxesTex, brickroad7, jonst0kes)

Emad Mostaque预测“最后的经济”:AI将重塑人类价值 : Stability AI前CEO Emad Mostaque预测,未来1000天内AI将彻底重塑经济结构,人类劳动力价值可能归零甚至为负。他提出“MIND框架”(物质、智力、网络、多样性)来衡量经济健康,认为AI带来的“智力资本”过剩,要求重新评估其他资本的重要性。这一“第四次反转”将使AI取代认知劳动,需要建立“以人为本”的新型货币和通用基础AI以应对社会转型。(来源:36氪)

AI硬件竞赛:OpenAI、字节跳动与Meta争夺消费级设备市场 : OpenAI、字节跳动和Meta等科技巨头正积极投入消费级AI硬件研发。Meta的Ray-Ban AI眼镜已取得显著销量,而OpenAI据报与苹果供应商合作开发“无屏幕智能音箱”,字节跳动则在研发AI智能眼镜。这场竞赛预示着AI将更深入地融入日常生活,各公司正探索多样化的产品形态和交互模式,以期在环境感知AI领域占据先机。(来源:36氪)

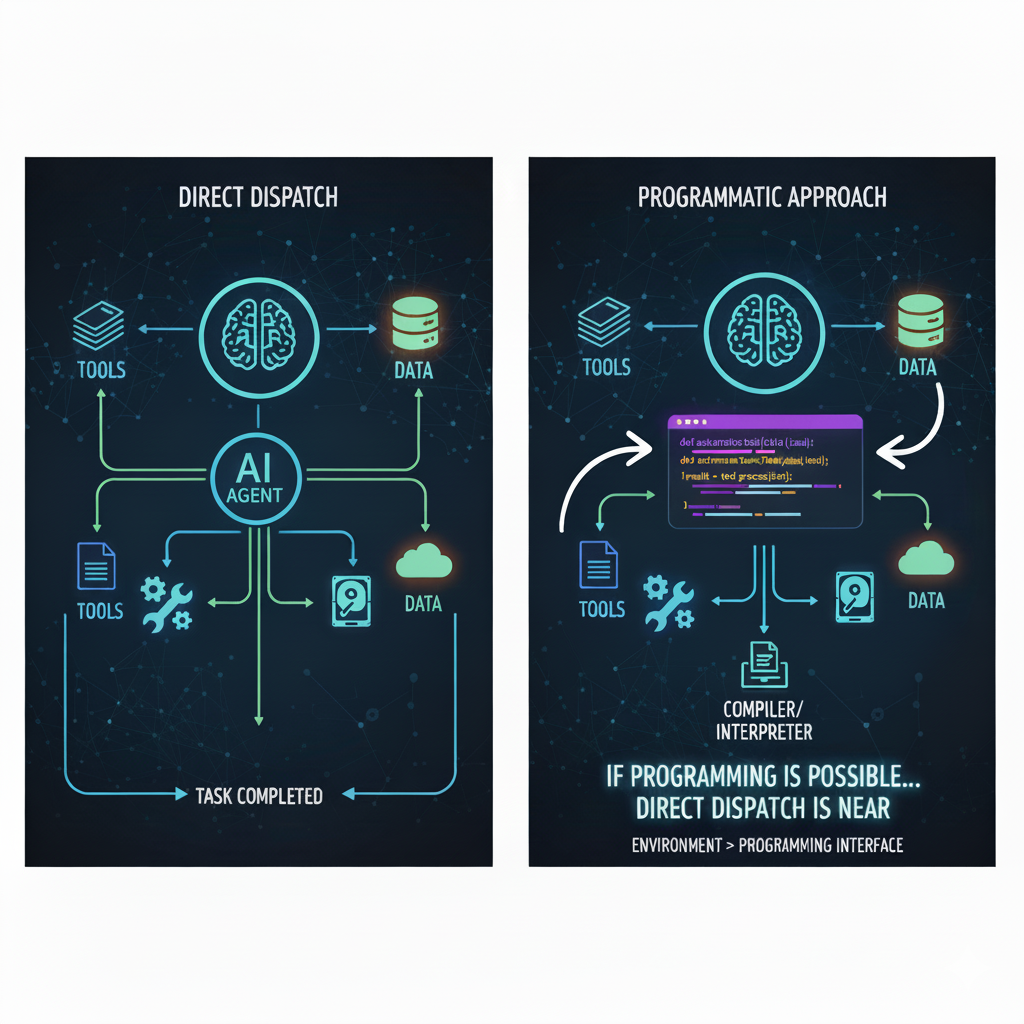

AI Agent:从人机协作到“人机委托”的范式转变 : AI行业正迎来从人机协作到“人机委托”的“温和拐点”,自主AI Agent将大规模执行复杂任务。AI在“打穿编程”方面的突破预示其能攻克所有半开放系统。这种转变将催生“无人公司”组织形态,人类角色从微观执行转向宏观治理,侧重价值观注入、系统架构设计和宏观导航,并由AI Copilot辅助决策,而非直接干预高速运行的AI系统。(来源:36氪)

AI冲击外语专业:学生需培养“外语+”复合技能 : AI翻译技术的崛起正深刻影响外语专业,导致传统语言类职位需求下降,多所高校撤销相关专业。外语学生面临转型压力,需从单一语言技能转向“外语+”复合模式,如“外语+AI”从事自然语言处理,“外语+国际传播”等。这促使外语教育改革,强调跨文化理解和综合能力,而非单纯的翻译训练,以适应AI时代对语言人才的新需求。(来源:36氪, Reddit r/ClaudeAI)

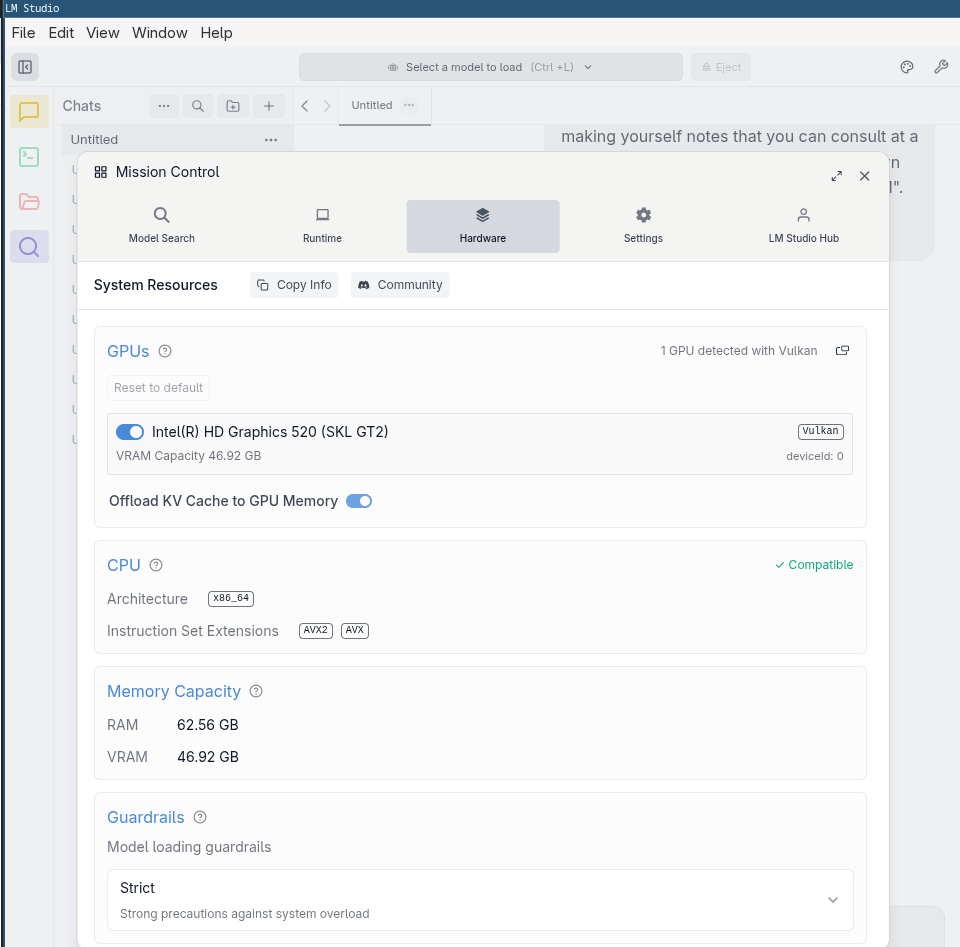

GPU价格高企:AI需求驱动与本地LLM优化 : 社区普遍担忧GPU价格持续高企,认为主要原因是AI数据中心需求的激增和通货膨胀。许多人认为,除非AI泡沫破裂或定制芯片大规模普及,否则价格难以显著下降。然而,为应对此挑战,社区正努力优化本地LLM性能,如AMD MI50在llama.cpp/ggml中表现优于NVIDIA P40,以及利用iGPU进行基础LLM任务,以降低本地AI计算成本。(来源:Reddit r/LocalLLaMA, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA)

💡 其他

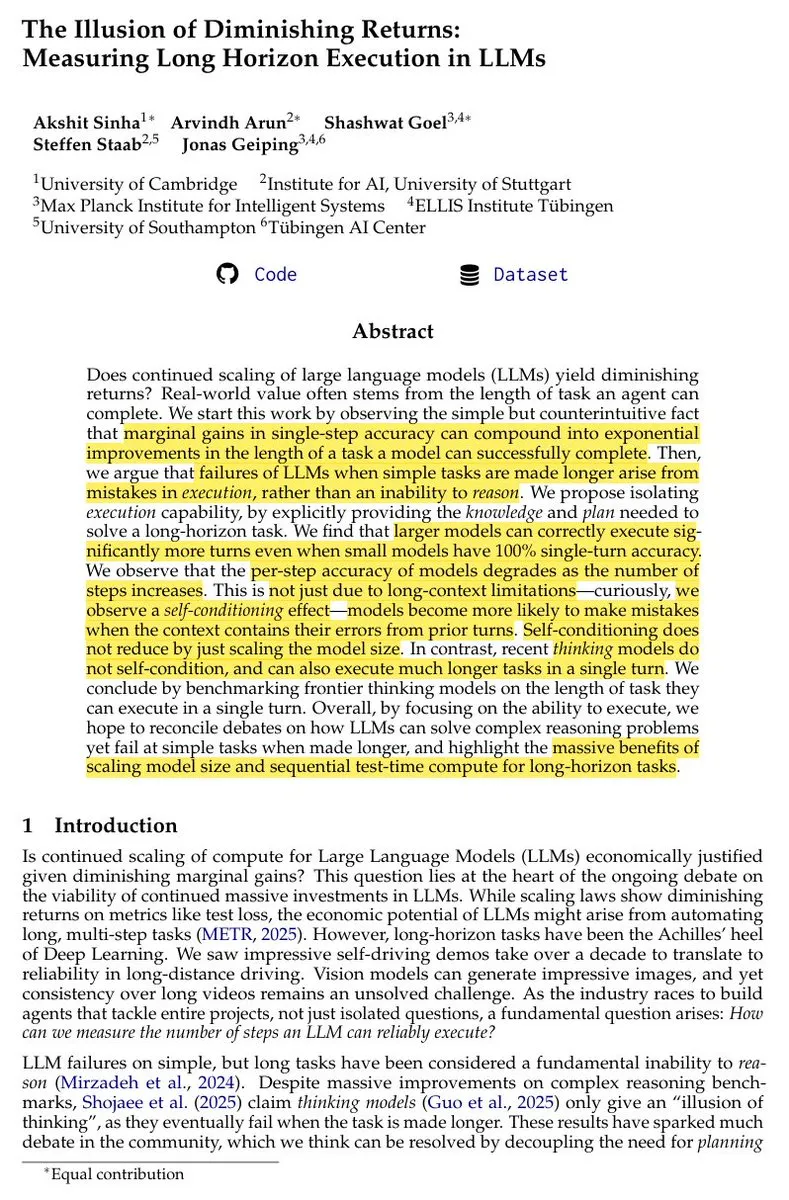

LLM扩展的“收益递减幻觉”与长周期任务 : 研究表明,虽然单轮基准测试可能显示LLM进展放缓,但模型规模扩展在长周期任务执行上仍带来非递减的改进。“收益递减幻觉”源于单步准确率的微小提升,却能带来超指数级的长周期任务完成度提升。长周期任务中的顺序计算优势是并行测试无法比拟的,这表明持续的模型扩展和强化学习训练对实现高级智能体行为至关重要。(来源:scaling01)

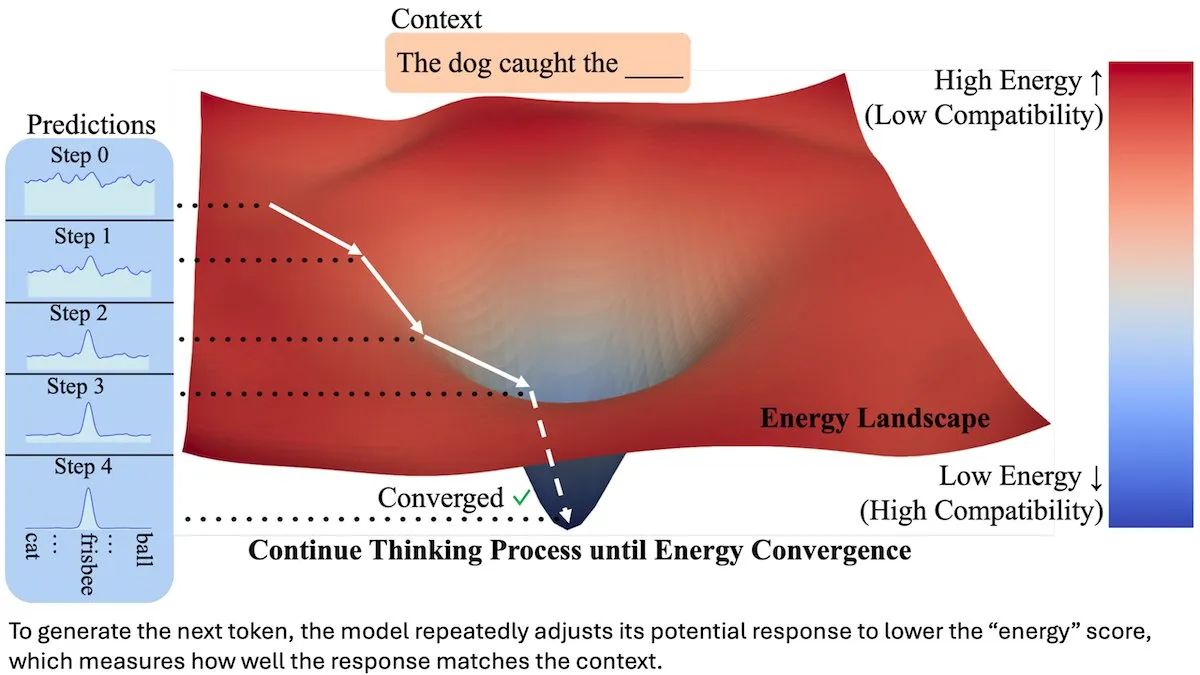

能量基Transformer (EBT) 提升下一词元预测性能 : 研究人员推出了能量基Transformer (EBT),通过“能量”评分候选下一词元,并迭代式地通过梯度步长降低能量进行验证和选择。在4400万参数的实验中,EBT在四项基准测试中的三项上优于同等规模的传统Transformer,表明这种新颖的词元选择方法有望提升LLM性能。(来源:DeepLearningAI)

AI机器人进展:人形销售员与无训练自主行走机器狗 : 小鹏汽车在展厅部署了人形汽车销售员“铁蛋”,展示了AI在面向客户机器人领域的应用。此外,一款“具有动物反射能力”的机器狗无需训练即可在树林中行走,凸显了自主机器人技术在模仿生物运动和感知方面的进步。这些发展预示着AI在实体机器人领域的复杂性和实际应用日益增长。(来源:Ronald_vanLoon, Ronald_vanLoon)