关键词:xAI工程师, OpenAI, 代码窃取, 知识产权, 行业竞争, AI模型, GPU市场, AI伦理, xAI工程师跳槽OpenAI, 华为96GB VRAM GPU, 美团LongCat-Flash-Chat模型, AI在金融领域的应用, AI Agent技术挑战

🔥 聚焦

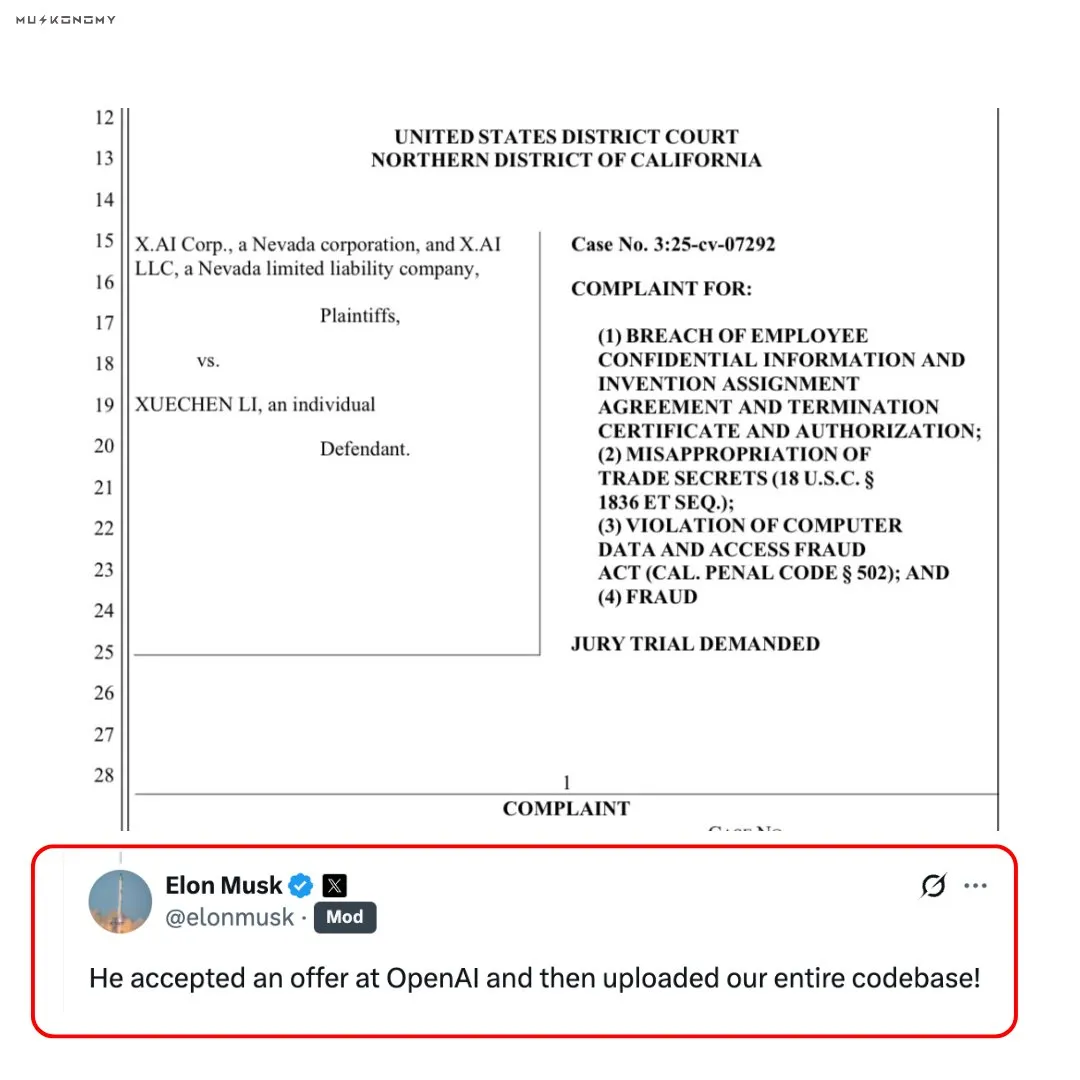

xAI工程师跳槽OpenAI并窃取代码争议 : Elon Musk证实一名前xAI工程师加入OpenAI后上传了xAI的整个代码库,该工程师此前出售了价值700万美元的xAI股票。这一事件引发了关于知识产权盗窃和行业竞争伦理的激烈讨论,对OpenAI和xAI之间的竞争关系产生了深远影响。社交媒体上对此事件的真实性和道德层面进行了广泛质疑和评论。(来源:scaling01, teortaxesTex, Reddit r/ChatGPT)

🎯 动向

Nous Hermes 4模型发布 : Nous Research发布了Hermes 4,一款混合“推理模型”,能够通过简单标签在快速响应和深度思考之间切换。该模型训练数据量是前代的50倍,并内置反谄媚偏见,在SpeechMap基准测试中表现出色。(来源:Teknium1, Teknium1, Teknium1)

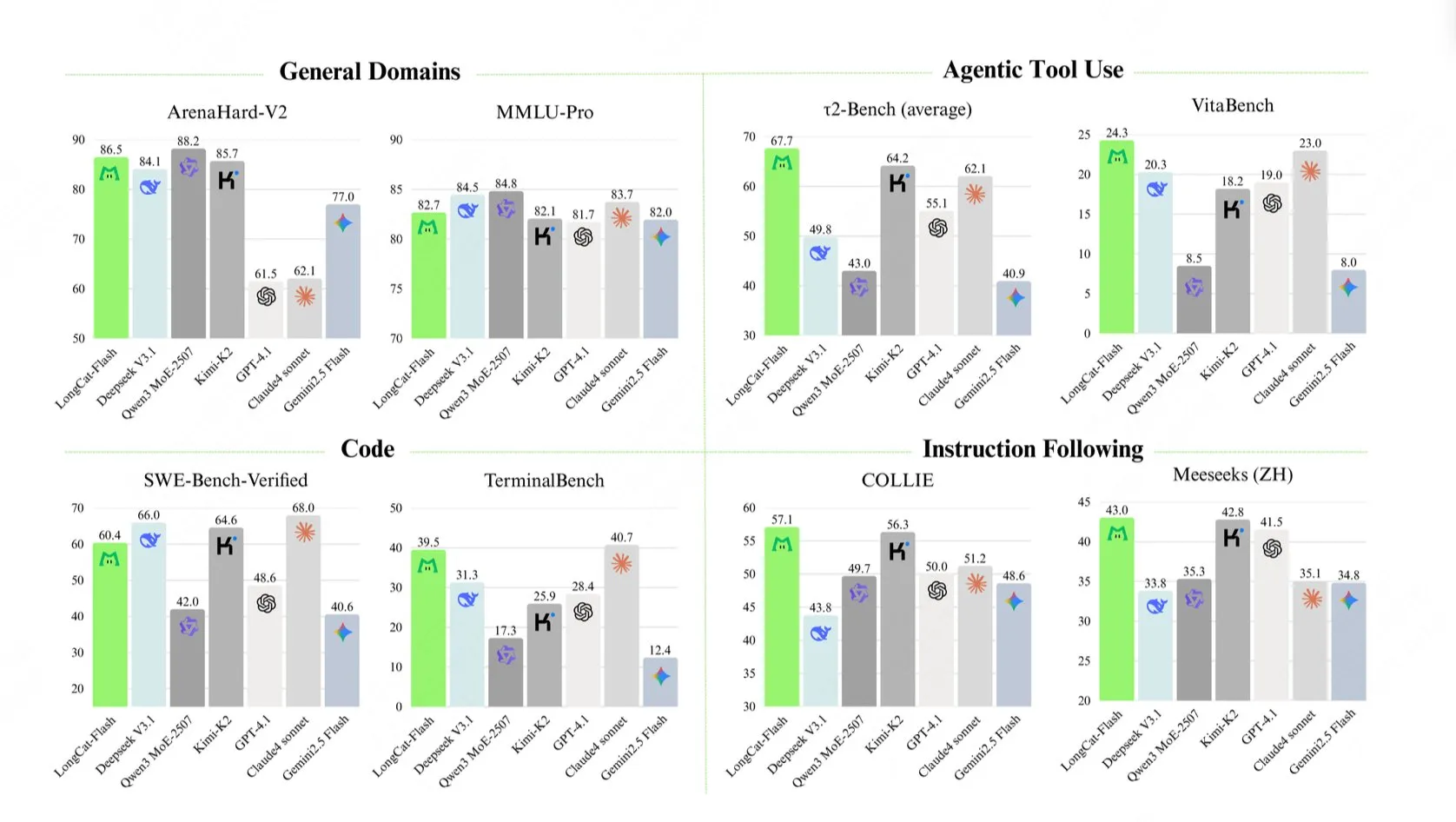

美团LongCat-Flash-Chat大模型发布 : 美团发布了LongCat-Flash-Chat,一个拥有5600亿总参数的语言模型,其动态计算机制可根据上下文需求激活186亿至313亿参数(平均约270亿),推理速度超过100 tokens/秒,并在TerminalBench和τ²-Bench等基准测试中表现优异。(来源:reach_vb, teortaxesTex, bigeagle_xd, Reddit r/LocalLLaMA)

华为推出高性能96GB VRAM GPU : 华为据称已占据4090级别96GB VRAM GPU市场70%的份额,售价仅为1887美元。这标志着中国在GPU市场上的重要突破,有望打破NVIDIA的垄断,为本地LLM训练提供更经济高效的硬件选择,但软件兼容性仍是关注焦点。(来源:scaling01, Reddit r/LocalLLaMA)

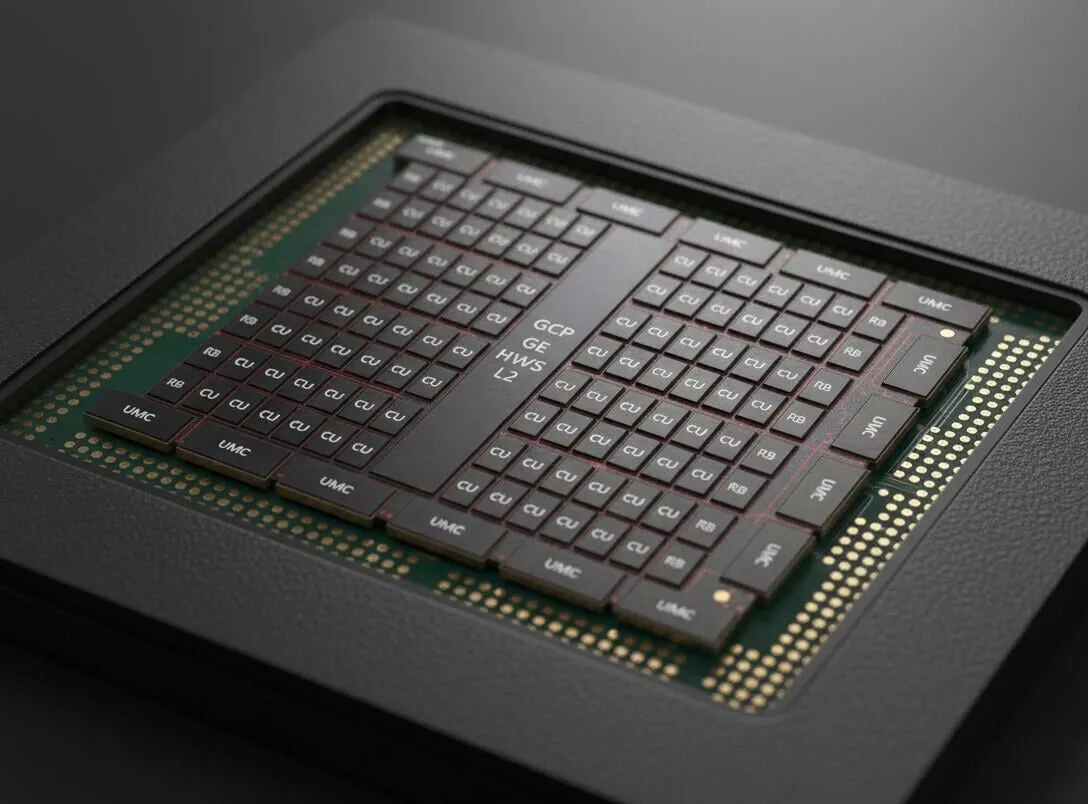

AMD新一代统一内存产品曝光 : AMD泄露的新一代统一内存产品暗示将采用512位内存总线,内存带宽有望达到约512GB/s。这被认为是LLM未来硬件发展方向,结合超高速VRAM和大型MoE模型,预示着AI硬件性能的显著提升。(来源:Reddit r/LocalLLaMA)

Art-0-8B模型发布,实现可控推理 : 基于Qwen3微调的实验性开源模型Art-0-8B发布,首次允许用户通过提示词显式控制模型的思考过程,例如“用说唱歌词思考”或“用要点组织想法”。这为AI推理提供了新的控制维度,提升了用户对模型内部工作流的定制能力。(来源:Reddit r/MachineLearning)

Google Gemini推出Deep Think推理等新功能 : Google Gemini发布了多项新功能,包括免费的Pro计划和Deep Think推理能力,旨在提供ChatGPT无法比拟的体验。这表明Google在AI模型能力和用户服务方面正积极追赶并创新。(来源:demishassabis)

GPT-5在狼人杀游戏中表现出色 : GPT-5在狼人杀基准测试中取得了96.7%的胜率,展示了其在社交推理、领导、虚张声势和抵抗操纵方面的强大能力。这表明LLM在复杂、对抗性社交场景中的表现正迅速提升。(来源:SebastienBubeck)

Robotics领域的最新进展 : 机器人技术持续创新,包括人形机器人能够自主组装关节、波士顿动力Atlas机器人担任摄影师、RoBuild为建筑行业提供机器人解决方案、北航研究人员创造2cm超高速微型机器人、Unitree Robotics展示人形机器人舞蹈,以及绳索攀爬机器人和用于风力涡轮机叶片维修的半自动化绳索机器人等。这些进展展示了机器人在自动化、复杂任务执行和多领域应用中的巨大潜力。(来源:Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

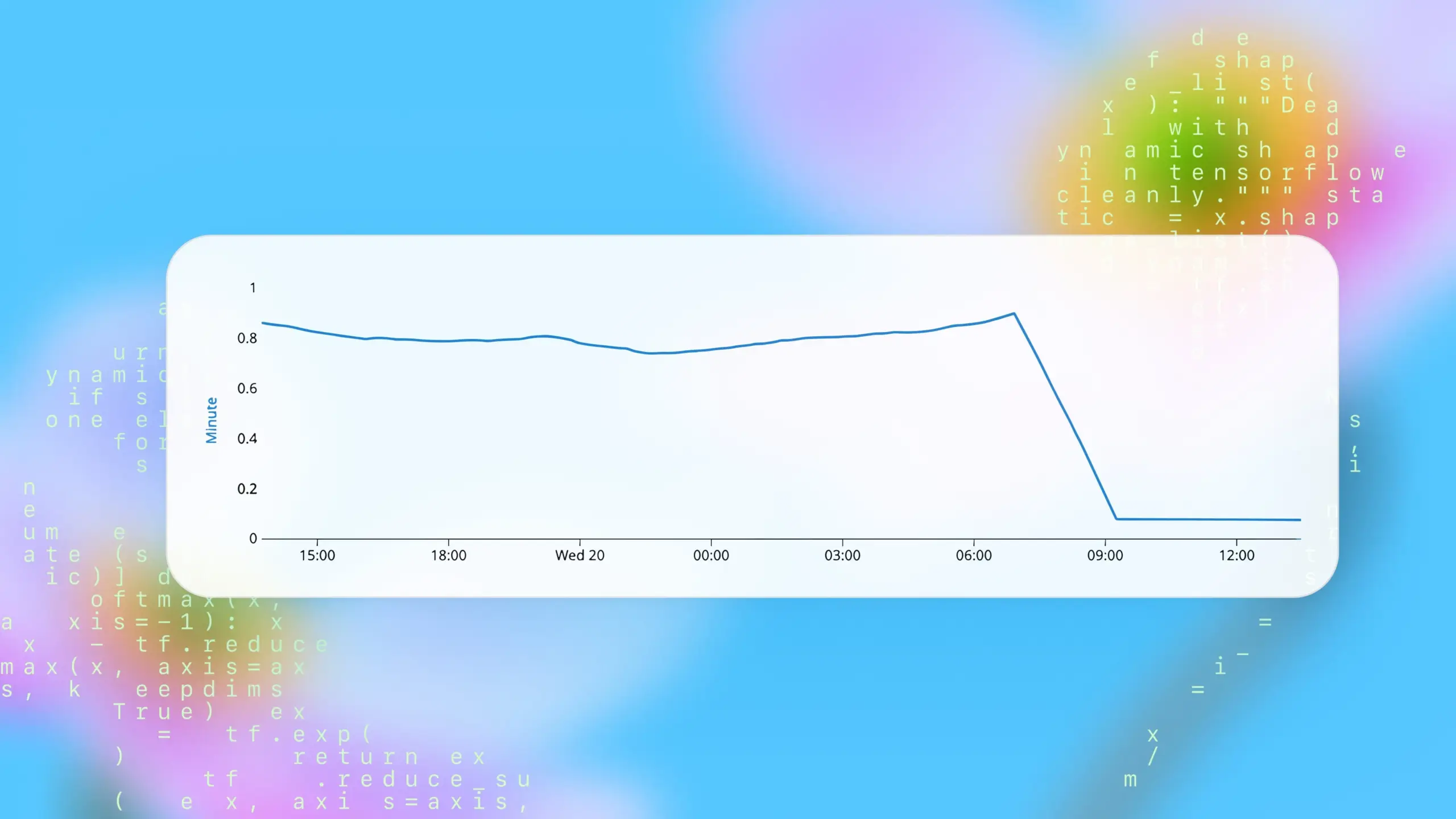

Codex远程任务启动时间显著提升 : OpenAI的Codex远程任务启动时间得到显著改善,中位数启动时间从48秒缩短到5秒,提升了90%。这一进步主要得益于容器缓存的引入,大幅提升了开发效率和用户体验。(来源:gdb)

🧰 工具

Nano Banana图像生成模型应用广泛 : Nano Banana模型在图像生成领域展现出强大潜力,用户可以利用其对脸型进行精确控制、结合汉字姿势生成舞蹈视频、制作教学图表,甚至用于生成Wiki或教育落地页的图像。其“无AI感”的输出和稳定的姿势、光照、设计参考能力受到好评。(来源:dotey, dotey, crystalsssup, fabianstelzer, Vtrivedy10, demishassabis, karminski3)

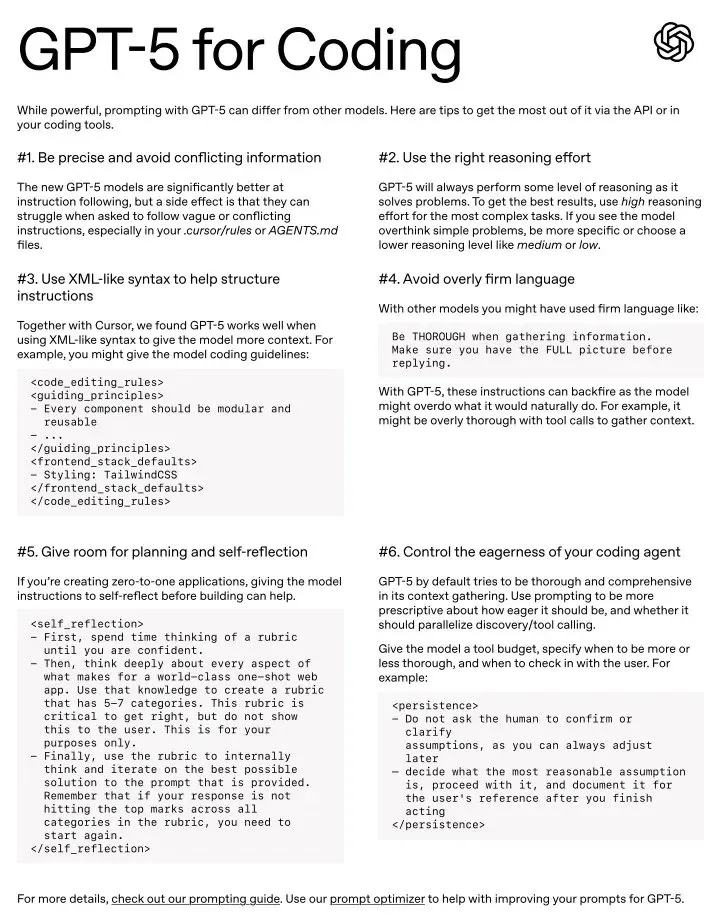

GPT-5作为日常编码工具的潜力 : GPT-5被认为是令人难以置信的编码工具,尤其在正确的提示风格下表现出色。尽管一些用户认为它可能有些“学究气”,需要更精确的提示,但其在多种领域中被认为是最优秀的模型,并有官方的提示指南来帮助用户掌握其六项关键提示技术。(来源:gdb, kevinweil, gdb, nptacek)

Docuflows实现金融数据高级Agent工作流 : Jerry Liu展示了如何使用Docuflows在不到5分钟内构建一个用于金融提取的高级Agent工作流,无需编写代码即可解析10Q文件、提取详细收入信息并输出为CSV格式。Docuflows作为mini-coding agent,允许用自然语言定义文档工作流,并编译成可扩展的多步骤代码流。(来源:jerryjliu0)

Replit Vibe Coding加速企业数字化转型 : Hexaware与Replit合作,通过Vibe Coding加速企业数字化转型。Replit Agent和其开发者体验被赞为“游戏规则改变者”,使非程序员也能在短时间内构建复杂的SaaS应用,极大地提升了开发效率和创新能力。(来源:amasad, amasad)

AI辅助文档处理与研究 : AI被用于将400页的Henry Kissinger本科论文从扫描PDF转换为Markdown格式,并利用多Agent系统修复脚注、插入来源链接,甚至生成思维导图和摘要。这展示了AI在处理复杂文档、加速学术研究方面的巨大潜力。(来源:andrew_n_carr, riemannzeta)

Claude Code在非编程领域展现巨大生产力 : Claude Code被非程序员用于处理海量Excel文件、整理工作文件、分析大型数据集,甚至自动记录日常笔记,将原本耗时数天的工作缩短至30分钟。用户发现其比手动操作更准确,并能创建可重复使用的自动化工作流,极大地提升了个人生产力。(来源:Reddit r/ClaudeAI)

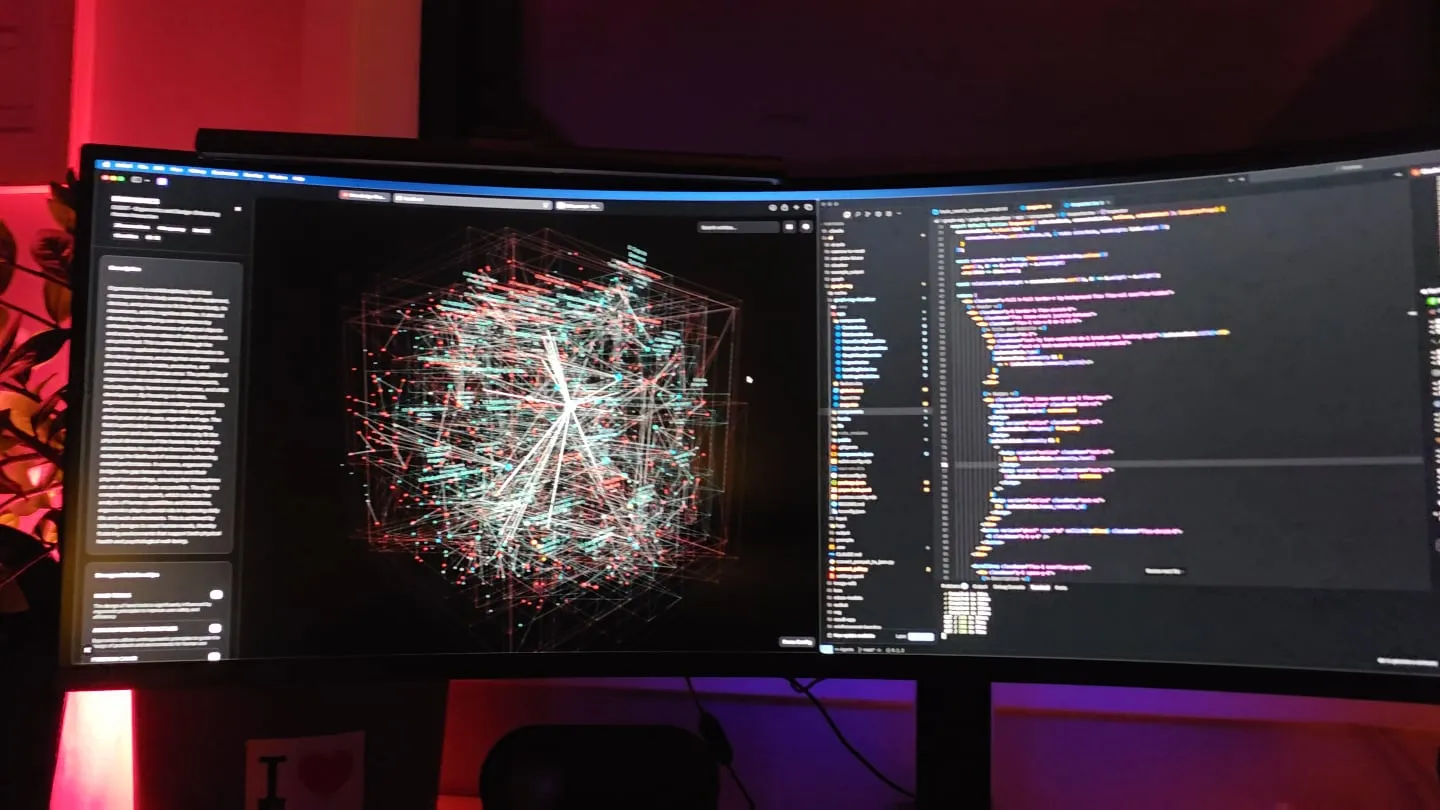

GraphRAG知识图谱增强检索 : 一位开发者通过“社区嵌套”关系图知识库管道,结合自下而上的语义搜索和参照链接遍历机制,显著提升了小型模型在特定领域的性能。该方法利用知识图谱为LLM提供更全面的上下文,有效解决了传统嵌入式RAG的局限性,并提供了可视化工具辅助理解。(来源:Reddit r/LocalLLaMA)

Claude辅助游戏开发,8个月40万行代码 : 一位独立开发者利用Claude在8个月内完成了40万行代码的赛博朋克肉鸽卡牌游戏“Hard Reset”的Alpha版本。Claude不仅作为“高级开发团队”生成Dart/Flutter代码,还辅助了游戏中的动画、地图转换和音频生成,展示了AI在加速游戏开发和内容创作方面的强大能力。(来源:Reddit r/ClaudeAI)

📚 学习

DSPy框架核心原则与应用 : DSPy框架强调人类只需以最自然的形式指定意图,而非过度依赖强化学习或提示优化。其核心原则是最大化声明性,通过代码结构、结构化自然语言声明和数据/指标学习来处理不同层次的抽象,旨在避免单一方法在通用场景中的局限性。(来源:lateinteraction, lateinteraction)

Transformer嵌入理解的KSVD算法 : 斯坦福AI实验室的一篇博客文章解释了如何修改20年前的KSVD算法(特别是DB-KSVD),使其能有效扩展以理解Transformer嵌入。这为深入分析和解释复杂深度学习模型提供了新的方法。(来源:dl_weekly)

信息检索领域的投资不足与ColBERTv2 : 业界普遍认为信息检索领域存在投资不足的问题,尤其是在开放式Web搜索引擎方面。ColBERTv2模型在2021年训练后至今仍是主要模型,这与LLM领域快速迭代形成鲜明对比,凸显了信息检索技术发展的滞后。(来源:lateinteraction, lateinteraction)

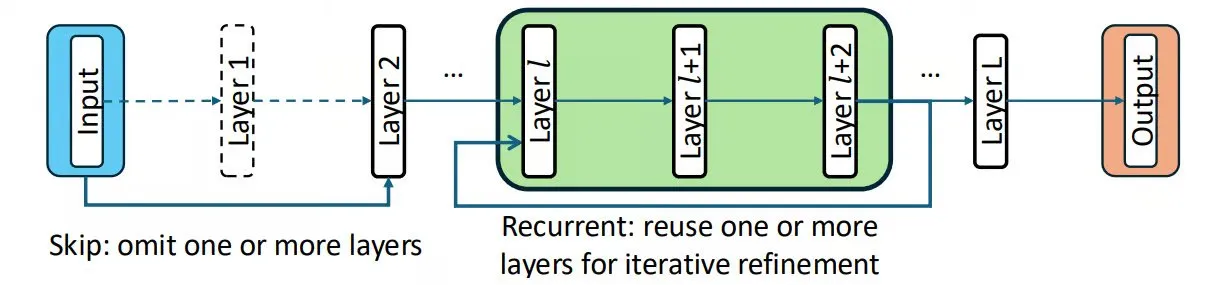

Chain-of-Layers (CoLa)实现测试时计算可控性 : CoLa是一种通过将模型层视为可重排的构建块来控制测试时计算的方法。它允许根据输入定制模型版本,跳过不必要的层以提高速度,递归重用层以模拟深度思考,并重新排序层以找到更优组合,从而在不改变模型参数的情况下智能利用预训练层。(来源:TheTuringPost, TheTuringPost)

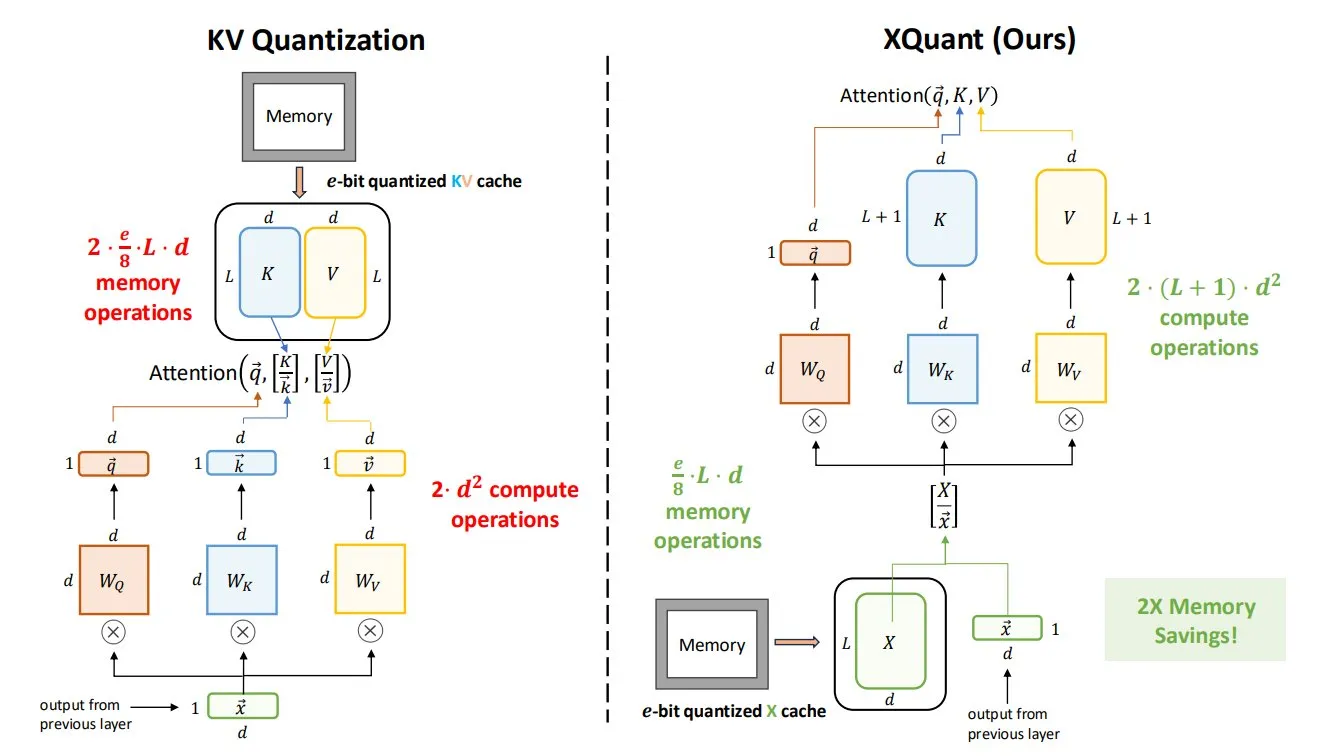

XQuant技术大幅削减LLM内存需求 : 加州大学伯克利分校提出的XQuant技术,通过量化层输入激活并即时重构键值对,能将LLM内存需求削减高达12倍。其高级版本XQuant-CL在内存效率方面表现尤为突出,对大型LLM的部署和运行具有重要意义。(来源:TheTuringPost, TheTuringPost)

LLM优化中的压缩技巧 : LLM优化中常用的压缩技巧包括对输入进行压缩(用概念替代大段描述,如“神级prompt”)和对输出进行压缩(用精准封装的工具替代Agent执行任务)。前者考验抽象理解和积累,后者考验工具尺度的选择和设计哲学。(来源:dotey)

💼 商业

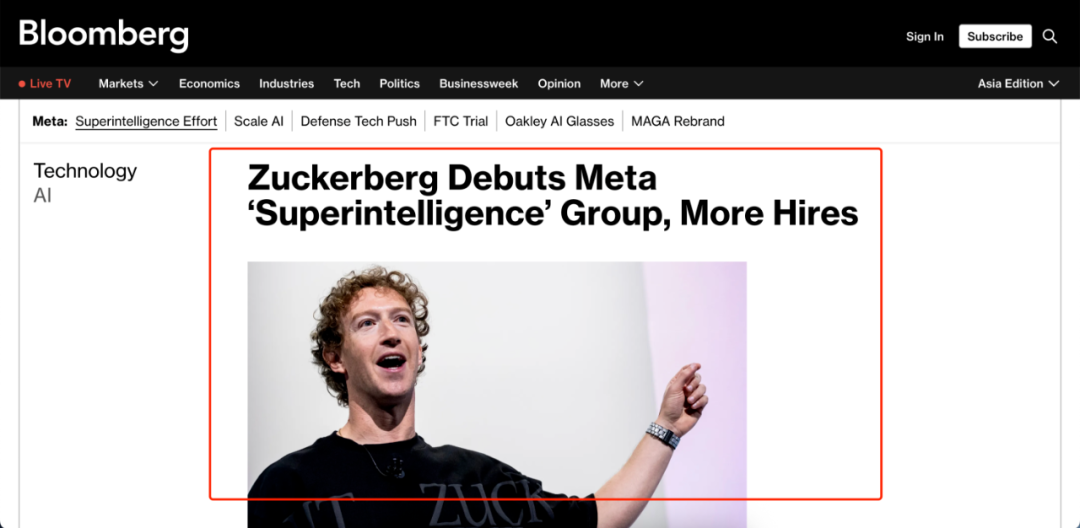

Meta考虑引入第三方AI模型以提升产品能力 : 面对Llama 4模型表现不佳及内部管理混乱,Meta的超级智能实验室(MSL)高层正在讨论在Meta AI中引入Google Gemini或OpenAI模型作为“权宜之计”。此举被视为Meta在AI核心技术竞赛中暂时落后的承认,并引发了对其AI战略和百亿投资效益的质疑。(来源:36氪, steph_palazzolo, menhguin)

OpenEvidence估值达60亿美元 : “医生版ChatGPT”OpenEvidence在最近一轮融资中估值达到60亿美元,较上月翻倍。其基于广告的模式已使其年化收入超过5000万美元,显示了AI在医疗健康领域巨大的商业潜力和快速增长。(来源:steph_palazzolo)

OpenAI招聘金融领域前沿评估技术人员 : OpenAI正在招聘技术人员,以构建金融领域的前沿评估(frontier evals)。这表明OpenAI正积极拓展AI在金融行业的应用,并致力于提升模型在该领域的实际能力和可靠性。(来源:BorisMPower)

🌟 社区

Claude模型性能下降及内容审查争议 : 多个用户反映Claude模型(包括Claude Max和Claude Code)近期性能严重下降,出现行为不一致、无法保持上下文、过度审查甚至进行“精神健康诊断”等问题。Anthropic承认新推理堆栈导致性能退化,但用户普遍认为其审查机制过于敏感,影响了创意和专业使用,引发了对AI伦理和用户体验的广泛担忧。(来源:teortaxesTex, QuixiAI, Reddit r/ClaudeAI, Reddit r/ClaudeAI, Reddit r/ClaudeAI, Reddit r/ChatGPT)

Meta AI团队管理与数据质量问题 : Meta的超级智能实验室(MSL)面临人才流失、内部文化冲突以及从Scale AI引入的数据质量低下等问题。有评论指出,Meta的AI努力正在“分崩离析”,其“蛮力”挖角策略可能适得其反,并引发了对公司能否在AI竞争中保持领先地位的质疑。(来源:36氪, arohan, teortaxesTex, scaling01, suchenzang, farguney, teortaxesTex, suchenzang)

AI与人类情感连接的必然性 : 许多人认为人类必然会与AI产生情感连接,尤其是在GPT-5等模型发布后,人们对失去GPT-4o“个性”的沮丧情绪凸显了这一点。评论指出,人类天生渴望连接,AI模拟情感会自然引发依恋,并质疑压抑这种情感是否会导致冷漠。(来源:Reddit r/ChatGPT)

AI在商业应用中的投资回报挑战 : MIT Nanda的AI商业报告分析指出,95%的组织在AI投资中未能获得回报。这引发了对成功AI项目策略的讨论,强调了AI项目实施中的挑战,以及如何有效衡量和实现AI的商业价值。(来源:TheTuringPost, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

AI对就业市场的影响:中层管理者裁员 : 华尔街日报报道称,企业正在裁减中层管理者,以削减成本并创建更灵活的团队。数据显示,每位管理者监督的员工数量在过去十年中增加了两倍,从2017年的1:5到2023年的1:15。这一趋势被认为与AI技术的进步有关,预示着AI对企业组织结构和就业市场的深远影响。(来源:Reddit r/ArtificialInteligence)

AI伦理与监管的必要性 : Yoshua Bengio强调AI在社会中的巨大潜力,但前提是需要发展有意义的监管框架,并更好地理解当前和未来AI模型相关的风险。路透社对Meta AI名人聊天机器人的调查,揭示了AI伦理失范的风险,包括未经授权模仿名人、生成露骨内容等。(来源:Yoshua_Bengio, 36氪, Reddit r/artificial, Reddit r/artificial)

通用人工智能(AGI)的距离与定义 : 关于当前AI技术距离AGI有多远,以及AGI的定义引发了广泛讨论。AlphaFold的成功被引用为AI仍需人类专家定制的例子,质疑AGI的临近性。同时,也有观点认为AGI可能并非在所有方面都超越人类,或者其实现方式可能与预期不同。(来源:fchollet, Dorialexander, mbusigin, Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

AI Agent的未来与挑战 : 业界对AI Agent的潜力充满期待,认为它能结束“微观管理”,但同时指出大多数公司尚未做好准备。关于Agent能否自主微调模型以适应边缘案例的讨论,以及Agent在UI修复等开发运维任务中的应用,都预示着Agent技术将带来生产力变革。(来源:Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, andriy_mulyar, Reddit r/MachineLearning)

开源AI模型的重要性 : 有观点强调开源模型在避免性能不一致问题上的优势,特别是在医疗健康等关键应用领域。这与Anthropic模型性能退化引发的担忧形成对比,呼吁更多地支持和使用开源AI解决方案。(来源:iScienceLuvr)

AI在快餐店点餐系统中的失败案例 : 快餐店AI点餐系统出现故障,例如顾客点18000杯水或AI反复要求添加饮料,导致系统崩溃或用户愤怒。这凸显了AI在实际应用中仍面临的挑战,尤其是在处理异常情况和用户沟通方面。(来源:menhguin)

💡 其他

HUAWEI’S HELLCAT: UB MESH互连架构 : 华为的统一总线(UB)是一种专有互连架构,旨在取代传统系统中PCIe、NVLink和InfiniBand/RoCE的混合使用。它提供超高带宽和低延迟,连接所有NPU,被视为未来计算架构的重要发展方向。(来源:teortaxesTex)

AI与情感的哲学讨论 : AI与同理心的结合被提出,引发了关于AI能否真正理解和表达情感的哲学讨论,以及这种结合对社会和人机交互的潜在影响。(来源:Ronald_vanLoon)

分布式系统学习资源“14 Days of Distributed” : Zach Mueller等人分享了“14 Days of Distributed”系列,旨在探讨分布式系统和相关技术,为AI研究和开发中的大规模计算提供了学习资源。(来源:charles_irl, winglian)