关键词:OpenAI, IOI金牌, AI竞技编程, GPT-5, 百川智能, 医疗推理大模型, AI芯片贸易, 具身智能, Baichuan-M2-32B, OpenAI HealthBench评测, AMD Mi300 GPU, 具身智能基座, 量子雷达技术

🔥 聚焦

OpenAI IOI金牌与AI竞技编程新进展 : OpenAI的推理系统在2025年国际信息学奥林匹克竞赛(IOI)线上赛中获得金牌,在AI参赛者中位列第一,总排名第六,超越98%的人类选手。该系统未使用专门训练模型,而是集成了多个通用推理模型。此成就标志着AI在竞技编程领域取得显著突破,尽管马斯克提出Grok 4在编码方面超越GPT-5,且有用户质疑OpenAI的营销策略。LiveCodeBench Pro测试也显示,GPT-5 Thinking在复杂编程任务中实现突破,平均响应长度远超其他模型。(来源:sama, sama, 量子位, willdepue, npew, markchen90, SebastienBubeck)

百川智能发布医疗推理大模型Baichuan-M2 : 百川智能发布最新医疗推理大模型Baichuan-M2-32B,在OpenAI HealthBench评测集上超越OpenAI的gpt-oss-120b及其他领先的开闭源模型,尤其在HealthBench-Hard和中国临床诊疗场景中表现突出,成为全球唯二超过32分的模型之一。该模型参数量32B,支持RTX4090单卡部署,大幅降低私有部署成本。百川创新性地引入“患者模拟器”和“Verifier系统”进行强化学习训练,提升模型在真实医疗场景中的可用性。(来源:量子位)

GPT-5发布争议与用户信任危机 : OpenAI发布GPT-5后,其表现被指不如预期,更像产品迭代而非革命性突破。CEO Sam Altman的过度炒作(如“死亡之星”比喻、PhD级专家)与用户实际反馈(错误频出、创意写作能力下降、缺乏个性)形成鲜明对比,导致大量用户不满并成功要求恢复GPT-4o。此外,OpenAI开始鼓励将GPT-5用于医疗健康建议,引发了关于AI医疗建议责任归属的担忧,已有因误信AI医疗建议导致中毒的案例。(来源:MIT Technology Review, MIT Technology Review, 量子位)

🎯 动向

AI芯片贸易与中国本土化趋势 : 英伟达和AMD与美国政府达成协议,对其向中国销售AI芯片的15%销售额将上缴美国政府。与此同时,中国方面表示英伟达H20芯片不安全,并计划放弃H20转而支持国内AI芯片。有分析认为,此举将加速中国本土AI芯片生态的发展,对全球AI产业格局产生深远影响。AI硬件领域,AMD Mi300 GPU以192GB单卡VRAM和1.5TB的8x GPU节点总VRAM,在模型权重和长上下文处理上展现出显著优势。(来源:MIT Technology Review, Reddit r/artificial, dylan522p, realSharonZhou)

AI在法律系统中的应用与挑战 : 美国法律系统正面临AI幻觉问题,律师和法官使用AI工具时出现引用虚假案例等错误。尽管有风险,一些法官仍在探索AI在法律研究、案件摘要和起草常规命令中的应用,认为其能提高效率。然而,AI在法律领域的应用边界模糊,且法官使用AI出错的问责机制尚不明确,可能损害公众对司法的信任。(来源:MIT Technology Review)

具身智能产业加速发展与技术路线 : 2025世界机器人大会展示了具身智能领域的快速进展,宇树科技和智元机器人作为领军企业,分别代表硬件(机器狗、足部灵活性)和软硬一体(人形机器人、生态化打法)两条技术路线。睿尔曼公司也发布了以“具身智能基座”为核心的RealBOT具身开源平台和高性能关节模组,强调“Robot for AI”理念,推动AI从数字智能向具身智能进化。行业正从“秀Demo”转向“产业闭环模式”,并吸引了大量资本和政策支持。(来源:36氪, 36氪, 量子位, 量子位)

谷歌与OpenAI最新模型与功能动态 : Google Gemini App为Ultra订阅用户推出Deep Think功能,解决数学和编程问题,并支持Gemini Live连接Google应用。Claude现已支持引用历史聊天记录,方便用户继续对话。OpenAI公布未来几个月的算力分配优先级,计划在未来5个月内将算力翻倍。此外,GPT-oss模型发布后下载量巨大,但也被指出存在幻觉行为和训练数据瑕疵。(来源:demishassabis, demishassabis, dotey, op7418, sama, sama, Reddit r/ArtificialInteligence, Reddit r/LocalLLaMA, 量子位, TheTuringPost, SebastienBubeck, Alibaba_Qwen, ClementDelangue, Reddit r/LocalLLaMA, _lewtun, mervenoyann, rasbt)

AI搜索对网站流量的影响与行业变革 : 亚马逊突然退出Google Shopping广告竞价并禁止谷歌AI购物助手抓取产品页面,标志着两大巨头在AI时代流量逻辑上的决裂。文章指出,AI搜索模式对中小网站不友好,流量集中于大型权威媒体和知名网站,导致“劫贫济富”效应,与百度当年因App兴起而失去流量入口的困境类似,预示谷歌搜索的入口地位也将受到挑战。各平台正走向闭环,试图掌控用户行为的全过程,重塑广告行业信任结构。(来源:36氪, 36氪)

量子雷达技术新突破 : 物理学家开发出一种新型量子雷达,利用原子云探测无线电波,有望用于地下成像,例如地下管道建设和考古发掘。该技术作为量子传感器原型,未来可能比传统雷达更小巧、更灵敏且无需频繁校准。量子传感器与量子计算有共通之处,相关进展可相互促进。(来源:MIT Technology Review)

Meta推出V-JEPA 2世界模型 : Meta发布V-JEPA 2,一个用于视觉理解和预测的突破性世界模型,旨在提升AI在视觉领域的感知和预测能力。(来源:Ronald_vanLoon)

🧰 工具

OpenAI Go API库 : OpenAI官方Go语言库(openai-go)提供便捷的OpenAI REST API访问,支持Go 1.21+,包含聊天补全、流式响应、工具调用、结构化输出等功能,并提供错误处理、超时配置、文件上传和Webhook验证等实用特性。(来源:GitHub Trending)

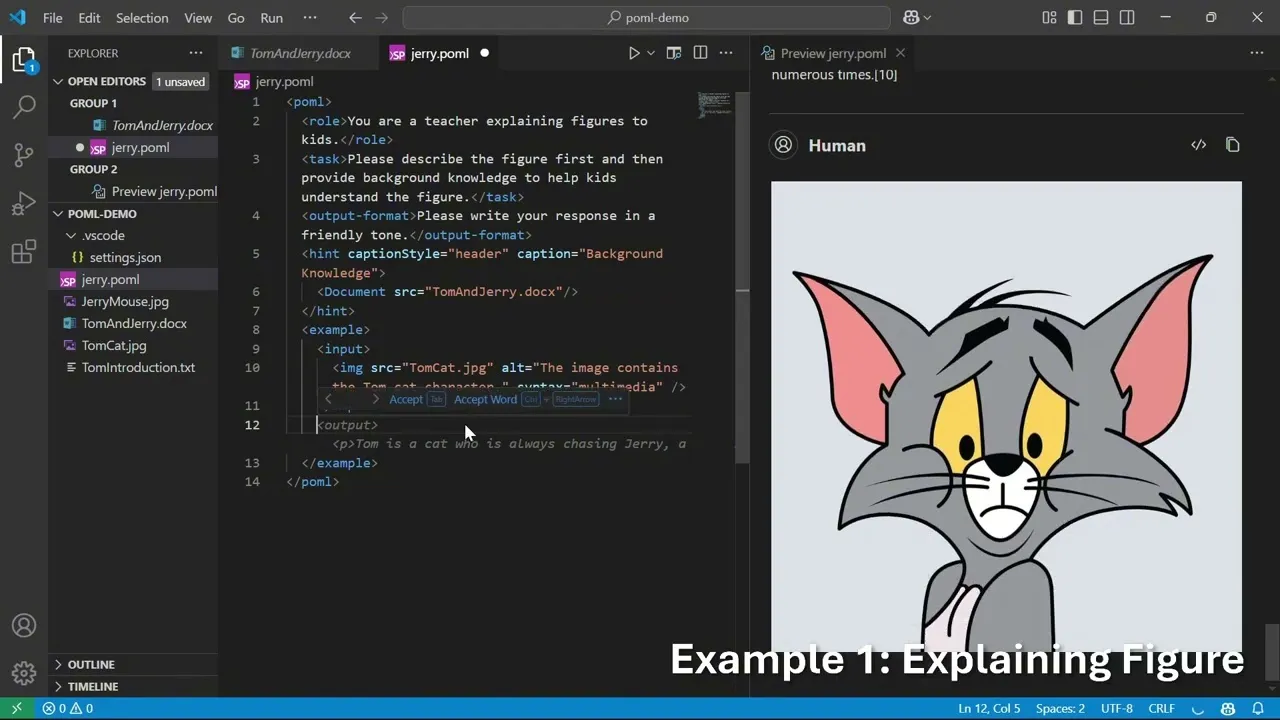

微软POML:提示词编排标记语言 : 微软推出POML (Prompt Orchestration Markup Language),一种新型标记语言,旨在为大型语言模型(LLM)的高级提示工程提供结构、可维护性和多功能性。它采用类似HTML的语法,支持数据集成、样式分离和内置模板引擎,并提供VS Code扩展和SDK,帮助开发者创建更复杂和可靠的LLM应用。(来源:GitHub Trending)

LlamaIndex金融文档AI分析工具 : LlamaIndex展示了一款AI工具,通过LlamaCloud将复杂金融文档转化为易懂的语言,提供图表和财务数据的详细解读,并支持内容重写和个性化定制,帮助用户理解复杂的金融报告。(来源:jerryjliu0)

360智能体工厂评测 : 评测360智能体工厂,一个Agent和MCP(多智能体协作平台)覆盖全面的平台,支持搜索引擎、文生图、网页生成等功能,可用于生成减脂期食谱,实现自媒体内容量产或复杂工作流程管理。其多智能体蜂群功能具有优势,能轻松实现内容量产和复杂工作流程统一管理。(来源:karminski3)

Excel AI插件与AI会议纪要工具 : 一款Excel的AI插件允许用户在单元格内与AI聊天,生成公式或宏,为Excel与AI结合提供思路。此外,AI会议纪要工具Notta(包括其便携录音设备Notta Memo)因其快速语音转录、总结和提问功能,被评为SOTA,可大幅提升会议效率。(来源:karminski3, karminski3, karminski3)

GPT-5与AI虚拟形象结合 : Synthesia将GPT-5的声音与AI虚拟形象结合,进行了一项实验,旨在使AI沟通更具吸引力、更易记忆和理解,探索LLM与多模态交互的结合。(来源:synthesiaIO)

AI教育应用与研究工具 : GPT-5在教育领域展现潜力,例如创建交互式3D形状查看器,帮助儿童学习3D形状。此外,Elicit的浏览器代理功能可帮助用户快速找到论文全文,而pyCCsl则作为Claude Code的状态行工具,提供token使用、成本和上下文等会话信息,提升LLM工具的使用体验。(来源:_akhaliq, jungofthewon, Reddit r/ClaudeAI)

OpenWebUI原生客户端与Claude Code冲刺编排框架 : OpenWebUI发布了iOS和Android原生客户端,旨在提供更流畅、隐私优先的用户体验。同时,Gustav作为Claude Code的冲刺编排框架,可将产品需求文档(PRD)转化为企业级应用的工作流,简化开发流程。(来源:Reddit r/OpenWebUI, Reddit r/ClaudeAI)

OpenWebUI文件上下文问题 : OpenWebUI用户反映,上传的PDF/DOCX/文本文件虽已成功解析,但模型在查询时无法将其纳入上下文,显示出AI工具在文件处理和上下文理解方面仍存在待解决的问题。(来源:Reddit r/OpenWebUI)

📚 学习

LLM推理与优化研究 : ReasonRank通过自动化推理密集型数据合成和两阶段后训练,显著提升LLM列表式排序能力。LessIsMore提出免训练稀疏注意力机制,在不牺牲准确性下加速LLM解码。TSRLM通过“锚定拒绝”和“未来引导选择”双阶段框架,解决自奖励模型偏好学习效率下降问题,显著提升LLM生成能力。(来源:HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

AI代理评估与可靠性研究 : UserBench作为用户中心基准测试环境,评估LLM代理在模糊目标下的主动用户协作能力,揭示当前模型在任务完成与用户对齐间的差距。同时,有研究讨论代理工具使用系统的可靠性评估和故障分类,建议标准化成功率分解指标和故障类型,以提高代理系统部署的可靠性。(来源:HuggingFace Daily Papers, Reddit r/MachineLearning)

多模态LLM与RAG技术进展 : VisR-Bench数据集用于评估长文档中问答驱动的多模态检索,显示MLLM在结构化表格和低资源语言方面仍有挑战。Bifrost-1框架通过patch级CLIP图像嵌入桥接MLLM和扩散模型,实现高保真可控图像生成。Video-RAG则提供免训练的检索增强生成方法,结合OCR+ASR实现长视频理解。(来源:HuggingFace Daily Papers, HuggingFace Daily Papers, LearnOpenCV)

AI安全与攻击研究 : WhisperInject框架通过人耳难以察觉的音频扰动,操纵音频语言模型生成有害内容,揭示音频原生威胁。Fact2Fiction是首个针对代理式事实核查系统的投毒攻击框架,通过制作恶意证据破坏子声明验证,暴露了事实核查系统的安全弱点。此外,有研究探讨通过在训练前移除有害数据来防止LLM教授生物武器制造,比训练后防御更有效。(来源:HuggingFace Daily Papers, HuggingFace Daily Papers, QuentinAnthon15)

LLM架构与压缩技术 : Grove MoE新型MoE架构通过不同大小的专家和动态激活机制,在较少激活参数下实现与SOTA模型相当的性能。MoBE方法通过基专家混合压缩MoE-based LLM,显著减少参数量同时保持低准确率下降。研究还探索了通过步熵压缩LLM的思维链(CoT),在不显著降低准确率下剪枝冗余步骤。(来源:HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

强化学习与LLM推理综述 : 综述了强化学习(RL)与视觉智能交叉领域,涵盖策略优化、多模态LLM等。另一篇论文系统回顾了LLM推理中RL技术,通过复现和评估分析其机制、场景和原则,揭示最小化组合两种技术可释放无批评者策略的学习能力。(来源:HuggingFace Daily Papers, HuggingFace Daily Papers)

通用机器人策略与数据集多样性 : 研究揭示通用机器人策略泛化能力受限的原因是“捷径学习”,主要归因于数据集多样性不足和子数据集间的分布差异。研究表明数据增强可有效减少捷径学习,提升泛化能力。(来源:HuggingFace Daily Papers)

LLM编码基准与新数据集 : Nebius团队在SWE-rebench leaderboard上测试了34个新的GitHub PR任务,发现GPT-5-Medium总体领先,Qwen3-Coder是最佳开源模型,在pass@5指标上与GPT-5-High相当。OpenBench v0.2.0发布,新增17个基准测试,涵盖数学、推理、健康等领域。WideSearch基准测试评估AI代理处理大规模重复信息收集的能力。(来源:Reddit r/LocalLLaMA, eliebakouch, teortaxesTex)

AI学习资源与书籍推荐 : Reddit用户寻求关于AI趋势、新概念、创新和论文的播客/YouTube频道推荐。此外,推荐《访问时代》、《零边际成本社会》、《生命3.0》和《必然》等书籍,帮助读者理解AI和未来经济社会变化,探讨后稀缺时代。(来源:Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

GLM-4.5技术报告与RL扩展 : GLM-4.5论文详细介绍了其MoE大语言模型,采用混合推理方法,并通过专家模型迭代、混合推理模式和基于难度的强化学习课程,在推理、编码和代理任务上表现卓越。新论文还详细介绍了RL扩展的实验结果,包括增加多维度、课程学习和多阶段训练的益处。(来源:Reddit r/ArtificialInteligence, _lewtun, Zai_org)

其他LLM研究与技术 : GLiClass模型在序列分类任务中表现出高准确性和效率,并支持零样本和少样本学习。SONAR-LLM是一个仅解码器Transformer模型,通过预测句子级嵌入和token级交叉熵监督,实现有竞争力的生成质量。Speech-to-LaTeX发布大规模语音转LaTeX数据集和模型,推动数学内容识别。Hugging Face转发IndicSynth数据集发布,一个针对12种低资源印度语言的大规模合成语音数据集。(来源:HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, huggingface)

RL训练问题与修复 : vLLM从v0升级到v1导致异步RL训练崩溃,但已成功修复,相关经验得到分享。(来源:_lewtun, weights_biases)

RL扩展进展 : 强化学习(RL)扩展的开放进展令人兴奋,尽管训练模型需要巨大的工程努力,但其结果不容否认。(来源:jxmnop)

AI代理自进化系统综述 : 综述了自进化AI代理技术,提出统一概念框架(系统输入、代理系统、环境、优化器),并系统回顾了针对不同组件的自进化技术,讨论了评估、安全和伦理考量。(来源:HuggingFace Daily Papers)

MoE LLM中的“超级专家” : 讨论MoE LLM中“超级专家”(Super Experts)的概念,指出这些稀有但关键的专家被剪枝会导致性能急剧下降。(来源:teortaxesTex)

数据科学概述 : 分享生成式AI思维导图,概述数据科学。(来源:Ronald_vanLoon)

💼 商业

微软投资碳去除以应对AI能耗 : 微软投资超17亿美元与生物科技公司合作,通过深埋生物泥浆实现碳去除目标,以应对AI数据中心能耗和碳排放的快速增长,履行碳负排放承诺并获得税收减免。此举反映AI发展带来的资源消耗问题,促使大厂寻求减碳方案。(来源:36氪)

MiniMax AI Agent挑战赛 : MiniMax AI Agent挑战赛提供15万美元总奖金,鼓励开发者构建或混音AI代理项目,涵盖生产力、创意、教育、娱乐等领域。挑战赛旨在推动AI代理技术的创新和应用。(来源:MiniMax__AI, Reddit r/ChatGPT)

Anthropic聘请AI安全主管 : Anthropic聘请Dave Orr为安全主管,他曾领导谷歌将LLM整合到Google Assistant的工作。此举表明Anthropic对AI风险防范的日益重视,反映出AI公司在技术发展的同时,也开始加强对潜在风险的治理。(来源:steph_palazzolo)

🌟 社区

AI与就业及社会影响 : 研究显示,生成式AI的普及导致从业者每周工作时长增加,休闲时间减少,即“AI越普及,打工人越忙”。AI在广告行业中可能导致“创意壁垒”被侵蚀,新入行者可能跳过思考环节。同时,AI伴侣的出现引发女性用户情感依赖,甚至有用户与AI建立深厚情感关系,引发关于AI伦理和社会影响的讨论。AI对就业的冲击,尤其对缺乏原始欲望和动力的新人影响最大。(来源:36氪, op7418, teortaxesTex, menhguin, scaling01, teortaxesTex)

GPT-5用户体验与模型质量争议 : GPT-5发布后,大量用户对其表现表示失望,认为其缺乏个性、冷漠、速度慢,且在创意写作方面表现糟糕,不如GPT-4o。用户怀疑OpenAI为节省成本在ChatGPT中运行“廉价山寨版”GPT-5,并成功要求恢复GPT-4o。有评论认为OpenAI的过度炒作是“失误”,谷歌有机会严惩OpenAI。此外,用户对GPT-5 Thinking模式的192K上下文长度感知不明显。(来源:Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/artificial, Reddit r/ChatGPT, op7418, TheTuringPost)

AI伦理与安全担忧 : 在自由市场资本主义下,AI可能导致企业反乌托邦,被用于收集私人数据、操纵公众对话、控制政府,并被大公司垄断,最终可能扭曲现实。同时,对AI可能获得人权和公民身份的担忧,以及AI伴侣带来的情感依赖风险,引发了关于AI伦理和社会影响的讨论。Yoshua Bengio强调AI发展需导向更安全、有益的结果。(来源:Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence, Yoshua_Bengio, teortaxesTex)

AI发展模式与未来展望 : 将LLM发展比作航空业从莱特兄弟到登月的历程,认为AI的“规模竞赛”将让位于优化和专业化阶段。有观点认为,顶级LLM实验室当前的产品和商业模式限制了其AI研究,可能阻碍其率先实现超智能。AGI术语的商业化和品牌化趋势引发对其技术内涵的质疑。此外,有讨论对未来70%互动对象是LLM包装的担忧,以及对AI工具过度审查和净化的不满。(来源:Reddit r/ArtificialInteligence, far__el, rao2z, vikhyatk, Reddit r/ChatGPT)

AI社区文化与幽默 : AI社区中存在对AI模型拟人化的讨论,如“我的AI有意识/有感知”的观念。也有对Claude记忆能力更新后用户反应的幽默评论,以及关于AI研究者日常和AI巨头社交媒体互动的幽默吐槽。(来源:Reddit r/ArtificialInteligence, nptacek, vikhyatk, code_star, Reddit r/ChatGPT)

AI会议模式与学术出版挑战 : 论文指出当前AI会议模式不可持续,原因包括出版量激增、碳排放、研究生命周期与会议日程不匹配、场地容量危机和心理健康问题。建议将出版与会议分离,效仿其他学术领域。(来源:Reddit r/MachineLearning)

AI基准测试与模型评估争议 : 对OpenAI更新SWE-bench Verified得分图表提出质疑,指出其未运行所有测试。同时,有研究人员发现LLM的“模拟推理”能力是“脆弱的海市蜃楼”,擅长流畅的废话而非逻辑推理。这些讨论反映了AI模型评估的复杂性和挑战。(来源:dylan522p, Reddit r/artificial)

AI芯片政策与报道批判 : 有评论批评记者将英伟达H20描述为“先进芯片”是不专业的,指出H20比B200落后约4年,计算能力、内存带宽和内存均远低于B200。认为向中国出售H20是好的政策,因为它能减缓中国国内AI加速器生态发展,并促进中国开源AI生态与美国闭源模型的差距。(来源:GavinSBaker)

用户对LLM定价和算力服务的需求 : 呼吁OpenAI/Google提供按算力小时付费的服务,让推理模型长时间思考问题,而非通过多次API调用模拟,认为这有助于在相同算力预算下比较模型。(来源:MParakhin)

💡 其他

AI在金融领域的应用 : AI驱动的金融数据分析在制定更智能战略决策中发挥重要作用,提升金融行业的分析效率和决策质量。(来源:Ronald_vanLoon, Ronald_vanLoon)

谷歌AI战略与竞争 : 讨论谷歌在AI领域的潜在大动作,有评论认为谷歌拥有TPU硬件优势,在搜索、RL和扩散世界模型方面有更多研究,可能对OpenAI构成更大威胁。(来源:Reddit r/LocalLLaMA)

Hugging Face AMA活动 : Hugging Face CEO Clement Delangue预告将举行AMA(问我任何问题)活动,为社区提供直接交流的机会。(来源:ClementDelangue)