关键词:世界机器人大会, 人形机器人, 具身智能, GPT-5, AI眼镜, Google DeepMind, LangChain, Reality Proxy AI眼镜, Genie 3世界模拟器, LEANN向量索引, Qwen Code免费调用, GPT-5优先处理服务

🔥 聚焦

具身界“春晚”,200家机器人同台竞技 : 世界机器人大会(WRC 2025)在北京盛大举行,吸引了220余家企业参展,展出1500余件展品,其中50家人形机器人企业带来100余款首发新品。大会展示了人形机器人在家庭服务(如铺床、叠衣服)、商业服务(如收银、咖啡制作、调酒)、工业应用(如精密装配、分拣、搬运)和医疗康养(如康复训练、按摩)等领域的最新进展。此外,机器人产业链上的零部件(如行星滚柱丝杠、灵巧手、触觉传感器)也展现了显著创新,标志着具身智能正加速融入物理世界,有望推动AI与现实场景的深度融合。 (来源: 36氪)

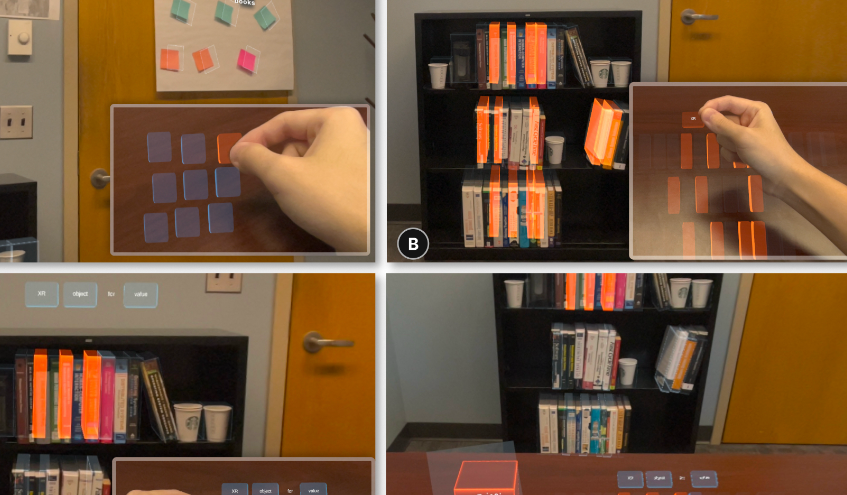

AI眼镜“隔空取物”:Reality Proxy : 浙江大学校友团队开发了一款名为“Reality Proxy”的AI眼镜技术,通过“数字替身”实现用户对现实世界物体的“隔空取物”和直观交互。该技术能够捕获场景结构并生成可操作的数字代理,支持多样的交互功能,如浏览预览、多对象刷选、按属性过滤、语义分组及空间缩放分组。这项创新将物理世界与数字世界融合,显著提升了XR设备在书籍检索、建筑导航、无人机控制等复杂场景中的交互效率和精准度,被视为迈向“贾维斯”式AI助手的关键一步。 (来源: 量子位)

🎯 动向

OpenAI GPT-5 发布及后续调整 : OpenAI正式发布GPT-5,强调其“路由系统”能根据任务复杂度、用户意图动态分配模型资源,实现多模态“无感协同”,并在事实错误率和幻觉方面大幅降低。然而,发布后用户反馈出现“变笨”现象,Sam Altman解释为自动切换器故障,并承诺修复,同时将恢复GPT-4o供Plus用户选择,并计划增加GPT-5的“温度”和个性化定制选项,以应对用户对模型“性格”的偏好。 (来源: 36氪, The Verge, The Verge, sama, openai, nickaturley, sama, openai, dotey, dotey, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/artificial, Reddit r/ChatGPT)

Google DeepMind 最新进展汇总 : Google DeepMind近期发布了一系列AI成果,包括最先进的世界模拟器Genie 3,向Ultra订阅用户开放的Gemini 2.5 Pro Deep Think,为大学生免费提供Gemini Pro并投入10亿美元支持美国教育,发布全球地理空间模型AlphaEarth,以及破译古文本的Aeneas模型。此外,Gemini在IMO(国际数学奥林匹克)达到金牌水平,推出带艺术和音频的故事书应用Storybook,新增Kaggle游戏竞技场LLM基准测试,异步编码Agent Jules退出Beta,英国地区上线AI搜索模式,并发布NotebookLM视频概览,Gemma模型下载量突破2亿。 (来源: demishassabis, Google, Ar_Douillard, _rockt, quocleix)

GLM-4.5 系列模型即将开源 : 智谱AI(GLM)宣布其GLM-4.5系列新模型即将开源,并透露该模型在地图搜索竞赛中,16小时内击败99%的真实玩家。此举预示着视觉模型领域的新进展,可能对地理定位和图像识别应用产生影响。社区对新模型的具体能力和开源细节表现出高度关注。 (来源: Reddit r/LocalLLaMA)

Cohere Command A Vision 发布 : Cohere团队推出了Command A Vision,这是一款最先进的生成式模型,旨在为企业提供卓越的多模态视觉任务性能,同时保持强大的文本处理能力。该模型的发布,将进一步推动企业在图像和文本结合应用中的效率和效果。 (来源: dl_weekly)

Meta V-JEPA 2 发布 : Meta AI发布了V-JEPA 2,这是一款突破性的世界模型,专注于视觉理解和预测。该模型有望在机器人技术和人工智能领域带来显著进步,因为它能帮助AI系统更好地理解和预测视觉环境,从而实现更复杂的自主行为。 (来源: Ronald_vanLoon)

OpenAI GPT-5 推出优先处理服务 : OpenAI为GPT-5引入了“优先处理”(Priority Processing)服务,允许开发者通过设置"service_tier": "priority"来获得更快的首个token生成速度。这项功能对于对毫秒级延迟敏感的应用至关重要,但需要额外付费,反映了OpenAI在优化模型服务体验和商业化方面的探索。 (来源: jeffintime, OpenAIDevs, swyx, juberti)

🧰 工具

Qwen Code 提供免费调用额度 : 阿里巴巴通义千问宣布Qwen Code每天提供2000次免费调用,国际用户通过OpenRouter可获得1000次。这一举措极大降低了开发者使用代码生成工具的门槛,有望推动基于Qwen Code的创新应用和“氛围编程”(vibe coding)的普及,使其成为AI辅助编程领域的有力竞争者。 (来源: huybery, jeremyphoward, op7418, Reddit r/LocalLLaMA)

Genie 3 探索绘画世界 : Google DeepMind的Genie 3展现了令人惊叹的能力,用户可以“走进”并探索自己喜爱的绘画作品,将其转化为可交互的3D世界。这项功能为艺术欣赏、教育和虚拟体验带来了新的维度,例如可以漫步在爱德华·霍珀的《夜游者》或雅克-路易·大卫的《苏格拉底之死》中,感受沉浸式的艺术体验。 (来源: cloneofsimo, jparkerholder, BorisMPower, francoisfleuret, shlomifruchter, _rockt, Vtrivedy10, rbhar90, fchollet, bookwormengr)

LangChain 推出 GPT-5 Playground : LangChain在其LangSmith Playground中集成了OpenAI的最新模型GPT-5(包括gpt-5、gpt-5-mini、gpt-5-nano),并内置了成本追踪功能。这为开发者提供了一个便捷的平台,可以测试和构建基于GPT-5的应用,同时监控API使用成本,有助于优化开发流程和资源管理。 (来源: LangChainAI, hwchase17)

Claude Code 助力移动热修复 : 一位开发者在Taco Bell汽车餐厅通过手机浏览器使用Claude Code,成功处理了生产环境中的紧急热修复。这展示了AI编码工具在移动场景下的强大实用性,让开发者摆脱办公桌束缚,实现随时随地进行代码调试和问题解决,提高了工作灵活性。 (来源: Reddit r/ClaudeAI)

Clode Studio 远程访问功能 : Clode Studio发布更新,新增内置Relay Server和多隧道支持,允许用户从任何设备远程访问桌面IDE,并控制Claude Code Chat。该功能提供多种隧道选项(Clode、Cloudflare、Custom),支持手机和平板触控,并确保安全认证,旨在提升远程开发体验和灵活性。 (来源: Reddit r/ClaudeAI)

LEANN: 极轻量级向量索引 : LEANN是一个创新的极轻量级向量索引,实现了在MacBook上进行快速、准确且100%私密的RAG(检索增强生成),无需互联网连接,索引文件比传统方式小97%。它能让用户在本地设备上进行语义搜索,处理邮件、聊天记录等个人数据,提供个人Jarvis般的体验。 (来源: matei_zaharia)

Qwen-Image LoRA Trainer 上线 : WaveSpeedAI平台推出了Qwen-Image LoRA Trainer,这是全球首个提供在线Qwen-Image LoRA训练器的平台。用户现在可以在几分钟内训练出自己的定制风格,极大简化了AI艺术创作的流程,提升了图像生成模型的个性化能力。 (来源: Alibaba_Qwen)

Jules 推出 Interactive Plan : Google的异步编码Agent Jules发布了Interactive Plan功能,允许Jules阅读代码库、提出澄清问题,并与用户协作完善开发计划。这种协同方法增加了用户明确目标的可能性,确保人机协作在代码生成和解决方案构建上保持一致,从而提高代码质量和可靠性。 (来源: julesagent)

Grok 4 PDF 处理能力升级 : xAI宣布Grok 4的PDF处理能力得到显著提升,现在可以无缝处理数百页的超大型PDF文件,并通过更敏锐的识别能力更好地理解PDF内容。这项升级已在Grok的网页和移动应用中上线,极大增强了用户处理和分析复杂文档的效率。 (来源: xai, Yuhu_ai_, Yuhu_ai_, Yuhu_ai_)

📚 学习

HuggingFace 推出 AI 课程 : HuggingFace发布了9门免费的AI精英级课程,涵盖LLMs、Agent和AI系统等核心主题。这些课程旨在帮助开发者和研究人员掌握前沿AI技术,降低学习门槛,推动开源AI社区的发展。 (来源: huggingface)

Attention Basin: LLM 上下文位置敏感性研究 : 一项研究揭示了大型语言模型(LLMs)对输入信息上下文位置的显著敏感性,称之为“注意力盆地”现象:模型倾向于对序列开头和结尾的信息分配更高注意力,而忽略中间部分。研究提出Attention-Driven Reranking (AttnRank)框架,通过校准模型注意力偏好并重新排序检索文档或Few-shot示例,显著提升了10个不同LLM在多跳问答和Few-shot学习任务上的性能。 (来源: HuggingFace Daily Papers)

MLLMSeg:轻量级掩码解码器提升指代表达分割 : MLLMSeg是一个新颖的框架,旨在解决多模态大模型(MLLMs)在指代表达分割(RES)任务中像素级密集预测的挑战。该框架充分利用MLLM视觉编码器中固有的视觉细节特征,并提出细节增强和语义一致的特征融合模块,结合轻量级掩码解码器,在性能和成本之间取得更好平衡,超越了现有SAM基和SAM-free方法。 (来源: HuggingFace Daily Papers)

学习推理以提高事实性 : 一项研究提出了一种新颖的奖励函数,旨在解决推理型大语言模型(R-LLMs)在长篇事实性任务中幻觉率高的问题。该奖励函数同时考虑事实准确性、响应细节水平和答案相关性,通过在线强化学习训练,使模型在六个事实性基准测试中平均幻觉率降低23.1个百分点,答案细节水平提高23%,且不影响整体响应有用性。 (来源: HuggingFace Daily Papers)

LangChain 举办 Hacking Hours : LangChain将举办“LangChain Hacking Hours”活动,提供一个专注的共同工作环境,让开发者可以在LangChain或LangGraph项目上取得实际进展,并获得团队的直接技术指导,与社区其他构建者交流。 (来源: LangChainAI)

DSPy:RAG 管道的忠实性 : 社交媒体上讨论了DSPy框架在RAG(检索增强生成)管道中保持忠实性的优势。通过DSPy,开发者可以工程化系统,使其在上下文不包含必要信息时主动输出“我不知道”,从而避免模型幻觉,并简化了提示工程的复杂性,将业务目标、模型、流程和训练数据分离。 (来源: lateinteraction, lateinteraction, lateinteraction)

AI Evals 课程洞察 : Hamel Husain分享了其AI Evals课程中的14个亮点,特别是关于检索(RAG)的突出思想。课程强调了评估在AI系统开发中的重要性,以及如何有效利用检索技术提升模型性能,尤其是在处理复杂数据和多源信息时。 (来源: HamelHusain)

Anthropic 承诺推进 AI 教育 : Anthropic加入了“Pledge to America’s Youth”倡议,与100多家组织共同致力于推进AI教育。他们将与全国范围内的教育工作者、学生和社区合作,为下一代培养必要的AI和网络安全技能,以应对未来技术发展的挑战。 (来源: AnthropicAI)

Chain-of-Thought (CoT) 推理的本质 : 关于CoT推理是否为“海市蜃楼”的讨论热议。一项研究通过数据分布视角分析,质疑CoT的真实理解能力,指出其可能过度拟合基准任务并易产生幻觉。同时,也有观点认为CoT在复杂认知任务中仍能提供有价值的信息,其“思考痕迹”在特定条件下仍具可信度。 (来源: togelius, METR_Evals, rao2z, METR_Evals, METR_Evals)

LLM 如何预测下一个词 : 社交媒体上分享了一个视频,直观地展示了大型语言模型(LLMs)如何通过预测下一个词来生成文本。这有助于用户理解LLM的基本工作原理,即通过概率分布选择最可能的下一个词,从而构建连贯且有意义的序列。 (来源: Reddit r/deeplearning)

Transformer 模型中 Q, K, V 独立投影的必要性 : 社区讨论了Transformer模型中Query (Q)、Key (K) 和 Value (V) 分别进行独立投影的原因。讨论指出,将Q和V直接绑定到输入嵌入会损失模型的表达能力和灵活性,因为独立投影允许模型在不同的语义空间中进行查询、匹配和提取信息,从而捕捉更复杂的依赖关系和多头注意力机制。 (来源: Reddit r/deeplearning)

Adaptive Classifiers: Few-Shot 学习新架构 : 一项研究提出了“Adaptive Classifiers”架构,使文本分类器能从少量样本(5-10个/类)中学习,持续适应新数据而无灾难性遗忘,并动态添加新类别而无需重新训练。该方案结合原型学习和弹性权重整合,在企业级任务中达到90-100%准确率,推理速度快,解决了数据稀缺和快速变化场景下的ML部署难题。 (来源: Reddit r/MachineLearning)

动态微调 (DFT) 提升 SFT : 一项研究提出了“动态微调”(Dynamic Fine-Tuning, DFT),通过将SFT(监督微调)重新定义为强化学习,并引入单行代码修改来稳定token更新,提升了SFT的性能。DFT在某些情况下超越了PPO、DPO、GRPO等RL方法,为模型微调提供了更高效和稳定的新途径。 (来源: TheTuringPost)

💼 商业

OpenAI GPT-5 定价策略引发价格战猜测 : OpenAI发布GPT-5,其API定价($1.25/1M输入, $10/1M输出)远低于竞争对手Anthropic Claude Opus 4.1($15/1M输入, $75/1M输出)。此举被视为“杀手锏”,可能引发LLM市场价格战。业界关注这是否是短期市场份额冲击,还是长期AI成本下降的开始,以及这将如何影响AI工具开发、商业模式和AI可及性。 (来源: Reddit r/ArtificialInteligence)

GPU 资源集中化与 AI 行业格局 : 评论指出,GPU资源的高度集中导致“GPU富裕实验室”在通用AI领域占据主导地位,开放模型难以匹敌。文章认为,2025年将是Agent和应用层之年,企业应专注于在最小LLM上构建可接受的解决方案,而非耗费巨资训练大型模型,这反映了AI行业从模型训练到应用落地的战略转变。 (来源: Reddit r/artificial)

AI 公司股权交易乱象 : 社交媒体上揭示了AI实验室股权交易中的“底层掠食者”和“骗子”现象。这些多层SPV(特殊目的实体)经纪人与公司本身没有直接关系,却从事欺诈行为,提醒投资者和公众警惕AI领域日益增长的非理性繁荣和潜在风险。 (来源: saranormous)

🌟 社区

GPT-5 发布引发用户强烈反响与争议 : OpenAI发布GPT-5后,引发了社区的广泛讨论。部分用户对GPT-5的性能(尤其在编程和创意写作方面)表示失望,认为其不如GPT-4o或Claude Code,甚至出现“倒退”的感觉,并对OpenAI的“自动切换器”功能、模型透明度、以及Plus用户使用限制的调整表示不满。许多用户表达了对GPT-4o“个性”和“情感”的怀念,认为其不仅是工具,更是“朋友”或“伙伴”,甚至发起请愿要求OpenAI恢复4o选项。Sam Altman回应称,公司低估了用户对4o“个性”的偏好,并承诺将恢复4o供Plus用户选择,同时改进GPT-5的“温度”和个性化定制功能,并解释了发布初期因技术故障导致模型表现不佳的情况。 (来源: maithra_raghu, teortaxesTex, teortaxesTex, teortaxesTex, SebastienBubeck, SebastienBubeck, shaneguML, OfirPress, cloneofsimo, TheZachMueller, scaling01, Smol_AI, natolambert, teortaxesTex, Vtrivedy10, tokenbender, ClementDelangue, TheZachMueller, TomLikesRobots, METR_Evals, Ronald_vanLoon, teortaxesTex, teortaxesTex, scaling01, scaling01, scaling01, scaling01, scaling01, scaling01, scaling01, scaling01, scaling01, scaling01, Teknium1, Teknium1, Teknium1, [Teknium1](https://x.com/Teknium1/status