关键词:Gemini模型, Mistral AI, NVIDIA NeMo, LTX-Video, Safari浏览器, RTX 5060, AI Agent, 强化学习微调, Gemini原生图像生成, Mistral Medium 3编程性能, NeMo框架2.0模块化, DiT实时视频生成, AI驱动搜索改造

🔥 聚焦

谷歌Gemini原生图像生成功能升级,提升视觉质量与文本渲染准确性: 谷歌宣布其Gemini模型的原生图像生成功能迎来重要更新,新版本“gemini-2.0-flash-preview-image-generation”在Google AI Studio和Vertex AI上线。此次升级显著提升了图像的视觉质量和文本渲染的准确性,并降低了延迟。新功能支持图像元素融合、实时编辑(如添加物体、修改局部内容)以及与Gemini 2.0 Flash结合实现AI自主构思并生成图像。用户可在Google AI Studio免费试用,API调用价格为每张图片0.039美元。尽管进步显著,部分用户认为其整体效果仍略逊于GPT-4o。 (来源: 量子位)

Mistral AI发布Mistral Medium 3,主打编程与多模态,成本大幅降低: 法国AI初创公司Mistral AI推出了其最新的多模态模型Mistral Medium 3。该模型在编程和STEM任务上表现突出,据称在多种基准测试中性能达到或超越Claude Sonnet 3.7的90%,而成本仅为其1/8(输入0.4美元/百万token,输出2美元/百万token)。Mistral Medium 3具备混合部署、定制化后期训练以及与企业工具集成等企业级能力,并已在Mistral La Plateforme和Amazon Sagemaker上线,未来将登陆更多云平台。同时,Mistral AI还推出了面向企业的聊天机器人服务Le Chat Enterprise。 (来源: 量子位)

NVIDIA NeMo框架2.0发布,增强模块化与易用性,支持Hugging Face模型与Blackwell GPU: NVIDIA NeMo框架更新至2.0版本,核心改进包括采用Python配置取代YAML,提升灵活性;通过PyTorch Lightning的模块化抽象简化实验与定制;并利用NeMo-Run工具实现大规模实验的无缝扩展。新版本增加了对Hugging Face AutoModelForCausalLM模型的预训练和微调支持,并已初步支持NVIDIA Blackwell B200 GPU。此外,NeMo框架还整合了对NVIDIA Cosmos世界基础模型平台的支持,用于加速物理AI系统的世界模型开发,包括视频处理库NeMo Curator和Cosmos tokenizer。 (来源: GitHub Trending)

Lightricks发布LTX-Video:实时DiT视频生成模型: Lightricks公司开源了LTX-Video,号称首款基于Diffusion Transformer (DiT) 的实时视频生成模型。该模型能够以30FPS生成1216×704分辨率的高质量视频,支持文本到图像、图像到视频、关键帧动画、视频扩展、视频到视频转换等多种功能。最新版本13B v0.9.7提升了提示词遵循度和物理理解能力,并推出了用于快速高质量渲染的多尺度视频管线。模型已在Hugging Face上提供,并有ComfyUI和Diffusers集成。 (来源: GitHub Trending)

苹果考虑Safari浏览器重大改造,或转向AI驱动搜索,与谷歌合作关系受关注: 苹果公司高级副总裁埃迪·库在美国司法部对谷歌的反垄断案中作证时透露,苹果正积极考虑改造Safari浏览器,重点转向AI驱动的搜索引擎。他指出Safari搜索量首次下滑,部分原因是用户转向OpenAI、Perplexity AI等AI工具。苹果已与Perplexity AI进行过磋商,并可能将更多AI搜索选项引入Safari。此举可能影响苹果与谷歌每年价值约200亿美元的默认搜索引擎协议,并对两家公司的股价产生影响。苹果已在Siri中集成ChatGPT,并计划加入谷歌Gemini。 (来源: 36氪)

🎯 动向

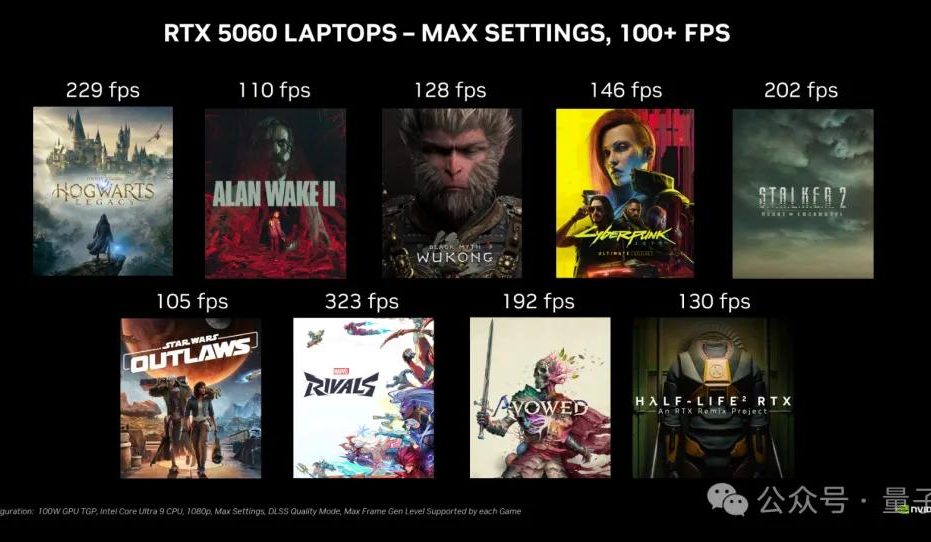

英伟达RTX 5060桌面显卡将于5月20日发售,国内定价2499元: 英伟达宣布RTX 5060桌面显卡将于北京时间5月20日开售,国内售价2499元。该卡采用Blackwell RTX架构,拥有3840个CUDA核心,8GB GDDR7显存,总功率145W。官方称,在支持DLSS 4多帧生成技术的游戏中,其性能是RTX 4060的两倍,目标是让用户以100 FPS以上的帧率运行游戏。评测解禁与销售将在同一天进行。 (来源: 量子位)

谷歌Gemini API推出隐式缓存功能,可节省75%成本: 谷歌宣布为其Gemini API推出了隐式缓存功能。当用户的请求命中缓存时,使用Gemini 2.5模型的成本可自动节省75%。同时,触发缓存所需的最小token数也已降低,Gemini 2.5 Flash降至1K tokens,Gemini 2.5 Pro降至2K tokens。此功能旨在降低开发者使用Gemini API的成本,无需显式创建缓存。 (来源: matvelloso, demishassabis, algo_diver, jeremyphoward)

Meta FAIR任命Rob Fergus为新负责人,聚焦高级机器智能(AGI): Meta宣布Rob Fergus将接任领导其基础AI研究(FAIR)团队。Yann LeCun表示,FAIR将重新聚焦于高级机器智能,即通常所说的人类水平AI或AGI。此消息受到AI研究社区的广泛关注和祝贺。 (来源: ylecun, Ar_Douillard, soumithchintala, aaron_defazio, sainingxie)

OpenAI推出o4-mini模型的强化学习微调(RFT)功能: OpenAI宣布其o4-mini模型现已支持强化学习微调(RFT)。该技术自去年12月开始研发,利用思维链推理和任务特定评分来提高模型性能,尤其适用于复杂领域。Ambience公司使用RFT调优的模型在ICD-10编码准确性上比专家临床医生高出27%。Harvey公司也通过RFT训练模型以提高法律任务中引文的准确性。同时,OpenAI最快最小的模型4.1-nano也已开放微调。 (来源: stevenheidel, aidan_mclau, andrwpng, teortaxesTex, OpenAIDevs, OpenAIDevs)

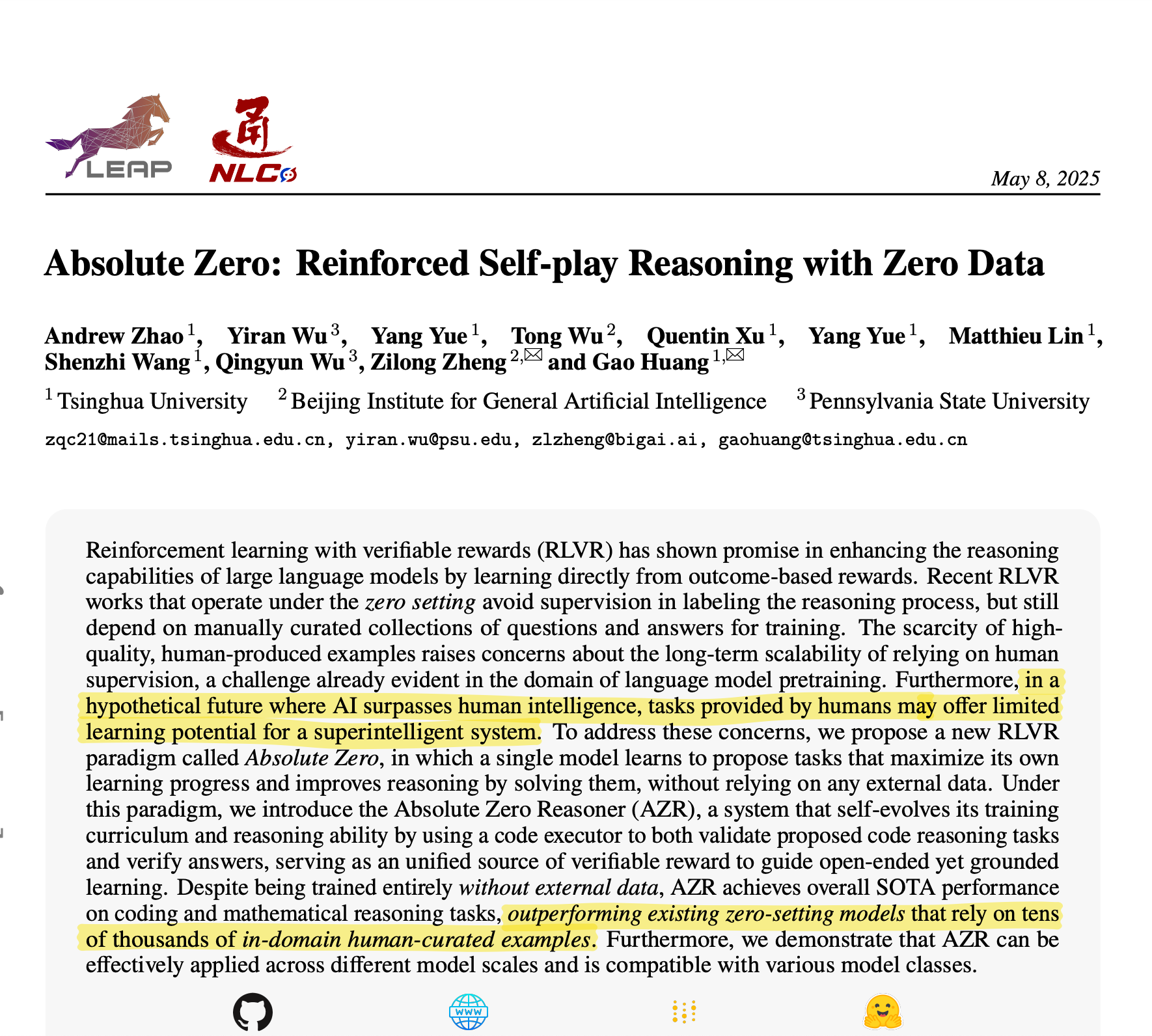

清华大学提出Absolute Zero Reasoner:AI自生成训练数据实现卓越推理: 清华大学团队研发出名为Absolute Zero Reasoner的AI模型,该模型能完全通过自我博弈(self-play)生成训练任务并从中学习,无需任何外部数据。在数学和编码等领域,其表现已超越依赖专家人工策划数据训练的模型。这一成果可能意味着AI发展中数据瓶颈问题将得到缓解,为通往AGI开辟新路径。 (来源: corbtt)

Meta与NVIDIA合作,通过cuVS增强Faiss GPU向量搜索性能: Meta和NVIDIA宣布合作,将NVIDIA的cuVS(CUDA Vector Search)集成到Meta的开源相似性搜索库Faiss v1.10中,以大幅提升GPU上的向量搜索性能。此次集成使得IVF索引的构建时间提升高达4.7倍,搜索延迟降低多达8.1倍;图索引方面,CUDA ANN Graph (CAGRA) 的构建时间比CPU HNSW快12.3倍,搜索延迟降低4.7倍。 (来源: AIatMeta)

谷歌AI Studio和Firebase Studio集成Gemini 2.5 Pro: 谷歌宣布已将Gemini 2.5 Pro模型集成到Gemini Code Assist(个人版)和Firebase Studio中。这将为开发者在这些平台中使用顶级编码模型提供更多便利和强大功能,旨在提升编码效率和体验。 (来源: algo_diver)

微软Copilot推出Pages功能,支持内联编辑和文本高亮: 微软Copilot新增“Pages”功能,允许用户直接在Copilot界面内联编辑AI生成的回复,可以高亮文本并提出具体修改需求。此功能旨在帮助用户更快速、智能地将问题和研究成果转化为可用的文档,提升工作效率。 (来源: yusuf_i_mehdi)

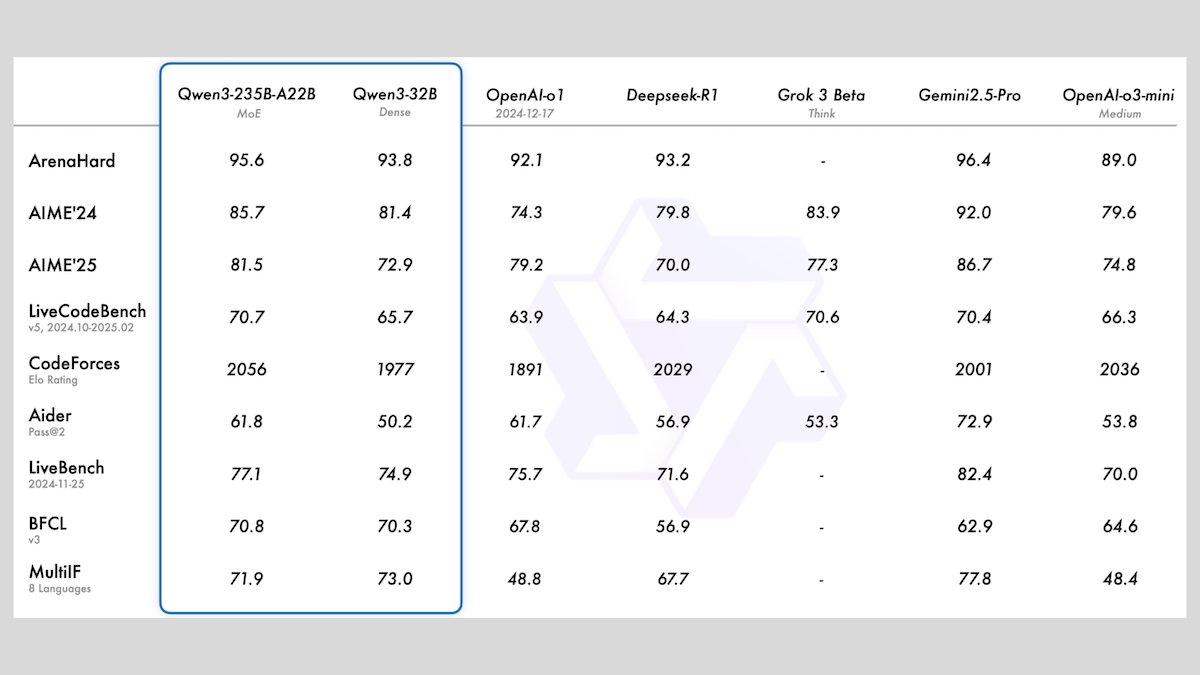

阿里巴巴推出Qwen3系列模型,包含8款开源大语言模型: 阿里巴巴发布了Qwen3系列,包括8款开源大语言模型,其中有2款混合专家(MoE)模型和6款参数范围从0.6B到32B的密集模型。所有模型均支持可选的推理模式和119种语言的多语言能力。Qwen3-235B-A22B和Qwen3-30B-A3B在推理、编码和函数调用任务上表现优异,可与OpenAI等顶尖模型媲美,尤其Qwen3-30B-A3B因其强大性能和本地运行能力而备受关注。 (来源: DeepLearningAI)

Meta推出Meta Locate 3D模型,用于精确3D环境对象定位: Meta AI发布了Meta Locate 3D,这是一个专为在3D环境中精确定位对象而设计的模型。该模型旨在帮助机器人更准确地理解周围环境,并与人类进行更自然的交互。Meta已提供模型、数据集、研究论文以及一个演示供公众使用和体验。 (来源: AIatMeta)

谷歌发布新报告,阐述如何利用AI打击网络诈骗: 谷歌发布了一份关于其如何利用人工智能技术打击搜索引擎、Chrome浏览器和安卓系统中的网络诈骗的新报告。报告详细介绍了谷歌十多年来在利用AI保护用户免受在线欺诈方面的努力和最新进展,强调了AI在识别和阻止诈骗行为中的关键作用。 (来源: Google)

Cohere推出Embed 4嵌入模型,强化AI搜索与检索能力: Cohere发布了其最新的嵌入模型Embed 4,旨在革新企业数据访问和利用方式。Embed 4作为Cohere迄今最强大的嵌入模型,专注于提升AI搜索和检索的准确性与效率,帮助组织从其数据中解锁隐藏价值。 (来源: cohere)

谷歌宣布Google I/O大会将于5月20日举行: 谷歌官方宣布,其年度开发者大会Google I/O将于5月20日举行,并已开放注册。届时将进行主题演讲、发布新产品和技术公告,预计AI将是核心议题之一。 (来源: Google)

NVIDIA Parakeet模型创音频转录新纪录:1秒转录60分钟音频: NVIDIA的Parakeet模型在音频转录方面取得突破,能够在1秒内转录长达60分钟的音频,并在Hugging Face相关排行榜上名列前茅。这一成就展示了NVIDIA在语音识别技术方面的领先地位,并为开发者提供了高效的音频处理工具。 (来源: huggingface)

🧰 工具

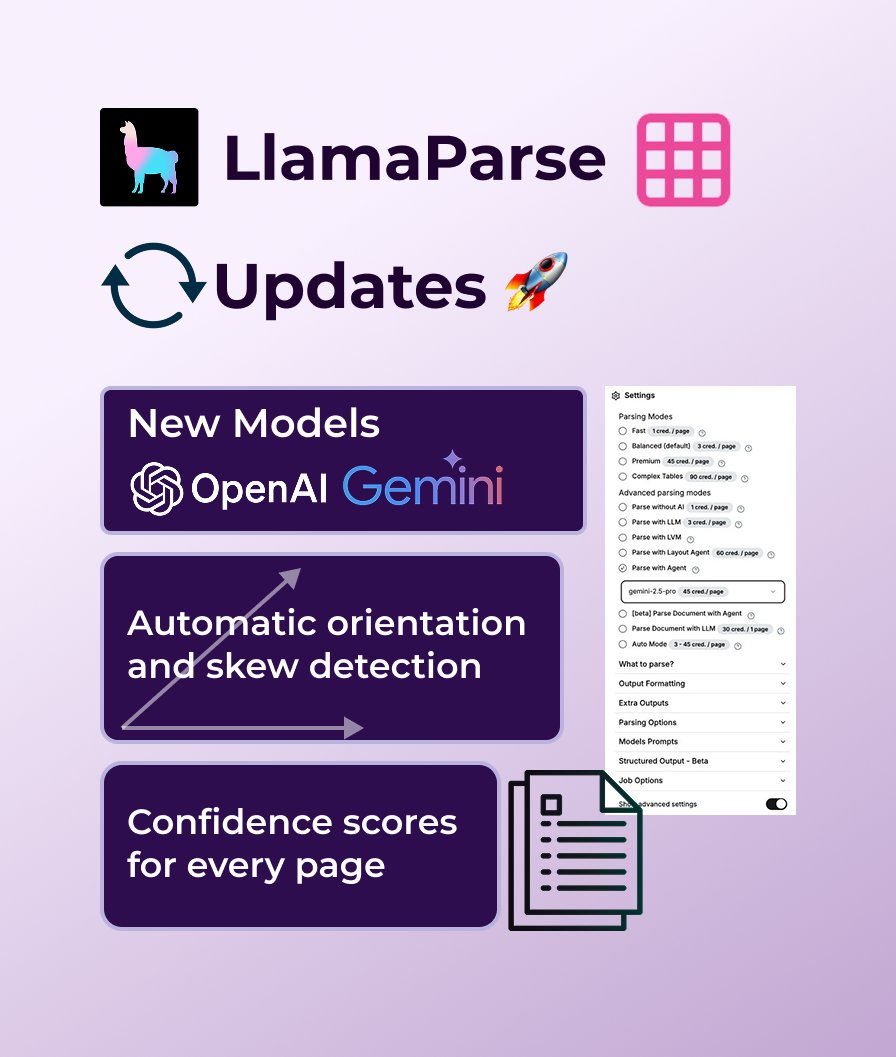

LlamaParse新增GPT 4.1和Gemini 2.5 Pro支持,强化文档解析能力: LlamaParse近期进行了一系列功能更新,包括引入新的解析模型GPT 4.1和Gemini 2.5 Pro以提升准确性。此外,新版本增加了自动方向和倾斜检测功能,确保完美对齐解析;提供置信度分数以评估解析质量;并允许用户自定义错误容忍度和处理失败页面的方式。LlamaParse提供每月10,000页的免费额度。 (来源: jerryjliu0)

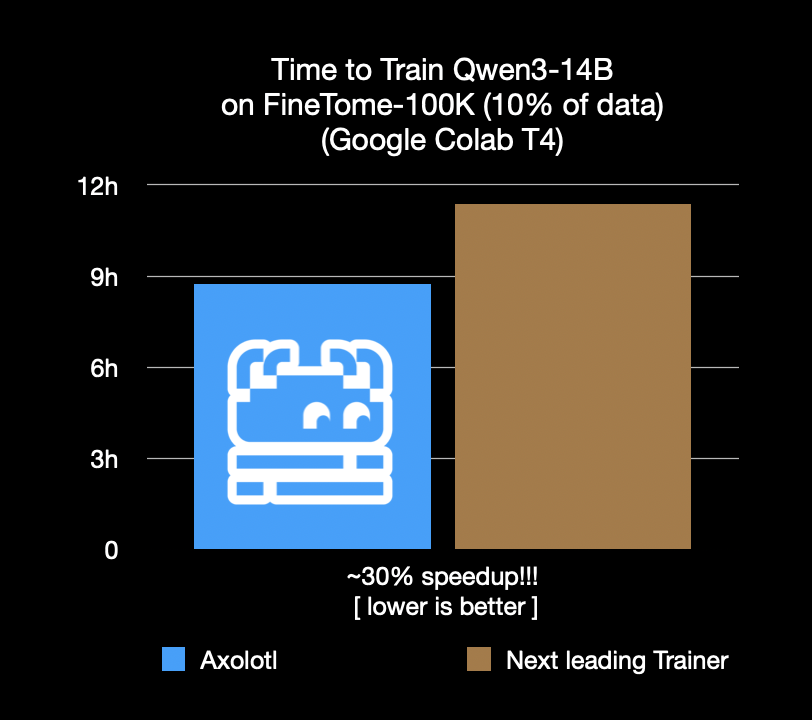

Axolotl微调框架提速30%,节省成本与时间: Axolotl微调框架宣布在FineTome-100k等真实工作负载上,其速度比次优框架快30%。对于中大型机器学习团队而言,这意味着每月可节省数千美元的成本。该框架的优化旨在帮助用户更高效、经济地进行模型微调。 (来源: Teknium1, winglian, maximelabonne)

Runway推出动画试播集《Mars & Siv: No Vacancy》,展示Gen-4模型能力: Runway旗下AI工作室推出了动画试播集《Mars & Siv: No Vacancy》,由Jeremy Higgins和Britton Korbel创作。该作品展示了Runway的Gen-4模型在动画制作流程中各个环节的应用,从概念到最终成品,突显了AI在创意内容生成方面的潜力。 (来源: c_valenzuelab, c_valenzuelab)

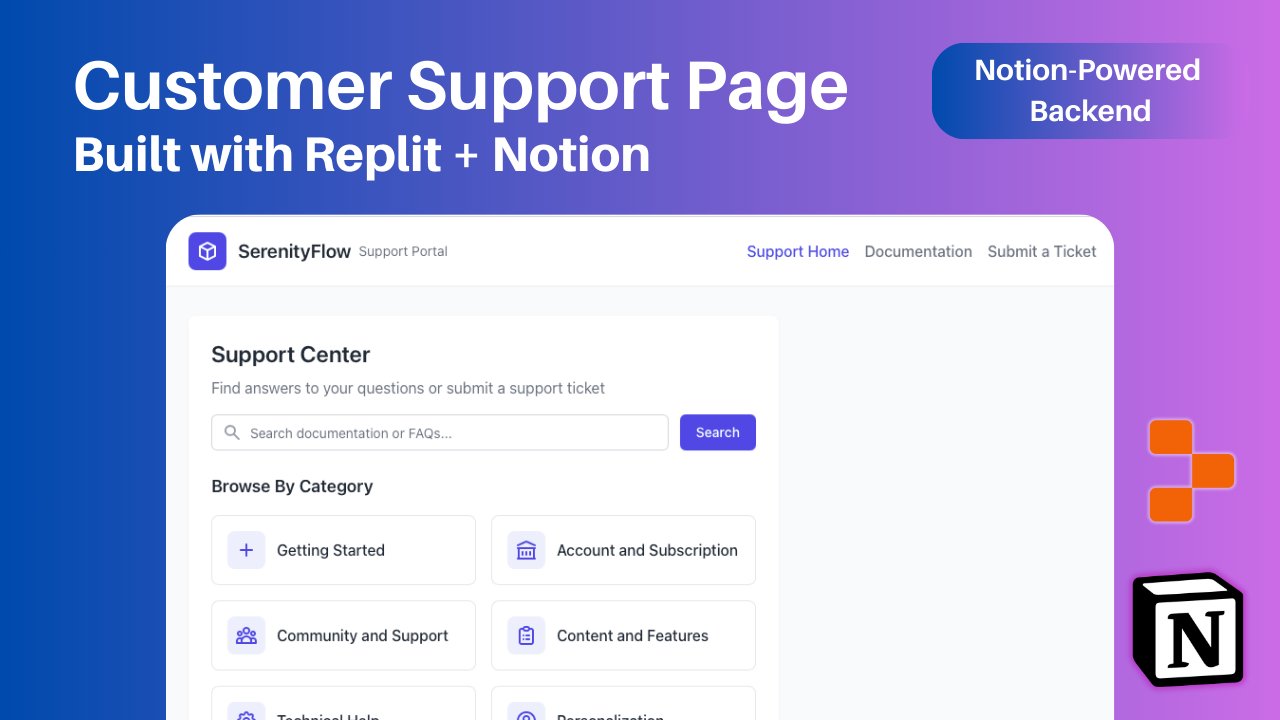

Replit新增Notion集成,支持将Notion内容作为应用后端: Replit宣布与Notion达成新的集成合作,允许开发者将Notion作为其应用程序的后端。用户可以将Notion数据库连接到Replit项目,用于展示FAQ、驱动基于文档的自定义AI聊天机器人,并将支持工单记录回Notion。此举旨在结合Notion的后端组织能力和Replit的灵活前端创建能力。 (来源: amasad, amasad, pirroh)

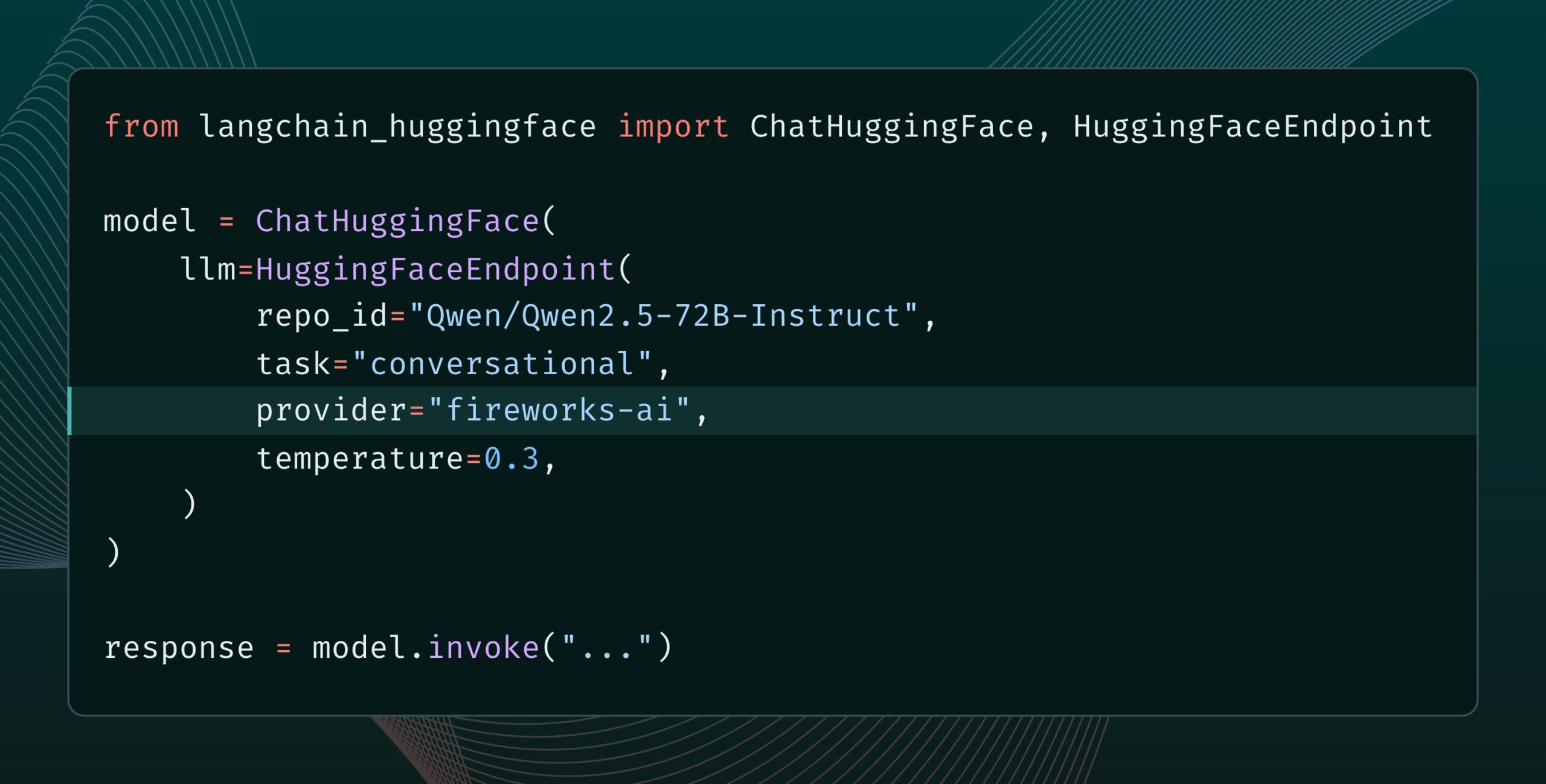

Langchain-huggingface v0.2发布,支持HF Inference Providers: Langchain-huggingface发布了v0.2版本,新版本增加了对Hugging Face Inference Providers的支持。这一更新将使得在LangChain生态中使用Hugging Face提供的推理服务更加便捷。 (来源: LangChainAI, huggingface, ClementDelangue, hwchase17, Hacubu)

smolagents 1.15发布,增加流式输出功能: AI代理框架smolagents发布1.15版本,引入了流式输出(streaming outputs)功能。用户在初始化CodeAgent时设置stream_outputs=True即可启用,这将使得所有交互过程感觉更加流畅。 (来源: huggingface, AymericRoucher, ClementDelangue)

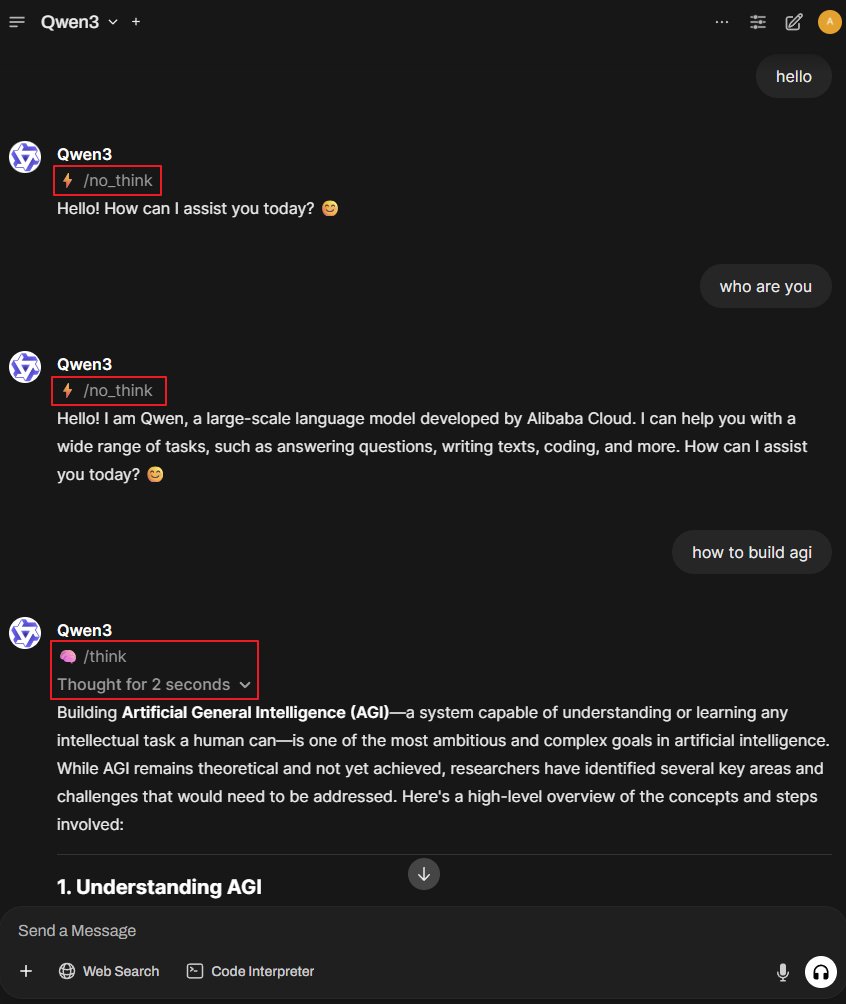

Better-Qwen3项目:让Qwen3模型自动切换思考模式: 一个名为Better-Qwen3的GitHub项目受到关注,该项目旨在让Qwen3模型能够根据用户提问的复杂度自动控制是否开启“思考模式”。对于简单问题,模型将直接回答;对于复杂问题,则会自动进入思考模式,以提供更深入的回答。项目地址:http://github.com/AaronFeng753/Better-Qwen3 (来源: karminski3, Reddit r/LocalLLaMA)

MLX-Audio:基于Apple MLX框架的TTS/STT/STS库: MLX-Audio是一个专为苹果芯片(Apple Silicon)打造的文本转语音(TTS)、语音转文本(STT)和语音转语音(STS)库,基于Apple的MLX框架开发,旨在提供高效的语音处理能力。该库支持多种语言、声音定制、语速控制,并提供交互式Web界面和REST API。 (来源: GitHub Trending)

Runway References模型支持图像扩展(Outpainting)功能: Runway的References模型现已支持图像扩展(outpainting)功能。用户只需在References中放置一张图片,选择所需的输出格式,将提示词留空,然后点击生成,即可对原始图像进行扩展。这一功能进一步增强了Runway在图像编辑和创作方面的能力。 (来源: c_valenzuelab)

Docker2exe:将Docker镜像转换为可执行文件: Docker2exe是一款可以将Docker镜像转换为独立可执行文件的工具,方便用户分享和运行。它支持嵌入模式,即将Docker镜像的tarball直接打包进可执行文件中。当在目标设备上运行时,如果本地没有对应的Docker镜像,它会自动加载嵌入的镜像或从网络拉取。 (来源: GitHub Trending)

Smoothie Qwen:平滑Qwen模型Token概率以平衡多语言生成: Smoothie Qwen是一个轻量级调整工具,通过平滑Qwen模型中的Token概率,旨在增强模型在多语言生成时的平衡性,减少对特定语言(如中文)的意外偏向,同时保持核心性能。该工具利用Unicode范围识别Token,进行N-gram分析,并调整lm_head中的Token权重。预调整模型已在Hugging Face上提供。 (来源: Reddit r/LocalLLaMA)

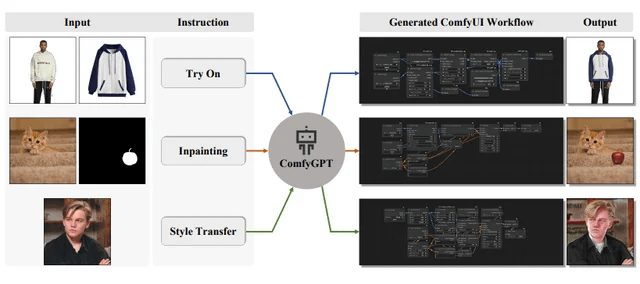

ComfyGPT:自优化多智能体系统生成ComfyUI工作流: 一篇名为《ComfyGPT: A Self-Optimizing Multi-Agent System for Comprehensive ComfyUI Workflow Generation》的论文被提交到arXiv,介绍了一个名为ComfyGPT的系统。该系统利用自优化的多智能体方法,旨在全面地生成ComfyUI的工作流程,简化复杂图像生成流程的构建。 (来源: Reddit r/LocalLLaMA)

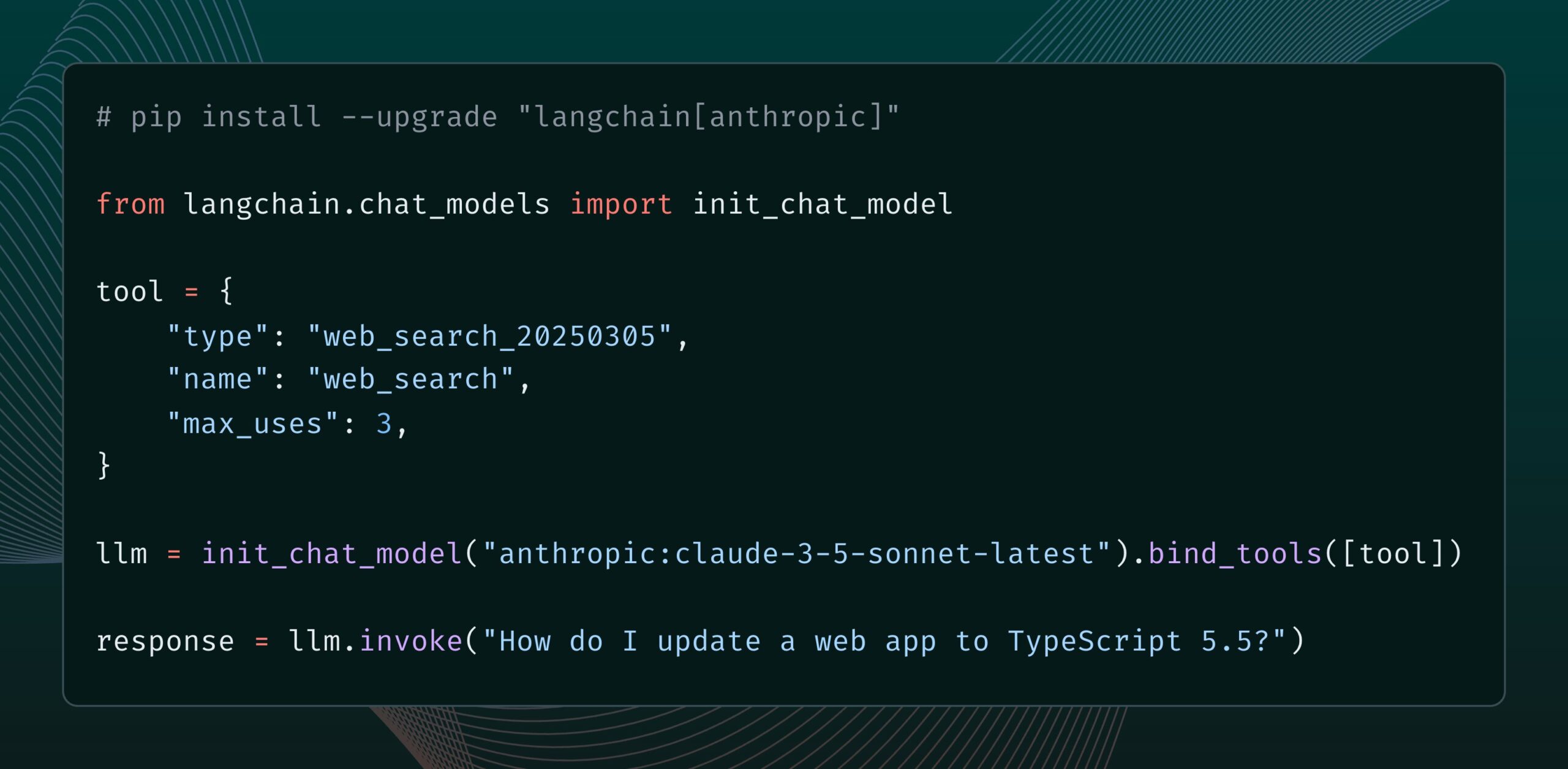

Anthropic Claude模型新增网页搜索工具: Anthropic为其Claude模型发布了一款新的网页搜索工具。该工具允许Claude在生成回复时进行网络搜索,并将搜索结果作为依据,提供带有引用的回答。这一功能已集成到langchain-anthropic库中,增强了Claude获取和利用实时信息的能力。 (来源: LangChainAI, hwchase17)

Glass Health推出Workspace功能,利用AI辅助临床诊断与治疗规划: Glass Health发布了新的Workspace功能,该功能允许临床医生使用AI更有效地完成复杂的诊断推理、治疗计划制定和文档记录工作流程。此举旨在通过AI技术提升医疗工作的效率和质量。 (来源: GlassHealthHQ)

OpenWebUI新增AI增强笔记与会议录音功能: OpenWebUI的最新版本加入了AI增强笔记功能,用户可以创建笔记、附加会议或语音音频,并让AI利用音频转录来即时增强、总结或优化笔记。此外,还支持会议音频录制和导入功能,方便用户回顾和提取重要讨论信息。 (来源: Reddit r/OpenWebUI)

📚 学习

联合国发布200页AI与全球人类发展报告: 联合国开发计划署(UNDP)发布了一份长达200页的报告,从全球人类发展的视角审视人工智能。该报告探讨了AI对可持续发展目标、不平等、治理以及未来工作等多方面的影响,并提出政策建议。报告因其观点鲜明而受到关注。 (来源: random_walker)

The Turing Post发布Agent2Agent (A2A)协议深度解读文章: 鉴于社区对AI Agent间通信协议的浓厚兴趣,The Turing Post在Hugging Face上免费发布了其关于Google A2A协议的深度解读文章。文章探讨了A2A协议的重要性(旨在打破AI Agent孤岛,实现协作)、潜在应用(如专业Agent团队协作、跨企业工作流、人机协作标准化、可搜索的Agent目录)以及其工作原理和入门方法。 (来源: TheTuringPost, TheTuringPost, TheTuringPost, dl_weekly)

提示词工程师分享:如何轻松写出好用的提示词模板: 提示词工程师dotey分享了创建高效提示词模板的三步骤方法:1. 收集同一风格但不同主题的提示词;2. 找出共同点和差异点(可借助AI);3. 反复测试与优化。他强调,好的模板类似程序中的函数,通过少量修改变量即可生成不同结果。他还分享了利用AI快速生成新提示词的指令模板,并指出并非所有风格都适合模板化,复杂细节多的主题仍需个性化优化。 (来源: dotey)

DeepMind研究员John Jumper团队招聘,扩展基于LLM的科学发现: Google DeepMind的研究员John Jumper宣布其团队正在招聘多个职位,以扩展在基于大语言模型(LLM)的科学发现方面的工作。招聘的职位包括研究科学家(RS)和研究工程师(RE),旨在推动自然语言科学AI的未来。 (来源: demishassabis, NandoDF)

Ragas博客分享两年AI应用改进经验: Shahules786在Ragas博客上发表文章,总结了过去两年与AI团队紧密合作、交付评估循环和改进LLM系统的经验教训。文章旨在为构建和优化AI应用的从业者提供实用的指导和见解。 (来源: Shahules786)

Kyunghyun Cho探讨LLM时代机器学习研究生课程教学方法: 纽约大学教授Kyunghyun Cho分享了他在当前LLM和大规模计算时代下,关于一年级机器学习研究生课程教学内容的思考和实验。他提出教授所有接受SGD(随机梯度下降)且非LLM的内容,并引导学生阅读经典论文。 (来源: ylecun, sainingxie)

智能文档处理(IDP)排行榜发布,统一评估VLM文档理解能力: 一个新的智能文档处理(IDP)排行榜上线,旨在为OCR、KIE、VQA、表格提取等多种文档理解任务提供统一的基准测试。该排行榜覆盖6个核心IDP任务、16个数据集和9229份文档。初步结果显示,Gemini 2.5 Flash总体领先,但所有模型在长文档理解方面均表现不佳,表格提取仍是瓶颈。GPT-4o最新版性能甚至有所下降。 (来源: Reddit r/MachineLearning, Reddit r/LocalLLaMA)

LangGraph推出Cron Jobs功能,支持定时触发AI代理: LangChain的LangGraph平台新增了Cron Jobs功能,允许用户设置定时任务来自动触发AI代理的运行。这一功能使得AI代理可以根据预设的时间表执行任务,适用于需要周期性处理或监控的场景。 (来源: hwchase17)

💼 商业

AI软件调试工具Lightrun获7000万美元B轮融资,Accel和Insight Partners领投: AI软件可观测性和调试工具开发商Lightrun宣布完成7000万美元B轮融资,由Accel和Insight Partners领投,花旗集团等跟投,累计融资额达1.1亿美元。其核心产品Runtime Autonomous AI Debugger能在IDE中精确定位问题代码并提供修复建议,旨在将调试时间从数小时缩短至几分钟。该公司2024年收入增长4.5倍,客户包括花旗、微软等财富500强企业。 (来源: 36氪)

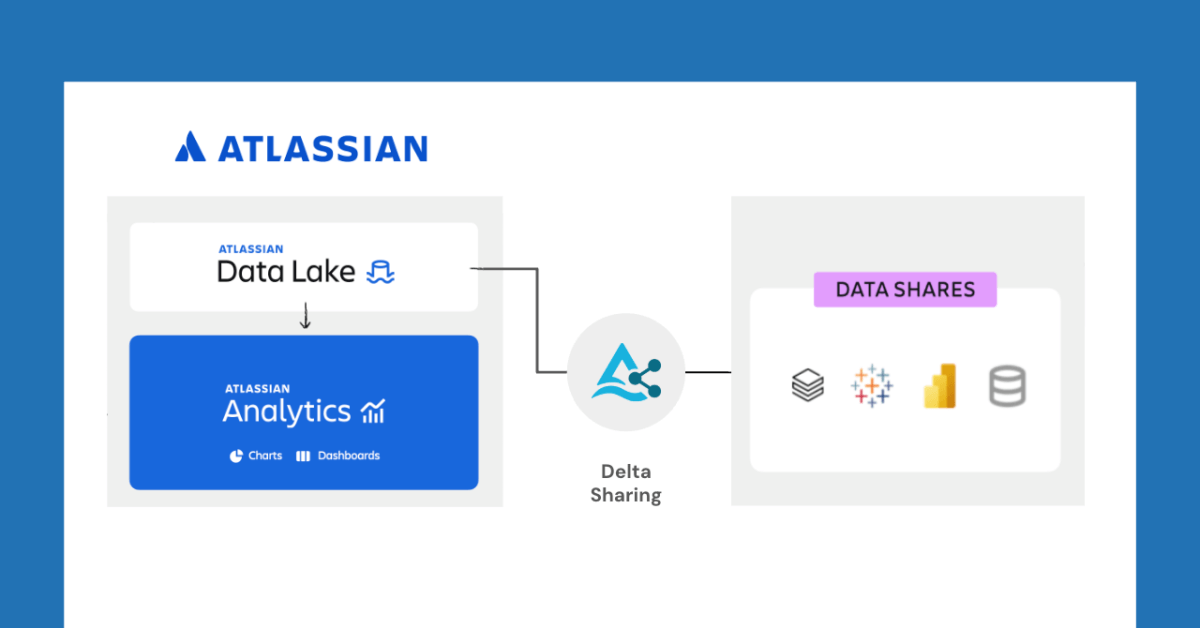

Databricks与Atlassian合作,通过Delta Sharing解锁数据共享新功能: Databricks宣布与Atlassian合作,为Atlassian Analytics带来新的数据共享能力。通过Delta Sharing的开放协议,Atlassian客户可以使用自选工具安全地访问和分析其在Atlassian Data Lake中的数据。此功能支持BI集成、自定义数据工作流、跨团队协作等用例。 (来源: matei_zaharia)

Fastino获1750万美元融资,专注任务特定语言模型(TLM): 初创公司Fastino宣布获得由Khosla Ventures领投的1750万美元(总计2500万美元预种子轮)融资,用于开发其创新的任务特定语言模型(TLM)。Fastino称其TLM架构小巧且针对特定任务,可在低端游戏GPU上训练,成本效益高。TLM通过在架构、预训练和后训练层面进行任务专业化,消除参数冗余和架构低效,旨在提高特定任务的准确性,并能嵌入对延迟和成本敏感的应用中。 (来源: Reddit r/MachineLearning)

🌟 社区

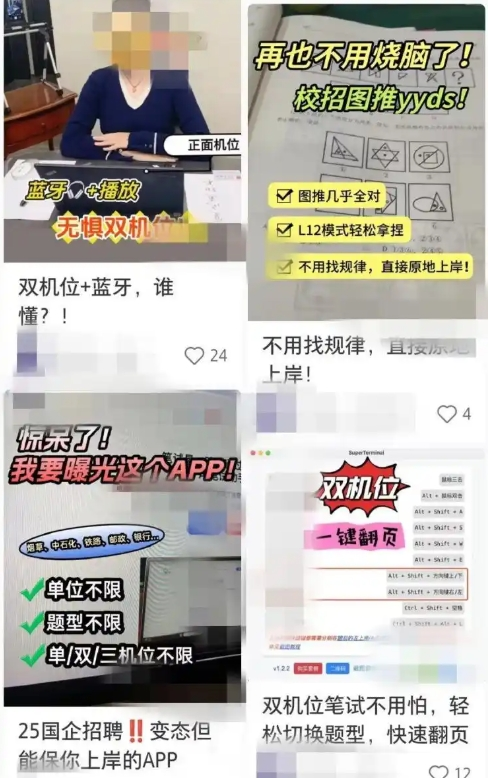

AI辅助求职工具引发作弊担忧,企业加强反制措施: 近期,利用AI工具辅助线上面试和笔试的现象增多,这类“AI面试神器”能根据用户简历定制答案,帮助应聘者在求职中获得优势。此类软件获取门槛低,甚至提供多档付费套餐和远程指导。这一趋势可追溯至“Interview Coder”等早期AI作弊工具的出现。企业方面已开始采取反制措施,如关注求职者面试时的异常行为、考虑引入屏幕检测或恢复线下面试。律师指出,使用AI作弊涉嫌违反诚信原则,可能导致劳动合同解除,并存在隐私泄露风险。 (来源: 36氪)

LangChain CEO Harrison Chase提出“环境智能体”与“智能体收件箱”概念: LangChain CEO Harrison Chase在红杉AI Ascent活动上分享了他对AI智能体未来发展的看法,提出了“环境智能体”(Ambient Agents)和“智能体收件箱”(Agent Inbox)的概念。环境智能体指能在后台持续运行、响应事件而非直接人类指令的AI系统,而智能体收件箱则是一种新的人机交互界面,用于管理和监督这些智能体的活动。 (来源: hwchase17, hwchase17, hwchase17)

Jim Fan提出“物理图灵测试”作为AI新北极星: NVIDIA科学家Jim Fan在红杉AI Ascent活动上提出了“物理图灵测试”的概念,将其视为AI领域的下一个“北极星”。该测试设想了一个场景:周日黑客马拉松后家中一片狼藉,周一晚上回家时发现客厅一尘不染,并准备好了烛光晚餐,而你无法分辨这是人类还是机器所为。他认为这是通用机器人技术的目标,并分享了解决该问题的首要原则,包括数据策略和规模法则。 (来源: DrJimFan, killerstorm)

AI模型评估面临危机,EvalEval联盟呼吁改进: 针对当前AI模型评估方法存在的不足,如基准饱和、缺乏科学严谨性等问题,EvalEval联盟被提及,旨在联合关心评估现状的人士,共同致力于改进评估报告、解决饱和问题、提升评估科学性及基础设施等。相关讨论认为,应更关注评估的有效性。 (来源: ClementDelangue)

Reddit热议:构建LLM工作流的观察与经验: 一位开发者在Reddit上分享了过去一年构建复杂LLM工作流的经验总结。关键点包括:任务分解至最小步骤并链式调用提示词优于单一复杂提示词;使用XML标签构建提示词结构效果更佳;需明确告知LLM其角色仅为语义解析和转换,不应引入自身知识;利用NLTK等传统NLP库验证LLM输出;小型任务上微调的BERT类分类器常优于LLM;LLM作为裁判或进行置信度评分不可靠,尤其在缺乏明确评分标准时;Agentic循环中,LLM决定退出循环的条件设置是难点;性能通常在输入上下文窗口超过4K Token后下降;32B模型在结构化任务中已足够;结构化CoT优于非结构化;自写CoT优于依赖推理模型;长期目标是微调所有组件,并注意构建平衡的微调数据集。 (来源: Reddit r/LocalLLaMA)

Reddit用户讨论Claude Sonnet 3.7系统提示词设置: Reddit r/ClaudeAI社区的用户反映Claude Sonnet 3.7模型在遵循指令、代码修复和上下文记忆方面存在不稳定性,并征集有效的系统提示词。有用户分享了模仿Sonnet 3.5行为的提示词,以及强调高效、实用解决方案、遵循核心计算机科学原则(如DRY, KISS, SRP)的详细指令。还有用户建议通过让Claude自行重写和优化系统提示词来提升效果,或使用简洁明了的单行指令。 (来源: Reddit r/ClaudeAI)

关于LLM微调所需Epoch数量的讨论: 在Reddit r/MachineLearning上,有用户针对Deepseek R1论文中仅用2个Epoch微调Deepseek-V3-Base模型(约80万样本)提出疑问,探讨了损失函数之外,决定微调Epoch数量的指标,如评估数据表现和数据质量。 (来源: Reddit r/MachineLearning)

💡 其他

François Chollet:构建坚实的思维模型是解决难题的前提: AI思想家François Chollet强调,建立清晰、自洽的思维模型是创造性解决难题(而非依赖运气)的先决条件,这与快速解决简单问题的能力不同。他认为优雅是表现力与简洁性的结合,与压缩密切相关。 (来源: fchollet, teortaxesTex, fchollet, pmddomingos)

Replit CEO Amjad Masad:AI Agent将是编程新浪潮: Replit的CEO及联合创始人Amjad Masad在The Turing Post的采访中表示,他始终认为AI Agent将引领编程的下一波浪潮。他分享了从教授编程到构建能自动编程的Agent的转变思路。他提到软件Agent已在实际业务中产生效果,例如帮助房地产企业优化线索分配算法,提升10%转化率。他认为未来的十亿美元初创可能由AI增强的独立创始人打造,并探讨了实现这一愿景所需条件、编程领域的现状与未来、Replit的愿景演变以及AGI和开源的重要性。 (来源: TheTuringPost, TheTuringPost)

LazyVim:为“懒人”打造的Neovim配置: LazyVim是一个基于lazy.nvim的Neovim配置方案,旨在让用户轻松定制和扩展其Neovim环境。它提供了一套预配置的、功能丰富的IDE般体验,同时保持了高度的灵活性,用户可以根据需要进行调整。 (来源: GitHub Trending)